多标记学习算法的简要概述

2019-09-10李星星

李星星

摘要:在如今的机器学习领域内,不再是简单的单标记算法,其对象(样本)具有多个语义(多个类标)。像这样的样本数据可看作为多标记数据样本,所对应的学习方法称之为多标记学习(Multi-label learning)法。

关键词:机器学习;单标记学习;多标记学习

一、多标记学习概述

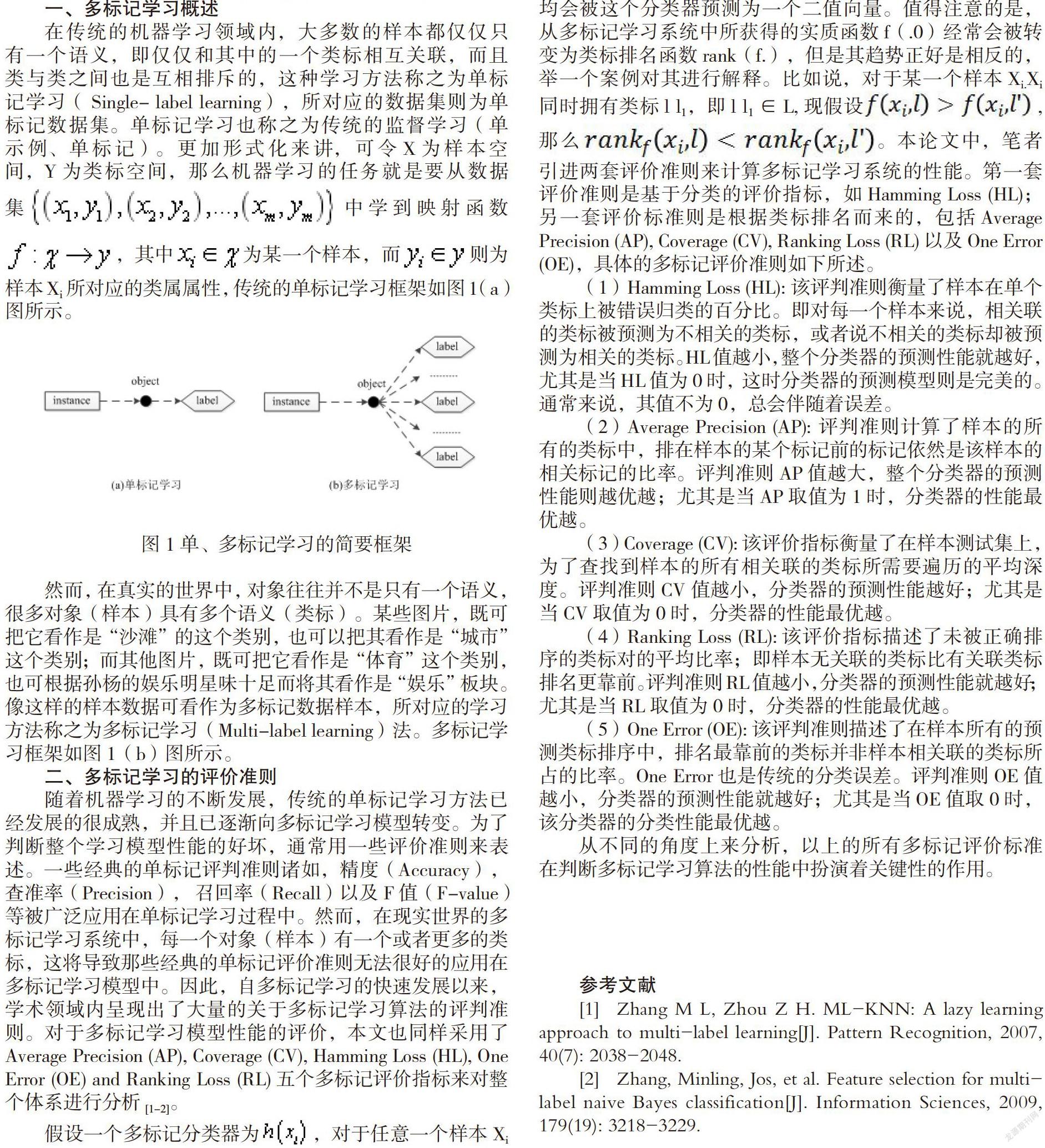

在传统的机器学习领域内,大多数的样本都仅仅只有一个语义,即仅仅和其中的一个类标相互关联,而且类与类之间也是互相排斥的,这种学习方法称之为单标记学习( Single- label learning),所对应的数据集则为单标记数据集。单标记学习也称之为传统的监督学习(单示例、单标记)。更加形式化来讲,可令X为样本空间,Y为类标空间,那么机器学习的任务就是要从数据集中学到映射函数,其中为某一个样本,而则为样本Xi所对应的类属属性,传统的单标记学习框架如图1(a)图所示。

二、多标记学习的评价准则

随着机器学习的不断发展,传统的单标记学习方法已经发展的很成熟,并且已逐渐向多标记学习模型转变。为了判断整个学习模型性能的好坏,通常用一些评价准则来表述。一些经典的单标记评判准则诸如,精度(Accuracy), 查准率(Precision), 召回率(Recall)以及F值(F-value)等被广泛应用在单标记学习过程中。然而,在现实世界的多标记学习系统中,每一个对象(样本)有一个或者更多的类标,这将导致那些经典的单标记评价准则无法很好的应用在多标记学习模型中。因此,自多标记学习的快速发展以来,学术领域内呈现出了大量的关于多标记学习算法的评判准则。对于多标记学习模型性能的评价,本文也同样采用了Average Precision (AP), Coverage (CV), Hamming Loss (HL), One Error (OE) and Ranking Loss (RL)五个多标记评价指标来对整个体系进行分析[1-2]。

假设一个多标记分类器为,对于任意一个样本Xi均会被这个分类器预测为一个二值向量。值得注意的是,从多标记学习系统中所获得的实质函数f(.0)经常会被转变为类标排名函数rank(f.),但是其趋势正好是相反的,举一个案例对其进行解释。比如说,对于某一个样本Xi.Xi同时拥有类标l l1,即l l1∈L,现假设, 那么。本论文中,笔者引进两套评价准则来计算多标记学习系统的性能。第一套评价准则是基于分类的评价指标,如Hamming Loss (HL);另一套评价标准则是根据类标排名而来的,包括Average Precision (AP), Coverage (CV), Ranking Loss (RL) 以及One Error (OE),具體的多标记评价准则如下所述。

(1)Hamming Loss (HL): 该评判准则衡量了样本在单个类标上被错误归类的百分比。即对每一个样本来说,相关联的类标被预测为不相关的类标,或者说不相关的类标却被预测为相关的类标。HL值越小,整个分类器的预测性能就越好,尤其是当HL值为0时,这时分类器的预测模型则是完美的。通常来说,其值不为0,总会伴随着误差。

(2)Average Precision (AP): 评判准则计算了样本的所有的类标中,排在样本的某个标记前的标记依然是该样本的相关标记的比率。评判准则AP值越大,整个分类器的预测性能则越优越;尤其是当AP取值为1时,分类器的性能最优越。

(3)Coverage (CV):该评价指标衡量了在样本测试集上,为了查找到样本的所有相关联的类标所需要遍历的平均深度。评判准则CV值越小,分类器的预测性能越好;尤其是当CV取值为0时,分类器的性能最优越。

(4)Ranking Loss (RL):该评价指标描述了未被正确排序的类标对的平均比率;即样本无关联的类标比有关联类标排名更靠前。评判准则RL值越小,分类器的预测性能就越好;尤其是当RL取值为0时,分类器的性能最优越。

(5)One Error (OE): 该评判准则描述了在样本所有的预测类标排序中,排名最靠前的类标并非样本相关联的类标所占的比率。One Error也是传统的分类误差。评判准则OE值越小,分类器的预测性能就越好;尤其是当OE值取0时,该分类器的分类性能最优越。

从不同的角度上来分析,以上的所有多标记评价标准在判断多标记学习算法的性能中扮演着关键性的作用。

参考文献

[1] Zhang M L, Zhou Z H. ML-KNN: A lazy learning approach to multi-label learning[J]. Pattern Recognition, 2007, 40(7): 2038-2048.

[2] Zhang, Minling, Jos, et al. Feature selection for multi-label naive Bayes classification[J]. Information Sciences, 2009, 179(19): 3218-3229.