无人机遥感监测作物病虫害胁迫方法与最新研究进展

2022-05-30杨国峰何勇冯旭萍李禧尧张金诺俞泽宇

杨国峰 何勇 冯旭萍 李禧尧 张金诺 俞泽宇

摘要:病虫害是作物生产面临的主要胁迫之一。近年来,随着无人机产业的快速发展,无人机农业遥感因其图像空间分辨率高、数据获取时效性强和成本低等特点,在作物病虫害胁迫监测应用中发挥了重要作用。本文首先介绍了利用无人机遥感监测作物病虫害胁迫的相关背景;其次对目前无人机遥感监测作物病虫害胁迫中的常用方法进行了概述,主要探讨无人机遥感监测作物病虫害胁迫的数据获取方式和数据处理方法;之后从可见光成像遥感、多光谱成像遥感、高光谱成像遥感、热红外成像遥感、激光雷达成像遥感和多遥感融合与对比六个方面重点综述了近期国内外无人机遥感监测作物病虫害胁迫的研究进展。最后提出了无人机遥感监测作物病虫害胁迫研究与应用中尚未解决的关键技术问题与未来的发展方向。本文为把握无人机遥感监测作物病虫害胁迫研究热点、应用瓶颈、发展趋势提供借鉴和参考,以期助力中国无人机遥感监测作物病虫害胁迫更加标准化、信息化、精准化和智能化。

关键词:无人机;遥感监测;病虫害胁迫;数据获取;数据处理;深度学习;多遥感融合

中图分类号:S-435 文献标志码:A 文章编号:SA202201008

引用格式:杨国峰, 何勇, 冯旭萍, 李禧尧, 张金诺, 俞泽宇.无人机遥感监测作物病虫害胁迫方法与最新研究进展[J].智慧农业(中英文), 2022, 4(1):1-16.

YANG Guofeng, HE Yong, FENG Xuping, LI Xiyao, ZHANG Jinnuo, YU Zeyu. Methods and new research prog‐ress of remote sensing monitoring of crop disease and pest stress using unmanned aerial vehicle[J]. Smart Agricul‐ture, 2022, 4(1):1-16.(in Chinese with English abstract)

1 引言

病蟲害的爆发会影响农业生产,造成作物产量和质量的严重下降[1]。近年来,中国病虫害的发生和传播呈现增多态势,各省份发生率都有所增加,导致病虫害的防治更加困难[2]。目前,中国作物病虫害监测主要依靠植保部门、植保站等人员实地调查取样,不仅费时费力、准确性低、时效性差、区域覆盖小,而且受人为因素影响,无法实现大范围全覆盖的作物病虫害胁迫监测。

遥感技术基于其精准、快速、大面积、无破坏等特点,在作物病虫害胁迫监测领域已经显示出了独特优势。遥感技术是指运用不与探测目标接触的遥感传感器,收集记录目标物辐射、反射、散射的电磁波信息,进而获取目标物的特征、性质及其变化的综合探测技术[3]。当前,遥感监测方式可大致分为天基、空基和地基三种方式。其中,天基监测如卫星遥感监测,容易受气象条件影响、重访周期较长且空间分辨率低;地基监测如固定监测站,监测范围有限、成本很高且难以大面积设立[4]。而空基中的无人机( Un ‐ manned Aerial Vehicle ,UAV )遥感监测具备运行成本低、灵活度高、采集迅速、覆盖面广等特点,可获得更高的空间、时间和光谱分辨率的影像,弥补了传统病虫害监测过程中存在的缺陷,被认为是遥感监测作物病虫害胁迫的有效手段[5]。

近年来,随着以无人机飞行平台和数据获取传感器等为代表的硬件不断成熟,以机器学习乃至深度学习等为代表的数据处理技术快速发展,基于无人机的遥感监测技术逐渐成为低空遥感领域的重要监测方式[6]。在作物病虫害胁迫遥感监测领域,基于无人机的遥感监测技术已是一个重要且热门的研究方向,并且基于感知、决策、执行的无人机技术也已成为智慧农业的关键核心技术。

本文围绕无人机遥感监测作物病虫害胁迫研究,首先在监测数据获取和处理两部分梳理了无人机作物病虫害遥感监测方法;然后从可见光成像遥感、多光谱成像遥感、高光谱成像遥感、热红外成像遥感、激光雷达成像遥感和多遥感融合与对比方面分析了国内外无人机遥感监测作物病虫害胁迫的研究方法与进展;最后提出了无人机遥感监测作物病虫害胁迫中尚未解决的关键技术问题与未来的发展方向。

2 无人机遥感监测作物病虫害胁迫方法

2.1概述

目前,基于无人机的遥感监测技术已在作物病虫害胁迫领域被广泛应用与研究。当作物受到病虫害胁迫时通常在不同光谱波段上表现出吸收和反射特性的变化,即为作物病虫害胁迫的光谱响应[7]。作物由于病虫害胁迫受损会引起色素、形态、结构等改变,通常可以通过提取其光谱响应特征并加以分析处理,实现对病虫害胁迫的精准、快速、无损监测[8]。

无人机遥感监测作物病虫害胁迫是以无人机为遥感监测平台,利用搭载的各种传感器获取目标作物的遥感影像、视频、点云等数据,通过对数据的处理、挖掘和建模来获取作物病虫害胁迫信息。监测方法大致可分为两类:(1) 单一遥感监测方法,主要通过无人机搭载相应传感器进行作物病虫害胁迫数据获取、处理及分析;(2)综合遥感监测方法,主要利用无人机遥感监测技术与地面人工调查取样等方式综合进行作物病虫害胁迫数据获取、处理及分析。根据实际监测情况的不同选择单一或综合无人机遥感监测作物病虫害胁迫方法,以实现作物病虫害信息的精准获取和高效动态监测,为作物病虫害科学防治提供支撑。其中,主要涉及到以无人机飞行平台和机载传感器为代表的无人机遥感监测硬件系统,以无人机测绘摄影测量等专业处理软件和数据处理分析相关算法或模型为代表的无人机遥感监测软件系统。

2.2监测数据获取方式

2.2.1 无人机飞行平台

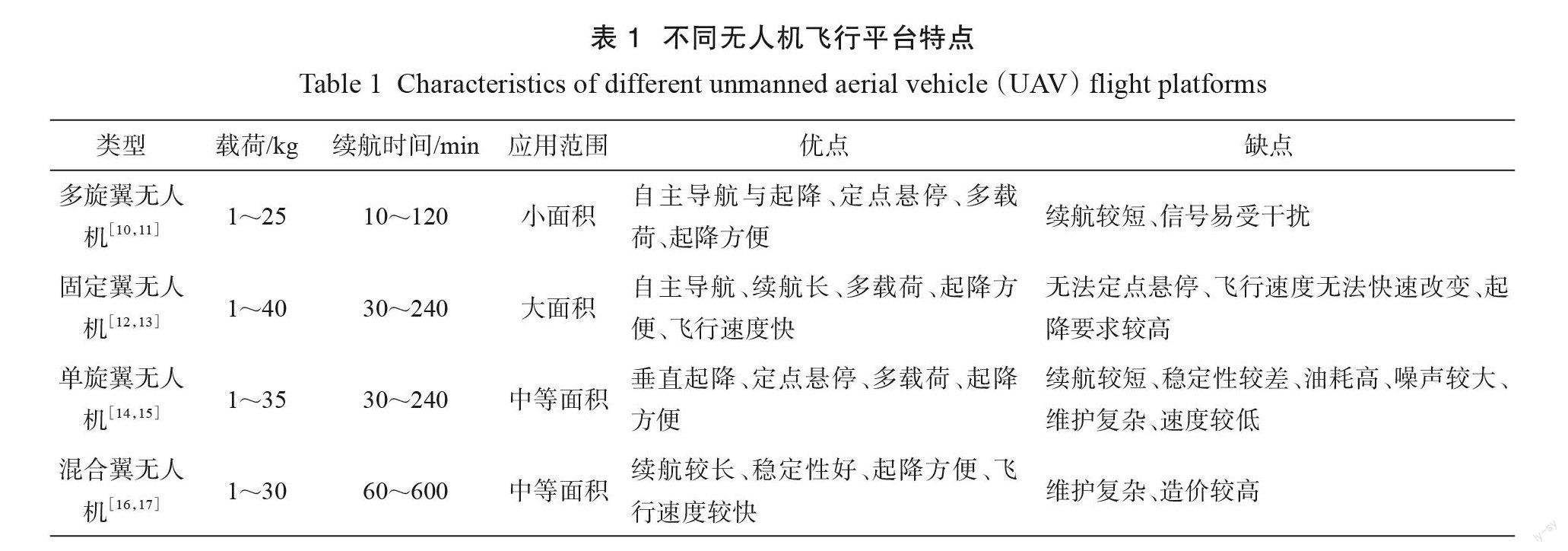

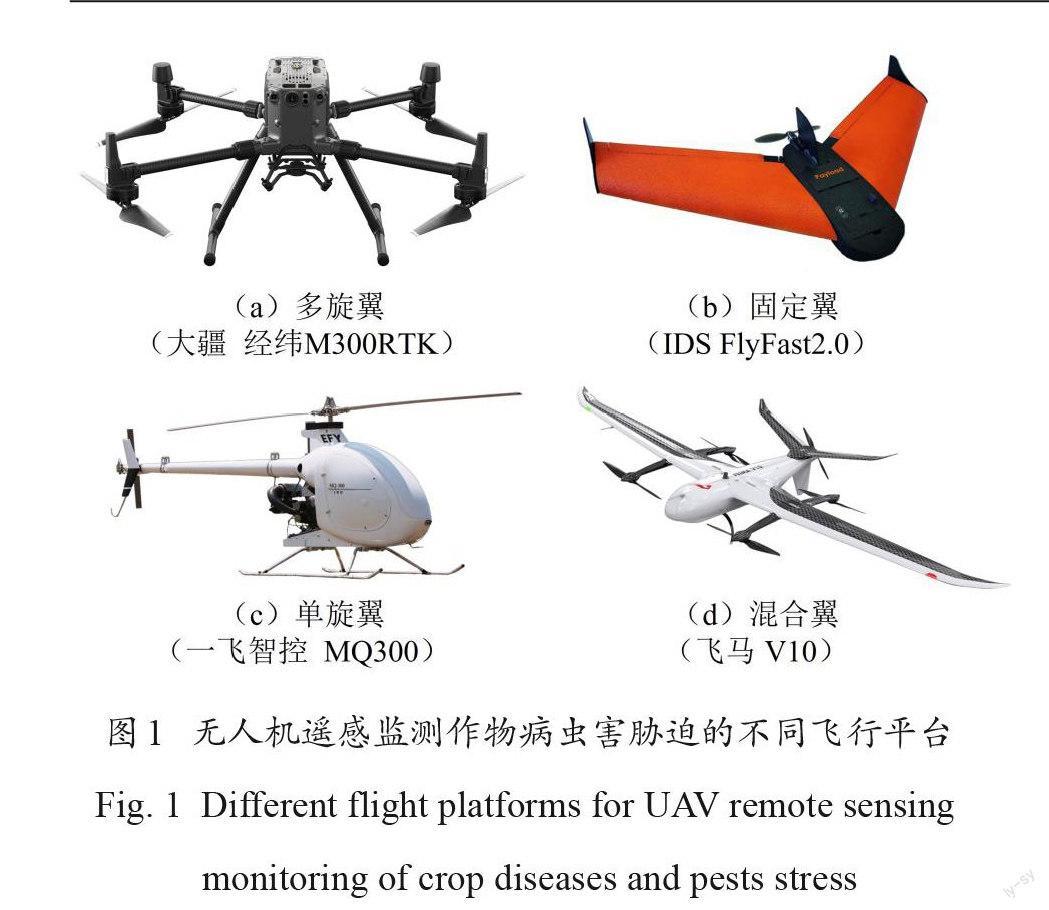

无人机是利用无线电遥控设备和自备的程序控制装置操纵的不载人飞行器[9]。大致可分为多旋翼、固定翼、单旋翼(直升机)和混合翼(垂直起降固定翼)几种,如图1所示。在使用无人机遥感监测作物病虫害胁迫时,关注的重点是无人机载荷、续航时间、飞行高度、监测精度和空间分辨率等。如表1所示为不同的无人机飞行平台。

由于遥感监测数据获取过程中飞行平台的选择对获取的数据质量有影响,因此选择的飞行平台应具备可操控性、高稳定性和飞行持久性等特点,以获取质量较好的数据。目前,多旋翼无人机因具有航速姿态可调、飞行稳定、能够定点悬停等优势,适用于定点重复获取多尺度、高分辨率的作物病虫害胁迫数据,在遥感监测作物病虫害胁迫研究与应用中最为广泛。

2.2.2 机载传感器

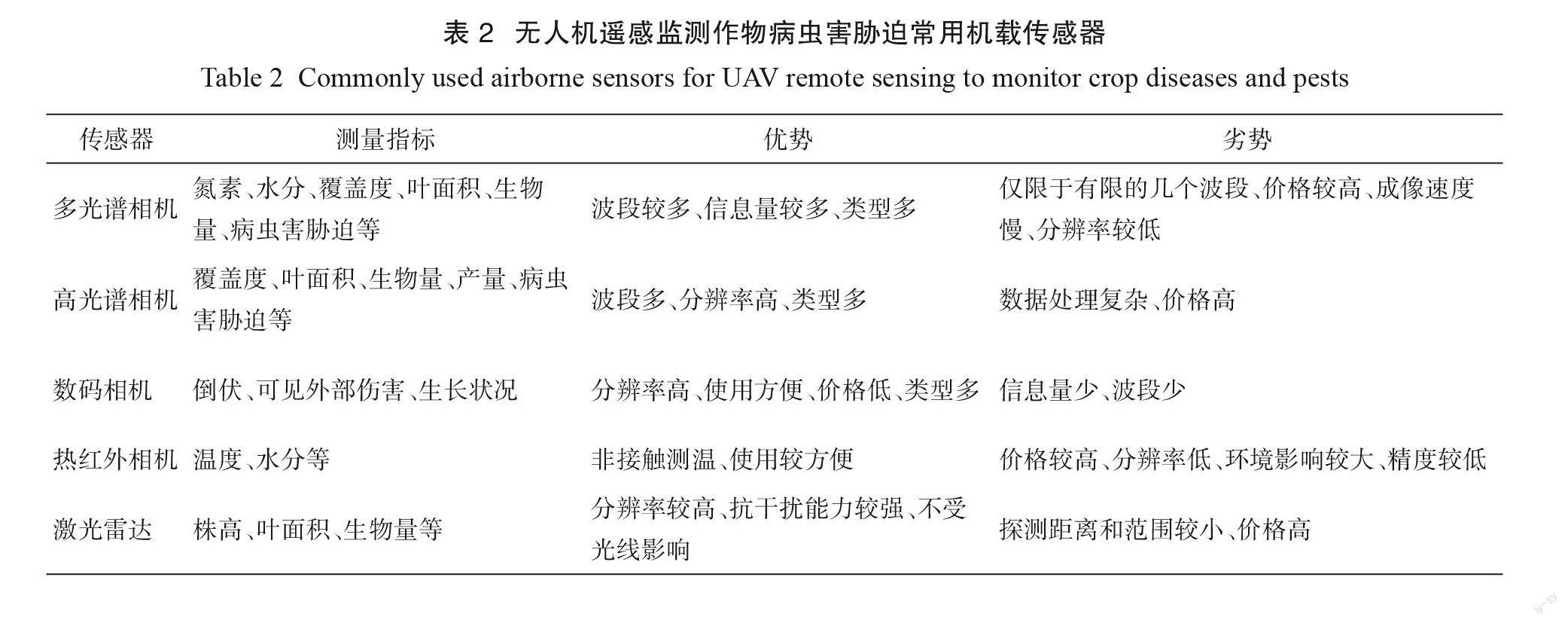

无人机遥感监测作物病虫害胁迫研究中的机载传感器类型主要包括多光谱相机、高光谱相机、数码相机、热红外相机、激光雷达等[18],如图2所示。无人机遥感监测作物病虫害胁迫的机载传感器通常为光学、光电学和热力学传感器,少部分机载传感器属于声学等领域。常用机载传感器及其测量指标、优势和劣势如表2所示。因此,利用無人机获取病虫害胁迫数据时,需要依据地域特征、病虫害爆发程度和作物种类等情况选择合适的传感器。

2.2.3 数据获取流程

无人机遥感监测作物病虫害胁迫的数据获取流程是保证每次飞行能正常操作且安全准确获取监测数据的重要流程,无人机数据获取的质量和数量对后续处理分析的结果有重要影响。对自主作业模式(全球定位系统模式,以实现精确悬停、指点飞行、规划航线等操作)下无人机遥感监测作物病虫害胁迫方法来说,主要有以下步骤:

(1) 飞行前期准备。确认飞行任务区域及申请空域;查询地理、天气环境信息;选择并调试飞行与地面设备(无人机飞行平台、机载传感器、遥控器、导航等)以及检查电量、是否能正常工作等;是否携带其他设备,如辐射定标板等。

(2) 正式飞行前准备。现场组装、调试、连接飞行与地面设备;根据任务区域地形、作物病虫害、续航、载荷等情况,设计飞行任务方案,如起降点、航线、高度、架次、重叠率等[19,20]。

(3) 飞行作业执行。实时关注无人机飞行平台的速度、位置、电量、电压、任务时间等飞行情况,监督飞行时稳定、安全作业,必要时可以手动接管飞行。

(4) 飞行作业结束。自主返航或操控返航;返航完毕可关闭飞行与地面设备电源;回收飞行与地面设备,读取储存卡数据或在飞行作业时通过地面设备实时获取遥感监测数据。

2.3监测数据处理方法

如何从无人机遥感监测作物病虫害胁迫获取的大量数据中高效提取表型特征十分重要,并且很大程度决定处理分析的结果。表型特征主要包括光谱特征、纹理特征、颜色特征、形状特征和生理特征等。目前,对这些表型特征的分析处理是无人机遥感监测作物病虫害胁迫研究的热点[21,22]。现阶段主流的无人机遥感监测作物病虫害胁迫数据处理的方法可以大致分为统计分析方法和机器学习方法两类。

目前,监测数据处理方法的流程主要为:遥感影像的格式调整、清洗、预处理、拼接、校正、特征提取、特征选择、设计方法模型、评价指标与调优等。对于遥感影像格式调整一般使用机载传感器配套软件处理,对于遥感影像拼接和校正等则使用无人机测绘摄影测量软件,如Metashape软件(Agisoft公司)、 PIX4Dmapper软件 ( Pix4D 公司) 和Inpho软件 ( Trimble 公司)等。

2.3.1 统计分析方法

在无人机遥感监测作物病虫害胁迫相关研究中,常用描述统计、相关分析、回归分析、判别分析、方差分析和聚类分析等统计分析方法。

通常,借助上述方法使用植被的光谱特征进行作物病虫害胁迫遥感监测。通过对光谱曲线进行分析,可以发现不同作物病虫害胁迫的光谱曲线变化特征。一般基于特定光谱波段、波段计算与组合以及植被指数(Vegetation Index ,VI )等方法进行光谱特征提取。因为不同病虫害胁迫对作物生长造成的影响程度不一致,所以特定光谱波段更有利于对不同病虫害胁迫进行监测。光谱波段经运算组合后可以得到反映植被生长状况、植被覆盖度等有相关意义的值,即 VI 。VI 已广泛用来定性和定量评价植被覆盖及其生长活力,常用于作物病虫害胁迫监测的 VI 主要由2~3个波段构成[23]。利用 VI进行回归或相关分析可以建立遥感监测数据与作物生长信息的反演模型,即经验模型。由于经验模型需要大量的实测数据为基础,而实测数据的精度如何,很大程度取决于实测数据的测量精度;经验模型存在区域适用性的限制,常常在实测数据采集的区域模型的适用性较高,在其他区域适用性较低;地表粗糙度的变化经验模型无法考虑。目前,由于植被参数的遥感反演物理模型具有因果关系和数学物理基础[24,25],因而正成为遥感反演作物病虫害胁迫研究的主要方向,但主要集中在辐射传输模型[26,27],尚无几何光学模型和混合模型等在作物病虫害胁迫中研究与应用。

2.3.2 机器学习方法

当前,无人机遥感监测作物病虫害胁迫的数据处理方法主要集中于机器学习方法。机器学习最基本的做法是使用算法来解析遥感监测数据,然后对真实世界中的病虫害胁迫做出决策和预测。机器学习传统的算法包括决策树、聚类、贝叶斯分类、随机森林( Random Forest ,RF )、支持向量机(Support Vector Machine , SVM )、 k-近邻(k-Nearest Neighbor ,kNN )算法等。从学习方法上划分,机器学习算法可以分为监督学习、无监督学习、半监督学习、集成学习、深度学习和强化学习等[28]。

在机器学习传统的算法中,如何最大限度地在数据中提取有用的特征以供算法和模型使用至关重要。当作物受到一定程度病虫害胁迫后,患病虫害的作物外部形态(叶面积、株高、颜色等)与内部生理均会发生较为明显的改变。因此,除了使用无人机遥感监测获取作物病虫害胁迫影像的光谱特征之外,颜色特征(如颜色直方图、颜色熵、颜色矩、颜色聚合向量等)、纹理特征(如局部二值模式、灰度直方图、灰度共生矩阵、小波变换等)和形状特征(如傅立叶变换、形状不变矩、小波轮廓描述符等)等也常被提取使用。此外,还可以结合实地调查取样获取作物病虫害胁迫下的株高、叶绿素含量、生物量和含水量等各项指标。特别地,作物受病虫害胁迫的环境(温度、湿度、海拔、土壤含水量、养分等)也会对病虫害胁迫有影响,也是需要重点关注与开展长期性、周期性的研究。

近年来,随着数据的高速增长、算力的迅猛增强、算法的完善成熟,深度学习逐渐在无人机遥感监测作物病虫害胁迫领域得以大量应用[29]。使用传统的机器学习方法提取特征往往需要进行手工提取或特征工程,并且需要大量的时间优化,而深度学习减少人为设计特征的过程,将自动学习与任务相关的特征即特征学习融入建立模型的过程。不过,使用深度学习方法面临需要大量训练数据和性能较高的计算机硬件支持,以及更优的模型等主要限制[30]。尽管如此,相关研究表明使用深度学习方法比机器学习传统的算法能获得更好的分类、检测、识别和分割性能,因此未来也需要不断深入研究与改进。同时,随着高光谱机载传感器和深度学习技术的不断发展,利用深度学习技术可以充分挖掘高光谱影像的潜在特征,实现更好地对各种作物病虫害胁迫进行监测。

3 无人机遥感监测作物病虫害胁迫最新研究进展

本节主要针对2019―2021年无人机遥感监测作物病虫害胁迫相关研究,从可见光成像遥感、多光谱成像遥感、高光谱成像遥感、热红外成像遥感、激光雷达成像遥感和多遥感融合与对比方面进行综述。

3.1可见光成像遥感

使用基于无人机搭载可见光传感器,如数码相机与 RGB ( Red Green Blue )传感器,可以获得可见光影像(红、蓝、绿波段)。目前,可见光成像遥感在作物病虫害胁迫领域已被广泛应用研究。

在利用统计分析方法方面,有研究提取红绿蓝波段的特征信息后,构建 VI 和分类模型识别病虫害胁迫程度。Nazir等[31]为监测种植园生长的桉树健康状况,利用冠层叶片的可见光波段开发视觉大气阻力指数(Visual Atmospheric Resis‐tance Index ,VARI ),并基于 VARI-green 将病虫害胁迫程度分為四级,将 VARI-green 指数和与 NDVI 进行相关性分析,平均相关系数为0.73。该研究展示了利用无人机和 RGB 相机对大规模工业林场作业区域进行航空调查的实际应用。 Dutta等[32]使用植被指数和 Otsu阈值分割方法对十字花科作物进行早期病害检测,利用在两种不同的阳光条件下收集的 RGB 图像,区分健康叶片、患病叶片和背景,研究表明需要根据作物类型调整植被指数,以便通过图像处理方法准确识别作物的感染部位。

在使用机器学习方法方面,对于可见光成像遥感主要利用提取的可见光影像的颜色、纹理、光谱和形状等特征开展如分类、识别、检测等监测任务[33]。在利用机器学习方法提取特征方面,Calou等[34]使用五种传统机器学习分类算法来识别和量化香蕉黄斑病, SVM 算法取得了最佳分类性能。类似地,Dang等[35]基于一系列颜色特征进行阈值检测以对萝卜枯萎病的严重程度进行分类,并使用 k-means聚类算法实现将萝卜区域与田地的其他区域(例如土地和地膜)分割。为评估无人机遥感监测方法在小麦蠕孢叶枯病检测方面的潜力,Huang 等[36]使用无人机进行可见光影像采集,同时进行地面调查,根据不同的病害胁迫程度建立了正常、轻度、中度和重度四种病害类别,构建了基于 LeNet-5的卷积神经网络,准确区分了小麦蠕孢叶枯病的感染区和健康区。为量化非洲叶蝉对葡萄园的影响,并开发害虫胁迫严重程度的专题图,del-Campo-San等[37]使用 RGB 图像构建基于人工神经网络与几何技术相结合的计算视觉算法,该算法与从 RGB 图像生成的地理产品相结合,改进了受影响植被、健康植被和地面的图像分割效果,并通过消除土壤的影响提高了检测的效果。Tetila等[38]使用无人机拍摄的大豆害虫图像进行五种深度学习模型的评估,发现经过微调训练的深度学习模型可以获得更高的分类准确率93.82%。此外,也展示了深度学习模型的性能优于传统的特征提取方法。

上述研究表明,采用较低成本的可见光成像遥感可以方便快捷地对作物病虫害胁迫进行监测,并且也能取得不错的识别效果。开发基于可见光成像的无人机遥感监测作物病虫害胁迫系统能以更大经济优势进行推广普及,从而助力农业高效生产。

3.2多光谱成像遥感

多光谱成像遥感是指用2个以上光谱通道传感器进行地物同步成像,接收和记录目标物反射辐射的电磁波信息被分成若干个窄波段的光束。在利用无人机搭载多光谱传感器遥感监测作物病虫害胁迫时,通常获取不同时空、冠层等2~5个波段遥感影像开展相关研究。

在使用统计分析方法方面,国内外研究通常在提取光谱特征后,再筛选、组合与作物病虫害胁迫遥感监测任务相关的 VI ,如归一化植被指数 (Normalized Difference Vegetation Index,NDVI )、增强型植被指数和垂直植被指数等常用VI或提出新的植被指数如 Excess Near-Infrared和Excess Red-Edge [39],同时结合地面调查的方式人工采集相关数据。基于上述 VI ,主要通过指数统计相关性、方差分析、线性回归、二元逻辑回归等统计分析方法识别敏感指数以及结合多时空变化进行小麦[40]、辣椒[41]、香蕉[42]、西瓜[43]、大豆[44] 和油棕[45]作物病虫害的定量评估和分析。部分研究建立了不同的机器学习分类模型对梨[10]、槟榔[46,47]、柑橘[48,49]、花生[50]、柠檬[51]和马铃薯[52]等病虫害发生情况进行了有效地监测,其中使用 SVM 和 RF 的方法占多数,还有使用径向基函数 ( Radical Basis Function,RBF )和kNN等。部分研究测试不同的输入波段组合,改进分割算法 U-net 进行小麦黄锈病检测[53] 以及开发新的分割算法处理获取的 RGB、CIR ( Color and Infrared )和 NDVI图像,随后使用线性判别分析对受木质部难养菌(Xylella Fas‐tidiosa)影响的橄榄树进行分类[54]。一些研究将统计分析方法和机器学习方法相结合,如 Lan 等[11]先计算 VI ,然后使用主成分分析和 Auto ‐ Encoder 进行相关分析和特征压缩以发现潜在特征,之后比较了几种机器学习分类算法以实现对柑橘黄龙病的监测。Chivasa等[12]通过玉米品种对玉米条纹病毒的反应,使用基于无人机的多光谱遥感数据来提高作物表型分析效率,用 RF 评估无人机衍生的光谱和 VI ,再对无人机获取的数据与人工玉米条纹病毒评分之间进行相关性分析。马云强等[55]通过深度学习技术定量反演云南切梢小蠹胁迫情况,结果显示 NDVI与虫害的危害程度呈负相关。

在仅使用机器学习技术方面,研究者使用传统方法包括 SVM 、RF 、kNN、朴素贝叶斯和集成学习等对油棕灵芝属病害、马铃薯晚疫病进行分类[56,57],并且开发了新的针对棉花根腐病的无监督 Plant-by-Plant 分类算法[58]。此外,还有研究使用改进的 U-Net进行小麦黄锈病病害区域分割研究[59]。

大量研究表明,通过使用统计分析方法和机器学习方法可以较为准确地评估作物病虫害胁迫的程度、类型和位置等。与可见光成像遥感相比,多光谱成像遥感能获取更多的光谱信息。当使用这些更多的信息时会使得监测结果更为准确有效。

3.3高光谱成像遥感

当前,基于无人机搭载高光谱传感器遥感监测病虫害胁迫的作物主要集中于小麦、水稻、柑橘等。与无人机搭载多光谱传感器遥感监测作物病虫害胁迫的方法不同,高光谱影像分辨率高、数据量大,相邻光谱波段相关性高,具有空间域和光谱域信息。

在使用统计分析方法方面,马书英等[60]对板栗树进行高光谱遥感监测,通过对冠层红蜘蛛胁迫下的光谱特征与红蜘蛛虫害感染程度直接进行相关性分析;郭伟等[61]通过分析棉花的冠层光谱特征,再基于敏感波段的比值导数值开发了蚜害胁迫程度的预测模型。上述研究使用光谱特征、敏感波长进行统计分析以识别板栗树红蜘蛛虫害与棉花蚜害的胁迫程度。相关研究在统计分析方法中还使用 VI ,与多光谱使用 VI类似,研究者基于多种 VI 、特征波长和冠层特征光谱参数等使用如 Fisher 判别分析法对毛竹刚竹毒蛾[62]、偏最小二乘回归 (Partial Least SquaresRegression,PLSR )方法对小麦全蚀病[63]、线性回归对玉米大斑病[64]、秩和检验对水稻稻曲病[65]进行了准确分类和识别,或构建由东亚飞蝗造成的芦苇损失估计模型,用定量的方式评估和量化东亚飞蝗损害程度[66]。Liu 等[67] 和 Ma等[68]考虑到高光谱影像处理的特点,在使用光谱带、VI 的基础上融入了纹理特征,构建和改进了 BP神经网络、SVM等机器学习来监测小麦枯萎病;而 Guo等[69]构建了基于 PLSR的不同感染时期的小麦黄锈病监测模型。此外,大量研究使用如 RF 、RBF 、kNN等机器学习方法将不同的光谱特征,如 VI 、光谱特征参数等作为输入量对水稻[70]、柑橘[71,72]、南瓜[73]病虫害胁迫等进行监测,其中有研究使用地面车辆和无人机两种测量平台对小麦黄锈病的发展阶段和病害严重程度进行检测和量化评估[74],也有研究通过逐步判别法识别和区分番茄病害程度的结果与 RBF和多层感知器的分类结果分别进行比较[75,76]。

在使用机器学习方法方面,邓小玲等[77]对光谱进行预处理和特征工程后,采用连续投影算法提取对作物病虫害胁迫程度或类别分类贡献最大的特征波长组合,以基于全波段或特征波段建立多个机器学习分类模型。虽然传统机器学习的方法希望提取具有代表性的光谱特征,但是对于高光谱影像的空间特征过去往往在处理的过程中被自动丢弃,从而不可避免地减少了信息量,并且限制了作物病虫害胁迫相关任务的深入研究[78-80]。当前,已有研究构建了能同时利用光谱和空间信息的深度学习模型对小麦黄锈病进行遥感监测[81],以充分发挥高光谱影像的潜力。目前,有研究基于光谱和时间特征,利用 RF 构建水稻稻曲病监测模型,发现水稻稻曲病的侵染面积随着时间的推移呈扩大趋势,符合水稻稻曲病的自然发展规律[82]。也有研究获取高光谱影像的敏感光谱特征和波段,以及通过灰度共生矩阵提取纹理特征,并将光谱和纹理特征融合以检测小麦赤霉病[83]。

现有研究表明,与可见光成像遥感和多光谱成像遥感相比,高光谱成像遥感具有连续光谱、更多波段和数据量更大等特点,因此很多研究人员能实现更好的作物病虫害胁迫遥感监测效果。此外,随着数据处理方法的发展,基于深度学习的方法已能更好地利用高光谱图像开展相关研究并取得相较于传统机器学习方法更好的效果。但是,如何更好地挖掘并使用高光谱遥感图像中病虫害光谱变化特征,仍然是实现遥感监测大面积作物病虫害胁迫的重点和难点。

3.4热红外成像遥感

作物病虫害胁迫进行热红外( Thermal Infra‐ red ,TIR )成像遥感主要是针对温度的差异进行分析。然而,由于遥感监测时易受风、云和雨等恶劣天气因素的影响,当前 TIR成像遥感监测作物病虫害胁迫面临巨大的挑战。目前,TIR成像遥感监测在作物病虫害胁迫方面的研究相对较少。研究人员在利用 TIR传感器遥感监测作物病虫害胁迫时,通常主要监测作物冠层温度的差异,从而对健康和受病虫害胁迫的作物进行分类。

在使用统计分析方法方面,Francesconi等[84]将 TIR 、RGB影像和地面测量(穗的温度、光合效率和赤霉病原体的分子鉴定)相结合,采用方差分析和主成分分析以及计算 VI 对小麦进行赤霉病监测,研究显示了基于无人机的 TIR和 RGB 影像在小麦和其他谷类作物应对病虫害胁迫时进行田间表型分析的潜力。陈欣欣等[85]将 TIR和无人机模拟平台相结合,基于冠层和叶片两个尺度,采用判别分析、单因素方差分析和相关性分析等方法可以对菌核病侵染油菜的过程进行监测。

从目前研究看,热红外成像遥感具备其独特优势,取得了较好的成果。但是,由于热红外成像遥感容易受到环境因素影响,未来需要研发适用性更强的热红外传感器,以及设计相应的监测方法。值得一提的是,融合 TIR成像遥感数据和其他成像遥感数据能更好地提升遥感监测的效果。

3.5激光雷达成像遥感

激光雷达(Light Detection and Ranging ,Li‐DAR )成像遙感方法监测作物病虫害胁迫,依据激光反射强度来分析作物的病虫害程度,一般提取作物水平以及垂直结构的冠层信息,如株高、生物量等。此外,激光雷达还可以获取虫群飞行方向和运动轨迹。当前,适用于无人机的机载激光雷达价格较贵(通常需5万~15万人民币),使用激光雷达获取点云等数据的方法和处理算法与模型还有待改进。使用无人机搭载激光雷达在遥感监测病虫害胁迫方面的研究大都应用在林业,且多与其他遥感影像数据融合进行病虫害胁迫的监测。

在使用统计分析方法方面,在针对松树常见的松针红斑病(Red Band Needle Blight), Lin等[86]研究使用基于无人机的热红外成像检测松针红斑病引起的冠层温度升高,并探讨成像时间和天气条件对检测的影响,发现冠层温度降低与病害水平之间存在统计学显著相关性,这可能与病害引起的针头损伤症状有关,即细胞完整性丧失、坏死和最终干燥;树冠温度的标准偏差表现出微弱但具有统计学意义的相关性;PLSR 中冠层温度降低和冠温标准差的组合进一步改善了觀察结果与估计病害程度的关系。

在使用机器学习方法方面,Briechle等[87]使用3D 深度神经网络PointNet++和激光雷达数据与多光谱影像对多种树种(松树、桦树、桤木)和带有树冠的枯立木进行了分类,验证了3D 深度神经网络对于多种树种和枯立木的分类前景。松材线虫病是对森林的全球破坏性威胁,在中国对森林造成了极大的破坏。Savian等[88]将松材线虫病感染分为五个阶段(绿色、早期、中期、重度和灰色),使用 RF 算法估计高光谱成像数据、LiDAR数据及其组合预测松材线虫病的感染阶段,发现高光谱数据在预测松材线虫病感染阶段的分类准确率高于 LiDAR ,并且它们的组合具有最佳精度,此外还证明 LiDAR 数据比高光谱数据具有更高的死树识别能力。类似地,为准确评估早期监测松梢甲虫的松林枝条损伤率,Yu 等[89] 同样基于无人机的高光谱成像数据和激光雷达数据融合检测害虫,并通过类似的方法评估松梢甲虫造成的损失。研究证实,如果结合高光谱数据和激光雷达数据,在单个树级别准确预测枝条损伤率的可能性很高,并且三维辐射传输模型可以确定来自激光雷达的三维树冠阴影。

目前的研究已经取得了一定的成果,但是相关算法、模型仍然具有局限性,有待进一步研究与应用。未来,需要重点研发更低成本的激光雷达与配套的算法、模型,并且能够更好地在复杂场景下精确成像。

3.6多遥感融合与对比

将可见光、多光谱、高光谱、TIR 、雷达等遥感数据进行融合与对比研究已逐渐成为热点,具有良好的研究前景。

在融合方面,研究人员使用上述多种传感器同步或异步获取作物病虫害胁迫信息,采取统计学习或机器学习方法对其进行处理分析。对于使用机器学习方法的研究,Smigaj等[90] 使用 K-means 、Ward分层聚类等遥感方法成功预测猕猴桃藤衰退综合征;Kerkech等[91,92]通过构建深度学习的分割模型检测葡萄病害,与直接使用单一来源的遥感影像相比,融合多源遥感影像的方法能获得更好的检测结果。

在对比方面,Moriya 等[93] 比较不同遥感监测方法的效果,对于25波段传感器获取的影像和3波段传感器获取的影像,结果表明,使用25波段传感器获取的影像检测柑橘树脂病的性能更好,因为其具有更高的数据维度和更详细的光谱信息从而可以更准确地检测感染柑橘树脂病的树木。当比较可见光和多光谱对水稻纹枯病的检测效果时,尽管多光谱传感器的检测结果更准确,但是可见光传感器更加经济且易使用[94]。Dang等[95]检测萝卜枯萎病时,对于可见光数据集,采用线性谱聚类超像素算法分割田块图像,然后通过新构建的RadRGB模型对不同萝卜、土壤和地膜区域继续分类,此外还从近红外数据集构建NDVI图高精度检测不同阶段萝卜枯萎病。尽管与识别可见光数据集中萝卜枯萎病的复杂算法相比近红外方法更简单,但它需要近红外这种特殊类型的传感器。

当前研究表明,相比于单一来源的监测数据,融合更多源的遥感监测数据将能实现优势互补,为作物病虫害胁迫监测提供更全面信息,从而实现更好的监测效果。未来,需要继续深入探索数据融合在作物病虫害胁迫中的研究与应用,构建通用性强、精度高的遥感监测算法和模型。

4 问题与展望

目前,利用无人机遥感监测病虫害胁迫的相关研究与应用还处于初级阶段,不仅在无人机飞行平台和机载传感器的研发、应用和管理方面存在问题,而且在遥感监测病虫害胁迫数据的获取、处理和应用方面也具有极大的提升空间。

4.1无人机性能亟待优化

目前针对遥感监测所使用的无人机飞行平台主要存在稳定性不足、续航时间较短、易受外界干扰和载荷不足等问题[18]。未来需要进一步开发稳定性强、续航时间长和载荷大的无人机飞行平台。对于无人机机载传感器,为满足不同的遥感监测任务需求,无人机可以搭载相应的传感器。然而,现有的无人机机载传感器无法完全适应复杂的外部环境[96],所获取的作物病虫害胁迫数据质量往往由于环境的不同而存在差异,并且由于无人机平台载荷不足,往往搭载传感器的重量和数量等有限[97]。因此,研发低成本、轻量化和模块化以及适用性更强的机载传感器具有重要意义。

在使用无人机遥感监测作物病虫害胁迫时,为实现精准、经济、普适等目的需要综合考虑飞行的任务、环境、天气等因素,从而选择合适的无人机飞行平台和搭载的传感器。特别地,在提高遥感监测任务的无人机自身安全性的基础上,还需进一步完善与遵循空中交通管理机制,施行无人机空域管理以实现统一规划,合理、充分、有效利用[98]。同时,对于无人机操作人员需要具备安全飞行意识,遵守当地法律法规,选择安全的飞行环境,预防无人机潜在危险等[99]。

4.2遥感监测数据获取困难

无人机遥感监测作物病虫害胁迫容易受大风、阴雨等恶劣天气影响,同时采集数据时对太阳光照有较高的要求。大部分无人机飞行任务的操作较复杂且过度依赖于人工设置[100],制约了其在作物病虫害胁迫遥感监测中的广泛应用。当前研究已逐渐从单块单次作物遥感监测变为多块多次的连续监测,而这加大了遥感监测数据获取的任务工作量,同时为监测数据获取与处理带来挑战。

另外,在开展无人机遥感监测作物病虫害胁迫研究时,实验人员通常需要自行携带辐射校正板等校正设备以便后续校正操作后获得反射率值等数据。此外,过去大部分研究使用单一来源的遥感监测数据,难以全面反应整体信息。随着传感器的轻型化和无人机载荷及续航时间的增加,已逐步实现多源数据同步遥感监测作物病虫害胁迫信息[4,6, 18]。未来,如何获取更多的遥感监测信息仍然需要深入研究,如获取空间结构数据与光谱成像对应数据、光谱数据与相应的环境数据,以及空天地(卫星、无人机和地面)一体化立体监测数据等。值得一提的是,越来越多开源的更大型、更多源、覆盖更广的遥感监测数据库、数据集和数据平台等正在不断涌现[101, 102],将为相关研究与应用提供数据基础。

4.3遥感监测数据处理复杂

通常研究与应用人员需要设计开发相应算法或使用相关软件才能实现对无人机遥感监测数据的拼接、解析和生成处方图等操作,其中部分算法和特定软件针对特定应用而开发[53,58,66,81]。随着利用无人机遥感监测作物病虫害胁迫时间增加,以及空间和光谱分辨率提高,需要解决无人机遥感监测获取的海量数据的处理问题。滞后的遥感监测数据解译将无法及时指导病虫害的防治,导致无法实现病虫害快速、精准、高效地防治。特別地,为实现时空实时感知、周期实时监测、要素实时评估,当前利用空天地一体化立体监测技术开展作物病虫害胁迫监测的综合研究与应用较少且具有巨大潜力[103]。

未来,须不断完善数据处理方法,应设计开发出适用性更强、适用面更广的数据处理算法或软件以提高数据处理的准确性;利用更多源的监测数据提取更全面综合的作物病虫害胁迫特征;缩短数据处理时间,使用基于5G 通讯网络和边缘计算设备以解决数据传输与数据及时处理的问题[104-107],更加及时、精准地监测病虫害发生和危害程度。

4.4遥感监测结果适用局限

由于存在作物的物候阶段、种植区域与类型、生育期、病虫害胁迫的监测时间、气候变化等影响,目前大部分算法或模型仅适用于对应研究,而无法具备很好的稳定性、普适性和通用性,往往由于时间和空间的局限性而严重制约其大面积应用与推广[10,56,61,90]。例如,在单次的无人机遥感监测病虫害胁迫中实现很高的识别率,但并不能保证在其他时刻通过无人机获取的遥感监测病虫害胁迫数据能得到同样的识别率。

因此,未来需要对作物病虫害胁迫状态进行持续监测,总结各种作物病虫害胁迫的类型和数据特征,深化对无人机遥感监测作物病虫害胁迫数据的认识。通过建立适用性更强的无人机遥感监测作物病虫害胁迫算法或模型,从而构建无人机遥感监测作物病虫害胁迫的方法库以推动病虫害遥感监测领域的发展。

参考文献:

[1] CARVAJAL-YEPES M, CARDWELL K, NELSON A,et al. A global surveillance system for crop diseases[J]. Science, 2019, 364(6447):1237-1239.

[2] WANG C, WANG X, JIN Z, et al. Occurrence of croppests and diseases has largely increased in China since 1970[J]. Nature Food, 2021, 3:57-65.

[3] GOETZ A F H, VANE G, SOLOMON J E, et al. Imag‐ing spectrometry for earth remote sensing[J]. Science, 1985, 228(4704):1147-1153.

[4] WEISS M, JACOB F, DUVEILLER G. Remote sens‐ing for agricultural applications: A meta-review[J]. Re‐ mote Sensing of Environment, 2020, 236: ID 111402.

[5] RADOGLOU-GRAMMATIKIS P, SARIGIANNIDISP, LAGKAS T, et al. A compilation of UAV applica‐tions for precision agriculture[J]. Computer Networks, 2020, 172: ID 107148.

[6] SISHODIA R P, RAY R L, SINGH S K. Applicationsof remote sensing in precision agriculture: A review[J]. Remote Sensing, 2020, 12(19): ID 3136.

[7] PINTER JR P J, HATFIELD J L, SCHEPERS J S, etal. Remote sensing for crop management[J]. Photo‐grammetric Engineering & Remote Sensing, 2003, 69(6):647-664.

[8] WHITE J W, ANDRADE-SANCHEZ P, GORE M A,et al. Field-based phenomics for plant genetics re‐ search[J]. Field Crops Research, 2012, 133:101-112.

[9] WATTS A C, AMBROSIA V G, HINKLEY E A. Un‐manned aircraft systems in remote sensing and scientif‐ic research: Classification and considerations of use[J]. Remote Sensing, 2012, 4(6):1671-1692.

[10] BAGHERI N. Application of aerial remote sensingtechnology for detection of fire blight infected pear trees[J]. Computers and Electronics in Agriculture, 2020, 168: ID 105147.

[11] LAN Y, HUANG Z, DENG X, et al. Comparison ofmachine learning methods for citrus greening detection on UAV multispectral images[J]. Computers and Elec‐tronics in Agriculture, 2020, 171: ID 105234.

[12] CHIVASA W, MUTANGA O, BIRADAR C. UAV-based multispectral phenotyping for disease resistanceto accelerate crop improvement under changing cli‐mate conditions[J]. Remote Sensing, 2020, 12(15): ID2445.

[13] CHIVASA W, MUTANGA O, BURGUENO J. UAV-based high-throughput phenotyping to increase predic‐tion and selection accuracy in maize varieties under ar‐tificial MSV inoculation[J]. Computers and Electronicsin Agriculture, 2021, 184: ID 106128.

[14] SUGIURA R, NOGUCHI N, ISHII K. Remote-sensingtechnology for vegetation monitoring using an un‐manned helicopter[J]. Biosystems Engineering, 2005,90(4):369-379.

[15] BERNI J A J, ZARCO-TEJADA P J, SUAREZ L, et al.Thermal and narrowband multispectral remote sensingfor vegetation monitoring from an unmanned aerial ve‐hicle[J]. IEEE Transactions on Geoscience and RemoteSensing, 2009, 47(3):722-738.

[16] CORCOLES J I, ORTEGA J F, HERNANDEZ D, etal. Estimation of leaf area index in onion (Allium cepaL.) using an unmanned aerial vehicle[J]. BiosystemsEngineering, 2013, 115(1):31-42.

[17] WAHAB I, HALL O, JIRSTROM M. Remote sensingof yields: Application of UAV imagery-derived NDVIfor estimating maize vigor and yields in complex farm ‐ing systems in Sub-Saharan Africa[J]. Drones, 2018, 2(3): ID 28.

[18] YAO H, QIN R, CHEN X. Unmanned aerial vehiclefor remote sensing applications—A review[J]. RemoteSensing, 2019, 11(12): ID 1443.

[19] SAARI H, PELLIKKA I, PESONEN L, et al. Un‐manned Aerial Vehicle (UAV) operated spectral cam ‐era system for forest and agriculture applications[C]//Remote Sensing for Agriculture, Ecosystems, and Hy‐drology XIII. International Society for Optics and Pho‐tonics, Prague, Czech Republic: SPIE, 2011, 8174: ID81740H.

[20] SADEQ H A. Accuracy assessment using differentUAV image overlaps[J]. Journal of Unmanned VehicleSystems, 2019, 7(3):175-193.

[21] YANG G, LIU J, ZHAO C, et al. Unmanned aerial ve‐hicle remote sensing for field-based crop phenotyping:Current status and perspectives[J]. Frontiers in PlantScience, 2017, 8: ID 1111.

[22] XIE C, YANG C. A review on plant high-throughputphenotyping traits using UAV-based sensors[J]. Com ‐puters and Electronics in Agriculture, 2020, 178: ID105731.

[23] XUE J, SU B. Significant remote sensing vegetation in‐dices: A review of developments and applications[J].Journal of Sensors, 2017, 2017: ID 1353691.

[24] GITELSON A, ARKEBAUER T, VI?AA, et al. Evalu‐ating plant photosynthetic traits via absorption coef‐ficient in the photosynthetically active radiation re‐gion[J]. Remote Sensing of Environment, 2021, 258:ID 112401.

[25] HAUSER L T, TIMMERMANS J, WINDT NVANDER, et al. Explaining discrepancies between spectral and in-situ plant diversity in multispectral satellite earth observation[J]. Remote Sensing of Environment, 2021, 265: ID 112684.

[26] HORNERO A, HERN?NDEZ-CLEMENTE R,NORTH P R J, et al. Monitoring the incidence of Xylel‐ la fastidiosa infection in olive orchards using ground- based evaluations, airborne imaging spectroscopy and Sentinel-2 time series through 3-D radiative transfer modelling[J]. Remote Sensing of Environment, 2020, 236: ID 111480.

[27] PIGNATTI S, CASA R, LANEVE G, et al. Sino – EUearth observation data to support the monitoring and management of agricultural resources[J]. Remote Sens‐ing, 2021, 13(15): ID 2889.

[28] LEE J H, SHIN J, REALFF M J. Machine learning:Overview of the recent progresses and implications for the process systems engineering field[J]. Computers & Chemical Engineering, 2018, 114:111-121.

[29] LIU J, XIANG J, JIN Y, et al. Boost precision agricul‐ture with unmanned aerial vehicle remote sensing and edge intelligence: A survey[J]. Remote Sensing, 2021, 13(21): ID 4387.

[30] VOULODIMOS A, DOULAMIS N, DOULAMIS A,et al. Deep learning for computer vision: A brief re‐ view[J]. Computational Intelligence and Neuroscience, 2018, 2018: ID 7068349.

[31] NAZIR M N M M, TERHEM R, NORHISHAM A R,et al. Early monitoring of health status of plantation- grown eucalyptus pellita at large spatial scale via visi‐ble spectrum imaging of canopy foliage using un‐ manned aerial vehicles[J]. Forests, 2021, 12(10): ID1393.

[32] DUTTA K, TALUKDAR D, BORA S S. Segmentationof unhealthy leaves in cruciferous crops for early dis‐ ease detection using vegetative indices and Otsu thresh‐olding of aerial images[J]. Measurement, 2022, 189:ID 110478.

[33] MAES W H, STEPPE K. Perspectives for remote sens‐ing with unmanned aerial vehicles in precision agricul‐ture[J]. Trends in Plant Science, 2019, 24(2):152-164.

[34] CALOU V B C, TEIXEIRA A D S, MOREIRA L C J,et al. The use of UAVs in monitoring yellow sigatoka in banana[J]. Biosystems Engineering, 2020, 193:115-125.

[35] DANG L M, HASSAN S I, SUHYEON I, et al. UAVbased wilt detection system via convolutional neuralnetworks[J]. Sustainable Computing: Informatics andSystems, 2020, 28: ID 100250.

[36] HUANG H, DENG J, LAN Y, et al. Detection of hel‐minthosporium leaf blotch disease based on UAV imag‐ery[J]. Applied Sciences, 2019, 9(3): ID 558.

[37] DEL-CAMPO-SANCHEZ A, BALLESTEROS R,HERNANDEZ-LOPEZ D, et al. Quantifying the effectof Jacobiascalybica pest on vineyards with UAVsby combining geometric and computer vision tech‐niques[J]. PLoS One, 2019, 14(4): ID e0215521.

[38] TETILA E C, MACHADO B B, ASTOLFI G, et al.Detection and classification of soybean pests usingdeep learning with UAV images[J]. Computers andElectronics in Agriculture, 2020, 179: ID 105836.

[39] PADUA L, MARQUES P, MARTINS L, et al. Monitor‐ing of chestnut trees using machine learning techniquesapplied to UAV-based multispectral data[J]. RemoteSensing, 2020, 12(18): ID 3032.

[40] SU J, LIU C, HU X, et al. Spatio-temporal monitoringof wheat yellow rust using UAV multispectral imag‐ery[J]. Computers and electronics in agriculture, 2019,167: ID 105035.

[41] ATSHAN L A, BROWN P, XU C, et al. Early detec‐tion of disease infection in chilli crops using sen‐sors[C]// International Horticultural Congress, Istan‐bul, Turkey: ISHS, 2018:263-270.

[42] YE H, HUANG W, HUANG S, et al. Recognition ofbanana fusarium wilt based on UAV remote sensing[J].Remote Sensing, 2020, 12(6): ID 938.

[43] KALISCHUK M, PARET M L, FREEMAN J H, et al.An improved crop scouting technique incorporating un‐manned aerial vehicle – assisted multispectral crop im‐aging into conventional scouting practice for gummystem blight in watermelon[J]. Plant Disease, 2019, 103(7):1642-1650.

[44] MARSTON Z P D, CIRA T M, HODGSON E W, et al.Detection of stress induced by soybean aphid (Hemip‐tera: Aphididae) using multispectral imagery from un‐manned aerial vehicles[J]. Journal of Economic Ento‐mology, 2020, 113(2):779-786.

[45] VIERA-TORRES M, SINDE-GONZALEZ I, GIL-DOCAMPO M, et al. Generating the baseline in theearly detection of bud rot and red ring disease in oilpalms by geospatial technologies[J]. Remote Sensing,2020, 12(19): ID 3229.

[46]趙晋陵, 金玉, 叶回春, 等.基于无人机多光谱影像的槟榔黄化病遥感监测[J].农业工程学报, 2020, 36(8):54-61.

ZHAO J, JIN Y, YE H, et al. Remote sensing monitor‐ing of areca yellow leaf disease based on UAV multi- spectral images[J]. Transactions of the CSAE, 2020, 36(8):54-61.

[47] LEI S, LUO J, TAO X, et al. Remote sensing detectingof yellow leaf disease of arecanut based on UAV multi‐ source sensors[J]. Remote Sensing, 2021, 13(22): ID4562.

[48] DADRASJAVAN F, SAMADZADEGAN F, POURA ‐ZAR S H S, et al. UAV-based multispectral imagery for fast citrus greening detection[J]. Journal of Plant Diseases and Protection, 2019, 126(4):307-318.

[49] CHANG A, YEOM J, JUNG J, et al. Comparison ofcanopy shape and vegetation indices of citrus trees de‐ rived from UAV multispectral images for characteriza‐tion of citrus greening disease[J]. Remote Sensing, 2020, 12(24): ID 4122.

[50] CHEN T, YANG W, ZHANG H, et al. Early detectionof bacterial wilt in peanut plants through leaf-level hy‐perspectral and unmanned aerial vehicle data[J]. Com ‐puters and Electronics in Agriculture, 2020, 177: ID105708.

[51] HEIM R H J, WRIGHT I J, SCARTH P, et al. Multi‐spectral, aerial disease detection for myrtle rust (Aus‐tropucciniapsidii) on a lemon myrtle plantation[J]. Drones, 2019, 3(1): ID 25.

[52] LE?N-RUEDA W A, LE?N C, CARO S G, et al.Identification of diseases and physiological disorders in potato via multispectral drone imagery using ma‐ chine learning tools[J]. Tropical Plant Pathology, 2021:1-16.

[53] SU J, YI D, SU B, et al. Aerial visual perception insmart farming: Field study of wheat yellow rust moni‐toring[J]. IEEE Transactions on Industrial Informatics, 2020, 17(3):2242-2249.

[54] DI NISIO A, ADAMO F, ACCIANI G, et al. Fast de‐tection of olive trees affected by xylella fastidiosa from UAVs using multispectral imaging[J]. Sensors, 2020, 20(17): ID 4915.

[55]马云强, 李宇宸, 刘梦盈, 等.基于无人机多光谱影像的云南切梢小蠹危害监测反演研究[J].西南农业学报, 2021, 34(9):1878-1884.

MA Y, LI Y, LIU M, et al. Harm monitoring and inver‐sion study on Tomicusyunnanensis based on multi- spectral image of unmanned aerial vehicle[J]. South‐ west China Journal of Agricultural Sciences, 2021, 34(9):1878-1184.

[56] IZZUDDIN M A, HAMZAH A, NISFARIZA M N, etal. Analysis of multispectral imagery from unmannedaerial vehicle (UAV) using object-based image analy‐sis for detection of Ganoderma disease in oil palm[J].Journal of Oil Palm Research, 2020, 32(3):497-508.

[57] RODR?GUEZ J, LIZARAZO I, PRIETO F, et al. As‐sessment of potato late blight from UAV-based multi‐spectral imagery[J]. Computers and Electronics in Ag‐riculture, 2021, 184: ID 106061.

[58] WANG T, THOMASSON J A, ISAKEIT T, et al. Aplant-by-plant method to identify and treat cotton rootrot based on UAV remote sensing[J]. Remote Sensing,2020, 12(15): ID 2453.

[59] ZHANG T, XU Z, SU J, et al. Ir-UNet: Irregular seg‐mentation u-shape network for wheat yellow rust detec‐tion by UAV multispectral imagery[J]. Remote Sens‐ing, 2021, 13(19): ID 3892.

[60]馬书英, 郭增长, 王双亭, 等.板栗树红蜘蛛虫害无人机高光谱遥感监测研究[J].农业机械学报 , 2021, 52(4):171-180.

MA S, GUO Z, WANG S, et al. Hyperspectral remotesensing monitoring of Chinese chestnut red mite insectpests in UAV[J]. Transactions of the CSAM, 2021, 52(4):171-180.

[61]郭伟, 乔红波, 赵恒谦, 等.基于比值导数法的棉花蚜害无人机成像光谱监测模型研究[J].光谱学与光谱分析, 2021, 41(5):1543-1550.

GUO W, QIAO H, ZHAO H, et al. Cotton aphid dam ‐age monitoring using UAV hyperspectral data based onderivative of ratio spectroscopy[J]. Spectroscopy andSpectral Analysis, 2021, 41(5):1543-1550.

[62]郑蓓君, 陈芸芝, 李凯, 等.高光谱数据的刚竹毒蛾虫害程度检测[J].光谱学与光谱分析 , 2021, 41(10):3200-3207.

ZHENG P, CHEN Y, LI K, et al. Detection of pest de‐gree of phyllostachys Chinese with hyperspectraldata[J]. Spectroscopy and Spectral Analysis, 2021, 41(10):3200-3207.

[63]郭伟, 朱耀辉, 王慧芳, 等.基于无人机高光谱影像的冬小麦全蚀病监测模型研究[J].农业机械学报 ,2019, 50(9):162-169.

GUO W, ZHU Y, WANG H, et al. Monitoring model ofwinter wheat take-all based on UAV hyperspectral im‐aging[J]. Transactions of the CSAM, 2019, 50(9):162-169.

[64]梁輝, 何敬, 雷俊杰.无人机高光谱的玉米冠层大斑病监测[J].光谱学与光谱分析 , 2020, 40(6):1965-1972.

LIANG H, HE J, LEI J. Monitoring of corn canopyblight disease based on UAV hyperspectral method[J].Spectroscopy and Spectral Analysis, 2020, 40(6):1965-1972.

[65]桑佳茂, 陈丰农.基于光谱特征点秩和检验的稻曲病发病程度检测[J].光谱学与光谱分析 , 2021, 41(10):3214-3219.

SANG J, CHEN F. Detection of rice false smut grade degree based on the rank sum test of spectral feature points[J]. Spectroscopy and Spectral Analysis, 2021, 41(10):3214-3219.

[66] SONG P, ZHENG X, LI Y, et al. Estimating reed losscaused by Locusta migratoriamanilensis using UAV- based hyperspectral data[J]. Science of the Total Envi‐ronment, 2020, 719: ID 137519.

[67] LIU L, DONG Y, HUANG W, et al. Monitoring wheatFusarium head blight using unmanned aerial vehicle hyperspectral imagery[J]. Remote Sensing, 2020, 12(22): ID 3811.

[68] MA H, HUANG W, DONG Y, et al. Using UAV-basedhyperspectral imagery to detect winter wheat fusarium head blight[J]. Remote Sensing, 2021, 13(15): ID 3024.

[69] GUO A, HUANG W, DONG Y, et al. Wheat yellowrust detection using UAV-based hyperspectral technolo‐gy[J]. Remote Sensing, 2021, 13(1): ID 123.

[70]孔繁昌, 刘焕军, 于滋洋, 等.高寒地区粳稻穗颈瘟的无人机高光谱遥感识别[J].农业工程学报 , 2020, 36(22):68-75.

KONG F, LIU H, YU Z, et al. Identification of japoni‐ ca rice panicle blast in alpine region by UAV hyper‐ spectral remote sensing[J]. Transactions of the CSAE, 2020, 36(22):68-75.

[71] DENG X, ZHU Z, YANG J, et al. Detection of citrusHuanglongbing based on multi-input neural network model of UAV hyperspectral remote sensing[J]. Re‐ mote Sensing, 2020, 12(17): ID 2678.

[72] ABDULRIDHA J, BATUMAN O, AMPATZIDIS Y.UAV-based remote sensing technique to detect citrus canker disease utilizing hyperspectral imaging and ma‐ chine learning[J]. Remote Sensing, 2019, 11(11): ID1373.

[73] ABDULRIDHA J, AMPATZIDIS Y, ROBERTS P, etal. Detecting powdery mildew disease in squash at dif‐ferent stages using UAV-based hyperspectral imaging and artificial intelligence[J]. Biosystems Engineering, 2020, 197:135-148.

[74] BOHNENKAMP D, BEHMANN J, MAHLEIN A K.In-field detection of yellow rust in wheat on the ground canopy and UAV scale[J]. Remote Sensing, 2019, 11(21): ID 2495.

[75] ABDULRIDHA J, AMPATZIDIS Y, KAKARLA S C,et al. Detection of target spot and bacterial spot diseas‐ es in tomato using UAV-based and benchtop-based hy‐perspectral imaging techniques[J]. Precision Agricul‐ture, 2020, 21(5):955-978.

[76] ABDULRIDHA J, AMPATZIDIS Y, QURESHI J, etal. Laboratory and UAV-based identification and classi‐fication of tomato yellow leaf curl, bacterial spot, andtarget spot diseases in tomato utilizing hyperspectralimaging and machine learning[J]. Remote Sensing,2020, 12(17): ID 2732.

[77]鄧小玲, 曾国亮, 朱梓豪, 等.基于无人机高光谱遥感的柑橘患病植株分类与特征波段提取[J].华南农业大学学报, 2020, 41(6):100-108.

DENG X, ZENG G, ZHU Z, et al. Classification andfeature band extraction of diseased citrus plants basedon UAV hyperspectral remote sensing[J]. Journal ofSouth China Agricultural University, 2020, 41(6):100-108.

[78] MACDONALD S L, STAID M, STAID M, et al. Re‐mote hyperspectral imaging of grapevine leafroll-asso‐ciated virus 3 in cabernet sauvignon vineyards[J]. Com ‐puters and Electronics in Agriculture, 2016, 130:109-117.

[79] GARCIA-RUIZ F, SANKARAN S, MAJA J M, et al.Comparison of two aerial imaging platforms for identi‐fication of Huanglongbing-infected citrus trees[J].Computers and Electronics in Agriculture, 2013, 91:106-115.

[80] MCCANN C, REPASKY K S, LAWRENCE R, et al.Multi-temporal mesoscale hyperspectral data of mixedagricultural and grassland regions for anomaly detec‐tion[J]. ISPRS Journal of Photogrammetry and RemoteSensing, 2017, 131:121-133.

[81] ZHANG X, HAN L, DONG Y, et al. A deep learning-based approach for automated yellow rust diseasedetection from high-resolution hyperspectral UAV im‐ages[J]. Remote Sensing, 2019, 11(13): ID 1554.

[82] AN G, XING M, HE B, et al. Extraction of areas ofrice false smut infection using UAV hyperspectral da‐ta[J]. Remote Sensing, 2021, 13(16): ID 3185.

[83] XIAO Y, DONG Y, HUANG W, et al. Wheat fusariumhead blight detection using UAV-based spectral andtexture features in optimal window size[J]. RemoteSensing, 2021, 13(13): ID 2437.

[84] FRANCESCONI S, HARFOUCHE A, MAESANO M,et al. UAV-based thermal, RGB imaging and gene ex‐pression analysis allowed detection of fusarium headblight and gave new insights into the physiological re‐sponses to the disease in durum wheat[J]. Frontiers inPlant Science, 2021, 12: ID 551.

[85]陈欣欣, 刘子毅, 吕美巧, 等.基于热红外成像技术的油菜菌核病早期检测研究[J].光谱学与光谱分析 ,2019, 39(3):730-737.

CHEN X, LIU Z, LYU M, et al. Diagnosis and moni‐toring of sclerotinia stem rot of oilseed rape using ther‐ mal infrared imaging[J]. Spectroscopy and Spectral Analysis, 2019, 39(3):730-737.

[86] LIN Q, HUANG H, WANG J, et al. Detection of pineshoot beetle (PSB) stress on pine forests at individual tree level using UAV-based hyperspectral imagery and lidar[J]. Remote Sensing, 2019, 11(21): ID 2540.

[87] BRIECHLE S, KRZYSTEK P, VOSSELMAN G. Clas‐sification of tree species and standing dead trees by fus‐ing UAV-based lidar data and multispectral imagery in the 3D deep neural network PointNet++[J]. ISPRS An‐nals of the Photogrammetry, Remote Sensing and Spa‐tial Information Sciences, 2020, 2:203-210.

[88] SAVIAN F, MARTINI M, ERMACORA P, et al. Pre‐diction of the kiwifruit decline syndrome in diseased orchards by remote sensing[J]. Remote Sensing, 2020, 12(14): ID 2194.

[89] YU R, LUO Y, ZHOU Q, et al. A machine learning al‐gorithm to detect pine wilt disease using UAV-based hyperspectral imagery and LiDAR data at the tree level[J]. International Journal of Applied Earth Obser‐vation and Geoinformation, 2021, 101: ID 102363.

[90] SMIGAJ M, GAULTON R, SUAREZ J C, et al. Cano‐py temperature from an unmanned aerial vehicle as an indicator of tree stress associated with red band needle blight severity[J]. Forest Ecology and Management, 2019, 433:699-708.

[91] KERKECH M, HAFIANE A, CANALS R. VddNet:Vine disease detection network based on multispectral images and depth map[J]. Remote Sensing, 2020, 12(20): ID 3305.

[92] KERKECH M, HAFIANE A, CANALS R. Vine dis‐ease detection in UAV multispectral images using opti‐mized image registration and deep learning segmenta‐tion approach[J]. Computers and Electronics in Agri‐ culture, 2020, 174: ID 105446.

[93] MORIYA ? A S, IMAI N N, TOMMASELLI A M G,et al. Detection and mapping of trees infected with cit‐rus gummosis using UAV hyperspectral data[J]. Com ‐puters and Electronics in Agriculture, 2021, 188: ID106298.

[94]趙晓阳, 张建, 张东彦, 等.低空遥感平台下可见光与多光谱传感器在水稻纹枯病病害评估中的效果对比研究[J].光谱学与光谱分析, 2019, 39(4):1192-1198.

ZHAO X, ZHANG J, ZHANG D, et al. Comparison between the effects of visible light and multispectral sensor based on low-altitude remote sensing platform in the evaluation of rice sheath blight[J]. Spectroscopy and Spectral Analysis, 2019, 39(4):1192-1198.

[95] DANG L, WANG H, LI Y, et al. Fusarium wilt of rad‐ish detection using RGB and near infrared images fromunmanned aerial vehicles[J]. Remote Sensing, 2020, 12(17): ID 2863.

[96] AWAIS M, LI W, CHEEMA M J M, et al. Remotelysensed identification of canopy characteristics usingUAV-based imagery under unstable environmental con‐ditions[J]. Environmental Technology & Innovation,2021, 22: ID 101465.

[97] FENG L, CHEN S, ZHANG C, et al. A comprehensivereview on recent applications of unmanned aerial vehi‐cle remote sensing with various sensors for high-throughput plant phenotyping[J]. Computers and Elec‐tronics in Agriculture, 2021, 182: ID 106033.

[98] RUBIO-HERVAS J, GUPTA A, ONG Y S. Data-drivenrisk assessment and multicriteria optimization of UAVoperations[J]. Aerospace Science and Technology,2018, 77:510-523.

[99] HUSSEIN M, NOUACER R, CORRADI F, et al. Keytechnologies for safe and autonomous drones[J]. Mi‐croprocessors and Microsystems, 2021, 87: ID 104348.

[100]MUKHERJEE A, MISRA S, RAGHUWANSHI N S. Asurvey of unmanned aerial sensing solutions in preci‐sion agriculture[J]. Journal of Network and ComputerApplications, 2019, 148: ID 102461.

[101]黄文江, 师越, 董莹莹, 等.作物病虫害遥感监测研究进展与展望[J].智慧农业, 2019, 1(4):1-11.

HUANG W, SHI Y, DONG Y, et al. Progress and pros‐pects of crop diseases and pests monitoring by remotesensing[J]. Smart Agriculture, 2019, 1(4):1-11.

[102] MIGNONI M E, HONORATO A, KUNST R, et al.Soybean images dataset for caterpillar and Diabroticaspeciosa pest detection and classification[J]. Data inBrief, 2021: ID 107756.

[103]OUHAMI M, HAFIANE A, ES-SAADY Y, et al. Com ‐puter vision, IoT and data fusion for crop disease detec‐tion using machine learning: A survey and ongoing re‐search[J]. Remote Sensing, 2021, 13(13): ID 2486.

[104] LI F, LIU Z, SHEN W, et al. A remote sensing and air‐borne edge-computing based detection system for pinewilt disease[J]. IEEE Access, 2021, 9:66346-66360.

[105]蘭玉彬, 邓小玲, 曾国亮.无人机农业遥感在农作物病虫草害诊断应用研究进展[J].智慧农业 , 2019, 1(2):1-19.

LAN Y, DENG X, ZENG G. Advances in diagnosis ofcrop diseases, pests and weeds by UAV remote sens‐ing[J]. Smart Agriculture, 2019, 1(2):1-19.

[106] ELNABTY I A, FAHMY Y, KAFAFY M. A survey onUAV placement optimization for UAV-assisted commu‐nication in 5G and beyond networks[J]. Physical Com ‐munication, 2021: ID 101564.

[107] MISHRA D, NATALIZIO E. A survey on cellular-con‐nected UAVs: Design challenges, enabling 5G/B5G in‐novations, and experimental advancements[J]. Comput‐er Networks, 2020, 182: ID 107451.

Methods and New Research Progress of Remote Sensing Monitoring of Crop Disease and Pest Stress UsingUnmanned Aerial Vehicle

YANG Guofeng1,2,3 , HE Yong1,2,3* , FENG Xuping1,2,3 , LI Xiyao1,2,3 , ZHANG Jinnuo1,2,3 , YU Zeyu1,2,3

(1. Huanan Industrial Technology Research Institute of Zhejiang University, Guangzhou 510700, China;

2. College of Biosystems Engineering and Food Science, Zhejiang University, Hangzhou 310058, China;

3. The Key Laboratory of Spectroscopy Sensing, Ministry of Agriculture and Rural Affairs, Hangzhou 310058, China )

Abstract: Diseases and pests are main stresses to crop production. It is necessary to accurately and quickly monitor and control the stresses dynamically, so as to ensure the food security and the quality and safety of agricultural products, protect the ecologi‐cal environment, and promote the sustainable development of agriculture. In recent years, with the rapid development of the un‐ manned aerial vehicle (UAV) industry, UAV agricultural remote sensing has played an important role in the application of crop diseases and pests monitoring due to its high image spatial resolution, strong data acquisition timeliness and low cost. The rele‐vant background of UAV remote sensing monitoring of crop disease and pest stress was introduced, then the current methods commonly used in remote sensing monitoring of crop disease and pest stress by UAV was summarized. The data acquisition method and data processing method of UAV remote sensing monitoring of crop disease and pest stress were mainly discussed. Then, from the six aspects of visible light imaging remote sensing, multispectral imaging remote sensing, hyperspectral imaging remote sensing, thermal infrared imaging remote sensing, LiDAR imaging remote sensing and multiple remote sensing fusion and comparison, the research progress of remote sensing monitoring of crop diseases and pests by UAV worldwide was re‐ viewed. Finally, the unresolved key technical problems and future development directions in the research and application of UAV remote sensing monitoring of crop disease and pest stress were proposed. Such as, the performance of the UAV flight plat‐ form needs to be optimized and upgraded, as well as the development of low-cost, lightweight, modular, and more adaptable air‐ borne sensors. Convenient and automated remote sensing monitoring tasks need to be designed and implemented, and more re‐ mote sensing monitoring information can be obtained. Data processing algorithms or software should be designed and devel‐oped with greater applicability and wider applicability, and data processing time should be shortened by using 5G-based commu‐nication networks and edge computing devices. The applicability of the algorithm or model for UAV remote sensing monitoring of crop disease and pest stress needs to be stronger, so as to build a corresponding method library. We hope that this paper can help Chinese UAV remote sensing monitoring of crop diseases and pests to achieve more standardization, informatization, preci‐sion and intelligence.

Key words: unmanned aerial vehicle; remote sensing monitoring; diseases and pests stress; data acquisition; data processing; deep learning; multiple remote sensing fusion