基于三目视觉标定的机器人精确移载视觉系统*

2017-11-30张栋梁

曲 豪,张栋梁

(河南广播电视大学 信息工程学院,郑州 450008)

基于三目视觉标定的机器人精确移载视觉系统*

曲 豪,张栋梁

(河南广播电视大学 信息工程学院,郑州 450008)

为了解决当前机器人视觉系统精度不稳定和单位作业时间过长,且缺乏自动补偿功能的不足,文章分别从系统硬件结构改进和软件算法优化的角度出发,提出了基于三目视觉的机器人视觉系统。首先,搭建PLC感应器、机器人和视觉PC之间的逻辑通信通道,达到材料运行状态实时获取与处理的目的。然后,根据机器人与视觉坐标系之间的缩放旋转平移参数,设计9点标定法,对三个工业相机进行标定,达到图像像素坐标与机器人世界坐标的精准绑定。最后,根据产品工程基准,选取感兴趣区域,优化最小均方误差匹配算法,达到系统精度与速度的平衡。实验测试结果显示:与当前机器人视觉系统相比,文中系统拥有更高的视觉准确度与作业效率。

三目视觉;9点标定;最小均方误差匹配

0 引言

近年来,机器视觉和机器人愈来愈多的应用到工业自动化生产,尤其是带有计算机视觉的机器人,为工厂无人化和智能化的实现与提高生产效率、质量,创造了有利条件[1-2]。目前,国内外开始把计算机的快速性、可靠性、结果得可重复性,与人类视觉的高度智能化和抽象能力相结合,产生机器人视觉引导技术[3-4]。但是国内自动化行业多数企业的规模小,整体行业实力相对国外还是较为落后,尤其是处在自动化设备核心的机器人视觉方面。机器人视觉达到机械手代替人力,视觉代替人眼,无疑又是实现智能化生产的关键技术。

在机器人视觉方面,国内研究人员已经取得了一定研究成果,如胡明星[5]提出了基于Canny检测与SIFT特征的旋转工件目标识别算法。首先,对采集工件图像的RGB三通道完成权重分配,获取灰度化图像;并利用Canny边缘检测和霍夫直线检测处理灰度图像,计算出工件旋转角度;并基于几何变换,定义图像校正模型,消除工件旋转角度,对其完成复位处理,并采用最小均方误差匹配在图像中定位工件,达到定位引导目的。但是,此技术未充分考虑定位不准确时,系统如何补偿,异常发生时,往往影响了机器人视觉准确性。潘悦维[6]将双目视觉引入移动机器人中,提出了基于双目视觉的机器人作业技术,主要集中在对摄像机定位,拍摄图像的分割计算,模式的坐标识别,探测目标距离,将视觉系统应用到机器人中的运用与分析,达到了视觉定位标定目的。然而,这种技术仅采用两个相机一次标定,在相机与机器人相对位置不可预知时,往往不能准确绑定机器人与相机坐标系。

为此,为了提高机器视觉系统实现搬运作业的稳定性,以及平衡系统精度与速度, 本文提出了基于三目视觉的机器人视觉系统,并编程实现与验证本文机器人视觉系统的功能。

1 本文机器人精确移载视觉系统

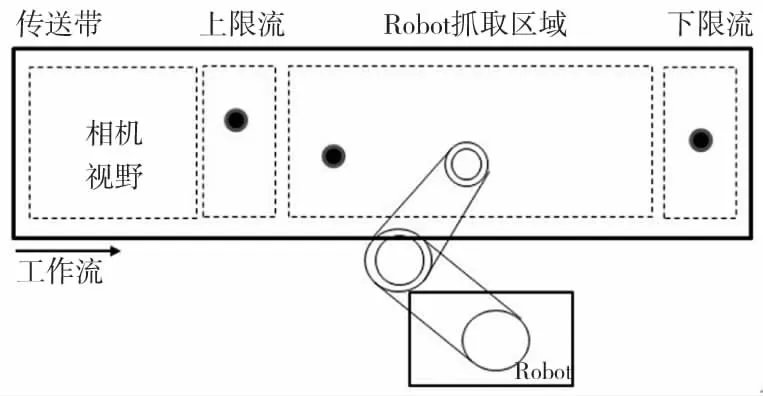

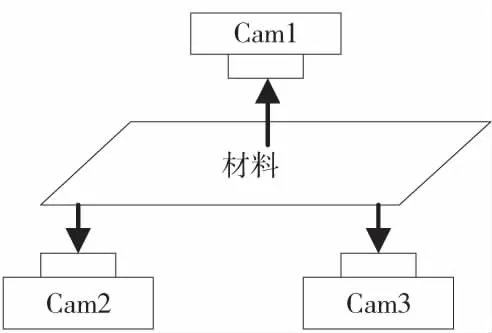

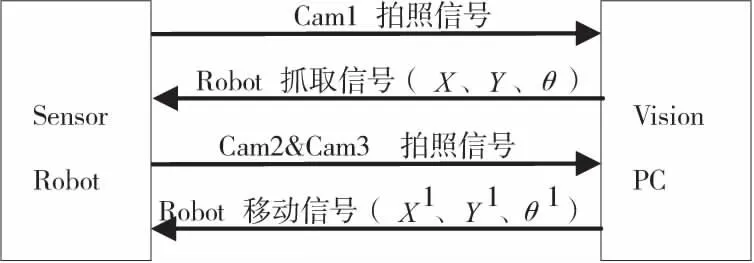

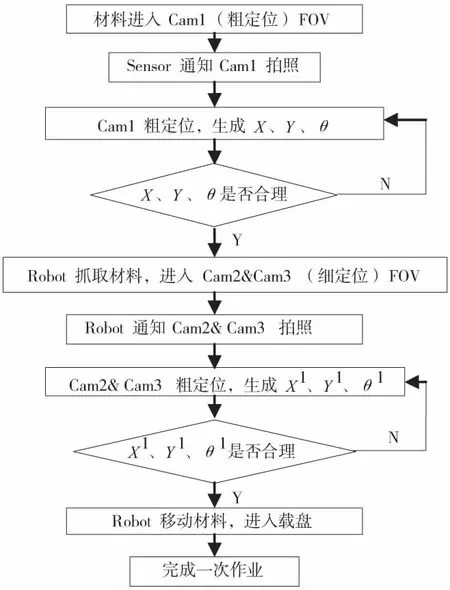

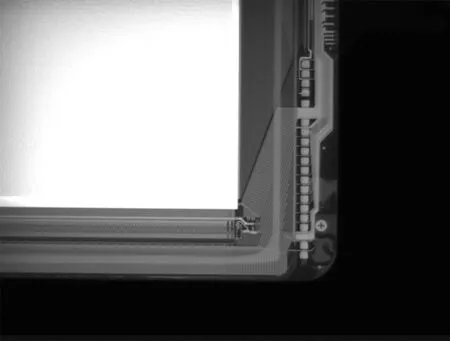

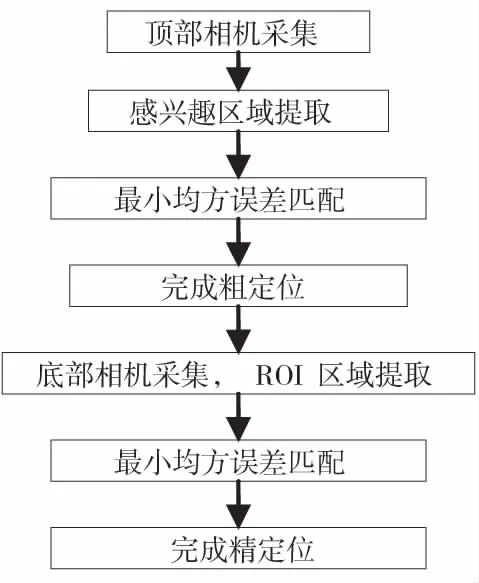

机器人视觉系统架构如图1所示,材料通过传送带的运送,通过相机视野区域,拍照获取材料位置,通过视觉系统分析,引导机器人进入抓取区域,准确抓取材料放入视觉处的空盘中。视觉硬件打光方式如图2所示,顶部相机采集材料整体,进行粗定位,底部相机采集材料两角上的mark(基点),进行精定位。系统通信逻辑如图3所示,PLC感应器第一时间感知材料到位,硬触发相机拍照,得到粗定位坐标,引导机器人抓取,机器人在物流过程中硬触发底部两个相机采集,得到精定位坐标,进一步精准引导机器人视觉。软件系统整体架构如图4所示,三目相机,二次触发拍照,定位分为粗定位和精定位,目的是保证视觉系统的准确性和稳定性。

图1 机器人视觉系统架构

图2 视觉打光结构

图3 系统通信逻辑

图4 系统软件架构

1.1 三目视觉标定

为了达到机器人准确抓取材料完成视觉作业目的,首先需要建立机器人世界坐标与视觉图像像素坐标的精准绑定,即视觉系统给出机器人能够看懂的坐标。为此,本文建立三目视觉标定机制,其过程如下:

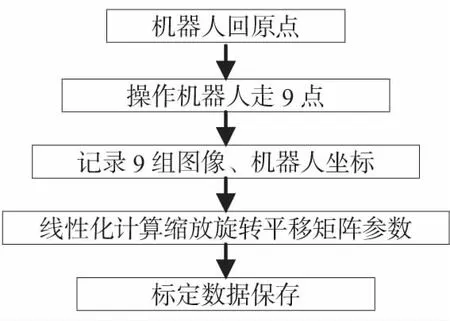

(1) 以9点法,操作机器人法兰盘走在相机视野内走9点,生成9个机器人世界坐标,并在标定板上留下标注;

(2) 获取对应标注点的图像像素坐标,和以上9个机器人坐标一同对应的导入本文开发的9点标定软件UI,完成顶部相机标定,为粗定位抓取做好准备;

(3)底部两个相机共用同一个机器人坐标系,每个相机分别进行(1)、(2)的标定过程,完成底部双相机标定,为精定位抓取做好准备。

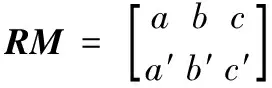

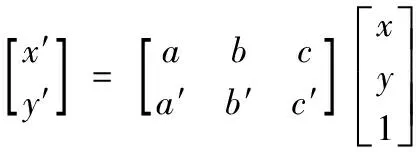

本文9点标定算法核心是计算图像像素坐标与机器人世界坐标之间的缩放旋转平移矩阵,建立数学模型如式(1)所示:

(1)

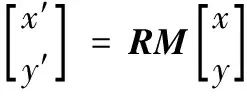

式中,R为缩放旋转矩阵,a、b、a′、b′、c、c′为缩放旋转平移矩阵参数元素。联立缩放旋转平移矩阵、图像像素坐标和机器人世界坐标,如式(2)所示:

(2)

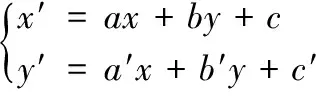

式中, (x,y)为图像像素坐标,(x′,y′)为机器人世界坐标,该式代表图像像素坐标与机器人世界坐标的转换关系,分解后如式(3)所示:

(3)

接着进行行列式化:

(4)

将式(3)转换为式(4),则a、b、c、a′、b′、c′构成旋转缩放平移矩阵。随后,操作机器人再走9个点,记录其对应Robot坐标和图像坐标,然后代入式(4),可得:

(5)

(6)

图5 标定算法流程

1.2 基于感兴趣区域的快速最小均方误差匹配

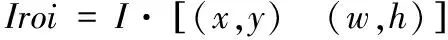

工业制造领域的视觉定位难点在于速度和精度的平衡,比如归一化相关匹配,采用逐个像素比较模板图像与目标图像,虽然定位精准,但是运算量大,不符合制造现场对效率的要求[7-8]。在给予时间不充足的情况,往往出现定位不准确。本文提出最小均方误差匹配,以特征点取代逐个像素匹配,从而在不影响精度情况下,减少运算时间,同时引入感兴趣区域(ROI)机制[9],即在图像部分区域内进行最小均方误差匹配,进一步较少图像处理数据量。

ROI提取运算如下:

(7)

式中,I为原始待处理图像,Iroi为经过ROI提取处理的图像,(x,y)为感兴趣区域左上角点坐标,(w,h)为感兴趣区域宽和长。在此基础上进最小均方误差匹配,以模板中特征点构造矩阵X,Y,目标图像的特征点构造矩阵x1,y1,求解x,y到x1,y1的变换矩阵,其中均方误差最小的位置为最佳匹配位置[10]。变换方程如下:

(8)

(9)

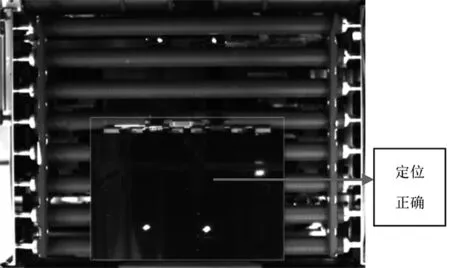

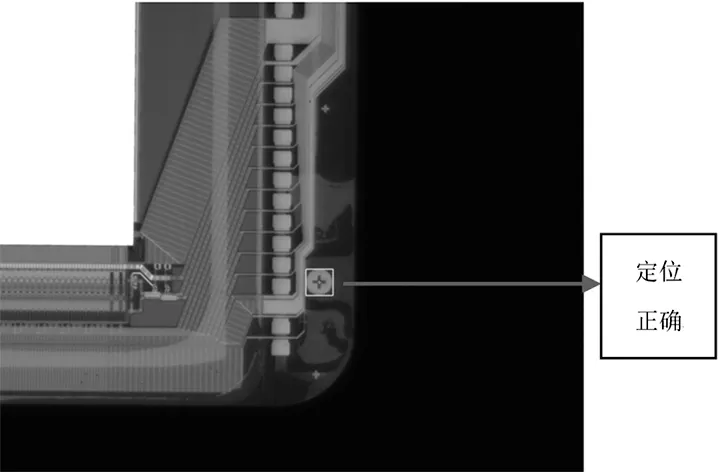

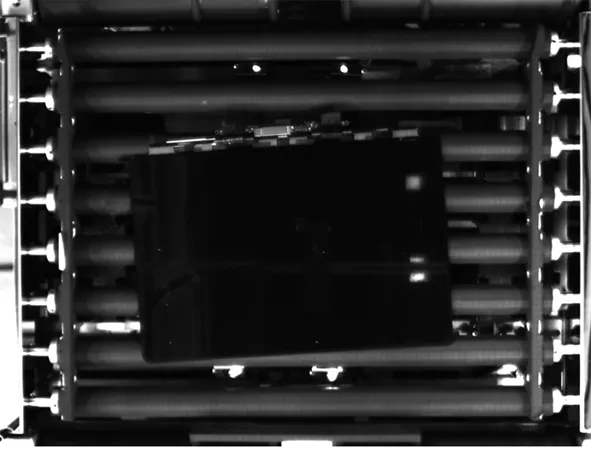

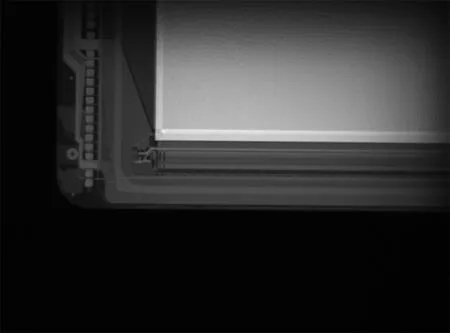

(a)顶部相机采集原图

(b) 底部相机采集原图图6 工件图像采集

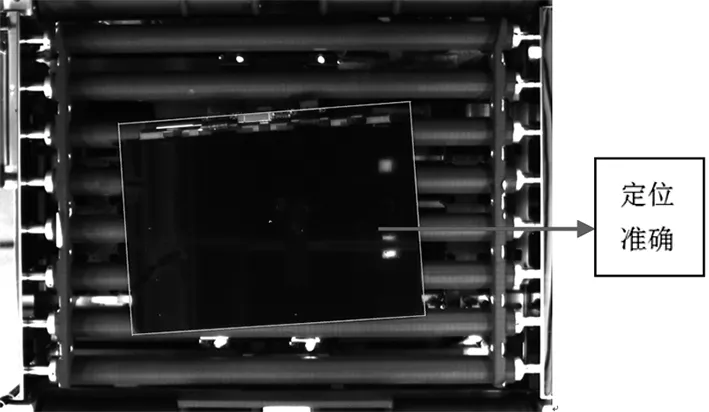

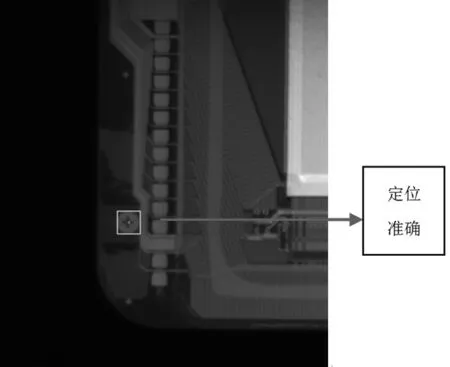

(a)顶部相机定位成功

(b)底部相机定位成功图7 工件图像的定位

图8 定位算法流程

2 实验与讨论

为了体现本文算法的优势,将定位视觉性能较好的技术-文献[5]、文献[6]设为对照组,本文系统基于VS2015平台开发实现,算法实验参数如:缩放旋转平移矩阵为[3221,4355,-4633,-4231,4335,-4623]。

本文机器人视觉系统结合粗定位和细定位的处理流程,基于三目标定实现机器人坐标与图像坐标的绑定,利用ROI区域与最小均方误差匹配实现材料图像坐标的精确定位。图9a为材料整体的采集,为粗定位准备,图9b为材料局部基准点的采集,为细定位准备。经过本文算法定位后,如图9c所示,准确粗定位材料轮廓,同时用绿色标注出材料轮廓,如图9d所示,准确定位基准点。

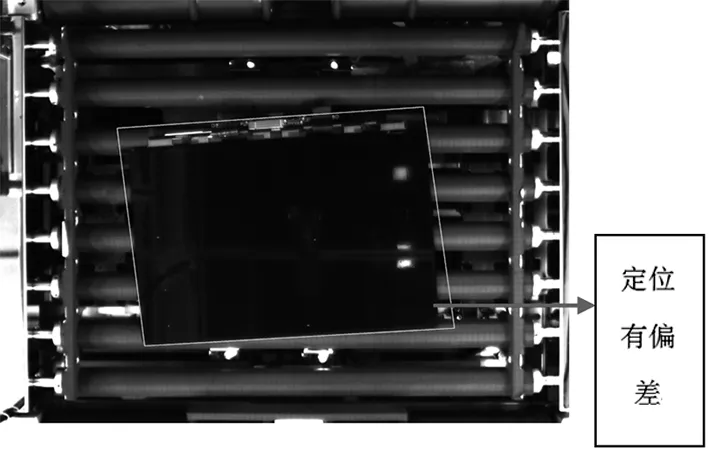

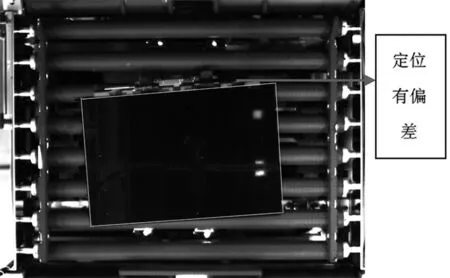

而利用对照组文献[5]技术,只进行粗定位,即只处理图9a,由于此技术未充分考虑定位不准确时,系统如何补偿,异常发生时,往往影响了机器人视觉准确性,如图10所示, 以绿色标注,可见存在明显的定位偏差,影响视觉作业的完成。

利用对照组文献[6]技术,只进行粗定位,即只处理图9a,由于依赖大量固定样本,在机器人与相机相对关系未知且多变时,往往不能精确完成标定,同时缺乏定位精细度,如图11所示, 绿色标注,其无法将完整的工件定位出来,存在较大的偏差。

另外,为了衡量所提算法与文献[5]、文献[6]技术的移载效率,以图10a为目标,利用本文机器人视觉系统对其进行作业,其工作效率最高,其下料完成的时耗仅为1186ms,而文献[5]、文献[6]的效率较低,其时耗均远高于本文视觉系统,分别为1776ms、 2046ms。原因是本文算法首先根据产品工程基准,提取ROI区域,减少图像处理的数据量;然后通过特征点构建得最小均方误差匹配,快速完成定位,而文献[5]、文献[6]则是对整个图像的所有像素进行逐个比较,造成较大巨大的计算代价。

(a)待处理材料整体原图

(b) 待处理材料基准点原图

(c)粗定位结果

(d)细定位结果图9 本文算法的定位结果

图10 Canny检测联合SIFT特征的标定结果

图11 双目视觉的标定结果

3 结论

本文分别从系统硬件和软件出发,提出了基于三目视觉的机器人视觉系统。首先,搭建系统逻辑通信通道,达到实时处理目的。然后设计9点标定法,达到图像像素坐标与机器人世界坐标的精准绑定目的。最后,结合选取感兴趣区域和最小均方误差匹配,达到精确定位材料的目的,实验结果表明:相较普通技术,本文的机器人视觉技术具有更高精度和稳定性。

[1] 许杰,戚大伟. 基于改进加权质心和UKF的移动目标定位算法[J]. 吉林大学学报(工学版),2016, 46(4):1354-1359.

[2] Ramon Cascaes Semim, Roberto S U Rosso. Engine Head Blocks Handling Robot Guided by Vision System[J]. IFAC Proceedings Volumes, 2012, 45 (6): 23-29.

[3] 徐敏, 陈州尧. 一种移动码垛机器人视觉控制与定位[J]. 组合机床与自动化加工技术,2016(8): 93-95.

[4] Sho′ji Suzuki, Ryoutarou Suda. A vision system with wide field of view and collision alarms for teleoperation of mobile robots[J]. ROBOMECH Journal, 2014, 1 (1): 1-17

[5] 胡明星. 最小均方误差匹配优化耦合图像校正的旋转工件目标定位算法[J]. 组合机床与自动化加工技术,2016(6):35-38.

[6] 潘悦维. 基于双目视觉的移动机器人平台设计[D]. 广州: 华南理工大学, 2013.

[7] Anonymous. Vision algorithms added to graphical programming software[J]. Vision Systems Design, 2013, 18 (9): 13-15.

[8] 杨娜,秦志远,李忠涛. 一种快速归一化相关匹配算法[J]. 信息工程大学学报, 2014, 15(2): 215-218.

[9] Weisheng Li, Peng Dong, Bin Xiao. Object recognition based on the Region of Interest and optimal Bag of Words model[J]. Neurocomputing, 2016, 172(8): 271-280.

[10] 林巨广,童洋洋,韩金娥,等. 基于球面约束的机器人系统标定[J]. 组合机床与自动化加工技术, 2016(9):35-39.

(编辑李秀敏)

RobotAccuratelyMovingVisionSystemBasedonThreeVisualCalibration

QU Hao, ZHANG Dong-liang

(School of Information Engineering, Henan Radio & Television University, Zhengzhou 450008, China)

In order to solve the current robot vision system precision and unit operation time is too long, insufficient and lack of automatic compensation function, this paper from the hardware and software structure of improved algorithm optimization perspective, put forward three robot vision system based on monocular vision. Firstly, the logical communication channel between PLC sensor, robot and visual PC is built to achieve the goal of real-time acquisition and processing of the material running state. Then, (according to the robot and vision coordinates between the zoom rotation and translation parameters), the design of nine point calibration method of three industrial two camera calibration, achieve accurate bound image pixel coordinates and the coordinates of the robot world. Finally, according to the product engineering benchmark, we select the region of interest, optimize the minimum mean square error matching algorithm, and achieve the balance of system precision and speed. Experimental results show that compared with the current robot vision system, the system has a higher visual accuracy and work efficiency.

three-camera calibrate; nine point calibration; minimum mean square error matching

1001-2265(2017)11-0061-04

10.13462/j.cnki.mmtamt.2017.11.016

2016-12-20;

2017-01-17

河南省科技攻关项目(162102210122);河南省科技成果转化项目(150201180010)

曲豪(1975—),男,河南唐河人,河南广播电视大学讲师,硕士,研究方向为计算机应用,图像处理,嵌入式技术,(E-mail)quhao1975hnifor@126.com;通讯作者:张栋梁(1982—),男,河南洛阳人,河南广播电视大学讲师,硕士,研究方向为计算机应用,软件技术,(E-mail)93822687@qq.com。

TH165;TG66

A