数字时代信息公平失衡的类型化规制

2021-09-02宋保振

宋保振

摘要:数字技术普及运用在带给人类高效便捷红利的同时,也致使社会主体间的信息公平失衡愈加凸显,并最终影响社会公平正义实现。当前研究多将此问题作为背景或在探讨个人信息保护、算法歧视治理时抽象运用,忽视了信息公平失衡在国家、企业、个人等不同主体间的差异化样态。以类型化分析为研究进路,当下信息公平失衡既表现为平等主体间的数据霸权、数据垄断和数字贫困,又表现为非平等主体间的私密监控、个人信息侵权及算法歧视。其原因存在于数字社会信息分化、智能技术差异赋能和参差赋权以及有效信息监管规则缺位三方面,且每种失衡类型各有侧重。结合 STS 理论,我们应从伦理、技术和制度三方面构建信息公平失衡规制体系,并根据每种信息公平失衡类型,进行针对性的对策选择和细化。

关键词:信息公平分配 正义 数字 不平等类型化

一、问题的提出

数字经济时代,信息取代土地和石油成为重要的生产要素和生产资料,不同社会主体能否公平、平等地获取和使用信息,直接影响个体发展乃至整个社会的公平正义。此时,数字鸿沟和红利差异也就成为一个全球性问题,不同主体间的信息公平越发引起人们的广泛关注。作为信息传播领域的专业术语,信息公平是指在一定的历史背景及物质条件下,处于信息活动中的人们以公平、正义、平等理念为价值尺度来反映社会主体间信息关系的平衡状态的价值/话语表述,是信息资源配置的公平,以及分配正义在数据信息领域的体现。依具体的情境不同,它可被视为一种价值期望、一种制度理念、一种关系状态。①数字时代的到来引发人们生产方式和生活方式转变,伴随大数据、云计算和人工智能技术发展,越来越多的人类活动存在于虚拟空间,依赖传统交流与传播技术的等级式、封闭性信息融通结构急剧变更。在暂不具有充分替代方案和有效回应机制之前,因信息获取和运用差异产生的信息公平权益失衡必然成为无法避免的事实,进而使得原有的信息公平机制被打破,社会秩序遭到破坏。数字霸权、算法歧视、数字鸿沟、信息孤岛、信息不对称、数字垄断以及信息侵权等都是其中的典型样态,并成为影响未来社会发展及公平正义实现的重要因素。

对此信息公平失衡,国家公权力机关及理论研究者都在积极探索化解路径。如人力资源与社会保障部门对老年人智能技术运用困难的援助,工业和信息化部门推动的5G 和“宽带行动”,反垄断委员会及市场监管部门对平台运行及监管规则的设定,计算机和法学等领域学者对算法歧视的审视、对个人信息权益的保护和对数据权利的塑造,以及立法部门对《网络安全法》《个人信息保护法》《数据安全法》等专门法规的加紧出台等。毋庸置疑,这些举措从不同层面、不同力度化解着各社会主体占有和使用信息时的不均衡。但在此化解中,我们却忽视了一个基础性问题——每种信息获取、运用及分配中的公平失衡都有着特定背景和语境。由于公平(Fairness)与公正(Just)、正义(Justice)及平等(Equality)在中西语境中均意义接近,当它们与社会公平的多维向度交叉杂糅,反映到信息传播领域,我们就会极容易地把信息公平理解为一个宏观抽象性概念,并将一切数字信息交往中的不平等都归到信息公平失衡范畴。其结果必然是,虽然不同领域、不同时代学者都在讨论信息公平,但却产生 Information Fairness、Information Equity 和 Information Equality 不同理解。而且,这些理解也有着实质性区别,如 Information Fairness 强调不同主体在身份、地位上的平等,侧重指的是机会; Information Equity 强调在制度或權利上的公平、公正,侧重指权利;而 Information Equality 强调在资源分配和使用上的平均和平等,侧重指的是条件。它们分处不同层次并针对不同主体,在最终指向上也呈现出相应差异。

亦即,面对数字社会发生的全方位、深层次变革,不同主体间的信息公平失衡必然呈现出迥异样态,我们对此不能进行政策上的“一刀切”。若忽视不同主体而笼统地讨论数字社会的信息公平失衡,将极易导致,虽然我们围绕数字分配正义及信息保护讨论的热火朝天,但因缺乏对问题的类型化分析,诸多的原因归纳及对策建构都有可能是自说自话。其结果必然使得,对策结果不甚理想,数字分配非正义无法化解。所以有学者在分析数据安全保护时,就基于分类分级理念,主张区分与数据安全相关的个体权益、公共利益和国家安全,以便进行不同层面的法益保护。②围绕此问题意识,本文立足主体视角,对国家、企业和个人层面上的信息公平失衡进行类型化分析。首先,厘清它们各自及彼此之间可能存在的信息公平失衡问题;继而针对问题,从“信息社会分化”“技术赋权差异”以及“治理监管规则”出发,分析公平失衡的原因;最后,从伦理、技术和制度出发,根据每种具体信息公平失衡类型,进行匹配性选择与细化。

二、信息公平失衡的具体类型及表现

面对社会冲突,衡量一项制度是否正义的首要标准就是能否实现多主体间的平衡,③这也构成信息公平问题的重要分析维度。而且,不同类型的信息公平失衡也确实是因主体不同产生差异,这也进一步印证该主体标准选择的科学合理性。

(一)同类型主体间的信息公平失衡

结合数字社会的信息活动现实,该同类主体主要围绕国家、企业及个人三类,它们存在的信息公平失衡情形分别如下:

1.国家之间的数据霸权和数字主权之争。大数据时代,谁掌握了数据,谁就有了话语权。具体到国家层面,该话语权就对应着数据霸权和数据强权。数据跨境流动为全球数字经济发展带来新增长和机会的同时,无序的数据跨境流动同样可能损害国家安全、公共利益、企业利益和数据主体权益。④发达国家会借助其在数字经济和科技领域的绝对优势,通过先占信息资源、制定游戏规则、打压竞争对手等方式,对相对落后的发展中国家“名正言顺地”进行信息掠夺。而且,借助日益发达的大数据和互联网通讯技术,信息强国的优势会更加凸显,并与政治、经济等方面的优势互动,形成“数字主权”。该“数字主权”并不像领土主权、领海主权甚至货币主权等,只是发生在传统现实空间。在智能化数字空间,不同国家围绕数字主权之争,必然会呈现出一种多元主权竞争共生的新秩序。在已结束的一轮竞争中,美国、欧盟等西方国家逐渐取得绝对优势,如近几年欧盟在大数据、人工智能等领域强化立法并积极制定数据跨境流动规则,尤其是伴随欧盟议会智库的《欧盟的数字主权》和欧盟对外关系委员会(ECPR)的《欧洲的数字主权:中美对抗背景下从规范制定者到超级大国》出台,欧盟数字主权战略逐步确定。⑤在“马太效应”影响下,信息强国与信息弱国之间的差距将进一步拉大。

2.企业之间的信息垄断和数字化竞争。当下数字技术日渐运用于所有人类活动领域,我们都生活在“数字化”和“符码化”的社会空格中。加之数据信息成为重要的社会生产资料而具有了绝对价值,这就使得信息的自由传播只是存在于理论上。各商业主体看似“共享”着很多信息,但这些大都是行业内的“公知数据”。就最关键的敏感数据和绝密信息,所有企业均讳莫如深并作为“商业秘密”予以保护。尽管有些时候,这些数据信息的得来方式并不那么“正当”。在巨大的竞争压力下,当后起商业主体还采用原方式获取和使用数据信息时,就面临前者所设置的技术与法律双重障碍。当下企业间大量数据信息侵权纠纷大都产生于此场合,如“新浪诉脉脉案”⑥和“淘宝诉美景案”⑦等。数字社会本应信息高度共享和流通,然而信息控制主体却为这种自由流通设置了屏障,一些基于数据驱动的数字平台尤其是那些大的垄断平台(苹果、微软、谷歌、亚马逊、facebook、阿里巴巴、腾讯等)具有强劲的市场影响和垄断优势,它们像一个个巨大的吸铁石,将众多有价值的信息“吸引”而来,并通过知识产权保护剥夺其他中小竞争企业的发展机会。此时,信息的“有偿使用”或者说“信息垄断”,就与信息的价值最大化之间形成难以调和的矛盾。

3.公民个体之间的数字鸿沟和数字贫困。生活在数字时代,当我们充分享受现代科学技术为我们带来的快捷与便利之时,却依然有这么一类群体被我们无意或刻意地忽略,他们要么因未能拥有或不会使用现代网络条件和信息交流设备,而无法进行在线学习、手机叫车、预约医疗、网络购票、在线缴费等极为日常的生活事项;要么如欲享受此技术便利,需付出极大且明显不对等的时间、精力成本。该数字贫困现象在当下智能社会已并不罕见,在有关代际数字鸿沟、乡村精准扶贫、技术治理实效以及数据信息权利等问题的探讨中已均有所体现和关注。借助政治经济学中的“弱势群体”概念,我们就可将这些在数据获取和运用中处于弱势地位的主体稱为“数字弱势群体”(data vulnerable groups)。⑧他们由于自身原有的科技水平、教育水平以及生活状况等因素的制约,无法及时有效地获取、理解和利用网络数据信息,而被新兴的技术所隔离和抛弃。相比政治层面的数据霸权和经济层面的数据垄断,公民个体间数字鸿沟和数字不平等直接体现着社会结构和社会关系变革对人们生活的影响,因而需要我们给予更多的关注。

(二)不同类型主体间的信息公平失衡

如上三方面为我们展现出了一种“横向”的信息公平失衡。但与此同时,国家、企业与个人主体之间还存在一种“纵向”的信息公平失衡。由于智能技术的趋利特性,以及国家、企业和个人本身的不同,各类型主体在获取和使用信息时呈现差异无可厚非。但值得注意的是,国家及数据控制企业借助技术优势,放任该不平等进一步扩大,并通过相应制度与政策,无意或恶意地阻断落后者的追平之路,此行为却严重违背科技伦理及主体权利平等保护理念,这也构成“相对正义”的矫正对象。而且,相比“横向”的信息公平失衡,该“纵向”失衡的影响更加普遍。伴随近期的“滴滴事件”,不同主体之间信息公平保护的必要性再度被推向舆论风口浪尖。对此领域所存在的公平失衡类型,可归纳为如下两类:

1.公权力通过私密监控对社会信息的绝对获取。政府通过获知社会信息并对其加工处理,以形成公共对策一直以来都是重要的社会治理方式。当下大数据、人工智能等技术赋能,更是让政府获取和控制信息达到新的量级。政府可以通过自己的行政优势,以及对企业服务的购买,在企业和个人还未有能力获取某些信息之时先行垄断,在未能做好数据信息分类分级之前,该“行政化”屏障会阻碍正当的信息流通。很多一般性信息,由于涉及公民及企业等主体的现实利益,国家必须及时且有效地公开,或者严格限制其用途,而不应成为一种实现社会治理目标的“私密监控”。⑨客观来说,政府为了实现社会管理需要,占有和使用这些数据信息本无可厚非,但其中假借“正当理由”过度收集甚至不当使用的行为却值得高度警惕。如在电子化政务推行中,各行政主体对企业尤其是个人信息的“过度”收集和电子化,为提高违法行为的发现和处罚概率,大范围、超密度、无限制地安置监控设施等,其实质都是以电子化方式呈现出的政府权力扩张。公权力面前,公民个人尊严和独立人格被抑制,大数据使得个人越来越透明,而政府和数据控制企业却越来越晦暗。在暂不具有完善的个人信息保护规范及有效的政府信息公开机制前,公私主体间的信息分配正义失衡将一直存在。

2.国家及大企业对个人及小企业信息自由的相对控制。大数据时代,所有社会主体都“平等”“自由”地生存于网络空间并参与信息活动,但实际上,只有政府和大型数据控制企业(比如阿里和百度)才有技术和能力去有效获取和利用。借助网络技术,威权国家极有可能与拥有大量数据信息资源的公司企业联盟,最终成为一个连奥威尔都无法想象的网络极权托拉斯。正如郑戈教授曾指出的,在“算法”统治的世界,受雇于政府和大企业的成千上万的程序员正在编写着各种程序,分析和处理着海量数据,这些复杂的算法正使我们的社会日益成为“黑箱社会”。由于政府和企业都有能力控制大数据并招揽数据分析人才,所以它们都可以成为数据控制者(data controller)。⑩此时,国家及大企业等信息控制者与个人及小企业之间的信息公平失衡就可归纳如下:

第一,个人信息侵权。该个人信息侵权是个人与数据控制者之间信息公平失衡的最极端展现,主要表现为对个人隐私权及个人信息权益的侵害。当下的几乎所有大型互联网企业,都是在我们认识到数据的价值之前,就完成了对数据的掠夺和积累。但数据信息积累和使用的方式压根没有考虑作为信息拥有者之个人的同意与授权,这也即我们通常所说的“互联网原罪”。国家和企业最大限度地利用其互联网优势,借助强大的算法和算力,收集、加工和处理大量与公民生活紧密相关的信息,进而做出利于其发展的决策,这本是一件再正常不过的行为。但与此同时,可能面临的风险却是——商业的逐利性和垄断本质,诱使公共信息供给走向歧途,甚至某些信息巨头企业为了满足特定诉求,故意置入和采用非正义的算法,用“合法形式”掩盖“非法目的”。伴随数字社会到来,该信息侵权现象日渐引起全世界的广泛关注。几乎所有国家都通过制定相关政策或规范性文件,规制数据控制者对个人信息权益的侵犯。当下我国对个人信息的保护,也是从破解个人信息侵权出发的。

第二,算法歧视。数据是算法的依托,其本身具有客观中立性,但人为设计的算法却不可避免地隐含偏见,如数据画像、定点投喂、数据杀熟、就业歧视等。在大数据收集、处理及使用中,算法由于忽视或者无法甄别数据来源,产生传输和使用过程中对某区域特定人群的优待或排斥,将极易导致数据本身所蕴含的不平等被原封不动地转移到大数据计算结果,并反过来加剧原本存在的信息资源分配不公和大数据不平等。?随着算法决策深度浸润到人类日常生活和社会管理的方方面面,算法歧视也在更广阔领域、以更加隐蔽的形式呈现,并继而引发就业、交易、理财等诸多领域不公平的差别对待。体现在人工智能运用上,该算法歧视又因所针对的主体及其影响不同归为两类。一类是反垄断语境下的价值歧视。该歧视最典型的就是大数据“杀熟”,其本质是经营者滥用市场支配地位。平台的趋利性致使其自产生时就存在差别待遇现象,大数据、人工智能等高新技术运用只不过将这种差别待遇推向新的量级。?另一类是平等权语境下的身份歧视,如性别歧视、残障歧视等。由于几乎所有算法程序设置都秉持一种“能人”思维,弱势群体的权益诉求在算法程序设置初始就被忽略。加之这些弱势主体在智能终端的占有和使用上同一般社会公众亦存在差距,因而也就自然成为数据收集中的暗点或盲点,进而影响到算法分析结果的失真。?尽管相对于个人信息侵权,该算法歧视具有显著客观特质,但其确实构成信息公平失衡不容忽视的方面。

三、信息公平失衡原因的多维度剖析

如上现象表明,受制于社会主体自身差异及智能技术的稀缺性,各社会团体和个人本该自由、平等分享数字红利,但不同社会主体间的信息公平失衡已越发成为一种社会常态。其原因既存在于主体实力、经济水平、社会结构、城乡差异等传统方面,也在智能信息社会呈现出相应的独特性。或者说,这些独特方面是传统原因在数字化社会生活中新的展现形态。此部分就围绕如上两层面的信息公平失衡,结合这些特殊原因展开分析。

(一)信息分化导致数字鸿沟和数字不平等

进入21世纪,以信息技术为主要标志的科技革命在全球范围内迅速兴起,信息以及信息的掌握能力是当今社会的核心资源,并成为社会分层考虑的重要维度。信息沟通技术(ICTs)自诞生以来,通过拓展信息获取渠道、革新互动模式、重塑身份认同,改变着社会关系和社会结构,其社会影响业已成为社会科学研究的核心议题。?为最大限度地获取和使用信息,人们正在多渠道探索实现路径。而对此技术掌握运用中不同主体呈现出的特有差异,我们一般称为“信息分化”。“信息分化”源于英文“information divide”“digital divide”或“information diffeientiation”,也有观点将此理解为“信息鸿沟”(或“信息区隔”)。二者虽然在性质、成因以及危害方面具有相同之处,但“信息分化”与“信息鸿沟”仍在动态与静态、目的与手段、本质与表象层面存在不同。数字鸿沟只是用来反映由于计算机技术、互联网技术等现代信息通讯技术所造成的现代信息活动主体间的信息差距;而信息分化是指由于一切信息技术所造成的信息活动主体间的信息差距。?

信息分化的深层的影响就是数字不平等。在数字时代,个人的数字参与与数字资本关乎个人或集体在许多领域内优势地位的获得,如果不考虑数字不平等,是无法理解21世纪的社会景观的。?数字不平等最早由 Paul Dimaggio和EszterHargigittai提出,调研对信息不公平的研究应从不同人群的接入差异转向不同人群使用互联网检索信息的能力差异。?不同于单纯从技术层面对数字鸿沟的分析,数字不平等更加重视社会与科技的交互关系,着重关心数字技术在影响社会福祉、家庭、政治参与、社会支持等方面的表现,?并在传统二分法(接入和未接入)基础上,兼顾到技术设备、自主使用、使用技能、社会支持和使用目的等方面内容,将技术的差异化使用放到本土社会实践情境中去认识。此时,信息不平等就成为数字时代信息分化的深层次影响,继而导致不同主体之间在信息获取和使用上的数字红利,且相对于数字鸿沟,可以更为直观地彰显信息公平失衡状态与影响。

结合如上信息公平失衡两类型,信息分化的影响集中体现在同类型主体间。首先,国家间信息霸权和企业间信息垄断的最直接原因是受经济、科技等方面实力影响所产生的数字鸿沟。在信息日益成为一项重要战略资源的情形下,无论是国家还是大的数据控制企业都在尽最大可能地收集有益信息,同时制定“游戏规则”以保证自己的优势地位。它们一方面借助所占的“先机”优势,进一步控制信息形成信息垄断;另一方面基于信息的可获利性,进行信息寻租。例如美国和欧洲国家借助工业社会的原始积累优势,顺势成为信息革命中的赢家。不仅相对于发展中国家和落后国家在信息技术上拥有绝对优势,而且凭借谷歌、亚马逊、IBM 等搜索引擎,已经牢牢控制世界的信息动态。其次,个人主体之间的数字贫困除了和数字鸿沟有关外,还深受数字不平等影响。受制于经济条件及地区发展水平,人们在购买和使用信息技术产品如电话、电脑、互联网等获取信息方面存在显著差异。在政府未能落实对弱势群体和落后地域的通讯基础设施保障之时,信息的不平等分配是一种必然。近二十年来,中国在填平接入鸿沟方面走在世界前列,所取得的成绩也有目共睹。但新的问题是,伴随社会的全面数字化、智能化进程,产生于信息“使用沟”中的数字红利差异已经成为信息不公平的新型主要形态。甚至伴随接入问题全面解决,该问题愈加凸显,数字贫困必将成为一个影响社会公平正义实现的长期不稳定因素。

(二)数字技术借助智能算法进行差异赋能

如果说信息分化是信息技术与传统社会的碰撞,主要描述的是一种简单的客观差异,当这种客观差异同数字技术紧密结合之后,这种数字鸿沟和数字不平等就上升到新的量级,继而導致一种更深层次的个人信息能力和信息权利差异——数字技术的差异赋能或参差赋权。当下个人信息权益保护之所以如此重点强调,一个重要原因就是始终存在一个不平衡的权力结构:个人对数据信息保护的力不从心与数据控制者对数据信息的绝对控制,当下化解此矛盾的最直接做法也许就是赋权。

作为数字治理非均衡性之体现,差异赋能或参差赋权都是技术领域的一种反向表达,二者的正向表达是技术赋能(或技术赋权)。区别在于,技术赋能强调信息技术对个体能力、水平、效能等方面的提升。是指智能技术尤其是互联网普及夯实了当代技术治理的基础,进而使信息流动由单向传接的“金字塔”型向双向交互的“网络”型转变。而技术赋权则涉及到技术引发的个体权力/权利变革。特指技术可以提升某治理方的权力,改善治理效果,主体是以人工智能技术为媒介,通过特定行为将价值目标和意愿加以现实化,增强自我控制与自我选择的能力,实现自我增权的过程。硅基文明时代,代码既规则、算法既权力,信息技术构成影響乃至主宰个体行为的控制力量。它提供的无障碍、全景式的信息流动渠道,使跨时空、跨边界、跨领域的普遍联系成为可能,实现了碎片化社会力量的集聚效应。?这种赋权本该是平等的,或者说是实现大体均衡的“双向赋权”。?然而现实却是,受制于赋能和赋权对象的异质性问题,所有主体平等的赋能和赋权只是存在于理论上,一种差异赋能和赋权才是现实社会的常态。

不同于社会层面的信息分化主要导致平等主体间的信息公平失衡,技术层面的差异赋能或参差赋权主要导致国家、企业和个人等非平等主体之间的信息公平失衡,并集中体现在公权力国家相对于企业、个人等私主体以及数据控制企业相对于小微企业及个人两方面。前者表现为,公权力机关借助其地位优势,可以较为容易地实现对人工智能算法结果的知悉和控制。进而在全方位、网格化社会治理中,将权力嵌入人工智能应用平台以强化国家监控能力和社会的数字化治理能力。此行为带来的可能危害是,国家在科层制的权力结构体外,再行编制一种隐蔽的权力网络,实现国家机器的政治权力延伸,是一种技术赋权。21相比之下,技术对个人的影响更多地存在于提供生活便利的技术赋能方面。尽管从“话语赋权”角度看,每个人都是话语产生和传播的重要“节点”,完全存在技术赋权之可能。但其产生和传播却受到严格的网络言论国家控制,也即相对于私主体,该赋权更多还只是存在于理论层面。强大的数字利维坦和微小的数字个人在信息获取和使用上的非均衡成为难以避免的事实。后者表现为,基于发达的信息传输设施与机制,现代企业组织结构越来越偏向扁平化、去中心,瞬息万变的发展机遇、残酷的市场竞争都要求企业必须迅速获知外界信息变化,进而展开相应的经营对策调整。此时,能否迅速、准确地掌握这些信息并作出回应,就成为大企业和小企业之间的差异赋能。而且,该赋权差异在企业和个人之间同样存在。主要表现为,当企业可以利用自己的技能优势,通过设计算法选择“意向对象”时,个人可能对此并不知情或无法抗拒。如企业将对特定劳动者工作选择时的歧视转嫁给算法平台,通过“隐性”方式剥夺劳动者权利;或对劳动者的行为进行特定目的的导向控制,如外卖平台基于提高效率这一“正当”目的,不断缩减送餐时间,侵犯了骑手权益等。对于这些“隐性”不平等产生的原因,我们不能仅是归于算法本身,算法背后的主体及其意图更值得我们重点关注。

(三)数据监管规则缺失或规则不具有可操作性

无论是社会信息分化还是智能技术运用中的差异赋能或参差赋权,均是导致社会主体之间信息公平失衡的根本性原因。除此之外,还有一直接原因——我们缺失对此信息公平失衡的监管或已有规制不力——同样不容忽视。大数据、云计算等技术发展,为各主体自由便捷地进行涉信息活动提供了极大便利。但在此过程中,国家及大企业等信息控制主体在收集、处理和使用所获取数据时,极易对其他主体及公众利益造成损害威胁,此时数据监管(digital curation 或 data curation)就成为防范风险的重要对策。从内容层面看,数据监管对象不仅是数字,还包括数字化信息和数字化研究;从时间层面看,“数据监管不仅仅是要保证数据当前使用目的,而且能用于未来再发现及再利用。”22在智能社会,大数据不仅是一种资源和工具,也是一种思维,我们可以通过一种全方位的数据治理创造数字经济时代的社会价值。此时,数据监管不仅只是数据保护的重要方式,更重要的是,我们可以通过对数据的监管调整,保障“数字弱势群体”权益,实现数据分配使用的公平正义。也即,从信息公平角度看,数据监管就是通过保障数据权利的合理、信息公平的实现,维护“数字弱势群体”在信息收集和使用等活动中所享有的权利自由,尽可能实现数字红利平等化。

在信息处理活动中,数据监管包括市场自我监管、技术平台监管和法律政策监管三个主要方面。以此为标准,当下我国信息处理活动监管中的问题就可总结为顶层设计缺失、监管模式分散、法律政策不足以及缺乏专门机构。23匹配到如上信息公平失衡类型,此监管问题亦呈现出如下特点:第一,在同类型主体方面,当下我们已经注意到国家间和企业间的信息不公平问题,如各国都强化对数据主权的保护,并将此作为现代综合国力的重要内容;在企业之间,也通过商业秘密和知识产权法律保护自己的信息权益。但相比之下,对于公民主体间的数字鸿沟和数字不平等所引发的数字贫困却关注不足,更多仍是将此视为技术更新迭代中的必然现象。我们不仅未能实现从数字鸿沟向数字贫困的数据监管模式转化,而且该问题由于涉及公民基本权利问题,也缺乏相应的法律规制。第二,在不同类型主体方面,也未从社会结构性变革角度,深入思考对国家权力的限制和具有“准公权力”之平台的责任问题。一直以来,面对信息活动中的公平失衡问题,我们要么忽视,要么秉承一种被动性调整思维。具体到制度性回应上,也只是在有关信息通讯和信息服务的政策和法规中间接指出,缺少类似《个人信息保护法》《反数字贫困法》等专门的规范性文件。此监管规则缺失或可操作性不足带来的直接结果就是,尽管相关对策已经制定,我们仍不能根本解决信息公平失衡问题,国家和大企业依然在信息分配中占有绝对优势。那些因程序设计者无意带来的算法歧视、企业在正常商业活动掩饰下的选择性推送、迎合受众“特定”需求的信息茧房效应等,不仅本身较为隐蔽,而且在作用方式及效果上具有极强的专业性和社会依附性。我们必须充分结合智慧社会中的社会结构和社会关系变革,以及智能技术本身的特点,将此充分融入到监管政策或法律规范中,才能真正取得现实效果。

综上,可将不同信息公平失衡现状与构成原因之间的关系对应如下(表1)。

四、信息公平失衡的多元化规制路径

针对信息活动不公平现状,如上选择主体标准进行了类型化分析,同时又从信息社会分化、人工智能算法和信息监管三方面出发剖析了原因。其最终目的均指向确立有效的失衡化解对策,借助信息公平最终实现社会公平,化解社会发展的不平衡、不充分矛盾。围绕该问题,当下学者已从个人信息保护、商业秘密保护、消除算法歧视、维护数据主权等多方面、多角度进行了问题化解对策探索并取得良好实效,但这些对策仍存在待完善之处:一方面,每种信息公平失衡都针对特定主体和原因,当我们未对此进行条分缕析时,必定会因对策单一简单而不能触及公平失衡实质;另一方面,信息公平失衡和数字社会紧密相关,而当下的很多对策或规制方式都是根据传统物理社会制定,因而难免出现匹配失衡。此时,我们能否结合 STS 理论确定的交叉研究方法,24并针对每类信息公平失衡类型,不断探索完善理性的伦理规范、科学有效的技术回应,以及可操作的规则与标准规制体系,对实现数字时代的信息公平和分配正义具有重要意义。

(一)伦理性规制

数字时代智能技术的“善治”以其本身的“善智”为前提。因而在所有针对高新科技所引发社会问题规制中,伦理规制几乎都被作为首要方法。在信息公平实现中,该伦理规制的理论原点是信息公平失衡对社会正义的侵害,以及由此造成的社会分配正义失衡和社会不公正。体现在已有学术讨论中,大家主要围绕智能算法反思其伦理危机问题,25关注不同类型社会主体因资源占有、使用和分配不平等而导致的“用户画像”“信息茧房”“大数据杀熟”及“个人信息侵权”等,较少将平等主体间的信息公平失衡列入伦理性分析视域,这也是当下该问题研究的不足。基于技术普适化,以公平正义理念为基础的伦理性规制路径存在于所有智能技术运用场合,因而自然应涵盖平等主体和非平等主体之间。

首先,平等主体间信息公平失衡伦理规制的着力点在于实现信息公平分配,核心是诉诸公平正义理念化解信息霸权、信息垄断及数字不平等。依据分配正义理论,所有的社会基本价值(或者说基本善)——自由和机会,收入和财富、自尊的基础——都要平等地分配,这也是社会公正性的基础。具体到信息活动中,人们亦应在获取数据资源、享有数据权利、享有数据开发收益时享有均等机会,秉持分配机会正义、分配程序正义和分配责任正义。且为保证其实现,严格遵循机会均等、分配标准与程序合理以及利益与责任同等分配基本原则。26在国家之间,该伦理规制主张秉持一种全球正义(global justice)理念,消弭信息强国信息霸权对信息弱国形成的经济剥削和政治侵犯,主权国家对构建世界共同体秩序负有道德责任;27在企业之间,该伦理性规制则指不同类型、不同规模企业在对依靠先占优势所取得的“既得利益”进行商业秘密和法律保护的同时,需要减少数字排斥并坚持数字包容,消除数字鸿沟并坚持开放合作,打破信息垄断并坚持分享精神;而在公民之间,该伦理规制主要指在制度设计及政府市场决策时要充分重视“数字弱势群体”的诉求,推行“促进平等的数据倡议”行动方案,保证弱势群体能充分融入数字化生活,共享数字红利。

其次,非平等主体间信息公平失衡伦理规制的着重点则在于如何通过设置正义和道德准则,破解个人权利与算法权力之间的抵牾,尽可能地消除“算法黑箱”“算法歧视”和“信息茧房”的负效应。其主要依借的手段和对策就是,充分认识大数据算法差异赋能和参差赋权对社会正义的侵害,恢复被算法所消解的个人主体性,实现个人主体信息活动自由。大数据和算法应用对提升人类活动效率功不可没,但在其广泛应用中也暴露出诸多问题:数据采集与捕获的平台单一性和数据失衡、数据处理中的不平等复制、算法分析中的偏见与歧视、数据应用决策中的不平等性等问题,都使算法非正义的一面受到普遍关注。28在智慧社会,“掌握了数据,就意味着掌握了资本和财富;掌握了算法,就意味着掌握了话语权和规制权。”29如果缺失最基本的社会正当性反思,人类成为技术的附庸将不是天方夜谭。此时对技术的伦理规制就体现在两个维度:第一是以理性为标准,智能算法设计不应把人作为客体进行数字化、符码化定位,而应该以人为主体,要体现基本人性关怀,突破“算法黑天鹅”“算法秘密”对公众认知的包围和殖民;30第二是以自由为标准,主要做法是消除国家、数据控制大企业对公民及小企业借助算法进行的行动限制或利益损害。依据这两方面伦理准则,社会主体不仅可以免受算法带来的非正义歧视如大数据杀熟,而且還不会因自己的行为导致错失数字红利,如陷于信息茧房或信息孤岛中被隐性剥夺信息选择权。伴随国家、企业及个人主体间的信息公平失衡愈加凸显,该伦理规制又被进一步深化,如提出算法正义要求,指出算法实践必须在法治之下秉持平等、尊严与自由价值;以及将对算法的规制提前到设计阶段,在算法设计中融入绿色、伦理、守法、自由、尊严、关爱等“善”的因素,改变从外部进行技术评估的传统路线,转而从内部进行价值赋予等。31

(二)技术性规制

相比宏观性的伦理规制,技术性规制具有直接针对性。而且在当下,信息公平失衡主要还是被作为高新技术运用产生的负效应。因而无论是平等主体间的信息霸权、信息垄断以及数字贫困,还是非平等主体间的信息侵权和算法歧视等,技术性规制都被作为一种重要规制方式。不过,两种类型也因各自侧重点不同,呈现出相应差异。

首先,平等主体间信息公平失衡的技术规制主要包括完善信息基础设施和提升社会信息服务。具体表现为:第一,完善信息基础设施。在数字社会,完善信息基础设施是消除数字鸿沟、缩小城乡差距、实现大数据治理的最基础手段,也是对数字霸权、信息垄断以及数字鸿沟和数字不平等问题的直接回应。信息公平失衡的根本原因在于某些主体的信息技术仍处于一种低水平,因此当务之急就是积极推行“宽带中国”和“互联网+”战略,提升网络覆盖率,积极建构各种数据库和平台,尽可能降低因信息接入和使用困难给某些企业和公民带来的利益损害。

第二,提升信息社会服务。如果说完善信息基础设施是针对整个信息公平失衡问题的一般性对策,而提升社会服务则主要针对小企业及“数字弱势群体”,实现的是信息获取与分配的相对正义。长期以来,我们过于追求社会发展的速度与效率,使得科学发现与技术发明理论上的“公共性”与实践中的“排他性”矛盾越发尖锐,不仅因公共服务供给偏狭引发特定主体劣势地位并直接影响公平正义的公共行政,32而且政府和市场决策与活动的高度数字化也使得同类主体之间的信息公平差距进一步拉大。此时,加强网络化、信息化、数字化以及智能化等现代科技教育和培训,提升数字政府服务效能,加速普及信息援助和惠民便民,多元供给公共服务机制,一方面有助于提升我国整体信息竞争实力,让弱势企业和个人摆脱信息贫困;另一方面有助于解决国内数字分配不正义引发的实质差异。该社会信息服务以国家为主导,当下应主要针对信息公共服务偏狭以及数字贫困问题,其形式也包括“线上”和“线下”两种。

其次,非平等主体间信息公平失衡的技术规制主要集中在从技术性层面确立算法规则,并对主体的信息处理活动进行监管。“数字弱势群体”之所以在信息处理活动中处于弱势,除了其客观存在的自身原因外,还和数据信息获取、使用及处理时的规则模糊直接相关。也因此,明确技术规则就被视为是消除数字歧视和规制算法的最直接做法。具体到操作中,一条进路是从计算机学和逻辑学出发,选择特定模型或构建某种逻辑架构,对典型的利用算法侵权行为进行规制。33或者通过要求该模型具有可解释性、严格控制智能算法的底层价值取向,尽最大可能实现技术的标准化,设置大数据挖掘、分析及处理数据的基本算法规则,保证算法运用的客观性。34另一条进路则是加强对信息处理活动的监管,保证实现公平信息实践。该进路既体现在数据跨境流动技术标准之设定,又体现在平台市场的界定方法之选择,35是从“政府—数据提供者—数据管理者—数据服务者”多主体角度对信息公平失衡做出的回应。主要意图在于化解国家和信息控制企业利用算法优势,对小企业及“数字弱势群体”进行的算法侵权和算法歧视。从当下研究成果来看,我国已初步建立了法律规范、市场主体、技术平台等多方综合监管体系。而且针对个人、社会及国家不同主体,也分别形成了不同对策。具体而言,法律政策方面主要是在《个人信息保护法》等基础性规范中明确数据、信息的内涵与外延,根据信息处理活动明确权利义务;而在市场和平台方面主要是以各大型数据信息处理平台为重点,厘清它们的交易范围,限定交易数据,明确交易标准,制定交易规则并保护交易安全。进一步提升平台服务的科學化,着重建构信息共享系统,缩小信息获取能力差异。36

(三)制度性规制

现代社会,各行业、各领域之间相互融通且高度互联,任何技术广泛使用的影响都不再仅仅只是科学问题,而是交叉性的社会问题,这也是 STS 理论作用实现的社会基础。在之前长期的农业和工业社会生活中,信息获取与流通作为人们交往的辅助方式,我们只是将此作为导致主体间强弱差距的外在原因。但是伴随当下数字社会的社会结构变革,数字信息成为连接人们生活各个环节的基本要素。不同主体间信息公平失衡也不应理解为人文领域的优胜略汰,而是必须予以关注的社会问题,但我们却并未对此足够关注。只是伴随近年信息侵权问题急剧凸显,我们才开始展开相应的制度性反思。正如有学者在分析网络社会治理弊端时所总结的,中国之所以在网络社会治理中无力,“根本原因在于中国政府没有充分意识到网络社会与传统物理空间的区别,并用传统物理空间的法律治理方式和思维方式来思考网络社会的治理问题。”37面对数字社会中遭遇的新冲突,原有的制度和政策已失效或者说成效甚微,在无法通过新技术彻底解决该信息公平失衡问题之前,我们就必须承受制度性规制缺失带来的消极影响。

结合信息公平保障实践来看,此制度策略最主要依赖的就是法律或其他相关规范性文件。而且,该法律规制路径亦因主体性质不同而呈现出相应区别:

首先,针对平等主体间的数据霸权、数据垄断及数字不平等,该制度性回应既包括规则也包括法律。对于发达国家数据霸权引发的信息公平失衡,当下治理主要依据的是国家及区域间有关信息处理的协定和人权保护决议。在此方面,我国积极参与了联合国、G20、金砖国家、APEC、WTO 等多边机制数字领域国际规则的制定,倡导发起了《二十国集团数字经济发展与合作倡议》《“一带一路”数字经济国际合作倡议》《携手构建网络空间命运共同体行动倡议》及《全球数据安全倡议》,积极主张不同国家间公平平等的信息活动与竞争。对于企业间数据垄断引发的信息公平失衡,当下政策规制集中于如何协调保护商业秘密与实现公共利益的关系;38如何在算法正义要求下适用并完善《反不正当竞争法》和《数据安全法》以规制数据爬取,并明确平台反垄断的法律标准;39如何在算法风险防控视域下,更有效地保护企业的数据信息权利;40以及是否为了达致实质正义,向亚马逊、facebook等数据控制大企业征收数字服务税等?相比之下,对于公民个体间因数字鸿沟和数字不平等引发的信息公平失衡,该制度性策略主要指向法律规范。但从我国当下立法来看,尽管已经注意到该问题,但现在还未有直接立法,主要诉诸宪法、行政法、社会法及老年人权益保障法等建构权利体系。它们以人权中的自由权、社会权和发展权为理论基石,围绕传统基本权利的数字化进阶,借助宪法搭建了信息时代个人信息公平权利保障的基本逻辑框架,相应具体权利内容则体现在《老年人权益保障法》《残疾人保障法》《政府信息公开条例》《无障碍环境建设条例》《电子商务法》《电信条例》及《网络安全法》等法律条文中。在未来,我们应在“数字人权”指引下,塑造作为新兴权利的上网权或数字化生活权,41并加强分析“数字弱势群体”信息权利的设置、分配及其法律责任救济。

其次,针对非平等主体间的个人信息侵权及算法歧视,学者们也正在积极构建法律规范体系。一方面,就个人信息侵权问题,当下理论及实务领域重点讨论和关注的内容主要集中于:第一,是否有必要以及如何厘清个人信息权及隐私权的边界,从而对数字社会的信息侵权进行针对性保护?第二,所谓“个人信息权”或“个人信息自决权”到底是一种私权利,借助民法框架进行保护?还是依据公民所享有的宪法性权利,构建国家保护义务体系?42第三,如果寻求一种私法“权利保护”,那么它到底是权益还是权利?权益的属性究竟是人格权、财产权,还是二者复合的新兴权利?它们又对应什么样的信息处理者义务?43如果寻求一种公法“权力保护”,那么该权利基础为何?以及怎样协调与“数字人权”的关系?

另一方面,就算法歧視问题,当下制度性规制的重点也集中于两点:第一,警惕本来应当是中立的智能应用,被用来掩饰未取得“多数人同意”的少数人集权;第二,建立利益相关者对话和商谈的场域,避免法律沦为“技术寡头”的帮凶。44围绕这两方面,当下学者主要从推进算法公开和透明、行使算法解释权、保证个人的“知情-同意”和数据赋权,以及要求反算法歧视和行使算法拒绝权等出发予以规制。45但同样也有学者基于对这些规制路径理论本身及其操作性的反思,提出场景化的规制路径,并试图进行制度构建。46具体到相应的法律文本,《网络安全法》《电子商务法》《网络安全审查办法》《优化营商环境条例》《反不正当竞争法》的颁布或修订为信息化生活中的国家安全、社会公共利益和消费者权益保护提供了直接依据;国家《个人信息保护法》《数据安全法》,以及贵州省《贵州省政府数据共享开放条例》、深圳市《深圳经济特区数据条例》、天津市《数据交易管理暂行办法(征求意见稿)》更是在已有立法基础上,针对性地解决数据信息处理活动中的重点问题,实现各主体在信息活动及分享数字红利时的公开、自由和平等。

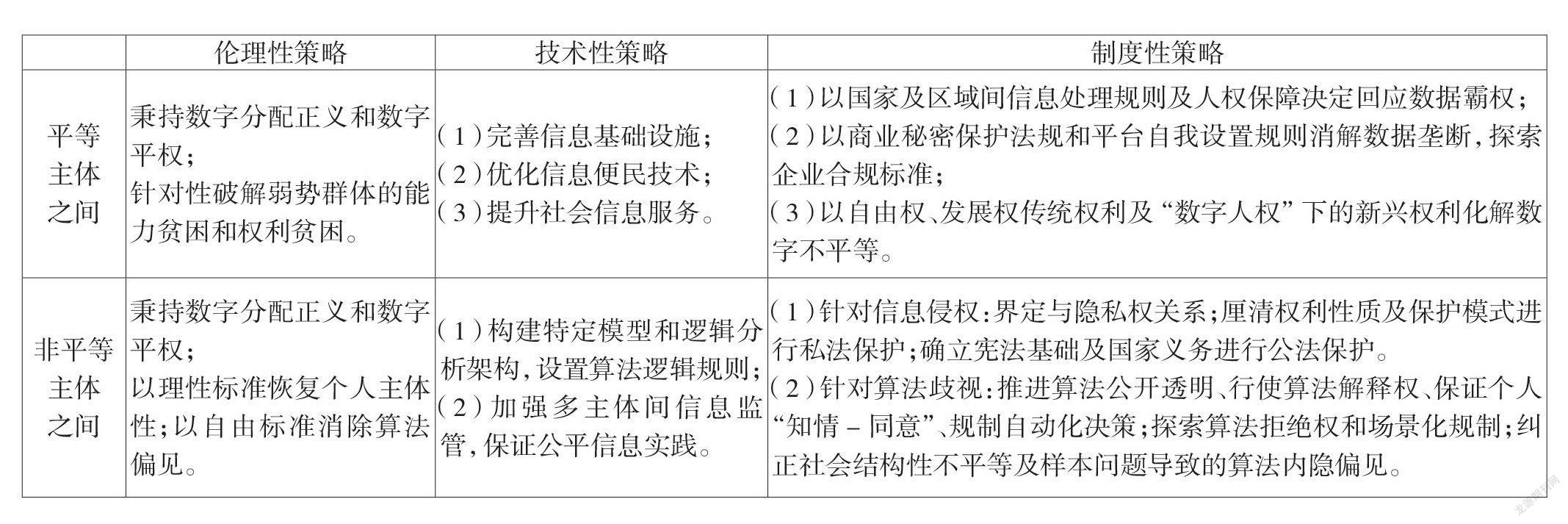

对于如上策略及其所欲实现的目标,我们可以下表展现(表2):

五、结语

在数字经济与国家战略双重推动下,我国数字化生产和生活方式正以迅雷之势向社会全方位、各领域穿插渗透,继而促使我们快速进入“数字化生存”时代。在暂不具有公平的社会分配制度和法律规制机制之时,不同主体间的信息公平失衡必将是一种社会发展常态。本文围绕该问题,以类型化分析为研究思路,详细阐释国家、企业及个人所面对的信息公平失衡现状及其原因,并从伦理、技术和制度三方面构建化解策略体系,其最大价值是摆脱当下研究者对信息公平及数字正义失衡问题的抽象含混理解,寻求针对性策略以提升问题化解实效。不过,由于每种信息公平失衡类型都有导致其产生的主要原因,而且在不同发展阶段,化解该问题的必要性和重要性也存在差异,因而在构建化解对策时,我们也不能平等着力。在未来高度互联社会,如何解决该信息公平失衡问题,越发成为一国甚至国际间、多主体“共建共治共享”的事业,以保证人类在享受科技带来的高效、便捷红利的同时,个人尊严、社会正义亦能得以同步推进。

Abstract: While the popularization of digital technology brings the benefit of efficiency and convenience to human beings, it also causes the imbalance of information equity among social subjects, and ultimately affects the realization of social equity and justice. Most current studies take this problem as the background or generally apply it in discussing personal information protection and algorithmic discrimination governance, ignoring the different causes and manifestations among countries, enterprises and individuals as well as among the three. The result may be that the problem and countermeasures are out of line due to the unclear definition of the problem. Based on the research approach of type analysis, the current imbalance of information equity is not only manifested as data hegemony, data monopoly and digital poverty among equal subjects, but also manifested as private monitoring, personal information infringement and algorithm discrimination among unequal subjects. The reasons are information differentiation in the digital society, intelligent technology differential empowerment and uneven empowerment, and the absence of effective information regulation rules, and each type of imbalance has its own emphasis.Combined with STS theory, we should construct a regulation system of information justice imbalance from three aspects of ethics, technology and system, select and refine targeted countermeasures according to each type of information justice imbalance.