虚拟现实技术中的未来音频制作技术研究新展望

2017-07-05姚国强

姚国强

虚拟现实技术中的未来音频制作技术研究新展望

姚国强

一、基于历史发展的听觉艺术与视音频技术的演进历程回顾

(一)听觉艺术发展历史回眸

听觉是人类重要的生理机能之一。依靠人类左右的两耳可以感知到外部世界声源的信息,从而达到人类认识客观世界环境及听到各种声源变化的主要目的。因为人类言语的产生实现了人与人利用声音进行实时信息交流的可能,并使得人类从此与自然界的其他生物之间发生了重要的性质变化。所以,听觉艺术的形成之于人类则由来已久。音乐、绘画和舞蹈的出现,则是人类文明社会和文化发展不断演进的重要结果。

早在18世纪工业革命爆发之前,中国与西方的音乐艺术其实都已经相当的繁荣和发达。

1791年,英国人詹姆斯·瓦特刚刚改良完成的蒸汽机就被投入到纺织、采矿、冶金、造纸等工业部门。而那年正是中国清朝的乾隆56年,先后6次下江南巡视的乾隆皇帝迎来了其80寿辰。为了给酷爱中国戏曲的老皇帝祝寿,南方的“三庆”“四喜”“和春”“春台”等四大“徽班”专程进京演出祝寿戏[1],受到了皇族权贵及京城民众的热烈欢迎。此后,四大“徽班”就留在北京继续进行民间演出,成为了京剧[2]发展史上重要的历史事件。[3]

而自巴洛克时期之后,西方的古典主义音乐也迎来了辉煌的发展时期。奥地利的著名欧洲古典主义作曲家沃尔夫冈·阿玛多伊斯·莫扎特[4]于1791年的年末去世,他一生创作了大量作品,包括器乐作品的协奏曲、交响乐和人声作品的歌剧。他的音乐生涯前期为萨尔斯堡领主的乐师,后期去了维也纳创作音乐谋生。此时,德国长笛演奏家特奥巴尔德·波姆改造完善了管弦乐中的木管乐器的发声腔体及机械按键结构和指法体系,使得木管乐器的音色和灵活性得到了大大的提高,成为了交响乐队中的固定乐器。莫扎特创作的大量经典音乐作品都是用这种改善后的木管乐器来演奏的,技术的进步促进了音乐形式的丰富与繁荣。由此可见,在18世纪末,想听到某个作曲家、乐手或戏曲家表演的音乐作品并不是一件简单的事情。因为即使是皇帝想要欣赏戏曲演出节目,也要兴师动众的南巡或者等待戏班跋涉千里上京才能实现。而其他的封建领主则需要自己掏钱供养乐师才能夜夜笙歌,只有在京城或者大城市的市民阶层才能花钱看到著名乐师艺人的现场演出。

当第一次工业革命用蒸汽机打碎了封建君主制度的枷锁后,便创造出了大量新兴的行业。而城镇市民的高速增长则为听觉艺术新形态的发展提供了新兴市场和变革契机。

19世纪末开始的第二次工业革命带领世界进入到了电气化的时代。基础科学的进步和经济的飞速发展,使得通信技术成为了民众日常生活的必须。在意大利人安东尼奥·梅乌奇、英裔美国人亚历山大·格雷厄姆·贝尔和美国人托马斯·阿尔瓦·爱迪生对电声传送技术的研究基础上,促使了电话在19世纪末的诞生。

1877年,爱迪生在对贝尔电话的改进工作中意识到可以通过带针膜片记录声音,于是他在声音的振动中刻蚀蜡纸从而保留下了声音的轨迹。此后,他还与助手发明了利用圆筒上滚动的锡箔记录声音的圆筒留声机(Phonograph)。

1887年,艾米尔·伯利纳在圆筒留声机技术基础上研制出唱盘和一种叫Gramophone的圆盘留声机,将声音振动信号记录在涂蜡圆盘上。[5]因为圆盘的携带比圆筒更方便,使得使用机械动力的78转Gramophone留声机受到了大众的欢迎。从此,电话和留声机的发明开启了电声学领域的技术大门。对于普通民众来说,通信的现实意义就是不需要乐器和歌手现场演出也可以听到音乐的时代终于到来了。留声机推动了当时音乐艺术在大众之中的流行传播和发展。因此,时代的改变使得“听音乐”一词由听现场音乐家的演奏音乐而变为了听声音载体上的音频信息。而“听音乐会”则成为了“听音乐”一词原本的含义。虽然这种变化最终导致“听音乐”缺失了抚弄丝竹的乐趣,但是,听众却获得了可以随心所欲地满足听觉审美鉴赏需要的能力。作为声音艺术的音乐是随着时代的变化而发生概念的演进与内涵的扩展,自此,听觉艺术上升到了声音艺术的领域。

(二)虚拟现实技术的基础——视音频技术的发展过程回顾

当今的虚拟现实技术实际上是一种综合利用计算机系统图形技术和各种显示及控制设备接口、在计算机上生成多源的信息融合交互式三维动态视听虚拟及真实场景,结合空间感知的“即时定位与地图构建”技术(Simultaneous Localization and Mapping,简称SLAM)。这种技术可使设备实时地获取到周围的环境信息,以便能够精确地将虚拟物体放到正确的位置上。同时,还可以利用观影者的实体行为数据来提供观影者沉浸于该仿真的虚拟环境中。虚拟现实技术实际上是一种具备新媒体特征的包含视听触觉的新技术。

技术的基础必然是根植于视听技术发展的历程之中的。虚拟现实内容的制作技术也必然是与视听媒体内容的制作技术的发展息息相关。纵观留声机的发明过程,虚拟现实中最为基础的声音保存与还放制作技术与当年留声机的留声技术,其最大的不同实际上是在声音保存的介质上,而不是在发明原理上。

1879年,爱迪生和助手接着发明了著名的白炽灯泡。灯泡的发明有力地促进了电子科学技术的发展和电影技术的诞生。

1888年之后,爱迪生和助手利用白炽灯泡光线照射胶片上的图像,发明了活动电影放映机Kinetoscope。活动电影放映机是通过机械装置放映影像的器材,但是一次仅能供一个人播放观看。

1894年,爱迪生在美国第一次举行了活动电影放映机的公开放映活动。为了让人们在看到画面的同时又能听到声音,1895年,爱迪生研究了将圆筒留声机Phonograph放入活动电影放映机的机器装置——有声活动电影机Kinetophone。这样,视听媒体就第一次被有机地结合在了一起。

1895年,法国人奥古斯特·卢米埃尔和路易斯·卢米埃尔发明了手提式电影放映机Film projection。同年12月28日[6],卢米埃尔兄弟在巴黎卡布辛大街的咖啡馆第一次用电影放映机和银幕公开放映了自己拍摄的电影短片,公认的电影至此诞生。

1904年,英国物理学家约翰·安布罗斯·弗莱明根据1883年爱迪生在灯泡改进过程中发现并留下的悬而未决问题的“爱迪生效应”发明了电子管。电子管是一种可以放大电信号的电子设备。利用电子管的放大功能,电信号可以推动扬声器发出巨大的声音。

1906年圣诞节前夜,加拿大人雷金纳德·奥布里·费森登在纽约附近设立了一个广播站并进行有史以来的第一次广播。广播的内容则是由圆筒留声机播放的英籍德国作曲家乔治·弗里德里希·亨德尔的《绿树成荫》(意大利语:Ombra Mai Fu)、费森登自己小提琴演奏法国作曲家阿道夫·夏尔·亚当的《圣善夜》(O Holy Night)、费森登自己演唱法国作曲家查理·弗朗索瓦·古诺的《喜欢和安静》(Adore and Be Still)等音乐作品。费森登最后还朗读了一段《圣经》中的《路加福音》(Gospel of Luke)。[7][8]而世界上第一座持有经营执照的电台则是美国匹兹堡KDKA电台。于1920年11月2日正式对外开始广播。

1927年,以美国华纳兄弟公司出品的《爵士歌手》为标志,到1929年华纳公司的《纽约之光》[9],有声电影逐渐占据了电影市场主流。有声电影中的光学录音使用胶片感光的方式来实现。所以在现场拍摄时,声音可以被记录在胶片上。而放映时则通过光信号转变为电信号,在电影院中还音出拍摄时所记录下来的声音。由于胶片上有齿孔的存在可以有效地保证胶片上的声音和画面能够同步还放。

至此,1931年中国也诞生了最早的光学录音电影《雨过天青》和《歌场春色》。[10]

不难发现,以胶片为记录基础的光学声底与画面印制在一起的优点是成本低、寿命长、易保存。

1898年,丹麦人瓦蒂玛·波尔森发明了录音电话机Telegraphone。[11]其实这是一种磁性钢丝录音机。经过第二次世界大战的战争洗礼,20世纪50年代开始了磁性录音设备的大量使用。比起此前的记录介质,磁性录音具有便携性能强、制作成本低、音质好等特点。它还能够在拍摄的现场就立刻还放。而这些优点是光学录音时代所无法比拟的。之后,光学录音系统主要被用来印制电影胶片的拷贝。毕竟电影胶片拷贝可以更方便地在电影院里还放画面和声音。因此,尽管光学电影录音拷贝的还音质量恶评甚多,但是,首先电影拷贝在进行光学录音处理及制片发行放映方面经济便宜;第二,胶片拷贝要比磁性声带更容易保存。即使到现在,通过实践发现一般的观众大多数人无法区别磁性4声道还音和杜比光学4声道的还音差异。[12]

二、电影录音技术与虚拟现实技术发展进程对比

2014年,美国社交网络平台——脸书公司(Facebook)宣布收购沉浸式虚拟现实技术公司——奥库鲁斯公司(Oculus),实现了时隔7年后虚拟现实技术的复苏。

2015年,全球资本市场大规模投入资金开始抢占工业4.0与互联网+时代的新型视听传媒市场,实现了虚拟现实技术第三次爆发。科技带动了电影电视的转型,由此派生出来360°全景视频、增强现实、混合现实和影像现实等虚拟现实技术。因此,虚拟现实对于音频制作的发展创新就成为了必然要求。目前,对于虚拟现实图像及视频技术的研究正方兴未艾,而对虚拟现实技术中的音频制作技术的研究尚乏善可陈。因此,尽快展开虚拟现实技术中的音频制作技术研究,对于增进国家文化技术“软实力”、深化推进国家经济“供给侧改革”、开创“大众创业、万众创新”社会则具有了迫在眉睫的社会意义及理论意义。

通过研究,虚拟现实技术最终呈现给观者的是在虚拟环境中实施自主交互式的包含视音频的内容及触觉感知的内容。因此,这种内容创作技术是建立在电影电视技术和计算机游戏技术之上的一种全新形态的多媒体技术。其中的视频与音频创作技术必然与电影电视和计算机游戏的创作过程有着传承和发展的关系。总结目前虚拟现实技术的专业特点,最为重要的核心特征就是具有计算机生成的可交互的、被称为“虚拟环境”(Virtual Environment,简称:VE)的三维环境。

虚拟现实的技术特点是“实时”(Presence)、“交互”(Interaction)和“自主”(Autonomy);而其重要的技术特征则是“3I”:“沉浸”(Immersion)、“交互”(Interaction)和“构想”(Imagination)。虚拟现实技术中的视音频内容制作技术实际上是在传统电影电视技术和计算机游戏制作技术的基础之上有所创新和发展的一项新的技术。

(一)电影录音技术的发展过程

广播和电影的出现,使得声音艺术及视听艺术必须依赖于音频制作这一技术制作环节。随着科学技术的不断发展创新,音频制作工艺也发生了天翻地覆的变化。

1881年,法国人克雷芒·阿尼耶斯·阿德尔(Clément Agnès Ader)在巴黎展示了第一个双声道音频系统(《科学美国人》Scientific American杂志对此曾进行过报道)。阿德尔使用一系列的电话拾音器连接从巴黎歌剧院到巴黎电子展的一套房间内,通过房间里的电话接收机,听众左右耳可以分别听到在现场左右设置的电话拾音器进行的实况转播演出。

1900年,巴黎世界博览会上献映了第一部环幕电影风光片。法国的格里麦·塞松发明的环幕电影画面以360°环行包围着观众。所以,环幕电影的声音系统具有全方位的立体空间感。[13]

现代立体声技术是20世纪30年代由英国工程师艾伦·布鲁姆林在EMI所发明的。他的专利技术包含了立体声录音、立体声电影、还有环绕声。①Early stereo recordings restored.BBC.2008-08-01.Archived from the original on 7 August 2008.Retrieved 2008-08-07.http:// news.bbc.co.uk/2/hi/technology/7537782.stm.艾伦·布鲁姆林早在1933年就开始了双耳拾音的技术实验。而对于电影中使用的立体声技术直到1935年才完成。他的实验短片《列车在海因斯站》(Trains At Hayes Station)完全实现了说话声音跟随画面里演员的行走方向进行运动的技术设计。

1938年,英国科学家亚历克·李维斯发表了作为电话科技的描述脉冲编码调制(PCM)的第一个专利技术。而后,数字音频技术经过了漫长的发展。

1952年9月30日,第一部西尼拉玛电影《这是西尼拉玛》公映①西尼拉玛电影官网http://cinerama.topcities.com/.。西尼拉玛电影使用的是35毫米全涂磁录音和胶片,在放映时与三条画面连锁同步运动放映。这种立体声影片有6个声道。其中的5个声道输向银幕后面的5组扬声器,而另外1个声道则作为观众厅内的环境声扬声器。

1955年,Todd-AO立体声系统推出。它采用了65毫米的电影底片拍摄,然后扩印成70毫米涂磁拷贝进行播映。

1974年,临场音响的森萨朗得系统立体声Sensurround作品《大地震》公映。②森萨朗得电影官网http://www.in70mm.com/newsletter/2004/69/sensurround/about.htm.

1972年,日本天龙公司推出了第一个8个通道的数字录音机DN-023R。这是一个4磁头开盘式的广播磁带录像机。4月24日第一次用于录制了斯美塔那的四重奏表演和莫扎特的弦乐四重奏K.458和K.421。

1979年,日本的索尼公司和荷兰的飞利浦公司合资公司开发了第一个数字光盘CD,并于1982年开始上市发售。

1987年,索尼开发了数字音频磁带DAT(Digital Audio Tape)。

1982年,阿根廷人乌戈·苏查雷利(西班牙语:Hugo Zuccarelli)发明的人头录音(Dummy head recording)——Holophonics技术③Holophonics“全息声音”http://www.acousticintegrity.com/acousticintegrity/Holophonics.html.令听觉系统充当干涉仪,从而能让声音得到立体空间音响效果。Holophonics技术的声音特征证明了用普通的双声道立体声扬声器也能有效的、清晰地听出来立体声。为了优化这种效果,扬声器也被特别设计以重现波场合成(Wave field synthesis,WFS)录音。

近年来,索尼以此技术还开发了虚拟立体声听音技术(Virtualphones Technology),利用了Holophonics技术的耳机来还放声音,可以将5.1或者7.1声道的立体声转换为双声道的立体声来还放,并保留多声道立体声的声场感受。

(二)虚拟现实VR的发展简史和分类

1968年,伊凡·苏泽兰(Ivan Sutherland)与学生鲍勃·斯普鲁(Bob Sproull)创造了第一个可以用于虚拟现实及增强现实的头戴式显示器系统,确立了VR的技术原理。这个第一次开启了头戴式虚拟现实系统的实验应用,由于设备非常沉重需要挂在天花板上,所以,该系统又被戏称为“达摩克利斯之剑”。

伴随着20世纪70年代末的信息技术与计算机的兴起,虚拟现实技术通过信息技术的支持迎来了第二次高速发展的时期。1982年,游戏行业久负盛名的美国Atari公司成立了虚拟现实研究实验室。贾瑞恩·拉尼尔(Jaron Lanier)经过对虚拟现实相关技术进行持续研究和开发,于1984年创办的VPL Research公司在研究可视化编程语言和数据手套等虚拟现实设备方面取得了较大的进展。虽然拉尼尔提出了“虚拟现实技术”,并使得“VR”成为当下已广为人知的技术概念。但当时的VR试图开发商业化时长却未能成功。

2012年,奥库鲁斯公司生产的虚拟现实(Virtual Reality。简称:VR)产品——“Oculus Rift”眼镜,通过国外知名众筹网站Kick Starter募集到了160万美元的风投资金。

2014年,奥库鲁斯公司被著名的美国社交网络平台——脸书公司(Facebook)以20亿美元的价格要约收购。“Oculus Rift”眼镜吸引了大批开发者投身于VR的项目开发中,正式打响了这场VR的世纪之战。此后对Magic Leap的多轮风投引爆了2015-2016年VR产业的全面爆发。在所谓的VR“元年”之际,全球资本市场开始大规模的投入资金开发虚拟现实技术,抢占工业4.0与互联网+时代的新视听传媒市场份额,预示着时隔7年的VR技术开始正式复苏,重返商业化的市场竞争,因而从发展的角度实现了VR技术的第三次爆发。

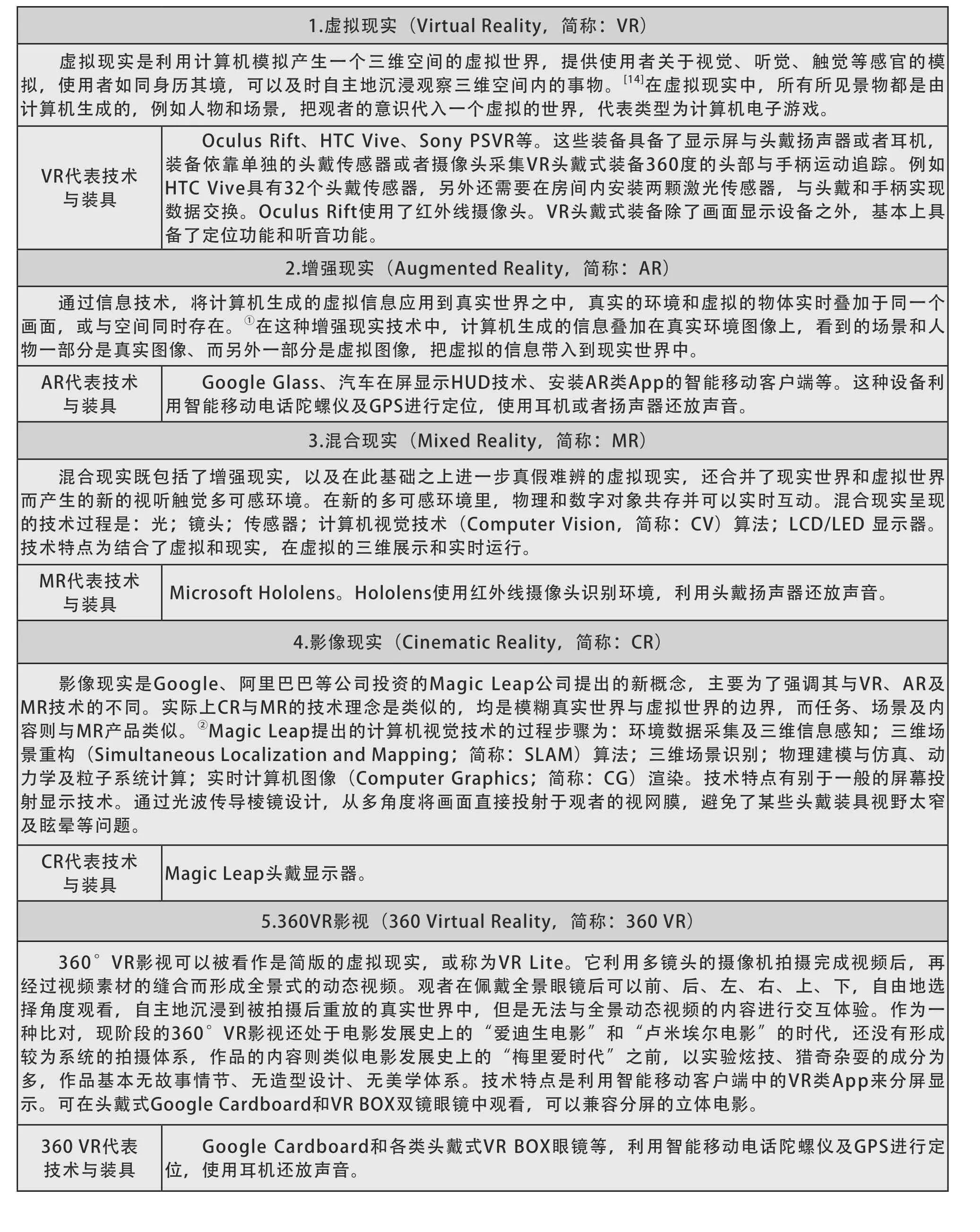

目前,虚拟现实大致可以细化为以下几类:

表1 虚拟现实分类及特点、代表技术与装具

表2 虚拟现实与电影立体声制作的历史对照

三、电影数字立体声与虚拟现实音频的制作模式

在简述了声音艺术创作中音频技术的发展脉络后,对比VR与电影音频制作的开发历程,不难看出,两者之间十分有意思的时间对应关系。

(一)电影数字立体声与虚拟现实音频的发展制作对比

自电影声音数字化以来,世界上主要的电影立体声录还音制式大致由杜比Dolby、数字影院系统DTS和索尼数字动态立体声SDDS此三家系统构成,基本垄断了全世界的商业电影市场。由此,高清数字电视也选用了杜比数字立体声系统作为广播伴音进行播放。近年来,杜比全景声、巴可数字声以及中国学者研究的全维度环绕立体声(ADSS)[15]等新的数字空间声系统也层出不穷,使得音频技术与声音艺术创作者对于空间声再现真实世界中的环境声场的学术研究也保持着不断发展的态势。

现阶段开发制作VR、AR、MR及CR声音的主要工具引擎有Unreal、Unity、Cryengine、TORQUE、COCOS、UNIGINE等。在节目的编程开发及美术、声音设计上,新的工具引擎开发与画面、声音技术制作模块的优化和完善已然成为一个必不可缺的主要技术环节。开发新的硬件器材和相关的App、研究工具引擎的应用技术也正是VR音频制作进程中的主要任务。所以,尽管目前正处在VR的开发与发展期,但是群雄割据但还没有国际统一的技术标准,所以基本上还是各说各的为多。由此,要进一步地开发出通用的VR硬件装备加入到混合现实(MR)及影像现实(CR)的内容制作及播放环节中。同时,还要进一步地改造现有的传统观影场所,以适合发展中的各种形态和制式的虚拟现实影像的还放体系。

前述可见,目前虚拟现实技术以及内容的呈现基本是利用个人的装具来实现的。而电影、游戏与VR呈现的声音则采用了不同的还放途径。

通过体验VR、AR、MR装具,可以发现,虚拟现实、增强现实以及混合现实的音频随着内容分类的不同而呈现出制作模式的差异。音频的播放,大致是在游戏应用和类似地图导航的应用中,通过计算机游戏引擎和地图的变化来带动不同的声音素材在交互活动中实现播放的。由此,声效音频不一定具备影视同期声的精确声场定位,虚拟物体的声效也不一定要匹配真实物体发出的声音。大部分声音只有简单的语音、声效和背景音乐,无刻意研发和创作的空间声还音体系。而在影像现实和360°VR影视中,声音的呈现方法则与现代数字立体声电影一样需要高度的逼真。这两类不同形态的声音导致了音频制作体系的不同。所以说,这导致了在目前现有的电影立体声制作体系和游戏声音制作体系之外有了新的发展要求和制作变化。

有声电影的声音,如语言、音响及音乐在播放时必须与画面一一对应(声音蒙太奇中的对位手法除外)。而电影声音及画面的运动则被导演的艺术设计所操控,所以观者在观影过程中是无法操控的也不能在技术上与故事内容进行参与和互动的。因此,电影中的声音与画面必然是与经过剪辑设计的时间线所对应,只能通过导演设计的视角来观影和听声。例如,电影《兵临城下》①电影《兵临城下》Enemy at the Gates.2001.http://www.imdb.com/title/tt0215750/.中,参加斯大林格勒战役的狙击手瓦西里在喷水池的尸体堆中隐蔽着,利用战场炮声响起的时刻开枪射杀敌人。影片中此段落是完整的一个外景场景,镜头经导演设计后成为了主观或者客观的视角,并不会因为不同的观者在观看时产生时间上的差异。因此影片在电影院放映时,电影中所有的语言及音响都会与影片的空间环境相一致,与实际发声的声源及发声时间所对应。

而交互式电子游戏的声音呈现方式是游戏参与者在触发了地图中的某个物体或者区域后才发声。因此,其语言及音响必然是在关卡中伴随游戏参与者的动作进展而互动,而与背景音乐BMG的发声而互不连贯。这样其声音与画面就没有了必然的时间线对应,画面只能看到由游戏参与者和游戏设计者选定的视角。例如,在游戏《使命召唤》②游戏《使命召唤2》Call of Duty2.2005.http://www.imdb.com/title/tt0469287/.中,在斯大林格勒的关卡中,游戏参与者扮演狙击手瓦西里在喷水池尸体堆中隐蔽,游戏提示游戏参与者必须利用战场炮声响起的时刻开枪射杀敌人。此关卡段落是完整的一个外景场景,游戏视角完全被设计成了游戏参与者的主观视角。由于游戏参与者的心理承受能力和反应灵敏度各有差异,有可能某些游戏参与者可以立即完成射杀任务,而有些游戏参与者则可能需要等很久才能完成射杀任务。这种互动能力的差异就产生了关卡时间长度的差异。因此,语言及音响将伴随游戏参与者的操作而由游戏引擎带动同步发声,而背景音乐BGM则会不断的循环播放去等待游戏参与者完成任务。因此,这个音乐和语言、音响就不会像电影音乐那样同步一致。这就使得这两种声音在与画面相向而行时互不一致。电影中,声音与画面同步一致,但在游戏中则不一定能做到同步一致。

特别是在360°VR影视中,由于整个环境空间都已被事先拍摄下来,所以,当观者头戴眼镜随意调整视角在360°空间内自由观看时,声音的定位也是不一致的。电影《兵临城下》中瓦西里在喷水池中狙击敌人的段落在360°VR影视中则会向观者开放360°环境空间,由观者自由选择参与观看时的视角,可以身临其境的全方位体验和感受电影中战场的冷酷和血腥。由于在多次观赏过程中可以随意的处于不同的环境位置,从而可以更加深入的感受到艺术家艺术创作与造型设计的美学意义。根据360°VR影视全视角无死角的图像特性,360°VR影视声音制作工艺及流程必须要融入对视频和观者运动捕捉的处理构思与设计。因此,360°VR影视包含并且兼容传统电影的声音制作工艺及流程,也是最接近电影制作工艺的影像展示方式。

(二)虚拟现实中音频制作模式的新发展

1. 运动捕捉与三维空间跟踪技术

为了开发制作虚拟现实视音频产品,传统影视声音制作体系和模式将要融入新的技术和知识内容。首先就是声音制作者必须掌握动作与运动捕捉技术。其中包含了对观者的运动捕捉和对被拍摄物体的运动捕捉及三维空间跟踪两个部分。在虚拟现实内容产品体验过程中,观者完全沉浸在一个360°自由的互动虚拟空间中,在这个虚拟空间中观者的身体会发生各种不同方位的运动。因此,通过光电摄影机及传感器来采集和捕捉人体运动的数据来融合交互式三维动态视听虚拟及真实场景,以及结合空间感知的“即时定位与地图构建”技术来对声音的产生、声像的变化与角色语言的交互互动就变得具有非常重要的意义了。

其次是对被拍摄物体的运动捕捉。这种运动捕捉技术早已成为电影视频特效制作中的一个重要环节。通过掌握被拍摄物体的运动捕捉数据,在声音动作效果的处理上就具备了精准的时间性与空间性客观因果对应关系。例如,目前在电影特效制作中的三维空间跟踪技术可以在视频工艺中重建三维虚拟环境,通过运动捕捉和三维空间跟踪技术可以替换掉画面不需要的内容。这些数据还可以进一步结合虚拟现实开发工具和引擎,为自动交互和添加各种不同的声音及创建实时的、随观者运动变化的空间声场建立起数据基础。所以说,声音制作者如何利用和处理这些运动捕捉数据对于虚拟现实中的音频制作具有举足轻重的关系。

2. 视音频制作统一设计的合成技术

在360°VR影视作品的拍摄录制中,由于打破了传统电影的画框限制,观者可以跳出导演与剪辑预设的故事窗口,自由自在地融入到场景之中。传统电影的声音拾音方式必然要受到巨大的技术挑战,话筒和话筒员将面临着无处可藏的困窘境地。为了避免话筒和话筒员进入画面穿帮,传统电影录音制作中会采取各种方法来隐藏话筒或者使用微型话筒。这种方法在一定程度上虽然避免了穿帮,但却可能影响到录音的技术质量。

声音艺术理论和实践工作者通过多年的创作经验积累和总结出了“同期录音三原则”[16]和“同期录音的五条基本原则”。

“同期录音三原则”指出:同期录音时,语言声音要优先于音响声音录制;画内声音要优先于画外声音录制;录音助理(话筒员)工作时要面向演员和摄影机。

“同期录音的五条基本原则”[17]则指出:声画景别相一致的原则;画内突出主体的原则;画内声(台词)与前景声(台词)为主的原则;话筒尽可能逼近发声体的原则;收录主台词尽可能避免噪声的原则。

当进行完全开放的360°场景的同期声音录制时,如果在人物比较多的场景中可以将声音拾取工作人员设计为串场的龙套人物角色进入画中,以此使话筒员成为合理的存在。但是场景在草原或沙漠、大海之中录制对话同期声,或者在交响乐队中录制演奏,如果继续隐藏或者使用微型话筒,在这种情况下录音工作会遇到相当大的困难,难以实现上述的原则或者导致录制的声音质量损失过重。因此,声音艺术工作者就需要掌握基本的图像擦除技术,使用擦除技术可以有效的打破隐藏话筒的局限。例如,在一个360°VR影视静止的真实外景草原对话镜头中,话筒和话筒员可以随意的逼近被拍摄对象,在后期制作时再在图像中擦除掉话筒和话筒员的影像,从而保证了画面内容的单一性。如果所拍摄的是运动镜头,就需要更好的掌握高水平的擦除技术。而当声音工作者掌握了这种擦除技术之后,同理也可以擦除掉周围影响画面的照明设备或是其他出现中画面中的人员或景物。所以此技术必然会对声音创作以及其他部门产生积极、有益的促进作用。

3. ADR技术

ADR技术也就是自动对白替换技术(Automatic Dialog Replacement)。ADR技术很早就被运用在了电影声音的制作之中了。可以想象,ADR技术在虚拟现实作品的声音制作中也可以大量运用。首先就是在非真实的内外景拍摄及同期录音时,由于需要进行蓝绿幕背景的抠像特技摄影,受现场混乱或者大量动作捕捉器材设备及信号的影响,同期录音可能非常棘手。此时,ADR技术就可以有效地展开对白替换,结合图像擦除和合成技术完成同期声场环境中对白效果的模拟。同理,在真实的内外景拍摄及同期录音时,前述的图像擦除技术和运动擦除复原技术以及ADR技术结合,也可以达到保证对白质量的技术目的。

4. 引擎音频开发和应用技术

由于虚拟现实的特点是“实时”“交互”“自主”“沉浸”和“构想”。虚拟现实影像作品可以使观者具备自主自由交互运动的观赏能力。因此,传统电影中由导演与剪辑设置的时间进度也就被颠覆了,声音与画面没有了剪辑设置好的对应时间线。这种虚拟现实作品的声音制作就具备了传统电子游戏的音频制作特征。

另外,传统电影声音制作工艺中所有的声音素材添加与调整,立体声的分配完全是由声音设计师的主观艺术设计和传统的手工制作模式来完成的。而音频参数的调整大部分是凭着录音师的创作经验和主观听觉感受来进行调整的。特别是拟音环节则完全是手工创作的。大量的数字设备,如数字音频工作站(DAW)则仅仅是参与了手工处理流程的效率提高,并没有带来智能化的改变。因此,这种手工的模拟制作方式模式是无法适应在虚拟现实中观者主宰时间线的进程和互动随机的位置以及自由在空间变化的情形。所以,此时声音艺术创作者就需要运用虚拟现实的引擎和开发工具来进行虚拟音频的制作和开发相关的APP。这样对声音资料素材的使用及调度完全可以自动进行。因此,掌握声音引擎的开发技术可以进一步的促进VR声音的国际化技术开发标准。例如,可以利用类似C语言进行音频的虚拟周边设备的开发处理和虚拟全景电位器的声音素材自动分配技术,或者开发出可以实时调用声音素材库的模块来结合画面运动进行动作捕捉和三维空间定位的数据,从而实现交互还原虚拟空间环境中的声音素材与立体声场的定位变化。另外,虚拟现实对于音频制作技术的另一个领域则是触觉震动,声音本质上是一种机械振动,模仿虚拟现实中触觉感知的震动也可以经由音频引擎的开发带动驱动相关放大器和触觉电子器械的实时响应。

5. 虚拟现实立体声声场在影院的还放技术

在虚拟现实的技术开发与内容制作领域内,由于电影立体声技术的发展历史成熟而久远,已有了大量的成型技术与内容产品。同时,声音的数据量相对于图像的数据量要小得多,在现有的计算机技术条件下,已具备了可以快速实时上传下载的能力,而声音创作的周期与人员配置也较为灵活。所以,VR的声音制作已具备了天然的优势。但是,我们也不得不意识到虚拟现实的音频制作之路上还存在很多的挑战。例如,空间声场的还放技术还不成熟。由于虚拟现实的观看和听音系统基本上是靠个人化的头戴装具模式来实现的。尽管头戴装具也具备了运动捕捉定位功能。但由于观者会随着内容进行交互运动,所以声音的传输则应该采用无线技术以避免产生线缆缠绕捆绑观者的危险。在此基础之上,我们可以开发出虚拟听音装具的专利,开发出听音衍生市场商业应用版权的技术。

尽管耳廓效应的存在导致耳罩式耳机比耳塞式耳机更具备听音方面的优势,但是,耳机先天性的缺点在于还放低音的能力不如扬声器。因此,在有条件的情况下应该在耳机中设置还放低音补偿的扬声器。由此我们可以引申到对现有电影院的改造。为了适应立体电影,绝大多数电影院都引入了立体放映系统和观者用的专用眼镜。所以,在虚拟现实作品的影院播放模式中也可以参考立体电影的分发专用眼镜的制度。将影院改造为使用无线传输声音信号,增加对观者的运动捕捉定位设备。通过分发无线接收音频的VR头戴式装具给观者,同时打开影院的低音扬声器,可以在虚拟现实发展的时代盘活当下的立体影院资源。进一步开发通用硬件加入到MR混合现实及CR影像现实的内容制作及播放环节中,进一步的改造现有的影院,才可以适合多种形态和制式的虚拟现实还放体系。

综上所述,虚拟现实中音频制作模式将出现新的技术发展,电影也将面临类似前述音乐艺术表现形式概念发展变化的情形。如同音乐与戏剧本质上是不同的艺术,但是可以发现存在二者形成交集的歌剧及音乐剧艺术形态,同样虚拟现实本质上与电影也是不一样的,但是两者在视听制作技术上能够形成大规模的交集。因此,新的机遇可以带动虚拟现实与电影自表现内容形式的差异开始进而逐渐形成各自新的制作技术体系。我们相信,声音艺术理论与声音制作教育也将随着虚拟现实技术的发展而进入到了一个新的发展时代。

[1]中国艺术研究院音乐研究所.中国音乐词典[M].北京:人民音乐出版社,1985:199.

[2][4]王沛纶.音乐词典[M].北京:文艺书屋,1977:386,78.

[3]封杰.勾勒京剧形成之路 展现数位卓越功臣——简评《同光十三绝合传》[J].中国京剧,2014(10):84-86.

[5]姚国强.电影电视声音创作与录音制作教程[M].北京:中国电影出版社,2011:3.

[6][12](日)日本映画テレビ技術協会.映像製作のためのサウンド·レコーディング[M].日本:写真工業出版社,2003:6,156.

[7]Helen May Fessenden.Fessenden:Builder of Tomorrows[M].US:Forgotten Books,2015:153-154.

[8]Engineering and Technology History Wiki.Milestones:First Wireless Radio Broadcast by Reginald A.Fessenden, 1906[M].2015.

[9]马守清.现代影视技术辞典[M].北京:中国电影出版社,1998:11.

[10]许南明.电影艺术辞典[M].北京:中国电影出版社,1986:518.

[11]姚国强.影视录音声音创作与技术制作[M].北京:北京广播学院出版社,2002:2.

[13]姚国强.环幕电影《龙城风光》数字多声道立体声录音新工艺影视技术[J].现代电影技术,1999(9):24-32.

[14]欧跃发.基于虚拟现实的移动学习模式探析[J].中国科教创新导刊,2010(22):71.

[15]姚睿,姚国强.数字电影声音——3D时代的全维度环绕立体声(ADSS)的概念、创意与发展对策[J].北京电影学院学报,2011(5):54-59.

[16]姚国强,王旭锋.影视同期录音的基本法则(上)——解析“同期录音三原则”[J].现代电影技术,2016(1):18-24.

[17]林临.电视剧同期录音浅谈[J].现代电视技术,2007(2):118-123.

姚国强,男,山东人,北京电影学院教授、博士生导师、国家一级录音师;上海大学上海电影学院兼职博士生导师、兼职教授;中国高校影视学会副会长,中国电影家协会电影声音艺术工作委员会会长、中国录音师协会电影录制制作专业委员会主任委员,主要从事影视声音方向研究。

本文系北京电影学院“中国文艺评论基地”《中外电影理论评论研究》(项目编号:CLACA-2015-010)阶段性研究成果。