智能社会中技术治理与法律治理关系论纲

2022-04-07刘蓓

刘 蓓

互联网、大数据、算法等系列科技发展让现代社会迎面科技创新的“超级风口”,这些技术与人工智能息息相关,成为智能技术系统的组成部分。在公共治理领域广泛适用科学技术以提升治理效率就是技术治理。①刘永谋:《技术治理、反治理与再治理:以智能治理为例》,《云南社会科学》2019年第2期。技术治理的强势来袭映射出:智能技术革命这种重构式的波轮影响已经辐射至维系人类现代社会秩序的核心部分——“法”,这种影响的核心议题即技术治理与法律治理的关系问题。从认识论角度看,先是通过“关系”发现“属性”,然后是通过“属性”认知“实体”,即关系—属性—实体,因此,事物关系是真正打开事物实体特性的钥匙。列宁也有过相关论断:真理是由现象及相互关系组成,看起来似乎独立的真理都是在真理关系集合中得以实践。②《列宁全集》第55卷,人民出版社1990年版,第165—166页。

世界各国都在探索技术治理与法律治理两者的关系,努力成为智能社会法治规则的制定者而不是接受者,这是一种政治上的高瞻远瞩。新时代带来的崭新的法治实践需要匹配相应的与时俱进的法学概念体系、理论体系和方法体系。③张文显:《在新的历史起点上推进中国特色法学体系构建》,《中国社会科学》2019年第10期。截至2020年8月15日,在知网检索“技术治理与法律治理”相关的CSSCI论文仅有3篇,均是将技术治理视为独立于法律治理的一种治理系统,与西方的“技治主义”理论一脉相承。中国目前在理论上关于技术治理与法律治理关系研究严重不足,有必要更加充分地探讨两者互嵌耦合的具体运行,厘清覆盖不同场景中技术治理与法律治理的外在关系模型,以利于中国更加科学地定位、充分理性地利用技术治理,真正接近并揭示正值智能转型期的法治系统的生成与发展规律。

一、技术治理与法律治理的互嵌运行

伯尔曼认为:综合思维和克服二元论思维均是启发新思维的钥匙,“非此即彼”已是明日黄花,“亦此亦彼”才是新时代特征。①伯尔曼:《法律与宗教》,梁治平译,中国政法大学出版社2003年版,第105页。智能技术被广泛应用于公共部门和商业场景,成为“技术治理”,以技术手段达到治理目的。然而技术治理本身并不是一种独立的治理系统,可以广泛嵌入各种类型治理系统中:技术治理可以嵌入“法律”“道德”“政治”“经济”“宗教”等社会治理系统,成为这些治理系统的一部分。当技术治理嵌入法律治理时,它就成为一种新型的法律治理手段。技术治理与法律治理必然会彼此内嵌、牵连、塑造以及互释。

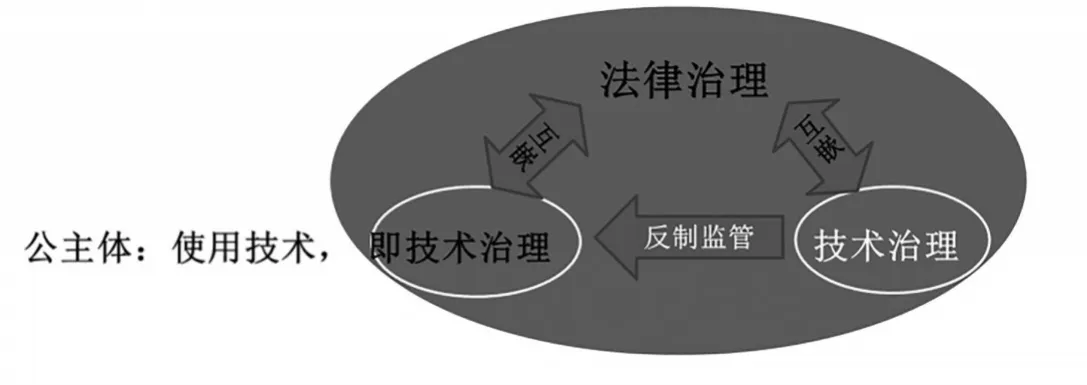

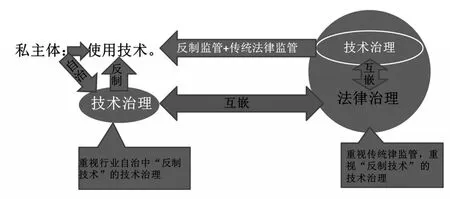

图1 法律治理与技术治理的隶属关系

1.技术治理嵌入、赋能法律治理

物理世界与赛博空间从平行向趋同发展,大多数法律运行都与网络产生直接或间接的关系,赛博空间迫使我们必须换取一个新的角度去认知和运作法律规则,它要求我们扩张“法律规则”的解释,需要对新生的规则形式进行描述与剖释。这个新的规制形式即“代码”,代码就是网络空间的“法律”。②William J.Mitchell,City of Bits:Space,Place,and the Infobahn,Mass MIT Press,1995,p.111.“代码就是法律”由约尔·芮登伯格(Joel Reidengerg)在信息法学研究中第一次提出。③Joel R.Reidenberg,Lex Informatica:The Formulation of Information Policy Rules Through Technology,76 Yale Texas Law Review 553(1998).技术架构、算法、区块链等代码形式均具有规训效果,④胡凌:《超越代码:从赛博空间到物理世界的控制/生产机制》,《华东政法大学学报》2018年第1期。甚至以高效、持续且精确的优势常常胜于传统法律治理手段。在赛博空间中代码开始愈来愈多地模拟、替代法律的部分传统功能,算法技术促使更多种类的合法的私人续造法律诞生。传统法律是在公权力的震慑中让人们“不敢”违法,法律技术化后是使人“不能”违法,最后人们会被规训为“不”违法。总体上,公、私场景适用智能技术开展技术治理(包括以技术反制技术),让技术嵌入法律的现实途径主要如下。

(1)架构技术法律化:有效控制的治理

网络空间核心规矩的实现,除却依赖传统的法律制裁,还需通过特殊空间的架构。⑤代码可能会引入新的规则,这些规则与现行法律间鲜有联系,甚至毫无关系。例如,许多P2P文档共享协议在代码中嵌入了使用规则:用户只有共享了文件,才能下载更多的内容,从而强化了用户间某种形式的合作。且代码对在线行为的规范作用远远超过这一点。在线服务提供商经常依靠代码或算法来影响用户群体的行为。代码架构使网络更易于规制,“这些技术已经促使法院认可网络上的哪些行为可以被干涉,甚至被规制”。⑥Joel R.Reidenberg,Technology and Internet Jurisdiction,153 Yale University of Pennsylvania Law Review 1951(2005).政府通过直接规制框架,间接规制网络行为,那些被规制的框架代码以自己的方式影响约束行为,展现出类法律功能。这种间接效果依靠修改制约执法的代码要素来实现,底线上要求架构设计主体必须秉持保护政府执法的能力。⑦例如,1994年美国国会颁布的《法律执行通信协助法》要求,网络必须设计成保护执法能力的模式,以便实施监听。架构代码控制人们“可为”与“不可为”,因为其具备在一个大标准下识别行为的能力。这种能力在代码作为规制手段时,可以将行为塑造成法律允许的形式。⑧Timothy Wu,When Code Isn’t Law,89 Yale Virginia Law Review679,707-708(2003).架构设计者似乎化身“立法者”可以设定网络隐私保护程度、可连接的边界等。架构设计者主要由平台决定,当商业利益起决定作用时必然续造出有利于私利的“法律”。但架构绝不仅是一个工程问题或市场行为,“对价值的选择,对控制的选择,对自由空间界定的选择——所有这些东西都是政治的东西”,⑨劳伦斯·莱斯格:《代码2.0:网络空间中的法律》,李旭、沈伟伟译,清华大学出版社2009年版,第88页。架构承担着将价值成文法化的实际功能,所以政府必须要掌握代码架构的直接或间接控制权。

(2)预测技术法律化:升维式治理

传统法律运作几乎欠缺时间维度考量,预测类算法使对个人行为的控制具有了时间维度,开始结合时间维度评价、治理个人行为。法律的功能变得更加强悍,在空间与时间①预测性和引导性数据分析可以通过个人化的识别、分析和干预“植入”意向和行为动机,从而改变法律的作用场域。参见Thomas L.Griffiths,Manifesto for a New(Computational)Cognitive Revolution,135 Yale Cognition 21-23(2015).的维度上将有更大作为,在秩序重构中法律将发挥更为广博的社会功能,如美国开始采用信用积分模式。②不良的信用积分状况会严重影响个人申请信用卡、贷款以及贷款利息、购买保险,甚至可能影响购物、享受服务、租赁和受聘。具体而言,在数据社会语境中,个人过往的行为可以以低成本的记忆数据形式沉淀储存,从而实现对个人认知的连续性与全面性。算法设计逻辑可以达到将信息细化分析,并对每一个步骤进行函数回应。网络空间中的生产与经济逻辑是将个人虚拟身份与真实身份连接,识别用户各种社会身份,运用个性化营销以实现营利。各类积分系统③例如“信用分”“活跃度”“贡献值”等各类积分系统。的计算所触发的对不同用户的差别性回应模式已经有了从商业领域向政府领域扩张的趋势。公权力监管开始应用信用评估与决策类算法工具,表明社会管理与控制模式正在接受智能化变革。用户的过往行为偏好数据有利于对其未来行为进行判断、预测,并可以提醒公权力机关进行预警性处置,执法与司法部门的管理能力与效率会产生跨越式进步。与此同时,预测类技术也可以通过嵌入立法、执法、司法运行环节对法律从业者的行为实施程序角度的技术约束,校正人为主观偏见,减少个体化价值衡量的负面影响,如审判偏离预警技术等。

(3)监测、测试技术法律化:持续、准确的治理

由于智能技术超高的风险程度必须加以实时监管,传统法律设置的事前、事中、事后的“时间点状”治理留给智能技术过多“以身犯险”的治理空白,必须重新树立起“持续”治理意识。如在数字版权保护中,作品提供商以DRM系统等来实施监管,以反制技术与版权法共同维护其合法权益。又如批量拦截技术可靠性高,使用成本低,对隐私入侵性小,所以英国高等法院表示:“批量拦截是目前唯一可行、合法的手段,特别是在如今恐怖主义在全球不断蔓延的背景下。”再如中国所有平台都会通过技术手段持续防范网络攻击、侵权行为。此外,技术专家通常都是采用测试算法保证原始算法运行不偏离最初设计目的。加强智能技术的安全测试与实时监测,已成为域外智能技术治理体系的重要组成部分。

(4)区块链技术法律化:可信的治理

自区块链技术、智能合约等新数据技术出现后,技术人员首先发现区块链技术比法律在规范个人行为和交易时更为有效,区块链代码技术开辟了一种前所未有的崭新的规制范式。中国三个互联网法院全部搭建了司法区块链,最高人民法院也开始主导建立司法区块链统一平台。④目前,已建设“人民法院司法区块链统一平台”,完成超过1.94亿条数据上链存证、固证,利用区块链技术分布式存储、防篡改的特点,有效保障了证据的真实性,极大降低了法官认定证据的难度。区块链技术开辟了一种以自治规则为主的秩序系统。未来,伴随传统合同条款与法律规则能够实现更多地被转化成智能合约代码,法律人可能会主动尝试通过代码技术起草法律或合同。依托区块链技术的智能合同为交易提供了另一种范式的可能,生效的协议可以直接反身扮演仲裁者,当事先预设的交易条件满足时,合同就会被自动执行,削弱了物理世界交易中对法律系统的需求。国内有学者关注到传统法律治理手段替代品的出现,甚至提出“法律的死亡”。⑤余成峰:《法律的“死亡”:人工智能时代的法律功能危机》,《华东政法大学学报》2018年第2期。当然,赛博空间与物理世界并不会完全重叠,合同中的一些行为仍将在物理世界中进行,法律并不会“死亡”。

(5)人脸、生物、情感等识别技术法律化:争议中的治理

个人敏感信息的“非再生性”和“稀缺性”远强于普通个人信息,所以商家拥有极大的动力去攫取这种稀缺资源,但是这种资源被滥用时产生的破坏力与其价值成正比,其负面风险是难以估量和被承受的,这种巨大张力使得法律必须加以援手去疏解各方面的质疑。

美国在人脸识别技术应用上似乎走向了保守。从2019年5月,美国旧金山市成为全球首个对人脸识别技术发出禁令的城市,禁止该技术在政府机关和执法机关中使用。2020年7月,纽约州立法机构通过一项法令,直至2022年,禁止在学校中使用人脸识别和其他生物特征识别技术。①参见中国安全防范产品行业协会网站http://news.21csp.com.cn/c3/202007/11398108.html,2020年7月23日访问。美国国会两党罕见共同提案拟立法暂停使用人脸识别软件。

从“中国人脸识别第一案”到2021年7月28日,最高人民法院发布的《关于审理使用人脸识别技术处理个人信息相关民事案件适用法律若干问题的规定》,已经体现出中国人脸识别技术使用从野蛮生长走向规范化。《中华人民共和国个人信息保护法》(以下简称《个人信息保护法》)第26条规定,原则上图像采集、个人身份识别技术使用仅限于公共安全目的;第62条规定,针对人脸识别等技术应具有专门规则和标准。

(6)加密技术法律化:安全的治理

密码技术是个人信息与数据传输、存储及使用的重要技术保护手段。在互联网安全中通过防火墙或者IDS等技术手段设置的“界”异常关键。数据保护同样需要“界”,密码技术可以承担起设立“界”的功能。只有在数据传输、存储及使用形态的变化节点进行数据加密,才能建设出可信的、安全的数据防护体系。②在数据存储和使用态的切换中,如果只进行访问控制和身份认证,当明文数据在数据库或归档备份时,数据访问容易被绕过。只有在数据流转的关键节点上,对数据进行加解密,并结合用户的身份信息和上下文环境做访问控制,才可以构建防绕过的访问控制、高置信度的审计。2020年1月1日,中国正式实施《密码法》,对加密技术进行规定。在2021年9月1日正式实施《中华人民共和国数据安全法》(以下简称《数据安全法》)背景下,数据安全时代的加密技术将成为重要的技术治理类型。

总之,治理行为必定在一定场景中展开,适应场景化治理的技术种类必将得以确立。③吕德文:《治理技术如何适配国家机器——技术治理的运用场景及其限度》,《探索与争鸣》2019年第6期。以上技术治理手段如同工具箱中的工具,在不同的法律治理场景中被选取、整合为相适应的技术治理工具,排兵布阵以应对不同的技术治理目标。例如,ATT&CK被公认为是网络安全行业目前最权威并被普遍接受的“以网络攻防为中心的安全”框架,是架构与反制技术的完美结合。进入智能社会,应该在ATT&CK基础上演进研发出智能技术安全的技术框架,尽力覆盖“规训智能技术”的各种技术手段。

2.法律治理嵌入、归化技术治理

技术治理嵌入、赋能法律治理的同时,法律治理也须嵌入、归化技术治理。在开展技术治理时应注意防范技术崇拜,注重代码风险识别,技术治理手段也需要法律归化。

(1)不同场景法律治理嵌入技术治理的程度不同

不同场景中的权益间必然要经历相互角力、斡旋、达成合意的过程,当价值博弈有了初步的结论与定位,法律治理嵌入技术治理的限度才得以进行考量。在公、私两种场景下价值博弈过程存在较大差异,法律治理嵌入技术治理的程度并不相同。美国在智能技术相关立法中非常注重出台场景化单行法案,而欧盟则采取不分场景式统一立法。

在公共部门适用智能技术场景中,需要平衡的是工作效率与工作安全之间的关系,显然工作安全是首要价值。执法和司法部门采用智能技术自动化决策辅助法的运行,可以更准确地审核证据、评估危险以及辅助量刑。针对公共部门场景中技术带来的风险,公共部门必须对技术治理进行严格的内部法律监管,实现技术治理与传统法律治理的安全耦合。在政府部门使用智能技术场景中,为了保证民众信任与技术安全,可以在透明度方式问责中披露算法种类、参数、数据范围、目的等,以保证智能技术被可靠使用。问责的严格程度高于商业场景中技术监管标准。在特殊国家安全机关适用智能技术则具备更高程度的独立性,当关涉国家安全时,在保证数据使用的合法性及安全性的基础上,安全部门拥有监督豁免权,这在《数据安全法》中已经得到体现。

在私主体适用智能技术场景中,需要平衡的是技术创新与技术安全之间的关系,两者要保持动态平衡。针对商业场景中使用技术带来的风险,公共部门和私主体均应对智能技术开展有效监管。私主体内部监管往往通过“技术机制”的自治得以实现。外部公共部门监管程度应低于公场景适用技术的监管,且针对差异化商业场景的监管标准也应有所差别。商业场景中技术治理与法律治理的耦合运行比公场景中两者的关系应增加柔性,当新技术处于发展期时,国家不应激进地利用法律治理手段来抑制新技术的可期待发展。①全世界都在思量如何平衡创新规则和权利保护,遑论中国。中国由于错过了18、19世纪的第一波工业革命浪潮,从19世纪40年代开始便陷入被动挨打的局面,并且一度沦为半封建半殖民地社会。鉴于历史教训,中国政府从20世纪80年代开始便高度重视信息产业发展,力争赶上信息产业革命。如今进入智能社会,面对新一轮的世界科技竞争与红利,要求鼓励而非遏制技术创新。面对智能技术的巨大发展张力,全口径的规制理论储备是必要的,但全面诉诸法律规则显然是过度的。

不区分场景探讨技术治理与法律治理关系问题可能导致很多理论与实践问题。法律治理嵌入技术治理的程度,是与法律治理在不同场景中的严厉程度一致的,不分场景式的“一刀切”,或者导致私场景的监管标准“就高”公场景的监管标准,造成对新技术发展管控过严,或者反过来出现“就低”现象,使技术风险威胁政府信任。虽然智能技术相关政策通常都要囊括技术的必要性、合理性、透明性、隐私侵权性及其问责,但这些标准应该与智能技术的应用场景高度适应,不分场景的统一立法模式必然在具体规则上只能维持最大限度的原则性与概括性。只有区分场景探讨技术治理与法律治理的关系,才能厘清各种关系脉络,避免产生以往研究中时而出现的逻辑不清晰问题。这些问题的梳理与深入研究对于《个人信息保护法》《数据安全法》等法律法规将具有进一步的解释论意义,对于未来分场景进一步出台细则将具有立法论价值。

(2)法律治理嵌入技术治理最有效的手段仍然是技术治理(反制技术)

当“人”作为治理对象时,技术治理是“锦上添花”。而对于智能技术这种治理对象,技术治理则是“不可或缺”。如前文所述,无论是在公共部门场景还是在商业场景中广泛适用智能技术,都需要加以法律治理(监管)的“再治理”。对智能技术最有效的治理就在于“以技术反制技术”,“反制技术”也是技术治理的具体形式,如前文提及的架构技术、监测技术、检测技术、区块链技术、加密技术等都可以成为克制智能技术的“反制技术”。解铃还须系铃人,智能技术的规训还需要求助于技术本身。需要更加关注智能技术的技术特性,并坚持以技术逻辑为基础去研发其治理系统。在风险(持续)识别、事前(持续)防护、事中(持续)监测和响应、事后恢复、追溯反制等环节均需要技术手段的参与,唯有如此才能建立起高效的纵深立体化技术防御机制。

首先,大数据中存在的歧视与偏见可能导致智能技术产生继发性歧视与偏见,在海量的数据中有效识别、纠正歧视是无法以人力实现的,只能凭借智能算法技术本身。美国的算法影响评估路径遇到的最大瓶颈就是歧视的价值判断,人力评估根本无法承担这项工作。

其次,智能技术风险需要持续性监管,传统人力监管无法保持持续性。智能技术比以往的新技术有着超高的风险系数,甚至已经开始出现权力异化风险,必须树立起全新的“持续”治理意识。人类可以使用机器学习功能、评估预设功能,判断、分析非常规变化及不连续性,追踪并即时记录算法。以科学有效的“反制技术”对技术开展全生命周期不间断监督,精准、持续、高效监控所有不符合社会道德与法律法规的技术运行行为。加强智能技术的安全测试与实时监测早已成为实践中智能技术治理必不可少的组成部分。

最后,面对智能技术的迅速迭代、或然性以及黑箱性,或者是由于现有法律(传统立法明示、传统执法监管、传统司法矫正等方式)无法覆盖,或者是由于取证难,传统法律治理手段显得束手无策。以算法透明为例,披露静态代码的证据,无法确切证明某一特定决策是由该代码得出的,也无法证明与所披露代码的运行和设计部署者在划定数据集时所预估的一样。技术专家正在研发解决方案以突破算法透明方式问责的瓶颈,将来或许有可能证明算法程序的规范性或判定算法实施的一致性。但目前可行的方法是以机器学习识别算法实施中的程序不规范和非一致性结果。技术专家通常都采用测试算法来保证原始算法运行不偏离最初的设计目的。针对算法技术黑箱与不确定性,即使依靠利益攸关的个人、技术管理员、企业、行业组织及公共部门的协同人力监管,也会心余力绌。只有将攻克重心投向智能测试技术,利用技术本身对技术进行反制,才能实现法律治理。

此外,智能技术安全漏洞层见叠出,外界攻击战略及战术层出不穷,导致传统法律治理手段难以奏效,必须依靠技术专家提供的技术防御手段。

总之,在规训技术时务必要重视“以技术反制技术”这种最有效的技术治理。但是,围绕智能技术可责问题可能会引发评价反制技术治理的疑虑与难题:第一,反制技术受到目前技术水平发展的限制。存有偏见的技术审计与测试存在漏洞,透明化监管与测试技术也仍需研究。①如Facebook自2018年起就遭到其偏爱左倾新闻来源的批评,尽管美国并未展开相关调查,Facebook还是对其算法的政治偏见进行了内部技术审计。从技术的角度来看,对测试结果的正确解释可能受到技术能力的限制,尤其是对于机器学习的算法“内部如何达成结果”可能无法进行有效解释。这限制了监管部门提供证据,以确认平台算法设计和运行中的过错。第二,监管是一个智能机器对另一个智能机器的监管,缺少人类介入。第三,智能算法和大数据交互与人机交互,两者在过程及效果上有着较大差别。第四,评估潜在风险的所有策略皆应竭力充分考量各种社会背景因素,但是人类理性是有限的。

二、公场景中技术治理与法律治理关系模型:赋能模型

这种赋能模型是指在执法、司法等公共部门使用智能技术场景中,从国家主义出发,坚持“技术”的客体地位,以技术赋能法律,通过“技术信任”赋能“制度信任”,将技术治理工具纳入法律治理范畴,两者双向互嵌运行的模型。世界上绝大多数国家在公权力场景中的技术治理与法律治理关系模型都是赋能模型。即使在有“技治主义”和“第三部门”理论铺垫的美国也很难将技术治理作为权力分享的主体,而只能成为赋能公共管理或法律治理的客体。在执法和司法部门,各国充分尊崇智能技术伦理指南,在“弱人工智能”阶段,技术治理被定位成辅助、赋能执法和裁判,而不是取代执法者和法官。

美国在公场景中实现了算法系统广泛嵌入执法、司法部门。然而,智能技术在司法系统的嵌入没有被规范式监管引发了大量质疑和异议,②如在美国威斯康星州State v.Loomis案件中,法院在量刑过程中使用了一款Compas算法软件。被告得知后质疑算法的准确性、透明性以及公正性,认为法官违反了正当程序原则并上诉到州最高法院。州最高法院则以被告没有提供足够证据证明算法软件成为法官量刑唯一的考量为由,驳回了上诉。因此,法院在采用智能技术时十分审慎。数据监视、算法决策等技术治理手段可能会对公众人身权、财产权以及社会福利产生重大影响,亟待民主参与及监督程序以防止技术歧视及偏见等负面风险的发生。“技术黑箱”使技术治理变得无形且不可察觉,关于“开放式”与“封闭式”两种代码边界的争锋虽然尚没有结论,但依据劳伦斯·莱斯格的观点,有两点是可以确定的:第一,开放式代码是国家权力的一种制约;第二,在某些情形下,代码在一定范围内应当公开。③劳伦斯·莱斯格:《代码2.0:网络空间中的法律》,第155页。鉴于代码公开程度的桎梏,美国研究机构AI Now Institute另辟蹊径,在“数据保护影响评估”④《欧盟通用数据保护条例》(缩写GDPR)第35条规定了“数据保护影响评估”(Data Protection Impact Assessment,缩写DPIA)。基础上提出了“算法影响评估”,在公共部门适用算法自动化决策重要事项前,应当开启重要程序,以确定算法危害发生的时间、方式。公共部门应增强算法专业知识和实践能力以科学评估算法,且允许第三方审计算法。美国政府针对算法的治理首先就指向了公共部门适用的算法。2017年12月11日,纽约市通过了《关于政府机构使用自动化决策系统的当地法》,规制法院、警局等公部门适用算法的行为,这成为算法监管启动的原点。2018年1月17日出台《自动化决策特别工作组法》,⑤马长山:《司法人工智能的重塑效应及其限度》,《法学研究》2020年第4期。由纽约市政府成立“纽约市算法特别(监管)工作组”,但没有配备执法权与相应的法律责任,所以公共机构可以选择替算法提供方保守商业秘密,这种监管立法直接造成工作组只能被动寻求公共机构和算法开发商自愿披露信息或遵守建议,导致监督权力落空。2018年10月,纽约市出台《算法问责法》,首创式地规定公共部门和慈善团体适用算法须接受自动化决策特别工作组算法影响评估,但由于没有执法保障制度,仍然无法完全扭转监督工作的困境。形成对比的是,这种算法影响评估制度最终在私场景中通过美国联邦《算法问责法案》得以实施。

英国政府已经意识到执法和司法机关等公共部门是特殊机构,承担不同于私人及私人组织的义务,公行为必须透明,遵循正当程序,对公民负责,为达到技术治理中的工作标准,政府应该明晰其公共地位以及所担负的职责与义务。针对公共部门在适用智能技术时肩负的特殊职责,英国内阁会议在2016年发布了政府分析员适用政府内部数据技术工具的首例伦理道德指南,指南由政府内外部数据专家协同制定,主要围绕两个问题:一是人类永远不能够脱离决策圈,人类应该对智能系统自动化决策结论提出“适度”质疑,既不可以让其成为主体,也不可以过于轻率。二是智能系统处理个人数据必须遵守现有法律法规;同时,强调审慎包容的沙箱监管,期望控制所有潜在变量,使错误得到安全控制、引导;要求公共部门间可以通过资源及方案共享,使容错纠错机制尽快成熟。值得反思的是,英国至今没有相应的专门监管部门,公共部门使用智能系统情况不够透明,基本没有办法确定政府在什么领域和工作中适用,公共部门是否维持责任制更是无从判断。

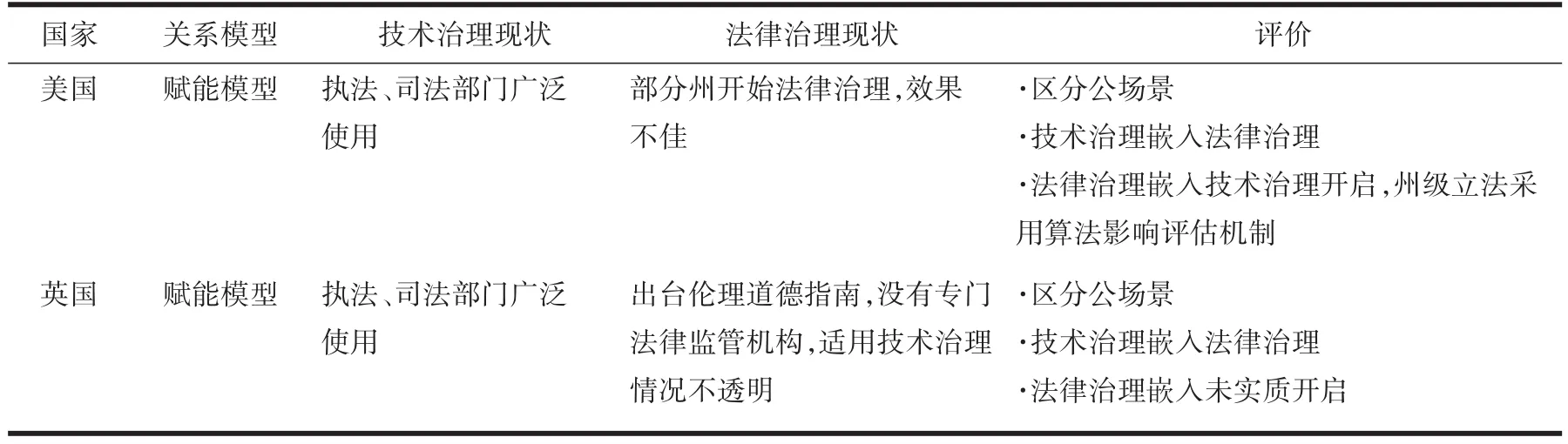

表1 公场景中技术治理、法律治理关系模型比较

世界上很多发达国家在执法和司法部门中均适用智能技术,以技术治理赋能法律治理。但是,在赋能模型的总体定位中,各国普遍缺少技术治理与法律治理两者具体互动耦合关系的理论研究和实践模板,尤其体现在法律治理嵌入技术治理的严重不足和“反制技术”手段应用不足上,即对技术治理“履职”缺失相应法律监管“再治理”框架,如图2中箭头部分(目前实践中应重点关注与完善的工作)。这极易导致公部门在运用智能技术时引发潜在的社会隐患与公众不安,也反过来不利于政府部门顺畅利用智能技术开展技术治理。

图2 公场景中的技术治理与法律治理赋能关系

三、私场景中技术治理与法律治理关系模型:单重模型与兼重模型

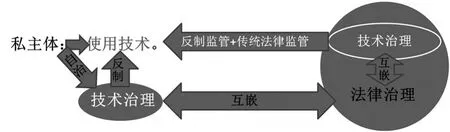

私场景中技术治理与法律治理的发生过程与公场景中存在差异,如图3。公共部门在使用智能技术时,因其特殊的公权力职能,所以可将其使用智能技术以达到治理目的的过程称为技术治理,并成为法律治理的一部分,如图2。私主体使用智能技术的目的通常并非出于治理目的,当出于经营目的时不可以称之为技术治理。需要说明的是,当其作为公权力技术治理的必要组成部分时,则为技术治理,因为公共部门的数据必然要依赖“关键信息基础设施”的大型平台获得,且如前文所述,当架构技术法律化时,平台设计技术框架控制用户的行为本身可能实质上就是一种技术治理,因为这种架构会间接受控于政府。所以,私主体使用智能技术是否可认定为技术治理要依据目的而定。鉴于目前私场景适用智能技术的本质目标是商业经营,我们暂且不将私主体适用智能技术的行为定性成技术治理。但是,当私主体对所适用的智能技术行为开展“以技术反制技术”达到自治时,可以被称为技术治理。

图3 私场景中的技术治理(新型法律治理)与传统法律治理关系

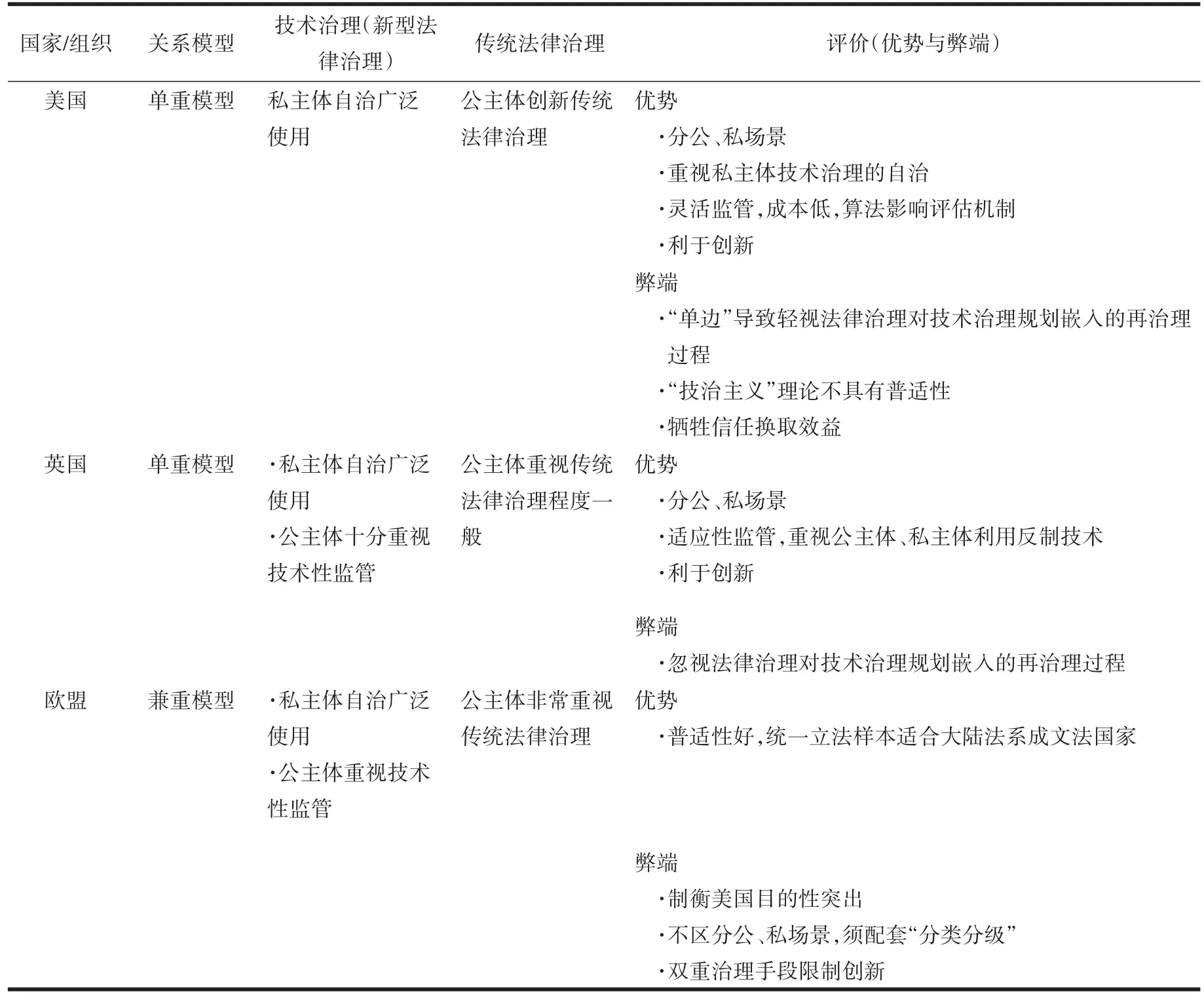

在私场景中,各国关于技术治理与法律治理关系的实践模型,实质上是技术治理(新型法律治理)与传统法律治理关系的模型:一种是单重技术治理,轻传统法律治理的关系模型,以美国、英国为代表。第二种是技术治理、传统法律治理兼重关系模型,以欧盟为代表。

1.单重技术治理的关系模型

单重技术治理的关系模型指在商业主体适用智能技术场景中,“单边”重视凭借“以技术反制技术”的技术治理,以技术信任为主的治理模型。技术治理的主体可以是私主体,也可以是公主体。

(1)典型分析

第一,美国:单边重视私主体开展的反制技术自治。

美国早在网络社会时便逐渐创建了以反制技术和私主体自治为主的技术治理体系,从此改变了传统的以主权国家为核心的自上而下的法律治理模式。①Jack Goldsmith&Tim Wu,Who Controls the Internet?Illusions of Borderless World,Oxford University Press,2006,p.23.美国通过极力限制监管范围使技术红利极值释放,助力美国一直保持技术创新的领跑地位。如今进入智能社会,美国依然想要延续这种单重技术治理的模式,主要先依靠行业自治,鼓励或强制要求行业以技术手段进行自我矫正。平台、技术行业组织等实施的技术手段自律、自治扮演绝对主角,而法律治理中的行政监管措施则是在行业技术治理失灵后扮演补位角色。以效益分析保证监管的科学性、灵活性,避免硬化立法规制细节,强调不监管和非监管措施。但是这种“单腿蹦”模型造成过于放松公共部门的监管,包括对私主体使用智能技术的监管、对私主体使用反制技术的监管、对公共部门以技术反制技术的监管都留下太多监管洼地,体现为图4中的右侧区域的箭头部分。虽然这些监管洼地有可能仅是表面上的,但仍可能导致民众信任危机(认为美国政府不作为),而隐秘开展的监管又缺少合法程序。

图4 美国技术治理(新型法律治理)与传统法律治理的“单重”关系

美国正在探索从“不监管”向“灵活监管”发展的路径,目前其创立的算法影响评估制度就是对传统法律治理方式加以“协同”理念的全面改革。美国国会出台《算法问责法案》,旨在指导联邦贸易委员会(算法评估的监管机构)规范私场景中私主体收集、存储、处理及共享个人信息。该法案采用了算法影响评估的机制,评估算法决策对公平、隐私保护、数据安全等方面的影响,在评估中仍然将私主体的“反制技术”机制作为重要的评估指标。没有规定风险等级,仅基于差异化场景加以结果披露,不具有其他问责法律效果。采用这种灵活动态的监管,相比要求算法公开及解释等算法透明路径②2019年2月5日加拿大颁布的《自动化决策指令》中算法影响评估制度采取透明度措施:从评估决定的通知和公布、决策后提供解释、访问组件、政府对所有已发布专有组件审计、调查、检查保留权、源代码发布等算法透明度措施加以规定。相对宽松,且有利于智能技术产业的发展。但关于评估中的歧视等价值判断问题仍是难题,是人力评估无法做到的,所以,美国政府还需要增强对“反制技术”的研发与使用。不过,美国政府并不想真正实施严格监督,依然旨在以私主体技术自治为重,实施灵活宽松的监管。

第二,英国:单边重视私主体和公主体开展的反制技术治理。

英国旨在兼顾公众信任和技术信任,正在尝试遵循技术逻辑的适应性监管,即在私主体开展的反制技术自治基础上,同时重视政府开展的反制技术治理。早年英国关于互联网监管和美国一样属于后置监管。当进入智能技术时代的英国脱欧,一方面为了促进负责任的创新并取得公众信任,另一方面为了投资者、发明者争取合理的数据使用,英国政府开始探索采用负责且积极的监管。政府发现,传统法律治理方法无法有效适用于持续学习进化的智能系统的检验和认证,因此政府开始将公共部门适用的智能技术引用到对技术的监管之中,以公权力开展的技术治理对技术进行监管。①例如英国期望尝试谷歌深度思维公司(Google Deep Mind)和牛津大学联合发起的人工智能系统的“自我毁灭装置(kill switch)”的研究项目,这个装置能够让人工智能系统处于不间断的人类监管干预之下,而且人工智能机器本身无法逃脱这一监管干预。英国的监管比美国监管多了一重公主体开展的反制技术治理,少了一些监管洼地。

(2)单重技术治理模型的理论溯源

关于法律治理失灵与技术治理补位,技术治理权力与法律治理权力平衡,技术专家参与法律治理等问题的讨论,无论如何都避不开重新审视“技治主义”理论。“技治主义”经过汰旧迎新的自反性发展,其在西方智能社会中的生命力更具有巨大张力,其内涵、价值与实施皆获得了智能社会注入的新生内容。

“技治主义”自20世纪30年代在美国兴起,随后这场政治思潮席卷全球,从而对现代国家的治理模式产生了广泛影响。“技治主义”(technocracy)从词源角度看,它可以指由科学技术专家拥有公权力的政治制度,也可以指科学技术专家及他们所掌握的科学、技术在国家中的权威地位等。在技术稀缺的社会中科学技术的负面效应几近可控,科学技术片面地展现出了确定性,于是科学技术专家成为权威走上神坛,如同中世纪的宗教一样禁锢了人们的反思性与批判性。②赫伯特·马尔库塞:《单向度的人——发达工业社会意识形态研究(世纪文库)》,刘继译,上海译文出版社年2006版,第3页。作者揭示了“一种舒舒服服、平平稳稳、合理而又民主的不自由”在发达工业社会的流行。转变发生在20世纪90年代,“生活所依赖的确定性源泉变化了”,③乌尔里希·贝克:《风险社会》,何博闻译,译林出版社2004年版,第15页。信息社会中生产力的指数式增长,使风险的释放达到人类有史以来的峰值。技术科学的或然性和未知性使民众陷入“无知”“蒙昧”“无助”的假性回归,科学技术的权威不再是效率与公正的代言人,“技治主义”在公众的质疑中开始祛魅。科学继而反观其自身的本体性问题,而这种自反性思辨首先聚焦于风险认知。

当前关于“技治主义”理论思辨的目的,是通过发起具有类似于“法治”的政治、哲学、社会、经济等意义的讨论,期望利用新理论与策略改善技术参与社会治理的发展环境。“技治主义”的自反性发展确实给实践中的技术治理完善带来了很多启示:一是识别与控制技术风险,如算法黑箱、算法霸权、数据鸿沟、数据孤岛等风险;二是重视程序民主,技术治理需要遵循法律治理的合法程序及其内在价值,充分吸收民众意见以达到程序正义;三是引导多方利益攸关主体共同参与技术治理,所有利益攸关方,包括非政府组织、政府、技术专家、个体,均应参与围绕新技术展开的技术治理和法律治理。这些启示成为优化技术治理与法律治理关系的重要理论。

(3)单重技术治理模型的优势与弊端

单重模型的优势有:第一,分场景对技术进行灵活监管。如针对私主体适用算法的监管,美国联邦出台《算法问责法案》。又如针对数据保护美国依据行业分类出台法案,没有出台统一法案。在国家安全场景中,美国对数据技术安全控制异常严格,如《澄清海外合法使用数据法案》④参见美国律政司官方网站https://www.justice.gov/dag/page/file/1152896/download,2021年6月20日访问。、《2019美国国家安全与个人数据保护法案》等。⑤参见美国国会官方网站https://www.congress.gov/bill/116th-congress/senate-bill/2889/text?r=1&s=2,2021年7月15日访问。第二,在监管中突出重视私主体或公主体开展的技术治理方式,用技术反制技术取得实效。第三,可以缓解政府直接监管而导致的成本高、效能低问题。第四,监管松绑十分有利于技术创新和产业发展。总体上,“单重”模型虽然不完全符合中国的理论与实践,但其特有的优势与成效需要科学镜鉴。

单重模型的弊端有:第一,没能正视技术治理、法律治理两者互嵌的运行规律。仅单边重视技术治理对法律治理的赋能嵌入,却轻视或忽视了法律治理对技术治理规划嵌入的再治理过程。对互嵌关系理论研究和实践上的不足,导致英国开展反制技术的技术治理行为被认为是“以机器监管机器”,这种质疑存在一定合理性,其深层原因是没有深刻认识到:以技术反制技术不是让技术拥有主体地位,而是要在法律规训底色上开展技术反制。第二,理论基础“技治主义”理论虽然具有启发价值,但并不意味其具有普适性。“技治主义”理论根植于美国理论与实践的土壤,其原生逻辑无法融入并支撑中国实践。中国有学者认为,“网络自主空间有以技术代码和自治伦理为主的技术治理,技术治理区别于法律治理”。①郑智航:《网络社会法律治理与技术治理的二元共治》,《中国法学》2018年第2期。这种二元并立的关系模型以“技治主义”理论为基础,与中国现有的法治理论体系无法达成共识。中国法治语境下的技术治理“公”烙印非常深切,假若强行植入“技治主义”理论必定水土不服。而中国目前关系模型理论研究中均采用“共治”或“协同”的描述。第三,以效益分析为基础,以牺牲民众利益和信任换来效益最大化。美国政府将监管责任推诿至企业自治,所以在开发人工智能技术上美国公众相对信赖的是军方和大学,在监管方面公众则更加信赖智能技术公司和公益组织而非政府。②2020年9月三家美国科技巨头IBM、亚马逊、微软接连暂停向公共部门提供人脸识别技术。IBM CEO克里希纳(Arvind Krishna)向美国国会议员发出公开信,宣布不再提供通用人脸识别软件,提议制定负责任的技术政策;紧接着,亚马逊亦声明暂停向警方提供人脸识别技术一年时间;微软也表态停止向警方销售人脸识别软件,直到有相关国家法律出台。

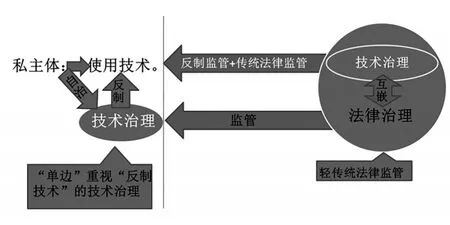

2、兼重传统法律治理、技术治理关系模型

“兼重模型”指在商业适用智能技术场景中,既重视传统法律治理,也重视技术治理这种新型法律治理方式(图5)。将传统法律治理与技术治理“两手抓”,实现全方位、严厉的技术管控。技术治理的主体可以是行业自治主体,也可以是公共部门,所开展的“以技术反制技术”的过程都是技术治理。典型代表是欧盟。

图5 技术治理(新型法律治理)与传统法律治理的“兼重”关系

(1)典型分析

欧盟一直致力于建设“单一数字市场战略”,以制衡美国等国际新技术产业势力。③欧盟各成员国国内立法和司法的差异阻碍欧盟的统一运作,尤其是妨碍了跨国界数字服务的发展,导致欧盟在互联网领域长期缺乏竞争力。因此,无论是《电子商务指令》的再扩张,还是拟制定的《数字服务法案》,或是已经颁布的《单一数字市场版权指令》、GDPR,以及持续推进中的数字税、平台治理规则、互联网反垄断调查等,都是欧盟实施“单一数字市场战略”的重要举措。欧盟法院(CJEU)也通过了一项裁定:各成员国可要求Facebook在全球范围内筛选和删除被认定为非法的内容。欧盟法院此次判决进一步体现了这一趋势,尤其是在涉及假新闻、仇恨言论等非法内容的治理上,欧盟频频给美国大型互联网平台施压。欧盟寄望将这一目的通过传统法律治理手段和反制技术手段加以实现,以此构建统一化的技术监管。欧盟负责且审慎的智能技术监管旨在以强监管保护个体权利、区域经济和世界话语地位,具体采用的是分类监管、长臂管辖,以及涵盖事前—事中—事后全环节的持续监管机制。

欧盟在立法中的最大特点就是不分场景统一立法。如《欧盟通用数据保护条例》(缩写GDPR)就是统一的、非常严格的立法模板,再如《算法责任与透明治理框架》④参见欧洲议会智库官方网站 http://www.europarl.europa.eu/thinktank/en/document.html?reference=EPRS_STU(2019)624262,2021年7月1日访问。《算法责任与透明治理框架》是由欧洲议会未来与科学和技术小组(STOA)发布的一份关于算法透明和责任治理的系统性研究报告。在算法监管方面与美国的算法影响评估监管不同。由于采用统一立法的模式,必须配套算法“分类分级”监管,以控制成本和缓解其技术创新阻碍。欧盟设计出侵权责任与算法影响评估的分层次动态配合机制:对于高风险算法可以考虑施加算法影响评估;对于低风险算法则匹配严格侵权责任,结合减轻算法评估、认证及保证义务。并设立算法监管机构负责协同利益攸关主体制定标准、负责风险评估、调查侵权以及向其他监管机构提供专业建议等。此外,欧盟也重视以“反制技术”的技术治理开展“持续”监管:事前阶段,对高级别风险智能技术开展合规评估与认证(包括测试、监测及认证程序),且辅以检查智能技术开发时采用的算法和数据集的传统手段。针对事中和事后阶段,开展监测和审计等形式的执法,测试主体包括监管部门或者第三方机构。同时,欧盟也关注私主体在自治中采用反制技术的技术治理,如GDPR第25条规定,数据控制者在构建算法系统及处理数据时,必须利用相匹配的技术治理和其他治理措施。

(2)兼重模型的优势与弊端

兼重模式最大的优势就是以其全面的立法体系成为大陆法系国家的立法模板,具有较好的普适性。但是目前欧盟的“兼重”模式由于制衡美国的目的和图景过于锐化,且缺少对技术治理与法律治理耦合关系的深刻认知,亦引发了不同程度的弊端。

第一,欧盟为达到制衡美国的目的,导致“杀敌一千,自损八百”,抑制了自身的创新。①全球市值最高的20家互联网企业中,没有一家来自欧盟,尽管其中的原因非常复杂,但是欧盟作为全球最早对数据市场进行立法规制且对个人数据保护得最为严格的地区,其数据经济发展没能与个人数据保护水平达到同样高度,或许说明了对个人数据的收集与利用监管过于严格会影响产业的发展。并且欧盟认为美国数据巨头在欧盟市场过于强势,因此在制定法律时还有一层通过严格监管来制衡美国数据巨头的意思,防止其形成对数据产业的垄断。第二,欧盟不区分公、私场景采用统一立法模式,最易出现的问题就是过于严厉,必须配套“分类分级”监管,以防止过度遏制技术创新。第三,“双重”监管体系将新技术束缚得没有足够成长的空间。对技术规训最有效的手段就是反制技术,欧盟在此基础上又叠加传统法律治理系统,双重治理狙击下的技术发展必然举步维艰。

表2 私场景中技术治理、传统法律治理关系模型比较

四、中国特色的关系模型选择与构建

不同场景中关系模型的理论根基及实践目标各不相同,理性选择适宜的关系模型,须充分尊重不同国家的理论渊源与历史传承,更须在差异化的国家体制与意识形态中具体分析、选择对象的实践土壤。

1、中国特色的关系模型选择

(1)公场景中的模型:赋能模型

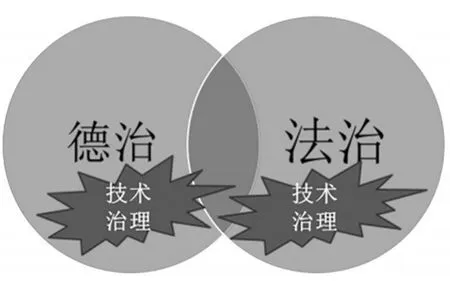

在公场景中各国关于技术治理与法律治理关系的实践模型无一例外都是技术治理赋能法律治理模型。从中国现有法治理论与实践基础来看,技术治理是法律治理的下位概念,是新型的法律治理手段,与传统法律治理手段共同涵摄于法律治理之下。在中国法安天下,德润人心,法治和德治相辅相成、相得益彰,两者并举是推进国家治理体系与治理能力现代化的坚实力量。虽然技术治理具有泛在性与嵌入性,它可以成为“法治”的分子,也可以成为“德治”的分子,却无法成为具有独立地位的分母,如图6。

图6 法治、德治及技术治理关系

利用技术治理实现中国治理能力现代化是中国现有政策的应有之意。在智慧公安、智慧检察院、智慧法院等法治系统的智慧转型也将技术手段融入法治运行,为中国法治适应智慧时代赋能增效。但也应保持审慎与理性,防范技术不透明、技术歧视、技术不确定等风险对中国现代法治可能带来的负面影响。然而公场景中算法决策适用的相关立法一直滞后于私场景中算法决策的相关立法。《个人信息保护法》《数据安全法》的出台初步对公共部门处理个人信息、数据进行了框架性规定。

(2)私场景中的模型:技术治理为主+传统法律治理为辅的组配模型

在私场景中各国关于技术治理(新型法律治理)与传统法律治理关系的实践模型,主要分为单重模型和兼重模型,中国应全面镜鉴两种模型的优势与弊端。在中国技术监管中,应由国家主导,社会协作。充分调动社会中的行业自治,同时提高国家与社会的合作深度。当合作规模越大,程度越深,共识越多,中国的技术监管就越灵活,技术创新就越有活力。简言之,就是遵循技术逻辑,由政府与企业协作监管技术,主要采用“以技术反制技术”这种最有效的监管方式,辅以传统法律治理手段。这种主、辅“浑然”组配模型的研发过程需要技术专家与法律专家的通力磋商、配合与协调。①《个人信息保护法》第11条规定了政府、企业、相关社会组织、社会公众共同参与个人信息保护的法治环境。第51条规定了个人信息处理者应采取相应的加密、去标识化等技术治理手段防止风险。第66条规定了如未采用相应安全技术保障手段的法律责任。《数据安全法》第9条规定了政府部门、行业组织、科研机构、企业、个人等主体合作参与数据安全保障过程的协作机制。第27条规定了为确保数据安全,在数据处理过程中要采用相适应的技术手段和其他必要措施。第45条规定了不采用适合的技术手段治理的法律责任。

2.中国特色关系模型的建设

(1)场景的精细化:分场景细致描绘技术治理与法律治理耦合互嵌限度

《个人信息保护法》没有清晰区分公、私场景,模糊了公、私主体适用智能技术的性质差异。公主体适用智能技术是在开展技术治理,以工作安全为第一要务。私主体以经营目的适用智能技术则需要平衡安全与创新。这导致《个人信息保护法》无法清晰描述技术治理与法律治理耦合互嵌限度,只能做框架性和原则性的规则设定,以避免出现严厉程度“就高”或“就低”现象。《个人信息保护法》采用了如同欧盟的统一立法模式,也配套了粗犷的“分类”制度,尽力弥补场景化、精细化治理的不足。《数据安全法》不区分公、私场景是因为其从国家安全场景维度进行了场景精细化,统一标准的同时配套了“分类分级”制度,进一步促进场景精细化。未来需要在现有立法资源基础上,进一步分场景出台更为细致的法律法规,以描绘不同场景中技术治理与法律治理的耦合互嵌。工作指南、标准等文件相较行政法规更加具有实验性与灵活性,是实验期的最优选择。中共中央发布的《法治社会建设实施纲要(2020—2025年)》亦建议开展算法应用调查,识别不同应用场景下的算法危害,加快出台算法应用规则和标准规范。

首先,在公共部门适用智能技术开展技术治理亟须法律对其履职进行“再治理”。目前世界上普遍存在技术治理与法律再治理规则异步的困局。《个人信息保护法》考虑到公私场景存在差别,单独设定一节“国家机关处理个人信息的特别规定”,但是仅五条,且没有针对国家机关开展技术治理的底层技术逻辑展开法律制约与归化。如第34条规定,国家机关处理个人信息应按法律、行政法规规定的权限、程序进行。然而对于算法决策,传统的正当程序等制约机制(如通知、公告等民主参与渠道)如同“螳臂挡车”。政府机构使用智能技术时务必注意增强公众信任与政府公信力,以工作安全为第一要务。目前中国应该出台更加细致的技术治理安全工作指南,指导政府机构使用智能技术,开展法律底蕴之上的技术治理。2021年5月,《最高人民法院网络安全和信息化领导小组工作报告和下一步工作安排》《最高人民法院信息化建设五年发展规划(2021—2025)》发布,文件的焦点主要集中在以技术治理嵌入、赋能法律治理。对于法律治理嵌入、规训技术治理则一笔带过。

其次,在私场景中可以采用在行业场景中开展适应性治理的路径。《个人信息保护法》对私场景中的个人信息处理者设定框架性、弹性的义务与责任,以确保当私场景进一步细分时,可以灵活权衡各方利益。统一立法模式只能起到公因式效果,无法全面适应金融、卫生、教育等不同行业,可以借鉴美国在私场景中以行业分类出台法案的做法。中国2021年10月1日实施的《汽车数据安全管理若干规定(试行)》是细分出汽车数据安全场景的规章制度,这无疑是有益的尝试。

(2)技术治理的优位化:以人为治理对象时,鼓励合法尝试技术治理;以智能技术为治理对象时,创建技术治理为主+传统法律治理为辅的“浑然”组配模型

应深刻理解以技术治理赋能法律治理,在理论研究与实践中鼓励合法尝试技术治理。尤其在规训技术时务必要强调以“技术反制技术”的技术机制,让技术治理与传统法律治理完美组配,成为全新、高效、完整的治理组合系统。

首先,在现有的规训智能技术的理论研究中,“反制技术”是最被忽视的,但其却是最有效的手段,这种理论研究现状导致了在肓视“反制技术”机制的策略体系中过度研发传统的法律治理手段。所以,需要法学家预先“跨域”把握“反制技术”的基本原理与治理效果,再配套研发传统法律治理手段,才是规训技术理论研究应有的跨域研究范式。在技术规训过程中,务必要认清反制技术本身就是新型法律治理手段,不可僵化地依赖传统法律治理手段,在智能时代里少走弯路。要将“以技术反制技术”的技术治理提升至策略集中最重要的地位,并尽可能无缝辅以其他适应性传统法律治理手段,以避免过度束缚技术创新和加重执法成本。

其次,在规训智能技术的实践中,针对智能技术治理赤字问题,习近平总书记提出要“用网治网”①2018年8月21日全国宣传思想工作会议上,习近平总书记提出:“我们必须科学认识网络传播规律,提高用网治网水平,使互联网这个最大变量变成事业发展的最大增量。”、“技术治网”②2019年1月27日,全媒体时代和媒体融合发展举行第十二次集体学习,习近平总书记提出:“着眼防范化解风险、造福广大人民的目标,全面提升技术治网能力和水平,规范数据资源利用,切实防范大数据等新技术带来的风险。”。此外,业界也开始出现“人机共治”③2018年11月8日第五届世界互联网大会提出“用科技延伸人类智慧,建立人机互信共治的世界”。的概念。“以技术反制技术”成为规训技术的必然选择,“反制技术”将迅速成为智能社会的治理“重器”,这也符合中国新形势下“敏捷治理”④2019年6月,中国国家新一代人工智能治理专业委员会发布《新一代人工智能治理原则——发展负责任的人工智能》(以下简称《治理原则》),提出了中国人工智能的治理框架和行动指南。《治理原则》不仅强调了人工智能的可问责性,而且提出了公平公正、尊重隐私、安全可控、开放协作、敏捷治理等8项重要原则。的新要义。智能技术的规训是有史以来最为复杂的治理挑战,需要构建一种以“反制技术”为核心、兼以其他传统法律治理手段为辅的崭新的“多边”系统。

最后,在规训智能技术的立法中,对“反制技术”重视不足。“反制技术”可以实现人力无法做到的监管,使风险防护缺口尽可能收紧。如《个人信息保护法》第54条、第55条仅分别设立适用主体事中定期合规审计和事前评估制度(类似算法影响评估),没有提及以技术工具开展审计与评估。没有“反制技术”参与的审计与评估的有效性是值得商榷的,技术的连续性、黑箱性、或然性、偏见识别的困难性都导致人力审计与评估结论存疑。①如加拿大颁布的《自动化决策指令》,其立法者运用动态编程语言创建开源性算法影响评估模型,参与者仅需花费35分钟即可利用该评估模型完成一项评估,十分便于监管者和设计者追踪风险产生的具体环节。而且当自动化决策系统的功能或者应用场景发生改变时,评估模型会依据新的因素及时更新。为确保评估规定符合最新算法实践,该指令采用动态治理思路,每隔6个月就会对评估标准和治理框架进行必要的更新。所以,公共部门还须进一步对不同智能技术标准、测试程序、审核标准加以细致研发。再如《数据安全法》第3条提出保障数据“持续”安全理念。高风险的智能技术需要匹配“持续”监管意识,只能依靠“反制技术”“持续”监管才能得以实现:利用智能技术手段强化对网络平台算法的数据采集、处理、结论等环节的“持续和实时”监测,加强对各种风险的预测、识别、防范及处置能力。然而,《个人信息保护法》没有提及“持续”安全理念。此外,对于其他类型的技术风险(侵权、攻击等)的技术监测也是基于私主体自治而做出的。未来在涉及数据、算法、人工智能、网络等技术规训的立法中均应重视“反制技术”。

(3)传统法律治理的协同化:传统法律治理高度“协同”的适应性变革

在规训智能技术时,相较技术治理这种新型法律治理手段,传统法律治理虽然处于辅助地位,但务必要做出适应性变革。应积极探索法治主体多元协作、法治运行方式多元协作和规则多元协作等。②Roger Clarke,Regulatory alternatives for AI,Yale Computer Law&Security Review,2019(35).目前美国、加拿大设立的算法影响评估制度就是出自“协同”理念的改革。③张欣:《算法影响评估制度的构建机理与中国方案》,《法商研究》2021年第2期。文中提及算法影响评估制度实现的路径是框架式治理和协同治理,实质上就是指“协同化”改革。

首先,法治主体多元协作,指国家、政府、行业组织、企业、社会组织、自然人等主体共同参与制定规则、化解纠纷、维护技术行业利益和消费者权益等法治环节。2005年,联合国在信息社会世界高峰会议上首次提出了网络社会多利益攸关方治理模式。④郑智航:《网络社会法律治理与技术治理的二元共治》。这种模式很快被欧盟引进人工智能的伦理治理。⑤曹建峰、方龄曼:《欧盟人工智能伦理与治理的路径及启示》,《人工智能》2019年第4期。中国《个人信息保护法》第11条、《数据安全法》第9条分别规定了利益攸关主体的协作参与。智能技术的专业鸿沟导致跨专业学者和普通人很难准确全面地识别技术风险。所以,一方面需要让立法—执法—司法部门、学术界、行业组织、社会组织、技术专家、从业者等均参与到新技术的规训中,保证技术规训方案(强制规范、技术标准等)是在科学吸收利益相关方意见的基础上出台的。另一方面需要在研究领域和教育领域加深跨域实践,更好地突破技术与法律间的壁垒,构建技术和法律专家融通的话语体系。

其次,法治运行方式多元协作,指法治需要科学立法、审慎包容执法、公正司法、依法自治等运行方式协作。其中最容易忽视的就是依法自治,而自治恰恰是技术规训的“元规制”。各国经验表明,技术规训需要更多依靠行业自治与“技术反制”的结合,而非过于诉诸传统立法、监管和司法。政府监管与私主体内部监管要尽力形成深度协作,重点推动私主体的技术力量自治,辅以灵活执法。《数据安全法》第10条对行业组织加强行业自律专门提出了要求,《个人信息保护法》对此则未以独立条文明确规定。在立法环节,要避免立硬法、赋硬权,初期应鼓励以“契约法源”实现动态赋权模式,出台“签约指南”、汇编指导案例等,然后逐步走向精细化立法,外加司法解释续造。在司法环节,注重个案司法审查,充分关注技术适用场景,平衡利益攸关各方的利益。此外,鉴于算法技术的权力异化迅速,须引入公益诉讼以制衡算法权力,这在《个人信息保护法》中得以实现。

最后,法治规则多元协作,指“硬法”“软法”综合治理。“法律”和“标准”的制定主体、制定程序等均存在较大区别,然而两者在性质上均具有规范性,技术标准事实上成为“隐形的法律”。⑥王庆廷:《技术标准的三重属性——兼论技术标准与法学研究的关系》,《中国科技论坛》2018年第2期。在中国既有的标准化法律体系中,“标准”分为五类:国家标准、行业标准、地方标准、团体标准和企业标准。标准(尤其是强制性标准)既非法律,也非技术法规,是拥有“软法”效力的技术规范。⑦包建华、陈宝贵:《技术标准在司法裁判中的适用方式》,《法律适用》2019年第13期。“法律”和“标准”体现出一种互相融合的关系,“法律”须引入“标准”,“标准”须吸收“法律”。⑧柳经纬、许林波:《法律中的标准——以法律文本为分析对象》,《比较法研究》2018年第2期。中国应鼓励各类主体积极出台各层级的技术标准,助力“柔性化”标准制度的充分构建。并且将技术标准融入行政法,将行政法治中的刚性(强制性)柔性化与灵活化。①关保英:《论行政法中技术标准的运用》,《中国法学》2017年第5期。2021年4月27日,《数据安全治理能力评估方法》团体标准发布,进一步完善了“软法”体系,②《信息安全技术大数据服务安全能力要求》《信息安全技术大数据安全管理指南》《信息安全技术数据安全能力成熟度模型》等国家标准。与“硬法”体系③《国家安全法》《网络安全法》《电子商务法》《密码法》《民法典》《数据安全法》《个人信息保护法》《电信法》《汽车数据安全管理若干规定(试行》等。呼应融合。《数据安全法》《个人信息保护法》中均提及软法“标准”的制定,表明了标准的重要性,要在标准中实现分级化、精确化。

综上,中国应在技术治理与法律治理关系理论与实践的不断探索中,积极发挥强大的集中整合能力,抓住智能技术发展机遇,扮演好技术治理与法律治理关系领域义不容辞的“专家”角色。在智能技术时代为中国特色社会主义法治理论体系输入更加丰满的中国表达,为世界各国的技术治理与法律治理关系模型提供中国智慧和中国方案。