一种多视角SAR图像目标识别方法*

2022-01-04杨小英陈海媚廖志平

陈 婕,潘 洁,杨小英,陈海媚,廖志平

(桂林信息科技学院 机电工程系,广西 桂林 541004)

0 引 言

合成孔径雷达(Synthetic Aperture Radar,SAR)可获取高分辨率图像,用于地表观测、地质勘测、情报解译等应用[1-2]。传统的SAR目标识别主要针对单一视角的图像,通过特征提取和分类器的结合进行分类确认。文献[3-5]分别采用主成分分析(Principal Component Analysis,PCA)、单演信号以及属性散射中心作为基础特征设计目标识别方法,文献[6-7]则是基于深度学习模型即卷积神经网络(Convolutional Neural Network,CNN)进行SAR目标识别。

与单视角方法相比,多视角SAR目标识别方法基于同一目标的不同视角图像,通过它们之间的互补提高识别性能。从现有文献来看,多视角方法主要采用两种思路。一种是“独立分类+决策融合”。这类方法将每个视角视为独立的信息源,按照单视角决策的过程获得分类结果,然后采用决策融合综合不同视角的结果获得最终的决策[8-9]。例如,文献[8]采用支持向量机(Support Vector Machine,SVM)分别对不同视角SAR图像进行分类,然后根据投票机制获得融合决策结果。文献[9]同样采用SVM作为基础分类器,但对不同视角的决策结果进行了可靠性筛选,只有通过筛选的视角进入后续的贝叶斯融合决策。另一种是“联合表征+分类”。得益于多任务学习算法的提出,可在统一表征框架下对不同视角的SAR图像进行分析,然后进行决策[10-13]。文献[10]首次将联合稀疏表示模型引入SAR图像多视角分类并验证其有效性。文献[11]在此基础上增加了视角筛选,认为只有鉴别力强的视角才能参加联合表征。文献[12]将多视角与多特征联合运用,对不同视角提取不同的特征并通过联合稀疏表示进行分类。文献[13]对多视角SAR图像进行聚类分析,分别在各个视角子集中进行联合稀疏表示,最后对不同视角集的决策结果进行线性加权融合。

本文根据现有多视角SAR图像目标识别方法进行优化设计,主要在文献[13]方法的基础上引入多重集典型相关(Multiset Canonical Correlations Analysis,MCCA)[14-15]特征融合算法。本文在继承多视角聚类算法的基础上,相比文献[13]对后续的处理过程进行了优化处理,可有效提高多视角SAR图像的利用率。特别地,对于只包含一幅SAR图像的视角集,则直接采用其特征矢量,无需进行MCCA操作。在MSTAR数据集上开展的实验结果表明,本文方法具有更好的识别性能。

1 基于相关准则的多视角聚类

对于同一目标的多视角SAR图像,由于获得的随机性,其中部分相近视角的相关性更强,而相差较大的视角则相关性较弱。为此,对多视角的相关性进行分析十分必要。本文以传统的图像相关性为多视角聚类的准则,定义如下:

(1)

式中:I1和I2分别代表两幅不同图像,m1和m2为它们的灰度均值;Δk和Δl指横纵坐标的偏置,实现滑动匹配的过程。

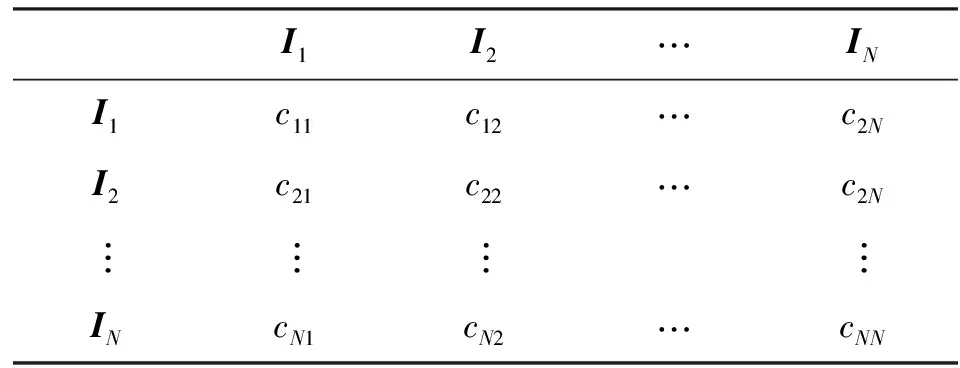

以式(1)的相关性准则为依据,对多视角SAR图像V={I1,I2,…,IN}进行聚类。首先,分别计算不同视角两两之间的相关性,记录如表1所示。后续算法描述如下:

表1 不同视角的相关矩阵

Step1 设置相关性门限Tc,初始化t=1。

Step2 设置I1为初始聚类中心,记St={1},执行以下循环判断:

forj={1,2,…,N}

ifc1St≥Tc

St=St∪j

end

end

Step3 得到一组视角集St。

Step4 更新V=VSt,t=t+1;重复Step 1~3,直到所有视角均获得聚类。

上述步骤中,“”表示余集操作,c1St≥Tc指的是I1与St中每个视角的相关系数均高于门限Tc。门限值的选取一般可采用经验分析加部分测试。在归一化相似度的条件下,门限取值一般趋于区间的中间值,保证聚类相关性和视角独立性的平衡。同时,结合部分合作训练和测试集进行测试,观察不同门限条件下的识别精度,可获取较为理想的相似度门限。经过上述聚类算法,原始的N个视角被重新划分为若干个子集。对于包含多幅SAR图像的子集,其中各个视角具有较高的内在相关性。

2 基于MCCA的多视角融合及联合表征

2.1 基于MCCA的多视角特征融合

MCCA[14-15]是典型相关分析(Canonical Correlation Analysis,CCA)的扩展,具备对多个随机变量的处理能力,主要用于分析它们之间的内在相关性[15-16]。对于n个经过中心化后的随机变量X1,X2,…,Xn,维数分别为pi(i=1,2,…,n)。设定p1最小,MCCA定义如式(2)所示的准则函数:

(2)

(3)

通过Lagrange乘子法进行求解,构造如下:

(4)

获得上式的求解结果,获得变换矩阵A=[α1,α2,…,αn]T,其中:

(5)

式中获得的是不同Xi最佳的投影方向,采用线性叠加的形式即可对它们进行融合处理,如下式所示:

(6)

本文采用MCCA对不同视角子集进行处理。对于同一视角子集中的若干SAR图像特征矢量,按照MCCA的过程进行融合,获得单一的特征矢量。融合后的结果在保持不同视角独立鉴别力的基础上,保留了它们之间的内在关联特性,因此具有更强的鉴别力。

2.2 联合稀疏表示

联合稀疏表示是一种多任务学习算法,主要针对多个具有关联性的稀疏表示问题[10-13]。对于多个视角子集融合得到的特征矢量,本文采用联合稀疏表示进行表征和分类。记所有SAR图像经过聚类获得M个视角子集,经过融合后对应的特征矢量分别为y=[y(1),y(2),…,y(M)],它们独立的稀疏表示问题如下:

y(k)=D(k)α(k)+ε(k),k=1,2,…,M。

(7)

式中:D(k)、α(k)、ε(k)分别对应第k个融合特征的字典、稀疏系数矢量以及表征误差。

对M个视角子集的稀疏表示问题进行共同考察,获得联合表征模型如下:

(8)

式中:β=[α(1),α(2),…,α(M)]为所有稀疏系数矢量的矩阵表达式。

式(8)所示的联合表征模型仅仅在形式上进行了统一,并没有利用不同视角子集之间的关联性。具有关联性约束的联合稀疏表示模型通过对稀疏矩阵β进行适当约束,提高整体求解精度,表达如下:

(9)

式中:‖·‖2,1为1/2范数。根据式(9)获得的稀疏系数矩阵,可分别计算不同类别的重构误差,进而生成目标所属类别的决策结果。

(10)

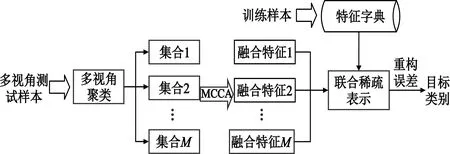

本文方法的实施流程如图1所示,主要过程分为多视角的聚类、视角子集的特征融合以及多视角子集特征的联合表征。具体过程中,对于每一个视角的SAR图像均采用主成分分析作为基本特征提取及降维手段,后续的特征融合及联合表征均在此特征基础上进行。

图1 方法实施流程图

3 实验与分析

3.1 MSTAR数据集

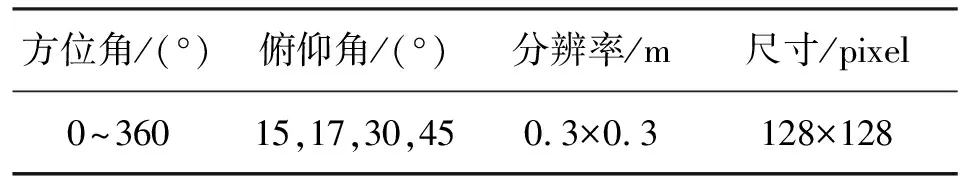

采用MSTAR数据集开展实验,对方法的性能进行测试分析。该数据集包含图2所示的10类目标,它们对应SAR图像相关信息如表2所列。表3设置了本文实验中使用的训练和测试集,包含了10类目标的类别、型号、样本数、俯仰角等。

表2 MSTAR数据集相关信息

表3 10类目标识别的训练和测试集

图2 MSTAR数据集目标光学图像

实验中,重点将所提方法与来自文献[8,11-13]的多视角SAR目标识别方法进行对比分析,分别记为“对比方法1”“对比方法2”“对比方法3”“对比方法4”。其中,对比方法1属于“独立分类+决策融合”类别,后三种对比方法都属于“联合表征+分类”类别。各类方法均在相同硬件平台上运行,主频3.4 GHz,8 GB RAM英特尔i7处理器。采用识别率作为方法性能的评价准则,定义为正确识别样本数占全部测试样本的比例。

3.2 实验场景与结果分析

3.2.1 标准操作条件

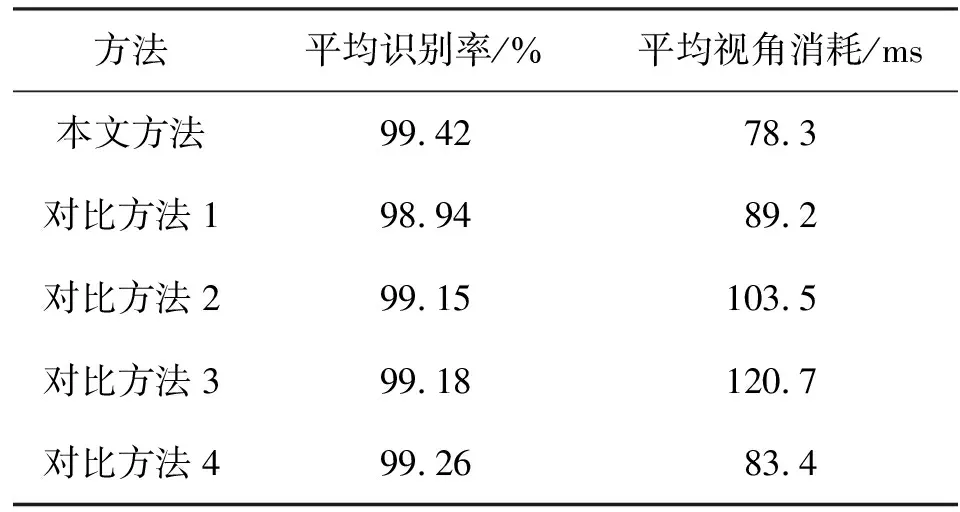

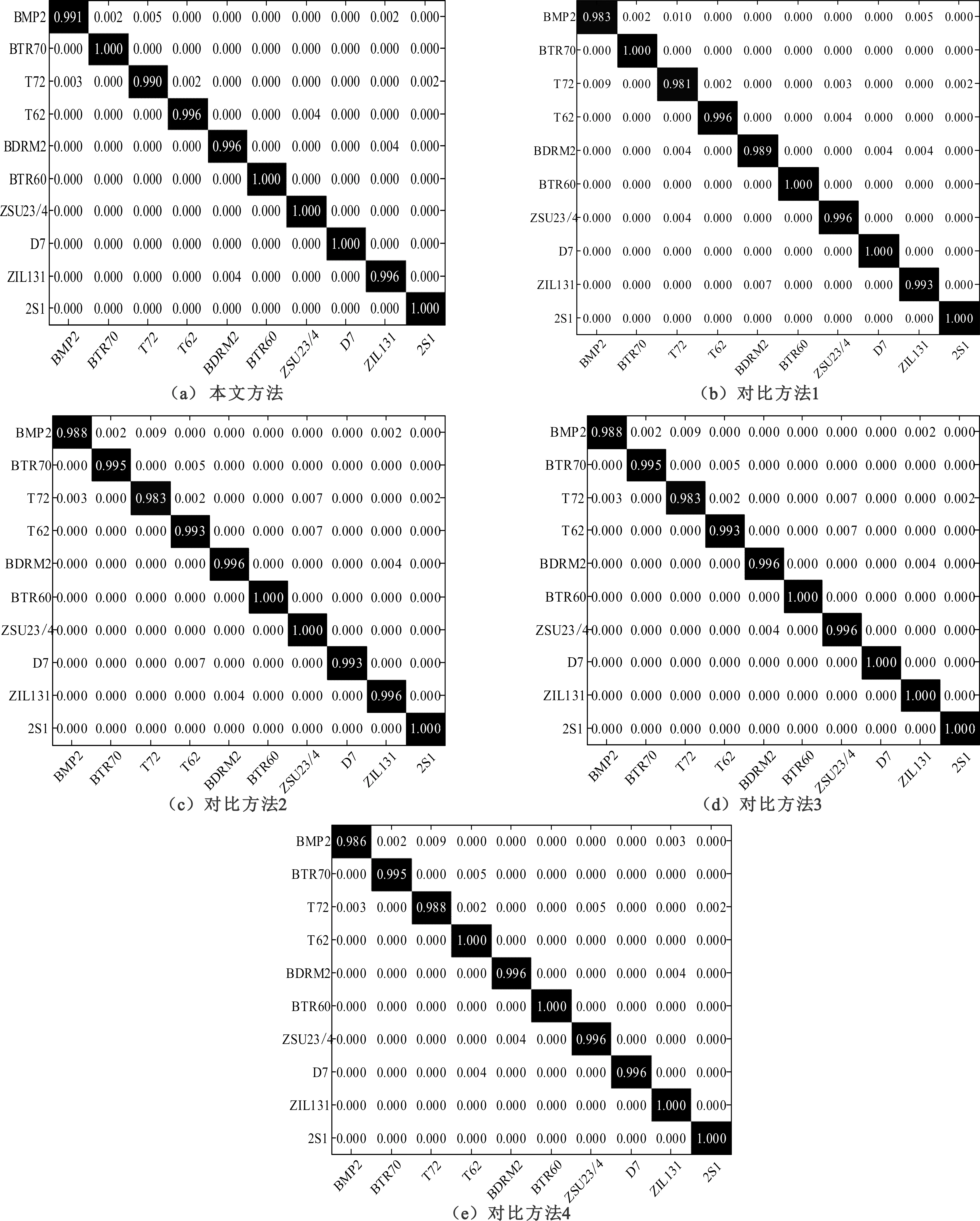

按照表3的设置,采用MSTAR数据集中的原始样本进行识别实验。此时,可认为实验场景为标准操作条件,即测试样本与训练样本整体相似度较高。当前实验设置当设置视角数目为5,相关门限为0.4。图3显示了本文方法和四类对比方法的识别结果,各个混淆矩阵中对角线元素即为对应目标的正确识别率。从表3可见,BMP2和T72的测试子型号多于训练子型号,这导致它们的识别率在10类目标中相对较低。综合10类目标识别结果,表4对比了不同方法在当前场景下的平均识别率和识别单个测试样本的平均时间消耗。在识别精度方面,本文方法在当前条件下的性能更优,体现了其有效性。相对采用“独立分类+决策融合”的对比方法1,后三类基于“联合表征+分类”的多视角方法的整体识别率更高,体现了不同视角之间内在相关性的作用。与对比方法3相比,本文通过引入基于MCCA的多视角融合提高了平均识别精度,说明了所提策略的有效性。可见,所提方法在标准操作条件的场景下具有更强有效性。在识别效率方面,本文方法同样具有优势。与对比方法4相比,本文方法的效率进一步提高,主要是对比方法4需要在各个视角集中进行联合稀疏表示,导致整体运算量增加。本文对于各个视角集采用MCCA进行高效融合,最终只需要进行一次联合稀疏表示,因此效率上更具优势。

表4 标准操作条件下的平均识别率

图3 标准操作条件下各类方法的混淆矩阵

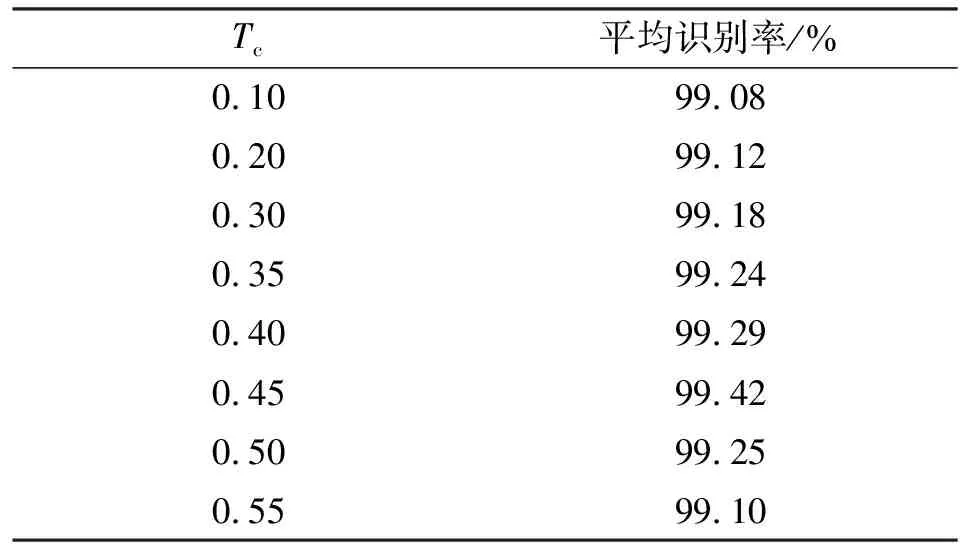

根据视角聚类算法,门限Tc对最终的聚类结果有着重要影响。因此,选取合适的聚类门限十分重要。表5给出了不同门限条件下所提方法的平均识别率,其在Tc=0.45时效果最佳。门限过小时,对于不同视角之间的相关性约束过弱,即导致存在较大差异的视角聚入一类;反之,当门限过大时,则对不同视角之间的相关性约束过强,则单个视角都倾向于自称一类,失去了聚类分析的价值。根据这一结果,本文在后续实验确定聚类相关门限为Tc=0.45。

表5 不同聚类相关门限条件下的平均识别率

3.2.2 噪声干扰

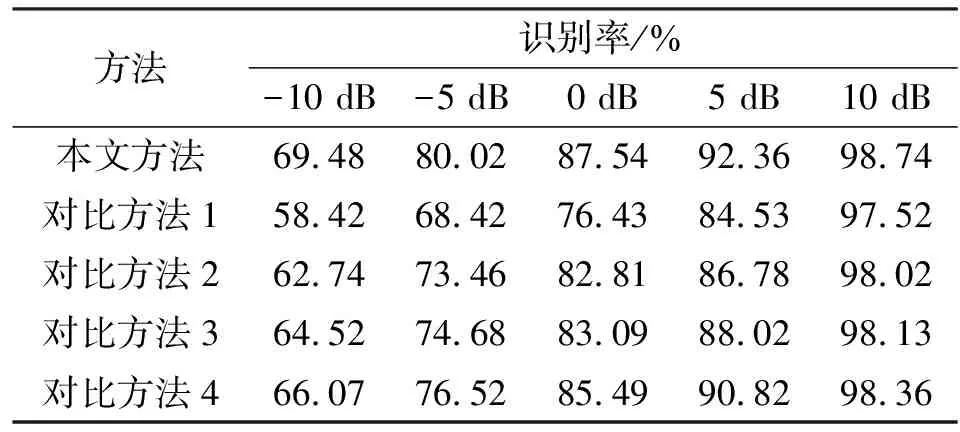

无论是光学图像还是雷达图像,其在获取过程中不可避免地受到噪声污染。在实际应用的识别系统中,训练样本往往经过精心挑选和预处理,具有较高的图像质量和信噪比(Signal-to-Noise Ratio,SNR)。然而,测试样本则来自相对随机的获取条件,存在图像质量差、信噪比低的情形。为此,识别算法的噪声稳健性十分重要。本实验在表3训练和测试集的基础上,对10类目标的测试样本进行噪声添加,获得多个不同信噪比的测试集[5],然后分别对各类方法进行测试。表6统计了当前实验场景下的识别率结果。与标准操作条件下的结果相比,噪声干扰下各类方法的性能都出现了下降。观察每个信噪比下的结果,可见在每个噪声水平下本文方法均可以取得最高的平均识别率,体现了其噪声稳健性。

表6 噪声干扰的识别率统计结果

根据文献[10-13],稀疏表示对于噪声干扰具有一定的稳健性,这也反映在表6中后三类对比方法的性能优于基于SVM的对比方法1。本文方法在使用联合稀疏表示模型的基础上,对各个视角集采用MCCA进行了融合处理。根据MCCA的基本原理,其主要是分析和利用不同输入之间的相关性,对于噪声和其他干扰因素,则可以在融合过程中进行有效剔除。因此,本文方法在特征和分类器两个步骤均考虑了噪声可能的影响,因此最终对于噪声干扰的稳健性更强。

4.2.3 目标遮挡

与噪声干扰的情形类似,实际获取的待识别样本也可能存在目标部分遮挡的情形。此时,只有部分目标特性能够体现在测试样本中并用于分类决策。按照文献[5]描述的算法,在表3测试集的基础上,采用目标区域部分遮挡的方式获得不同遮挡比例下的测试集,进而测试各类方法的性能。图4显示了各方法的识别率曲线,直观可见本文方法在此实验场景下的稳健性更强。与噪声干扰的情形类似,基于联合稀疏表示的方法相比采用SVM的对比方法1整体稳健性更强。本文方法在采用MCCA进行多视角融合时,同样只会保留不同遮挡图像之间的相关部分,而对由于遮挡噪声的样本差异进行剔除。因此,在后续的决策阶段,基于MCCA融合后的特征对于目标遮挡具有更好的适应性。

图4 目标遮挡的识别率统计结果

4 结束语

本文提出了一种多视角SAR目标识别方法。该方法首先基于相关性准则对多视角进行聚类,然后通过MCCA分别对各个视角子集进行融合处理。最终,基于联合稀疏表示对多特征进行表征和聚类,获得目标类别。通过多视角聚类、融合以及联合表征实现对多视角SAR图像独立鉴别力和内在相关性的运用,提高了最终决策的可靠性。目前,该方法在多视角聚类的门限自适应确定方面主要是依靠经验和部分测试结果,还存在一定的不足,后续要重点进行改进。未来,将针对实测多视角SAR图像数据开展应用研究,为智能识别决策提供支撑。