不同情感状态下的普通话言语清晰度分析

2012-06-06陈彧

陈 彧

(1.河南师范大学 文学院,河南新乡453007;2.维多利亚大学 语言学系,加拿大 维多利亚 V8T IR6)

一、引言

在语言生活中,人的言语总是伴随着特定情感的,而特定情感也总是投射到具体言语活动中。日常生活经验告诉人们,人在生气的时候语速较快、声音含混;在悲伤的时候则语速缓慢、声音清晰。显然,当人处于喜悦、悲伤、愤怒等不同情感状态下时,其言语的清晰程度是不同的。这种直观的言语清晰程度,在一定程度上是可以通过言语清晰度(或译言语可懂度)的测量来量化的。在通过对汉语情感语音数据库中不同情感状态下普通话语音言语清晰度相关声学参数进行测量的基础上,观察言语清晰度与不同情感状态的相互关系。其意义在于,除了在国内外率先从言语清晰度的角度考察情感语音问题、检验和发展元音清晰度的声学空间特征参数理论外,还能够有助于进一步弄清情感语音的声学特性,为言语工程提供更多的有效合成参数,从而有助于改进语音合成效果,提高合成语音识别率。

(一)言语清晰度与元音声学空间特征参数

言语清晰度是语言学、言语工程、心理学、耳鼻喉科临床医学等众多学科的重要研究内容。在言语工程领域,言语清晰度常被用作设计和评价言语通讯系统的评测工具。心理学家利用言语清晰度研究儿童语言发展、言语与肢体语言的相互关系等问题。临床医学关注发音和听力器官缺陷、语音纠正、听力丧失等。

在语言研究领域,学者很早就开始关注言语清晰度的问题。一些研究关注语言学信息在清晰度感知中的作用。Black指出,即使在理想化的发音和感知条件下,由于受到发音人个体因素的影响,不同说话人所发语音在感知上也存在言语清晰度差异[1]。Mullennix等的研究表明,对于相同的文本,言语清晰度的感知结果随着发音人个体变异的增多而下降[2];Nygaard发现,对于发音人语音的熟悉程度越高,听音人越倾向于在感知实验中给予更高的清晰度得分[3]。另一些研究着眼于发音人受特定交际需要而系统化转换言语模式对其言语清晰度造成的影响。Picheny等发现,对于同一名发音人用“清晰的”言语和“交际的”言语两种模式说话时,前者能获得更高的言语清晰度得分,并被认为言语语速更慢、存在更少的音系删节现象[4-5]。Bond&Moore分析了言语清晰度得分不同的三名发音人言语材料的声学参数,发现得分较高的发音人所发语音与前述“清晰的言语模式”存在较多的共同点[6],该结果证明Picheny等所提二元言语模式对于分析多名发音人的言语清晰度问题同样适用。还有一些研究关注与言语清晰度相关的声学参数的提取和应用。例如,Bradlow等通过分析印第安纳多语者语句数据库(Indiana Multi—Talker Sentence Database),致力于寻找与言语清晰度密切相关的精细的、反映即时发音情况的元音声学空间特征参数(Vowel space characteristics)[7]。数年后,Pierrehumbert等运用这些参数分析了不同性取向美语母语者的言语清晰度,确证了性取向与元音发音的相互关系[8]。

目前,国内有关言语清晰度的研究多集中在言语工程和临床医学领域,从语言学界、心理学等其他学科关注言语清晰度的研究报告还暂未看到。

(二)情感语音

对于情感语音的研究可以帮助人类认识其在信息表达和信息提取的运作机制,进而合成更为自然流畅的人工语音并应用于实践,因此是语言学、心理学、言语工程等学科的重要课题。特别是在言语工程领域,声音中的情感信息逐渐成为语音工程的研究热点。近二十年来,随着相关领域的长足进步,言语工程对于参数化合成语音的自然度提出了更高的要求。在实现人工语音的较好的可懂度的基础上,人们还要求人工语音能够以一种合乎人类情感特征的方式被表达出来。目前,以各主要语言包括普通话[9-13]的情感语音为对象的研究不胜枚举。概括来说,大部分研究均采用建立情感语音库、提取语音参数并予以分析、进行参数化合成和语音识别的步骤进行,总体上合成效果和研究方法还有待提高。

然而,有关情感语音的研究在国内外语言学界却一直未能得到足够的重视。在汉语语言学界,赵元任较早地提出了中性语调与表情语调的概念,并指出情感表达的语音手段包括音质、音强、音高和语速[14]。此后,徐世荣、沈炯、吴宗济的相关研究对于普通话情感语音亦有所涉及[15]。近年来,李爱军等也对诸如友好语音等与情感语音密切相关的表现力语音进行了试验性的探讨分析[16-17]。目前,汉语语言学界目前尚无其他有关普通话或方言的情感语音研究见诸报端。

二、方法和过程

从汉语情感语音库中选取四名发音人(男女各2人)在中性、惊奇、喜悦、悲伤、愤怒五种情感状态下的语音样品,实施听感实验并进行言语清晰度计算;接下来,对所选语音样品进行声学数据提取;进而,运用Bradlow等的方法进行元音声学空间特征参数计算;最后,结合感知实验和声学实验结果进行分析、探讨。

(一)汉语情感语音库

本文所用的语音样品源于清华大学开发的汉语情感语音数据库。该语音库依据PAD情感模型[18],从P愉悦度(Pleasure—Displeasure)、A激活度(Arousal—Nonarousal)和D优势度(Dominance—Submissiveness)三个维度区分了11种情感状态;对于每一种情感状态,各设计10段录音文本,每段录音文本大致包括100左右的音节;数据库共有发音人20人,其中男女各10名,录音时年龄在18至25岁之间;录音过程同时进行了相关生理数据的提取,最后共得到包括7维声学参数和9维生理参数共16维参数[19]。

(二)言语清晰度感知实验

笔者首先运用拉丁方(Latin square)对各发音人的语音样品进行伪随机编排处理,再采用交叉法对听音人进行分组,以保证每组听音人对两个发音人的语音样品进行评判。听音人共计6组,每组10人(5男5女),年龄18~22周岁,由天津市两所高校的非语言学专业的学生组成,日常以普通话为交际语言,并报告无听力障碍及相关疾病史。

实验在语音实验室进行。语音样品由控制台统一播放,在每段录音开始之前会插入提示音;在该段录音播放之后、下个提示音之前,会有3秒时间以供听音人做出判断。评判由听音人在纸质评判量表上完成。评判表由50道题目组成,评判标准从完全听不清楚至清晰共分五档,其结果转为百分制显示(见表1)。

(三)元音声学空间特征参数及其提取和计算

Bradlow等在考察言语清晰度与元音声学空间特征参数的相互关系时,共提取了美语顶点元音/a、i、o/360个样品的前两个共振峰数值,进行了从赫兹值(Hz)到镁值(Mel)的换算并进行了八维参数的计算。其结果表明,元音空间面积(Vowel space,单位为mels2),元音空间离差(Vowel space dispersion,单位为mels),/i/的第一第二共振峰差值(F2-F1/i/,单位为mels)与言语清晰度结果呈正相关关系;范畴聚类(Category clustering,单位为mels),/a/的第一第二共振峰差值(F2-F1/a/,单位为mels)与言语清晰度结果呈负相关关系;其余参数与言语清晰度的统计关系不明显。

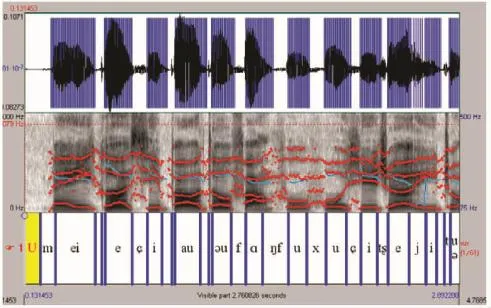

在本文中,笔者在Praat5.1.26环境下编写脚本,对汉语情感语音库中四名发音人的语音样品进行了切分、标注。图1示例了一个经过自动切分和手工标注的情感语音片段。

图1 情感语音切分标注示意

然后,找出各发音人在各情感状态下所发语音中前五个包含以顶点元音/a、i、u/单独做韵母的句子①Bradlow等所选取的顶点元音为/a、i、o/,本文所选取的顶点元音为/a、i、u/,这是由美语和汉语普通话的差异造成的。Bradlow指出,美语中的/u/由于存在过多变体,故不宜作为顶点元音进行元音声学空间特征参数的提取,因而以/o/代之。相反,汉语中的/u/则是稳定的顶点元音,用来进行声学空间特征参数的计算是没有问题的。因为包含/a、i、u/单独做韵母例字的句子较多,且各元音符合要求的句子数量不均;所以我们统一为各元音选取符合要求的前五个句子,使得各元音的样品数目相等,便于下一步的分析探讨。如果同一个句子中包含两个及以上以/a、i、u/单独做韵母的音节,则只取其中最先出现的那个音节的韵母进行考察。。现将中性情感状态下包含/a、i、u/单独做韵母的前五个句子示例如下。

/a/

我不由得说,啊……

该语料库面向语音合成的理论研究、技术开发和系统评测。

赫鲁晓夫在苏共二十大揭露斯大林的暴行时……

数字荧光管、发光二极管,数字显示器等……

下午记得把昨天的会议记录拿过来……

/i/

这是因为二进制数的基数为二……

它只有零和一两个数字……

每一个细胞都仿佛呼吸着一种叫做中性的情绪……

语音合成多采用基于语料库的拼接合成……

台下有人递条子上去……

/u/

在数字系统中常常采用二进制数……

这是因为二进制数的基数为二……

它只有零和一两个数字……

便于电路实现……

二进制数也采用位置计数法……

接下来,对所选取句子当中的顶点元音进行相关数据的提取。每位发音人的样品数量为3×5×5个,四位发音人共计300个。对于每个样品,分别提取其前两个共振峰(即F1、F2)的平均值,并转为相应的Mel值。最后,进行元音声学空间特征参数的计算并进行相应分析。

三、结果分析

利用所得数据,笔者对上述五个参数进行了计算(见表1)。

表1 四名发音人言语清晰度得分和元音声学空间特征参数表

(一)元音空间面积和元音空间离差

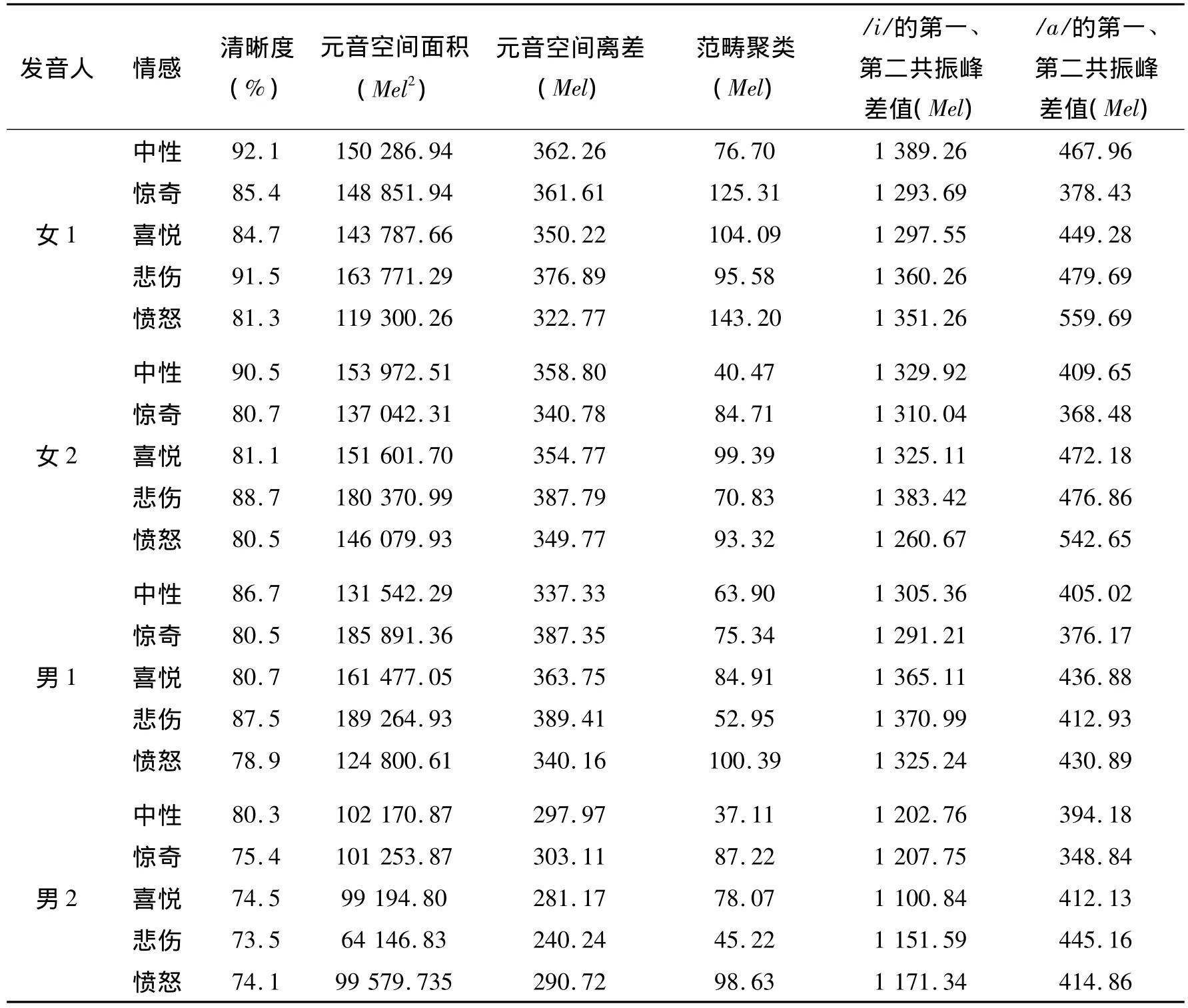

笔者先求取各发音人在不同情感状态下/i/、/a/、/u/五次发音F1、F2数据的平均值,再依据海伦定理计算出相应的元音空间面积(见表1),并绘制出声学元音图(如图2所示)。

观察该图可以看到,图2a所示女1在不同情感状态下的元音声学空间分布离散、各种情感状态下的元音声学空间面积相对较大;而图2d所示男2在不同情感状态下的元音声学空间分布集中、同时各种情感状态下的元音声学空间面积较小;图2b和图2c所示的男1和女1的情况则处于中间状态。这个情况说明,发音人女1在不同情感状态下所发语音的区分程度,在整体上好于男1和女2,而男1和女2又好于男2。

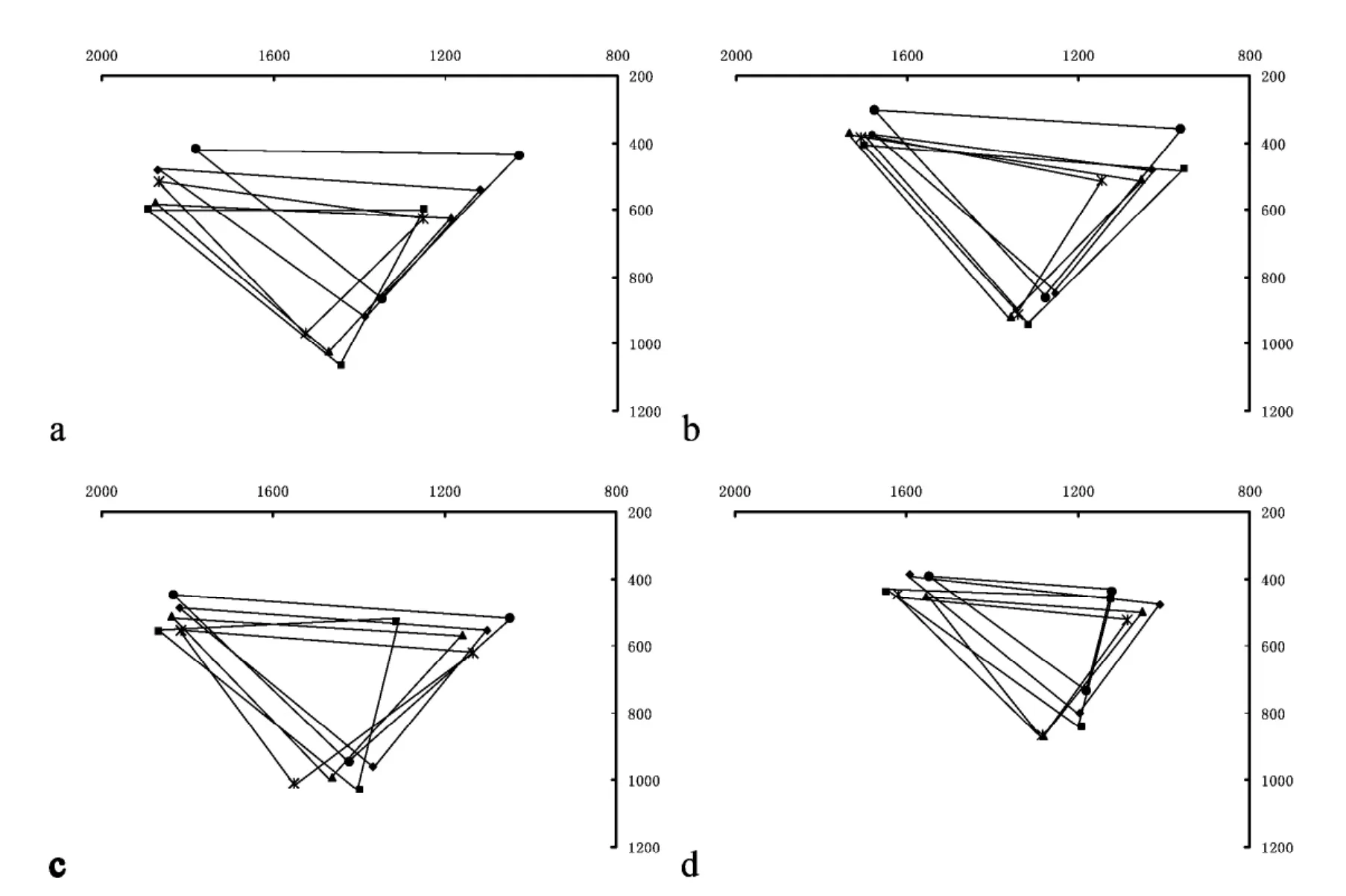

由于元音声学空间的计算基于顶点元音参数的平均值计算之上,不能反映发音人某次发音活动的实际情况。因此,要更好地观察某发音人不同情感状态下言语清晰度间的差异,还需计算相应的言语空间离差。图3反映了女1在惊奇、喜悦、悲伤、愤怒状态下的言语空间离差情况。

图2 四名发音人不同情感状态下的声学元音图

图3 发音人女1在不同情感状态下的言语空间离差图

图3显示,3c所反映的悲伤情感中,不同顶点元音的分布间距较大,而同一元音的各次发音之间则相对集中;同时,中点距历次发音中各顶点元音的距离较远且波动不大。因而,在此情况下的不同元音的区分度较好,清晰程度更高。与之形成鲜明对比的是反映愤怒情绪的3d,元音/a/、/u/存在相混的情况,中点距各采样点的距离亦波动甚剧,因此区分度不够好、元音的清晰度相对较低。

总体上对元音声学空间、言语空间离差和言语清晰度数据分别进行相关分析,结果分别为:元音声学空间与言语清晰度的皮尔逊相关系数为0.686**(p<0.001);言语空间离差与言语清晰度的皮尔逊相关系数为0.729**(p<0.001),二者皆与言语清晰度密切正相关,与Bradlow等所得结果一致。该结果说明,总体上元音声学空间和言语空间离差数据较大的情感状态,其言语清晰度往往好于相关数据较小的情感。描述统计的结果显示,五种情感的元音声学空间和言语空间离差数据均依次为悲伤>惊奇≈喜悦>中性>愤怒;而相应的言语清晰度排序为中性>悲伤>惊奇≈喜悦>愤怒。如果除去中性状态,两个序列的顺序是完全对应的。对于中性情感状态的问题,笔者将在下文中专门讨论。

具体到各发音人,其情况也基本符合上述规则。这里有两点需要单独说明的是:其一,发音人在惊奇和喜悦状态下的相关数据存在互有参差的情况,这可能和二者在PAD情感量表上较为接近有关。同时,两者在言语活动中的区别,可能更多的体现在语调而非音质上,因而在元音声学空间参数方面区分不够明显。其二,发音人男2的情况与总体趋势不相吻合,这可能与其自身的言语活动个性相关。由于其各种情感状态下的相关参数变化不大、区分不明显,可能造成其各种情感状态下的清晰度得分接近,言语清晰度总体水平偏下。

(二)范畴聚类和共振峰差值

范畴聚类的计算方式是,先求取某情感状态下各顶点内各次发音数据的空间离差,再对三顶点的空间离差的进行求平均值计算。Bradlow等人的研究表明,这个参数可以显示元音发音时的内部变异,其值越大,元音变异越大,发音越不稳定,言语清晰度越低;反之,则言语清晰度越高。

在考察各发音人自身的情况时发现,虽然各发音人间的数据相差较大,但在各发音人内部,悲伤和中性情感状态下的范畴聚类都小于惊奇和喜悦,而愤怒情感下的范畴聚类则是最大的。在对情感状态和范畴聚类进行描述统计时发现,范畴聚类的排序为中性<悲伤<惊奇≈喜悦<愤怒,但相关分析的结果却显示言语清晰度和范畴聚类不存在明显的相关关系。

再来看元音/i/、/a/的共振峰差值的情况。依据Bradlow等人的研究结论,/i/的F2-F1越大,/a/的F2-F1越小,则言语清晰度越高。而本文所作的相关分析显示,/i/的共振峰差值与言语清晰度存在密切的正相关关系(相关系数为0.782**,p<0.001),而/a/的共振峰差值与言语清晰度不存在相关关系。

笔者认为,造成/a/的共振峰差值分布杂乱,进而使其与言语清晰度不能形成相关关系的可能原因有两个:第一,正常情况下/a/的F1、F2就因为距离较近,容易彼此产生干扰,会对其共振峰数值的测定产生不利影响[20]。在附带各种情感的情况下,/a/的音质更易受到不同情感状态的影响而产生剧变如擦音化等,造成Praat软件判断函数周期波检测的困难,从而使得共振峰数据测量困难、数据失真。第二,Monsen&Engebretson的研究表明,无论采用谱图观测法还是线性预测法,基频的抬高会造成共振峰数据测量的失真,特别是当基频高于350Hz以后,该现象将更为显著[21]。在本研究中,受到惊奇、喜悦、愤怒等情感的影响,基频存在被大幅抬高的可能,从而造成共振峰数据测量的困难。虽然/i/、/a/都会受到基频的影响,但后果显然不同。假设在测量/a/、/i/的F1时,均因基频的干扰而出现了150Hz的测量误差。对于两个共振峰间距较小的/a/而言,150Hz的测量误差就可能造成共振峰差值计算结果的较大偏误;而同等情况下,/i/的F1、F2间距较大,因此150Hz的测量误差造成的偏误影响要比/a/小得多。当然,上述观点只是笔者对于这个现象的一种推测,要想搞清这个问题,仍需进一步研究、验证。

四、结语

通过对不同发音人不同情感状态下言语清晰度及其元音声学空间进行观察,确实可以看到情感状态确实会对言语清晰度产生相应的影响。在所考察的五种情感中,其言语清晰度确实存在一定规律,激活程度较低的情感状态下的语音,其言语清晰度往往高于激活程度较高的情感状态下的语音。总体而言,本文所考察的五种情感言语清晰度的次序是:中性>悲伤>惊奇≈喜悦>愤怒。

与言语清晰度相对应的是,情感状态确实对元音声学空间参数产生了影响。本文的研究结果表明,激活程度较低的情感如悲伤,往往整体上声学空间面积较大、不同元音分布较为离散,而在各元音内部,则分布较为集中,离散程度低;反之,激活度较高的元音如愤怒,则整体上空间较小而各元音内部离散程度较高。因此,本文的结果也基本上证实了Bradlow等人的看法,并进一步证明了该理论运用于情感语音研究的可能。当然,本文的一些结论与Bradlow等人的结果相左。例如,在范畴聚类和/a/的共振峰差值上,并未发现它们与言语清晰度的负相关关系。这可能是由于情感语音的复杂性或不可控的测量误差造成的,因此现在对这些现象下结论还为之过早。

在结束本文之前,仍需对中性语音现象做一些说明。作为情感语音研究的参照系,中性语音实际上是一种人造情感语音。因此,在对中性语音的实现上,发音人的把握也可以是有所不同的。既可以像本文中两名女发音人那样,发得字正腔圆,由此产生较大的元音声学空间和元音空间离差;又可以像两名男发音人那样,发音器官常常处于自然状态,共鸣腔变化幅度较小,由此元音声学空间和元音空间离差很小。当然,不管采用何种方法,中性语音在产生时都因发音不受情感的影响而不产生各种复杂的音质改变,从而元音内部的变异较小,因此范畴聚类在各种情感语音中最小。也正是由于中性语音不产生各种复杂的变化,在清晰度感知中也往往能够获得较高评分。因此,言语清晰度的声学空间参数分析在用来分析中性语音时,可能会出现一定困难。

[1]BLACK J W.Multiple-choice Intelligibility Tests[J].J.Speech and Hearing Disorders,1957(22):213 -235.

[2]MULLENNIX J W,PISONI D B,MARTIN C S.Some Effects of Talker Variability on Spoken Word Recognition[J].J.Acoust.Soc.Am.,1989(85):365-378.

[3]NYGAARD L C,SOMMERS M S,PISONI D B.Effects of Stimulus Variability on Perception and Representation of Spoken Words in Memory[J].Perception and Psychophysics,1995(57):989 -1001.

[4]PICHENY M A,DURLACH N I,BRAIDA L D.Speaking Clearly for the Hard of Hearing I:Intelligibility Differences Between Clear and Conversational speech[J].J.Speech and Hearing Research,1985(28):96 -103.

[5]PICHENY M A,DURLACH N I,BRAIDA L D.Speaking Clearly for the Hard of HearingⅢ:An attempt to Determine the Contribution of Speaking Rate to Difference in Intelligibility Between Clear and Conversational Speech[J].J.Speech and Hearing Research,1989(32):600-603.

[6]BOND Z S,MOORE T J.A Note on the Acoustic-phonetic Characteristics of Inadvertently Clear Speech[J].Speech Communication,1994,14(4):325-327.

[7]BRADLOW A R,TORRETTA G M,PISONI D B.Intelligibility of Normal Speech I:Global and Fine-grained Acoustic-phonetic Talker Characteristics[J].Speech Communication,1996,20(3-4):255-272.

[8]PIERREHUMBERT J B,BENT T,MUNSON B,et al.The Influence of Sexual Orientation on Vowel Production(L)[J].J.Acoust.Soc.Am.,2004,116(4):1905-1908.

[9]赵力,邹采荣,吴镇扬.语音识别中基于MCE准则的CHMM学习方法[J].东南大学学报:自然科学版,2000(3):21-25.

[10]赵力,邹采荣,吴镇扬.基于3维空间Viterbi算法的汉语连续语音识别方法[J].电子学报,2000(7):67-69.

[11]蒋丹宁,蔡莲红.汉语疑问语气的声学特征研究[C]∥第六届全国现代语音学术会议论文集,2003:186-191.

[12]蒋丹宁,蔡莲红.基于语音声学特征的情感信息识别[J].清华大学学报:自然科学版,2006,46(1):86-89.

[13]金学成.基于语音信号的情感识别研究[D].合肥:中国科学技术大学,2007.

[14]赵元任.汉语的字调跟语调[M]∥吴宗济,赵那新.赵元任语言学论文集.北京:商务印书馆,2002:734-749.

[15]李爱军.友好语音的声学分析[J].中国语文,2005(5):418-431.

[16]LI A,WANG H.Friendly Speech Analysis and Perception in Standard Chinese[M].ICSLP2004,JEJU,Korea,2004:49-52.

[17]CHEN F,LI A,WANG H,et al.Acoustic Analysis of Friendly Speech[M].ICASSP2004-5,Montreal,Canada,2004:53-56.

[18]MEHRABIAN A.Framework for a Comprehensive Description and Measurement of Emotional States[J].Genetic,Social,General,and General Psychology Monographs,1995(121):339 -361.

[19]CUI D,CAI L.Acoustic and Physiological Feature Analysis of Affective Speech[M].ICIC 2006,Kunming,China,2006:912-917,

[20]林焘,王理嘉.语音学教程[M].北京:北京大学出版社,1992:54.

[21]MONSEN R B,ENGEBRETSON A M.The Accuracy of Formant Frequency Measurements:A Comparison of Spectrographic Analysis and Linear Prediction[J].J.Speech Hears,1983(26),89 -97.