基于情绪识别技术的学科情感目标达成检测与教学改进

2023-06-21王凯余发碧李敏

王凯 余发碧 李敏

摘要:情绪情感能力是人生存与发展的关键,在课堂教学中开展情感教学既是培养学生情绪情感能力的重要途径,也是推动课程标准落地的应有之义。该研究基于情绪自动识别技术,结合教师观察,构建了帮助教师检验情感目标达成效果的模型,该模型对于教师而言简单易行,配合情绪自动识别技术可以提高教师教学反思的准确性和全面性,进而促进新课程标准的有效落实。

关键词:情绪识别;情感目标;检测模型

中图分类号:G434 文献标识码:A

本文系全国教育科学“十三五”规划2019年度教育部重点课题“基于情绪识别技术的学科情感目标检测与教学设计改进研究”(课题编号:DHA190365)研究成果。

伴随着人工智能技术的不断发展,许多基础性工作正逐渐被机器所取代,特别是ChatGPT的出现,人工智能从决策式变为生成式,一些含有一定技术含量的工作也可能被机器轻松完成,但人工智能的核心还是基于数据的理性逻辑,无法从根源上实现与人类情绪情感的交互及共鸣,情感为人类天生所具有,可以预见,在未来情绪情感能力将是人与人工智能相比的最大优势,相应的,如何在教育教学中培养学生在未来有竞争力的情绪情感能力,成为教育改革无法忽视的现实课题。

一、问题的提出:教學中情感目标的虚化

学生的完整发展是教育一直追求的目标,从三维目标的提出,到学生发展核心素养的出台,再到学科核心素养的确立,情感目标都是其中的关键内容和重要维度。联合国教科文组织在《反思教育:向“全球共同利益”的理念转变》一书中指出:“在知识学习过程中掌握方法,获取知识,形成能力,培养情感态度价值观,这是一个整体”“如果教育的过程、内容、方法等不包含价值,教育本身就无教育价值”[1]。情感目标是课程的“意义”目标,它不是虚无或强加的,是教育教学中的过程性体验及有目的有计划地形成的学生情感状态。通过对学生在学习过程中的情绪情感状态的观察,教师也可以掌握学生的学习状态,进而有针对性地调整教学计划,促进有意义学习的发生。

然而长期以来课堂教学一直以认知发展作为内在结构,情感目标的教学设计与达成检测一直是一个灰色地带,带有很强的随意性,并逐渐虚化。2001年《基础教育课程改革纲要(试行)》明确提出了“情感态度价值观”作为新课程教学的“三维目标”之一,然而二十余年过去了,情感目标教学对于教师来说仍然是个难题。教师会在教案的目标部分列入情感目标,但往往只是单纯地列在上面,在实际教学实施中并未考虑如何实现该目标,也有的教师虽然主观上希望达成情感目标,但实际上并不清楚如何实现,教学设计上还是按照知识教学的思路进行。之所以存在“重认知,轻情感”的问题,一方面是因为考试作为指挥棒极少涉及到情感态度价值观的内容,另一方面则归咎于对情感目标教学的研究较少。

在新修订颁布的2022版义务教育课程标准中,“情感”不再单独作为一维目标,而是整体融入了核心素养,这就使得教师在实际教学中更容易忽视素养中的情感成分。总体来看,在实际教学过程中,教师在课堂教学中对情感目标的重视程度普遍不够,对情感目标的整体设计思路不清,情感目标的达成检测技术与策略不明,针对情感目标达成的反思与改进基本处于空白状态,这些现实问题亟需解决。

二、文献综述:情感内涵构成与识别技术

(一)情感的内涵

情感是人们日常生活中普遍使用的词语,使用中往往可以指代多种含义。我国传统文化中使用“情”一字往往包含感情、情谊、感受、想法、态度等多种含义,如“人之常情”中的情兼有情绪、情谊、想法,“一往情深”中的情包含情谊、感受。在英文中,Feeling和Affect均有情感的意思,科林斯英语字典定义情感(Feeling)“就是一种情绪(Emotion)”“你对某件事情的情感是你对它的想法和感受,或你对它的态度”[2],韦氏字典对情感(Affect)定义为“一组可观察到的体验到的情绪表现:通常伴随着情绪的面部表情、手势、姿势、声调等”[3]。美国心理学会(American Psychological Association,以下简称APA)将情感(Affect)定义为“感受或情绪的体验……通常用积极情感或消极情感来描述,情绪(Emotion)和心境(Mood)都被认为是一种情感状态”,APA对情感的另一词Feelings定义为“一种独立的可感知经验,是主观的、评价性的,并且独立于唤起它们的感觉、思想或图像”,情感区别于感觉、知觉的核心特征是其“评价性”,即情感都是基于主体对客观事物的主观评价而产生的[4]。

可见,“情感”和“情绪”联系密切,情感一词在使用中有时和情绪同义,同时情感也包含了除情绪外的想法、感受和态度。情感和情绪的这种难以准确区分的关系也体现在教育领域,如我国教育家朱小蔓在其著作《情感教育论纲(第3版)》中使用的“情感”一词,“它包含着情绪和情感的综合过程,既有情绪的含义,也有情感的含义”[5]。因此在实际教学中所指的情感,也包含情绪和情感的双重含义。

情感和情绪既有所区别又相互关联,情绪可以看作是情感的情境性、暂时性的表达[6],因此我们往往可以通过对个体当下情绪的观察以得知其对某事物的具体情感。基于此,本研究形成学科情感目标达成检测的研究思路:把学科情感目标拆解并在教学设计中预设相应的外显情绪,以改变传统的以认知主线为主的教学设计,把情感目标从暗线变为明线,再进行情感目标教学达成情况与预设目标的匹配度研究及归因分析,分析不一致或者未达成目标的原因。

(二)情感的维度和类别

从情感的表现而言,情感“是由独特的主观体验、外部表现和生理唤醒等三种成分组成”[7]。也可以从效价、动机强度、唤醒程度三个方面对情感进行分析,效价是指情感的积极性或消极性,如悲伤、愤怒为消极情感,高兴、满足为积极情感;动机强度是指情绪或情感激发行动的强烈程度;唤醒程度可以通过主观报告或者检测交感神经系统的激活程度而得知[8]。我国学者将课堂教学中情感性教学分为三种[9]:乐情,教学能促进学生对课程的喜欢;冶情,教学能使学生获得积极的情感体验;融情,教学能使学生与教师和周围同学情感融洽。并根据内化程度不同,在乐情、冶情、融情三个维度上均进行了四层次划分。

情绪可以分为基本情绪和复合情绪,“每一种基本情绪都具有独立的神经生理机制、内部体验和外部表现,并具有不同的适应功能”[10],复合情绪则是由不同的基本情绪组合形成。关于基本情绪的种类目前尚未达成共识,有心理学家和人类学家提出至少包含8種基本情绪,也有研究者提出只有4种基本情绪,目前接受度比较高的观点是包含6种或7种基本情绪:害怕、惊讶、厌恶、难过、愤怒、高兴、轻蔑(7种说)。在心理治疗中,情感又被分为五种:完全的情感、限制的情感、迟钝的情感、贫乏的情感、不稳定的情感[11];我国学者将人类具有的高级社会性情感分为道德感、理智感和美感[12]。

(三)情感的检测方法及应用

根据情感和情绪的三个构成成分,主观体验、外部表现、生理唤醒,情感的检测方式也可以分为三大类:主观报告法、外部观察法、穿戴设备监测法。

主观报告法是个体报告自己的情绪情感状态,通常通过访谈、问卷、量表、句子完成法等方式进行[13]。访谈既包括正式的访谈也包括非正式访谈,如教师在和学生的偶尔闲谈中了解学生的情绪情感就是一种非正式访谈;问卷法、量表法是研究者经常采用的测量方法,该方法操作简便,结果清晰,但容易受到个体自身期待或动机的影响,且通常是在事件发生一段时间后才让个体通过回忆的方式进行主观报告,其准确性、完整性会受到一定影响;句子完成法是通过让个体补充完整特定的句子,继而研究者通过对个体补写的句子进行分析解读而得出个体的情绪情感状态,该方法对研究者本人的专业性要求较高。

穿戴设备监测法主要通过佩戴相应的仪器设备以检测个体的脑电、皮肤电、心跳等信息,目前也有研究尝试采用无线信号识别生理唤醒情况,该技术通过无线信号在接触一个人身体后回弹,分析其呼吸和心跳信息,从而识别情绪[14],然而该技术受到双重技术的阻碍,一方面是无线信号对生理状态的反应准确性和完全性,另一方面是如何根据生理信号准确分析出个体的情绪情感状态。

外部观察法主要针对情绪情感所展现出的表情,含面部表情、姿态表情、语调表情,长期以来主要通过他人的观察来了解。近年来人工智能技术的发展也使得机器识别人类情绪情感成为可能,基于AI的情绪自动识别“是采用非接触式途径采集个体语言、面部变化和肢体动作等自然状态下的生态化情绪数据,利用机器学习或深度学习等算法建立情绪预测模型,从而实现自动化情绪识别”[15],现有技术已经可以实现对面部表情、语音表情、姿态表情的自动识别,情绪的自动识别技术已经广泛应用于刑侦、销售、管理等多个领域[16-18]。相比于姿态表情和语音表情,面部表情的自动识别应用最广,这是由于面部表情本身是表达情绪的最主要的通道,有研究发现,情绪表达=7%的言词+38%的语音表情+55%的面部表情[19],也有研究表明,面部表情相比于姿态表情更能准确反应个体的实际情绪[20]。

在教育领域中,面部表情识别最早应用在远程教育中,用以监测学习者情感变化,以调整教学方法,提高教学质量[21]。如有研究者将表情识别与视线跟踪相结合,构建了远程学习中的智能教学系统结构模型[22];另有研究者提出了一种学习困惑的自动识别方法,使教师对学习困惑进行有效检测并提供干预[23];也有研究者通过语音、表情和自我报告相结合的方式形成了学习者情绪可视化仪表盘[24]。但这些研究并没有关注课堂中的学科情感目标的达成。

三、工具研发:基于情绪识别技术的学科情感目标检测框架构建

(一)情感目标教学问题聚焦

本研究通过对北京市的不同区不同学科的教学设计进行调研分析发现,情感目标设计中存在如下问题:(1)教学设计中缺乏对情感目标的描述或者描述不具体:有的教师在教学设计中缺乏对情感类的目标描述,只关注认知类的目标;还有的教师在教学设计中虽然关注了情感教学目标,但是对情感目标的描述过于笼统,并不能完全精准地对应于“这节课本身”;(2)情感目标在教学设计中思路不清:绝大部分教师不了解学生情感形成机制,不了解情感目标达成所需要的主要条件,因此表现在教学设计上仅仅只是列为目标,但在落实思路上并不清晰,教学设计中对情感目标的主脉络是以认知为主线的,忽略情感线索;(3)情感目标达成的检测不足:教师在进行评价时只关注知识、技能的检测,通过学生达成的行为来描述和表达,但对于情感目标,由于存在认知偏差,对此达成检测严重不足,情感目标变为游离于评价之外的因素;(4)情感目标达成的改进策略缺失:由于对情感目标的不明就里,设计的无视和评价的游离,致使学生情感目标达成与否以及存在的问题无法得知,相应地,也就缺乏针对问题的改进策略。

(二)开发“四能四类三层”情感目标分析表

本研究采用质性研究方法,对2022年版义务教育各学科课标中的“课程目标”、2017年版2022年修订的普通高中各学科课标中的“学科核心素养与课程目标”部分关于情感目标的表述进行类属分析,得到新课标中关于情感目标的描述包含情感能力、情感类型两大类:

1.情感能力指学生在情感表达、情感体验与情绪情感调控上所具有的能力。具体包括:(1)情感体验,如“感受和体验文学作品的语言、形象和情感之美”;(2)情感表达,如“能运用祖国语言文字表达自己的审美体验,表达自己的情感、态度和观念”;(3)情感调控,如“学会调控自己的情绪,积极应对挫折和失败,保持良好的心态”。

在实际教学中,还涉及到对情感的认识和分析,如正确认识友情、分析主人公的情感状态变化,因此本研究认为教学目标中的情感能力包括情感认知、情感体验、情感表达、情感调节;

2.情感类型指学生所需分析、感受、体验和表达的具体情感。具体分为如下几类:(1)道德类,含爱党爱国、爱社会、爱集体、爱家庭、爱劳动、爱自然、热爱和平、关爱他人等;(2)学习类,含爱学科、学习兴趣、学习自信等;(3)审美类,含学科美、艺术美、文化美、自然美、社会生活美等;(4)健康类,含热爱生活、珍爱生命、自尊自信、享受运动等;(5)人际类,含友情、师生情等。

以课程标准为基础,我们将情感目标分为“四能四类三层”,四能是指四种情感能力,四类三层是指四种情感类型拆解为三个层次,以便为教师提供更加具体、可操作化的情感目标拆解工具,具体为每一类情感下列出具体情感,以及情感对应最可能出现的情绪。

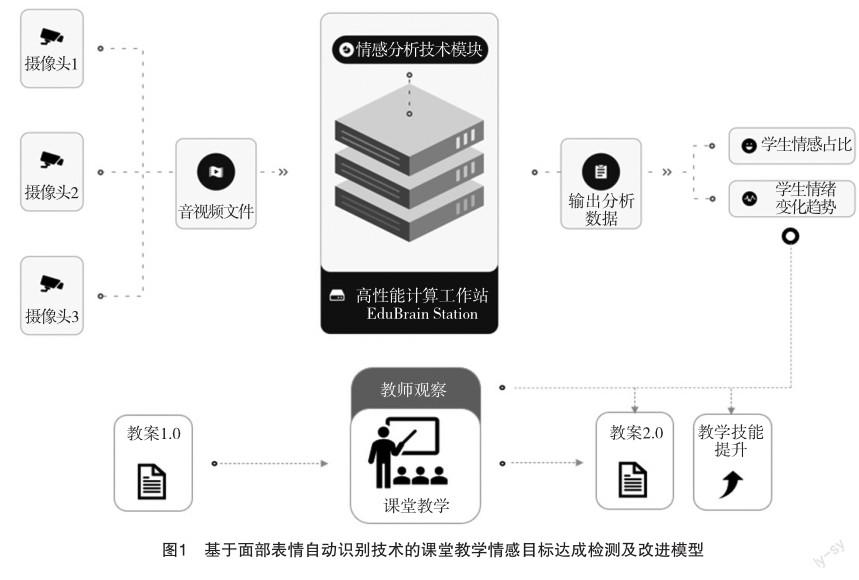

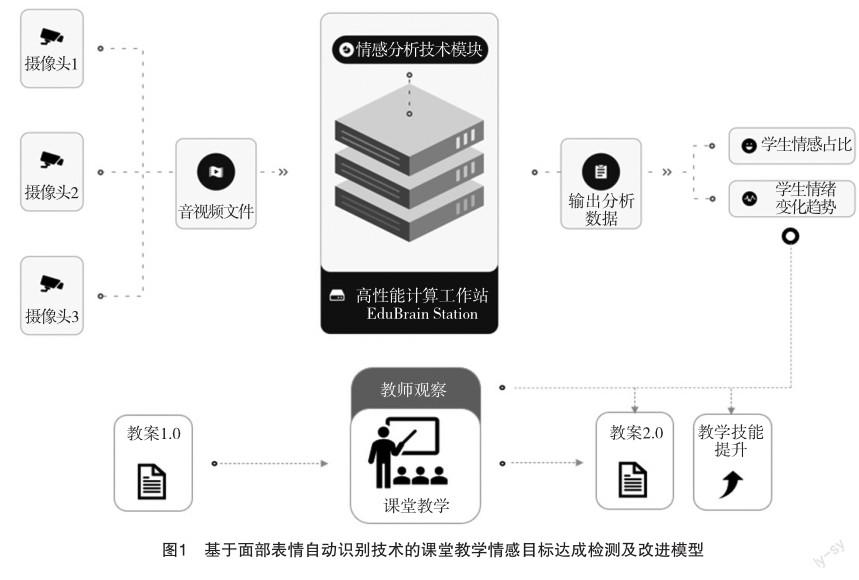

(三)建立基于情绪识别技术的课堂观察框架

在实际教学中对学生的情绪情感状态进行监测和识别,如若采用主观报告法,可能受到学生的期待和动机影响,倾向于往教师期待的方面报告自己的情绪情感状态,或某些情绪片段并未引起学生注意,则无法做出准确的自我报告,也容易受到学生心理发展水平影响,低年级学生可能对一些词语缺乏准确的理解[25],或难以准确清晰地识别和表达自己的情绪情感;若采用穿戴设备法则会影响学生的自然上课状态,老师的实时观察可以帮助老师及时掌握教学效果,但无法实现时时刻刻观察、全覆盖观察。因此本研究建立了如图1所示的基于面部表情自动识别技术的课堂情感目标检测模型,该模型通过教室内安装的摄像头获取学生上课时的视频画面,进而提取学生面部表情特征并进行基本情绪识别,最终呈现出整节课的实时表情结果报告。

研究表明,人工智能情绪识别准确率可以达到88%,其中对高兴的情绪识别准确率可以达到96%,识别准确率最低的愤怒情绪也可以达到76%[26]。然而目前人工智能自动识别的情绪仅限于基本情绪,即害怕、惊讶、厌恶、难过、愤怒、高兴、中性,而实际在课堂教学中,基本情绪仅是学生表现出的情绪一部分,诸如困惑、沮丧等情绪状态也是学生学习过程中常见的情绪,与心理唤醒状态密切相关,而目前的情绪识别技术却无法很好地将其与中性情绪区别开来[27]。为此,本研究将情绪自动识别技术与传统的观察法相结合,以帮助教师检验自己的教学过程,并改进教学设计和教学技能。

1976年,Ekman和Friesen提出6种基本情绪,并基于6种基本情绪提出面部表情编码系统(Facial Action Coding System, FACS),该系统成为后来研究者和实践者进行面部表情自动识别普遍采用的系统,系统可以让编码者基于情绪表达的46个动作单元和面部动作进行情绪评估,Ekman和Friesen提供了“面部表情编码手册”,手册共包含9个方面的信息,就算是第一次参与面部表情識别规则的人员也能使用该手册进行工作[28],但FACS系统的使用需要投入大量的时间和精力,工作人员需要反复不断地练习及对每一个表情进行多轮次打分,这一特点恰好是人工智能技术的优势所在,人工智能识别技术正是建立在深度学习的基础上,相比于传统手动识别的方法,深度学习方法可以自动提取特征并以端到端的方式进行分类[29]。人工智能面部表情识别的核心是模型的训练,一般基于实验室环境下和自然环境下的数据集对模型进行反复训练[30],实现面部表情自动识别模型的建立和优化。整个面部表情识别过程一般包含数据收集和处理、面部特征检测和提取、表情识别(分类)、输出结果并评估等步骤[31-33]。具体到教学场景中,基于人工智能的面部表情识别应用框架,主要包括感知层、算法层、数据层和应用层。

(1)感知层

感知层是整个技术框架的感知终端,利用终端设备对课堂教学过程中产生的非结构化数据进行采集。通常使用的设备包括摄像头(彩色摄像头,深度摄像头,红外摄像头等),拾音器阵列,智能手表/手环,心率采集装置,脑电波采集装置等。其中后三种设备在教育场景的普及度较低,本研究采用彩色摄像头与拾音器搭配的采集方案,以便实现无侵入的数据采集,不影响正常教学流程。

(2)算法层

算法层是技术框架的核心,主要对感知层采集到的非结构化数据进行分析,将其转变为结构化的信息。如针对图像数据进行人员身份识别,动作姿态检测,情感计算,以及图像层面的统计指标分析。针对语音数据进行说话活动识别,说话人识别,以及语音指标统计。更进一步通过时间轴的统一可以将语音信息与图像信息进行关联分析,综合教学的场景特点得到语音和图像信号的关联关系。

(3)数据层

数据层主要利用机器学习、模式识别等技术对算法层产生的结构化数据进行进一步的处理。预先标注特定行为后对获取结果进行分类识别。对于新的模式可以利用无监督算法进行聚类分析,找到不同数据的不同模式。例如在无先验知识的情况下对班级内学生的学习模式的聚类,对不同班级或不同老师之间的教学模式的聚类。

(4)应用层

应用层是课堂观察技术框架的最顶层,是身份特征识别、行为识别和情感计算等智能感知技术形态实现的最终功能体现。应用层通过接收来自算法层的数据处理结果,面对课堂场景,面对不同对象,提供情绪变化可视化数据等,如情感饱满度、音量与节奏的授课分析,情感与课堂氛围的听众分析。

四、问题解决:基于学科情感目标检测框架的教学改进

为帮助教师更好地达成一节课的情感目标,课题组为教师提供了系列工具支架,包括课节目标描述工具、预设环节目标拆解工具,其中课节目标描述由教学情境、情感能力、情感对象、具体情感四部分组成,通过四部分描述可以帮助教师将情感目标具体化,加强课节目标对整节课的引导作用;预设环节情感目标拆解分为教学内容/模块、教学情境、情感能力、具体情感、对应情绪,该工具既可以帮助教师提高教学设计的科学性、有效性,也可以提高情绪自动识别结果与预设结果对比分析的准确率。

以一堂小学三年级语文课《在牛肚子里旅行》为例,本课中课节情感目标为:通过对课文内容的分析认识友情的内涵,在现场表演中体悟青头和红头之间的珍贵友情,在分享友情故事中拓展对友情的认识,进而珍惜友情。根据教学设计,教师预设1—10分钟以着急、高兴情绪为主,10—20分钟以兴奋、感动为主,20—30分钟以感悟为主,30—40分钟以领悟为主。教学结束后,AI情绪分析结果显示,整节课学生的正面情绪(高兴、惊喜)占18%,中性情绪占79%,负面情绪(伤心、生气、害怕)占3%,其中正面情绪主要为高兴,负面情绪主要为生气。具体如表1所示。

整体而言,这节课的情感目标教学效果与预期存在一定差距,这与教师对情感目标教学经验不足有关,特别是关于学生情绪发生的影响因素、情绪的准确命名上存在较为明显的短板,如教师反思到学生的情感变化最大的原因不是故事情节的变化,而是课堂上教师的语言、教学活动的安排,这与该环节本身的设计有关,课前引入环节,以“谈话”导入的方式,未能很好地激发学生的情绪情感状态,也影响了整节课的情感基调,因此建议该环节加强情境创设;又如教师对20—30分钟、30—40分钟的情绪情感进行预设时,未能将其进一步细化到可明确观察的情绪层次,感悟感、领悟感本身包含多种情绪成分和过程,如学生从困惑到惊讶、兴奋,可能还会有因为获得了新知而产生的满足。这节课中,教师呈现的配乐、图片等,对于帮助学生理解故事内容,激发学生预设的情绪情感状态的作用比较明显,可见适当呈现形式多样的材料对于实现情感教学目标是有帮助的。

基于上述分析,我们与授课教师对这节课的教学设计共同进行了改进,包括以视频故事的方式作为导入;在表演环节由原来的两组学生(共计4个学生)上台表演改为全班同学两两一组同时表演,结束后请同学分享感受;提前一天让学生准备友情故事,以便在最后的友情故事分享环节进行高质量的分享;同时,我们还建议教师在上课时,注意充分利用自身语调、表情、动作等情绪表现来带动学生的情绪情感状态。在第二次教学后,教师和研究者通过观察,都认为学生的情感目标达成效果好于第一次课堂,AI情绪识别结果也显示学生的中性情感占比下降至50%,正面情绪和负面情绪占比均有所增加,在各环节的情绪占比相比第一次课堂更加符合预设状态。

五、前景展望:情绪自动识别技术应用于情感目标教学的前景与挑战

(一)未来发展与应用前景

情绪自动识别技术已经广泛应用于管理、医疗、游戏等多个行业,目前也有研究与实践尝试将该技术应用于学校教学,其客观性、高效性可以为教师和研究者提供较为准确、丰富的支持性数据,帮助教师更加客观、完整地分析课堂中学生的情绪情感状态。对学生情绪情感状态的识别不仅可以用作检验情感目标教学效果,也能为日常教学中监测学生学习动机激发情况、学习卷入度情况、学习效果等提供支持[34-36],目前的研究主要将情绪识别的结果用于教学评估,如教学质量的评估[37]、學习过程状态评估[38],对于情绪识别数据在教学中的应用还可以更加多元,如推动个性化学习,目前已有研究尝试利用情绪自动识别的结果进行个性化学习内容的推送[39],利用情绪自动识别结果为推动学生个性化学习进程服务也是未来情绪自动识别应用于教学的重要方式。目前情绪识别技术主要应用在线上教学过程中,但在日常的线下课堂教学中的应用还存在一定的滞后性,即在教学过程结束后才进行结果分析,教师再根据结果反思教学,改进下一次教学,这种方式无法让教师对本堂课进行实时改进,未来还需进一步探讨在常规班级授课环境下,如何进一步使情绪识别结果实时反馈给授课教师,让教师在上课的过程中就可通过实时数据了解学生的情绪情感状态,及时调整教学安排。

(二)可能的挑战

情绪自动识别的应用一直处于较窄范围的实验,其最大的阻碍在于情绪自动识别的范围有限。一方面,目前对情绪的自动识别还仅限于七种基本情绪,基本情绪只是人类情绪类别中的冰山一角,并不是学习情境中发生频率最高的情绪类别,且面部表情存在较大的地域文化差异,将情绪的自动识别拓展到更多的复合情绪还有很长的一段路要走,且涉及心理学、生理学、社会学、信息科技等多个领域。情绪自动识别的发展首先要突破对情绪的识别范围,随着技术的不断推进,对情绪识别进行更加细分领域的模型训练成为可能,如分地域、文化的情绪识别。另一方面,目前的情绪识别训练数据集都是以清晰正面镜头的面部数据为基础,而像教室中采集的普通群像的视频集数据,存在面部信息不全、位置不正、位置变换等情况,使得实际数据分析存在较大的困难,如何解决自然群体录像中的面部特征数据的缺失带来的问题,也是情绪识别技术常态化应用于常规课堂教学所面临的挑战。

参考文献:

[1] 联合国教科文组织.反思教育:向“全球共同利益”的理念转变?[M].北京:教育科学出版社,2017.

[2] Collins English Dictionary.Definition of feeling [EB/OL].https://www. collinsdictionary.com/dictionary/english/feeling,2023-04-01.

[3] Merriam-Webster Dictionary.Affect Definition and Meaning [EB/OL]. https://www.merriam-webster.com/dictionary/affects,2023-02-24.

[4] American Psychology Association.APA dictionary of psychology--feelings [EB/OL].https://dictionary.apa.org/feeling,2023-01-01.

[5] 朱小蔓.情感教育论纲(第3版)[M].南京:南京师范大学出版社,2019.

[6][7][10][12] 彭聃龄.普通心理学(第四版)[M].北京:北京师范大学出版社,2012.

[8] Eddie Harmon-Jones,Philip A.Gable,et al.Does Negative Affect Always Narrow and Positive Affect Always Broaden the Mind Considering the Influence of Motivational Intensity on Cognitive Scope [J].Current Directions in Psychological Science,2013,22(4):301-307.

[9] 卢家楣.课堂教学的情感目标分类[J].心理科学,2006,29(6):1291-1295.

[11] Verywellmind.Understanding Inappropriate Affect [EB/OL].https://www. verywellmind.com/understanding-inappropriate-affect-4767992,2022-11-26.[13] 赵德成.课程实施中的情感、态度和价值观评价[J].课程·教材·教法,2003,(9):10-13.

[14] 黄勇萍.基于无线信号的情绪识别应用研究[J].无线互联科技,2018, 15(20):24-25.

[15][16] 胡心约,张怡路等.基于AI的情绪识别在组织中的实践:现状、未来和挑战[J].中国人力资源开发,2022,39(1):57-70.

[17] 杨天琪.讯问中谎言识别技术智能化及其法律风险规制研究[D].武汉:中南财经政法大学,2020.

[18] 刘洋,秦海波.语音情绪识别技术在载人航天领域的应用[J].人民论坛·学术前沿,2018,(17):69-73.

[19] 陈子健,朱晓亮.基于面部表情的学习者情绪自动识别研究——适切性、现状、现存问题和提升路径[J].远程教育杂志,2019,37(4):64-72.

[20] Paul Ekman,Wallace V.Friesen.Detecting deception from the body or face [J]. Journal of Personality and Social Psychology,1974,29(3):288-298.

[21] 李勇帆,李里程.情感计算在网络远程教育系统中的应用:功能、研究现状及关键问题[J].现代远程教育研究,2013,(2):100-106.

[22] 程萌萌,林茂松等.应用表情识别与视线跟踪的智能教学系统研究[J].中国远程教育,2013,(3):59-64.

[23] 江波,李万健等.基于面部表情的学习困惑自动识别法[J].开放教育研究,2018,24(4):101-108.

[24] Mohamed Ez-zaouia,Lavoué E.EMODA:a tutor oriented multimodal and contextual emotional dashboard [EB/OL].https://doi. org/10.1145/3027385.3027434,2017-03-13.

[25] 姜媛,林崇德.情绪测量的自我报告法述评[J].首都师范大学学报.社会科学版,2010,(6):135-139.

[26] Sabrina St ckli,Michael Schulte-Mecklenbeck,et al.Facial expression analysis with AFFDEX and FACET:A validation study [J].Behavior Research Methods,2018,50(4):1446-1460.

[27] Bethany McDaniel,Sidney D Mello,et al.Facial Features for Affective State Detection in Learning Environments [J].Proceedings of the Annual Meeting of the Cognitive Science Society,2007,29(29):467-472

[28] Paul Ekman,Wallace V.Friesen.Measuring Facial Movement [J]. Environmental Psychology end Nonverbal Behavior,1976,1(1):56-75.

[29][31] Muhammad Sajjad,Fath U Min Ullah,et al.A comprehensive survey on deep facial expression recognition:challenges,ap plications,and future guidelines [J].Alexandria Engineering Journal,2023,68:817-840.

[30][32] 張隽睿.基于深度学习的静态和动态面部表情识别研究[D].成都:电子科技大学,2022.

[33] 李广鹏,刘波等.一种基于机器学习的人脸情绪识别方法研究[J].计算机技术与发展,2019,29(5):27-31

[34] 龚雅云,唐小煜等.基于面部情绪识别的物理实验教学过程评价[J].物理实验,2020,40(9):20-31.

[35] 陈盛,戴建邦等.基于学生情绪动态识别的课堂教学研究[J].中国教育信息化,2019,(13):33-36.

[36] 陈子健.在线学习环境下基于面部表情的学习情绪识别方法及应用研究[D].武汉:华中师范大学,2020.

[37] 谭利,陈子洋等.基于情绪识别和深度学习的课堂教学质量形成性评价算法[J].信息与电脑,2022,(17):236-241.

[38][39] 谢盼,张贺.基于面部情绪识别的在线学习过程评价的研究与实现[J].吉林广播电视大学学报,2021,(6):24-27.

作者简介:

王凯:研究员,博士,主任,研究方向为课程理论与实践。

余发碧:助理研究员,硕士,研究方向为课程理论与实践研究、教材编写与管理。

李敏:中学一级,硕士,研究方向为学习方式变革、电子教材。

Research on Subject Emotion Goal Achievement Detection and Teaching Improvement Based on Expression Recognition Technology

Wang Kai1, Yu Fabi1,2, Li Min1

(1.Beijing Institute of Educational Sciences, Beijing 100036; 2.Faculty of Education, Beijing Normal University, Beijing 100875)

Abstract: Emotional ability is the key to humans survival and development. Carrying out emotional teaching in classroom teaching is not only an important way to cultivate students emotional ability, but also the due meaning of the implementation of curriculum standards. Based on the emotion automatic identification technology and combined with teachers ‘observation, this study constructs a model to help teachers test the effect of emotional goals. This model is simple and easy for teachers. The automatic emotion recognition technology can promote the implementation of the new curriculum standards, and improve the accuracy and comprehensiveness of teachers teaching reflection.

Keywords: facial expression recognition; affect goals; analyzing model

責任编辑:李雅瑄