具有局部和全局注意力机制的图注意力网络学习单样本组学数据表征

2023-11-24周丰丰张金楷

周丰丰,张金楷

(1.吉林大学 计算机科学与技术学院,长春 130012;2.吉林大学 符号计算与知识工程教育部重点实验室,长春 130012)

近年来,现代高通量生物医学技术得到快速创新和发展,生物数据积累加速[1].这些数据极大促进了许多生物学过程的潜在机制研究,包括衰老过程和复杂的疾病发病机制[2].但大多数生物组学数据集具有高噪声、多维度和多维异质性的特点.此外,生物组学的许多特征与表型无关,特征之间存在冗余.高通量技术生产的生物组学大多存在“大p小n”的维度灾难问题,其中p指特征数量,n指样本数量.因此,组学数据存在高维问题.特征选择是克服高维组学数据维数灾难的有效方法.特征选择方法在生物信息学领域被广泛应用于生物标记物识别和数据降维.而现有的应用于组学数据的特征选择算法,基本都是使用传统的分类学习算法对数据进行分类,即在组学数据降维的研究中,很少考虑深度特征选择算法,导致组学数据分类精度较低.

目前基于深度学习的方法有许多尝试采用基于图的混合策略,在分析前将每个组学建模为一个单独的图,利用图嵌入方法从每个网络中学习节点及其周围环境的低维表示.然后将新的基于图的特征组合并输入其他机器学习模型进行预测、分类等.在组学数据上构建网络的常用方法包括蛋白质相互作用网络、基于相关性的网络、比值网络等.Jonsson等[3]通过分析蛋白质相互作用网络,发现与癌变相关的蛋白质特征常具有更密切的相关性,表明功能相似的特征或特征集通常以模块化的形式反应有机体功能的表型.Wang等[4]通过分析蛋白质相互作用网络揭示了肝脏特异性蛋白、肝脏疾病蛋白和重要信号通路分子之间的相互作用特征.Liu等[5]利用Pearson相关系数计算特征之间的相关性,建立相应的生物网络,利用有特定样本和无特定样本时特征之间的相关性变化构建单个样本网络,为疾病的个性化治疗提供了帮助.Netzer等[6]使用配对生物标记标识符(paired biomarker identifiers,PBI)作为指标,测量不同群体特征比的变化,并构建了相应的生物网络.将单个特征作为网络节点,通过特征之间比值关系的变化构建网络的方法首先应用于代谢组学数据,之后推广到基因组学数据[7].因此,选择合适的网络并找到高效的分类学习算法尤为重要.

本文在从组学数据的单样本网络中学习有用信息的基础上,提出一种具有局部和全局注意力机制的图注意力网络(GATOr).首先,从每个样本的组学数据中构建一个图,以一个组学特征作为一个节点,两两特征之间的相关性作为边的权值;由于构建图的时间复杂度为平方,因此对无关特征进行预筛选,以减少单样本图中组学特征的数量.其次,提取图注意力网络中集成的局部和全局注意模块的有用信息作为工程特征,并从该单样本网络中学习到的特征进行类预测任务.实验结果表明,与现有的组学分类方法相比,GATOr具有更好的分类性能.

1 算法设计

1.1 单样本网络

单样本网络是一种基于参考数据集的利用单样本数据构建的生物分子网络,它是一种将复杂网络的理论和方法应用于疾病研究和药物开发的方法,可从系统的角度识别个体疾病所涉及的相互作用或功能失调[8].Liu等[5]提出了基于Pearson相关性的单样本网络,在疾病表征基因调控网络的背景下获得个体特异性或样本特异性网络.对于节点网络,其构建需要多个样本,但在临床实践中通常无法获得.在单样本[9]的基础上对节点网络进行表征或推断是必要的.这种方法的优点是网络只依赖于从每个模型中学习基于图的变量,这些变量可用于其他机器学习模型的输入,用于聚类、子类型发现或生存预测.

1.2 图注意力网络

图神经网络通过聚合网络中多层邻居节点对当前节点的影响,更新节点的嵌入式表示,然后用更新的嵌入式表示完成后续任务,如节点分类和链接预测等[10].Bruna等[11]提出了一种基于谱域的图卷积神经网络(GCN),谱域的卷积需要在Laplace矩阵上进行特征分解,每次都需进行节点的聚合,非常耗费算力.Defferrard等[12]对卷积核进行近似操作,提出了Chebyshev网络,该网络避免了Laplace矩阵的特征分解,降低了运算的复杂度.Kipf等[13]对其进行了进一步优化,提出了最初的图卷积网络模型,在谱域上的图卷积网络可以发挥其最大的效能.图注意力网络(GAT)先在各节点间采用消息传递的方式聚合邻居节点[14],然后更新自身节点的信息,通过学习注意力权值,放大更重要的节点和边的权重,使用注意力机制定义聚合函数,从而计算并更新节点的特征信息,得到节点局部结构新的特征.

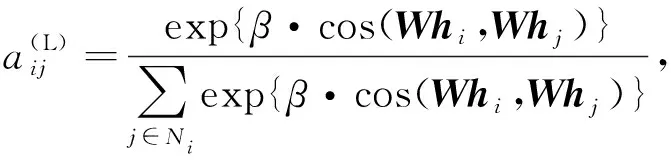

GAT网络由堆叠简单的图注意力层(graph attention layer)实现,每个注意力层对节点对(i,j),注意力系数计算方式为

(1)

其中aij为节点j到i的注意力系数,Ni表示节点i的邻居节点.节点输入特征为h={h1,h2,…,hN},hi∈F,节点特征的输出为F,其中N,F分别表示节点个数和输入特征维数;W∈F′×F表示在每个节点上应用的线性变换权重矩阵;a∈2F′为权重向量,可以将输入映射到.最终使用Softmax进行归一化并加入LeakyReLU以提供非线性.最终节点的特征输出可表示为

(2)

其中σ表示非线性激活函数,如Sigmoid和ReLU.

1.3 GATOr网络

图1 基于局部和全局注意力机制学习组学特征表示的图注意力网络Fig.1 Graph attention network based on local andglobal attention mechanism to learn omicsfeature representation

本文提出的基于局部和全局注意力机制学习组学特征表示的图注意力网络(GATOr)整体结构如图1所示.由图1可见,其主要包含两部分: 1) 单样本网络,将每个组学数据样本建模为一个单样本网络,将特征作为节点,每对特征之间的相关性作为边;2) 具有局部和全局注意力机制的图注意力网络,用于从单样本网络中学习表征特征向量进行分类任务.GATOr网络的优化目标是评估中心节点附近某个邻居节点的重要性,从而为其邻居节点分配不同权重.中心节点的局部注意力只关注其一阶邻居,而全局注意力则关注图中所有节点,局部与全局注意力机制的融合优化了特征提取能力,使下游的分类性能得到提高.

GATOr网络引入了注意力机制,用于解决GCN对邻居节点一视同仁的局限性,通过分配不同的权重给不同的邻居,赋予模型更强的特征表示能力,将原始图数据转换到低维空间并保留关键信息,生成保留原始图中某些重要信息的低维向量,同时也提高了节点分类等下游任务的分类性能.

1.3.1 构建单样本网络

本文将组学数据的样本作为单样本网络训练基于图的GATOr模型.考虑到现实情况,仅利用一个样本数据检测复杂疾病恶性突变的临界状态和预警信号至关重要.虽然表达数据或测序数据在单个样本的基础上提供了关于分子谱的信息,但由于数据集每个病人只有一个样本数据,无法利用传统方法计算出基因的相似性网络,因此需给出足量的参考样本表征正常时期基因之间的相关性,通过对比单个样本与参考样本之间的差异反应单样本特征[5,15].

首先基于基因共表达网络构建出参考网络,通常用无向图表示,网络中的节点表示特征,边表示特征之间的相关性.给定n个参考样本,参考样本数据中任意一对特征x和y之间的相关性可使用Pearson相关系数(PCC)计算,用公式表示为

(3)

Yu等[16]检索了查询样本中每个组学特征相对于参考样本子集的方差,并计算了查询样本中两个组学特征方差向量之间的PCC.在查询样本中,这两个组学特征之间的PCC值被定义为基于参考的变异PCC(rvPCC).rvPCC取值范围为-1~1,当rvPCC接近-1或1时,将两个查询特征定义为正相关或负相关[17].

组学数据集通常具有数千个甚至更多的特征,使得构建单样本网络的平方时间复杂性变得不切实际.本文使用t检验衡量每个特征与类标签的关联,并选择排名靠前的k个特征(本文中k=800)[18]进行进一步分析.采用PCC测量特征间的冗余度.

至此已构建出一个完整的单样本网络,该网络为一个加权无向图,可用于各种基于图的深度神经网络,为在网络层面表征个性化特征并分析生物系统开辟了新途径.

1.3.2 局部与全局注意力机制

GAT使用特征向量a学习节点及其邻居的相对重要性,可能无法捕获分类任务的有用信息.假设与节点本身相似的邻居节点可能更重要,则可通过直接计算两个相连节点之间的相似度得到节点的相对重要性[19].节点的局部注意力只关注其邻居,而节点的全局注意力从图中所有节点中提取信息.基于双重注意力机制的网络,通过对低层详细信息和高层语义信息的注意获取高质量、独特并可鉴别的特征[20].

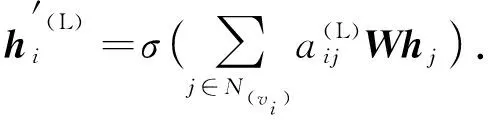

局部注意力系数计算公式为

(4)

式中β表示标准偏差,cos(·)用于计算余弦相似度.为聚合来自节点邻域的信息,式(2)可表示为

(5)

局部注意力模块与图注意力模块的区别: 本文显式地使用cos(·)计算节点之间的相似度作为相对重要性权重,而传统方法使用可学习参数a学习节点之间的相对重要性.局部注意力是在图上一个节点的邻居上计算的,而本文在所有实体的集合上构造局部注意力.

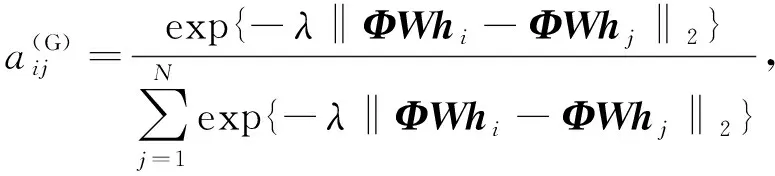

本文还实现了全局注意力机制,其中节点可有选择地聚合图中任何其他节点的信息.扩展图注意力层以进行全局操作.Mostafa等[21]提出了一种基于欧氏距离的注意力系数.全局注意力系数可表示为

(6)

其中:Φ∈D×F′为嵌入矩阵,它将节点特征转换到d维节点相似度空间;λ表示标准差的逆,‖·‖2表示2范数.

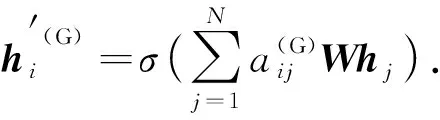

节点i的全局加权注意力为

(7)

(8)

其中‖为串联运算符.式(8)也可视为将不同注意力头的输出相连接.使用A个注意力头,输出特征向量的维数为2AF′,最终的特征向量也可表示为

(9)

其中G表示单样本网络的无向图,注意力头数A=2,g表示进行注意力操作的过程.

2 实 验

2.1 数据集

使用4个数据集评估GATOr特征工程算法,这4个数据集均选自文献[22]中整理的组学数据集: 数据集ROSMAP提供了阿尔茨海默病(AD)患者与正常对照组(NC)的组学数据;数据集LGG用于低级别胶质瘤(LGG)的分级分类;数据集KIPAN用于肾癌类型分类;数据集BRCA用于乳腺癌PAM50亚型的分型任务.每个数据集的预处理包括排除缺失值的特征以及随机选择参考样本.

各数据集信息列于表1,其中第四列给出了每个数据集中两个或多个类的详细信息,最后一列给出了3种类型组学数据的特征数量,即mRNA表达(mRNA)、DNA甲基化(Methy)和miRNA表达(miRNA).数据缺失的特征被排除在进一步分析外.由于本文不讨论多组学整合分析,因此3种类型组学数据混在一起进行计算.

表1 各数据集信息

2.2 评价指标

在进行构建单样本网络等时间复杂度较高的任务前,先通过特征预筛选降低特征维度.由表1可见,4个数据集的特征数量都远大于样本数量.考虑到构建单样本网络的平方时间复杂度,因此仅对有限数量的原始组学(OMIC)特征设计GATOr特征.

通过分层策略将每个数据集随机分为80%的训练数据集和20%的测试数据集,即保持训练数据集和测试数据集的类分布.二分类任务的评价指标为分类精度(ACC)和ROC曲线下面积(AUC).对于多分类任务,只计算ACC.

2.3 实验结果及分析

2.3.1 对比实验

本文将GATOr的分类性能与以下7种组学数据基线方法进行比较.

1)k近邻分类器(KNN): 基于查询样本的k个近邻的类别实现投票策略.

2) 支持向量机分类器(SVM): 一种流行的基于最大间隔分割平面的分类器.

3)L1正则化训练的线性回归(Lasso): Lasso回归是线性回归模型的一种收缩和变量选择方法,用于获取定量响应变量的预测误差最小的预测变量子集.

4) 随机森林分类器(RF): 融合多棵随机树的决策.

5) 朴素Bayes分类器(NB): 基于Bayes定义和特征条件独立假设的分类器方法.

6) 极限梯度提升算法(XGBoost): 提供了一种可扩展的快速梯度提升分类系统.

7) 全连接神经网络分类器(NN): 使用具有交叉熵损失的全连接神经网络作为基线神经网络分类器.

GATOr算法与7种基线方法在4个数据集分类任务上的性能评估列于表2.由表2可见,GATOr框架在4个数据集上的ACC和AUC指标均优于其他基线分类器.与传统的组学分类方法相比,GATOr还获得了相对较小的标准差,具有更好的分类性能.

表2 GATOr算法与7种基线方法在4个数据集分类任务上的性能评估

2.3.2 消融实验

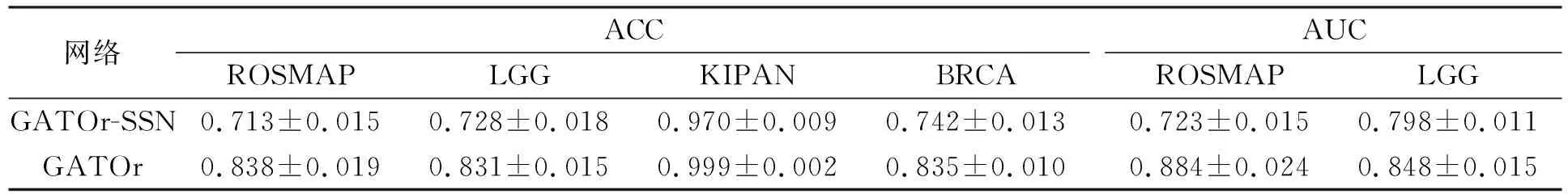

首先,实验评估了由单样本网络(SSN)学习到的嵌入特征的贡献度.将没有SSN模块的GATOr过程表示为GATOr-SSN,即直接将预处理后的特征加载到下一个模块中,而不使用SSN模块.实验结果列于表3.由表3可见,完整的GATOr过程在4个数据集上的两个性能指标ACC和AUC都优于GATOr-SSN版本.因此,有必要将单样本网络引入到OMIC数据的特征工程任务中.

表3 单样本网络(SSN)嵌入特征的分类贡献

其次,通过消融实验评估GATOr主要模块的贡献.基线模型为图注意力网络GAT.将没有局部和全局注意力机制的GATOr网络分别表示为GATOr-Local和GATOr-Global.将这3种图网络与完整的GATOr网络根据其提取的特征进行分类性能比较.

GATOr图注意力网络主要模块的分类贡献列于表4.由表4可见,移除任何一个模块都会降低分类ACC和AUC值.去掉局部注意力机制导致的性能下降最大,表明在GAT网络中仅包含全局注意力可能会使提取的特征分类性能恶化.而全局注意力机制和局部注意力机制的引入对基线GAT网络具有积极贡献,即使是基线GAT网络也比表3中GATOr-SSN过程提取了有用的信息,以获得更好的分类性能.

表4 GATOr图注意力网络主要模块的分类贡献

综上所述,本文提出了一种结合局部和全局注意力机制的图注意力网络,用于从组学数据的单样本网络中学习有用信息.本文对组学数据所有的样本构建其对应的单样本网络,通过具有局部和全局注意机制的图注意力网络从单样本网络中学习基于图的组学特征表示进行类预测任务.实验结果表明,即使是基线图注意力网络在分类任务上的性能也优于原始的组学特征,并且局部注意力和全局注意力的融合可以进一步提高数据分类性能.