面向广域场景的可见光-SAR遥感图像匹配方法

2022-11-15王钦炜李璋江云天卞一杰赵宏叶熠彬

王钦炜 李璋,* 江云天 卞一杰 赵宏 叶熠彬

面向广域场景的可见光-SAR遥感图像匹配方法

王钦炜1,2李璋1,2,*江云天1,2卞一杰1,2赵宏1,2叶熠彬1,2

(1 国防科技大学空天科学学院,长沙 410073)(2 湖南省图像测量与视觉导航重点实验室,长沙 410073)

可见光-SAR(合成孔径雷达)遥感图像的高精度匹配是视觉导航、图像融合等典型遥感应用的基础,现有匹配方法主要聚焦在非线性辐射失真(NRD)等成像差异的问题,并未充分考虑遥感图像的场景差异,导致匹配方法的场景适应性有限。为解决可见光-SAR图像匹配中成像场景广域多样、成像差异等挑战,文章提出了一种结合遥感图像场景分类的广域场景异源图像的匹配方法。该方法首先使用广域图像匹配场景分类算法按照纹理特征对遥感图像进行四个典型场景(重复纹理、非均匀纹理、弱纹理和混合类别)的分类,然后在统一的特征匹配框架中为每类场景选择合适特征描述符。将该方法在异源图像匹配数据集上与两种常用的可见光-SAR匹配方法进行比较,通过实验验证,文章的方法可以在不增加计算时间的前提下,在所有类别上取得最优的匹配结果。该方法为广域场景下的可见光-SAR遥感图像匹配提供了一种可行的解决方法。

可见光图像 合成孔径雷达图像 广域场景 特征描述 异源图像匹配 场景分类 遥感应用

0 引言

近年来,随着遥感成像技术快速发展以及商用遥感的普及,遥感图像的品质有了显著改善,形成了可见光、合成孔径雷达(Synthetic Aperture Radar,SAR)等多模态成像方式下的海量遥感影像数据。为了更加有效的利用各成像模式所包含的不同信息,通常需要对同一区域的多模态成像进行异源图像匹配,高精度的匹配结果是图像融合、变化检测、视觉导航等遥感典型应用的基础[1-3]。然而,由于成像机理的不同,可见光和SAR遥感图像之间存在几何特性、非线性辐射失真(Nonlinear Radiation Distortions,NRD)以及噪声等差异[4-5]。此外,遥感图像覆盖区域广且场景复杂多样,给高精度的异源图像匹配带来了挑战[6]。

常用的异源图像匹配方法会基于图像的特征进行匹配[7],针对可见光和SAR图像间存在的NRD等问题,常用的图像特征包括梯度、相位一致性(Phase Congruency,PC)[8]和局部自相似性(Local Self-Similarity,LSS)[9]等特征。

传统的特征描述符多数采用梯度特征构建[10-14],但相比于梯度,PC特征已被证明对光照和对比度变化更具鲁棒性[15],文献[16]以分组的方式使用PC结构图提出了相位一致性结构描述符(Phase Congruency Structural Descriptor,PCSD);文献[17]计算了PC的方向信息,使用方向梯度直方图(Histogram of Orientated Gradient,HOG)描述符的框架构建结构特性描述符——方向相位一致性直方图(Histogram of Orientated Phase Congruency,HOPC);文献[18]提出了一种新的仿射和对比度不变描述符,称为最大稳定相位一致性(Maximally Stable Phase Congruency,MSPC);文献[19]提出了一种基于PC和最大索引图(Maximum Index Map,MIM)的更通用的方法,即辐射不变特征变换(Radiation-Invariant Feature Transform,RIFT)。

受局部自相似性(LSS)策略的启发,文献[20]提出了一个密集LSS(Dense Local Self-Similarity,DLSS)描述符来匹配光学和SAR图像;文献[21]提出了一种基于独特顺序的自相似性(Distinctive Order-Based Self Similarity,DOBSS)描述符,更准确但也更费时;文献[22]引入了一种基于秩的局部自相似性(Rank-Based Local Self-Similarity,RLSS)描述符,以解决用于光学和SAR图像之间严重的NRD。

但是,现有方法无法适应广域场景的匹配问题,本文尝试提出一种适用于广域场景的异源图像匹配方法。首先,根据图像纹理的强度和空间分布对SAR进行场景分类,不同于语义分类的典型遥感分类方法[23-24],围绕匹配的需求,更侧重特征的分布特性。进一步在分类的基础上,选择合适特征描述符,充分验证各特征描述的场景适应性,最终实现面向广域场景的鲁棒且准确异源图像匹配。

1 广域图像场景分类算法

典型的遥感图像场景分类是学习和发现图像语义标签的过程,语义标签通常包括居民区、商业区、农田、河流以及森林等。基于图像特征表达的遥感图像分类方法,例如全局特征信息(GIST)[25]对场景的分类更注重特征的分布,而不是语义的标签[26],更适合基于特征的异源遥感图像匹配任务,设计适合异源图像匹配的场景分类方法是提高匹配精度的关键。本文的分类方法受文献[25]启发,将实际匹配任务的需求作为本文进行场景分类的目的。

针对俯瞰视角的广域遥感图像匹配问题,本文更加关注图像全局的纹理强度与空间分布。本文根据图像匹配任务设定的类别,以及场景分类中使用的特征描述和分类方法介绍如下。

1.1 广域场景类别设定

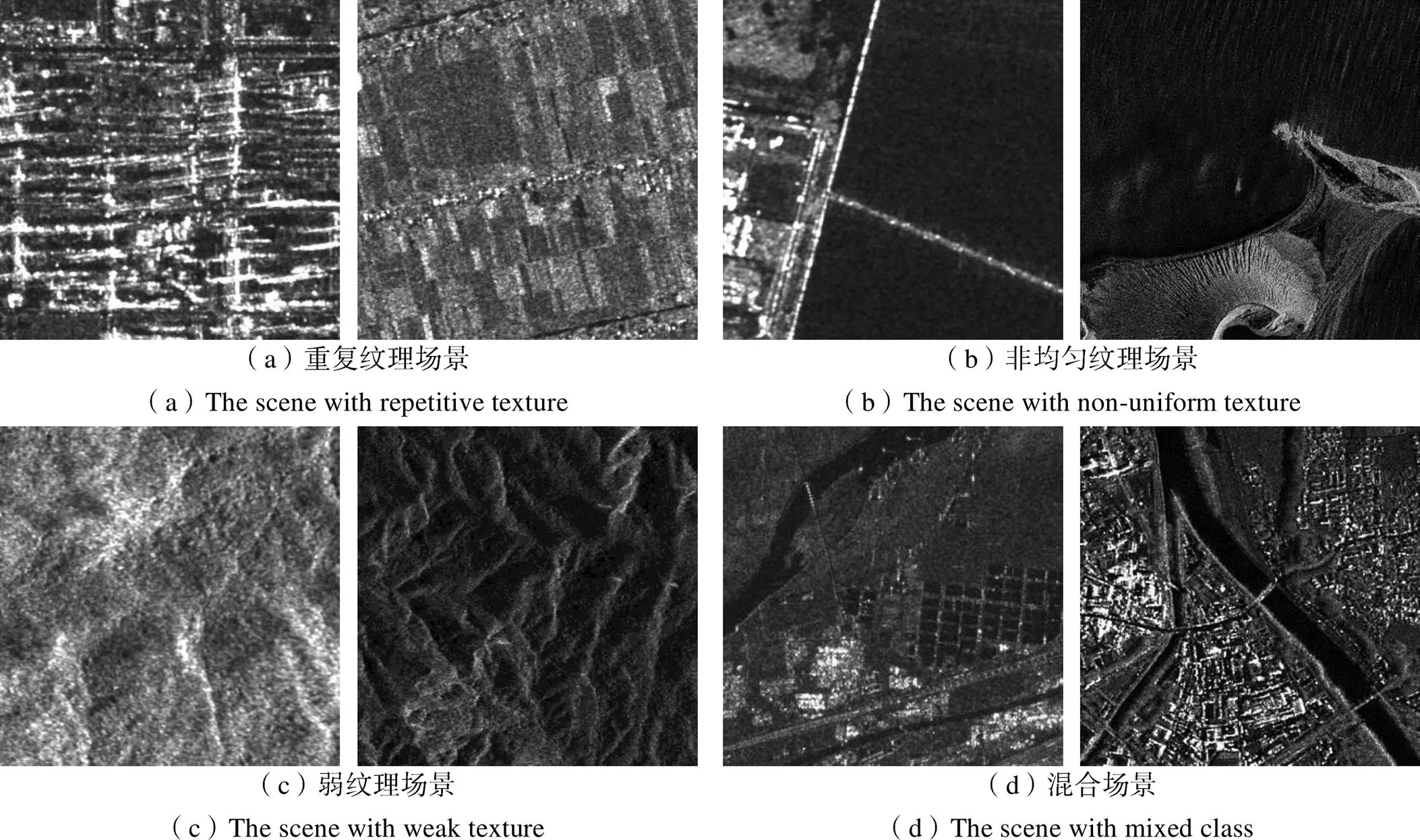

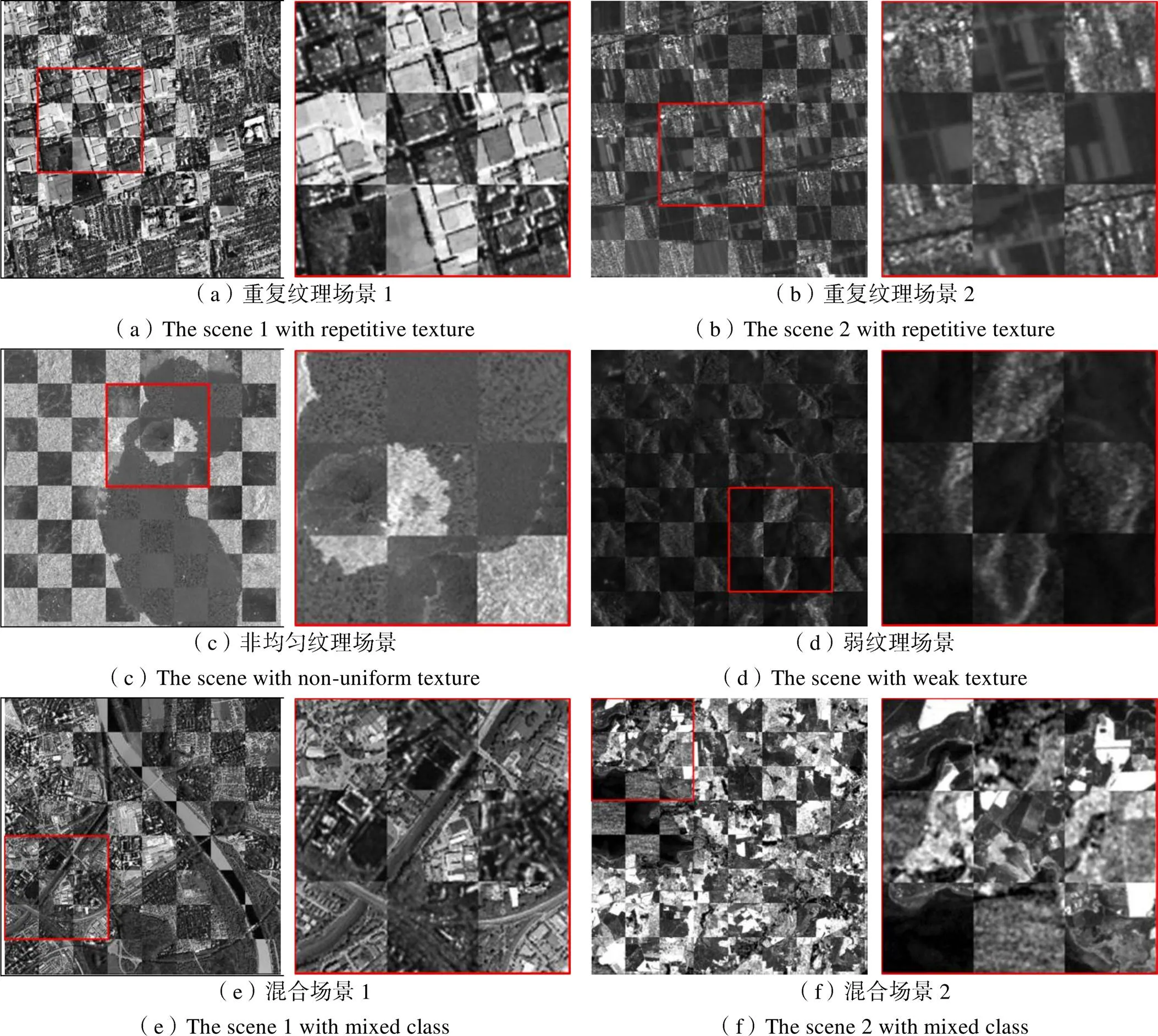

图像中常见的八种语义场景分别为港口、城市、河流、机场、岛屿、平原、戈壁以及山区。根据匹配任务需求,针对SAR图像将以上八类场景按照纹理强度和空间分布分为四个类别——局部重复纹理、非均匀纹理、弱纹理以及混合场景。下面具体介绍每一类图像的特点,并且在图1中给出每个类别的两幅示例图。

1)重复纹理类别:主要为城市和平原场景。城市场景中建筑物大多以相似矩形沿着城市道路规则排列分布,道路将重复的建筑划分成重复区域;平原场景中的农田形状结构相似,沿道路分布且没有明显的地形差异。

2)非均匀纹理类别:主要为港口和海岛场景。这两种典型场景的共同之处是图像中较大区域为海域,没有有效纹理信息的存在。

3)弱纹理类别:主要为丘陵、戈壁和山区场景。图像中的纹理信息多为地形起伏造成的非结构性纹理,对比度较低且可辨别性不强。

4)混合类别:除了以上三种具有明显纹理分布的场景以外,剩余的场景均被划到混合类别。该类别场景种类多样,包含前面提到的几种类别的组合特点。

图1 各类别场景示例

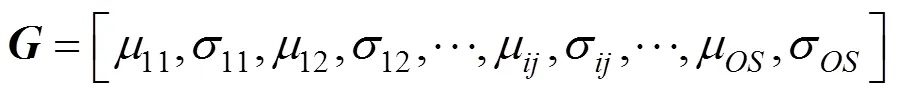

1.2 基于纹理分析的场景特征描述

对于上一节中提到的四种类别的图像,可使用纹理强度、均匀度两项指标去衡量其全局的纹理强度和分布。本文采用二维Gabor滤波器组[27]提取图像纹理信息,然后计算滤波器组的输出的均值和标准差从而构建特征向量。

1.3 基于支持向量机(SVM)的场景分类

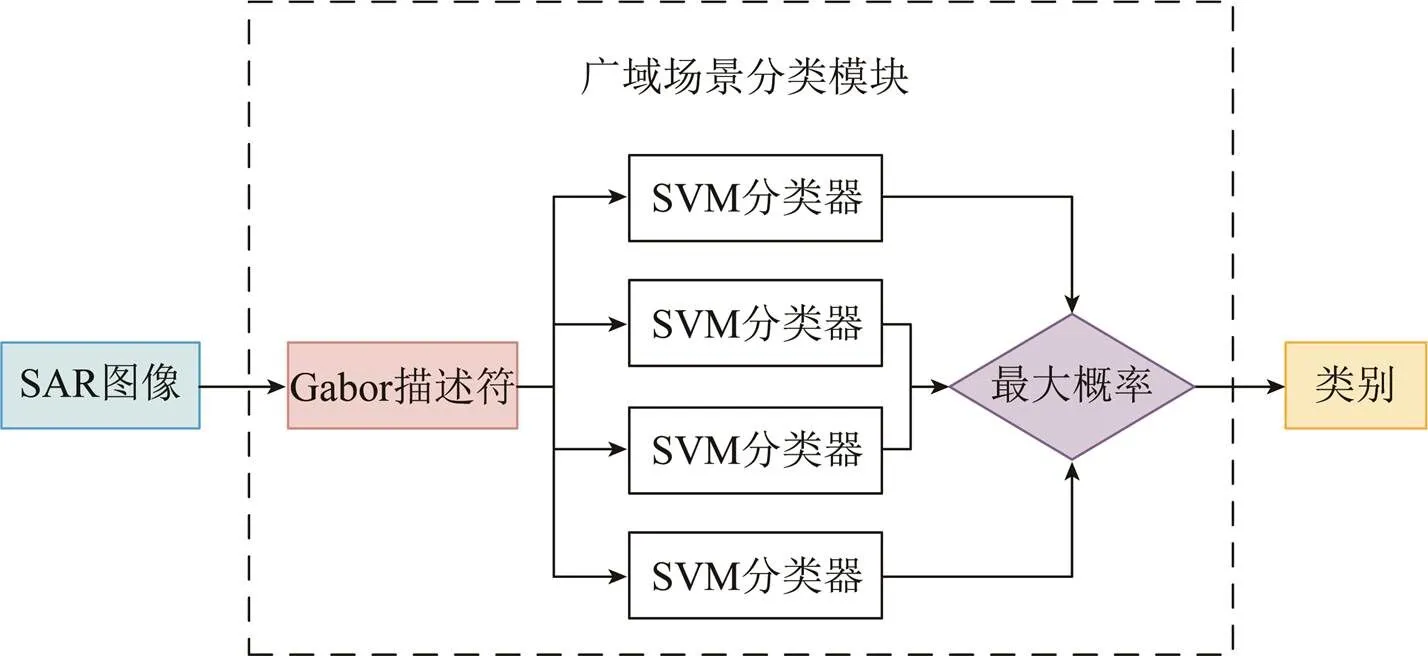

由于当前缺少基于特征分类方式构建的公开数据集,没有足够庞大的数据集去训练深度学习模型,而上述纹理强度和均匀性度量属于低维特征,本文采用SVM基于全局纹理特征对图像进行分类。

在本文的多分类问题中,使用“一对多”策略,又称为OVR-SVM[28],训练时依次把某个类别的样本归为一类,其他剩余的样本归为另一类,这样四个类别的样本就构造出了四个二元分类器。给定未知样本时,将其分类为具有最大分类函数值的类别。

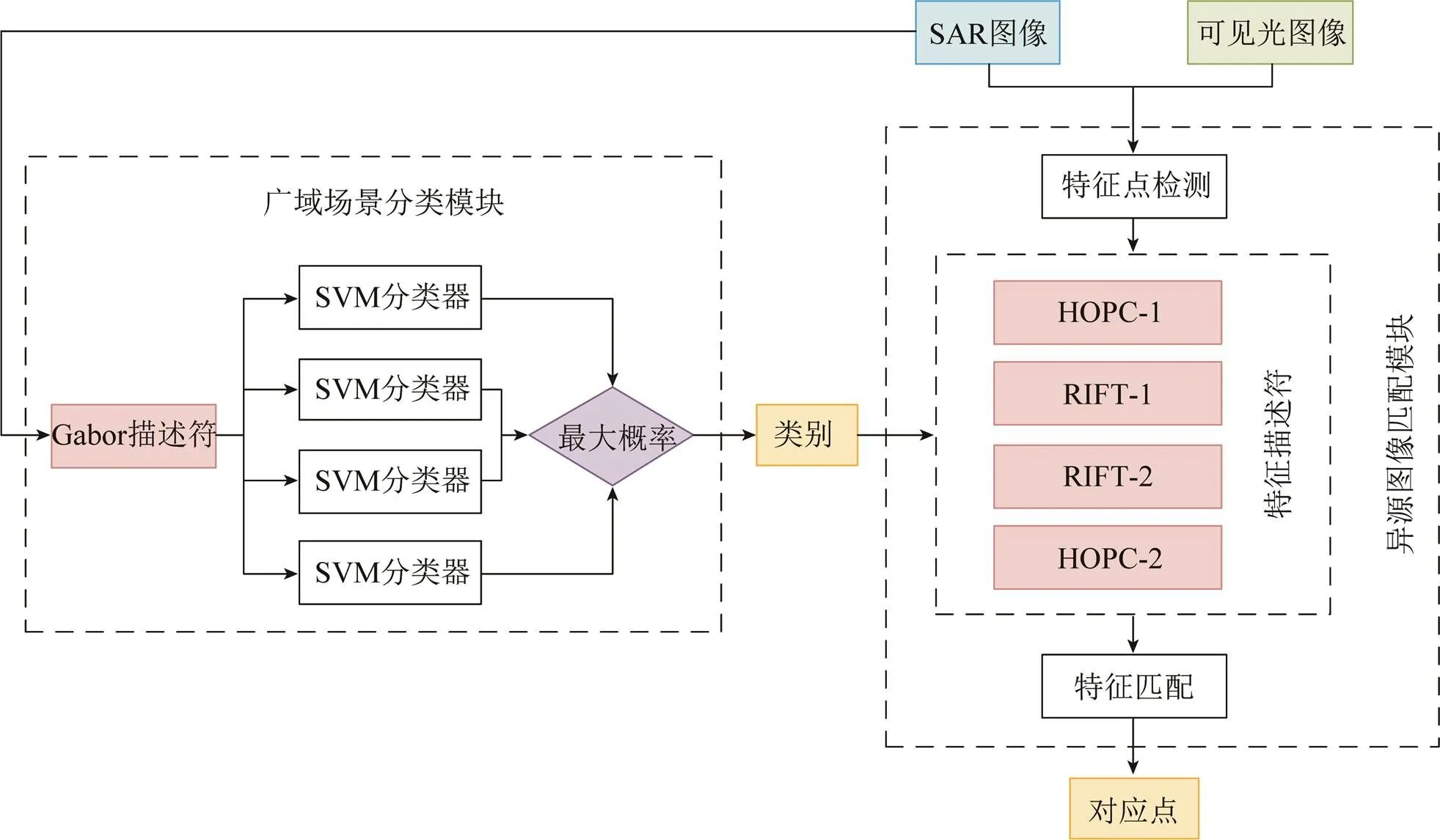

在广域场景分类模块中,使用Gabor滤波器组构建图像的全局纹理特征向量,然后训练一组SVM二元分类器进行多分类。如图2所示。

图2 广域场景分类模块

2 结合场景分类的异源遥感图像匹配方法

2.1 异源图像特征描述

结构和形状特性是相对独立于辐射变化的物理特征,通过提取不同模态中稳定的物理结构特征,并基于特征图像进行异源图像匹配,通常可用于解决可见光和SAR图像中存在的NRD问题。相比于梯度,PC特征已被证明对光照和对比度变化更具鲁棒性[15],是计算结构特征的最常用表示。基于PC特征图的常用特征描述符包括HOPC[17]和RIFT[19]已成功用在了异源图像匹配中。

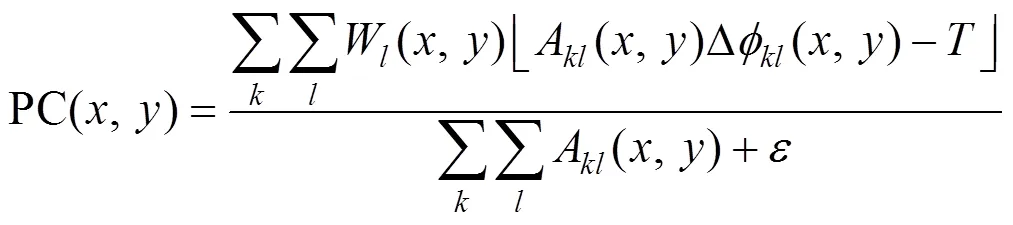

相位一致性是一种基于图像局部相位的特征检测器,边缘和角点等特征常具有高度一致的局部相位信息[29]。文献[15]使用多尺度和方向上的Log-Gabor滤波器(Log-Gabor Filter,LGF)计算了相位一致性,作者考虑了图像的噪声与模糊,改进了相位一致性的计算,使其对噪声更加鲁棒[15],改进后相位一致性表达式如下

通过计算得到相位一致性的幅值,在此基础上,文献[17]还计算了相位一致性的方向,然后使用HOG的特征框架,将梯度替换为PC,利用PC的幅值和方向构建HOPC特征。

2.2 广域场景异源图像匹配

针对SAR与可见光图像匹配中成像场景广域多样、存在非线性辐射差异等挑战,本文提出一种结合遥感图像场景分类的广域场景异源图像的匹配框架,用于提升异源图像匹配的鲁棒性和准确性,为视觉导航、图像融合以及变化检测等任务奠定基础。

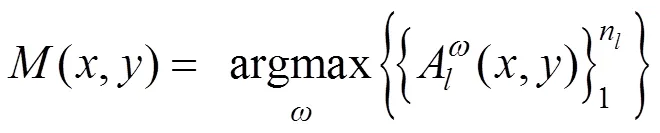

上一节介绍的两种特征描述符中,HOPC描述符构建过程中特征单元划分更具层次,利用更精细的纹理信息构建更高维的特征描述符,同时使用了幅值和方向信息,适用于纹理信息丰富的场景上,并且多层次的构建单元,使得其在一定程度上适应局部重复的纹理。RIFT描述符中使用MIM作为特征图,其特征图的构建方式一定程度上克服了特征图中有效纹理的稀疏性的缺点,对于包含无纹理和低对比度纹理的场景有着更好的鲁棒性。

为了比较了两种特征描述方式在不同类别图像上的性能,本文统一使用RIFT方法[19]的特征匹配框架,并且根据其特点用于不同类别的场景:

1)重复纹理类别:选择使用了更精细的纹理信息的HOPC作为特征描述符,记为R-HOPC;

2)非均匀纹理类别:选择使用MIM作为特征图的RIFT特征描述符;

3)弱纹理类别:同样选择使用MIM作为特征图的RIFT特征描述符;

4)混合类别:包含的场景种类丰富且混合了以上多种类别的场景特点,纹理信息较为丰富,选择使用了更精细的纹理信息的HOPC作为特征描述符。

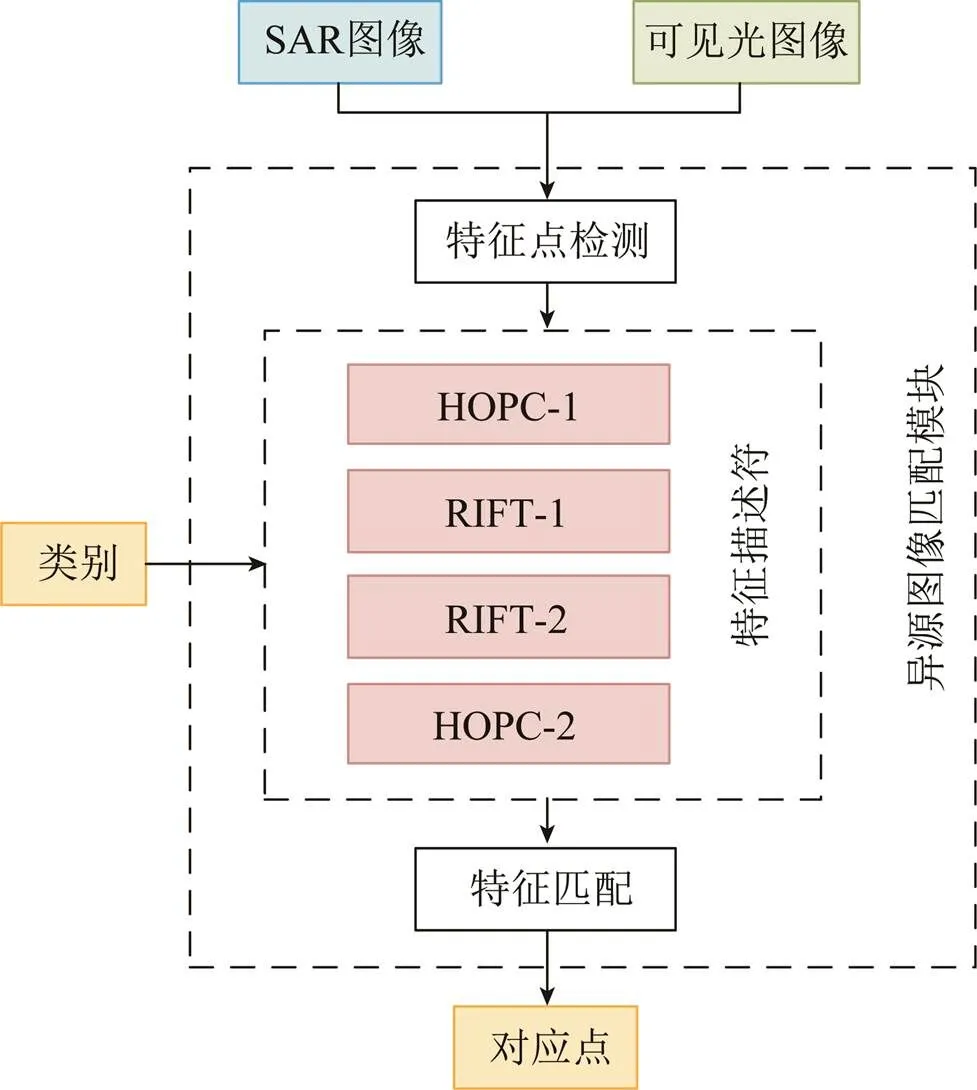

根据上面对四种类别图像的分析,可以确定广域场景异源图像匹配框架中的特征描述方法。在第3章中通过测试匹配性能来调整描述符的参数,从而确定最终使用的描述符。匹配模块如图3所示。

图3 异源图像匹配模块

广域场景的异源图像匹配框架如图4所示。

图4 广域场景异源图像匹配框架

可以看到,框架中的各部分算法都可以根据任务需求进行调整。

3 实验验证

由于目前尚未存在使用纹理分类的遥感图像数据集,因此本文使用某挑战赛数据集和实验室自有图像构建数据集,用于场景的分类与匹配测试。为了验证提出的广域场景异源图像匹配框架的有效性,本文测试了SAR图像纹理分类,R-HOPC和RIFT方法在各类图像上的匹配性能。在本章中,使用精确率和召回率指标验证分类性能,使用均方根误差和正确匹配率验证匹配性能。

3.1 数据集及评估标准

异源图像匹配数据集包含可见光与SAR图像对,均为真实非合成的图像。数据集中的可见光与SAR图像之间预先进行了全局几何矫正。数据集中的SAR图像分辨率为512像素×512像素,经过筛选保留其中325张SAR图像通过人工标注的方式构建场景分类数据集。依据场景中纹理特征分布准则,数据集的组成为:重复纹理类别55张、非均匀纹理类别67张、弱纹理类别32张以及混合类别171张。

为了测试分类器的性能,将场景分类数据集划分为训练集和测试集,测试集中包括重复纹理7张、非均匀纹理6张、弱纹理5张和混合类别10张。将与测试集中SAR图像成对的可见光图像进行裁剪,形成完全对齐一组的图像对,构成了本文的匹配测试集。

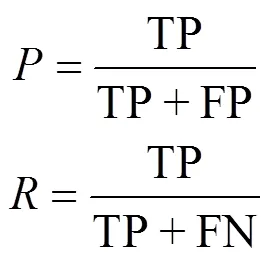

对于遥感图像分类,选取精确率和召回率的计算公式分别为

式中 TP为真阳性;FP为假阳性;FN为假阴性。

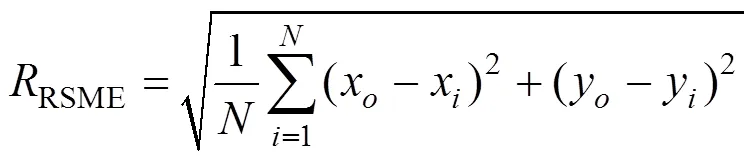

对于异源图像匹配,选取均方根误差RMSE和正确匹配率CMR作为评价标准,其中RMSE的计算公式为

CMR计算公式为

式中 CM为匹配结果中正确匹配的点对数;为匹配点对总数。只有与真值点的误差小于给定误差阈值的匹配点才被认为是正确匹配,由于不同场景匹配的难度不同,我们为每类场景选定不同的误差阈值来确定正确的匹配数[17,30]。由于本文使用的是真实数据集,对于重复纹理与混合类别的场景,匹配难度相对较低,使用较小的阈值(2像素)来确定CM;对于非均匀与弱纹理类别的场景,匹配过程非常具有挑战性,使用较大的阈值(3.5像素)来确定CM。

3.2 分类性能测试

在广域场景分类中,本文使用了两种以纹理信息构建特征描述符的方法,GIST[25]、Gabor特 征[27]和两种方式的混合记为GIST(Gabor)。在测试集上计算每个类别的精确率和召回率,将每种特征构建方法在每个类别图像上的和如表1所示。

表1 几种特征的分类性能比较

Tab.1 Classification performance comparison of several features 单位:%

由表1可知,Gabor特征描述在每类图像上的精确率和召回率均取得了最优值,分类性能最好;通过结合GIST和Gabor特征描述方式分类,性能并没有进一步的提升。另外,本文中每种特征的平均构建时间,如表2所示。

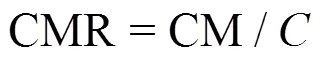

表2 几种特征的计算时间

Tab.2 Computation time of several features

可以看到,低维度的全局特征描述过程很简单,计算速度非常快,三种特征描述方式的计算时间都在20~35ms的范围,而使用Gabor特征的SVM分类器在每幅图上的预测时间为10-2ms左右,相比于匹配过程10s数量级的计算时间可以忽略不计。得到结论,Gabor特征描述取得了最优的分类性能和最快的计算速度,在广域场景分类模块中将其作为本文的特征描述方法。

3.3 匹配性能测试

本文对四类图像需要的特征描述符参数进行测试,通过调整两种描述符的参数,寻找每类图像上匹配性能最优的参数组合。在HOPC描述符中,可调整的参数有每个块内单元的大小、数量、计算方向数以及模板的尺寸,参数组合记为R-HOPC(---);在RIFT描述符中,可调整的参数有卷积滤波器组的尺度数、方向数以及图像块大小,参数组合记为RIFT(--)。

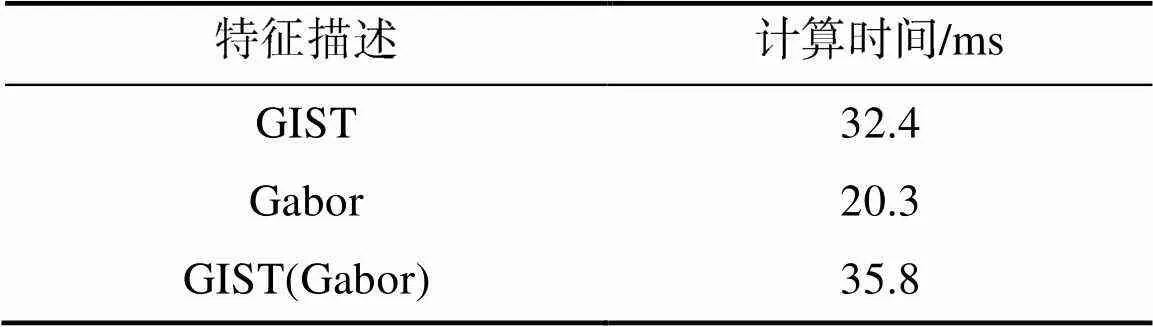

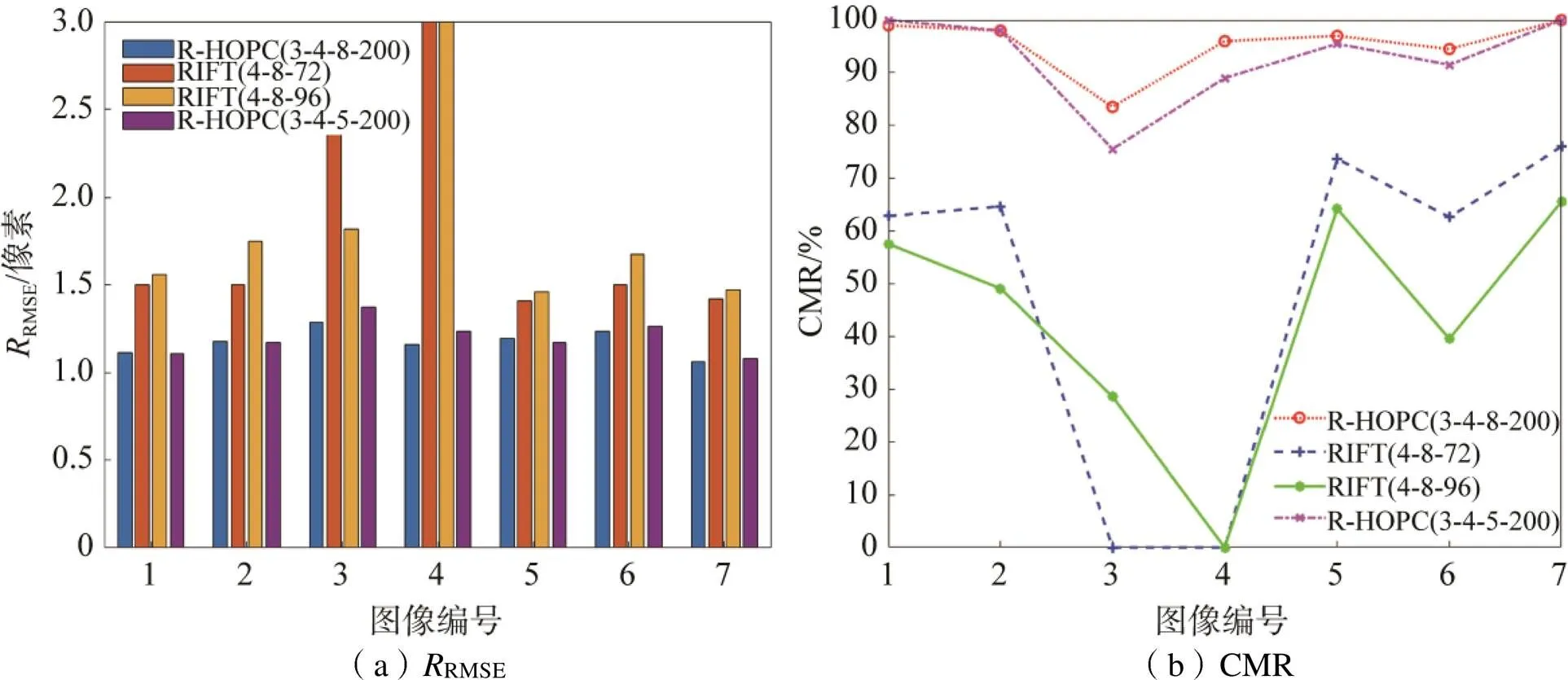

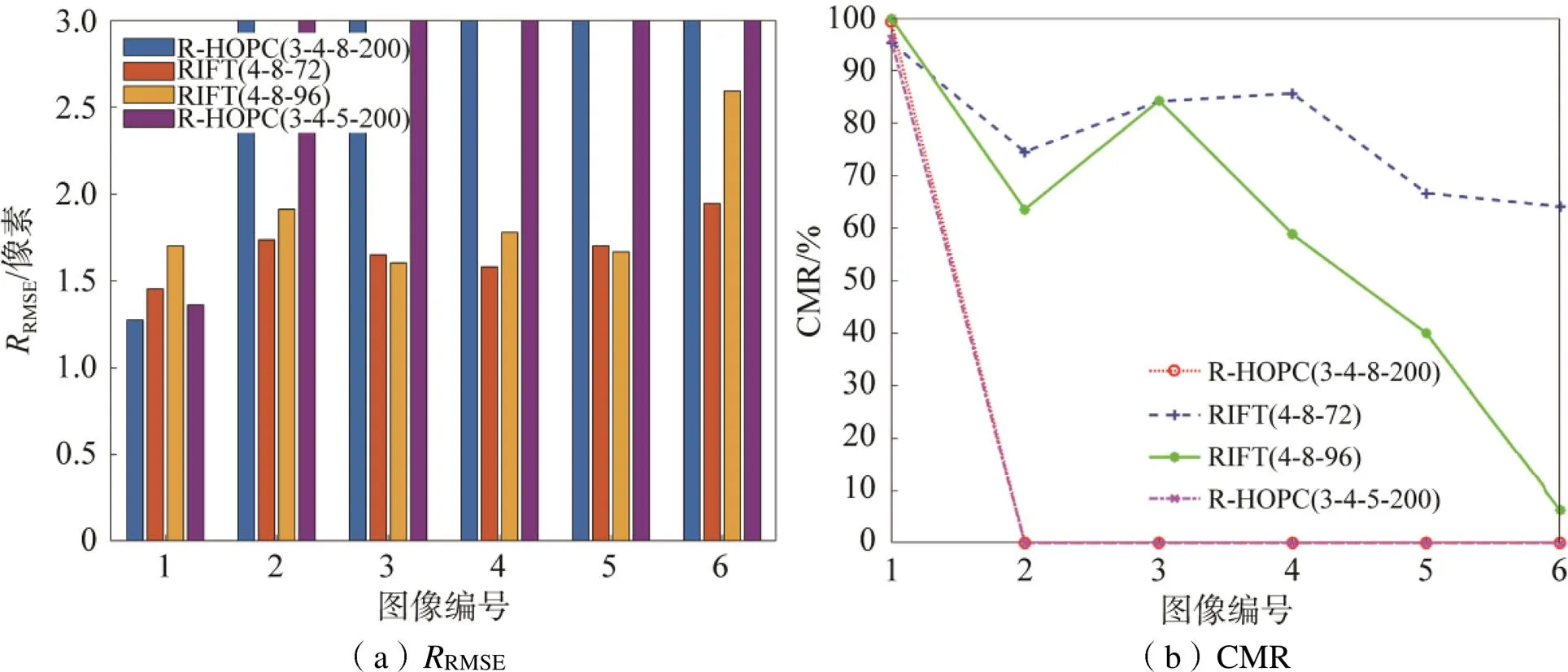

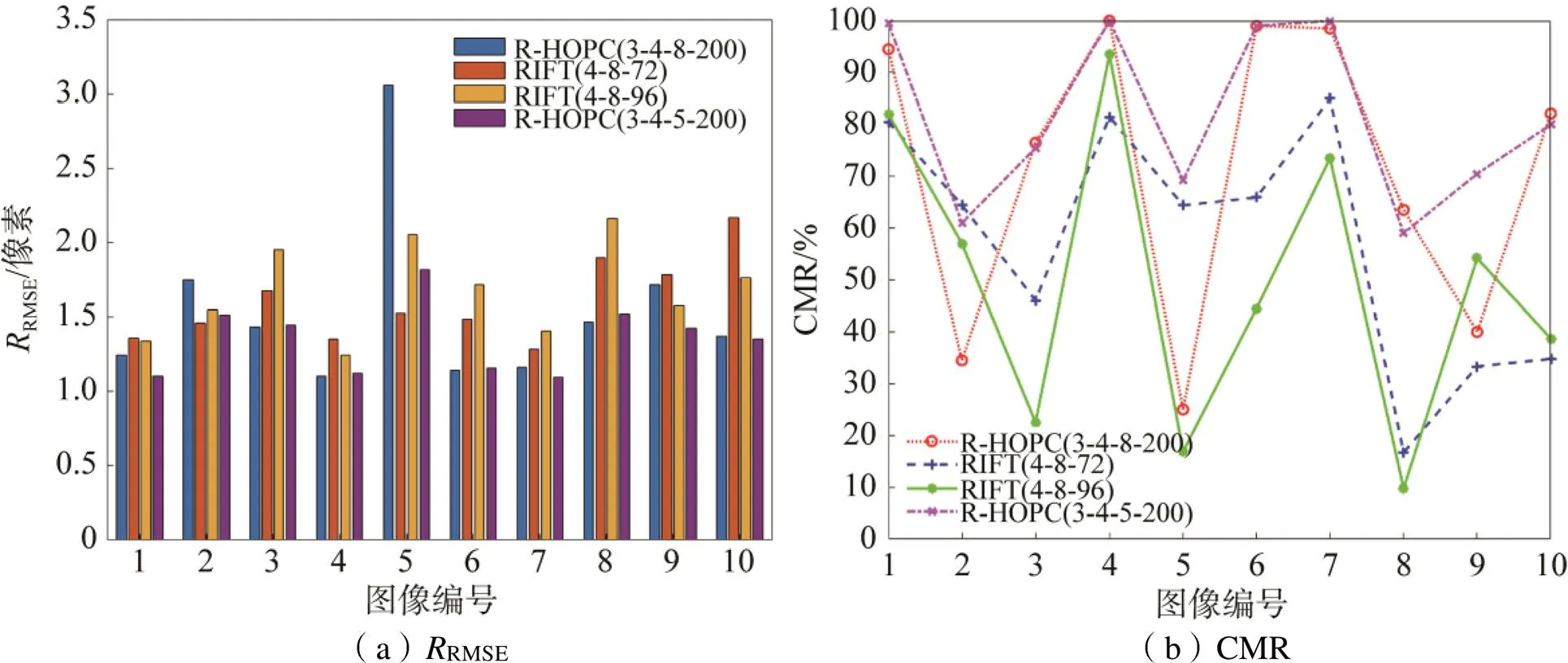

在HOPC特征描述符中,计算方向数的选择是关键参数,通过增加计算的方向数量可以提高对重复纹理的适应性,体现了方向信息在结构表征中的重要性。在RIFT特征描述符中,图像块大小的选择是关键参数;对于非均匀纹理类别,相对较小的图像块可以减轻纹理信息稀疏性对特征描述符表示性能的影响;对于弱纹理类别,适中尺寸的图像块既保证足够的纹理信息,又不会因为较多非结构纹理而降低描述符的匹配性能。本文中两种描述符参数调整过程中在各自类别场景中计算的CMR和RMSE如图5、图6所示。

图5 不同参数HOPC特征描述符的RRMSE与CMR

图6 不同参数RIFT特征描述符的RRMSE与CMR

通过图5和图6中的结果,本文推荐在四种场景的类别中分别使用参数为R-HOPC(3-4-8-200)、RIFT(4-8-72)、RIFT(4-8-96)和R-HOPC (3-4-5-200)的特征描述符。

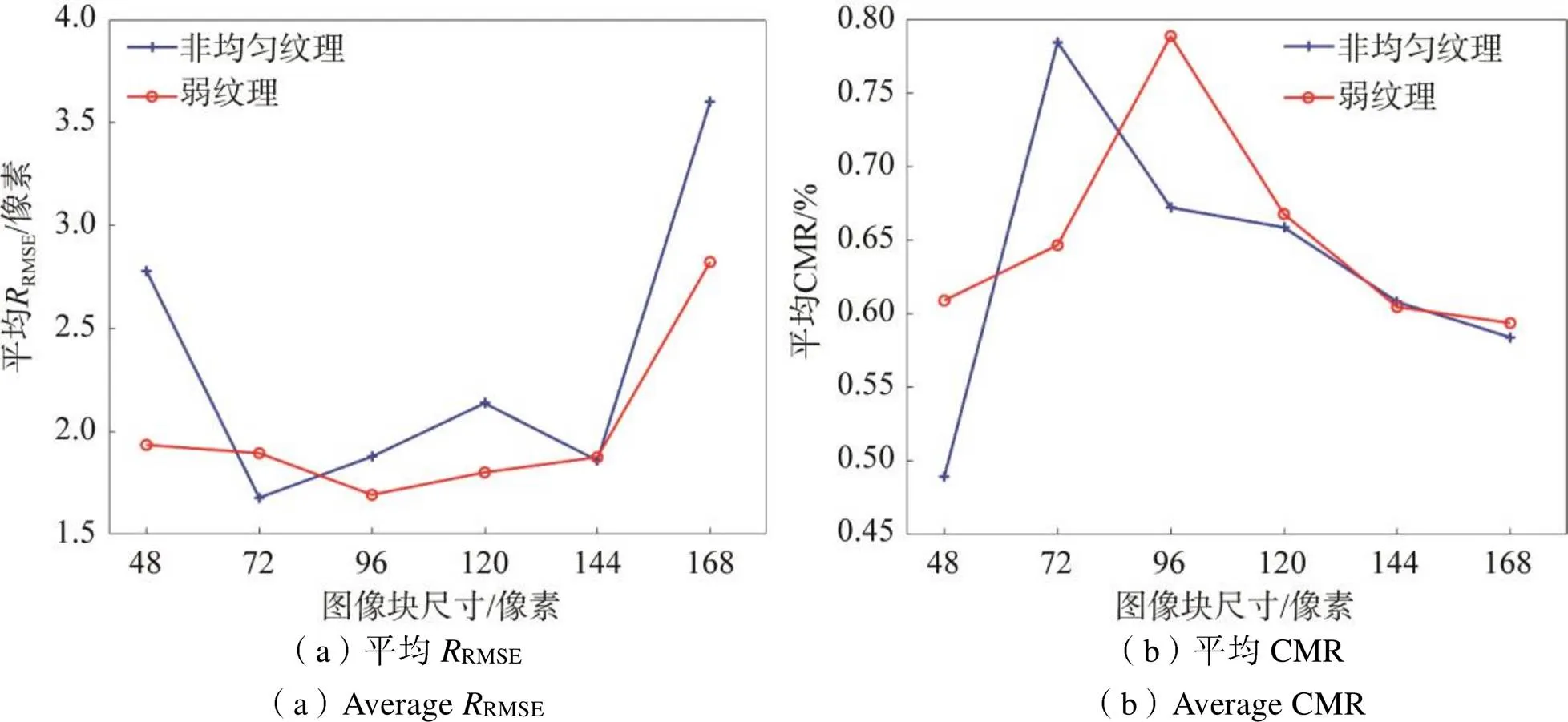

图7显示为每个类别确定的最优特征描述符在所有图像上匹配的平均RMSE(为了方便可视化,我们只保留了RMSE小于2.5个像素的区域)。由图7的结果可以验证,异源图像匹配模块中为每类图像确定的最优特征描述符在该类图像上取得了最优的匹配精度。每个类别上最优描述符计算的平均RMSE(图7中绿框选中)分别为1.175像素、1.677像素、1.691像素及1.356像素。

图7 每类图像的平均RRMSE

本文按照类别在图8~图11中显示了每对图像匹配的RMSE和CMR。

RIFT描述符直接使用特征图的直方图得到,相比HOPC的特征描述方式在重复结构上没有任何优势,从图8中可以看到其性能远落后于HOPC。四种方法计算的CMR分别为95.43%,48.56%,43.52%,92.79%。R-HOPC(3-4-8-200)的在编号为1的图像上的CMR略低于R-HOPC(3-4-5-200);但是在其余图像上均不低于R-HOPC(3-4-5-200),RMSE的趋势同CMR。综上来看,R-HOPC(3-4-8-200)方法在重复纹理类别图像上的匹配性能最优。

图8 重复纹理类别的RRMSE与CMR

在非均匀纹理类别中,无纹理区域的存在导致PC特征图中有大量零值,因此使用MIM作为特征图的RIFT描述符一定程度上避免了有效纹理信息的稀疏性,从图9(a)中(为了方便可视化,我们只保留了RMSE小于3个像素的区域)看到几乎在所有图像的匹配中得到了更低的RMSE。四种方法计算的CMR分别为16.55%,78.43%,58.82%,16.00%。RIFT(4-8-72)在编号为1的图像上的CMR略微低于RIFT(4-8-96)方法,但是在其余图像上均高于或与RIFT(4-8-96)相近,综合来看,RIFT(4-8-72)方法在非均匀纹理类别图像上的匹配性能最优。

图9 非均匀纹理类别的RRMSE与CMR

在弱纹理类别中,绝大多数的纹理为非结构性纹理,RIFT描述符通过构建MIM可以显著克服纹理低对比度的挑战,在图10(a)中(为了方便可视化,我们只保留了RMSE小于4个像素的区域)看到所有图像的匹配中得到了更低RMSE值。四种方法计算的CMR分别为15.71%,60.66%,78.84%,15.89%。从图10(b)上可以看到,RIFT(4-8-96)在编号为4的图像上的CMR低于RIFT(4-8-72)方法,但是在其余图像上均为最优且优势明显。

混合类别通常包含着上述三种类型以外的所有图像,因此单元更加精细的HOPC描述符提取的信息丰富特性得以体现。在图11(a)中观察到,R-HOPC(34-5-200)在所有图像上都取得了最低或者接近最低的RMSE。四种方法计算的CMR分别为71.36%,57.25%,49.25%,81.37%。R-HOPC(3-4-5-200)仅在编号为8和10的图像上略低于R-HOPC(3-4-8-200)方法,在其余图像上均具有领先优势。综合来看,R-HOPC(34-5-200)方法在混合类别图像上的匹配性能最优。另外该类别图像的匹配结果中还有一个很明显的特点,由于其场景种类的丰富性,计算的CMR差异很大,最高的达到100%的CMR,而最差的仅有60%左右。

图11 混合类别的RRMSE与CMR

此外,为了还原文献[17]中HOPC匹配框架的性能,本文使用了文献[17]中的设置,将归一化互相关(Normalized Cross Correlation,NCC)作为HOPC描述符的相似性度量准则即HOPCNCC,在所有类别的图像上进行了匹配性能的测试。得到了在四种类别场景的图像上计算的平均CMR分别为89.86%,50.33%,31.30%,78.80%,由上述CMR值可知,在非均匀纹理和弱纹理类别上HOPCNCC的匹配性能相较R-HOPC有明显的提升,但是与RIFT相比仍然有一定差距。

图12显示了配准结果。可以看到本文为每类场景确定的特征描述符将可见光-SAR图像对很好的对齐。

图12 配准结果的棋盘格可视化

4 结束语

本文提出了一种结合遥感图像场景分类的广域场景异源图像的匹配方法,为解决SAR与可见光图像匹配中成像场景广域多样、存在非线性辐射差异等挑战。在异源图像匹配中,现有方法无法适应广域场景的图像匹配问题。在本文提出的匹配方法中,首先将SAR图像中的场景类别分为重复纹理、非均匀纹理、弱纹理以及混合四类,受到GIST的启发使用低维的全局纹理特征对SAR图像的纹理强度和分布进行描述,然后使用一组SVM分类器对纹理特征进行分类,构成广域场景分类模块。通过对异源遥感图像匹配领域中两种较优的特征描述符HOPC和RIFT进行参数调整,为每类场景确定具有最优匹配性能的参数,并将特征描述符嵌入到同一个特征匹配框架中,组成异源图像匹配模块。

两种特征描述符的特点可以较好的适应SAR图像中常出现的几种场景类别,但是从匹配结果中也可以看到非均匀和弱纹理两种类别的图像没能取得与其余两种类别接近的性能,面临的挑战仍然是比较严峻的。在未来的工作中,将尝试对两种类别的特征检测和匹配过程进一步改进,例如在非均匀纹理类别中使用纹理丰富度掩模,在弱纹理类别中应用图像增强方法来增强轮廓或边缘特征,这些都可能有助于提高图像匹配的精度。

由于HOPC和RIFT两种特征描述符可以很好的解决NRD,适用于不同模态的图像,因此本文的方法也可以拓展到其他类型的异源图像匹配任务中。

[1] MA J Y, MA Y, LI C. Infrared and Visible Image Fusion Methods and Applications: A Survey[J]. Information Fusion, 2019(45): 153-178.

[2] JAMES A P, DASARATHY B V. Medical Image Fusion: A Survey of the State of the Art[J]. Information Fusion, 2014(19): 4-19.

[3] 陆翔, 章皖秋, 郑雅兰, 等. 特征选择的全极化SAR 影像面向对象土地覆盖分类[J]. 航天返回与遥感, 2018, 39(2): 93-103.

LU Xiang, ZHANG Wanqiu, ZHENG Yalan, et al. Object-oriented Land Cover Classification Based on Feature Selection in Quad-polarimetric SAR Images[J]. Spacecraft Recovery & Remote Sensing, 2018, 39(2): 93-103. (in Chinese)

[4] LI Q, FU B H, DONG Y F. Registration of Radar and Optical Satellite Images Using Multiscale Filter Technique and Information Measure[M]//IMPERATORE P, RICCIO D. Geoscience and Remote Sensing New Achievements. London: Intec open Limited, 2010.

[5] HONG T D, SCHOWENGERDT R A. A Robust Technique for Precise Registration of Radar and Optical Satellite Images[J]. Photogrammetric Engineering & Remote Sensing, 2005, 71(5): 585-593.

[6] XIAO G B, LUO H, ZENG K, et al. Robust Feature Matching for Remote Sensing Image Registration via Guided Hyper-plane Fitting[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 60(99): 1-14.

[7] JIANG X Y, MA J Y, XIAO G B, et al. A Review of Multimodal Image Matching: Methods and Applications[J]. Information Fusion, 2021, 73: 22-71.

[8] MORRONE M C, OWENS R A. Feature Detection from Local Energy[J]. Pattern Recognition Letters, 1987, 6(5): 303-313.

[9] SHECHTMAN E, IRANI M. Matching Local Self-similarities Across Images and Videos[C]//2007 IEEE Conference on Computer Vision and Pattern Recognition, June 17-22, 2007, Minneapolis, MN, USA. IEEE, 2007: 1-8.

[10] XIANG Y M, WANG F, WANG L, et al. OS-Flow: A Robust Algorithm for Dense Optical and SAR Image Registration[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(9): 6335-6354.

[11] YE Y X, BRUZZONE L, SHAN J, et al. Fast and Robust Matching for Multimodal Remote Sensing Image Registration[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(11): 9059-9070.

[12] DALAL N, TRIGGS B. Histograms of Oriented Gradients for Human Detection[C]//2005 IEEE Conference on Computer Vision and Pattern Recognition, June 20-25, 2005, San Diego, CA, USA. IEEE, 2005: 886-893.

[13] XIANG Y M, WANG F, YOU H J. OS-SIFT: A Robust SIFT-like Algorithm for High-resolution Optical-to-SAR Image Registration in Suburban Areas[J]. IEEE Transactions on Geoscience & Remote Sensing, 2018, 56(6): 3078-3090.

[14] FAN B, HUO C L, PAN C H, et al. Registration of Optical and SAR Satellite Images by Exploring the Spatial Relationship of the Improved SIFT[J]. IEEE Geoscience & Remote Sensing Letters, 2013, 10(4): 657-661.

[15] KOVESI P. Image Features from Phase Concurrency[J]. Journal of Computer Vision Research, 1999, 1(3): 1-26.

[16] FAN J W, WU Y, LI M, et al. SAR and Optical Image Registration Using Nonlinear Diffusion and Phase Congruency Structural Descriptor[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(9): 5368-5379.

[17] YE Y X, SHAN J, BRUZZONE L, et al. Robust Registration of Multimodal Remote Sensing Images Based on Structural Similarity[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(5): 2941-2958.

[18] LIU X Z, AI Y F, ZHANG J L, et al. A Novel Affine and Contrast Invariant Descriptor for Infrared and Visible Image Registration[J]. Remote Sensing, 2018, 10(4): 658.

[19] LI J Y, HU Q W, AI M Y. RIFT: Multi-modal Image Matching Based on Radiation-variation Insensitive Feature Trans-form[J]. IEEE Transactions on Image Processing, 2020(29): 3296-3310.

[20] YE Y X, LI S, HAO M, et al. Robust Optical-to-SAR Image Matching Based on Shape Properties[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(4):1-5.

[21] SEDAGHAT A, EBADI H. Distinctive Order Based Self-similarity Descriptor for Multi-sensor Remote Sensing Image Matching[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2015(108): 62-71.

[22] XIONG X, XU Q, JIN G W, et al. Rank-based Local Self-similarity Descriptor for Optical-to-SAR Image Matching[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 17(10): 1742-1746.

[23] YANG Y, NEWSAM S. Spatial Pyramid Co-occurrence for Image Classification[C]//2011 IEEE International Conference on Computer Vision, November 6-13, 2011, Barcelona, Spain. IEEE, 2011: 1465-1472.

[24] 于梦馨, 刘波, 汤恩生. 改进粒子群算法优化SVM参数的遥感图像分类[J]. 航天返回与遥感, 2018, 39(2): 133-140.

YU Mengxin, LIU Bo, TANG Ensheng. Remote Sensing Image Classification Based on Improved PSO Support Vector Machine[J]. Spacecraft Recovery & Remote Sensing, 2018, 39(2): 133-140. (in Chinese)

[25] OLIVA A, TORRALBA A. Modeling the Shape of the Scene: A Holistic Representation of the Spatial Envelope[J]. International Journal of Computer Vision, 2001, 42(3): 145-175.

[26] 杨迎港, 刘培, 张合兵, 等. 基于特征优选随机森林算法的 GF-2 影像分类[J]. 航天返回与遥感, 2022, 43(2): 115-126.

YANG Yinggang, LIU Pei, ZHANG Hebing, et al. Research on GF-2 Image Classification Based on Feature Optimization Random Forest Algorithm[J]. Spacecraft Recovery & Remote Sensing, 2022, 43(2): 115-126. (in Chinese)

[27] NEWSAM S, WANG L, BHAGAVATHY S, et al. Using Texture to Analyze and Manage Large Collections of Remote Sensed Image and Video Data[J]. Applied Optics, 2004, 43(2): 210-217.

[28] BOTTOU L, CORTES C, DENKER J S, et al. Comparison of Classifier Methods: A Case Study in Handwritten Digit Recognition[C]//1994 IEEE International Conference on Pattern Recognition, October 9-13, 1994, Jerusalem, Israel. IEEE, 1994: 77-82.

[29] KOVESI P. Phase Congruency Detects Corners and Edges[EB/OL]. [2022-03-15]. https://www.docin.com/p-782365141.html.

[30] YE Y X, YANG C, ZHANG J C, et al. Optical-to-SAR Image Matching Using Multiscale Masked Structure Features[J]. IEEE Geoscience and Remote Sensing Letters, 2022(19): 1-5.

An Optical-to-SAR Remote Sensing Image Matching Method for Wide Area Scene

WANG Qinwei1,2LI Zhang1,2,*JIANG Yuntian1,2BIAN Yijie1,2ZHAO Hong1,2YE Yibin1,2

(1 College of Aerospace Science and Engineering, National University of Defense Technology, Changsha 410073, China)(2 Hunan Provincial Key Laboratory of Image Measurement and Vision Navigation, Changsha 410073, China)

Accurate optical-to-SAR image matching plays a fundamental role in typical remote sensing applications such as visual navigation and image fusion. Current image matching methods mainly focus on imaging differences such as the nonlinear radiation distortion (NRD). The differences of remote sensing image scene are not fully considered in common image matching procedure, which limits the adaptability of image matching methods for different scenes. To address the issues of wide-area image scenes and imaging modality differences in optical-to-SAR image matching, this study proposes a multimodal image matching framework with wide-area image scene classifier. The classifier is built on texture features and used to classify the images into four typical scenes (repetitive texture, non-uniform texture, weak texture and mixed classes). Then we select the corresponding feature descriptor for image matching process for a certain scene. The proposed method is compared with two commonly used optical-to-SAR image matching methods on the public dataset. The proposed method can achieve the best matching results for all typical scenes without increasing the calculation time, which provides a solution for optical-to-SAR remote sensing image matching for wide area scene.

optical image; synthetic aperture radar image; wide area scene; feature descriptor; multimodal image matching; scene classification; remote sensing application

V445

A

1009-8518(2022)05-0109-14

10.3969/j.issn.1009-8518.2022.05.011

2022-05-23

国家自然科学基金(61801491);中国博士后基金项目(2021M693972)

王钦炜, 李璋, 江云天, 等. 面向广域场景的可见光-SAR遥感图像匹配方法[J]. 航天返回与遥感, 2022, 43(5): 109-122.

WANG Qinwei, LI Zhang, JIANG Yuntian, et al. An Optical-to-SAR Remote Sensing Image Matching Method for Wide Area Scene[J]. Spacecraft Recovery & Remote Sensing, 2022, 43(5): 109-122. (in Chinese)

王钦炜,男,1998年生,2020年获南京理工大学兵器科学与技术专业学士学位,现在国防科技大学航空宇航科学与技术专业攻读硕士学位。主要研究方向是可见光与SAR图像匹配。E-mail:wqw20@nudt.edu.cn。

李璋,男,1985年生,2015年获得代尔夫特理工大学生物医学工程专业博士学位,国防科技大学空天科学学院应用力学系研究员。主要研究方向是图像测量与视觉导航。E-mail:zhangli_nudt@163.com。

(编辑:庞冰)