面向注意力增强和特征选择的多目标跟踪算法

2022-08-11殷向阳李树辉陈禹铭

殷向阳,李树辉,陈禹铭,文 峰

(沈阳理工大学 信息科学与工程学院,沈阳 110159)

多目标跟踪技术涉及计算机视觉、图像处理、机器学习、深度学习等多种技术领域,其以计算机视觉中的目标检测技术为基础,结合其他数据关联技术实现图像中目标与历史轨迹匹配关联,完成对图像中目标的检测与跟踪,通过与人体行为分析、异常姿态检测等视觉任务的结合可广泛应用于安全防护、自动驾驶、智能机器人等[1-3]领域。

多目标跟踪算法利用多任务学习方法,将目标检测与重识别(Re-Identification,Re-ID)任务通过特征图共享的方式完成图像中目标的位置检测及外观特征的提取。此类方法将目标检测和Re-ID任务融合到一个模型中,减少了网络参数量,加快了模型推理速度,目标跟踪速度较快,可达到实时处理效果。这种多任务学习方法可以在速度和精度之间有一个较好的权衡,但是也存在弊端。简单地将多任务学习直接应用于多目标跟踪会导致对特征图的优化冲突:对于目标检测部分,网络希望强化同类别对象的表示相似性,而Re-ID任务负责提取目标外观特征,其希望最大化同类别不同对象之间的差异,因此两任务相反的优化方向阻碍了多目标跟踪的效果。

为解决上述问题,引入一个基于空间注意力和通道注意力的特征增强模块,将骨干网络输出的特征图进行空间和通道上的注意力提取,增强特征的感知信息,得到表达能力更强的特征图;使用一种简单高效的特征选择模块,将特征图分解为适用检测和适用Re-ID任务的两种特征图,以缓解检测任务和Re-ID任务学习方向相反问题,有效提升跟踪质量,降低ID切换次数。

1 多目标跟踪算法

目标检测是视觉任务的基础,以带有解耦头部的目标检测网络YOLOX为骨干网络的研究已经成为一种趋势[4-6]。目前以目标检测为基础的多目标跟踪算法可以分为两类:基于检测的目标跟踪算法与联合检测和Re-ID的目标跟踪算法。

基于检测的多目标跟踪算法获得图像中目标的位置,其数据关联方法大部分基于运动学,如卡尔曼滤波[7],利用上一帧轨迹通过卡尔曼滤波预测在当前帧出现的位置,并通过匈牙利匹配算法[8]得到匹配结果。基于检测的目标跟踪算法仅通过目标的位置信息进行轨迹匹配,在遮挡、打闹等运动行为难以预测的情况下无法进行有效跟踪。

联合检测和Re-ID的目标跟踪算法通过目标检测得到目标的位置信息和外观特征,利用目标的位置信息和外观信息综合计算进行目标和轨迹的关联匹配。多目标跟踪和分割框架(Multi-Object Tracking and Segmentation,MOTS)[9]在基于掩膜的两阶段目标检测网络顶部添加了一个Re-ID头,对于每个目标得到一个回归框和Re-ID特征。文献[10]提出一种基于一阶段目标检测的多目标跟踪算法(Joint Detection and Embedding,JDE),首先通过在一阶段目标检测框架添加Re-ID头得到目标的位置信息和外观特征,再通过跟踪算法DeepSort[11]进行数据关联,从而实现多目标跟踪。基于无锚框检测器及多层特征融合的多目标跟踪算法(Fair Multi-Object Tracking,FairMOT)[12]认为基于锚框的目标检测器不适合作多目标跟踪任务,于是使用无锚框的目标检测网络作为检测器,该方法在目标跟踪算法竞赛上取得了优异成绩。上述方法均为检测与Re-ID多任务学习模式,存在两任务相反的优化方向,阻碍跟踪效果。

2 本文算法网络模型

2.1 总体结构

本文算法的模型框架结构如图1所示。

图1 基于注意力增强和特征选择的多目标跟踪算法框架

由图1可见,本文算法框架包括联合检测和Re-ID框架、跟踪器两部分。联合检测和Re-ID框架包括三部分:第一部分是骨干网络,负责特征提取,输出特征图;第二部分是注意力增强和特征选择模块,将骨干网络输出的特征图输入该模块,分别生成适合检测和Re-ID任务的特征图;第三部分为网络头部,包括检测头和Re-ID头。检测头使用YOLOX的解耦头部,输出目标的类别、位置及置信度;Re-ID为新增分支,负责输出每个目标的外观特征。跟踪器负责数据关联,将当前图像检测结果与历史轨迹进行匹配,使用DeepSort作为数据关联方法。

2.2 注意力增强模块

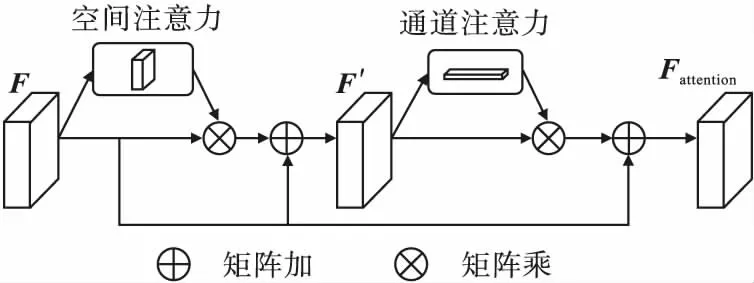

跟踪过程中检测质量低、ID频繁切换的问题由特征表达能力弱、信息提取不充分造成,本文在骨干网络之后引入注意力增强模块,该模块结构如图2所示。

图2 注意力增强模块结构图

注意力增强模块的输入特征图为骨干网络输出的特征图,表示为F∈RC×H×W,其中R表示实数集,C表示特征图通道数,H和W分别表示特征图的高度和宽度。本文注意力增强的设计利用了残差网络的短路连接方式与空间、通道注意力增强结合的方式。该模块首先将骨干网络输出的特征图进行空间注意力增强,并将得到的空间注意力权重与原特征图相乘后再进行短路连接,为特征图进行每个像素点的权重计算,即空间注意力。将上一步的计算结果F′经过通道注意力增强后得到通道注意力的权重,并与F′相乘,与原特征图进行短路连接,目的是计算特征图每个通道的权重并进行分配,最后输出该模块的增强特征图Fattention。上述过程的计算表达式为

F′=f1(F)·F+F

(1)

Fattention=f2(F′)·F′+F

(2)

式中f1和f2分别代表空间注意力和通道注意力操作。该模块捕获空间注意力和通道注意力,通过提炼关键特征提高检测质量、降低ID切换次数,进而提升跟踪的准确度。

空间注意力结构如图3所示。

图3 空间注意力结构图

(3)

式中:Concat是特征图拼接操作;Conv是3×3卷积。

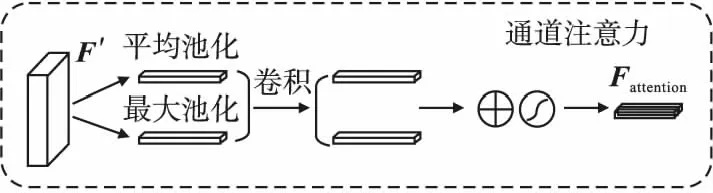

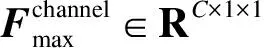

利用通道注意力模块对通道特征进行权重分配,其结构如图4所示。

图4 通道注意力结构图

(4)

2.3 特征选择模块

引入特征选择模块解决检测任务和Re-ID任务存在的特征图优化冲突问题。通过挖掘特征间的关联性,提取并融合特征图的全局信息,分别得到检测特征图和Re-ID特征图,记为Fdet和Freid。特征选择模块的具体结构如图5所示。

图5 特征选择模块结构图

该模块包括两个部分,产生全局信息特征向量Z与生成检测特征图Fdet和Re-ID特征图Freid。

(5)

式中Wk代表1×1卷积计算。

(2)将全局信息特征向量分别经过两组不同的卷积、激活函数Mish、群组归一化GN、卷积操作,得到适合检测和Re-ID任务的特征向量。将得到的特征向量和特征图Fattention进行广义相加,得到Fdet和Freid。上述过程的计算表达式为

Fdet=Conv(Mish(GN(Conv(Z))))+Fattention

(6)

Freid=Conv(Mish(GN(Conv(Z))))+Fattention

(7)

2.4 检测分支

检测分支沿用YOLOX的检测头结构,其结构如图6所示。

图6 检测分支结构图

检测分支输入特征图尺寸为H×W×128,其中128为特征图通道数,得到三组平行输出结果:Cls头、Reg头和Obj头,分别为所属类别、预测框的坐标信息、是否存在物体判别结果,图中M表示检测类别数。

检测分支损失函数Ldet由三个头部的损失函数Lcls、Lreg和Lobj组成。Lcls和Lobj均通过二值交叉熵计算,Lcls计算式为

(8)

式中:N代表当前图像中目标数量;yi表示第i个目标真实类别;p(yi)表示第i个目标的类别预测值。同理可求Lobj。

(9)

(10)

式中:IOUi表示第i个预测框和真实框的交并比;Pi表示第i个目标的预测框;Gi表示第i个目标的真实框。

2.5 Re-ID分支

本文通过新增与检测分支平行的Re-ID分支提取目标外观信息。Re-ID分支对输入特征图进行卷积操作,得到检测目标对应的外观特征,流程如图7所示。

图7 Re-ID分支结构图

Re-ID分支损失函数Lid计算公式为

(11)

式中:K代表ID总数量;pid(k)表示预测为第k类的概率;Li(k)表示第i个目标真实的one-hot标签。由此可得

L=Ldet+Lid

(12)

式中L为本文算法最终损失函数,以此进行反向传播计算。

3 实验

3.1 数据集

相比于JDE、FairMOT和基于互关联网络与尺度感知注意力的多目标跟踪算法(Cross-correlation and Scale-aware Track,CSTrack)[13]使用多数据集混合训练,本文实验仅使用其中两个行人跟踪数据集:CrowdHuman和MOT17,其中CrowdHuman场景中行人更为密集,使用MOT17测试集评估效果。使用COCO[14]数据集训练的模型作为预训练模型。本文和其他目标跟踪算法的比较实验使用CrowdHuman和MOT17训练集训练80轮,输入图片尺寸大小为1440×800,数据增强方法包括Mosaic和Mixup,模型在两块16GTesla V100 显卡上训练72小时,一次训练样本数设置为4,优化器使用SGD,权重衰减为5×10-4,动量设置为0.9,初始学习率设置为10-3,使用余弦退火学习率优化方法。

3.2 评估指标

评估指标采用度量集CLEAR-MOT Metrics。其中MOTA代表跟踪的精确度,其综合考虑轨迹中误检、漏检和ID切换,MOTA值越高,表示跟踪效果越好;IDF1综合考虑ID的准确率和召回率,与MOTA不同的是,IDF1中更加重点关注ID信息,而MOTA仅仅考虑了ID切换信息,所以IDF1对轨迹中的ID信息准确性更敏感,而MOTA更偏向于检测效果;IDs表示多目标跟踪中ID切换次数;MT表示被跟踪到的真正轨迹与全部真正轨迹数量的比值;ML表示丢失的真正轨迹与全部轨迹数量比值,一条轨迹被跟踪到20%以下就可被判定为丢失;FPS表示每秒处理帧率,即推理速率。

3.3 消融实验

为验证提出的注意力增强模块和特征选择模块的效果,消融实验将MOT17训练集分割成两部分,一部分用于训练,另一部分用于效果评估。结果如表1所示,表中展示了增加Re-ID分支的YOLOX作为基线方法(Baseline)的前提下,增加各模块对模型的影响。

表1 消融实验

由表1可以看到,当Baseline增加注意力增强模块时,MOTA提升1.4,IDF1提升0.6,IDs减少69,但FPS降低了约0.6,说明注意力增强模块可以明显提升特征图的表达能力,略微降低推理速度。当Baseline增加特征选择模块后,MOTA上涨0.4,IDF1提升0.2,而IDs降低了75,可以发现特征选择模块成功地解耦出适合各任务的特征图并且缓解了优化冲突问题。以上两组实验结果说明增加注意力增强和特征选择模块均可以不同程度地对检测效果和ID切换问题进行优化,其中注意力增强模块对MOTA提升效果更好,而特征选择模块对ID切换问题优化更显著。同时增加注意力增强和特征选择模块后,MOTA提升1.6,IDF1提升1.0,IDs减少89,虽然FPS降低1.0,但其速度仍超越目前主流跟踪器,并且达到实时处理效果。实验证明,注意力增强和特征选择均可以一定程度上提升检测质量,减少ID切换数。

3.4 目标跟踪算法比较

本文算法与检测跟踪同时进行的多目标跟踪算法CenterTrack[15]、CSTrack、使用额外数据集训练的CSTrack(CSTrack++)方法、FairMOT在MOT17测试集上做对比实验,仅使用CrowdHuman和MOT17训练集训练,效果即超越了上述几种多目标跟踪算法。对比实验结果如表2所示。

表2 不同方法在MOT17测试集下结果对比

表2的实验结果证明了注意力增强和特征选择模块的有效性,且推理速度也处于领先状态。本文方法在私有检测器MOT17测试集上达到了78.6的MOTA,MT也取得了新高49.2%,同时FPS达到了28.4的推理速度,值得注意的是,表2中其他方法均为近年来最先进的方法,而本方法在MOTA、MT远远领先的前提下,FPS也达到了实时推理速度。

4 结论

针对目前一阶段方法中存在的特征信息提取不充分和检测、Re-ID任务之间优化冲突的问题,引入注意力增强和特征选择模块解决该问题。注意力增强模块通过丰富待提取特征的感知信息提高检测精度,进而提升跟踪的精度和准确度;特征选择模块缓解一阶段方法中检测和Re-ID任务优化冲突的问题。在MOT17测试集上的对比结果表明,该算法有效提高了整体跟踪效果,对于ID切换问题提升显著,MOTA达到了78.6,且达到了实时推理速度,具备较强的跟踪性能。