基于改进GoogLeNet网络的时空双流乒乓球动作识别

2021-12-17张傲于洪霞

张傲 于洪霞

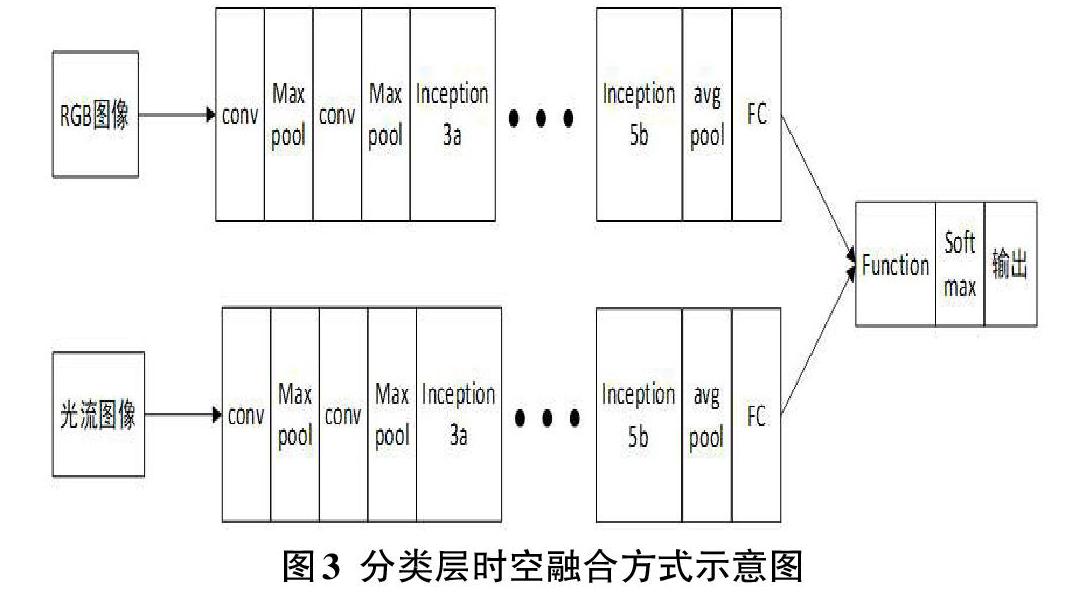

摘要:针对乒乓球运动视频中人体动作具有连续性,需要有效地提取时间维度上的运动信息,提出了基于改进的GoogLeNet作为基础网络框架,搭建了时空双流卷积神经网络进行乒乓球动作识别。对GoogLeNet网络进行内部参数优化和网络结构改进。该方法以RGB图像作为空间网络的输入,光流图作为时间网络输入,选择加权的特征融合方式在分类层进行时空特征融合。在UCF101中的乒乓球动作视频以及自制数据集上进行实验,通过实验表明,本文提出的乒乓球动作识别方法最终识别准确率可以达到98.88%,该方法提高模型的训练速度同时提高了模型的识别能力的。

关键词:人体动作识别;GoogleNet网络;双流网络

中图分类号:TP311 文献标识码:A

文章编号:1009-3044(2021)33-0078-03

开放科学(资源服务)标识码(OSID):

1 引言

随着深度学习技术的日益成熟,基于深度学习的人体动作识别广泛受到国内外研究学者的关注。运动类视频中的技术动作检测是计算机视觉领域在体育方面的重要应用,其中乒乓球运动其技术特点鲜明,对于单个人体动作技术识别分类具有显著优势。通过运动视频中对双方运动员动作技术的识别分类,对运动员技术分析和战术安排有着重要作用。因此基于深度学习的乒乓球人体动作识别有着重要研究意义和应用价值。

乒乓球运动的动作识别其本质属于人体动作识别分类范畴。卷积神经网络被引入到视频领域进行动作识别。2014年,Karenx[1]等人首次提出了基于双流神经网络的人体动作识别方法,在ImageNet来进行预训练,利用RGB单帧和光流图训练双流网络,最后融合进行动作识别。2016年Wang等人[2]在经典双流网络的基础上,提出了时间段网络(TSN),结合稀疏时间采样策略与视频监督方法。2014年ILSVRC挑战赛冠军GoogLeNet网络被提出,其在传统深度卷积神经网络的基础上加入多个inception网络模型的结构。

對视频中的人体动作进行识别一直是计算机视觉领域中具有挑战性的研究,人体动作识别除了需要提取图像中外观场景等空间信息外,有效地提取时间维度上的运动信息也很重要。因此本文结合双流思想,构建了基于双流New GoogLeNet卷积神经网络的乒乓球动作识别算法,并采用加权融合的策略将空间流提取的场景特征和时间流提取的运动特征进行特征融合[3],从而提高了模型的泛化能力和乒乓球动作识别的准确率。

2 时空双流卷积网络模型构建

双流New GoogleNet网络的结构可以分为空间流和时间流这两种通道。双流卷积神经网络比传统卷积神经网络优势在于,其对视频数据中时间信息特征的捕捉更加清晰且高效。对于单帧RGB的空间信息一般主要表达出的特征为事物的坐标位置以及固定场景,而对于时间信息中,在多个光流帧的连续运动形式下可以传递出更多的目标连续动作信息。空间流和时间流两个通道都应用同一网络对特征图像进行训练,随后通过时空特征融合实现动作识别。

2.1 GqoogLeNet网络

GoogLeNet是由Christian Szegedy于2014年提出的深度学习网络结构。GoogleNet不同于之前的网络AlexNet[4]、VGG16[5](通过增大网络的深度来获得更好的训练效果),而GoogLeNet不但加深网络深度同时还拓宽了网络的宽度。Inception作为GoogLeNet网络中最核心的结构,在Inception中将单一卷积核改变为卷积核配合池化层并用的模式,其中的卷积核为三组并行卷积核(1*1,3*3,5*5),池化层为单个池化层。且每路在卷积操作之前或者池化操作之后都紧跟着一个1*1的卷积操作。可以在相同的尺寸的感受视野中叠加更多的卷积,能够提取更丰富的特征,1*1的卷积还能达到降维的效果,降低了计算的复杂度,提升了网络的性能。因此本文针对乒乓球动作识别选取GoogLeNet网络作为基础网络进行改进。

2.2 GoogLeNet网络结构改进

本文对GoogLeNet网络从Inception模块内部优化、批量归一化算法选择、激活函数的选择、引入Dropout以及在分类层中选择改进后的AM-softmax分类器等方面进行内部参数优化和网络结构改进。其中对于网络中Inception模块的结构改进最为重要。

GoogLeNet网络结构分别在浅层中加入Inception3模块,中层Inception4模块,以及深层Inception5模块,其中原始网络结构中对于该模块结构进行统一设定相同结构。由于加入的Inception模块拥有着较大的卷积核,导致参数过大。因此本文将原有传统的浅层的Inception3模块进行了适当的结构优化。将浅层的Inception3删除5*5的卷积核,增加3*3卷积核的通道数,同时将3*3改成3*1和1*3,使计算速度更快速。

在改进了浅层的Inception3模块之后,中层的Inception4模块进行更大的结构改进,由于中层模块对于特征提取相对于浅层更加重要,因此要保留完整的卷积操作使特征提取更加显著的同时加快计算速度。先将原有传统的中层Inception4模块结构中5*5大小的卷积核进行改进。将两个3*3大小的卷积核依次连接所组成的新的卷积层小网络取代原有的大卷积核结构。同样对中层Inception 4模块结构中两个离输出图形更近的3*3大小的卷积核使用3*1和1*3两种卷积核串行来代替。随后将模块中的滤波器组进行扩展,使得网络结构更宽而不是更深,这样减少维度,使神经网络的性能会更好,较适合于乒乓球运动人体细微动作幅度这样的高维特征。因此在计算速度更快的同时,调整以后模型的准确率相比之前更高。

对于深层的Inception5结构,本文保留该模型的原来结构,因为在网络的深层中卷积核的空间集中性会下降,相对较大的卷积核提取的特征较为抽象,因此适合应用于网络的深层。

2.3参数选择及优化

(1)选择CN批归一化。改进后的Inception网络结构在每个卷积操作之后将统一进行CN批归一化,CN归一化方法可以更好的避免梯度消失等问题。相对于原有的BN归一化的泛化性会更加的强。

(2)选择激活函数。在浅层网络中选择Leaky-Relu激活函数,中层后选择ELU激活函数,从而以结合优秀的激活函数来达到更高准确率的目的。

(3)引入Dropout层并选择最优比例。通过最大值池化操作后依次进入改进的两个浅层Inception3模块,结构优化后的5个中层Inception4模块,以及两个拥有较大卷积核的高层Inception5模块,随后进行了全局的平均池化,在全连接层引入Dropout层选择最优的Dropout比例为0.5。

(4)通过AM-Softmax分类器对特征图像进行分类输出。由于该分类器对于不同动作特征的类间距更大,类内距更小,因此选择基于Softmax进行算法改进的AM-Softmax分类器运用于乒乓球动作识別,使局部动作分类效果更佳显著显。

以上对于GoogLeNet网络进行改进后的New GoogLeNet网络相对于原有的基础网络的性能更加优化。

2.4时空特征融合设计

本文对于视频中乒乓球运动的动作识别所选择的时空融合策略进行设计,选取在分类层的融合方式进行特征融合。双流网络分类层的融合方式是在经过全连接层之后在后期的分类层中进行特征融合。前期过程应用改进NewGoogLeNet神经网络对单帧RGB图像和堆叠的光流图像进行处理,双流网络分别提取运动视频中的空间特征和时间特征,并且两个网络间进行权值共享,在NewGoogLeNet网络中经过卷积、池化、全连接层等操作后,在分类层将两流的特征进行融合。该方法在两个网络间加入权值参数共享的方式可以增强两种不同特征在参数学习时的相互联系,同时也降低训练成本。在网络的后期进行融合主要原因是考虑RGB图像和光流图像间的独立性,对于时空双流的各自特点分别进行更明确的提取。

本文采用加权融合法在分类层进行特征融合。对于加权融合方法,可以表示为将空间特征和时间特征定义不同权重分配后进行相加和。对于特征融合使用加权融合方法将时间流网络和空间流网络进行融合,加权融合权重比例为时间:空间=6:4,融合时机选择在分类层进行融合。

3实验设计与结果对比分析

3.1乒乓球数据集建立

本文的实验数据集为UCF101公开数据集以及自制乒乓球数据集。UCF101数据集中乒乓球运动类视频有143个,自制数据集为109个,所有视频内容包括大量的乒乓球持拍对打,视频中角度多样,光照信息场景信息变化多样,视频的像素较低,且视频长度较短。根据本文对于乒乓球技术特点的分析要求,将短视频划分为四个类别:(1)正手攻球(2)反手攻球(3)正手搓球(4)反手搓球。本文所用的UCF101数据集以及自制乒乓球数据集分别将视频数据格式通过分帧处理成RGB格式,以及通过Lucas-Kanade算法进行光流图像处理。

3.2实验步骤

本文实验仿真部分在tensoflow平台上进行实验验证,网络的训练实验在UCF101数据集及自制数据集上进行,空间流网络的输入为T=5帧的RGB图像。时间流网络的输入为连续叠加L=10的光流图像。在网络训练中迭代批量大小每次为100个,动量设置0.9。本次实验总共进行了60轮epoch,网络迭代到18000次时,网络停止训练。

3.3实验结果对比

综上所述,使用加权融合方法按权重比例时间:空间=6:4将时间流网络的运动特征和空间流网络的场景特征在后期AM-Softmax分类层时进行融合后,此时特征融合双流New GoogLeNet卷积神经网络的乒乓球动作识别的平均准确率达到了98.88%,损失函数值为0.4523。识别率高于其他网络模型。

4 结论

本文提出的时空特征融合的双流New Googlenet卷积神经网络的乒乓球人体技术动作识别有效地加快了模型的训练速度,提高了模型的识别能力以及泛化能力。

参考文献:

[1] Simonyan K, Zisserman A. Two-stream convolutional networks for action recognition in videos[C]//Advances in neural information processing systems,2014:568-576.

[2] Wang L, Xiong Y, Wang Z, et al. Temporal segment networks: Towards good practices for deep action recognition[C]//European Conference on Computer Vision,2016:20-36.

[3] 王婵娟.利用特征融合的行为识别方法研究[D].赣州:江西理工大学,2018.

[4] You Y,Zhang Z,Hsieh C J et al.100-epoch ImageNet Training with AlexNet in 24 Minutes[J].Journal of Jinggangshan University,2016,33(6):1020-1026.

[5] Simonyan K,Zisserman A.Very Deep Convolutional Networks for Large-Scale Image Recognition[J]. Computer Science,2014,36(1):231-235.

【通联编辑:梁书】

\