融媒直播云平台的设计研究

2021-08-04罗列异

罗列异

(浙江广播电视集团新蓝网,浙江 杭州 310000)

0 引言

5G时代的来临,依托移动网高速低延时的传输能力、云计算弹性伸缩的扩展能力、音视频超高清实时编码能力以及AR/VR人工智能无限想象力,5G+4K/8K、5G+VR等多种创新性技术形态应运而生。2020年在新冠肺炎疫情的催生下,直播教育、直播带货、远程视频办公等云直播产业更是异军突起,直播已从传统广电行业迅速拓展到社交、教育、旅游、购物等多个领域。

1 系统架构

传统广播电视直播借助于演播室导播切换台,对摄像机、转播车等专业摄录设备采集的视音频信号进行导播切换、特技处理后播出。为了满足多样化的直播体验,在直播中借助于虚拟演播室或利用大屏技术及前置虚拟技术,实现AR/VR沉浸化的虚拟体验。

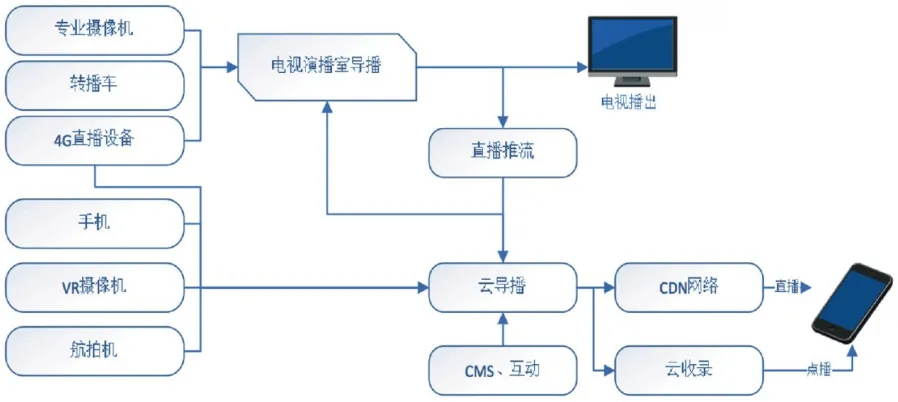

融媒直播云平台由云直播、云导播、云编辑、云收录、短视频制剪、AR/VR人工智能处理等直播功能模块构成,构建采、编、录、发、播一站式、全链路、全方位的直播能力,并提供延时、垫播、转码等相关各类辅助工具。如图1所示。

图1 网络直播流程图

融媒直播云平台具有以下特点:

(1)融合多场景:满足传统广电直播和网络直播的融合应用场景,实现融媒跨域直播。网络直播信号能提供给演播室进行电视互动直播,电视直播信号能通过编码推流提供网络直播。

(2)兼容多协议:兼容传统摄录设备推流、4G/5G直播设备以及手机、VR设备、无人机航拍等网络直播设备源,适配多协议的流格式和码率,提供不间断的HLS/RTMP流媒体直播服务,满足手机、电脑端直播播放的要求。

(3)智能化处理:通过人工智能技术和服务,搭建起智能化的业务生产和应用场景模型,实现AR/VR、语音识别、人脸场景识别等常规业务难以实现的能力。

2 研发实现

融媒直播云平台核心是实现直播流传输编码、导播合成切换以及解码播放技术。

2.1 导播技术

为了做到帧精度的导播切换,编码传输的视音频流经过解封装、解码两套流程解出视音频帧,输入给导播切换的核心过滤器。过滤器不仅能实现对各路输入流的无缝切换,同时还能够叠加辅助信息,如字幕、台标等信息,最终经过编码、封装后输出。

在导播算法模型设计上,切换精度和码流格式是实现关键。首先,对多路音视频源进行归一化处理,转换为统一的分辨率和码率,并归一化时间戳、解码时序和播出线程,保障了多路视音频源在解封装解码切换时的整体一致性,达到帧精度。切换是人与系统交互的过程,播出线程会实时从在播音频和视频的帧队伍中取出音视频帧压入播出PGM队列中,然后输出给处理单元进行视频变换,最后编码、封装合成后播出。

过滤器单元除了导播切换功能外,还具有特技能力,实现对输入帧变换功能,视频翻转,旋转,缩放等。过滤器核心采用了libavfilter库。过滤器使用有过滤链Filterchain和过滤图Filtergraph两种方式,前者适合单链条一对一视音频处理流程,后者适合于overlay等多对一,多对多的复杂视音频处理。

2.2 解码播放技术

解码播放技术难点是解决好音视频的时序问题,处理好声画同步。正常编码时视频数据和音频输出是交替写入的,解码时音视频可以同步解码。为了提高编码效率,引入双向预测内插编码帧(Bframe)。FFmpeg在AVFrame帧结构定义上加入PTS和DTS两个字段[2]。PTS定义解码后的视频帧显示的时间戳,而DTS定义了视频流送入解码器解码的时间戳。考虑到音频没有B帧,解码时序单一,在音视频同步播放算法中以音频为基准,视频同步到音频时间。播放流程启动四个线程[1]:

(1)时间线程:提供系统统一的时钟,控制系统播放时间的精确运行。

(2)解封装解码线程:为各路音视频源解码、解封装为视频帧和音频帧,装入各自队列。

(3)音频渲染流程:按序把音频帧送入声卡播放,提取音频流PTS,并动态更新系统当前播放时间。

(4)视频渲染线程:按序取出视频帧,提取PTS时间。设定门限为±1/2fps,如果PST在播放区间内则进行视频帧渲染,如果PTS超出播放区间则降低播放速率,反之进行丢帧处理。

3 融合人工智能

借助了人工智能能力,通过机器学习和深度学习,建立起更具智能的直播云平台业务场景模型,满足常规业务无法实现或难以实现的能力,让云平台更智慧、更省心、更懂你。

3.1 语音识别和实时字幕

国内科大讯飞、百度、腾讯等主流云服务商的语音技术识别率均已经达到95%以上。AI云服务商提供实时语音服务首次识别延时1s左右,根据语义环境最终识别在4s左右,识别率高,能较好地满足直播业务需求,并为现场直播提供实时字幕,提升直播效果。

主流实时语音字幕能力实时性要求强,客户端边上传,服务端边识别。对音频帧实时发送给AI服务商,同时接收进程实时获取转义文字内容,本地进行分句后输出字幕内容,通过在线包装合成,叠加到直播视频上。

3.2 场景和人脸识别

人物识别在直播应用中有着极其广泛的应用。比如直播人物字幕流程,当关键人物进入画面后,手动拍出提前准备好关键人物字幕条,传统方式无法实现突发事件及无法预测场景。通过人工智能技术,建立可能出现的关键人物库,通过脸部识别技术自动识别人物,并自动输出人物字幕条。建立面部识别库,一类基于Dlib、dnn为主流的离线识别,另一类是百度、腾讯、讯飞为主流的在线识别。以离线识别库为例,对比Dlib使用卷积神经网络(CNN)和方向梯度直方图(HOG),CNN方法准确度高,但速度慢,而HOG方法速度快,但准确性有所下降。启动GPU cuda加速能力后CNN计算时间大大缩小,HOG和CNN时间相仿。

3.3 实时短视频制作

直播目的为了更好、更快地传播热点内容的聚焦和时效性,直播中需要快速提取热点和亮点内容制成短视频,通过App或者社交媒体快速传播,如果采用传统手动流程,往往耗时耗力。

借助于转语音能力,文字内容与视频内容的位置是对应的,选择所需文字内容就能够确定视频片段的出入点,实现基于文字内容的人工智能快速拆条。

借助于人物识别能力,可以准确获得焦点人物出现的时间,实现基于人物的人工智能拆条。后台根据焦点人物在镜头中出现的准确时间点,快速生成短视频。

4 应用实践

融媒直播云平台不仅适用于活动、电商、游戏等直播场景外,人工智能+云端直播方式也赋予了更广泛、更新颖的应用场景及业务模式。

(1)云综艺录制/直播:新冠肺炎疫情对直播产业催生了不少创新应用。伴随5G技术的成熟,云综艺真正实现了多地多机位互动的录制直播,参与录制节目的嘉宾无需到演播室现场,只需通过视频设备和云综艺软件就可以实现跨越空间的互动演绎。

(2)VR直播:特指环视VR直播,以相机为中心向周围拍摄[3];利用VR摄像机拍摄,然后编码推流直播。观众佩戴VR眼镜可以720度环视,有着身临其境的临场感,更具感染力和真实感。以往,VR直播无法突破的原因是带宽、实时高清编码以及VR眼镜。5G+8K技术突破了网速和画质的限制,让VR直播产业化发展扫清了障碍。VR演唱会、VR云观赛、VR云旅游等均为VR直播的典型应用。

(3)子弹时间:指环物VR直播,以被拍摄物为中心,相机环绕被摄物拍摄[3]。采用时间凝结技术,现场布置一套有若干台与被拍摄物在同一聚焦平面上,但彼此时间码同步,可以依次触发的摄像机组成的360度环绕拍摄制作系统,用户不需要戴眼镜就能观看到运动或静止中的人或物不同视角的瞬间,整体效果炫酷完美[4]。典型应用为竞技类体育赛事、舞蹈演唱会等场合。

(4)直播带货:近年来直播带货异军突起,开辟了直播及短视频变现盈利的新途径。通过直播手段重构“人、货、场”三要素,具有强互动性、社交性和高转化率。为了提高商品到消费者触达率,调动购买热情,借助VR直播模式,提供沉浸式购物体验,如临现场,让直播与消费完美结合。

5 结束语

融合了人工智能的能力,直播系统更智能、更高效、更人性化,同时也会加速直播产业业务形态和模式的创新发展,催生业务向更具有创新性的领域发展。