载人航天发射场电力仪表在线异常检测模型研究

2019-01-10张道昶郑永煌胡永刚

张道昶,郑永煌,胡永刚

(中国酒泉卫星发射中心,兰州 732750)

1 引言

载人航天发射场地勤系统包括加注、非标、配电、空调、通信、电视等专业,承担着航天发射地面保障工作,是发射场系统的核心职能之一。为了确保精准化任务保障,各系统安装有大量的传感器和仪表,以获取必要的信息。日常的监测、设备的操控均依赖这些传感器采集的信息实现准确处理,但信息测量的准确性通常很难判断。一方面,传感器和仪表数量过于庞大,比如配电系统,整个发射场相应仪表、互感器的数量超过3000台,因此,无论人力还是时间,都难以逐个进行有效标定;另一方面,绝大多数传感器和仪表由于拆除困难、标定工作过于繁琐等因素,难以在现场标定。一直以来,如何准确、及时发现损坏失灵的传感器都是制约发射场信息化发展的关键环节。

从现有技术研究和发射场实际条件看,实现在线校验的难度非常大,目前尚没有良好的解决方案。但是,虽然无法直接对仪表进行准确地标定,如果能够及时、自动发现失灵的仪表,然后再由人工进行标定检测,在实际中也很有意义。本质上,仪表的检测问题是对仪表测量数据本身的异常检测。

异常检测是数据处理中的一项重要内容,主要通过分析当前样本与以往经验分布差异,以判断样本是否“异常”。异常检测是许多数据深度应用的基础,被广泛的应用于故障检测[1]、疾病筛选[2-3]、设备监测[4]、网络安全[5]等领域。从文献看,异常检测经典方法的主要思想是通过建立当前参数与训练样本统计分布之间的各种距离实现异常的检测,常见的如欧式距离和统计距离[6-8]等。近几年,学者开始利用机器学习的识别分类、空间聚类等手段[9-11]实现异常的监测,并取得了不错的结果。

但是,這些常规的异常检测针对的是仪表数据代表的设备状态,即通过分析仪表参数来判断设备状态,而我们希望是通过分析仪表的参数来判断仪表本身,这二者有本质的区别。在这个意义下,直接、孤立的分析仪表的数据是难以找到仪表异常特征的。

应注意到,仪表背后的设备数据是相互有关联的,通过建立各参数之间的关联模型,直观上看,通过关联模型的变化就可以检测各仪表状态的变化。基于这个思想,发射场最先采用经典最小二乘方法,利用配电系统进出平衡理论,估算各仪表传递误差模型。但该模型难以充分利用海量数据把模型的精度和泛化能力得到有效的统一,且模型精度高,计算复杂度大幅增加。

深度学习是当前机器识别中的重要分支,在人工智能中,特别是视觉处理、语音识别、自然语言理解等传统方法难以获得突破领域的出色表现,使其成为国内外学者研究的热点[12]。深度学习有两个重要特点:①具有强大的样本学习能力,可以轻松处理海量和异构样本,即大数据处理能力出色;②通过多层分解,能够对样本的深层特征进行自然的表征和分层,从而获得与人类大脑相似的学习过程,解决了传统机器学习中需要人工设计特征的问题[13-14],适应不同类型的学习问题。近年来,许多学者开始研究其在异常检测的应用,并取得了较好的效果[16-17]。

本文从这一思想出发,利用深度学习在大数据处理能力和特征提取的自动化等优良特性,基于Google TensorFlow框架,以多层感知模型为基础,建立基于深度学习的发射场电力仪表在线异常检测模型,并通过与经典最小二乘方法的对比验证其有效性。

2 电力仪表测量误差分析

从电力仪表测量的误差的来源看,误差主要有以下几个方面[18]:

1)互感线圈测量误差;

2)测量仪表解析误差;

3)线路损耗带来的误差。

误差的形式包括:

1)电流误差,互感线圈在测量电流时所出现的数值误差成为电流误差或比值差,它是由于存在励磁电流引起的实际电流与额定电流比不相等造成的;

2)相位误差,一次电流与二次电流相量的相位之差成为互感线圈的相位误差。

需要注意的是:电流、电压的误差是向量,但功率误差是标量,即进线电流和电压的点积与出现电流、电压的点积理论上相同;如果采用电流误差作为检测点,不仅要考虑电流有效值的误差,还要考虑相位角的误差,会大幅增加问题分析的难度。因此,本文以功率差异为分析基础,在对仪表进行测量误差校订时就可只专注于标量误差的检测,而无需考虑向量问题。

图1为某工作时段发射场某配电站动力回路进出负荷的对比及相应的差值误差和相对差误差的曲线,相对偏差为实际偏差与进线测量值的比值。可见,理论上,通过对比进出负荷的差异可以评估仪表工作的状态。但是,不能直接从进出负荷的差值来作为仪表异常检测的依据,因为:①无论是绝对差值还是相对差值,均随着负荷变化而变化,难以形成稳定的检测量,检测结果比较粗糙;②容易形成漏检,从逻辑上讲,出线仪表如果出现正负偏差,则由于求和的相互抵消,难以体现在其偏差中。同时,由于实际数据时间对齐误差以及进、出线仪表灵敏度差异等原因,差值的随机噪声很大,难以直接通过差值分析仪表状态的变化。

图1 仪表监测数据进出线的负荷差值对比分析Fig.1 Comparison of the output and input load obtained from the meters

发射场原来采用经典最小二乘模型,通过分析各回路工作仪表的工作状况发现:①各回路主要工作在固定的几个工况,工作模式相对固定;②工作范围远低于其额定负荷,且有效范围相对其额定范围较小。基于此,可以假定各回路满足线性误差传递关系,建立式(1)所示优化函数:

(1)

X=BA-1

(2)

其中:

3 基于深度学习的估计模型

本文以TensorFlow框架为基础,针对现有样本的特点,设计多层感知(MLP、也称DNN深度神经网络)训练模型,并通过实测数据训练,建立仪表的异常检测模型。

3.1 算法设计

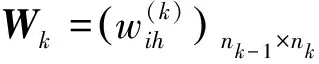

MLP是包含有多个隐含层的多层感知器,包括输入层、隐含层、输出层。依据现有数据的特点,设计1个输入层,2个隐含层和1个输出层。考虑到预处理数据特征相对简单,为降低计算的复杂度,同时避免结果的过拟合,本文设2个隐含层,其基本过程如图2所示。输入层为各分支回路测量的功率。根据计算结果的情况,调整隐含层节点的数量。

图2 多层感知器结构图Fig.2 Structure of multilayer perception

对于输入层有I个单元,输入样本(x,z),设计从输入层到隐含层、输出层正向传递公式如式(3):

(3)

(4)

与最小二乘方法处理不同,输入层包含所有已有回路,利用深度学习的特性,通过尽可能的扩大训练样本的范围,来直接从数据中找到模型。输出的损失采用式(5)所示损失函数:

(5)

若E为(5)式定义的均方差损失函数,该模型反向误差传递各层参数的更新公式为式(6):

(6)

3.2 实验验证

实验的主要过程是以公式(5)为损失函数,通过大量的样本训练,找出合适的权值系数Wk和bk。数据的来源主要来自发射场历年系统记录的数据。数据记录采用3分钟均值方式,但不同仪表之间数据记录时间并不同步。

3.2.1 数据预处理

对数据的预处理主要包括数据缺失的补全策略(即丢点处理)、数据噪声的处理以及数据时间对齐的处理。

1)丢点处理。由于记录时,有回路不工作时,现场操作手会关闭相应回路的仪表,造成数据长度不同。此时,采用插值对齐,如某个仪表产生大范围数据丢失,由于样本插值推广能力非常差(亦称泛化能力),在外延估算时将会产生巨大的偏差,而且其偏差扩散的速度是不可控的。本文采用外延补点采用补零的办法。

2)噪声处理。由图1可以看出,除了常规的进出仪表精度的差异造成监测数据不同外,数据大部分噪声出现在数据变化剧烈的部分,主要原因应在于对齐操作存在的横向时间偏差,即对齐误差。这种非对齐即包括出线间样本的对齐度,也包括进线和出线之间的对齐度。关于对齐的度量,本文定义如下:

定义1(对齐度):若C为采用周期为T的样本集,若Xi∈C,对任意固定采样周期区间,Δj为Xj∈C相对该周期的偏移量,称i=∑j∈I,j≠iΔj/n-1为C相对第i回路的偏移量,n为回路数量,I为回路指标集。称/T为C的对齐度。

在此定义下,降低弱化非对齐产生的噪声最有效的办法就是下采样平滑,即临近样本整合平均方法。关于这点,本文定义如下命题:

由定理1可知,通过整合平均的方法可以有效降低对齐误差产生的影响。但过度平滑会导致数据特征弱化,因此,一般取k=2或3,此时平滑对对齐度提升效果明显,但特征仍能够尽可能得到保留。

3)对齐操作。对每个回路进行降采样后的数据三次样条拟合,然后利用进线仪表记录的时间进行插值计算,获得与进线仪表相同的时间对齐数据。

3.2.2 验证计算

本文通过对2016年80天共36125条测量数据进行训练,涵盖全年四个季度的工作工况。通过不断的调整和试算,得到如下TensorFlow各项训练参数:学习率:0.001;训练循环次数:500;子样本大小:100;隐含层节点数:32。根据经验,权值W和偏置b的初始值采用0均值方差为0.1的正态分布。

选择2016年到2018年不同时期实测数据估计的结果如表1,每个数据合计20天,其中原有偏差是指原始数据计算所得实际偏差;深度方法是指用MLP深度算法估计后计的偏差结果;经典方法是指用公式(2)得到的结果。

表 1 测试集对不同时段实际仪表监测数据的估计结果

从表1结果可以看出:利用2016年数据训练的结果来估计2016年到2018年的测试样本,模型对于偏差估计都远优于实际偏差;而最小二乘经典方法明显误差比深度方法来的大,且2016-12月份和2017-10月份的数据还超过了实际的偏差,说明经典模型适应性较弱。

从偏差看,经过深度模型计算,原始数据偏差大幅度降低,且偏差的改善效果各年与2016年没有显著性发生变化,说明设备运行一年多后,状态没有发生明显变化。

训练结果对2017年12月底数据估计结果的对比如图3,上图为估计值与原始值、进线值三个值的比较,下图为其中一段差值结果的堆栈图。从图上可以直观的看出,深度学习估计的模型对于数据有非常好的拟合和估计能力。

图3 深度模型对于测试数据的估计效果Fig.3 The estimated effect of the deep learning model on test data

此外,深度学习对于大样本处理非常方便,模型的适应性较经典方法有大幅增加。

深度算法能够取得较好的结果,在于其对模式的学习:仪表数据测量结果形成一个一维向量v,当相同的工作状态频繁出现时,v就成了代表这个工作模式的特征。非线性神经网络的最大特点,就是善于提取这样的特征。深度学习在图片识别中取得的较好结果,与此机理上是相同的。

4 结论

本文针对发射场设备监测仪表的在线检测问题,以配电系统为例,利用深度学习模型,提出了一个新思路。从实际数据的验证结果来看,可以捕捉数据中的非线性特征,有强大的学习能力,能够做到大样本训练,且推广能力和估计精度随着样本训练数量的增加而增强,可以做到二者兼顾。文中的仿真结果也充分证明了模型的有效性。其不足之处在于,深度算法训练出的模型不够直观,内涵不如经典模型清晰。

另外,首先,检测都是以学习样本中的基本信息为标准,即哪怕学习样本中某仪表本身就存在较大偏差,但检测结果只能说明当前仪表与学习样本中的状态没有发生大的差异,因此训练样本中的数据应当选择仪表统一人工校验后的数据,以确保检测的准确性;其次,当前模型目前只能判断某一区域是否存在异常仪表,但具体异常的仪表,尚无法明确定位,还要进行针对性的检测。这同时也是我们今后研究的方向。