应用卷积网络及深度学习理论的羊绒与羊毛鉴别

2017-12-26靳向煜东华大学纺织学院上海20620东华大学纺织面料技术教育部重点实验室上海20620

王 飞, 靳向煜,2(. 东华大学 纺织学院, 上海 20620; 2. 东华大学 纺织面料技术教育部重点实验室, 上海 20620)

应用卷积网络及深度学习理论的羊绒与羊毛鉴别

王 飞1, 靳向煜1,2

(1. 东华大学 纺织学院, 上海 201620; 2. 东华大学 纺织面料技术教育部重点实验室, 上海 201620)

为解决羊绒与羊毛纤维图像难以鉴别的问题,提出一种基于卷积网络和深度学习理论的鉴别方法。使用sigmoid分类器将卷积深度网络提取的纤维图像特征进行粗分类,根据验证集合验证结果并记录网络的最优权重。根据整体的分类网络所获取的权值,对每张样本图片使用改进的局部增强整体的网络模型提取局部特征,并对局部特征和整体特征进行融合,根据这些融合特征建立新的分类网络。在此基础上,使用鄂尔多斯标准羊绒与羊毛数据集对网络进行50轮次的迭代训练,得到的最优准确率达92.1%。实验结果表明:采用深度卷积网络表征纤维,并对羊绒羊与毛纤维图像进行分类的方法,能够有效解决羊绒、羊毛等类似纤维鉴别问题;若用于商业检测,还需更多数据集的验证。

羊绒; 羊毛; 图像鉴别; 卷积网络

由于羊绒和羊毛的物理表征极为接近,二者的鉴别一直是纺织领域的难题。目前业界常用的羊绒与羊毛鉴别方法有扫描电镜法[1],近红外光谱鉴别法[2],脱氧核糖核酸(DNA)分析法[3],电子显微镜纤维表征传统计算机技术测量法[4-5]等。传统的基于计算机图像处理技术的羊绒与羊毛鉴别方法,通过计算机测量纤维表面形态一些特征的量化值对二者进行鉴别,如纤维直径、鳞片高度、鳞片厚度等,但是,这些方法对数据的敏感程度高,并且特征的测量工作难度较大。在使用计算机采样时容易造成数据丢失,同时在还原数值时通过计算会造成数据的污染,此外由于近年来羊绒和羊毛纤维变异程度很大,羊毛与羊绒的直径、鳞片高度等特征差异越来越小,仅依靠人工筛选很难满足实际应用中的需要。综上所述,以上提及的几种方法通常只有经过专业训练的专业人员才能够比较准确鉴别,同时准确率也不足以用于大批量的应用环境,因此,采用精密仪器以及传统计算机图像比对方式鉴别羊绒与羊毛具有耗时长、成本高、人工经验依赖性强等不足。

近年来,以深度学习理论为代表的计算机视觉技术取得了突破性的发展,基于图像特征的图像分类与识别已取得了很大进展。本文借鉴Alex-Net[6]图像分类网络,提出一种利用部分特征增强整体特征的卷积网络的羊绒与羊毛鉴别方法,该方法获取纤维表面的整体特征,并利用调整参数的模型通过整体网络特征选取局部特征,将整体与局部特征进行融合训练获取分类网络,最后利用获取到的网络对这2种纤维进行分类与鉴别。

1 研究方法

采用的策略思路是利用羊绒与羊毛纤维的原始计算机图像具有不同层次的特征,依据此特征值对2种纤维图像进行分类,这就可把近似类别纤维鉴别问题转化为图像的分类问题并加以解决。人们对图像分类以及物体识别已做出了突破性的进展,在诸多方法中,卷积网络[7](convolutional neuron networks, CNNs)是一种对自然图像分类极为有效的方法,该方法训练时间稍长,但利用训练好的网络进行分类时间效率较高。具体方法为首先需要使用卷积网络提取原始图像特征,然后介绍网络的构成,再利用所获取的网络,调整参数模型对分类网络进行局部特征提取,最后通过混合使用局部特征和整体特征,进行特征增强,最后通过预测值和样本真实标签值的比较来评价识别效果。

1.1 图像特征与卷积网络

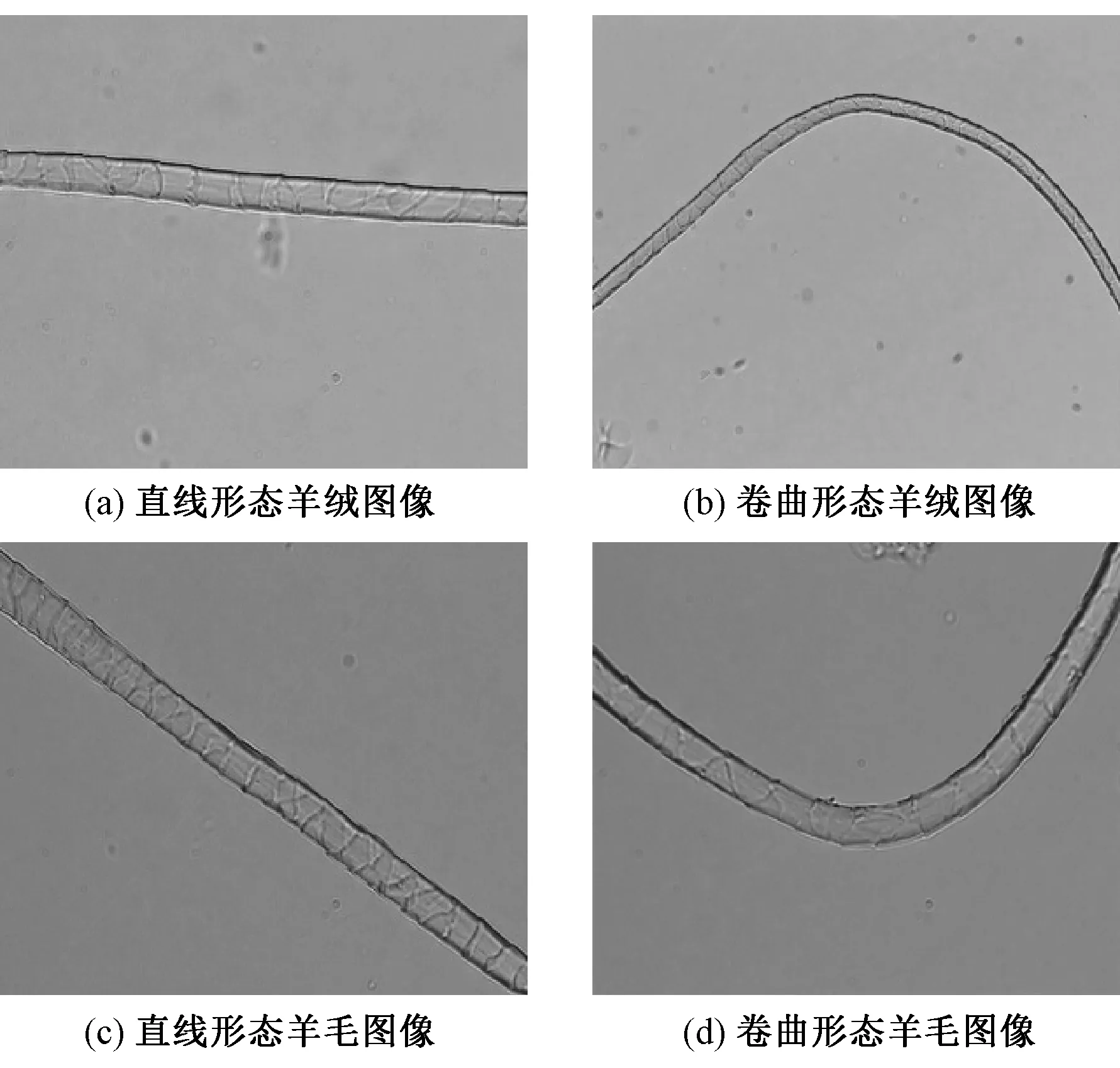

图1示出常见的弯曲度差异较大的2种羊绒及羊毛纤维。2种纤维从二维图像角度观察,外观形态比较接近,由于不同范围内的直观特征如直径、鳞片厚度等人工选择的一些特征很难作为量化区分的直接依据。同时,由于拍摄的环境并非严格无尘环境,所以样本图像存在若干肉眼可分辨的杂质,如果使用传统的图像比对方法,这些内容需要尽量剔除。同时由于样本存在不规则的展开形态,并且传统图像灰度图的处理方式不能有效利用图像的颜色及光泽度信息,所以传统的图像比对方法不适用于纤维的细分类。

图1 整根的羊绒和羊毛不同形态的显微镜图像Fig.1 Object-level microscope images of cashmere and wool.(a) Straight cashmere; (b) Curl cashmere; (c) Straight wool; (d) Curl wool

由于卷积网络采用模拟人类识别物体的分层方式,鉴于样本的原始特征存在背景包含信息较少且不具有典型的边缘、层次等内容,同时样本图片也是自然图片,所以使用卷积网络进行特征提取不需要对样本图片进行过多的人工干预。

卷积网络是以像素图像为基础输入单位的前馈型神经网络。其理论主要由生物学中的感受野启发得到。卷积网络有局部连接、空间次采样以及权值共享3个主要特性。它的出现大大降低了以往神经网络的计算难度,同时也产生了在一定程度上的抗平移、抗变形以及抗扭曲的特性。由于以上几点原因,卷积神经网络用于图像的处理尤为合适。

同时考虑到具体羊绒与羊毛分类的任务,每个输入图像由一组像素的3个通道灰度值所组成,输出为2个类别的后验概率分布。针对自然图像的不同形态处理,卷积网络具有平移、缩放、旋转等不变性特点,所以使用卷积网络处理不同形态的细分类羊绒、羊毛纤维图像不需要进行过多的人工干预处理。

1.2 卷积网络模型选取

卷积网络从全连接网络演化而来,受生物学中接受视觉信息的局部接收野启发,采用算法对全连接网络中的信息进行选择传递,构成了卷积网络。卷积网络分类分为以下几个步骤:卷积层的使用及特征的提取;下采样层的选用;通过训练样本集进行训练;使用训练所得网络对测试样本集进行分类预测并记录结果。

1.2.1卷积网络输入层及处理

鉴于计算量及硬件限制,在实验中采用的样本图片集合被处理为300像素×300像素。根据鄂尔多斯羊绒鉴别工程师提供的先验知识,样本图像的光泽也是鉴别羊绒与羊毛的关键要素,所以本文使用R、G、B 3个通道处理数据[8],而不是如传统图像比对采用灰度图像。这样,一个输入计算单元的计算数据量为300像素×300像素×3通道数×1 Byte即270 kByte。解决这个问题的办法是使用部分联通特征的卷积网络降低其计算量。由于自然图像有其固有特性即图像的一部分的统计特性与其他部分是基本一致的。

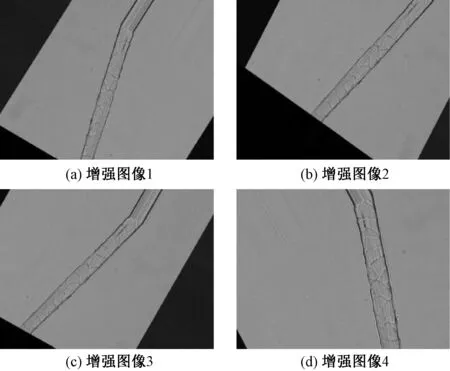

同时,实验使用4 800张的训练数据集合对于使用深度网络进行二分类的比赛,kaggle[9]数据竞赛平台的猫狗大战等图像集合在数量级上仍有很大的差距,因此,对数据进行增强处理是防止由于网络深度加深而导致的数据过拟合情况发生的关键环节。本文采用了4种方式进行了图像的生成增强。分别是随机平移、随机角度旋转、随机缩放尺寸、随机裁剪。

针对每个样本均采用上述随机变换的方式增强后生成20个样本。如此,羊毛与羊绒的数据集合扩展到了80 000训练样本集合。可达到二分类的数量要求,从而防止数据过拟合情况的发生。经过生成增强方法处理的羊毛样本样例如图2所示(本文仅选取了编号为1、2、3、4的图像为例,羊绒的增强处理方法与此相同)。

图2 单根羊毛纤维样本生成增强处理样例Fig.2 A single wool fiber sample instance after processing enhance-generating.(a) Enhanced image 1; (b) Enhanced image 2; (c) Enhanced image 3; (d) Enhanced image 4

在实验训练中,对每个样本进行如图2所示的增强处理能够有效地降低样本的过拟合。

在输入处理中,图像以二维矩阵通过R、G、B 3个通道被算法拉长成为1个列向量输入到网络中。虽然神经网络中激活函数通常采用logistic激活函数,但针对所处理纤维样本特征及计算量的考虑,所选用的是简单非线性RELU激活函数。RELU激活函数的公式如下:

(1)

在使用的卷积网络中每层使用了32到64不等数量的滤波矩阵,对同一副纤维图像进行特征提取。这样处理也能够把不同的滤波矩阵所输出的内容理解为样本图像经不同特征提取后所得特征的集合。过滤矩阵的运算结果也就是特征提取所得的矩阵为特征映射(feature map),所以可使用较为深层的网络分层次提取纤维图像的不同层次的特征,为网络最后的分类节点提供数据基础及支持。

1.2.2下采样层的选用

在上述卷积层提取了图像的特征之后,接下来所要进行的工作是使用这些特征值进行分类,但是,若利用所获取的所有特征去训练分类器,会出现计算维度过大的问题。

同时由于纤维样本的纹理复杂度低颜色单调,由实验得知,普通处理极容易出现提取特征的重叠;同时由于提高了特征映射的维度,训练过程中的过拟合也是一个不可忽视的问题。本文在网络中强化纤维图片的纹理特征,添加所需的下采样层避免上述问题的发生。

在下采样层输入的特征矩阵为W1×H1×D1,其中空间变换幅度为F以及下采样步长S,通过下采样过程产生一个W2×H2×D2的映射矩阵:

(2)

(3)

D2=D1

(4)

式中:W1、W2为图像宽度;H1、H2为图像高度;D1、D2为图像的通道数。

由上述公式可得网络下采样可降低网络前馈以及反向传导的计算量,同时由于自然图像的局部表征性质,并没有降低图像的特征表达能力。

在下采样层常用的2种算法分别是最大值下采样max-pooling和均值下采样mean-pooling。其中max-pooling是取得下采样过滤矩阵范围内的最大特征值,常用于获取纹理细节特征;而mean-pooling是以下采样过滤矩阵范围内的特征矩阵的均值为特征值组成新的特征矩阵,常用于获取图像的整体特征。

针对2种不同的过滤策略,本文通过实验中进行了针对性策略选择。在训练过程中,第1轮粗分类中使用max-pooling层,意在于获取纤维整体的纹理特征;而在第2轮局部特征提取中使用mean-pooling,从而获取样本纤维的局部的整体性特征。通过上述调整可在有限的数据集合中尽量挖掘所有数据的有效内容。

1.3 改进的网络结构

利用Alex-Net方法,可在cifar图像10分类样本以及各类自然物品图像分类竞赛中取得良好的分类效果。针对羊绒与羊毛自然图像纹理特征较明显的特点,该网络结构提取并表征其特征。

使用改进的Alex-Net,其主要思想是不同的过滤器可获取不同层次的样本特征。如:纹理、光泽、边缘、形态等。同时,由于样本数量有限,且样本的主要特征区别在于纹理及边缘以及光泽等内容,所以对Alex-Net进行了降低维度的使用。图3示出经过改进的Cashmere and Wool-Net(CW-Net)结构。

图3 改进的CW-Net结构Fig.3 Improved CW-Net structure

网络中的特征矩阵均由基本像素点的灰度值构成,同时基于小样本,简单纹理等原因,本文只使用了3次卷积层提取特征。针对每个卷积层后都紧跟1个下采样层对卷积提取的特征映射进行降维。下采样层均为最大值下采样即max-pooling,这样做能够针对图像的纹理特点进行特征提取。图3中最后2个全连接层是为2种纤维图像分类计算而加入。同样地,也在低维度对样本集特征值进行计算。所以文中的全连接层使用的连接单元数修改为256。最后根据2种纤维的二分类需求,修改最后1个全连接层使用one-hot的1个运算位即可对二者进行区分标注,因此最后可使用sigmoid函数分类器对二者进行最终的分类鉴别,从而降低运算量。

其中使用的sigmoid函数为

f(x)=1/(1+e-x)

(5)

式中:x表示网络中传导的灰度计算值。

针对二分类问题,设P(y=1|x,θ)=f(x)则P(y=0|x,θ)=1-f(x)。由式(5)及以上可得:

P(y|x,θ)=f(x)y(1-f(x))1-y

(6)

式中:y=0表示计算结果为羊绒;y=1表示计算结果为羊毛。

1.4 局部特征增强选择

在使用上述改进的CW-Net对样本进行第1轮粗分类之后。受文献[10-12]启发,使用部分特征增强整体特征[13]的思路,利用第1轮粗分类的结果网络,每个样本选取放大局部特征向量对整体图像进行增强。特征增强的步骤如下。

第1步:将原始样本图片768像素×576像素随机划分出20~200个300像素×300像素候选样本。

第2步:使用CW-Net对随机数量的候选纤维样本区域进行分类,选取分类概率最高的图像作为增强部分图像。

第3步:保存卷积网络提取部分增强图像的特征,用于下一步分类器的训练。

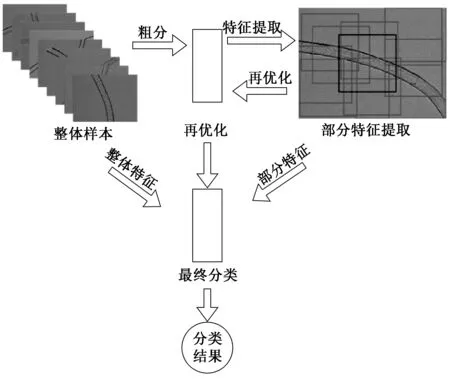

图4示出纤维部分级特征选取过程。其中灰色方框为绑定窗口的候选区域,纯黑色方框为选定区域。

图4 纤维部分级特征选取过程Fig.4 Part-level feature selection procedure

1.5 网络整体结构描述

通过上述网络结构,应用部分增强整体的思路,本方法分为3个步骤:使用上述网络结构第1轮粗分类并记录权重;第2轮中对原始图像样本采用候选区域划分部分法,在原始768像素×576像素大小的图像上随机划分20~200个300像素×300像素的候选区域,对其使用第1轮分类的结果对这 20个区域进行预测,得分最高的图像划分为对应类别;最后,对于选出的样本中的候选区域加入整体样本中再进行第3轮训练。其中稍有调整的是第2轮的训练中修改所有的下采样子层的max-pooling调整为mean-pooling,即采用均值下采样,这里意图为获取局部样本的整体特征。最后利用第3轮调优的网络进行分类预测。图5示出整体算法的结构描述。

图5 使用局部增强整体策略的整体网络算法结构Fig.5 Whole structure of part-level enhance object-level strategy

根据人类视觉细胞的分层增强性,通过3个轮次调优,同时使用图5中方法进行部分特征对整体网络进行训练增强,则可获取优于单独使用整体特征或者单独使用部分特征进行训练结果的鉴别网络权重值。

2 实验与结果分析

实验样本集合是鄂尔多斯羊绒集团测试中心工程师拍摄的20批羊绒和24批羊毛纤维,其中样本来自羊鄂尔多斯土种羊及澳洲杂交羊。样本经洗去杂质并干燥处理后进行拍摄,图像拍摄仪器是北京合众视野公司生产的CU系列纤维摄像机,该摄像机最高能够得到光学放大500倍的显微镜图像,获取每张样本原始图像大小为768像素×576像素。根据国家推荐标准GB/T 16988—2013《特种动物纤维与绵羊毛混合物含量的测定》中规定,分类样本纤维须大于等于1 500根,并且机器学习网络深度越深,所需要的样本数越多,因此,本文选用的纤维图像总数为4 800张,其中包含2 400根羊绒图像和2 400根羊毛图像,每轮次实验的数据集从样本容量中随机选择各2 000张作为训练集样本,同时选取余下的400张图像作为验证集样本。每张样本图片均被处理成.jpg格式,实验进行50轮次的训练,并每次使用训练样本所获取的网络对验证集进行分类判断,选取其中分类结果最优的网络参数。实验按照前文提到的方法和策略流程进行。首先,原始纤维图像要按照CW-Net进行图像特征提取,获取第1轮纤维整体粗分类的网络;然后利用第1轮获取的网络模型更换max-pooling层为min-pooling层对每张样本进行分部特征提取;最后使用第2步的分部特征对第1步获取的整体特征进行增强后对验证样本进行分类鉴别。

2.1 评估指标

因实验中实际上属于二分类问题,可通过计算准确率(AC)来衡量鉴别的有效程度。同时,也可分析训练的损失值(LS)评估该模型最后是否收敛于最小值,从而以此评估分类识别的效果。

其中准确率定义如下:

(7)

式中:TP表示样本的真实类别为正,最后预测得到的结果也为正;FP表示样本的真实类别为负,最后预测得到的结果却为正;FN表示样本的真实类别为正,最后预测得到的结果却为负;TN表示样本的真实类别为负,最后预测得到的结果也为负。在文中计算的目标是二分类,设羊绒为正值,羊毛为负值,则TP为统计羊绒经过CW-Net计算结果为羊绒的数量;FP为统计羊毛被鉴别为羊绒的数量;FN为统计羊绒被鉴别为羊毛的数量;TN表示羊毛被鉴别为羊毛的数量。准确率就是正确分类的羊绒及羊毛的数量与所有样本数量的比值。

另外一个本文主要采用的统计指标损失函数LS,该函数根据分类评分和训练集图像数据实际分类的一致性,衡量某个具体参数集的质量好坏。在此选择对数损失函数,对数损失函数LS的计算公式如下:

(8)

其中:N为样本数;M为类别数,在此类别数为2;yi,j表示当第i个样本为j类时为1,否则为0;pi,j表示第i个样本被预测为j类的概率;其中y和p均为N×M的one-hot值矩阵。

综上所述,本文方法中主要采用准确率AC为主要指标对网络鉴别效果进行判别。同时考虑到函数的收敛性,也选取损失函数LS作为参考评价指标。其原因是损失值经过不断梯度计算迭代而变小时,所得的网络收敛到局部极值,效果最好。

2.2 结果分析

实验中进行的是监督学习训练,每轮次从数据集中随机选择不同数量和比例的纤维图像作为训练集和测试集,效果最佳的训练集与测试集的比例为5∶1。训练和测试均为50轮次,选取其中效果最优的网络进行预测。

表1示出分别使用标准的Alex-Net、object-level CW-Net、part-level CW-Net以及增强整体MixCW-Net 4种分类方法的准确率和loss值。其中Alex-Net是Alex Krizhevsky的网络结构;object-level是使用CW-Net网络以及仅使用纤维整体样本进行训练的方法;part-level CW-Net是使用CW-Net网络以及1.4小节策略仅选取样本局部进行训练的方法;CW-Net是使用局部特征增强整体特征进行训练的方法。

表1 不同结构网络的分类效果Tab.1 Classification results of different structure networks

从表1可看出,在处理样本有限且表面纹理细节简单,同时背景等无意义内容较多的图像时,使用3轮次局部增强整体的CW-Net能够比使用Alex-Net获取更好的效果。同时,若使用了更深层次的vgg16等网络则得到的LS值是0,发生了网络弥散,所以针对样本调整网络为更低维度。同时,适当降低网络的深度以应对样本图像的数量不足问题。

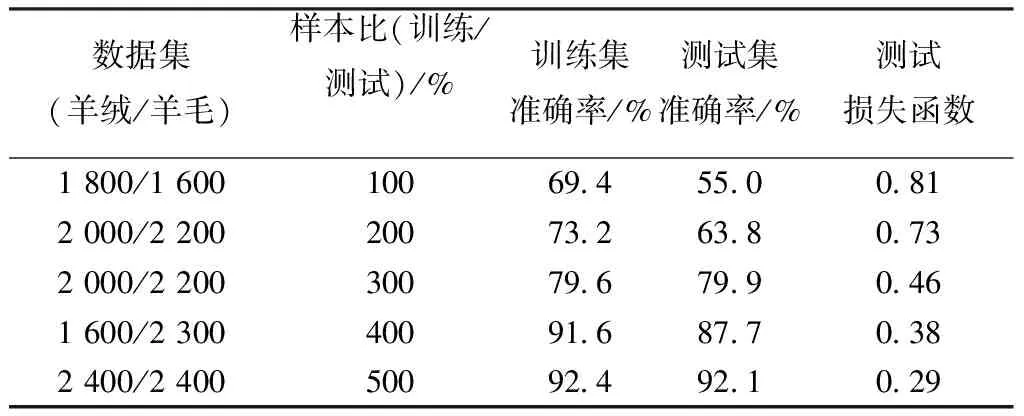

表2示出不同混合样本比例的分类效果。第1列给出了每次选择的数据集的纤维数量,数量单位为纤维的根数,第2列给出了训练和预测的样本混合比与比例。第3、4列给出了训练集和测试集的准确率。最后一列是训练的损失值。

表2 不同混合样本比例的分类效果Tab.2 Classification results of different mix ratio

从表2可看到,当使用训练测试集合比为5∶1时得到最优分类准确率。使用50轮次随机挑选的不同批次的数据集,在该混合比下测试集中准确率最高为92.1%,最低为79.5%,同时对比其他混合比例,发现该比例损失值由8.0降低到0.29。

综上所述,考虑到样本数量有限,样本总量为5 000张,去除样本图像带有明显杂质及灰尘阴影的无效图像,实验只选取了4 800张作为样本。CW-Net针对图像内容简单,图像无效内容居多,图案及颜色并不丰富的羊绒及羊毛纤维图像进行了低维度及深度降低的调整。在通过设计的3轮次模型的部分增强整体的实验中,得到的最佳测试样本分类准确率达到了92.1%。

与传统计算机图像处理识别方法相比较,该方法在训练阶段速度在可接受范围内,且获得最优网络值后检测速度更快。针对与传统图像关键点比对算法样本少、应用范围窄的问题,网络学习应用范围更广,更适合用于大批量羊绒与羊毛的鉴别。同时考虑到羊的杂交及变异,羊绒与羊毛也产生的不可预测的变化,该方法获得的分类效果较好。该方法使用的图像样本获取方便、廉价、方法应用性价比高,更容易推广应用。

3 结 论

本文提出了一种使用卷积网络模型的羊绒与羊毛识别方法,该方法使用羊绒与羊毛的光学显微镜图像,借助计算机卷积网络技术中的特征提取及特征描述方法,将纤维鉴别问题转化为图像分类问题。通过改进采用低维度的CW-Net提取纤维图像表面特征,在使用部位特征增强整体纤维特征的同时,采用sigmoid分类器分类图像,鉴别羊绒与羊毛。实验结果表明,该方法的鉴别效果较传统计算机方法适用范围更广,鉴别速度更快,识别率更高,比较适合用于2种相似纤维的鉴别,但商业应用尚需进一步研究。下一阶段的工作是获取更多更高质量的纤维样本图像,同时适当调整网络结构模型,优化算法,同时也可适当增加网络深度,从而进一步提高识别准确率和鉴别的精度。

FZXB

[1] 盛冠忠,李龙. 关于山羊绒鉴别有关问题的探讨[J]. 毛纺科技, 2007(12): 52-55.

SHENG Guanzhong, LI Long. Study on distinguishing problem of cashmere fiber[J]. Wool Textile Journal, 2007(12): 52-55.

[2] ZOCCOLA M, LU N, MOSSOTTI R, et al. Identification of wool, cashmere, yak, and angora rabbit fibers and;quantitative determination of wool and cashmere in blend: a near;infrared spectroscopy study[J]. Fibers & Polymers, 2013, 14(8):1283-1289.

[3] TANG Minfeng, ZHANG Weiping, ZHOU Hui,et al. A real-time PCR method for quantifying mixed cashmere and wool based on hair mitochondrial DNA[J]. Textile Research Journal, DOI: 10.1177/0040517513494252.

[4] 石先军, 胡新荣, 蔡光明,等. 基于鳞片纹图基因码的羊绒理论识别精度及正误判率[J]. 纺织学报, 2014, 35(4):5-10.

SHI Xianjun, HU Xinrong, CAI Guangming, et al. Theoretical recognition accuracy and error rate for cashmere based on scale pattern gene code[J]. Journal of Textile Research, 2014,35(4): 5-10.

[5] 季益萍,杨云辉,黄少君. 基于决策树算法的羊绒羊毛鉴别[J]. 纺织学报, 2013, 34(6): 16-20.

JI Yiping, YANG YunHui, HUANG Shaojun. Identification of wool and cashmere based on decision tree algorithm[J]. Journal of Textile Research, 2013, 34(6): 16-20.

[6] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Image net classification with deep convolutional neural networks[J]. Advances in Neural Information Processing System, 2012, DOI: 10.1145/3065386.

[7] CHAKRADHAR S, SANKARADAS M, JAKKULA V, et al. A dynamically configurable coprocessor for convolutional neural networks[J]. Acm Sigarch Computer Architecture News, 2010,38(3):247-257.

[8] SUN B, ABDULLAH M I, YAN F, et al. An RGB multi-channel representation for images on quantum computers[J]. Journal of Advanced Computational Intelligence & Intelligent Informatics, 2013, 17(3):404-417.

[9] Distinguish images of dogs from cats. Dogs vs. cats redux: kernels edition [db/ol]. (2016-12-22)[2017-07-25].https://www.kaggle.com/c/dogs-vs-cats-redux-kernels-edition.

[10] GE Zhongyuan, ALEX Bewley, CHRISTOPHER Mccool, et al. Fine-grained classification via mixture of deep convolutional neural networks[J]. Computer Science, 2015, 9241(3):1-7.

[11] REN Shaoqing, HE Kaiming, ROSS Girshick, et al. Towards real-time lbject detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2017, 39(6):1137-1149.

[12] ZHANG Ning. Part-Based R-CNNs for fine-grained category detection[C]//DONAHUE Jeff, GIRSHICK Ross. 13th European Conference on Computer Vision 2014. Swizerland: Springer International Publishing, LNCS, 2014: 834-849.

[13] XIAO Tianjun. The application of two-level attention models in deep convolutional neural network for fine-grained image classification[C]//XU Yichong, YANG Kuiyuan. 2015 IEEE Conference on Computer Vision and Patten Recognition(CVPR). USA: IEEE Xplore, 2015: 842-9850.

Identificationofcashmereandwoolbasedonconvolutionalneuronnetworksanddeeplearningtheory

WANG Fei1, JIN Xiangyu1,2

(1.CollegeofTextiles,DonghuaUniversity,Shanghai201620,China; 2.KeyLaboratoryofTextileScience&Technology,MinistryofEducation,DonghuaUniversity,Shanghai201620,China)

In order to solve the problem of the difficulty in identification of cashmere and wool fiber images, a novel identification method based on convolutional neuron network (CNN) and the deep learning theory was proposed. A sigmoid classier was used to carry out coarse classification on fiber image features extracted by the CNN. The results were verified according to the validation datasets, and the optimal weights of the network was recorded. Part-level features of each sample image are extracted by an improved part-level augment object-level network based on previously obtained parameters. In addition, the part-level and object-level features were fused, and a new network model was established based on the fused features. On this basis, Ordos′s standard cashmere and wool dataset was used to train the network for 50 times, and the best accuracy is 92.1%. The experiment results demonstrate that the method for classifying cashmere and wool images, based on the CNN features, can be applied to cashmere and wool or discriminate similar fibers identification successfully. However, a large number of sample sets and validations are required for commerical use.

cashmere; wool; image identification; convolutional neuron networks

10.13475/j.fzxb.20161202907

TS 131

A

2016-12-20

2017-08-29

王飞(1982—),男,博士生。主要研究方向为机器视觉及深度学习算法在纺织品鉴别的应用。靳向煜,通信作者, E-mail:jinxy@dhu.edu.cn。