颜色自适应与相关滤波互补目标跟踪

2017-06-28吴迪云吴正平

吴迪云 吴正平

(三峡大学 电气与新能源学院, 湖北 宜昌 443002)

颜色自适应与相关滤波互补目标跟踪

吴迪云 吴正平

(三峡大学 电气与新能源学院, 湖北 宜昌 443002)

针对相关滤波(Correlation Filter, CF)算法在目标跟踪中严重依赖目标及背景的颜色在空间中布局,对目标变形极其敏感,且因背景颜色分布的变化导致目标中心计算不准确问题,提出了颜色自适应(Color Adaptive,CA)与相关滤波互补的跟踪策略.跟踪过程中,首先根据前面帧学习的滤波模板和颜色模板,通过两种算法分别计算目标中心坐标;其次,由相关滤波产生的响应图中目标区域数值的占比,分配两种算法计算的中心坐标相应权值,得到最终的跟踪坐标.跟踪实验表明,本文方法(CACF)应对跟踪过程中各种干扰问题具有更强的鲁棒性,优于近几年一些主流的跟踪算法,且跟踪速度可达到实时性.

颜色自适应; 相关滤波; 互补跟踪; 目标跟踪; 跟踪算法

0 引 言

近些年,相关滤波算法在基于视觉的目标跟踪中引起了广泛的关注,2010年Bolme DS等[1]首次将相关滤波用于目标跟踪领域,提出误差最小平方和滤波(MOSSE)算法,后来大量优秀的目标跟踪算法也是基于此算法改进.例如,CSK算法[2],选取目标及其周围的一定矩形区域,利用循环移位方法进行碎片采样作为训练样本,结合FFT快速进行分类器的训练,跟踪的过程就是计算下一帧窗口内相关滤波的响应.KCF算法[3],是CSK算法作者进一步对CSK算法的改进,从单通道特征换成了Hog多通道特征,使训练所得的分类器检测目标的分辨力更强.STC算法是Zhang等[4]提出的高效跟踪算法,通过贝叶斯框架对要跟踪的目标和它类器的训练,跟踪的过程就是计算下一帧窗口内相关滤波的响应.KCF算法[3],是CSK算法作者的进一步对CSK算法的改进,从单通道特征换成了Hog多通道特征,使训练所得的分类器检测目标的分辨力更强.STC算法是Zhang等[4]提出的高效跟踪算法,通过贝叶斯框架对要跟踪的目标和它的局部上下文区域的时空关系进行建模,得到目标和其周围区域低级特征统计相关性.利用目标周围局部上下文的环境辅助进行目标的定位,取得了良好的效果.

上述列举的跟踪算法均基于相关滤波思想,相关滤波算法是利用目标区域的颜色分布,该算法对目标的变形极其敏感,背景移动也会影响目标中心的计算.常见的处理目标变形跟踪鲁棒性较强的算法有:直方图匹配法[5-7],特征匹配算法[8-9].

本文提出了颜色自适应算法,该算法不受背景颜色布局和目标变形的影响,改进了相关滤波算法在目标变形和背景移动下目标中心位置计算不稳定问题.

颜色自适应算法是通过计算目标及其周围区域像素的RGB颜色向量,然后滤去背景颜色,最后提取目标的主要颜色向量进行跟踪.由于目标颜色的分布位置不影响目标颜色的识别,所以对于目标的变形问题有很强的抗干扰能力,且不依赖于背景颜色的布局,但在遮挡或目标颜色发生快速变化时,目标中心位置计算较差.

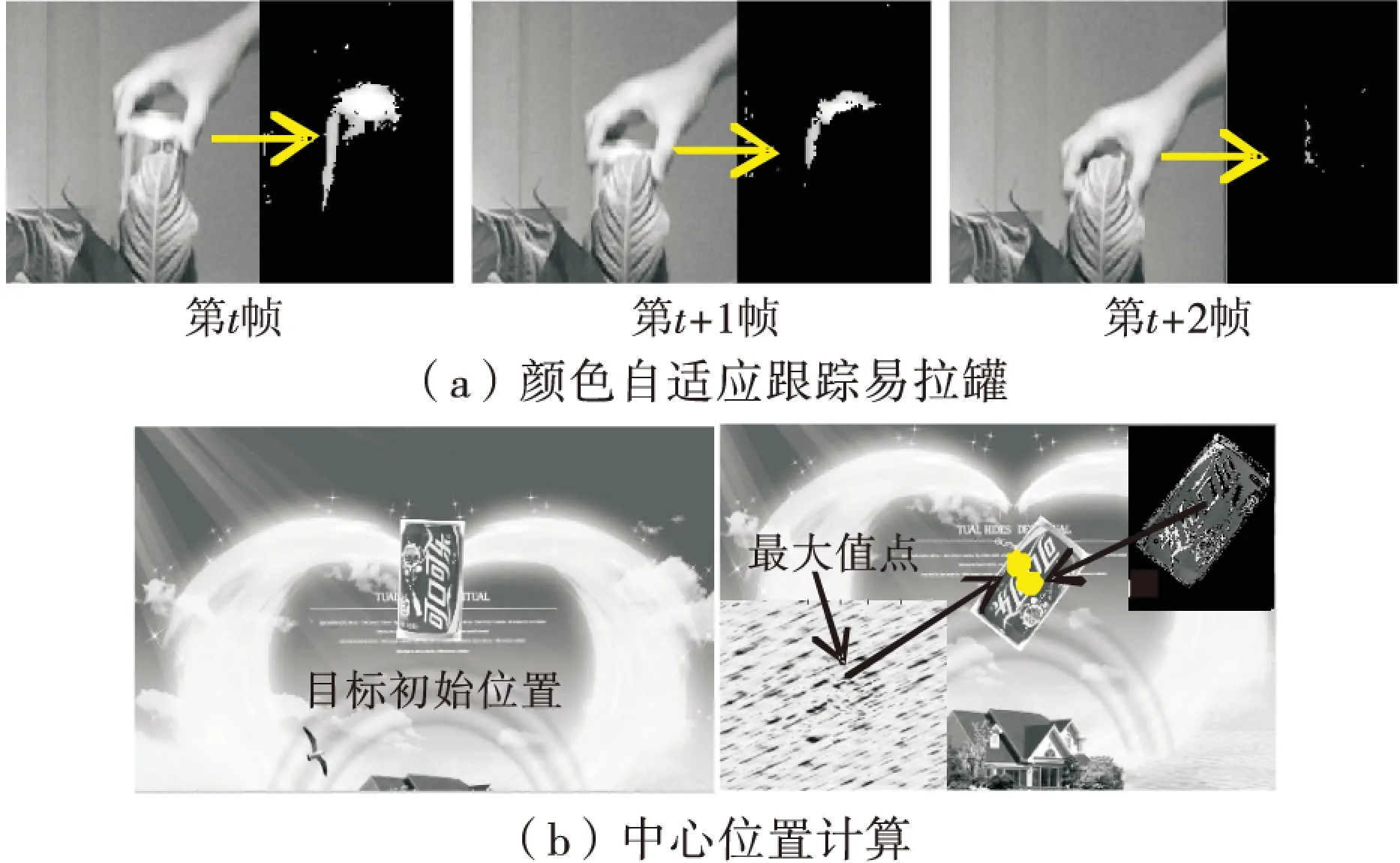

图1 互补跟踪

如图1(a),目标严重遮挡后,目标颜色缺失导致无法跟踪.相关滤波算法充分利用了目标周围区域的颜色布局,对目标遮挡和光线变化有较强的跟踪鲁棒性.因此,两种算法在跟踪过程中形成互补关系,在相关滤波计算目标中心位置可信度较低时,由颜色自适应的计算结果进行补充.如图1(b)所示,可乐罐产生较大位移和旋转变形后,相关滤波计算的响应图对应的最大值点位置与实际目标中心点位置有偏差,而颜色自适应在目标变形情况下能准确提取目标颜色并计算中心位置.

1 相关滤波算法

本文的相关滤波跟踪算法以STC算法[4]为基础,跟踪的核心是使用滤波模板L与当前帧跟踪区域图像Xt做卷积计算,得到跟踪区域的相关性响应图R,目标的中心位置即为响应图的最大值处,然后更新滤波模板用于下一帧目标跟踪计算.本文设置目标跟踪区域为以目标及其周围区域,大小为目标框的2倍.

若当前帧跟踪区域为Xt,上一帧目标位置为Pt-1,当前帧滤波模板为L(Xt),则当前帧目标位置Pt计算为:

(1)

其中,函数W的作用是以上一帧目标中心为圆心,裁剪跟踪区域图像,然后进行加窗处理,将离目标近的像素值赋较大权值,减少跟踪区域的边缘影响.加窗是把跟踪区域的图像灰度值I(x)投影到高斯核函数上,公式为:

(2)

其中,b为高斯函数的归一化常数;σ为尺度参数;d为跟踪区域的对角线长度.

跟踪过程中目标的尺度是变化的,由于本文的相关滤波是基于高斯核函数,目标位置处在核函数的中心,目标的颜色分配较大的权值,当目标变大后,响应图R的最大值也会变大,基于此特性设计尺度计算如下:

(3)

其中,max(Rt)为第t帧响应图的最大值,ρ为尺度变化抑制常数,适当的取值有利于尺度稳定的变化.

核函数相关性响应图R是以目标中心位置为中心的二维高斯函数,即为

(4)

其中,a为归一化常数.

目标滤波模板L(Xt)是通过训练得来,假设当前帧的滤波模板已知,则响应图R的计算为:

(5)

其中,⊗是卷积计算.众所周知,图像卷积之后再进行傅里叶变换等价于先进行傅里叶变换,然后再进行对应像素的乘积,则上式可记为

(6)

其中,F代表快速傅里叶变换,⊙表示对应像素相乘.可以推导出滤波模板L为:

(7)

其中,F-1为傅里叶反变换.滤波模板是由每帧训练更新得到,记为:

(8)

其中,α为滤波模板训练速率.

2 颜色自适应算法

目标跟踪过程中,最显著的特征就是目标颜色,本文颜色自适应跟踪算法就是在目标运动过程中,从变化的背景颜色和目标颜色中自适应提取目标的颜色,进而计算目标的中心位置.

假设目标区域图像为Xm×n,跟踪区域为目标及其周围区域,大小为目标框2倍的区域,记为:T2m×2n.将跟踪区域图像RGB颜色矩阵数值分别映射到{1,…,16}整数区域,则颜色直方图由16×16×16=4 096种颜色向量组成,计算为:

(9)

目标颜色和背景颜色分离是以当前帧目标颜色模板的颜色向量比重为计算依据,比重较大的颜色向量为跟踪目标中较为突出的颜色.首先,统计跟踪区域和目标区域周围的背景区域RGB颜色向量直方图;然后,用对数法计算当前帧目标颜色的主要成分,详见公式(10).颜色模板C16(Xt)的更新是提取每一帧目标主要颜色进行线性叠加,记为公式(11):

(10)

(11)

其中,Ht和Hb分别是跟踪区域颜色直方图和背景区域的颜色直方图;δ为目标颜色提取阈值常数,取值范围为(0,1),取值的大小决定了提取目标主要颜色向量的数量,λ为颜色模板更新速率,设置合适的更新速率抑制背景色在目标颜色模板中占据的比重.

将目标颜色模板C16中大于阈值τ的RGB颜色向量在跟踪区域中用二值模式标注,目标颜色标注为1,背景颜色标注为0,记为:

(12)

目标中心位置计算采用均值漂移法[10],设上一帧目标中心位置为Pt-1,当前帧跟踪区域二值矩阵Mt.首先,中心点初值设为Pt-1.然后,把Mt投影到高斯核函数上,减少离中心点远的坐标影响权重.最后,逐步迭代寻找下一个中心点位置,直到两次中心点间距离小于一定阈值,公式如下:

(13)

其中,g为归一化常数,⊙为二维矩阵的对应点相乘,式中与二值矩阵M相乘作用是将背景色权值都归零.xj为M中每一点的坐标,n为M中像素的个数.

3 互补跟踪实现

相关滤波与颜色自适应是由权值变量β来实现互补,β是根据相关滤波得到的高斯核函数响应图R中数值计算得来.当跟踪区域的背景色和目标颜色布局变化较小,跟踪区域与滤波模板进行卷积产生的响应图如图2(a)所示,近似于高斯二维分布;若背景和目标颜色布局与滤波模板存储的布局有较大差异,则响应图和图2(b)类似,分布杂乱没有规则.

图2 互补实现

以响应图最大值点处为矩形框中心,矩形框大小为目标框的尺寸(如图2(b)所示),将响应图内小于零的边缘值置零,然后将数值进行归一化,计算框内数值的和与响应图数值和的比值V.若当前帧为第t帧,则β的计算公式见式(14),实验表明β取值主要介于0.6~0.9,β数值较小则相关滤波计算的目标中心位置可信度较低.通过颜色自适应计算的目标中心位置进行纠正,大大地降低了由于相关滤波算法的不足引起的中心位置漂移甚至跟丢.设颜色自适应计算目标中心位置为PCA,相关滤波计算目标中心位置为PCF,则最终位置P的计算见式(15),直观描述如图2(c)所示.

(14)

(15)

4 实验与结果分析

4.1 参数设置

为验证本文跟踪算法的有效性,进行了大量的跟踪实验.使用IntelPentiumB960CPU,主频为2.2GHz,4GB内存配置电脑,在Matlab2009上运行,平均跟踪速度达116 帧/秒.实验过程中,算法的各个参数设置如下:式(2)中尺度参数初值设置为σ=1,式(3)中尺度变化抑制常数ρ=0.25,式(8)中滤波模板训练速率α=0.1,式(10)目标颜色提取阈值δ=0.4,式(11)颜色模板学习速率λ=0.2,式(12)阈值τ=0.6.

为了充分说明本文算法在处理目标非刚性变形、背景干扰、局部遮挡及光照变化等方面的优势,本文有针对性地选取了8段具有挑战性的测试视频.8段视频及目标真实位置均来自www.visual-tracking.com. 挑选了近些年8种跟踪算法及算法公开的跟踪数据结果进行对比,算法分别是:CT[11]、DFT[12]、LSK[13]、LOT[14]、CXT[15]、BSBT[16]、VTD[17]、STC[4].

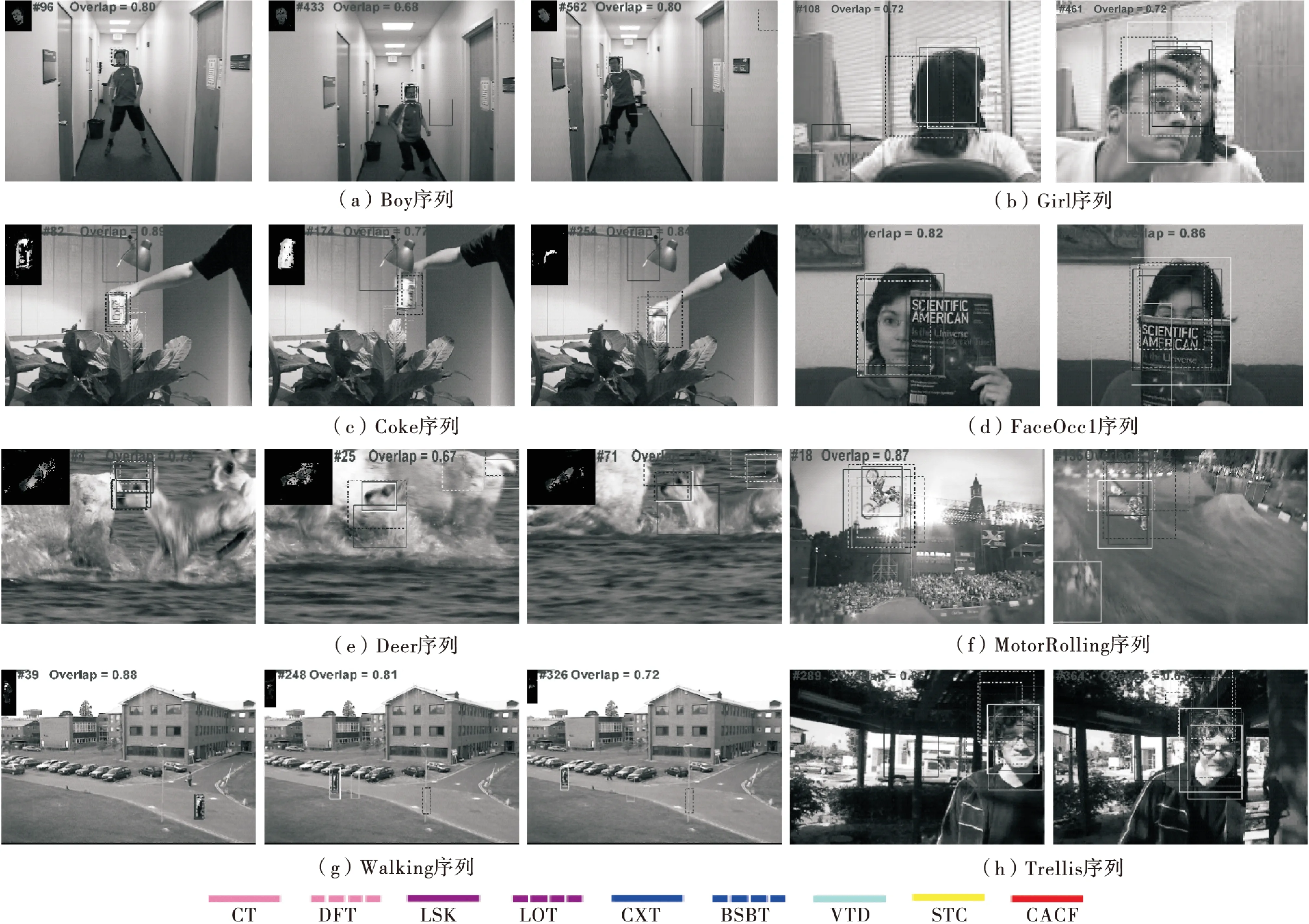

4.2 定性对比

选择的8段公开测试视频片段中有遮挡(Coke,Girl,FaceOcc1和Walking),光照变化(Coke,Trellis和MotorRolling),旋转(Girl和MotorRolling),快速运动及模糊(Boy,MotorRolling和Deer)等问题,见图3跟踪截图.对部分目标尺度较小的视频,图3中将颜色自适应算法提取的目标颜色显示在图的左上角.本文提出的CACF算法在这些视频上均达到了较好的跟踪效果,与8种对比算法跟踪情况比较,说明该算法具有更强的跟踪鲁棒性.

图3 跟踪截图

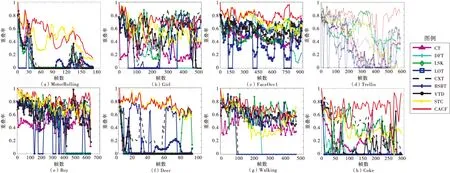

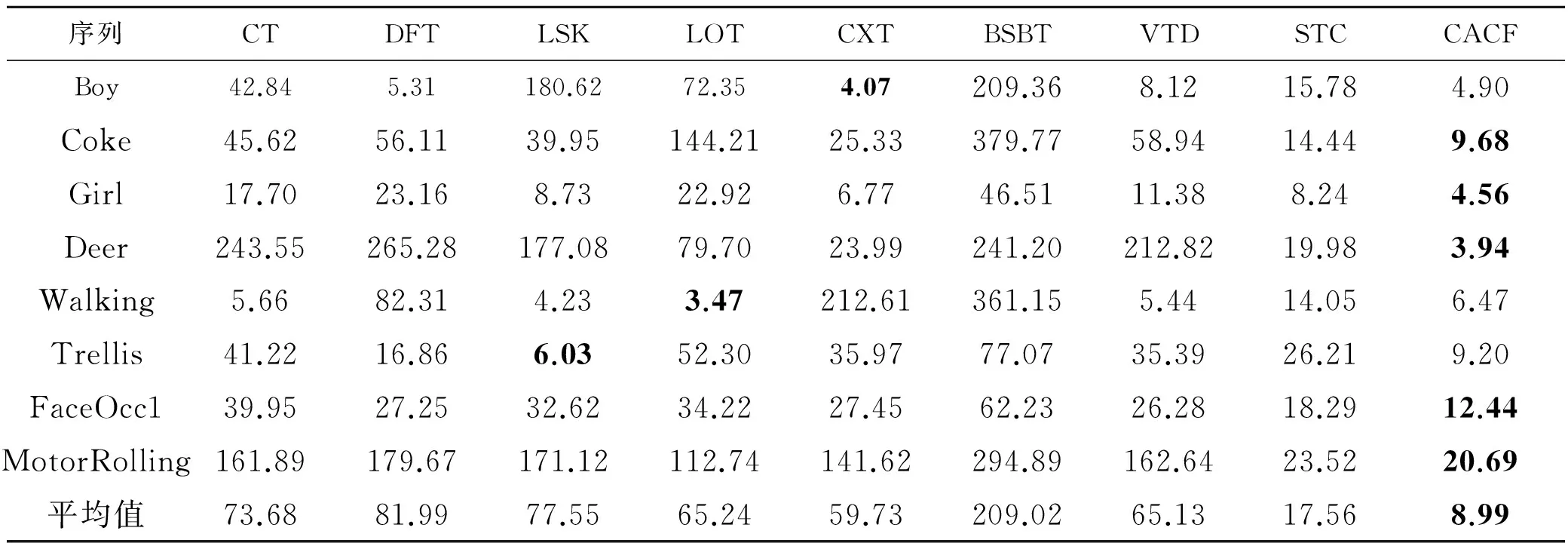

4.3 定量对比

从图4中不同跟踪算法重叠率计算对比可以看出,CACF算法在8段视频的平均重叠率均处于较高水平,在FaceOcc1、Coke序列具有明显跟踪重叠率优势,分析原因是CACF算法在目标颜色与背景颜色区别较大时跟踪性能更突出.由表1目标跟踪中心位置误差可以看出,CACF算法中心位置计算平均上较其余8种跟踪算法更为准确.

图4 不同跟踪算法重叠率对比

序列CTDFTLSKLOTCXTBSBTVTDSTCCACFBoy42.845.31180.6272.354.07209.368.1215.784.90Coke45.6256.1139.95144.2125.33379.7758.9414.449.68Girl17.7023.168.7322.926.7746.5111.388.244.56Deer243.55265.28177.0879.7023.99241.20212.8219.983.94Walking5.6682.314.233.47212.61361.155.4414.056.47Trellis41.2216.866.0352.3035.9777.0735.3926.219.20FaceOcc139.9527.2532.6234.2227.4562.2326.2818.2912.44MotorRolling161.89179.67171.12112.74141.62294.89162.6423.5220.69平均值73.6881.9977.5565.2459.73209.0265.1317.568.99

5 结 论

本文提出了颜色自适应与相关滤波两种算法互补的目标跟踪策略,弥补了相关滤波算法对跟踪区域的颜色布局严重依赖的不足,能更好地应对目标变形和目标快速运动时背景色导致目标中心位置计算不稳定等问题.相关滤波对跟踪区域背景颜色布局的利用能够很好地处理遮挡问题和目标的颜色或光线变化问题,弥补了颜色自适应在这方面的不足.两种算法利用相关滤波计算后的响应图数值特征进行衔接,通过定性和定量的方式对本文方法进行验证,本文方法平均跟踪性能优于其他算法,在应对光照变化、遮挡、旋转、快速运动及模糊等问题具有较强的鲁棒性,而且跟踪速度达到了实时性要求;同时发现,本文方法在处理光照变化和变形同时发生时效果不佳,两种算法此时中心点位置计算都误差较大,下一步拟通过对跟踪区域提取纹理特征来改进本文算法的不足.

[1] Bolme D S, Beveridge J R, Draper B, et al. Visual Object Tracking Using Adaptive Correlation Filters[C].Computer Vision and Pattern Recognition (CVPR), 2010 IEEE Conference on. IEEE, 2010: 2544-2550.

[2] Henriques J F, Caseiro R, Martins P, et al. Exploiting the Circulant Structure of Tracking-by-detection with Kernels[M].Computer Vision-ECCV 2012. Springer Berlin Heidelberg, 2012: 702-715.

[3] Henriques J F, Caseiro R, Martins P, et al. High-speed Tracking with Kernelized Correlation Filters[J]. Pattern Analysis and Machine Intelligence, IEEE Transactions on, 2015, 37(3): 583-596.

[4] Zhang K, Zhang L, Liu Q, et al. Fast Visual Tracking Via Dense Spatio-temporal Context Learning[M].Computer Vision-ECCV 2014. Springer International Publishing, 2014: 127-141.

[5] 余旺盛, 侯志强, 田孝华. 基于旋转不变直方图的快速匹配穷搜索[J]. 电子学报, 2012, 40(11):2177-2182.

[6] 马 丽, 常发亮, 郭立智. 基于颜色直方图匹配的非刚性目标跟踪算法[J]. 青岛理工大学学报, 2005, 26(5):79-83.

[7] 刘惟锦, 章毓晋. 基于Kalman滤波和边缘直方图的实时目标跟踪[J]. 清华大学学报:自然科学版, 2008, 48(7):1104-1107.

[8] 薛 明. 基于稀疏表示的在线目标跟踪研究[D].上海:上海交通大学, 2014.

[9] 宋晓琳, 王文涛, 张伟伟. 基于LBP纹理和改进Camshift算子的车辆检测与跟踪[J]. 湖南大学学报:自然科学版, 2013, 40(8):52-57.

[10] 杜 凯. 基于均值偏移算法的运动目标跟踪算法的研究[D].西安:长安大学, 2012.

[11] Zhang K, Zhang L, Yang M H. Real-time Compressive Tracking[M].Computer Vision-ECCV 2012. Springer Berlin Heidelberg, 2012: 864-877.

[12] Sevilla-Lara L, Learned-Miller E. Distribution Fields for Tracking[C].Computer Vision and Pattern Recognition (CVPR), 2012 IEEE Conference on. IEEE, 2012: 1910-1917.

[13] Liu B, Huang J, Yang L, et al. Robust Tracking Using Local Sparse Appearance Model and k-selection[C].Computer Vision and Pattern Recognition (CVPR), 2011 IEEE Conference on. IEEE, 2011: 1313-1320.

[14] Oron S, Bar-Hillel A, Levi D, et al. Locally Orderless Tracking[C].Computer Vision and Pattern Recognition (CVPR), 2012 IEEE Conference on. IEEE, 2012: 1940-1947.

[15] Dinh T B, Vo N, Medioni G. Context Tracker: Exploring Supporters and Distracters in Unconstrained Environments[C].Computer Vision and Pattern Recognition (CVPR), 2011 IEEE Conference on. IEEE, 2011: 1177-1184.

[16] Stalder S, Grabner H, Van Gool L. Beyond Semi-supervised Tracking: Tracking Should be as Simple as Detection, But Not Simpler than Recognition[C].Computer Vision Workshops (ICCV Workshops), 2009 IEEE 12th International Conference on. IEEE, 2009: 1409-1416.

[17] Kwon J, Lee K M. Visual Tracking Decomposition[C].Computer Vision and Pattern Recognition (CVPR), 2010 IEEE Conference on. IEEE, 2010: 1269-1276.

[责任编辑 张 莉]

Complementary Object Tracking with Color Adaptive and Correlation Filter

Wu Diyun Wu Zhengping

(College of Electrical Engineering & Renewable Energy, China Three Gorges Univ., Yichang 443002, China)

In light of that the problem of correlation filter algorithm depends strongly on the spatial color layout of the target and background in object tracking, also that are extremely sensitive to deformation, moreover,target central location calculation inaccurate due to background color layout changes, a combining color adaptive with correlation filter(CACF) complementary object tracking strategy is proposed. In tracking process,firstly,according to the pre-frame learned filter model and color model to get the central location from the two algorithms, and then to assign them weights according to the numeral proportion in responses map which is produced by correlation filter, finally, the tracking coordinate is obtained. Tracking experiments show that this paper proposed algorithm (CACF) has great robustness to various challenging situation, outperforms the recent years state-of-the-art algorithms, also has high tracking efficiency.

color adaptive; correlation filter; complementary tracking; object tracking; tracking algorithm

2016-11-22

国家自然科学基金项目(61272237);湖北省教育厅科学技术研究计划重点项目(D20151204);湖北省创新群体项目(2015CFA025)

吴迪云(1989-),男,硕士研究生,研究方向为模式识别、图像处理.E-mail:wudiyun2009@qq.com

10.13393/j.cnki.issn.1672-948X.2017.03.021

TP391.41

A

1672-948X(2017)03-0093-06