基于Lenet—5的卷积神经网络改进算法

2016-08-16李丹沈夏炯张海香朱永强

李丹 沈夏炯 张海香 朱永强

摘 要: 在当前语音识别和图像识别领域,卷积神经网络已经取得了很大的成功。现有的Lenet-5卷积神经网络是多层网络结构,但是大量实验表明,从全链接层到输入层的回调影响了最终的精度,特别是在有限数据量的情况下。因此提出了单层回调的Lenet-5算法,即在Lenet-5卷积神经网络的卷积层后添加一个临时输出层,与真实标签进行比较,根据误差函数对层间参数进行回调,并用全球手写数字MNIST数据集进行训练和测试。实验表明,即使在有限数据量的情况下算法的精度仍能得到提高。

关键词: 卷积神经网络; Lenet-5; 全链接; 卷积; 池化; 回调; 精度

中图分类号:TP391.4 文献标志码:A 文章编号:1006-8228(2016)08-04-04

Abstract: In the area of speech recognition and image recognition, convolutional neural network has achieved a great success, the structure of Lenet-5 convolutional neural network is multilayer, but a lot of experiments show that the callback from full connection layer to the input layer influences the accuracy, especially in the case of limited data sets. So, the single layer callback Lenet-5 algorithm is proposed, which adds a temporary output layer in the end of each convolutional layer, compares the output with the real labels, adjusts the parameter of each layer according to the error function, and uses the global MNIST data base to train and test. The experiment proves that the accuracy of the algorithm can be improved even in case of limited data sets.

Key words: convolutional neural network; Lenet-5; full-connection; convolution; pooling; callback; accuracy

0 引言

提高卷积神经网络的精度对于卷积神经网络[1]在实践中的应用有重要的意义,1962年Hubel和Wiesel通过对猫视觉皮层细胞的研究,提出了感受野[2](receptive field)的概念, 1984年日本学者Fukushima基于感受野[3]概念提出的神经认知机(neocognitron)可以看作是卷积神经网络[4]的第一个实现网络,也是感受野概念在人工神经网络领域的首次应用。Lenet-5卷积神经网络是一个多层的神经网络,对于图片的特征提取[5-7]有着出色的表现。

针对Lenet-5卷积神经网络的结构及其在处理图片的数据量方面的研究,笔者构造出了一种新的Lenet-5卷积神经网络模型,使其同时具备单层神经网络和多层神经网络的优点,考虑在较少的训练数据的情况下,该模型在图片特征提取中仍然能通过层间传递得到优秀的训练参数,特构建出一个特征模型。

1 Lenet-5算法简介

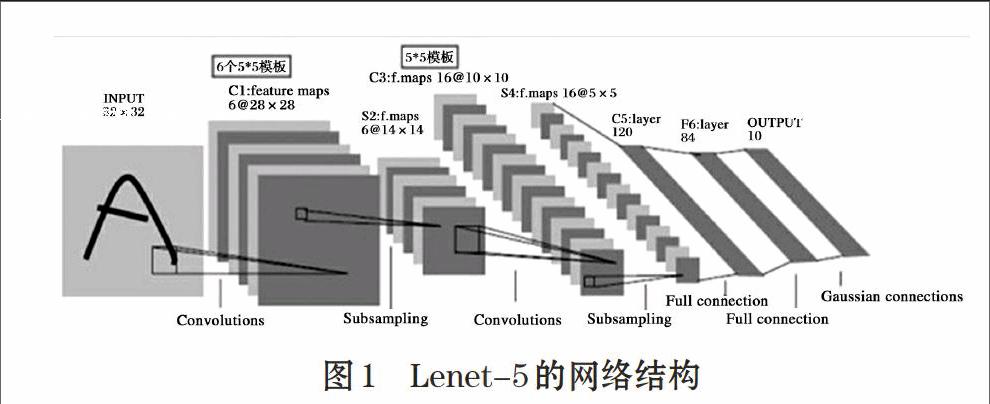

Lenet-5[8]算法是Y.LeCun提出的一个卷积神经网络,它是一种特殊的多层神经网络,和其他神经网络一样,也是通过反向传播方式来训练,不同点是它的网络结构,其最大的特点就是每层间的权值共享,这让Lenet-5在构建网络过程中减少了大量的参数,加快了学习过程,其网络结构如图1所示。

Lenet-5的每层由多个二维平面组成,每个平面由多个独立神经元组成,网络中包含一些简单元和复杂元,分别标记为S-元和C-元,S-元聚合在一起组成S-面,S-面聚合在一起组成S-层,同理C-元、C-面、C-层也存在类似关系。C层是特征提取层,每个神经元的输入与前一层的局部感受也相连,并提取该局部特征;S层是特征映射层,每个计算层由多个特征映射组成,每个特征映射为一个平面,平面上所有神经元权值相等,特征映射结构采用影响函数核小的sigmoid函数作为卷积网络的激活函数,使得特征映射有位移不变性的特征。

2 Lenet-5训练过程

Lenet-5[9]的训练过程主要分为两个部分,一是前向传播,从训练集中取出一个训练数据(trnData, trnLabel),trnData输入到神经网络中,经过多次卷积和池化的传播,得到实际输出output_real;二是反向传播,计算出实际标签reaLabel和理想标签trnLabel的误差函数,反向传播使用极小化误差的方法,根据每层与上层间的误差调节层间参数。

2.1 卷积

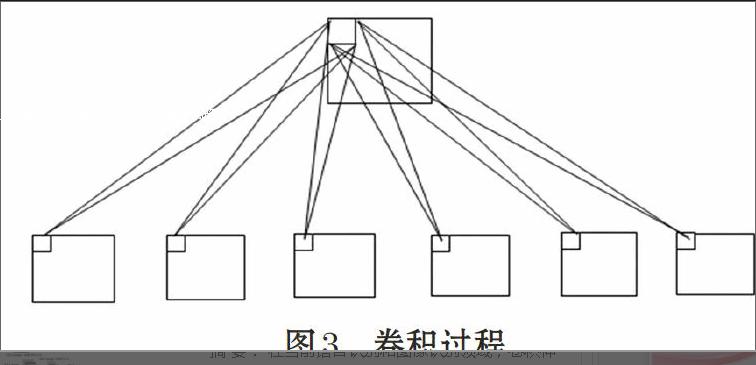

输入数据经过卷积得到C1层,产生六个特征映射图,由一个滤波器F(x)来卷积输入图像,加偏置B(x),得到卷积层C1层,多个滤波器来做卷积可以得到多个Feature Map。卷积的计算过程如图2所示。

规定卷积核大小为5*5,以输入层与C1层为例,输入层大小为32*32,则C1层特征图的大小为28*28,可由28=32-5+1计算得到,C1层共六个Feature Map,由权值共享概念可得:每个Feature Map共5*5+1=26个参数,C1层共26*6=156个参数,共156*(28*28)=122304个连接,卷积过程如图3所示。