自然光下的新型动态注视点眼动向量

2016-05-31秦华标王信亮胡大正

秦华标,王信亮,卢 杰,胡大正

(华南理工大学电子与信息学院,广东广州510641)

自然光下的新型动态注视点眼动向量

秦华标,王信亮,卢杰,胡大正

(华南理工大学电子与信息学院,广东广州510641)

摘要:为解决自然光下视线跟踪系统注视点估计精度不高和头部运动受限问题,提出了一种基于虹膜和眼睛内角点特征的动态注视点眼动向量,并以虹膜面积信息对其进行标准化,以消除头部运动对眼动向量的影响.最后结合动态注视点眼动向量与多项式映射模型得到实时注视点,实现眼动向量与注视点的一一映射.采用该眼动向量可提高注视点估计精度,降低头部运动的影响.

关键词:虹膜;眼睛内角点;视线跟踪;自然光

1 引言

视线跟踪作为一种前沿的人机交互方式,提高了用户体验并催生了多种新型的信息系统及应用.目前的非接触式视线跟踪方法大部分都使用主动红外光源[1,2],但红外光容易受室外光线的干扰,并且红外光的长期照射会使人眼睛产生不适应感,甚至造成损伤[3],这些因素影响了视线跟踪技术的推广应用.因而寻找一种能在自然光下克服头部运动的视线跟踪技术具有重要的科学研究意义和实际应用前景[4,5].

近年来越来越多的研究人员对自然光下的非接触式视线跟踪技术和理论进行了研究.其中部分研究者认为视线是发自眼球中心、经过虹膜中心的射线方向,所以通过获取虹膜、瞳孔或者眼睛的内外角点图像来计算出视线,并通过视线与屏幕交叉定位眼睛注视点.文献[6]认为视线垂直于虹膜平面且通过虹膜中心,因此首先通过虹膜中心以及虹膜边界点的定位,结合眼球几何模型计算出眼球中心,再通过眼球中心与虹膜中心的连线确定方向,但该文献在求取眼球中心时采用了固定的解剖学常数,给视线估计带来误差;文献[7]认为瞳孔中心与虹膜中心共面,先获取头部姿势与偏转信息,结合眼角点位置估计眼球中心,再结合瞳孔中心或虹膜中心估计视线方向.然而瞳孔中心与眼角点的提取精度受到部分闭合的眼睑影响,且该方法需要三维深度传感器及眼睛解剖学参数;文献[8]则首先利用眼球中心和虹膜中心对视线进行预估计,并在头部运动时通过眼球的旋转模型计算出表征眼球平移和旋转的注视角,最终结合注视角与眼球中心确定三维空间中的视线.由于上述文献中眼球中心与虹膜中心的连线并不是真正的视线,而是眼睛的光轴,所采用的眼睛视线模型没有考虑到眼睛视轴与光轴之间的夹角[9],最终影响视线估计的精度.文献[10]则认为三维空间中虹膜与瞳孔并不共面,把虹膜中心与瞳孔中心的连线方向作为视线方向,而眼动向量是虹膜轮廓的法线向量并经过眼球中心,然而在定位瞳孔中心时并未考虑眼睑的遮挡使得视线方向精度受到影响.

总之以上方法存在着以下缺点: (1)需要使用立体眼睛特征参数,增加了眼睛特征检测和参数提取的复杂性; (2)其估计精度依赖于立体摄像头的精度,对硬件配置要求较高; (3)需要进行较多标定,如摄像头标定、使用者标定和屏幕位置标定,并且视线估计过程对以上位置变化非常敏感,如摄像头与头部相对位置发生变化时需要重新进行标定.

因此,一些研究者通过直接建立眼动信息与注视点之间的映射关系来解决视线跟踪问题,如文献[11]获取眼睛的角点,嘴角点,以及鼻孔中心等特征点,并建立人眼图像与屏幕注视点的数据集,然后通过高斯过程进行监督学习,进而得到眼动特征点与注视点的映射关系.由于嘴角点是非刚性参考点,以及头部运动幅度过大会导致鼻孔特征消失等原因,此方法的精度与鲁棒性无法得到保证.文献[12]则以虹膜中心与眼睛内外角点为特征点,由虹膜中心与眼睛内外角点构成眼动向量,通过多项式映射方程匹配得到注视点,但是该方法在头部运动时注视点估计误差快速增大;虽然利用眼睛嫩外角点间的距离对眼动向量进行标准化可以一定程度上克服头部运动的影响,但是眼睛外角点具有不稳定性,使得标准化后的眼动向量鲁棒性不强,注视点估计精度难以保证.

综上所述,本文将选取在自然光下更稳定的眼动特征信息,构建对头部运动具有更强抗干扰能力的动态注视点眼动向量,提高了注视点定位精度,同时又允许头部在一定范围内运动.

2 自然光下的注视点映射模型

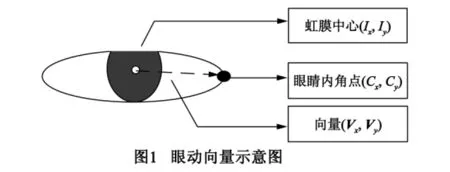

本文以眼睛内角点与虹膜特征作为自然光下的眼动特征,并以此构建注视点眼动向量,系统基本原理如图1所示.

图1中(Ix,Iy)是虹膜中心,(Cx,Cy)是眼睛内角点,眼动向量(Vx,Vy) = (Cx-Ix,Cy-Iy).

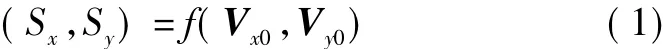

当头部静止不动时,眼睛内角点(Cx,Cy)处于静止状态,眼睛在屏幕上的注视点会随着眼球的转动而移动,此时虹膜中心(Ix,Iy)与眼睛内角点构成的眼动向量与注视点之间的映射关系如下:

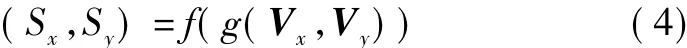

选取多项式映射模型[13]作为标定位置眼动向量(Vx0,Vy0)与屏幕注视点(Sx,Sy)之间的映射关系f,如式(2)所示.

ai,bi,(i =0,1,2,3,4,5)为待求解的多项式系数,眼睛依次注视均匀分布在屏幕上的3×3个标定点,同时提取相应的眼动向量,代入多项式映射模型并利用最小二乘法求解参数ai,bi,使得式(2)可用于注视点实时估计.

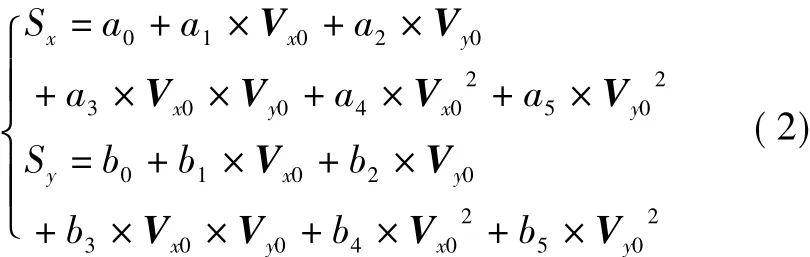

上述注视点映射模型是静态的,即头部在标定点位置保持静止时,标定位置眼动向量(Vx0,Vy0)可以很好地与屏幕上注视点实现一一映射.但是当头部偏离标定点位置时,即使眼睛注视着屏幕上同一位置,眼动向量(Vx,Vy)也会随着头部位置的移动而变化,若仍直接采用原多项式方程f求解注视点,此时计算出的注视点会有很大的误差.因此本文将在分析头部运动影响的基础上建立对头部运动具有抗干扰能力的注视点眼动向量.

3 头部运动对眼动向量影响分析

为了构建对头部运动具有抗干扰能力的向量,本文对头部运动但眼睛注视同一目标点不变情况下眼动向量的变化趋势进行了分析,并寻找将此眼动向量(Vx,Vy)映射回标定位置眼动向量(Vx0,Vy0)的方法.如公式(3)所示,移动后眼动向量(Vx,Vy)与标定位置的(Vx0,Vy0)可由公式(3)建立映射关系:

再结合公式(1)便可以计算出头部移动后眼睛注视点位置

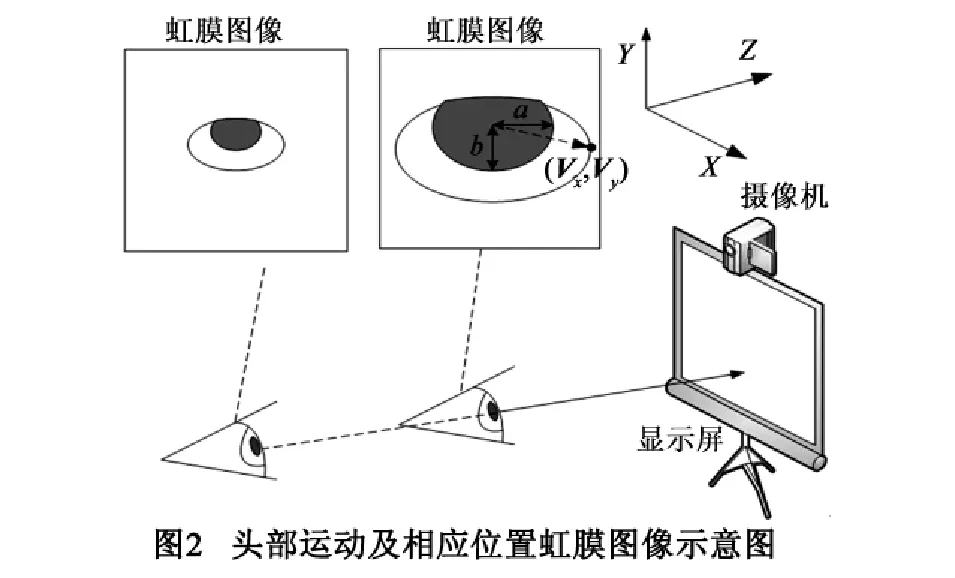

当眼睛注视着某一位置而头部位置变化时,眼动向量(Vx,Vy)也会发生变化,同时也会引起虹膜参数变化,即虹膜面积变化.如图2所示,当头部距离摄像机越近,虹膜面积越大,眼动向量的模‖Vx‖和‖Vy‖也会越大;反之,当头部离摄像机越远,虹膜面积越小,相应的‖Vx‖和‖Vy‖也会变小.依据上述分析,本文将研究眼动向量(Vx,Vy)与虹膜面积的函数关系,从而建立对头部运动不敏感的眼动向量.

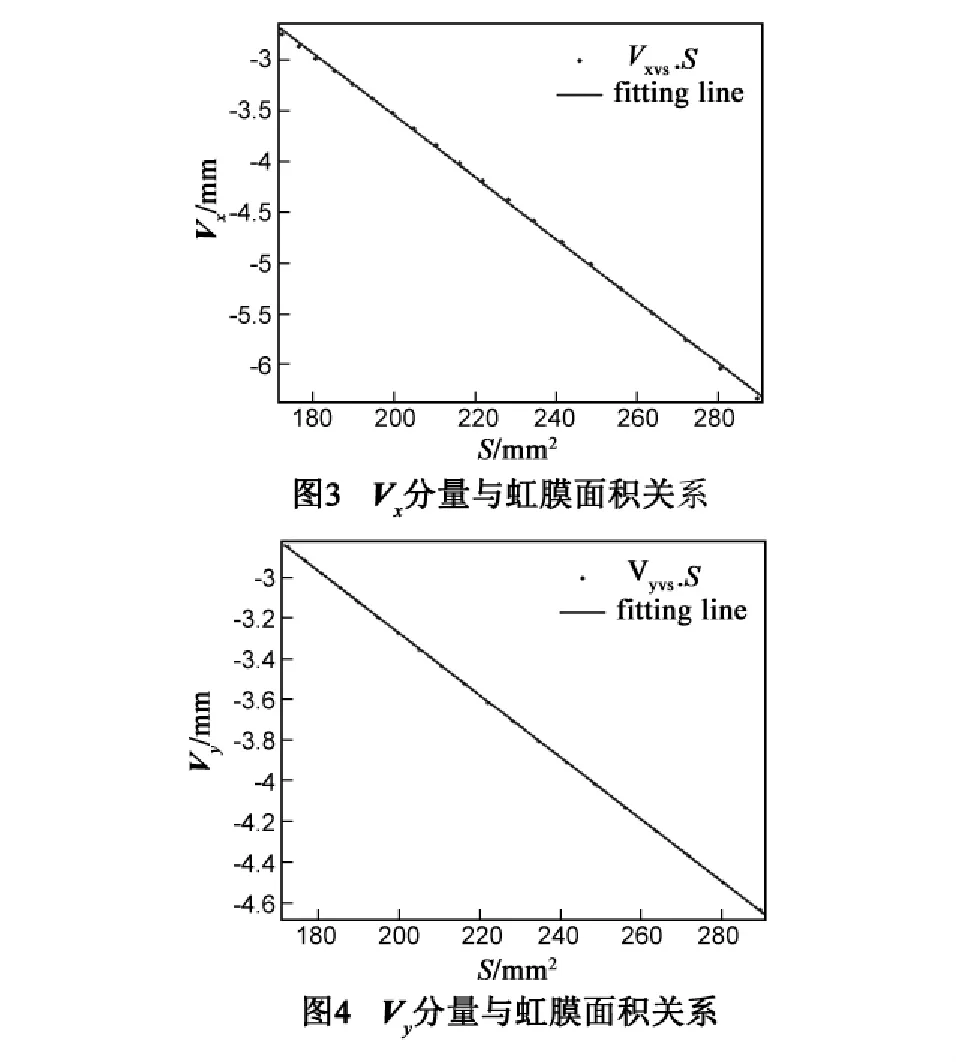

如图2所示,当眼睛注视着同一位置点时,头部沿着前后方向运动,分别记录20个不同位置时眼动向量(Vx,Vy)及虹膜长短轴数据.首先分析Vx分量与虹膜面积的关系.如图3所示,上述实验数据可拟合为直线Vx= K1×S + B1,其中虹膜面积S =π×a×b,a与b分别为虹膜长轴与短轴,可见Vx的变化与虹膜面积变化线性相关.

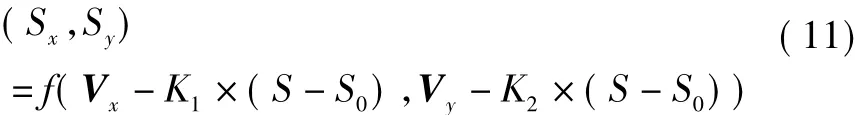

同理,Vy分量与虹膜面积的关系如图4所示,可拟合为直线Vy= K2×S + B2.由此可见,当头部前后运动时,眼动向量变化与虹膜面积变化线性相关.

当头部沿着上下或者左右方向运动时,也会引起对眼动向量和虹膜面积发生类似的变化,使得眼动向量与虹膜面积线性相关.因此,本文采用虹膜面积对眼动向量进行校正,用于获得稳定的对头部运动抗干扰能力的眼动向量(Vx,Vy).

综上所述,可以获得眼动向量(Vx,Vy)与虹膜面积之间的函数关系如式(5)和(6)所示,其中K1和K2分别表示Vx和Vy随着面积的变化率.

4 可克服头部运动影响的注视点眼动向量

为了克服头部运动的影响,需要将运动后的眼动向量(Vx,Vy)映射为标定位置眼动向量(Vx0,Vy0),该映射关系有多种形式,文献[12]采用眼睛内外角点距离进行标准化,而本文采用虹膜面积进行标准化.当头部沿前后方向运动时,分别利用以上两种方式进行标准化,所得的眼动向量分别为

本文中虹膜面积标准化关系式如式(7)和(8)所示.

其中S0=π×a0×b0为使用者标定点处的虹膜面积,S为当前头部位置处的虹膜面积,由此可以将向量(Vx,Vy)映射为标定点处的向量

文献[12]中眼角点间距标准化关系式为

其中D0为使用者标定点处的眼睛内外角点间的欧氏距离,D为当前头部位置处的眼睛内外角点欧氏距离.

依据公式(7),(8),(9),(10),使用者以距离屏幕中点550mm的空间位置点为头部空间标定点位置,此时头部正对屏幕中心并处于静止状态,摄像机捕捉此时人眼图像并进行眼动参数的提取,定位出虹膜中心与眼睛内外角点,记录对应的坐标值并求取相应的S0与D0,然后使用者以头部空间标定点位置为中心在距离屏幕450mm至650mm范围内进行头部前后移动,并分别计算20个不同位置时(Vx,Vy)、S及D数据,依据公式(7),(8),(9),(10)得出相应的虹膜面积标准化眼动向量与眼角点间距标准化向量,其结果对比如图5、图6所示.直线1与直线3表示拟合所得的直线,直线2与直线4表示拟合所得的直线,图中横坐标表示头部与屏幕的距离(450mm-650mm),纵坐标表示标准化后的眼动向量分量.从结果对比可以看出,在头部运动时,可拟合成一条水平方向的直线,说明经虹膜面积标准化后的分量不会随着头部位置变化,对头部运动不敏感,而会随着头部位置变化,对头部运动不具有稳定性.因此利用虹膜面积进行标准化比利用眼睛内外角点间距离标准化具有更好的抗干扰能力.

综合公式(1),(3)以及(7),(8),可以得到方程:

依据公式(11),可以对眼动量向量进行实时的标准化调整,实现眼动向量与注视点的一一映射.

5 实验结果

本文视线跟踪系统采用单目摄像机,在自然光下使用,无需主动红外光源辅助,基于VS2010和OPENCV进行算法验证与仿真分析.采用虹膜特征与眼睛内角点作为眼动参数,从图像设备获取人脸图像后,通过人眼定位得到眼睛区域图像,如图7(a)所示.对该图像进行滤波、直方图均衡以及灰度拉伸图像预处理操作,再进行自适应双阈值二值化处理[14],分别得到虹膜左右轮廓有效边缘像素点,结合椭圆拟合方法提取出虹膜轮廓;然后采用具有方向性的SUSAN算子,依据眼睛内角点与虹膜中心的相对位置关系,定位到眼睛内角点的精确位置,提取结果如图7 (b)所示.

本文与文献[12]系统配置对比如表1所示.在参数标定过程中,文献[12]中设置4×4个显示屏标定点,以距离屏幕中心630mm的空间位置点为头部空间标定点位置,标定时头部正对屏幕中心并处于静止状态;而本文采用3×3个显示屏标定点,以离屏幕中心550mm的空间位置点为头部空间标定点位置.在实际测试过程中,文献[12]仅采用了距离屏幕580mm的空间位置进行了测试,本文采用了距离屏幕450mm至650mm范围内的不同位置进行测试.为了进一步说明第4节中两种标准化眼动向量的性能差异,将文献[12]中的眼角点间距标准化向量应用于本文实验条件中,利用公式(2)中的多项式映射模型进行注视点映射,进而分析各自的误差.

表1 系统配置对比

依据第2、3、4节建立实验系统,进行实验数据收集与分析.选取20个测试者数据,以屏幕中心点为参考点,建立空间直角坐标系,每一个测试者都要经历以下步骤:首先是参数标定,以距离屏幕中点550mm的空间位置点为头部空间标定点位置,此时头部正对屏幕中心并处于静止状态,眼睛依次注视屏幕上设定的9个标定点位置,建立眼动向量与屏幕注视点的映射模型,并求取映射模型的参数,用于对注视点位置的计算;其次,测试者以头部空间标定点位置为中心,在(200mm× 100mm×200mm)的空间范围内运动,在其中的每一个空间测试点,测试者要注视屏幕上设定的不同测试点,并通过本文算法计算出注视点与真实的注视点之间的误差.综合以上两步便可以得到算法模型的注视点估计精度,以下通过两种方式验证本文提出的眼动向量的性能.

第一种方式以测试者的空间位置为基准,获取在不同空间位置下注视不同屏幕位置点的平均误差.如表2(a),(b),(c)所示,以头部空间标定点位置(0,350,550) mm为原点,头部分别在空间75个位置间移动,具体位置如表2所示.在这些空间位置,测试者分别注视屏幕上8×8个测试点,并计算出相应注视点的估计误差.为验证所出提出眼动向量的性能,表2中与文献[12]的方法进行对比.

表2(a)运用虹膜中心与眼睛内角点构造向量(原始向量),注视点总体误差均值为50.4mm.该向量未作任何校准,因此当头部偏离标定点时,相应的注视点估计误差便快速增大.表2(b)使用眼睛内外角点距离对原始眼动向量进行标准化,对头部运动具有一定抗干扰能力,其误差的总体均值为22mm.表2(c)使用本文动态注视点眼动向量,其误差的总体均值为16mm,其注视点估计精度比前二种眼动向量分别提高了68.2%和27.3%.对头部在空间不同位置的测试结果进行对比,可以发现采用本文提出眼动向量得到的注视点估计精度更高,对头部运动的容忍能力更强.

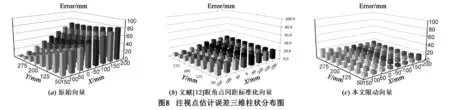

第二种方式以屏幕注视点为基准,统计测试者在不同空间位置注视同一屏幕注视点时的平均误差.三种眼动向量的注视点估计误差如三维柱状图8所示,屏幕范围为-200mm<X<150mm,50mm<Y<312.5mm,柱状图高度为头部在不同空间位置注视该平面点时的误差值.对于图中某一屏幕位置点(x,y),测试者眼睛注视着同一空间位置而头部位置在(200mm×100mm×200mm)空间里运动,并计算出该注视点相应的估计误差.图8(a)为原始眼动向量下的注视点估计误差;图8(b)为使用眼睛内外角点的距离对上述原始眼动向量进行标准化后的估计误差; 图8(c)为采用本文提出的眼动向量时的结果.三种向量下的视线总体估计误差如表3所示,本方法屏幕注视点平均误差可达到13.8mm,总体平均误差相对于图8(a),(b)方式分别提高了69.6%及31.3%,其容许头部运动能力更突出.

表2 不同空间位置中各眼动向量的注视点误差分布

表3 总体估计误差分析

6 结论

本文建立自然光下的动态注视点眼动向量,通过获取虹膜参数与眼睛内角点,并利用虹膜面积信息对眼动向量进行标准化,最终建立基于虹膜与眼睛内角点的动态的注视点眼动向量,其允许头部自由运动同时使得注视点的精度满足系统要求.实验证明,本文提出的自然光下的动态注视点眼动向量在头部运动空间(200mm×100mm×200mm)内平均精度可以达到1.5°,在头部运动范围、精度以及实时性上都有了较大的提高.

参考文献

[1]Lee J W,Cho C W,Shin K Y,et al.3D gaze tracking method using Purkinje images on eye optical model and pupil[J].Optics and Lasers in Engineering,2012,50(5) : 736-751.

[2]张闯,迟健男,张朝晖,王志良.一种基于立体视觉的视线估计方法[J].电子学报,2010,38(5) : 1008-1013.ZHANG Chuang,CHI Jian-nan,ZHANG Zhao-hui,WANG Zhi-liang.A novel gaze estimation method based on stereo vision[J].Acta Electronica Sinica,2010,38(5) : 1008-1013.(in Chinese)

[3]IEC/EN 62471-2006,Photobiological safety of lamps and lamp systems[S].

[4]Roberts D J,Rae J,Duckworth T W,et al.Estimating the gaze of a virtuality human[J].IEEE Transactions on Visualization and Computer Graphics,2013,19(4) : 681-690.

[5]Bakker N M,Lenseigne B A J,Schutte S,et al.Accurate gaze direction measurements with free head movement for strabismus angle estimation[J].IEEE Transactions on Biomedical Engineering,2013,60(11) : 3028-3035.

[6]Waizenegger W,Atzpadin N,Schreer O,et al.Model based 3D gaze estimation for provision of virtual eye contact [A].2012 19th IEEE International Conference on Image Processing[C].Berlin: IEEE Press,2012.1973-1976.

[7]Panev S,Petrov P,Boumbarov O,et al.Human gaze tracking in 3D space with an active multi-camera system[A],2013 IEEE 7th International Conference on Intelligent Data Acquisition and Advanced Computing Systems[C].Berlin: IEEE Press,2013.419-424

[8]Wen Zhang,Taining Zhang,Shengjiang Chang.Eye gaze estimation from the elliptical feature of one iris[J].Optical Engineering,2011,50(4) : 047003-047003-9

[9]Guestrin E D,Eizenman E.General theory of remote gaze estimation using the pupil center and corneal reflections [J].IEEE Transactions on Biomedical Engineering,2006,53(6) : 1124-1133.

[10]Mohammadi M R,Raie A.Selection of unique gaze direction based on pupil position[J].IET Computer Vision,2013,7(4) : 238-245.

[11]Nguyen B L,Chahir Y,Molina M,et al.Eye gaze tracking with free head movements using a single camera[A].Proceedings of the 2010 Symposium on Information and Communication Technology[C].New York,USA: ACM Press,2010.108-113.

[12]Sesma L,Villanueva A,Cabeza R.Evaluation of pupil center-eye corner vector for gaze estimation using a web cam [A].Proceedings of the Symposium on Eye Tracking Research and Applications[C].New York,USA: ACM Press,2012.217-220.

[13]秦华标,严伟洪,王信亮,等.一种可克服头动影响的视线跟踪系统[J].电子学报,2013,41(12) : 2403-2408.QIN Hua-biao,YAN Wei-hong,WANG Xin-liang.A Gaze Tracking System Overcoming Influences of Head Movements[J].Acta Electronica Sinica,2013,41(12) : 2403-2408.(in Chinese)

[14]范九伦,赵凤.灰度图像的二维Otsu曲线阈值分割法[J].电子学报,2007,35(4) : 751-755.FAN Jiu-lun,ZHAO Feng,WANG Zhi-liang.Two-dimensional otsu’s curve thresholding segmentation method for gray-level images[J].Acta Electronica Sinica,2007,35 (4) : 751-755.(in Chinese)

秦华标男,1967年出生于湖南省张家界市,现为华南理工大学电子信息学院教授,主要研究方向为智能信息处理、无线通信、嵌入式系统与FPGA设计.

E-mail: eehbqin@ scut.edu.cn

王信亮男,1987年出生于安徽省阜阳市,2011年毕业于安徽师范大学,现为华南理工大学电子信息学院在读硕士研究生,主要研究方向为计算机视觉、图像处理以及视线跟踪算法.

E-mail: li-ang-scut@ foxmail.com

A Novel Dynamic Gaze Vector in Natural Light

QIN Hua-biao,WANG Xin-liang,LU Jie,HU Da-zheng

(School of Electronic and Information Engineering,South China University of Technology,Guangzhou,Guangdong 510641,China)

Abstract:In order to deal with the constraint on accuracy and head movements in natural light,a novel dynamic gaze vector constructed by iris center and inner eye corner is proposed.The gaze vector,which is normalized by iris area to overcome the influences of head movements,is combined with the polynomial mapping model for real-time fixation point calculation,realizing the best mapping relation between the vector and the gaze point.The gaze vector proposed can improve the fixation point estimation precision and eliminate the influences of head movements.

Key words:iris; inner eye corner; gaze tracking; natural light

作者简介

基金项目:国家自然科学基金(No.60972136) ;广东省科技计划项目(No.2011A010801005)

收稿日期:2014-07-11;修回日期: 2015-03-12;责任编辑:马兰英

DOI:电子学报URL: http: / /www.ejournal.org.cn10.3969/j.issn.0372-2112.2016.02.025

中图分类号:TP391.41

文献标识码:A

文章编号:0372-2112 (2016) 02-0420-06