集成成像3D拍摄与显示方法

2014-03-21王琼华

王琼华,邓 欢

(四川大学 电子信息学院,四川 成都610065)

1 引 言

三维(3D)显示是指采用光学和计算机等多种技术手段来模拟实现人眼的立体视觉特性,将空间物体以3D 信息再现出来,呈现出具有纵深感的立体图像的一种显示方式[1]。与传统的二维(2D)显示相比,3D 显示能够带给观看者更强的视觉冲击和现场感受,能够把人的感官甚至于思想完全带入到所观看的场景中去,不仅能让观看者获得前所未有的视觉盛宴,还可以体验一种不一样的生活方式。在众多的3D 显示技术中,集成成像因其对光源没有特殊要求(不需要相干光源),信息量相对较少,超薄屏幕(可壁挂),片源获取相对容易,成本低廉等优点,已成为3D 显示领域的研究热点之一[1-3]。

集成成像包括记录和再现两个过程。记录过程利用微透镜阵列记录3D 场景在不同角度的3D 信息,由于构成微透镜阵列的每个透镜元从不同方向记录3D 场景的小部分信息,每个透镜元都具有独特的成像功能,在每个透镜元的后焦平面上对应生成了一幅不同方位视角的微小图像,称为图像元,所有的图像元组成了微图像阵列。在这一过程中,3D 场景中的任意一点都被许多透镜元记录下来,该点的3D 信息就被扩散记录于微图像阵列中。再现过程中,利用普通2D 显示器显示微图像阵列,再使用与记录时参数相同的微透镜阵列与之精密耦合,根据光路可逆原理,微透镜阵列又把所有图像元像素发出的光线聚集还原,在微透镜阵列的前后方重建出与记录时的3D场景完全相同的3D 图像。由于CCD 等记录器件和LCD 等显示器件的发展成熟,集成成像记录端的胶片可由CCD 代替,再现端的胶片可由LCD 等显示器代替,由此构成集拍摄和显示3D图像及3D 视频于一体的集成成像系统,其对应的两个过程又分别称为集成成像3D 拍摄和集成成像3D 显示。本文将介绍集成成像的几种拍摄和显示方法。

2 集成成像3D 拍摄方法

在长达100多年有关集成成像技术的研究过程中,人们累积了多种3D 拍摄方法,如全光学3D 拍摄法、直接3D 拍摄法、扫描式3D 拍摄法、摄像机阵列3D 拍摄法和计算机生成法等,下面一并进行介绍。

2.1 全光学3D 拍摄法

G.Lippmann在1908年首次提出的集成摄影术就是采用的全光学3D 拍摄法[1],它使用真实的光学元件来完成。在微透镜阵列的后焦平面上涂上一层感光乳剂,然后用漫射光照射3D 场景,被3D 场景反射的光线到达微透镜阵列上,再被微透镜阵列折射到感光乳剂上,这样感光乳剂就记录下了一幅微图像阵列。全光学3D 拍摄法是最原始最粗糙的集成成像3D 拍摄法,存在深度反转问题。而后1931年H.E.Ives提出的两步记录法能解决深度反转问题,但是多次使用微透镜阵列和感光乳剂,使得记录的微图像阵列模糊不清[4]。

2.2 直接3D 拍摄法

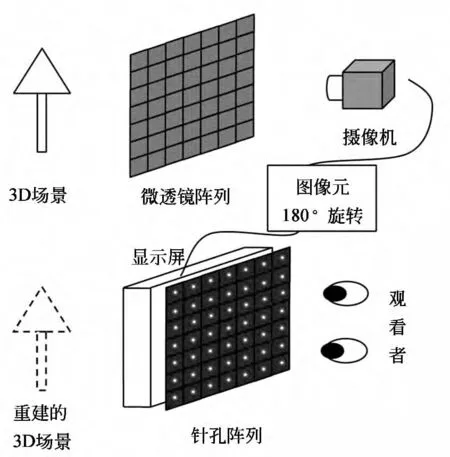

1997年,日本的F.Okano等人采用直接拍摄法实现实时的集成成像3D 拍摄,如图1所示为该实时3D拍摄系统的原理示意图[5]。3D 场景发出的光线通过微透镜阵列的每个透镜元折射,然后被摄像机直接拍摄下来,形成了微图像阵列。每个图像元各自中心旋转180°之后,被传送到集成成像3D显示器上显示,该3D显示器由普通的二维显示器和一个针孔阵列组成,针孔阵列可以用来代替微透镜阵列,由于图像元经过了180°旋转,解决了深度反转问题。但该方法重建的3D 图像只能是虚像,即凹进显示屏幕里面,没有凸出显示屏幕之外的实像,其3D显示效果不佳。

图1 直接拍摄法的原理示意图Fig.1 Direct 3Dpickup method

后来M.Martinez-Corral等人提出,在微透镜阵列与摄像机中间加入一个成像物镜,便可进行深度可调的集成成像3D 拍摄。由于附加的成像物镜将会带来一次深度反转,加之集成成像本身的深度反转,两次深度反转之后将是深度正确的3D 图像,则不需进行180°旋转或两步记录来解决深度反转问题,且通过适当调节成像物镜的位置,可以同时实现实像和虚像的3D 显示[6]。J.Arai等人改进了传统的直接拍摄法,将渐变折射率微透镜阵列直接与图像传感器相贴合,避免了相机镜头的使用所带来的图像畸变等问题[7]。但上述方法需要附加相应的光学器件,如成像物镜、渐变折射率微透镜阵列等,将引入图像畸变等问题,也增加了系统的复杂度。J.H.Kim 等人将直接拍摄法获得的微图像阵列进行实时的计算机处理,通过控制中心深度平面的位置提高了图像质量[8]。

2.3 扫描式3D 拍摄法

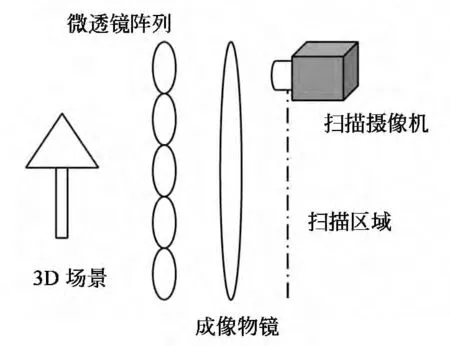

一种较简单的集成成像3D 拍摄方法是采用平台式 的扫描3D 拍 摄 法[9-10],其3D 拍 摄 原 理 示意图和实验装置如图2所示,扫描摄像机被安置在一个扫描平台上,通过平台的平行移动来拍摄不同角度的3D 信息。该方法由于需要一段时间的扫描,因此要求3D 场景在扫描过程中是绝对静止的,静止时间依赖于扫描频率,一般来说大概几分钟时间。对于大节距的透镜元,图像元分辨率为20×20个像素以上时,才能较为清楚地重建出3D 图像,而扫描式3D 拍摄法使用的摄像机较难获得高分辨率的微图像阵列。

图2 扫描式3D 拍摄法示意图Fig.2 Scanning pickup method

2.4 摄像机阵列3D 拍摄法

组成微透镜阵列的每个透镜元都可以用摄像机来代替,因此可以用等间距排列的摄像机阵列来代替微透镜阵列,如图3所示为摄像机阵列3D拍摄法示意图[11]。由于透镜元成像和摄像机成像存在上、下、左、右翻转的关系,那么采用摄像机阵列拍摄获取的微图像阵列就相当于微透镜阵列拍摄的微图像阵列中每个图像元进行180°旋转后的效果,因此摄像机阵列3D 拍摄法获取的微图像阵列没有深度反转问题。而每个摄像机只需要获取一个图像元,因此图像元的分辨率很高,可以组合成高质量的微图像阵列。但是该方法所需的摄像机个数较多,等于所需的图像元个数,各摄像机间需要进行匹配、矫正等复杂操作,不适合大场景的集成成像3D 拍摄。

图3 摄像机阵列3D 拍摄法示意图Fig.3 3Dpickup method using camera array

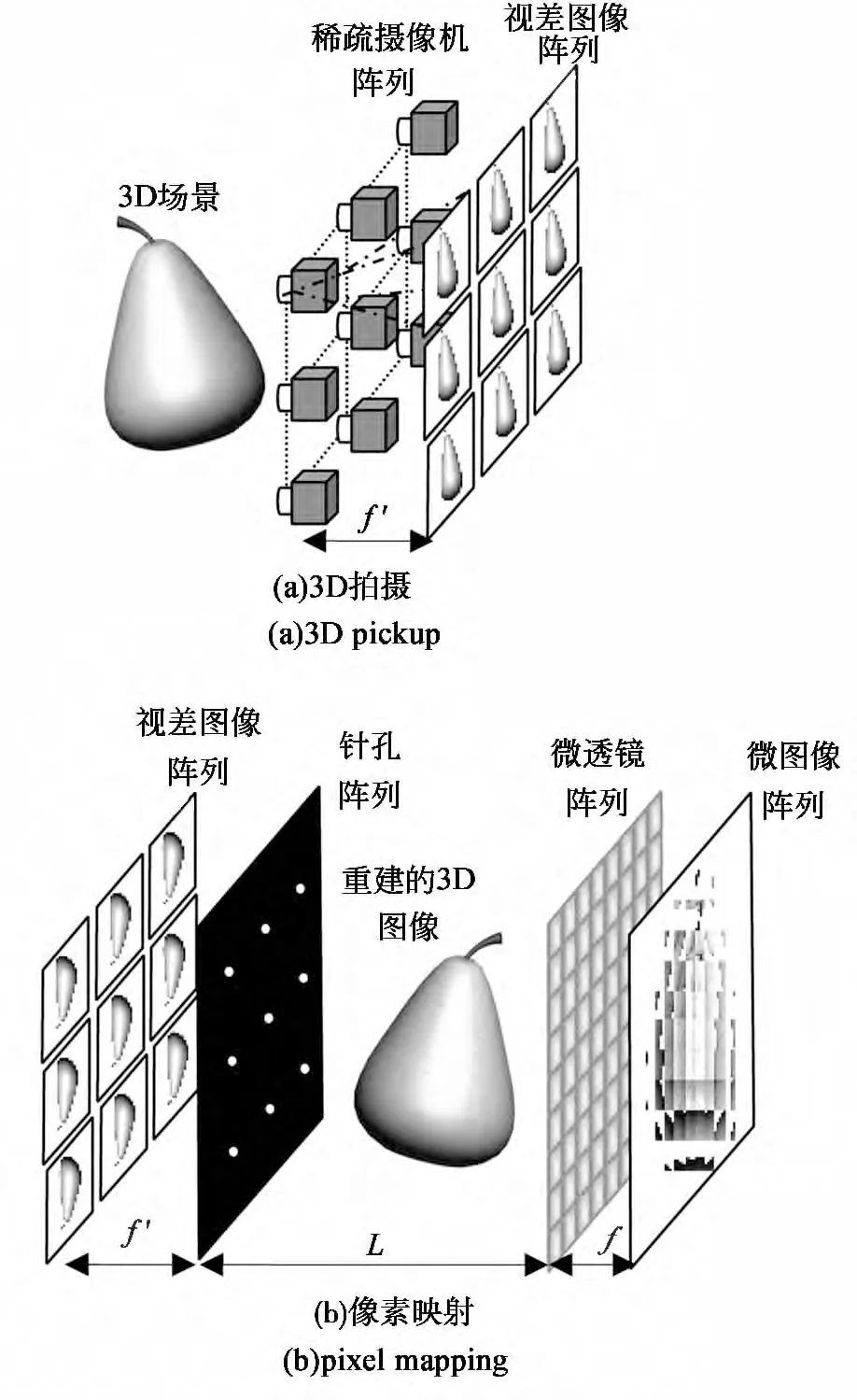

图4 稀疏摄像机阵列3D 拍摄法示意图Fig.4 3Dpickup method using sparse camera array

稀疏摄像机阵列法可以大幅度地减小拍摄时的摄像机个数,使得大场景的集成成像3D 视频拍摄成为可能。如图4所示稀疏摄像机阵列拍摄3D 场景不同角度的立体信息,获得视差图像阵列,然后在计算机中通过建立的像素映射模型将视差图像阵列转换为微图像阵列,就可获得集成成像3D 显示所需的微图像阵列[12-13]。

2.5 计算机生成法

随着计算机技术的发展,人们开始用计算机程序代替实际微透镜阵列或摄像机来进行3D拍摄。M.Halle等人在1998年提出多视点渲染算法,该算法在计算机中设置虚拟的相机阵列来代替微透镜阵列的各个透镜元对3D 模型进行渲染,获得的微图像阵列可用于实际的集成成像3D 显示[14]。但由于虚拟相机阵列包含的相机数量往往较多,计算机中需依次完成各个虚拟相机的渲染流程,导致计算过程十分耗时,无法实现微图像阵列的实时渲染。S.W.Min等人基于方向性投影原理分别提出了点回溯算法[15]与视矢量渲染算法[16],两种算法的虚拟相机渲染次数均等于图像元的像素个数,由于减少了虚拟相机的渲染次数,故生成微图像阵列的计算效率有所提高。点回溯算法仅适用于集成成像的聚焦显示模式,而视矢量渲染算法虽然适用于集成成像的所有显示模式,但该算法的计算效率受图像元像素个数的限制,且不适用于大数据量3D模型的实时渲染。

为了进一步提高计算机集成成像技术生成微图像阵列的效率,科研工作者们开始尝试采用GPU 并行处理数据技术来加速微图像阵列的生成过程。K.C.Kwon等人在2012年提出基于图像空间的并行计算算法[17],其优势在于该算法大大降低了3D 模型数据量对生成微图像阵列过程的影响。由于微图像阵列的渲染效率几乎仅与其像素个数有关,而该算法采用GPU 并行计算来完成微图像阵列中各个像素的计算,故其计算效率可满足大数据量3D模型的实时渲染。S.H.Jiao等人在2013年提出多光线集成渲染算法[18],该算法通过GPU 的几何着色器将组成3D 模型的所有3D顶点数据进行复制,使得所有的3D顶点均可通过一个透视投影几何关系映射至单张纹理中,大大降低了GPU 与CPU 间数据传输的时间,从而有效地提高了微图像阵列的生成效率。

集成成像的计算机生成法虽然只能用于计算机模型和动画的3D 拍摄,但其成本较低、拍摄速度快,已基本能实现较大场景的实时3D 拍摄,是目前常用的集成成像3D 拍摄方法。

3 集成成像3D 显示方法

集成成像的3D 显示过程包括基于视点的3D 显示和基于深度平面的3D 显示两种,下面简略分析这两种集成成像3D 显示方法。

3.1 基于视点的3D 显示

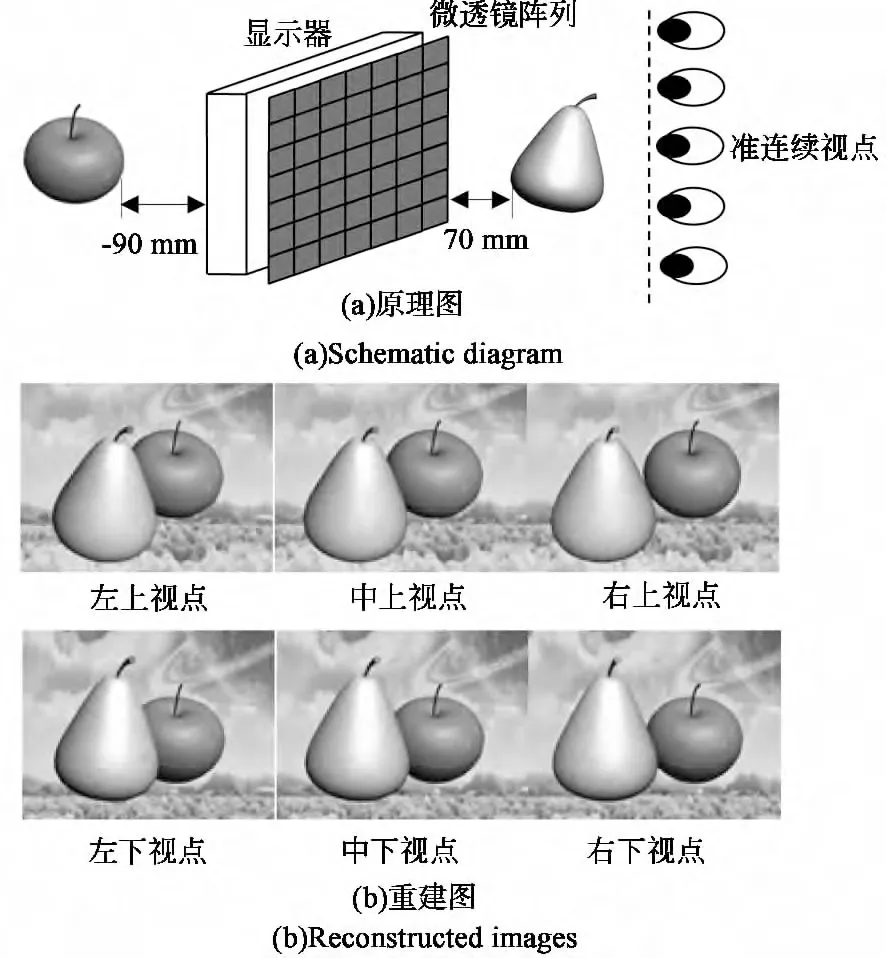

虽然集成成像3D 显示在一定的观看视区内具有连续的视点,但由于采用了离散化像素结构的感光器件进行集成成像3D 拍摄和3D 显示,因此,集成成像3D 显示在观看视区内具有准连续的视点。如图5(a)所示为基于视点的集成成像3D 显示原理图,观看者在准连续视点内的不同位置上都可以清晰地观看到3D 图像,从而获得明显的立体感[19]。由于人眼通过每个透镜元只能在对应图像元上看到一个像素信息,因此人眼每只眼睛看到的像素个数,即3D 分辨率,等于微透镜阵列中的透镜元个数。如图5(b)所示为基于视点的集成成像3D 显示获得的6个不同视点上的图像。除了传统的集成成像3D 显示外,还有360°视 角 的3D 显 示 系 统[20]以 及 平 铺 式3D 显示[21]等。该基于视点的集成成像3D 显示方法能为观看者提供直观的3D 感受,可用于娱乐、广播传媒、虚拟现实[22-23]、医学[24-25]等方面。

图5 基于视点的集成成像3D 显示Fig.5 Integral imaging 3Ddisplay based on viewing point

3.2 基于深度平面的3D 显示

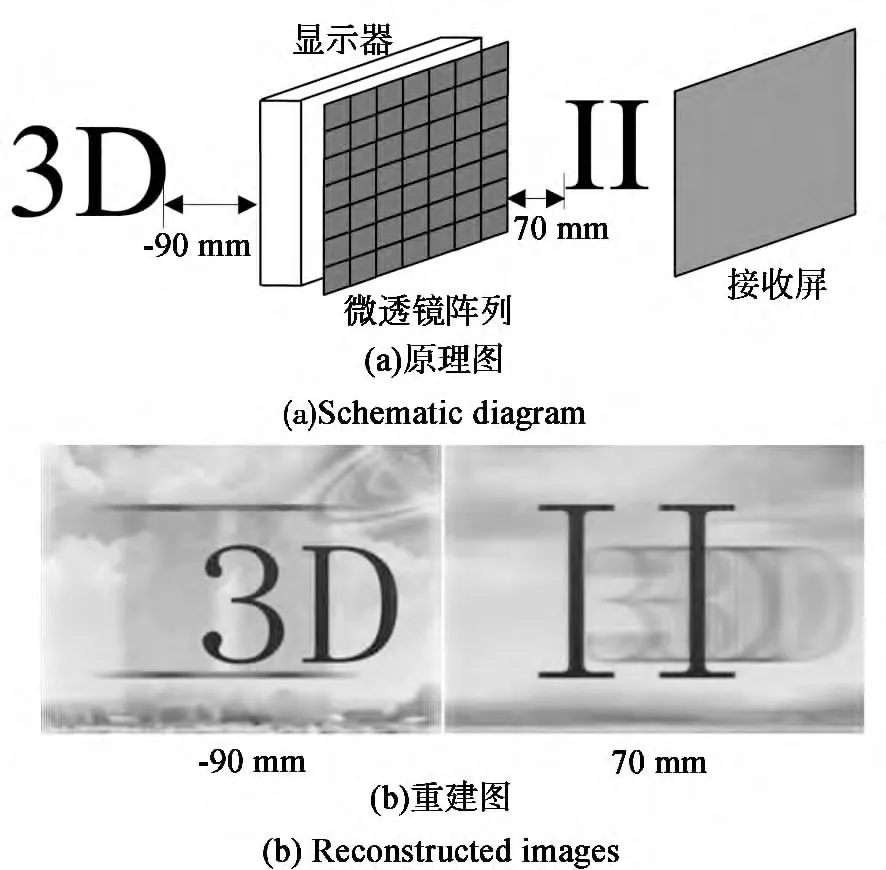

图6 基于深度平面的集成成像3D 显示Fig.6 Integral imaging 3Ddisplay based on the depth plan

基于深度平面的集成成像3D显示的原理如图6(a)所示,显示器上像素发出的光线经过微透镜阵列折射后,在空间中会聚成像,重建出3D图像,但所有的光线并不会终止,而是继续向前传播,并到达接收屏上,因此该接收屏可在不同深度平面上接收到重建的3D图像。当接收屏位于重建3D图像的深度平面上时,将接收到清晰的图像,否则接收到的则是模糊的图像。在计算机中还可以设置虚拟的负深度,从而接收到3D 虚像。如图6(b)所示为负深度和正深度平面上分别接收到的重建的3D 虚像和3D 实像,当接收屏位于-90mm 处时,字符“3D”成清晰像,而字符“II”则成模糊像,反之亦然。该方法可用于遮挡物体的3D 重现[26-27]、微生物识别[28]和深度重建[29]等方面。

4 结 论

各国的科研工作者在集成成像技术方面进行了深入的研究并提出很多有效的解决方法,本文对集成成像3D 拍摄和显示的部分技术进行了介绍。稀疏相机阵列法减小了相机个数、能适用于真实大场景的3D 拍摄,而计算机生成法拍摄速度快、成本低、可进行计算机模型的实时视频拍摄,将是集成成像3D 拍摄的主流技术。随着计算机技术、微透镜阵列制备工艺、记录和显示设备等的快速发展,集成成像将是未来3D 显示技术的主要发展方向之一,并在3D 电视、3D 印刷、深度测量、建筑、娱乐、军事、医学诊断等领域具有很广泛的应用前景。期待集成成像3D 显示走进千家万户,改变人们的生活。

[1] 王琼华.3D 显示器件与技术[M].北京:科学出版社,2011.Wang Q H.3 D Display Technology and Device[M].Beijing:Science Press,2011.(in Chinese)

[2] Lippmann G.La photographie integral[J].Comptes Rendus de l'Académie des Sciences,1908,146:446-451.

[3] Xiao X,Javidi B,Martinez-Corral M,et al.Advances in three-dimensional integral imaging:sensing,display,and applications[J].Applied Optics,2013,52(4):546-560.

[4] Ives H E.Optical properties of a lippmann lenticulated sheet[J].Journal of the Optical Society of America A,1931,21:171-176.

[5] Okano F,Hoshino H,Aral J,et al.Real-time pickup method for a three-dimensional image based on integral photography[J].Applied Optics,1997,36(7):1598-1603.

[6] Martínez-Corral M,Martínez-Cuenca R,Saavedra G,Orthoscopic,long-focal-depth 3Dintegral imaging[C]∥Proceedings of the SPIE,Stockholm,Sweden,2006:63940H(1-9).

[7] Aral J,Yamashita T,Miura M,et al.Integral three-dimensional image capture equipment with closely positioned lens array and image sensor[J].Optics Letters,2013,38(12):2044-2046.

[8] Kim J,Jung J H,Jang C,et al.Real-time capturing and 3Dvisualization method based on integral imaging[J].Optics Express,2013,21(16):18742-18753.

[9] Wang X,Hong H.Theoretical analysis for integral imaging performance based on micro-scanning of a microlens array[J].Optics Letters,2008,33(5):449-451.

[10] Papageorgas P G,Athineos S S,Sgouros N P,et al.3Dcapturing devices based on the principles of integral photography[C]∥1st International Scientific Conference,Tripoli,Libya,2006.

[11] Deng H,Wang Q H,Li D H,et al.Realization of undistorted and orthoscopic integral imaging without black zone in real and virtual fields[J].Journal of Display Technology,2011,7(5):255-258.

[12] Deng H,Wang Q H,Li D H,et al.1Dintegral imaging based on parallax images’virtual reconstruction[J].Chinese Optics Letters,2013,11(4):041101(1-4).

[13] Deng H,Wang Q H,Li D H.Method of generating orthoscopic elemental image array from sparse camera array[J].Chinese Optics Letters,2012,10(6):061102(1-3).

[14] Halle M.Multiple viewpoint rendering[C]∥SIGGRAPH ’98,Proceedings of the 25th Annual Conference on Computer Graphics and Interactive Techniques,1998:243-254.

[15] Min S W,Kim J,Lee B.New characteristics equation of three-dimensional integral imaging system and its applications[J].Japanese Journal of Applied Physics,2005,44(2):L71-L74.

[16] Park K S,Min S W,Cho Y.Viewpoint vector rendering for efficient elemental image generation[J].The Institute of Electronics,Information and Communication Engineers,2007,90(4):231-241.

[17] Kwon K C,Park C,Yoo K H,et al.High speed image space parallel processing for computer-generated integral imaging system[J].Optics Express,2012,20(2):732-740.

[18] Jiao S H,Wang X G,Kim J Y,et al.Multiple ray cluster rendering for interactive integral imaging system [J].Optics Express,2013,21(8):10070-10086.

[19] Deng H,Wang Q H,Li D H,et al.Realization of undistorted and orthoscopic integral imaging without black zone in real and virtual fields[J].Journal of Display Technology,2011,7(5):255-258.

[20] Jung J H,Park G,Kim Y,et al.360-degree viewable cylindrical integral imaging system using electroluminescent films[C]∥9th International Meeting on Information Display (IMID),Ilsan,Korea,2009:1254-1257.

[21] Hirayama Y,Saishu T,Fukushima R,et al.Flatbed-type auto stereoscopic display systems using integral imaging method[C]∥Consumer Electronics,Digest of Technical Papers,Las Vegas,USA,2006:125-126.

[22] Yanaka K,Yoda M,Lizuka T.Floating Integral Photography Using Fresnel Mirror[C]∥IEEE Virtual Reality,CA,USA,2012:135-136.

[23] Son J Y,Son W H,Kim S K,et al.Three-dimensional imaging for creating real-world-like environments[J].Proceedings of the IEEE,2013,101(1):190-205.

[24] Liao H,Sakuma I,Dohi T.Development and evaluation of a medical autostereoscopic image integral videography for surgical navigation[C]∥International Conference on Complex Medical Engineering,Beingjing,China,2007:213-218.

[25] Liao H,Hata N,Nakajima S,et al.Surgical navigation by autostereoscopic image overlay of integral videography[J].IEEE Transactions on Information Technology in Biomedicine,2004,8(2):114-121.

[26] Xiao X,Daneshpanah M,Javidi B.Occlusion-removed scheme using depth-reversed method in computational integral imaging[J].Journal of Display Technology,2012,8(8):483-490.

[27] Zhang M,Piao Y,Kim E S.Occlusion removal using depth mapping in three-dimensional integral imaging[J].Applied Optics,2010,49(14):2571-2580.

[28] Javidi B,Moon I,Yeom S.Three-dimensional identification of biological microorganism using integral imaging[J].Optics Express,2006,14(25):12096-12106.

[29] Deng H,Li D H,Wang Q H,et al.Integral imaging without image distortion using micro-lens arrays with different specifications[J].Optical Engineering,2013,52(10):103113(1-5).