融合项目影响力的图神经网络会话推荐模型

2024-01-09孙轩宇史艳翠

孙轩宇,史艳翠

融合项目影响力的图神经网络会话推荐模型

孙轩宇1,史艳翠1,2*

(1.天津科技大学 人工智能学院,天津 300457; 2.国家开放大学 数字化学习技术集成与应用教育部工程研究中心,北京 100039)(∗通信作者电子邮箱syc@tust.edu.cn)

针对现有的会话推荐模型难以显式地表示项目对推荐结果的影响的问题,提出一种融合项目影响力的图神经网络会话推荐模型(SR-II)。首先,提出一种新的边权重计算方法,将计算结果作为图结构中转移关系的影响力权重,并用图神经网络(GNN)的影响力图门控层提取该图的特征;其次,提出改进的捷径图连接有关联的项目,有效捕获远程依赖,丰富图结构所能表达的信息,并通过注意力机制的捷径图注意力层提取该图的特征;最后,通过结合上述两层,构建推荐模型。在Diginetica和Gowalla数据集上的实验结果中,SR-II的HR@20最高达到53.12%,MRR@20最高达到25.79%。在Diginetica数据集上,相较于同一表征空间下基于训练模型的会话推荐(CORE-trm),SR-II在HR@20上提升了1.10%,在MRR@20上提升了1.21%。在Gowalla数据集上,相较于基于会话的自注意网络推荐(SR-SAN),SR-II在HR@20上提升了1.73%;相较于基于无损边缘保留聚合和捷径图注意力的推荐(LESSR)模型,SR-II在MRR@20上提升了1.14%。实验结果表明SR-II的推荐效果优于对比模型,具有更高的推荐精度。

会话推荐;推荐系统;图神经网络;注意力机制;会话图

0 引言

随着推荐系统的发展以及用户对隐私保护的重视,需要用户长期历史行为记录作为训练数据的传统推荐算法不再适合所有情景。为了给匿名浏览的用户和没有历史行为记录的新用户推荐符合需求的商品,同时提高在一次会话中推荐系统的性能,学者们提出了一个新的推荐系统发展方向:基于会话的推荐系统。

基于会话的推荐系统将一系列连续行为从开始到结束的过程作为一次会话。传统的推荐系统主要研究如何利用用户历史行为挖掘用户的长期兴趣偏好,基于会话的推荐系统则认为用户的短期兴趣偏好也很重要,且认为用户的短期兴趣偏好主要和一次会话中的上下文有关。同时用户选择项目的兴趣偏好是动态的,所以基于会话的推荐系统的任务是根据用户当前会话中的行为上下文预测用户下一个可能感兴趣的项目,并作出推荐。

目前的会话推荐算法存在以下两点不足:

1)在为会话序列建模时,认为同一跳的不同项目是同等重要的,忽略了项目之间的差异性,导致项目对推荐结果的影响程度不同。

2)只通过用户点击序列对连续的上下文进行建模,使项目间的转移关系局限于相邻项目之间,很难捕获不相邻的项目之间的依赖关系。

为了解决上述两点不足,本文提出了一种融合项目影响力的图神经网络会话推荐模型(Session-based Recommendation model by graph neural network fused with Item Influence, SR-II)。

本文的主要工作如下:

1)提出影响力图,在将会话构建成图的过程中使用改进的边权重计算方法,使越接近当前兴趣的转移关系在同一跳中获得的权重越大,通过加强边权重的差别增强图的表达能力。

2)为存在路径的不相邻的两个图节点间添加有向边,构建捷径图,并通过边权重提升捷径图的表达能力,提供远程项目之间的依赖关系捕获能力。

3)融合影响力图和捷径图,建立了图神经网络(Graph Neural Network, GNN)模型进行会话推荐,并在两个公开数据集上进行实验,实验结果表明了本文模型在会话推荐上的合理性和有效性。

1 相关工作

1.1 GNN

近年来,由于图结构具有较强的处理关系型数据的能力,所以学者们对图的研究和应用的探索广泛存在于各个领域,包括图像处理[1]、药物医学[2-3]和交通预测[4-5]等。

GNN是一类用于处理图结构数据的神经网络的总称,包括图卷积网络[6-7]、图循环网络[8]和图注意力网络[9-10]等。GNN具有处理关系型数据和解决长距离信息传播的能力,在社会化推荐、个性化推荐和会话推荐上表现出了较高的契合度和较好的效果[11]。

1.2 会话推荐

早期基于会话的推荐算法通常使用马尔可夫链预测用户的下一个行为。Shani等[12]提出基于马尔可夫链的推荐模型,利用项目的转换频率得到转移矩阵;但是在应用过程中当训练集中不存在转移关系时,该模型的效果较差。为了解决这一问题,Rendle等[13]提出将张量分解与马尔可夫链结合的FPMC(Factorizing Personalized Markov Chains for next-basket recommendation)模型。Davidson等[14]提出Item-KNN(Item based K-Nearest Neighbor)模型,通过计算项目之间的余弦相似度预测下一个最有可能出现的项目。

随着深度学习在许多领域取得了成功,在会话推荐领域也逐渐使用深度学习技术提高推荐算法特征提取的能力。例如Hidasi等[15]提出GRU4Rec(Gated Recurrent Unit for Recommendation)模型,将循环神经网络应用于会话推荐,因为循环神经网络能够捕捉会话中的序列模式,所以该模型取得了较好的效果;Tan等[16]改进了该模型,使用数据扩张的方法进行数据预处理,并添加dropout方法防止过拟合。

随后,注意力机制在许多机器学习任务中被使用,并在推荐系统领域引发热潮,会话推荐模型中开始嵌入注意力网络。Li等[17]提出了一个结合注意力网络和循环神经网络的NARM(Neural Attentive Recommendation Machine)模型,在循环神经网络考虑用户行为序列的基础上考虑用户的注意力。Liu等[18]认为在用户的一次会话中应该优先提取用户的当前兴趣,所以通过注意力机制为更符合用户当前兴趣的项目赋予更大的权重,达到短期注意力优先的效果。

但是基于循环神经网络的会话推荐在建模时遵循严格的线性序列关系,忽略了项目之间复杂的转移关系。为了更好地表示项目之间的转移关系,GNN逐渐被用于会话推荐。Wu等[19]提出基于GNN的会话推荐模型SR-GNN(Session-based Recommendation with Graph Neural Network)模型,该模型将会话建模成不带权重的有向图,使用门控图神经网络(Gated Graph Neural Network, GGNN)[8]顺着节点方向在邻居节点间传播信息,随后使用注意力网络读取全局兴趣,融合会话的全局兴趣和当前兴趣生成最终兴趣,最后生成推荐结果;Song等[20]认为用户兴趣是动态变化且容易受社会影响的,于是提出了动态图注意力网络进行基于会话的社会推荐;Yu等[21]提出了一种目标注意力图神经网络TAGNN(Target Attentive Graph Neural Network)模型,使模型能够针对会话中目标项目的变化而激活不同的用户兴趣,更好地进行会话推荐;Xu等[22]提出GC-SAN(Graph Contextualized Self-Attention Network for session-based recommendation)模型,结合GNN与自注意力机制,增强局部特征的提取能力;Xian等[23]结合GNN与复购-探索机制,强化复购行为;Chen等[24]提出基于无损边缘保留聚合和捷径图注意力的推荐(Lossless Edge-order preserving aggregation and Shortcut graph attention for Session-based Recommendation, LESSR)模型,将会话序列的点击顺序作为权重赋值给边,使图结构能够保留会话的顺序信息,又使用无权重的捷径图辅助捕获远程依赖,取得了较好的效果;Fang[25]提出基于会话的自注意网络推荐(Session-based Recommendation with Self-Attention Networks, SR-SAN)模型,将多头自注意力机制应用于会话推荐;南宁等[26]将用户与项目的交互作为项目间转移关系的权重,取得了较好的效果;任俊伟等[27]使用物品的类别信息作为项目的补充信息,对SR-GNN进行了改进;黄震华等[28]使用模型训练获得会话图的边权重,使用词嵌入方法获得数据集的全局特征;闫昭等[29]挖掘商品间的历史交互,使用相似度构建商品关系图,进行图卷积会话推荐;Hou等[30]提出的CORE(COnsistent REpresentation space)模型,通过设计编码器,将会话嵌入和项目嵌入统一在同一表示空间中进行会话推荐。

现有模型通常认为在传播过程中同一跳的转移关系同等重要,忽略了同一跳项目在转移概率上的差异性;在使用捷径图时,也忽略了转移关系之间的差异性。为此,本文提出了融合项目影响力的GNN会话推荐模型。

2 融合项目影响力的GNN会话推荐模型

对于一个会话,会话历史中的项目可能会影响用户对下一个感兴趣项目的判断,因此会话图同一跳的每一个转移关系对结果的影响力不同。本文提出了一种融合项目影响力的GNN会话推荐模型,结构如图1所示。

将用户会话序列构造为两个具有代表性的图结构:影响力图和捷径图。影响力图表示目标项目与同一跳中其他项目相比,对推荐结果的影响能力;捷径图为不相邻的项目间添加带权重的有向边,强化远程依赖关系,提升模型的远程依赖捕获能力。图和节点的表示将作为输入传递给多个交错的影响力图门控层和捷径图注意力层,每一层都输出新的节点表示,最后预测下一个项目的概率分布。

图结构中丰富的信息会给图神经模型更多学习选择的空间,使模型的拟合更加灵活,从而得到更好的表达,获得更好的推荐结果。

图1 本文模型的结构

2.1 相关定义

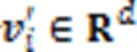

定义1 会话序列。一个会话序列表示为=[1,2,…,v],序列长度为。

2.2 将会话构建为图

2.2.1构建影响力图

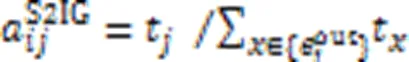

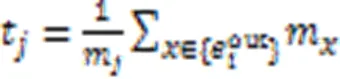

在将会话序列构建成图结构时,现有工作[19,23,29]通常将目标节点的每一条出边设定为相同权重。本文认为这类出边虽然从同一目标节点出发,但是这些边表示的转移关系的重要程度不同,这种有区别的转移关系会影响用户找到心仪项目所需的时间,本文将这样的影响称为影响力,根据影响力不同,为对应的边添加权重,具有这样边权重的图就是影响力图。

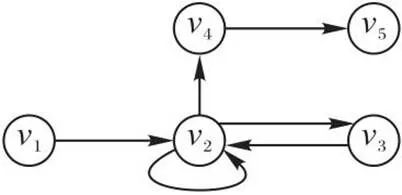

图2 会话图

如图3(a)所示,有会话序列=[1,2,2,3,2,4,5],经过计算可以得到如图3(b)所示的影响力图和如图3(c)所示的邻接矩阵。

图3 构建影响力图

2.2.2构建捷径图

图模型的逐层传播可能会忽略远程项目的信息,使得当前节点的传播与聚合只考虑相邻的少数几个节点的信息,而忽略不相邻的节点的信息。这些不相邻的节点信息称为远程依赖,丰富的远程依赖可以为模型提供更多的信息。

捷径图为可达但不相邻的两个节点添加有向边,边指向的方向由节点表示的项目在会话中出现的先后顺序决定,这样的边称为捷径。图结构通过添加捷径和自循环,可以有效学习远程依赖,并在执行消息传递时结合更新功能和聚合功能。

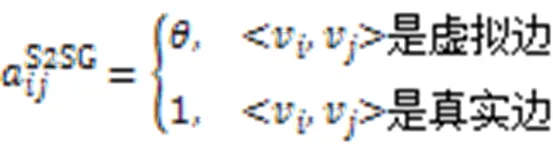

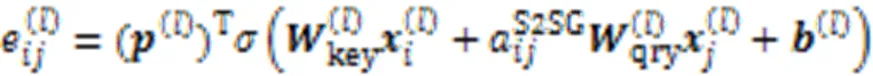

在使用捷径图进行基于GNN的会话推荐时,现有工作使用无权重的捷径图辅助学习远程依赖[24],忽略了图的边权重可以携带信息这一特点。

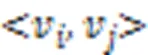

本文使用边权重区分虚拟边和真实边,丰富图结构携带的信息:将捷径和添加的自循环称为虚拟边,将用户真实点击转移关系形成的边称为真实边。虚拟边是根据用户的真实点击转移关系补充而成,具备参考价值;真实边是用户点击转移关系的真实表示,具备决定价值。为了区分虚拟边与真实边,在新构成的捷径图中为这两类边分配不同的权重。

其中:是虚拟边的权重,决定了虚拟边在捷径图注意力层中的重要程度。元素将被保存在邻接矩阵AS2SG中。例如,对于会话S=[v1,v2,v2,v3,v2,v4,v5],构建的捷径图GS2SG和邻接矩阵AS2SG如图4所示。

2.3 模型构建

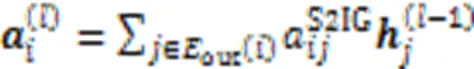

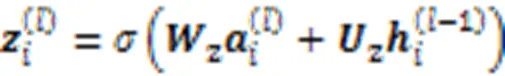

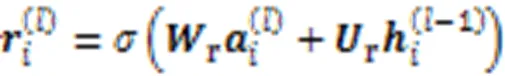

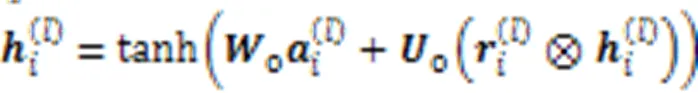

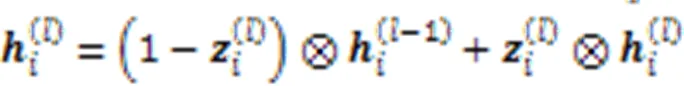

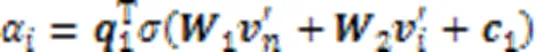

2.3.1影响力图门控层

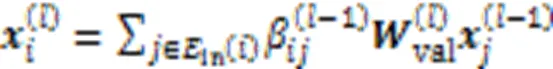

2.3.2捷径图注意力层

一般情况下,一层GNN只能捕获1跳距离的节点关系,想要捕获1跳以上的节点关系就需要叠加多层GNN;然而使用多层GNN叠加的方法虽然可以捕获多跳关系,但是会引入过平滑问题,即多个节点收敛到同一个值。因此,使用捷径图为有关联的多跳节点添加新的转移关系,再使用捷径图注意力层学习捷径图,可以避免多层GNN叠加并能有效捕获远程依赖,实现信息的远程传播。

对于影响力图门控层与捷径图注意力层,本文引入密集连接[31]的方法,将影响力图门控层与捷径图注意力层交错堆叠,从而进一步促进特征重用。

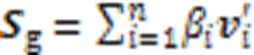

2.3.3生成会话嵌入

其中,1,1∈R以及1,2∈R控制每个节点嵌入获得的权重。

最后,将g和last向量串联后进行线性变换,可以得到混合向量h作为最终兴趣表示:

其中矩阵3∈R2d把两个向量的串联映射到潜在空间R中。

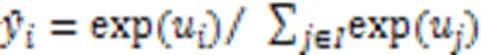

2.3.4生成推荐和训练模型

对于每个会话图,损失函数定义为预测值与真实值的交叉熵,如式(18)所示:

其中是真实的会话序列中下一个点击项目的one-hot向量。最后通过反向传播算法训练模型。

3 实验与结果分析

3.1 数据集

为了验证融合项目影响力的GNN推荐模型的有效性,本文在以下两个公开数据集上进行实验。

1)Diginetica(https://competitions.codalab.org/competitions/11161)是一个来自CIKM CUP 2016的数据集,包含一个电子商务网站5个月内的点击流数据。本文将它最后一周的点击数据作为测试集,其余数据作为训练集。

2)Gowalla(http://snap.stanford.edu/data/loc-gowalla.html)是一个广泛用于兴趣点推荐的签到数据集。本文使用出现最多的前30 000个位置,并将用户间隔时间不超过1 d的相邻签到记录作为签到会话,其中最后20%的会话作为测试集。

在训练之前首先对数据集进行预处理,将非常短的会话和不常出现的项目筛除,并对数据集使用数据增强技术[17-19,24]。预处理之后的数据集的统计信息如表1所示。

表1 实验数据集的统计信息

注:长度指项目数。

3.2 对比模型和评价指标

为了评估SR-II的效果,用以下8个典型模型与SR-II进行对比。

FPMC[13]:将马尔可夫链和矩阵分解结合进行下一个篮子推荐,将当前会话中的下一个项目作为下一个篮子,可以使FPMC运用在会话推荐中。

Item-KNN[14]:使用余弦相似度计算项目间的相似度,推荐与目标项目相似度最高的项目。

NARM[17]:在GRU4Rec的基础上引入注意力机制捕获用户的主要兴趣。

SR-GNN[19]:将会话序列建模为图结构,并使用GNN聚合项目间的转移关系,达到加强项目特征的目的。

GC-SAN[22]:使用GNN捕获项目间的局部依赖关系,使用自注意力机制捕获全局依赖关系。

LESSR[24]:使用图结构的边保存点击顺序,解决由会话构建图的信息损失问题,并用捷径图辅助学习远程依赖。

SR-SAN[25]:使用多头自注意力机制进行会话推荐。

CORE[30]:设计编码器,将会话嵌入和项目嵌入统一在同一表示空间中进行会话推荐,本文选用在两个数据集上实验结果较好的同一表征空间下基于训练模型的会话推荐(simple and effective session-based recommendation within COnsistent REpresentation space-transformer, CORE-trm)作为对比模型。

考虑到本文提出的创新点,提供两种实现作为对比模型:一是使用基础会话图(如图2所示)和捷径图的实现,记为SR-II-base;另一个是使用影响力图和捷径图的实现,记为SR-II。

本文使用命中率(Hit Ratio, HR)和平均倒数排名(Mean Reciprocal Rank, MRR)作为评价指标。HR@和MRR@中的表示使用推荐结果列表的前个项目进行评价。

3.3 实验参数设置

本文经过多次实验,确定了最优实验参数:初始学习率为0.001,学习率衰减系数为0.2,嵌入维度为64,L2正则化系数为0.000 1,使用Adam优化器优化模型参数,最小批处理量为256,SR-II堆叠的层数为2,捷径图中虚拟边的值设置为0.4,并且采用提前停止策略,即如果在连续10轮测试中HR@20指标没有提升,则提前终止训练。

3.4 与现有模型比较

为了验证SR-II的效果,将SR-II-base和SR-II与对比模型在两个数据集上进行对比实验,实验结果如表2所示。

表2 不同模型在两个数据集上的 HR@20和MRR@20比较 单位: %

注:下画线数据表示对比模型中的最优值。

从表2可以看出,SR-II-base模型的实验结果已经超过了大部分对比模型,SR-II在HR@20和MRR@20两个指标上的效果均有进一步提升。与结果最优的对比模型进行比较,在Diginetica数据集上,相较于CORE-trm,SR-II在HR@20上提升了1.10%,在MRR@20上提升了1.21%;在Gowalla数据集上,相较于SR-SAN,SR-II在HR@20上提升了1.73%,相较于LESSR在MRR@20上提升了1.14%。

综上,SR-II在引入了影响力概念后,命中率进一步提升,表明通过影响力概念丰富图结构的内容后,能进一步提升推荐效果。

3.5 消融实验

本节将验证SR-II各个组件的有效性,分析重要超参数对推荐性能的影响。

3.5.1验证影响力图和捷径图有效性

为了验证本文提出的影响力图的有效性,将影响力图门控层模型、使用GGNN的SR-GNN和SR-II进行对比。实验使用的数据集为Diginetica,3个模型在评价指标HR@20、MRR@20上的表现如图5所示。

图5 3个模型的表现

根据图5所示结果可知,与SR-GNN相比,影响力图门控层模型在HR@20和MRR@20上分别都有提升;这是因为影响力图门控层模型考虑了图结构中转移关系差异性,并根据转移关系对结果的影响力区别分配对应权重,因此可以得出结论,考虑了图结构中转移关系差异性可以改善推荐结果。

与影响力图门控层模型相比,SR-II在HR@20和MRR@20上分别都有提升;这是因为在SR-II中还引入了捷径图。由此可以得出结论:与影响力图门控层相比,将影响力图门控层与捷径图注意力层融合得到的SR-II可以得到更好的推荐结果。

3.5.2虚拟边的权重对性能的影响

本文提出设置虚拟边和真实边不同的权重值,显式地区分两类边,以提高捷径图的表达能力。为了研究虚拟边权重值的变化对模型效果的影响,本文将模型的虚拟边的权重值分别设置为{0,0.2,0.4,0.6,0.8,1}进行实验,模型的其他参数设置与3.3节相同,在数据集Diginetica上模型表现如图6所示。

图6 不同θ下SR-II的表现

从图6可以看出,使用改进的捷径图(即={0.2,0.4,0.6,0.8})的推荐结果较好,明显优于无捷径的会话图(即=0)的推荐结果,说明改进的捷径图能有效提高推荐效果。同时,从图6可以看出,虚拟边权重值的变化会影响模型的表现效果。使捷径图不区分虚拟边和真实边,即虚拟边的权重值为1时,模型表现明显差于区分虚拟边和真实边时的情况,此现象表明虚拟边和真实边的重要性存在差异。从图6还可以看出,在以上评价指标中,=0.4时模型的表现都优于或相近于等于其他值时模型的表现。

3.5.3超参数对性能的影响

模型层数和嵌入维度是两个重要的超参数,通常能显著影响模型的性能,本节将探究这两个超参数对SR-II的影响。SR-II以{影响力图门控层,捷径图注意力层,影响力图门控层}的顺序堆叠,堆叠层数在{1,2,3,4,5}中取值,嵌入维度在{16,32,64,96,128}中取值。在评价指标HR@20上的实验结果如图7所示。由于在指标MRR@20上的结果变化趋势与在HR@20上的类似,又考虑到篇幅限制,故此省略。

图7 SR-II的表现

从图7可以看出,盲目地增加堆叠层数和嵌入维度大小无法使推荐性能变得更好。逐步增加堆叠层数,会使模型性能呈现先升高再下降的趋势。在达到最优层数之前,增加层数可以加强模型的学习能力;但是在这之后添加更多的层数,反而会导致过平滑等问题,使得模型性能下降,因此堆叠层数不是越多越好。

对于嵌入维度,在Diginetica数据集上,32是最佳的嵌入维度大小,由于过拟合问题,大于最佳大小越多,模型性能表现越差;对于Gowalla数据集,更大的嵌入维度大小能带来更好的模型学习能力,提升模型的性能。因此嵌入维度不是越大越好,而是最合适的最好。

3.6 时间复杂度和时间效率分析

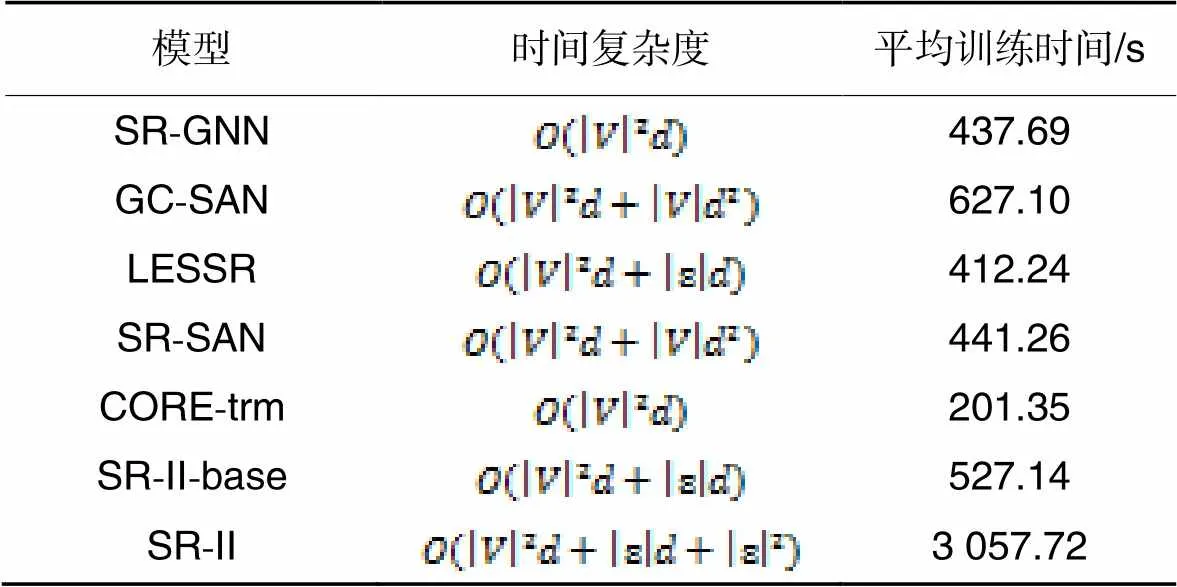

表3展示了本文模型和对比模型在时间复杂度上的对比和在Diginetica数据集上平均每轮的训练时间。

从表3可以看出:SR-GNN和CORE-trm的时间复杂度较优,本文模型在时间复杂度上高于SR-GNN,高出的复杂度与会话图中边数有关,但本文模型的推荐效果更好。在平均训练时间方面,SR-II的平均训练时间较长。这是因为在每个会话构建影响力图的过程中,需要多次遍历会话图得到计算影响力的依据。使用普通会话图的SR-II-base,需要的平均训练时间大幅缩短,与现有模型相比,相差不大。综合分析推荐精确度和训练时间,可以得出结论:在精度要求比较高的场合,SR-II的表现优于其他对比模型;在兼顾精度和时间的场合,SR-II-base更适用;在对训练时间要求较高的场合,可以选用CORE-trm。

表3 不同模型的时间复杂度和平均训练时间对比

4 结语

为了克服现有会话推荐算法的不足,本文提出了一种融合项目影响力的GNN模型的会话推荐模型(SR-II)。不仅通过增强图结构中边的表达能力有效提升模型推荐效果,而且一定程度上解决了GNN难以捕获远程依赖的问题。

该模型使用GGNN根据影响力图提取项目特征,通过注意力机制捕获项目的远程依赖关系,得到会话全局嵌入,将会话最后点击项目的嵌入作为局部嵌入,结合两种嵌入得到会话的最终兴趣表示,并产生推荐结果。实验结果表明,本文模型在HR@20和MRR@20这两个指标上取得了较好的推荐效果。

本文使用现有的GNN提取影响力图的特征,为了进一步提升推荐效果,下一步工作将考虑优化影响力图的计算效率,并设计更适合影响力图的GNN增强项目影响力的表达效果;并且对于改进的捷径图,也考虑设计更看重边的区别的神经网络,更好地利用捷径图的远程依赖。

[1] SHI L, ZHANG Y, CHENG J, et al. Skeleton-based action recognition with directed graph neural networks [C]// Proceedings of the 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2019: 7912-7921.

[2] GOMES J, RAMSUNDAR B, FEINBERG E N, et al. Atomic convolutional networks for predicting protein-ligand binding affinity[EB/OL]. [2022-05-10]. https://arxiv.org/pdf/1703.10603.pdf.

[3] MA T, XIAO C, ZHOU J, et al. Drug similarity integration through attentive multi-view graph auto-encoders[C]// Proceedings of the 27th International Joint Conference on Artificial Intelligence. California: IJCAI, 2018: 3477-3483.

[4] YU B, YIN H, ZHU Z. Spatio-temporal graph convolutional networks: a deep learning framework for traffic forecasting[C]// Proceedings of the 27th International Joint Conference on Artificial Intelligence. California: IJCAI, 2018: 3634-3640.

[5] KOSARAJU V, SADEGHIAN A, MARTÍN-MARTÍN R, et al. Social-bigat: multimodal trajectory forecasting using bicycle-gan and graph attention networks[C]// Proceedings of the 33rd International Conference on Neural Information Processing Systems. [S.l.]: NIPS, 2019: 137-146.

[6] BRUNA J, ZAREMBA W, SZLAM A, et al. Spectral networks and locally connected networks on graphs[EB/OL]. (2014-04-21)[2022-07-10]. https://arxiv.org/pdf/1312.6203.pdf.

[7] KIPF T N, WELLING M. Semi-supervised classification with graph convolutional networks [EB/OL]. [2022-06-02]. https://arxiv.org/pdf/1609.02907.pdf.

[8] LI Y, ZEMEL R, BROCKSCHMIDT M, et al. Gated graph sequence neural networks [EB/OL]. [2022-03-26]. https://arxiv.org/pdf/1511.05493.pdf.

[9] VELIKOVI P, CUCURULL G, CASANOVA A, et al. Graph attention networks [EB/OL]. [2022-03-28]. https://arxiv.org/pdf/1710.10903.pdf.

[10] LEE J B, ROSSI R, KONG X. Graph classification using structural attention [C]// Proceedings of the 24th International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2018: 1666-1674.

[11] 刘鑫,梅红岩,王嘉豪,等.图神经网络推荐方法研究[J]. 计算机工程与应用, 2022, 58(10): 41-49.(LIU X, MEI H Y, WANG J H, et al. Research on graph neural network recommendation method[J]. Computer Engineering and Applications, 2022, 58(10): 41-49.)

[12] SHANI G, HECKERMAN D, BRAFMAN R I, et al. An MDP-based recommender system [J]. Journal of Machine Learning Research, 2005, 6: 1265-1295.

[13] RENDLE S, FREUDENTHALER C, SCHMIDT-THIEME L. Factorizing personalized Markov chains for next-basket recommendation[C]// Proceedings of the 19th International Conference on World Wide Web. New York: ACM, 2010: 811-820.

[14] DAVIDSON J, LIEBALD B, LIU J, et al. The YouTube video recommendation system[C]// Proceedings of the 2010 4th ACM Conference on Recommender Systems. New York: ACM, 2010: 293-296.

[15] HIDASI B, KARATZOGLOU A, BALTRUNAS L, et al. Session-based recommendations with recurrent neural networks[EB/OL]. [2022-04-15]. https://arxiv.org/pdf/1511.06939.pdf.

[16] TAN Y K, XU X, LIU Y. Improved recurrent neural networks for session-based recommendations[C]// Proceedings of the 1st Workshop on Deep Learning for Recommender Systems. New York: ACM, 2016: 17-22.

[17] LI J, REN P, CHEN Z, et al. Neural attentive session-based recommendation [C]// Proceedings of the 2017 ACM on Conference on Information and Knowledge Management. New York: ACM, 2017: 1419-1428.

[18] LIU Q, ZENG Y, MOKHOSI R, et al. STAMP: short-term attention/memory priority model for session-based recommendation [C]// Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York: ACM, 2018: 1831-1839.

[19] WU S, TANG Y, ZHU Y, et al. Session-based recommendation with graph neural networks [EB/OL]. [2022-11-01].https://arxiv.org/pdf/1811.00855v4.pdf.

[20] SONG W, XIAO Z, WANG Y, et al. Session-based social recommendation via dynamic graph attention networks[C]// Proceedings of the 12th ACM International Conference on Web Search and Data Mining. New York: ACM, 2019: 555-563.

[21] YU F, ZHU Y, LIU Q, et al. TAGNN: target attentive graph neural networks for session-based recommendation[C]// Proceedings of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM, 2020: 1921-1924.

[22] XU C, ZHAO P, LIU Y, et al. Graph contextualized self-attention network for session-based recommendation [C]// Proceedings of the 28th International Joint Conference on Artificial Intelligence. PaloAlto, CA: AAAI Press, 2019: 3940-3946.

[23] XIAN X, FANG L, SUN S. ReGNN: a repeat aware graph neural network for session-based recommendations[J]. IEEE Access, 2020, 8: 98518-98525.

[24] CHEN T, WONG R C W. Handling information loss of graph neural networks for session-based recommendation[C]// Proceedings of the 26th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York: ACM, 2020: 1172-1180.

[25] FANG J. Session-based Recommendation with self-attention networks[EB/OL]. [2022-04-28]. https://arxiv.org/abs/2102.01922.

[26] 南宁,杨程屹,武志昊. 基于多图神经网络的会话感知推荐模型[J]. 计算机应用, 2021, 41(2): 330-336.(NAN N, YANG C Y, WU Z H. Multi-graph neural network-based session perception recommendation model[J]. Journal of Computer Applications, 2021, 41(2): 330-336.)

[27] 任俊伟,曾诚,肖丝雨,等. 基于会话的多粒度图神经网络推荐模型[J]. 计算机应用, 2021, 41(11): 3164-3170.(REN J W, ZENG C, XIAO S Y, et al. Session-based recommendation model of multi-granular graph neural network[J]. Journal of Computer Applications, 2021, 41(11): 3164-3170.)

[28] 黄震华,林小龙,孙圣力,等. 会话场景下基于特征增强的图神经推荐方法[J]. 计算机学报, 2022, 45(4): 766-780.(HUANG Z H, LIN X L, SUN S L, et al. Feature augmentation based graph neural recommendation method in session scenarios[J]. Chinese Journal of Computers, 2022, 45(4): 766-780.)

[29] 闫昭,项欣光,李泽超.基于交互序列商品相关性建模的图卷积会话推荐[J]. 中国科学:信息科学, 2022, 52(6): 1069-1082.(YAN Z, XIANG X G, LI Z C. Graph convolution session recommendation based on interactive sequence commodity correlation modeling[J]. SCIENTIA SINICA Informationis, 2022, 52(6): 1069-1082.)

[30] HOU Y, HU B, ZHANG Z, et al. CORE: simple and effective session-based recommendation within consistent representation space[C]// Proceedings of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM, 2022: 1796-1801.

[31] HUANG G, LIU Z, VAN DER MAATEN L, et al. Densely connected convolutional networks[C]// Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2017: 4700-4708.

Session-based recommendation model by graph neural network fused with item influence

SUN Xuanyu1, SHI Yancui1,2*

(1,,300457,;2,,,100039, China)

Aiming at the problem that it is difficult for the existing session-based recommendation models to explicitly express the influence of items on the recommendation results, a Session-based Recommendation model by graph neural network fused with Item Influence (SR-II) was proposed. Firstly, a new edge weight calculation method was proposed to construct a graph structure, in which the calculated result was used as the influence weight of the transition relationship in the graph, and the features of the graph were extracted through the influence graph gated layer by using Graph Neural Network (GNN). Then, an improved shortcut graph was proposed to connect related items, effectively capture long-range dependencies, and enrich the information expressed by the graph structure; and the features of the graph were extracted through the shortcut graph attention layer by using the attention mechanism. Finally, a recommendation model was constructed by combining the above two layers. In the experimental results on Diginetica and Gowalla datasets, the highest HR@20 of SR-II is reaching 53.12%, and the highest MRR@20 of SR-II is reaching 25.79%. On Diginetica dataset, compared with CORE-trm (simple and effective session-based recommendation within COnsistent REpresentation space-transformer), SR-II has the HR@20 improved by 1.10% ,and the MRR@20 improved by 1.21%; On Gowalla dataset, compared with SR-SAN(Session-based Recommendation with Self-Attention Networks), SR-II has the HR@20 improved by 1.73%.Compared with the recommendation model called LESSR (Lossless Edge-order preserving aggregation and Shortcut graph attention for Session-based Recommendation), SR-II has the MRR@20 improved by 1.14%. The experimental results show that the performance of SR-II is better than that of the comparison models, and SR-II has a higher recommendation accuracy.

session-based recommendation; recommender system; Graph Neural Network (GNN); attention mechanism; session graph

This work is partially supported by Basic Research Business Fee Project for Science and Engineering of Tianjin Education Commission (2018KJ105), Innovation Fund of Engineering Research Center of Ministry of Education for Integration and Application of Digital Learning Technology (1221025).

SUN Xuanyu, born in 1998, M. S. candidate. His research interests include deep learning, recommender system.

SHI Yancui, born in 1982, Ph. D., associate professor. Her research interests include recommender system, social network.

TP391.4

A

1001-9081(2023)12-3689-08

10.11772/j.issn.1001-9081.2022121812

2022⁃12⁃07;

2023⁃03⁃05;

2023⁃03⁃07。

天津市教委理工类基本科研业务费项目(2018KJ105);数字化学习技术集成与应用教育部工程研究中心创新基金资助项目(1221025)。

孙轩宇(1998—),男,江苏南京人,硕士研究生,CCF会员,主要研究方向:深度学习、推荐系统;史艳翠(1982—),女,河北保定人,副教授,博士,CCF会员,主要研究方向:推荐系统、社会化网络。