基于Leap Motion的电影前期预演人机交互方法

2021-04-10赵建军黄竣鹏陈俊良

赵建军,黄竣鹏,陈俊良

基于Leap Motion的电影前期预演人机交互方法

赵建军,黄竣鹏,陈俊良

(北京电影学院影视技术系,北京 100088)

随着虚拟现实(VR)技术的发展,虚拟预演逐渐成为电影制作流程中不可或缺的一环,如何使用自然、多模态的交互方式,结合三维实时渲染引擎,提高电影制作人员在前期预演中的参与感,是该领域的重要研究内容。针对当前虚拟预演中使用的交互方式大多为光学运动捕捉系统等,存在价格昂贵、操作难度高、便携性差等问题。提出一种基于Leap Motion的电影前期预演人机交互方式,在获得精准数据的同时,大大降低了操作难度与设备成本,电影制作人员使用手势交互控制虚拟角色的运动轨迹,完成不同运动状态的切换,并结合运动捕获数据库,直接参与到前期预演中。通过方案验证,该方法的用户体验更加自然、友好、直观和高效。

Leap Motion;电影前期预演;人机交互;虚拟现实;虚拟角色

电影是科技与艺术相结合的产物,电影技术的重大变革,均伴随着科学技术的重大突破。近年来,随着虚拟现实(virtual reality,VR)技术与计算机图形学的飞速发展,电影制作方式也发生着新的变化,其中前期预演是影视制作中新兴的应用技术。在电影开拍之前,对一些镜头甚至整部影片进行可视化预览且无需承担实际拍摄成本,在虚拟环境下可帮助电影制作团队进行技术论证、探讨影片叙事、规划拍摄流程等。

前期预演的加入,使得电影制作呈现出后期流程“前置”化的特征。这种可视化呈现方式,能够方便电影创作团队进行构思设计及电影拍摄的预览。当前大部分的镜头预演是借助于传统的三维软件如Maya,3DMax和Motion Builder等实现,这些软件借助于动捕系统等技术手段,进行大部的分预演镜头制作。此外,市面上也有多种专业软件用于帮助电影创意设计探索和创作团队头脑风暴,如Amazon Storyteller,Sketchup,FrameForge 3D Studio,Cinebox和iClone等,虽然功能各有不同,但可在不同程度上完成对镜头画面进行可视化预览。

然而,现有的前期预演软件及呈现方式,一般由动画师参与设计三维动画,通过生成动画镜头,来指导电影现场拍摄。电影主创团队大多不能实时、便捷地参与镜头设计,若要参与,需使用鼠标键盘进行虚拟角色的动画设计、虚拟镜头的设置等,大大降低了创作团队的创作设计体验感及创作效率。针对上述问题,本文提出了一种基于Leap Motion的人机交互方式,创作团队简单使用手势交互的方式,控制虚拟拍摄中的角色动画轨迹,以及控制角色在运动状态间进行切换,达到参与虚拟预演动画设计的效果,使得电影创作人员能够便捷地参与到电影的前期预演中。

1 相关工作

Leap Motion 是一种人机交互中的体感控制器,可利用手势识别采集数据,即借助手掌和手指的动作感应技术进行信息输入,完成人机互动。因其设备使用方式简单、体积小、价格低廉、手势精度高、可配合多种传感设备进行辅助操作,为人机交互的应用提供了一种新的思路。Leap Motion由于直接捕获真实的手势运动数据,其数据更自然、逼真、仿真度高。同时,支持双手交互控制,可在极端情况下进行动作采集、跟踪,结果更精确、稳定、识别度好。

在人机交互领域,KHALAF 等[1]对多种手势识别采集设备进行对比测试,在基于视觉的手势识别设备中,测试了RealSense,Leap Motion和Kinect的用户体验、认知需求、舒适度和使用性能,测试结果表明Leap Motion的表现最佳。Leap Motion在多个行业内被广泛应用:在航天领域中,胡弘等[2]提出了基于Leap Motion采集设备的关键点模型手姿态参数估计,驱动虚拟手运动;在医疗领域中,孙国道等[3]提出基于双Leap Motion的三维可视化体感交互系统,以减少手指混叠现象、提高设备易用性;教学领域中,VASYLEVSKA 等[4]利用Leap Motion进行VR和AR的教学构建和发展,提升VR用户使用体验;在安全领域,基于Leap Motion传感设备,利用手指的速度和倾斜角的特征进行生物身份识别认证,MARUYAMA 等[5]利用手指的关节间三维空间坐标计算出的手指内和手指间的特征值进行用户验证,结果显示其仅使用关节间距离作为特征进行识别,识别率高达84.65%。除此,KAMAISHI和UDA[6]借助Leap采集的数据,基于动作识别的用户界面设计,提升工作效率;HERNOUX等[7]利用Leap的高精度采集特性,实时将3D人体运动采集应用于机器人动态运动,使机器人能够应对和执行多种复杂的任务;美国宇航局使用Leap Motion模拟控制太空机器人登陆火星,提升用户使用操作体验。

在影视娱乐行业,HANTRAKUL和KACZMAREK[8]将Leap传感器与合成器、扬声器相连接,使用手指和手部运动对合成器进行触发,实现了设备控制声音合成和交互式现场表演的应用;DESNOYERS- STEWART等[9]通过Leap Motion与HTC Vive,在虚拟环境中操作混合现实的乐器,使用户在视觉、触觉和本体感觉吻合中获得良好的用户体验;XU[10]借助Leap Motion采集手的位置和手势数据,对机器人角色进行动画交互。

综上,Leap Motion体感控制器体积小、价格低廉,采集数据精度高、稳定性强、识别度好、仿真度高,符合人体工程规律,可应用于多种领域。然而在当下影视领域的虚拟制作中,人机交互控制仍然采用传统的鼠标键盘操作,电影从业者体验感差,参与度低。基于此,本文提出了一种基于Leap Motion的虚拟预演人机交互系统设计方案,在渲染引擎中通过Leap Motion体感控制器对场景内的数字角色进行控制与操作,解决艺术家对角色快捷控制的需求,提升用户体验,同时实现虚拟预演的高效制作。

2 基于Leap Motion的虚拟角色交互控制

在电影前期预演中,非常重要的内容是通过设计演员的走位,进而设计镜头,演员的走位设计分为2类:设计演员的轨迹和安排演员在不同的运动类型之间进行切换。如图1所示,为了使得电影创作人员能够在电影前期预演中充分发挥作用,尤其是设计虚拟角色运动,本文设计了一种基于Leap Motion的人机交互方式。首先需分别设计虚拟角色的运动轨迹以及进行不同运动状态的切换,然后结合运动数据库,生成自然的虚拟角色运动,用于镜头设计与前期预演流程。

图1 基于Leap Motion的人机交互方式

2.1 基于Leap Motion的轨迹规划

在虚拟预演的制作过程中,如何让制作人员快速生成角色运动轨迹是虚拟预演人机交互的重要研究部分。为此,本文提出基于手势识别的轨迹规划方法,快速生成角色运动轨迹。其使用Leap Motion获得采样点,分2步驱动角色运动:对采样点进行再处理获得控制路径离散点;利用路径离散点驱动角色运动。

2.1.1 采样点再处理

Leap Motion采集到的手部位置抖动非常明显,为获得一条相对平滑且准确的控制路径,在利用路径离散点驱动角色运动中,本文提出数据重采样、数值滤波、根据缩放进行插值等3步进行处理。

步骤1.在获取离散点后,对数据进行重采样,减少手部运动缓慢时路径在一个区间内不断抖动的现象。设置一个阈值(单位为像素),当采样点之间欧氏距离小于该阈值时,可忽略。当实验阈值设置为6时,可大幅减少抖动,同时对路径的连续性影响较小。重采样算法1为:

设重采样离散点序列为,采集离散点序列为,阈值为。

算法1.

输入:, array

输出: array

该方法可用在获取离散采样点上。若采样到手部位置为1,路径离散点序列中最后的离散点为,(1,)≥,则将1保存在中,否则丢弃该点。

步骤2. 进行重采样处理后,需要对数据进行滤波,进一步减少抖动。传统的卡尔曼滤波、中值滤波等方式,可使冲击信号出现延迟,缺少尖峰等现象。在路径规划中,如果路径中存在折角,经滤波后会变为圆弧,当折角为锐角或直角时,该现象尤为明显。为解决此问题,在滤波中首先判断采样点是否为路径角点,如果是则保留。获取当前采样点前后各3个点,在此范围内,将路径近似为2段直线。滤波算法如下:

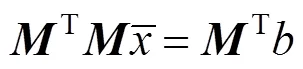

(1) 设重采样离散点序列为,=(x,y)为其第个点,取当前采样点前后各3个点,用最小二乘法分别拟合直线,即=1+2,其最小二乘法的矩阵形式为

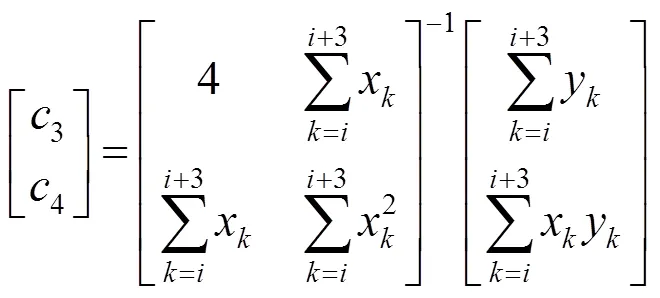

可推出-3,-2,-1,,所拟合直线*1=1+2,即

同理,,+1,+2,+3所拟合直线*2=3+4,即

利用2,4计算出*1,*2方向向量之间的夹角,当夹角大于90°时,标记采样点A为角点。

(2) 利用角点进行分段,2个角点之间的采样点使用滑动平均滤波(算法2)。

算法2实现如下:设上一步处理好的重采样离散点序列为,滤波处理后离散点序列为,角点序列为。

算法2.

输入:, array

输出: array

步骤3. 根据缩放进行插值。上述获取的路径采样点是处于Leap Motion的分辨率范围中,若将路径映射在虚拟场景中,需进行缩放。为使缩放后路径的采样点依然保持较好的分布,需对路径进行重采样或插值,方法为:

(1) 缩放比例是通过场景中需要的路径空间与离散点分布的空间相除得到的,其中像素与距离的换算比为1 px/0.05 m。

(2) 对离散点进行归一化,并缩放到虚拟场景中。

(3) 根据缩放比例,对缩放后的路径离散点进行插值或降采样,确保场景中点的密集程度相对均匀。其中插值的方式为使用三次样条对2个离散点之间的空隙进行插值,空隙中需要插值-1个点,若<1则丢弃相应比例的点。

2.1.2 路径离散点驱动角色运动

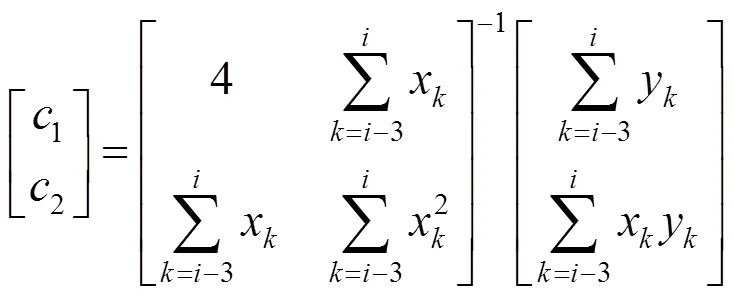

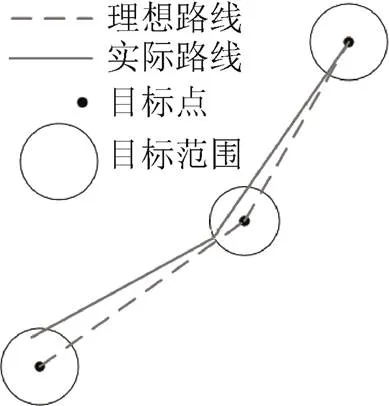

将处理后的离散点按获取时间排列,并作为角色的运动路径。到达一个点后,可将下一个点作为逼近的目标,按照角色的运动速度进行移动,逐渐逼近目标点。由于角色处于移动状态,很难精确到达每一个目标点,故本文将目标点变为一个目标圆,其直径大于角色每帧运动距离,以解决角色陷入不断逼近某个目标点或移动超过了目标点而折返发生运动抖动的情况,如图2所示。

2.2 基于Leap Motion的状态切换控制

虚拟预演中对虚拟角色控制,通常是一个多状态的过程,需要用户进行不同状态间切换。在一个简单的控制元里,通过加入不同的附加条件,影响和控制角色的不同状态。同时,状态的设计还需要符合用户的操作控制思维。基于此思路,如图3所示,Leap Motion作为角色运动控制采集器之外,还作为不同状态间切换控制器。

图2 运动轨迹逼近方法

图3 运动状态转移示意图

如图4所示,用户使用Leap Motion时手势基本高度保持一致,角色保持默认走路姿态。

图4 步行状态及手势对应图

如图5所示,用户进行握拳或手的三维空间坐标高度接近传感器平面,角色运动状态切换为停止状态,虚拟角色不再运动。

图5 停止状态及手势对应图

如图6所示,用户抬手到达一定高度时,角色表现为跑步。

图6 跑步状态及手势对应图

如图7所示,用户手掌位置向前或向上运动超过一定速度时,角色进行跳跃。

通过不同的手势对角色的4种状态进行控制操作,如图8所示。基于手势的控制方式,不仅符合用户对虚拟角色的控制习惯,同时提升了用户体验。

图7 跳跃状态及手势对应图

图8 Leap Motion控制方式示意图

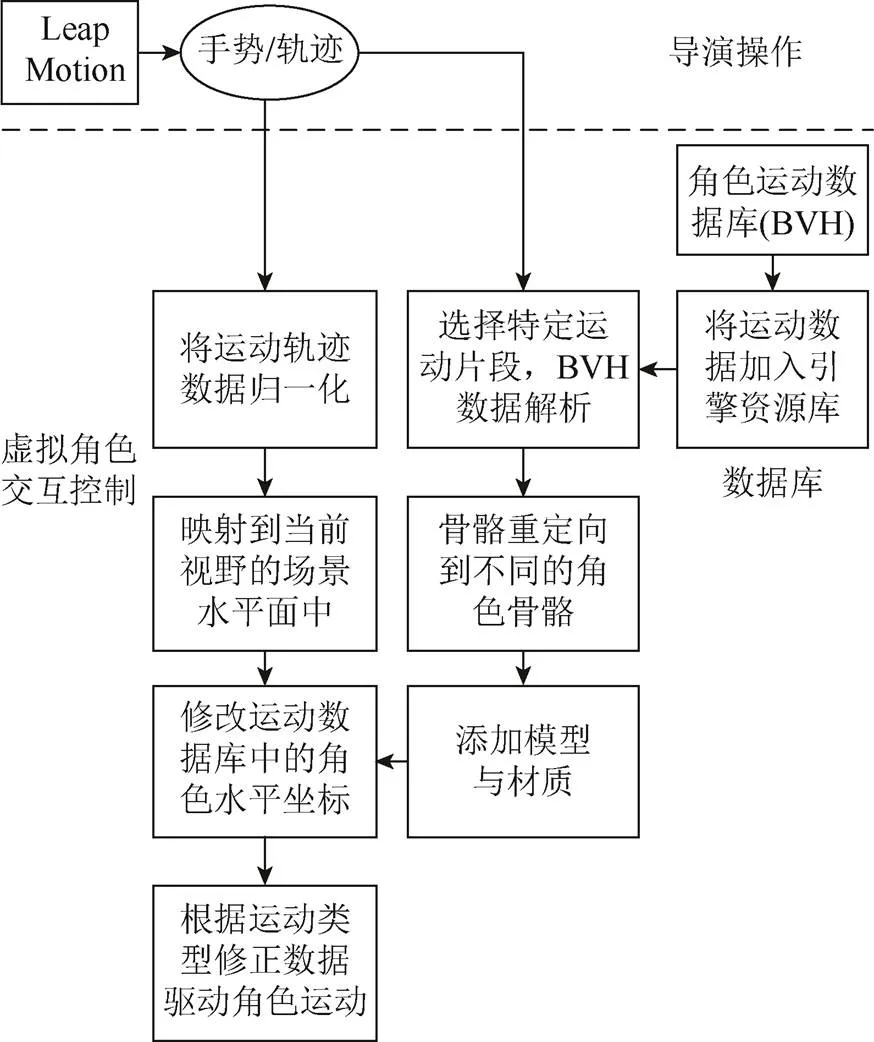

2.3 基于运动数据库的动画生成

通过上述的路径获取与状态切换控制方法,使用者能够便捷地交互控制虚拟数字角色。在电影制作中,预演动画生成除了要求交互性强之外,还需要角色的运动能够自然逼真,具有一定的表现力。为此,在上述控制的基础上,采用运动数据库,驱动角色在发生位移等运动时,肢体运动表现的自然逼真。

另本文还采用了BVH格式的数据库。其为骨骼构成和动作数据库,广泛支持各种动画制作软件,业界许多动捕数据库,均以BVH文件为发行格式。角色动捕数据大大提升了角色运动的真实感,增强了虚拟预演的效果,给导演提供更大的创作空间。

前期预演中,虚拟角色的位置信息更为关键,而一些穿帮现象并不重要,故可采用同一组运动数据库进行不同角色的交互控制。一般需要使用与所驱动的模型采用同样骨骼结构的BVH文件。本文采用了卡耐基梅隆大学的运动捕获数据库转换得到BVH文件进行测试验证。值得注意的是,BVH文件中角色的关节坐标,,轴朝向均为初始姿态,即以右手坐标系为标准的世界坐标系下,,轴朝向。所有关节初始姿态的,,轴朝向均相同。

图9首先将角色运动数据库加载到引擎中。不同的手势,对应于不同的运动,如张手为步行,握拳为跳跃。根据手势类型,选择调用的运动类型。确定运动类型后,进行BVH解析,得到动作信息。在基于引擎的实现中,需要调整所驱动角色的初始姿态,并获得初始姿态,使得在后续操作中,每次驱动角色,均需每个关节恢复到初始姿态再驱动。

图9 基于数据库的虚拟角色交互控制

需注意的是,在现有的预演方案中,一部分使用运动捕获系统直接控制虚拟的角色,另一部分使用基于物理的虚拟角色生成方法进行人体运动控制。而本文所采用的方法,成本低廉、便携,在不同的场合均可便捷使用。

3 电影前期预演的实例应用

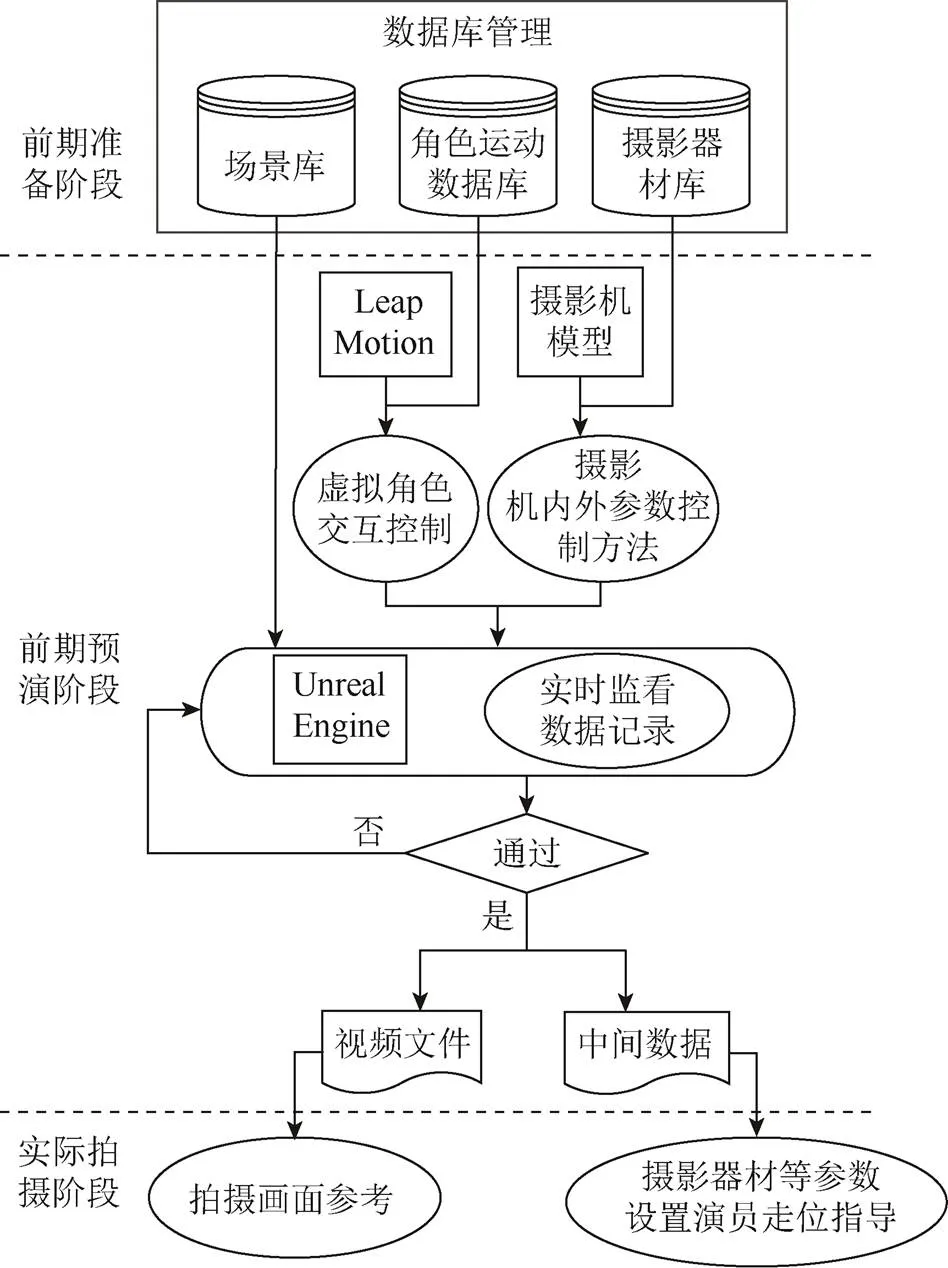

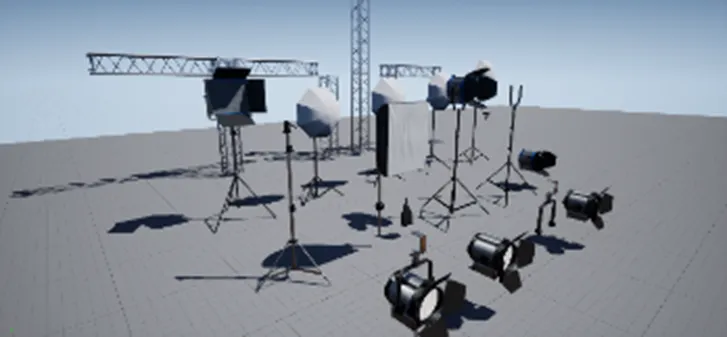

为了验证方法的实用性,本文使用Unreal Engine,设计了电影前期预演的解决方案,如图10所示。

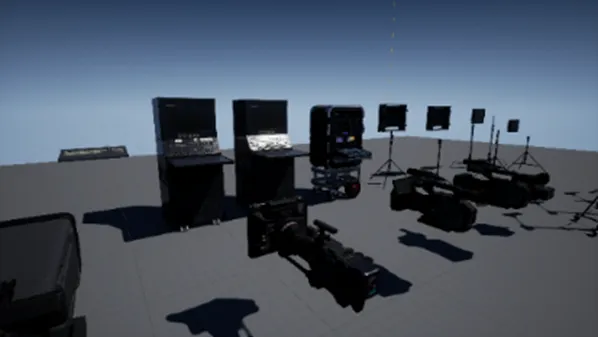

3.1 虚拟资产库的准备

为了确保前期预演的内容能够在拍摄中得以执行,需要根据真实的设备,建立虚拟模型,其物理属性需与真实的设备完全一致,如图11~12所示。本文使用了与当前电影主流真实摄影机、三脚架、灯具、视频辅助设备等完全相同尺寸、相同数字属性的虚拟资产模型,以便在前期预演中根据不同剧组、不同导演在不同场景、不同剧目中进行选择。

图10 前期预演交互设计方案框架图

为了验证对不同角色的交互控制,使用了多种虚拟角色模型,如图13所示。

同样,还使用图像建模或手工建模等方式,设计虚拟场景,用于前期预演,如图14所示。

为了方便不同的场景预演,在前期预演中预加载不同场景模型,方便在前期预演中实时切换所预演的场景,如图15所示。

通过与真实对象相一致的数字资产库的建设,以保证前期预演的内容在现场拍摄中复现出来。

3.2 基于半实物模型及回看监视器的虚拟摄影实现

在电影的拍摄中,导演、摄影师通过摄影机与画面进行交流创作。为了使导演、摄影师能够以自身熟悉的方式进行创意设计,本文采用3D打印的半实物仿真摄影机镜头模型加回看监视器模拟真实的拍摄工作环境,如图16所示。摄影机镜头模型及数字参数与真实摄影机相似且一致。在其他虚拟资产保证一致性的前提下,前期预演设计的镜头能够完美地在真实拍摄中呈现。

图11 虚拟摄影机及镜头

图12 虚拟灯具

图13 虚拟角色

图14 虚拟场景

图15 虚拟场景选择界面

图16 摄影机模型及监看设备

与光学跟踪点的半实物模型相比较,本文的半实物模型能够直接控制摄影机的内外参数,同时进行实时记录,有助于后续现场拍摄与后期制作。而与Mosys机械传感器的半实物模型相比较,其造价低廉,在满足前期预演需求的前提下,可让摄影师通过个人友好的方式进行虚拟创作。

3.3 基于Leap Motion的虚拟角色交互控制

在现有的虚拟角色交互方式解决方案中,大多使用运动捕获系统,该方式能够由演员表演驱动虚拟角色得到想要的表演效果。然而需要在前期预演系统中搭建运动捕获系统,除了经济成本之外,对于前期预演的环境有比较严格的要求。

由于在前期预演中,需要验证的是在特定的场景中,虚拟角色走位与摄影机走位的关系,其虚拟角色的运动细节是否充分、细致,对于预演效果影响有限。导演是否能够方便、友好、快捷地控制虚拟角色的走位,是前期实时预演中需要解决的问题。本文使用Leap Motion,在Unreal Engine引擎中基于手势识别的方式进行虚拟角色交互控制。并实时获取手掌的运动轨迹,归一化到场景窗口的地面后,虚拟角色根据指定的运动轨迹进行运动,并使用手势上下滑动控制运动速度。通过这种便携、低廉的体感控制器,导演能够实时控制虚拟角色的走位,如图17所示。

图17 虚拟角色轨迹规划控制

3.4 基于按钮传感器的摄影录制及数据记录

前期预演的主要产出是镜头的预演视频。与动画预演或游戏过场动画的制作方式不同,前期预演需求是能够充分、快捷地反映创作者的想法。即导演、摄影师的创作能够实时进行可视化预览,通过视频监看,判断预演效果是否达到预期。如果达到预期,则该视频可作为真实拍摄与后期特效制作的参考视频。

如图18所示,通过在摇杆上添加2个按钮,控制虚拟摄影的拍摄与回看,这样既能够实时将引擎中的渲染画面传送到摄影师操作端,以供摄影师参考,也能够将预演拍摄的镜头录制供导演等回看,从而保证导演、摄影师的创作能够得到可视化呈现。

图18 前期预演录制按钮

在Intel i7-8700k,16 G内存,NVIDIA RTX 2080实验环境中,帧速率测试结果为120 fps,相较于传统键盘鼠标操作,帧速率相同,但交互性更强。

为验证该虚拟角色交互控制系统的人机交互友好性与操作易用性,本文对19名志愿者进行应用实验,志愿者均为在读影视制作类专业本科生及研究生。

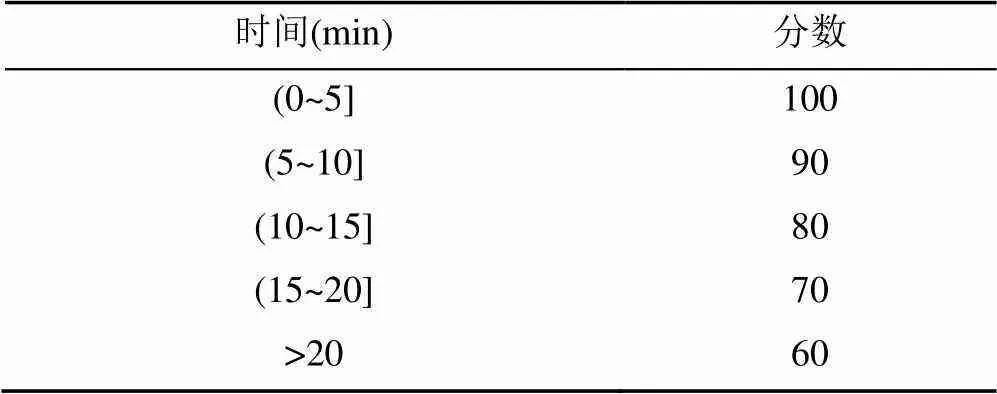

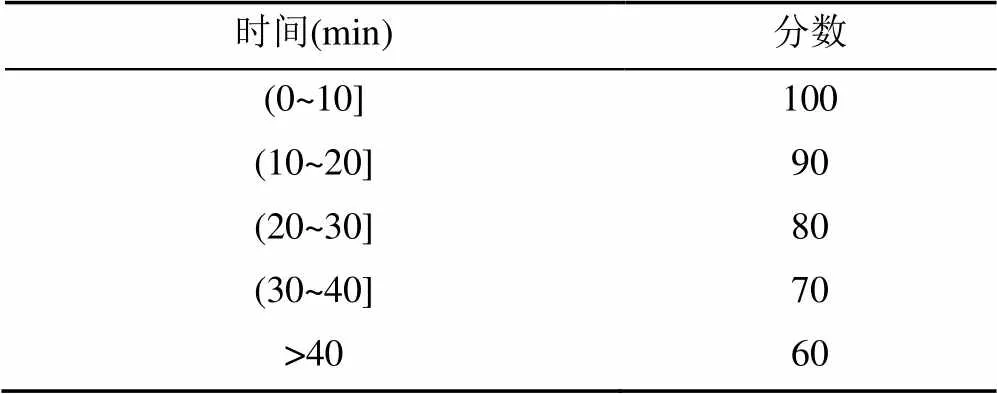

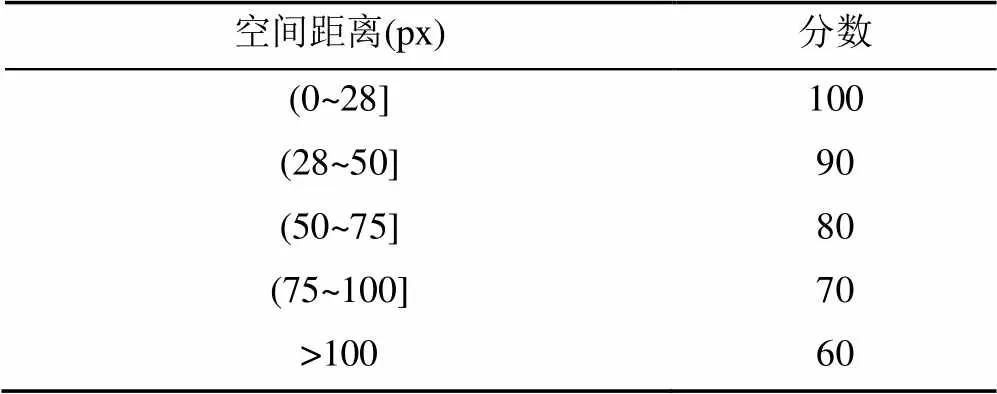

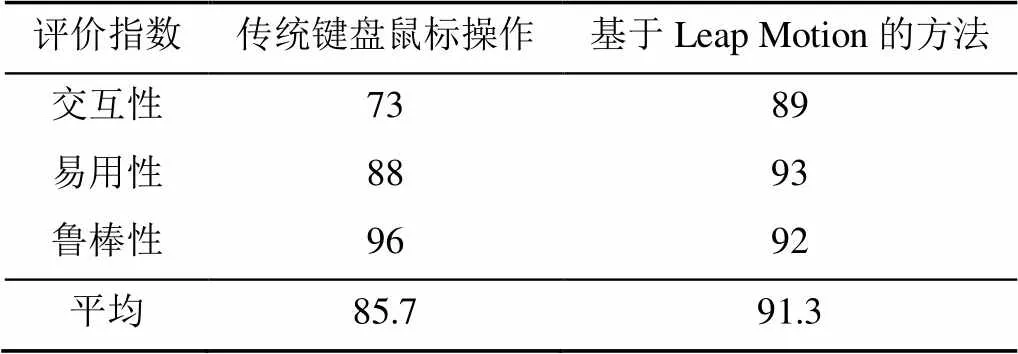

其中,交互性为用户在使用不同交互方式达到同一镜头所需时间;易用性为零基础用户学习不同交互方式后进行制作所需的学习时间。鲁棒性为在不同交互方式下,达到同一镜头实现结果与预计要求位置的精准度,衡量标准见表1~3。

表1 交互性指标衡量表

表2 易用性指标衡量表

表3 鲁棒性指标衡量表

志愿者使用键盘鼠标操作与基于Leap Motion交互控制进行对比,结果见表4。

表4 不同交互方式用户体验评价

通过表4可见,基于Leap Motion的虚拟角色交互控制系统更加方便用户使用,交互体验感更强。

4 小结与讨论

与传统的动画前期预演方式不同,本文实现了面向电影制作人员的前期预演中人机交互。本文的人机交互系统基于Unreal Engine实现,其主要功能基于蓝图编程实现。本系统的特点如下:

(1) 面向电影制作人员的人机交互方式。在游戏动画及动画预演领域,修改镜头画面必须重新进行繁复的三维动画流程。与游戏制作行业不同,电影从业者不习惯动画编辑的方式,本系统通过简便、友好的交互方式,电影从业人员能够充分在前期预演系统中表达自己的诉求,进行艺术创作。

(2) 由于本系统使用了与真实世界完全一致的虚拟资产,其预演的镜头可参考性更强,预演中能够实现的内容,在真实的拍摄中也能够实现。

(3) Unreal Engine引擎不仅仅是一款开放的实时游戏引擎,也是各种大型3D项目的组装器。开放的引擎具有兼容各种硬件接口的能力,本系统能够满足前期预演对交互控制的外设接口需求,如手柄、遥控器等。

(4) 基于高效、高质量的实时渲染,前期预演的画面质量相较于传统的如Maya,3Dmax等工具,画面逼真,便于使用者接受。

(5) 本系统使用的外接设备为3D打印模型及Leap Motion,成本低廉,无需昂贵的运动捕获设备等系统,也为后续电影制作人员远程协作进行前期预演提供了可能。

随着电影特效制作流程的后期前置化,数字资产库在前期预演中起着非常重要的作用。虚拟资产库不仅仅包括摄影机、镜头、滑轨等摄影器材的虚拟资产,还包括灯光、道具等,以及虚拟角色的动画资源。为了能够应对不同题材、不同场景的预演需求,数字资产的需求将会非常巨大。

数字资产是否与真实一致,即数字参数与真实的参数是否完全相同,将在很大成度上影响着前期预演效果,这也是前期预演镜头能否在现场拍摄以及后期制作中“再现”的主要制约因素。

本文设计了符合影视制作人员使用习惯的人机交互方式,能够使电影制作人员参与到电影前期预演中。该交互方式也为未来交互式影像的数字娱乐方式带来一定的参考价值。

[1] KHALAF A S, ALHARTHI S A, DOLGOV I, et al. A comparative study of hand gesture recognition devices in the context of game design[C]//2019 ACM International Conference on Interactive Surfaces and Spaces. New York: ACM Press, 2019: 397-402.

[2] 胡弘, 晁建刚, 杨进, 等. Leap Motion关键点模型手姿态估计方法[J]. 计算机辅助设计与图形学学报, 2015, 27(7): 1211-1216.HU H, CHAO J G, YANG J, et al. Key point model for hand pose estimation based on leap motion[J]. Journal of Computer-Aided Design & Computer Graphics, 2015, 27(7): 1211-1216 (in Chinese).

[3] 孙国道, 黄普永, 刘义鹏, 等. 基于双Leap Motion的三维可视化交互方法研究[J]. 计算机辅助设计与图形学学报, 2018, 30(7): 1268-1275.SUN G D, HUANG P Y, LIU Y P, et al. Interactive 3D visualization with dual Leap Motions[J]. Journal of Computer-Aided Design & Computer Graphics, 2018, 30(7): 1268-1275 (in Chinese).

[4] VASYLEVSKA K, PODKOSOVA I, KAUFMANN H. Teaching virtual reality with HTC vive and leap motion[C]//SIGGRAPH Asia 2017 Symposium on Education on – SA’17. New York: ACM Press, 2017: 1-8.

[5] MARUYAMA K, SHIN J, KIM C M, et al. User authentication using leap motion[C]//2017 International Conference on Research in Adaptive and Convergent Systems. New York: ACM Press, 2017: 213-216.

[6] KAMAISHI S, UDA R. Biometric authentication by handwriting using leap motion[C]//The10th International Conference on Ubiquitous Information Management and Communication – IMCOM’16. New York: ACM Press, 2016: 1-5.

[7] HERNOUX F, BÉARÉE R, GIBARU O. Investigation of dynamic 3D hand motion reproduction by a robot using a Leap Motion[C]//2015 Virtual Reality International Conference on ZZZ – VRIC’15. New York: ACM Press, 2015: 1-10.

[8] HANTRAKUL L, KACZMAREK K. Implementations of the Leap Motion device in sound synthesis and interactive live performance[C]//2014 International Workshop on Movement and Computing – MOCO’14. New York: ACM Press, 2014: 142-145.

[9] DESNOYERS-STEWART J, SMITH M, GERHARD D. Mixed reality MIDI keyboard demonstration[C]//The 12th International Audio Mostly Conference on Augmented and Participatory Sound and Music Experiences. New York: ACM Press, 2017: 1-5.

[10] XU Y M. An animated lighting robot by gesture recognition[C]//SA’14: SIGGRAPH Asia 2014 Posters. New York: ACM Press, 2014: 1.

Human-computer interaction method in previz based on Leap Motion

ZHAO Jian-jun, HUANG Jun-peng, CHEN Jun-liang

(Department of Film and TV Technology, Beijing Film Academy, Beijing 100088, China)

With the development of virtual reality (VR) technology, previz has gradually become an indispensable part of the film production. To improve the experience of filmmakers in previz, the utilization of natural multi-modal interaction, combined with 3D real-time rendering engine, has become increasingly important. At present, most of the interactive methods employed in previz are optical motion capture methods, which are expensive, difficult to operate, and poor in portability. This paper presented a human-computer interaction method based on Leap Motion. In addition to obtaining accurate captured data, it greatly reduced cost and the difficulty of operation. Filmmakers can interactively control the trajectory and switch between different motion states of virtual characters through gestures. With the help of motion capture data, filmmakers can directly participate in previz. The verification through previz schemes shows that this method is more natural, friendly, direct and efficient.

Leap Motion; previz; human computer interaction; virtual reality; virtual character

TP 391

10.11996/JG.j.2095-302X.2021010071

A

2095-302X(2021)01-0071-08

2020-08-04;

4 August,2020;

2020-08-14

14 August,2020

北京市教委科研计划一般项目(KM201810050001);北京市教委科技创新服务能力建设项目(PXM2019_014220_000096)

:Beijing Municipal Education Commission Science and Technology Planning Project (KM201810050001);Beijing Municipal Education Commission Scientific and Technological Innovation Service Capacity Building Project (PXM2019_014220_000096)

赵建军(1983–),男,山西平遥人,讲师,博士。主要研究方向为计算机图形学、虚拟现实。E-mail:zhaojianjun@bfa.edu.cn

ZHAO Jian-jun (1983-), male, lecture, Ph.D. His main research interests cover computer graph and virtual reality. E-mail:zhaojianjun@bfa.edu.cn