基于U-Net模型的含杂水稻籽粒图像分割

2020-07-10韩梦娜

陈 进,韩梦娜,练 毅,张 帅

基于U-Net模型的含杂水稻籽粒图像分割

陈 进,韩梦娜,练 毅,张 帅

(江苏大学机械工程学院,镇江 212013)

含杂率是水稻联合收获机的重要收获性能指标之一,作业过程中收获籽粒掺杂的杂质包含作物的枝梗和茎秆等,为了探索籽粒含杂率和机器作业参数之间的关联,需要实时获取籽粒含杂率数据。该文基于机器视觉的U-Net模型对联合收获机水稻收获籽粒图像进行分割,针对传统分割算法中存在运算量大、耗时多、图像过分割严重和分割参数依赖人为经验难以应对各种复杂谷物图像等问题,采用深度学习模型多次训练学习各分割类别的像素级图像特征,提出基于U-Net深度学习模型的收获水稻籽粒图像中谷物、枝梗和茎秆的分割方法,采用改进的U-Net网络增加网络深度并加入Batch Normalization层,在小数据集上获得更丰富的语义信息,解决图像训练数据匮乏和训练过拟合问题。选取田间试验采集的50张收获水稻籽粒图像,采用Labelme方式进行标注和增强数据,裁剪1 000张256像素×256像素小样本,其中700张作为训练集,300张作为验证集,建立基于改进U-Net网络的收获水稻籽粒图像分割模型。采用综合评价指标衡量模型的分割准确度,对随机选取的60张8位RGB图像进行验证。试验结果证明,水稻籽粒的分割综合评价指标值为99.42%,枝梗的分割综合评价指标值为88.56%,茎秆的分割综合评价指标值为86.84%。本文提出的基于U-Net模型的收获水稻籽粒图像分割算法能够有效分割水稻籽粒图像中出现的谷物、枝梗和茎秆,时性更强、准确度更高,可为后续收获水稻籽粒图像的进一步识别处理提供技术支撑,为水稻联合收获机含杂率实时监测系统设计提供算法参考。

图像处理;水稻;杂质;U-Net网络模型

0 引 言

在水稻联合收获机实际工作过程中,机器作业参数的选取会直接影响收获的水稻纯度,具体地,当风机转速过慢、分风板角度不当等情况下,收获的水稻籽粒含有枝梗和茎秆等杂质,会导致收获品质降低[1],给农民带来直接的经济损失。在联合收获机工作过程中,实时监测粮箱中收获的杂质含量,并传送到驾驶室进行显示,有助于驾驶员及时调整机器的工作参数,从而提升联合收获机作业质量,减少经济损失。国内已有研究提出了采用机器视觉对图像进行分割,主要是基于室内试验的理想状态,水稻籽粒和杂质都是分开放置的,没有重叠粘连的情况,不能反映田间作业的真实情况。陈璇[1]采用分水岭算法和BP神经网络分割识别杂质和破碎籽粒,分水岭算法会导致图像过分割严重,使用BP神经网络算法进行图像处理的运算量较大,处理速度慢,难以满足实时性的要求;陈进等[2]采用MSRCR算法增强图像,并通过颜色区分茎秆、枝梗和破碎籽粒,再通过形态学处理得到最终分割结果,遇到杂质与籽粒颜色相近的情况,该方法易造成杂质误识别为籽粒,人为设置形态学参数泛化能力弱,易造成分类识别错误。

近年来,深度学习被广泛地应用到各个领域,基于深度学习的分割算法在图像处理领域取得了卓越的效果。其中,FCN(Fully Convolutional Networks)是一种用于语义分割的全卷积神经网络,由Long等[3]在2015提出,可以对任意大小的图像进行像素级分割,但FCN与图像语义信息联系不紧密,部分细节信息容易丢失。鉴于此,Ronneberger等[4]提出了适用于小训练集的网络模型U-Net,使用全卷积网络代替全连接层,可输入任意尺寸的图像,输出也是图像,实现了端到端的网络结构。U-Net呈“U”字型,左边的收缩路径输入分辨率比较高的特征图复制叠加到右边的扩展路径对应的采样特征图上,保留高分辨率与抽象特征的语义信息[5],该网络模型广泛应用于生物血管图像[6-8]、肝脏图像[9-10]、桥梁裂缝图像[11-12]和地理信息图像[13]等的分割,能够将图像细节分割出来,特别是对小数据集的处理表现出色,其效果优于传统分割方法[14-15]。

联合收获机作业时在线监测含杂率有助于驾驶员及时调整联合收获机作业参数。获取杂质含量的传统方法有收获后停机,人手动分离或通过筛分将谷物籽粒和杂质分离,然后再算出含杂率,这些方法不能在联合收获机作业时获取含杂率,驾驶员或联合收获机自动控制系统无法及时调整作业参数。周期性实时采集收获过程中的谷物图像,通过图像分割技术得到谷物图像杂质含量,再由质量像素数学模型得到含杂率。已有的图像分割算法存在过分割严重、分割参数依赖人为经验、需要图像集大等问题,本文采用深度学习模型多次训练学习各分割类别的像素级图像特征,提出基于原始U-Net网络增加深度, 在小数据集上获得丰富的语义信息,并加入Batch Normalization层解决因网络模型深度增加带来的训练过拟合问题,运用模型训练得到的颜色和形态特征等语义信息进行预测分割,提高谷物和杂质的图像分割准确度,为驾驶员或联合收获机作业参数自动控制系统提供调控依据。

1 图像来源与分割

1.1 图像采集系统

图像采集系统主要包括密闭取像室、LED光源、工业相机、采样盒、嵌入式处理器和显示屏等,如图1所示。

图1 图像采集系统组成及实物图

采样盒朝向工业相机镜头一侧用透明亚克力板密封形成视窗,工业相机和LED光源封装在采样装置内。田间试验时,采样装置安装在联合收获机出粮口下方(图1c)。联合收获机正常作业时,谷物从出粮口高速喷出,在重力作用下落入采样内,挡板受电磁铁推拉控制移动,电磁铁控制信号由嵌入式控制器给出,电磁铁不通电时,挡板挡住采样盒底部,谷物收集满后,相机与谷物相对静止,嵌入式控制器控制工业相机抓拍谷物静止图像,拍摄到的图像由嵌入式处理器后台进行分割,处理结果通过CAN通讯传输到驾驶室上位机并在显示屏显示。图像处理结束后,嵌入式控制器给出电磁铁通电信号,电磁铁带动挡板从采样盒下方移开,谷物全部释放,再进行下一个采样周期[17]。水稻联合收获机正常作业时喂入量一般不低于4 kg/s[16],在每个采样周期内采样盒可以被完全填满,与联合收获机的作业速度无直接关联[17]。选用的嵌入式处理器采用NVIDIA Pascal™构架,配置Pytorch深度学习环境,部署训练好的深度学习模型在线处理,可在田间环境持续工作。

1.2 图像来源

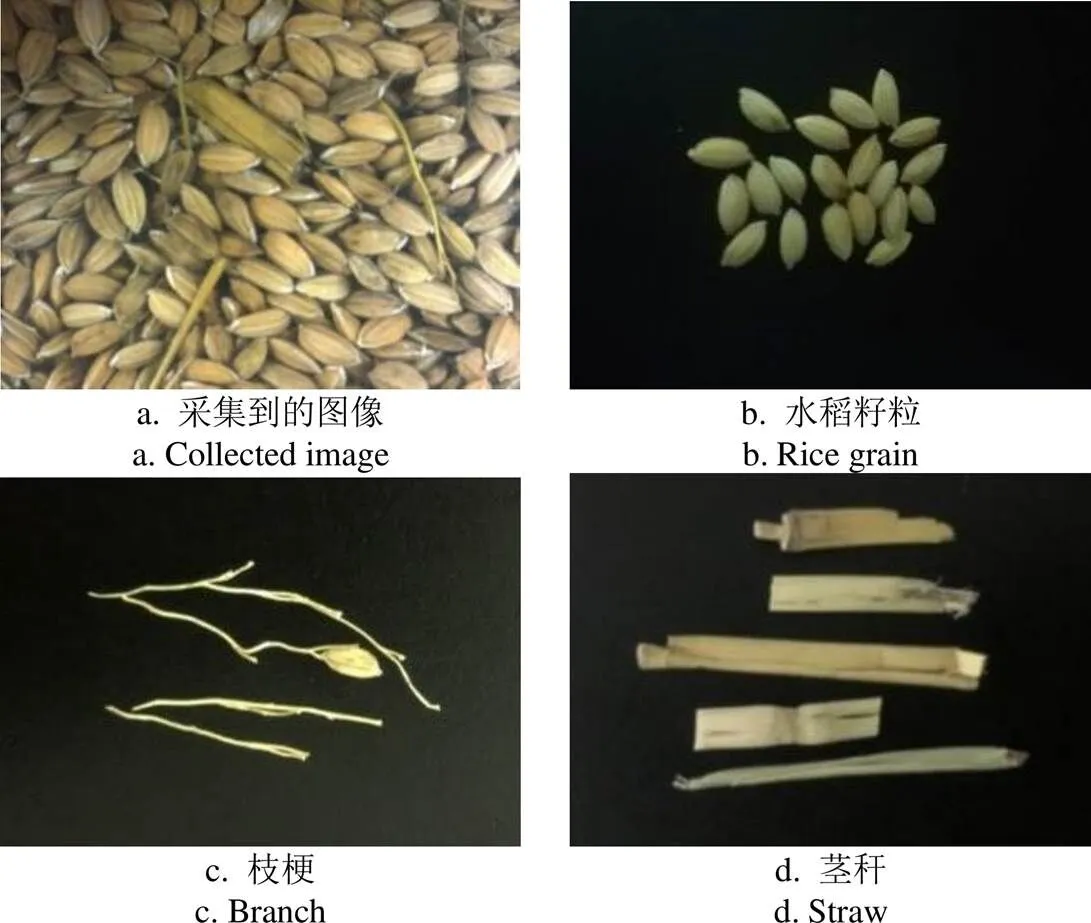

图像采集自2018年10月江苏省海门市三和镇水稻试验田的收获过程,将图像采样装置安装在雷沃十公斤机型联合收获机输粮装置的出粮口下方。工业彩色相机通过GigE接口与嵌入式控制器相连,嵌入式处理器Linux系统调用相机SDK动态库,得到RGB 8位数字图像并处理,程序设定保存图像格式为.png。采集到的图像包含水稻籽粒、枝梗和茎秆,如图2所示。

图2 采集到的图像及分割对象

从田间收获试验采集的图像中随机选取50张,图像格式为.png,原图为1 600像素×1 200像素,直接分割耗时长,因此重新调整图像尺寸为800像素×600像素。先使用图像标记工具Labelme手工标记水稻籽粒、枝梗和茎秆边界,并对包括背景在内的4类识别对象进行标记着色,得到手工标记图。水稻籽粒RGB值为[128,128,128],枝梗RGB值为[0,128,0],茎秆RGB值为[128,0,0],背景RGB值为[0,0,0]。经过图像增强,将800像素×600像素的原始图像和真实值随机裁剪成256像素×256像素,共得到1 000张图像,其中700张作为训练集,300张作为验证集。图像增强可以提升网络模型的鲁棒性,数据增强方法包括数据旋转、翻转、随机加噪声、拉伸、滤波等[18-19]。原始图像的手工标记结果即真实值如图3所示。

图3 原始图像的手工标记结果

1.3 图像分割

采集到的图像中籽粒、枝梗和茎秆粘连严重,各种目标堆叠在一起,语义信息复杂,需要获得各分割对象更为细致的图像特征。本文提出在原始U-Net网络模型基础上加深网络深度,同时为避免深层网络结构带来的训练过拟合问题,引入Batch Normalization层。将田间试验获得的收获水稻籽粒图像按籽粒、枝梗、茎秆和背景手工标记得到训练数据集。经过训练得到预测模型,并调用模型预测分割用于测试的图像。图像分割流程如图4所示。

图4 图像分割流程图

2 构建U-Net网络模型

在嵌入式系统平台使用Pytorch深度学习框架进行模型构建、训练和测试。 Ronnebergerd等[4]提出的原始U-Net 网络模型由收缩路径和扩展路径组成,收缩路径包括卷积操作和池化操作,扩展路径包括反卷积和卷积操作[20],包括19次卷积操作,4次最大池化操作,4次反卷积操作,4次复制叠加,原始网络输入572像素×572像素图像,输出图像为388像素×388像素。

本文改进网络以获取深层的图像信息,改进的U-Net网络包括3×3卷积核的卷积操作(conv)19次,2×2池化核的最大池化操作(maxpooling)4次,反卷积(up-conv)4次。因为待预测的枝梗外形纤细,需要增加模型深度以提取更丰富的语义信息,所以每次反卷积操作之后引入2×2卷积核,该操作保证扩展路径与收缩路径获得相同大小的特征图,方便之后的复制叠加操作(copy and crop),训练过程中,输入图像为256像素×256像素,与输出图像尺寸相同。改进U-Net网络如图5所示。

图5 改进的U-Net网络结构

改进U-Net网络模型深度增加,整个网络在训练过程中激活输入值分布易向内协变量偏移,导致训练过程中梯度消失,收敛速度降低。为解决该问题,本文在每次卷积操作后引入批归一化操作[21],实现输入数据均值为0、方差为1的标准正态分布,以加快网络收敛速度,提高网络泛化能力。

本文在隐层神经元采用ReLU函数作为激活函数,节省反向传播求误差梯度的计算量,其函数表达式为

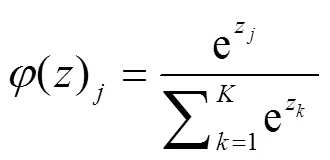

输出层多分类采用Softmax作为激活函数,将含任意实数的维向量“压缩”到另一个维实向量(),使得每一个元素都映射到(0,1)区间,其函数表达式为

式中()表示维实向量(),=1,,;z表示含任意实数的维向量,=1,,。

采用交叉熵函数作为多分类损失函数(Crossentropy Loss),其数学表达式如下:

式中表示总样本个数;y表示第个样本预测是否为第个标签,若是记y,否则为0;p表示第个样本预测为第个标签的概率。

采用自适应时刻估计方法(Adaptive Moment Estimation)计算每个参数的自适应学习率,加快收敛速度,其数学表达式如下:

3 模型训练与预测

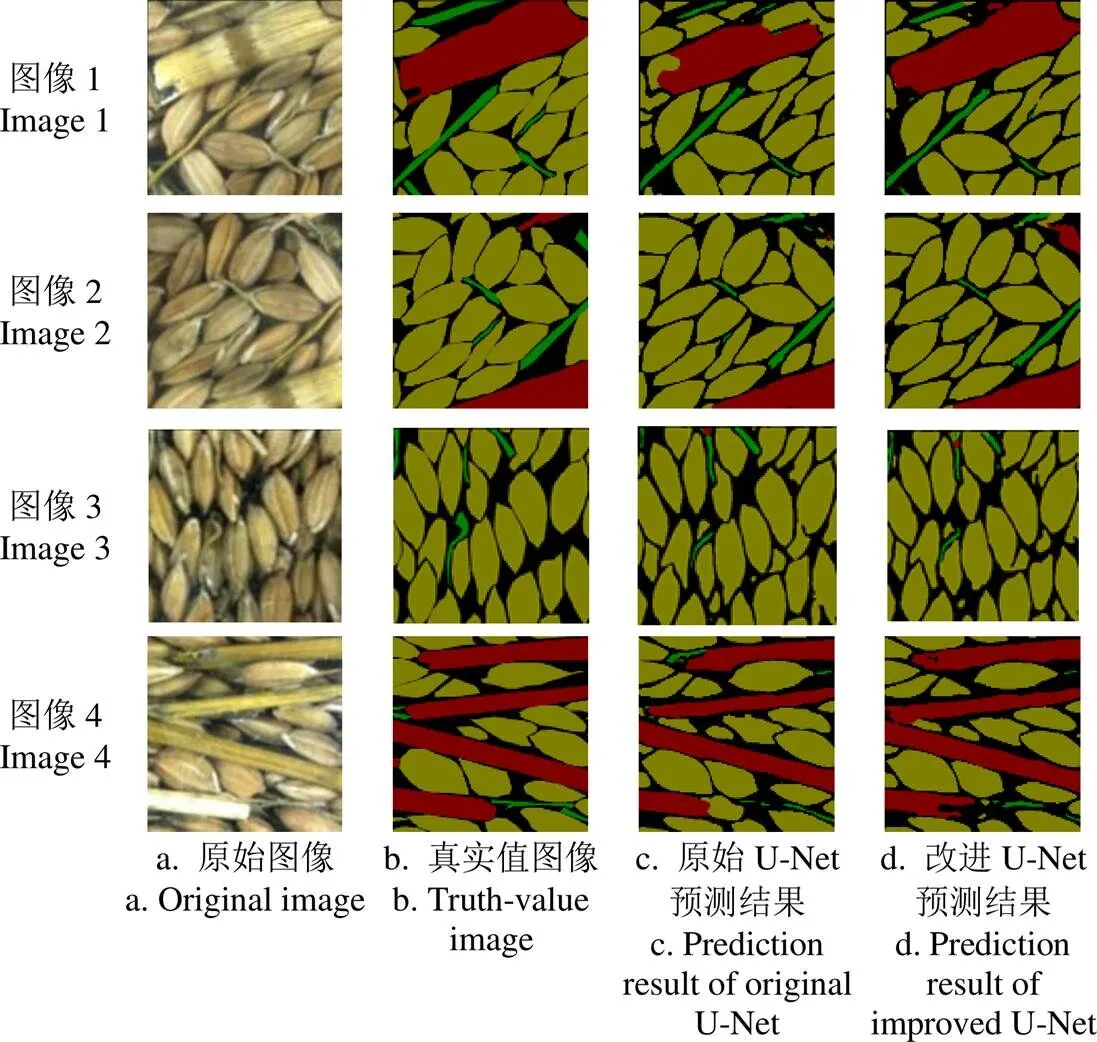

在微型计算机系统上安装Ubuntu 16.0系统、Python3.6编译环境、CUDA架构、cuDNN开发库,使用深度学习框架Pytorch,在该深度学习环境下进行模型构建、训练和预测,并将训练好的深度学习模型移植到嵌入式处理器,调用训练好的.pth模型进行实时图像分割。设置初始学习率为0.000 1,迭代次数100次。模型训练耗时6.41 h。在训练集上的准确度为0.886 4,训练损失为0.324 3,在验证集上的准确度为0.866 9,训练损失和准确度曲线图如图6所示。如图7所示,对256像素×256像素图像的预测结果与对应的真实值图像基本吻合。说明采用U-Net网络模型对水稻籽粒、茎秆和枝梗图像分割是可行的。

图6 训练损失和准确度曲线

图7 预测结果

4 模型后处理

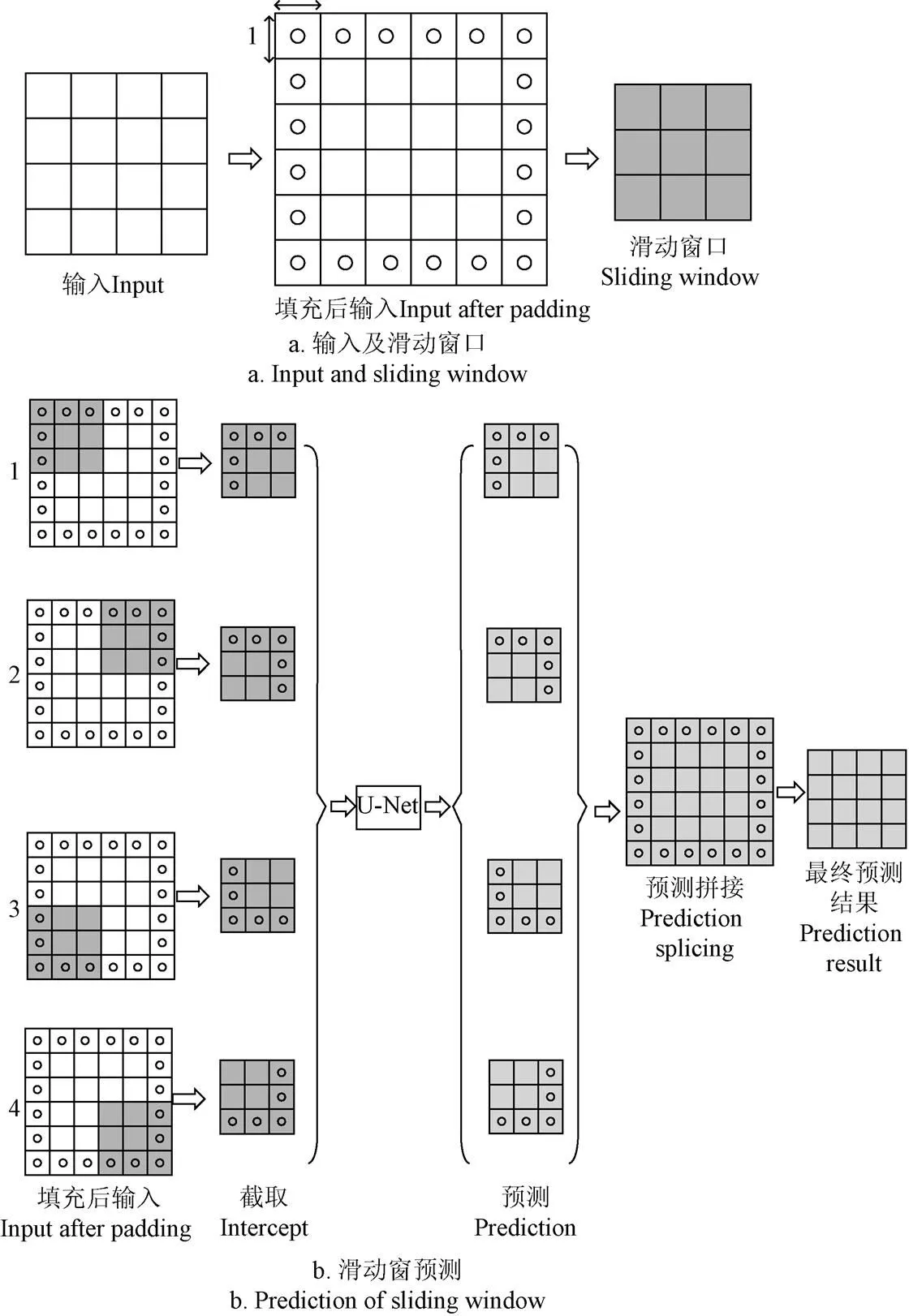

采用滑动窗进行预测图像[22-24],滑动窗预测原理如图8所示。

图8 滑动窗预测原理

图8中输入图像为4像素×4像素,padding填充大小为1×1,滑动窗口大小3×3,stride步长为3,滑动窗口在填充后的输入图从左到右、从上到下按步长依次滑动,每次截取与滑动窗大小相同的图像,得到4个截取部分,输入到U-Net网络模型得到预测图像,按填充后输入的像素坐标位置拼接回去,再将预测部分中原来填充部分去掉,得到输入图像的预测结果。

输入图像按照800×600矩阵形式排列,padding填充大小为84×112,滑动窗口大小256×256,stride步长256,每张800×600像素图像得到12个截取部分,分2个batch输入到U-Net预测,拼接去掉padding填充部分,得到完整预测拼接图。图9为滑动窗预测图像结果,可以看出预测拼接的图像没有产生接缝、错位。预测输出图像与手工标记的真实值图像(图3)着色一致,水稻籽粒的RGB值为[128,128,128],枝梗的RGB值为[0,128,0],茎秆的RGB值为[128,0,0],背景的RGB值为[0,0,0]。

图9滑动窗预测结果

5 结果与分析

本文使用准确率(precision),召回率(recall)作为图像分割结果的评价指标,并以综合评价指标(1)作为准确率和召回率的评估值。

式中TP为正确分割的像素数,FP为误分割的像素数,FN为漏分割的像素数。

从收获试验采集到的实时水稻图像中另取60张8位RGB数字图像,用原始U-Net模型和改进U-Net模型分别进行分割,将训练好的深度学习模型和程序在嵌入式处理器上运行。分别统计出分割结果中水稻籽粒、枝梗、茎秆连通域的正确分割、误分割、漏分割的像素值,计算出准确率和召回率,最后统计得到1值,如表1所示。

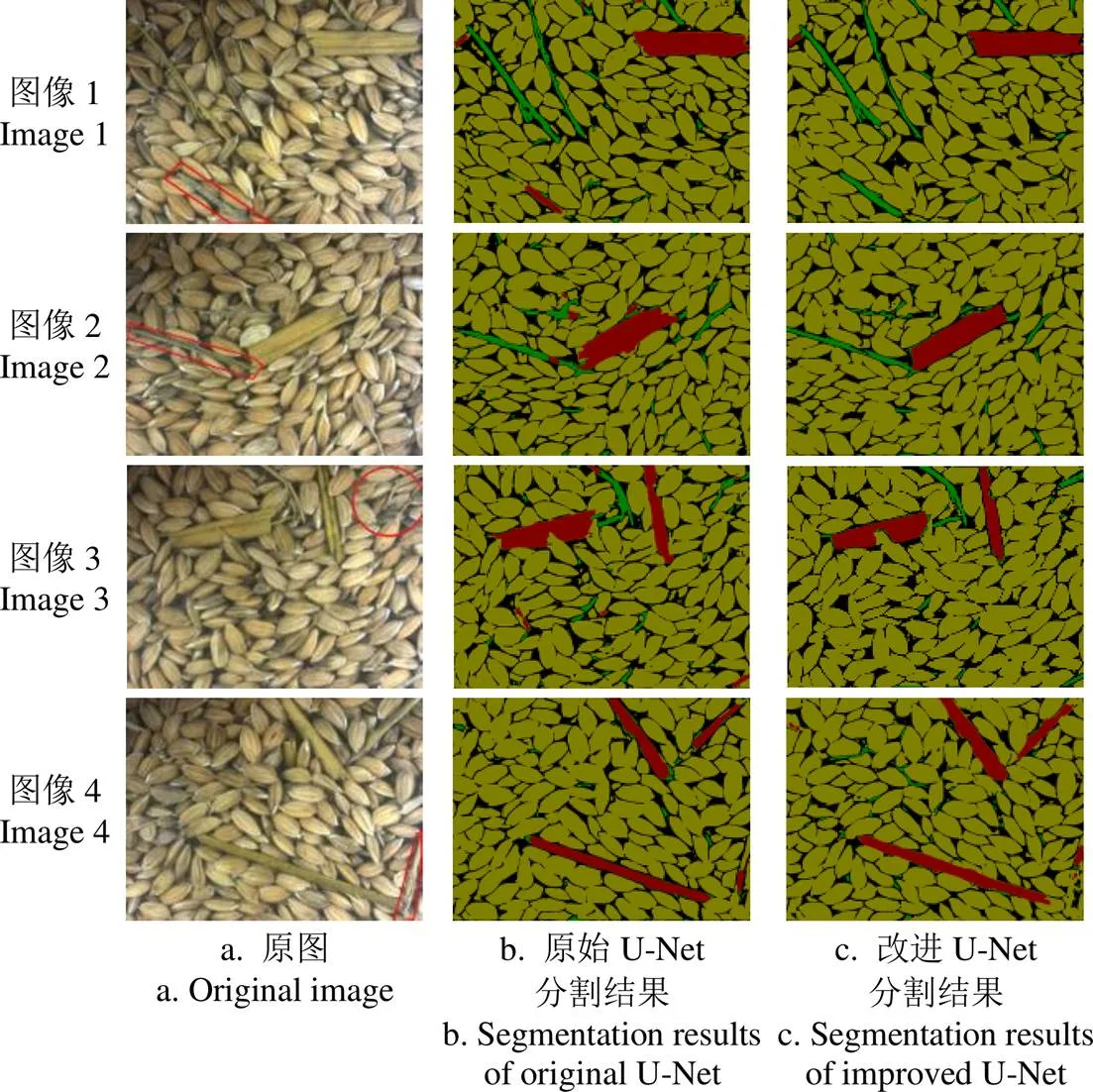

由表1可知,本文方法的水稻籽粒分割1值为99.42%,水稻籽粒基本都可以正确地分割出来,被误分割成茎秆或枝梗的情况较少,且边界能较好地保留;枝梗的1值为88.56%,大部分枝梗得到有效分割,能够将细小的枝梗分割出来;茎秆的1值为86.84%,茎秆外形呈直条状,与其他目标区别明显,分割结果比较理想。与原始U-Net模型相比,改进后的U-Net模型对水稻籽粒分割的1值提升3.53个百分点,枝梗的1值提升15.22个百分点,茎秆的1值提升31.82个百分点。分割效果如图10所示。

表1 U-Net模型改进前后的分割结果对比

图10 分割结果

由图10可知,对于图像1,改进U-Net模型能够正确地将枝梗分割出来,而原始U-Net模型误分割成茎秆;对于图像2,改进U-Net能够将枝梗正确地分割出来,分割形状与原图契合,而原始U-Net模型存在误分割,且茎秆欠分割严重。对于图像3,改进U-Net模型将枝梗误分割为籽粒,这是由于该枝梗较为纤细且周围的籽粒粘连严重,2种分割目标的边界不清晰;对于图像4秆,改进U-Net模型没有将其完整识别出来,这主要是因为该茎秆在图像边缘与周围的水稻籽粒重叠,茎秆与籽粒颜色区分不明显。

对田间试验采集的60幅图像分别使用已有的2种算法进行处理,计算准确率和召回率,得到1值,并记录各算法的平均处理时间,结果如表2所示。文献[1]采用分水岭算法和BP神经网络识别杂质与谷物,每张图像处理耗时10 s左右,难以满足实时作业要求,算法过分割严重。文献[2]采用MSRCR算法,结合HSV颜色模型和形状特征对杂质与谷物分割识别,对颜色相近的谷物与茎秆易造成误识别。

表2 4种算法分割性能对比

由表2可知,与文献[2]相比,本文的改进U-Net模型处理时间提升不明显,这主要是因为分割过程中运用模型后处理滑动窗口预测机制,滑动产生一定的耗时,改进U-Net模型与原始U-Net模型在实时处理时间上相差不大,总体耗时前者大于后者,这是由于网络层数加深,处理语义信息存在一定耗时。一次谷物采样和弃样耗时5 s,本文算法处理时间4.62 s,能够满足田间作业实时处理的要求。本文算法利用训练得到各对象语义信息实现预测分割,减少人为设置形态学参数造成的分割误差,误分割、过分割情况减少,分割准确度整体优于已有算法。

6 结 论

1)本文提出一种分割收获水稻图像的算法,改进了U-Net网络模型,训练手工数据集并调用训练好.pth格式的模型预测分割出水稻籽粒、茎秆和枝梗。

2)针对收获水稻图像中含有水稻籽粒、茎秆和枝梗多个分割目标、各目标粘连覆盖现象严重,提出在原始U-Net网络基础上加深网络,以获取更丰富的语义信息;为避免网络的加深导致训练过程中,收敛速度降低,引入批归一化操作,改进后的网络模型预测出的效果明显优于原始网络模型,证实改进后的U-Net网络模型鲁棒性更好;部分杂质的形态颜色与籽粒接近,使用单一的颜色特征分割籽粒和杂质,极易将杂质误分割成籽粒,因此通过图像增强模拟待分割目标的复杂状态。

3)从收获试验采集到的图像中另外选取60张8位RGB水稻图像作为测试样本,采用综合评价指标衡量分割准确度评估预测分割效果,统计测试结果显示,水稻籽粒分割的综合评价指标值为99.42%,枝梗分割的评估为88.56%,茎秆为86.84%,与已有方法相比分割准确度有所提升。

本文提出的基于U-Net模型的含杂水稻籽粒图像分割算法能够分割图像中的水稻籽粒、枝梗和茎秆,提升了分割准确度,为后续含杂率的计算奠定基础。含杂率数据能反应当前联合收获机工作参数选取是否合适,利于提升机器的作业质量。在接下来的研究中,可将U-Net分割算法与SVM分类机制结合,进一步提高收获水稻图像的分类准确度。

[1]陈璇. 联合收获机谷物破碎率、含杂率监测方法及系统研究[D]. 镇江:江苏大学,2017.

Chen Xuan. Research on the Methods and Systems for Monitoring Grain’s Crushing Rate and Impurity Rate for Combine Harvester[D]. Zhenjiang: Jiangsu University, 2017. (in Chinese with English abstract)

[2]陈进,顾琰,练毅,等. 基于机器视觉的水稻杂质及破碎籽粒在线识别方法[J]. 农业工程学报,2018,34(13):187-194.

Chen Jin, Gu Yan, Lian Yi, et al. Online recognition method of impurities and broken paddy grains based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2018, 34(13): 187-194. (in Chinese with English abstract)

[3]Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2015: 3431-3440.

[4]Ronneberger Olaf, Fischer Philipp, Brox Thomas. U-Net: Convolutional networks for biomedical image Segmentation[J]. Medical Image Computing and Computer- Assisted Intervention-MICCAI 2015, 2015, 9531: 234-241.

[5]亢洁,丁菊敏,万永,等. 基于分水岭修正与U-Net的肝脏图像分割算法[J]. 计算机工程,2020,46(1):255-261,270.

Kang Jie, Ding Jumin, Wan Yong, et al. Liver image segmentation algorithm based on watershed correction and U-Net[J]. Computer Engineering, 2020, 46(1): 255-261, 270. (in Chinese with English abstract)

[6]雷军明,王成钢,刘雪燕. 基于改进U-Net的视网膜血管图像分割[J]. 信息技术与信息化,2019(10):168-169.

[7]孟笛. 改进的U-net网络在冠状动脉血管分割中的应用[D]. 长春:吉林大学,2019.

Meng Di. Application of Improved U-Net Network in Coronary Artery Segmentation[D]. Changchun: Jilin University, 2019. (in Chinese with English abstract)

[8]周叶萍. 基于编码器—解码器结构的眼底图像中视网膜血管分割的方法研究[D]. 广州:华南理工大学, 2019.

Zhou Yeping. Retinal Vessel Segmentation in Fundus images using a Convolutional Enconder-Decoder Architecture. Guangzhou: South China University of Technology, 2019.

[9]张凯文. 基于U-Net的肝脏CT图像分割研究[D]. 广州:华南理工大学,2019.

Zhang Kaiwen. Liver Segmentation from CT Images Based on U-Net[D]. Guangzhou: South China University of Technology, 2019. (in Chinese with English abstract)

[10]刘哲,张晓林,宋余庆,等. 结合改进的U-Net和Morphsnakes的肝脏分割[J]. 中国图象图形学报,2018,23(8):1254-1262.

Liu Zhe, Zhang Xiaolin, Song Yuqing, et al. Liver segmentation with improved U-Net and Morphsnakes algorithm[J]. Journal of Image and Graphics, 2018, 23(8): 1254-1262. (in Chinese with English abstract)

[11]朱苏雅,杜建超,李云松,等. 采用U-Net卷积网络的桥梁裂缝检测方法[J]. 西安电子科技大学学报,2019,46(4):35-42.

Zhu Suya, Du Jianchao, Li Yunsong, et al. Method for bridge crack detection based on the U-Net convolutional networks[J]. Journal of Xidian University, 2019, 46(4): 35-42. (in Chinese with English abstract)

[12]高卫宾. 基于改进U-net网络的桥梁裂缝检测方法[D]. 西安:西安电子科技大学,2019.

Gao Weibin. Bridge Crack Detection Method Based on Improved U-Net Network[D]. Xi’an: Xidian University, 2019. (in Chinese with English abstract)

[13]任欣磊,王阳萍,杨景玉,等. 基于改进U-net的遥感影像建筑物提取[J]. 激光与光电子学进展,2019,56(22):195-202.

Ren Xinlei, Wang Yangping, Yang Jingyu, et al. Building detection from remote sensing images based on improved U-Net[J]. Laser & Optoelectronics Progress, 2019, 56(22): 195-202. (in Chinese with English abstract)

[14]王海鸥,刘慧,郭强,等. 面向医学图像分割的超像素U-Net网络设计[J]. 计算机辅助设计与图形学学报,2019,31(6):1007-1017.

Wang Haiou, Liu Hui, Guo Qiang, et al. Design of superpiexl U-Net network for medical image segmentation[J]. Journal of Computer-Aided Design & Computer Graphics, 2019, 31(6): 1007-1017. (in Chinese with English abstract)

[15]吴则举, 王嘉琦, 焦翠娟, 等. 基于深度学习网络U-Net的轮胎带束层分割算法研究[J]. 青岛大学学报,2019,32(4):22-29,35.

Wu Zeju, Wang Jiaqi, Jiao Cuijuan, et al. Research on tire belt segmentation algorithm based on deep learning network U-Net[J]. Journal of Qingdao University, 2019, 32(04): 22-29, 35. (in Chinese with English abstract)

[16]顾琰. 联合收获机谷物含杂率、破碎率在线监测装置研制及试验研究[D]. 镇江:江苏大学,2019.

Gu Yan. On-line Monitoring Device and Experimental Study of Grain Impurity Rate and Broken Rate of Combine Harvester[D]. Zhenjiang: Jiangsu University, 2019. (in Chinese with English abstract)

[17]Chen Jin, Lian Yi, Li Yaoming, et al. Design of sampling device for rice grain impurity sensor in grain-bin of combine harvester[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(5): 18-25.

陈进,练毅,李耀明,等. 联合收获机粮箱内稻谷含杂率传感器采样盒设计(英文)[J]. 农业工程学报,2019,35(5):18-25. (in English with Chinese abstract)

[18]高震宇. 基于深度卷积神经网络的图像分类方法研究及应用[D]. 合肥:中国科学技术大学, 2018.

Gao Zhenyu. Research and Application of Image Classification Method Based on Deep Convolution Neural Network[D]. Hefei: University of Science and Technology of China, 2018. (in Chinese with English abstract)

[19]梁舒. 基于残差学习U型卷积神经网络的乳腺超声图像肿瘤分割研究[D]. 广州:华南理工大学,2018.

Liang Shu. Research on Breast Ultrasound Image Segmentation Based on Residual U-shaped Convolution Neural Network[D]. Guangzhou: South China University of Technology, 2018. (in Chinese with English abstract)

[20]许慧敏. 基于深度学习U-Net模型的高分辨率遥感影像分类方法研究[D]. 成都:西南交通大学,2018.

Xu Huimin. Method Research of High Resolution Re-mote Sensing Imagery Classification Based on U-Net Model of Deep Learning[D]. Chengdu: Southwest Jiaotong University, 2018. (in Chinese with English abstract)

[21]Ioffe S, Szegedy C. Batch normalization: Accelerating deep network training by reducing internal covariate shift[EB/OL]. 2015-02-11[2018-10-15]. http://arxiv.org/pdf/1502.03167.pdf.

[22]Chen Guanzhou, Zhang Xiaodong, Wang Qing, et al. Symmetrical dense-shortcut deep fully convolutional networks for semantic segmentation of very-high-resolution remote sensing images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing. 2018, 11(5): 1633-1644.

[23]马治楠. 基于深度学习的计算优化技术研究[D]. 贵阳:贵州大学,2019.

Ma Zhinan. Research on Computational Optimization Technology Based on Deep Learning[D]. Guiyang: Guizhou University, 2019. (in Chinese with English abstract)

[24]张怡晨. 基于卷积神经网络的舰船检测研究[D]. 厦门:厦门大学,2018.

Zhang Yichen. Ship Detection via Convolutional Neura1 Network[D]. Xiamen: Xiamen University, 2018. (in Chinese with English abstract)

Segmentation of impurity rice grain images based on U-Net model

Chen Jin, Han Mengna, Lian Yi, Zhang Shuai

(212013)

The impurity rate is one of the important harvesting performance indexes of the rice combine harvester. The impurity of the harvested grain during the harvest includes the branches and straws of the crop. In order to study the correlation between the impurity rate of the grain and the operation parameters of the combine harvester, it is necessary to obtain the data of impurity rate in real-time. This paper studies the segmentation algorithm of hybrid rice grain image based on U-net model of machine vision technology. Aiming at the problems existing in traditional segmentation algorithm, such as large amount of computation, time-consuming processing, serious over segmentation of images, and the determination of segmentation parameters depends on human experience, the deep learning model is used to train and learn image features of each segmentation category of pixel level for many times. Based on the U-net depth learning model, a method of predicting and segmenting grains, branched and straws in hybrid rice grain images is proposed. The improved U-net network is used to increase the depth of the network and add the batch normalization layer. The information of more abundant data is obtained in a small data set, and the problem of lack of training data and over fitting of training is solved. In this paper, 50 rice images collected from the field experiments are selected, Labelme method is used to annotate and enhance data. 1 000 small samples of 256 × 256 pixels are cut, in which 700 images are used as training data set, 300 images are used as verification data set, and a hybrid rice grain image segmentation model of combine harvester based on improved U-net network is established. The accuracy of the model is measured by the comprehensive evaluation index, and 60 images with 8-bit RGB selected randomly are verified. The experimental results show that the comprehensive evaluation index value of rice grains segmentation is 99.42%, the comprehensive evaluation index value of branch and stem segmentation is 88.56%, and the comprehensive evaluation index value of straws segmentation is 86.84%. The proposed algorithm based on U-net model can effectively segment the grains, branches and straws in the hybrid rice grain images, and has the higher real-time and accuracy of the segmentation. The research results can provide technical support for the further recognition and processing of rice grain image, and provide algorithm reference for the design of rice combine harvester impurity rate monitoring system.

image processing; rice; impurities; U-Net model

陈进,韩梦娜,练毅,等. 基于U-Net模型的含杂水稻籽粒图像分割[J]. 农业工程学报,2020,36(10):174-180.doi:10.11975/j.issn.1002-6819.2020.10.021 http://www.tcsae.org

Chen Jin, Han Mengna, Lian Yi, et al. Segmentation of impurity rice grain images based on U-Net model[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(10): 174-180. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2020.10.021 http://www.tcsae.org

2019-02-24

2020-04-30

国家重点研发计划重点专项(2016YFD0702001);江苏省重点研发项目(BE2017358);江苏省研究生科研与实践创新计划(SJCX19_0550)

陈进,教授,博士生导师,主要从事智能农业装备和机械系统监测与控制研究。Email:chenjinjd126@126.com

10.11975/j.issn.1002-6819.2020.10.021

S147.2

A

1002-6819(2020)-10-0174-07