基于改进GWO-GRNN 的管道焊缝三维重构测量

2024-01-31高博轩赵弘苗兴园

高博轩,赵弘,苗兴园

(中国石油大学(北京)机械与储运工程学院,北京 102249)

0 前言

近年来随着机器视觉、计算机图像处理等技术不断兴起与发展,双目视觉三维重构技术已经运用到智能工厂、非接触测量、虚拟现实、教育辅导和生物医学等领域中,极大地促进了模式识别、人工智能等相关领域的发展[1]。曹治国等[2]提出的基于Snake 模型的血管树骨架三维重构技术大大减少了人工干预,提高了重构的精度。高庆吉等[3]设计了实现全自主足球机器人导航的异构双目活动视觉系统,通过数据融合观测相遇目标。彭鹤等人[4]基于NURBS 曲面三维成像技术,通过管道检测数据反求曲面的节点矢量与控制点,重构出表面过渡更加平滑的管道三维模型。OKADA 等[5]设计了仿真机器人动态行走导航系统,将采集到的二维图像重构成周围区域地图,实现机器人的避障和自行走。

双目视觉三维重构技术同样也用到管道焊缝测量领域。传统的焊缝测量方法是采用肉眼观察或接触式测量等方法,这种方法效率低、精度低且需要耗费大量的人工成本,工人工作强度大,已经不再满足目前工业自动化的需求,因此越来越多的学者采用机器视觉技术对焊缝尺寸进行非接触测量研究[6]。陈海永等[7-10]提取焊缝线结构光,计算特征点的空间坐标对焊缝进行三维测量。王乃鑫[11]搭建了基于线激光视觉的焊缝三维信息测量平台来解决对焊后焊缝磨抛的数据问题,对于实际熔宽6.9 mm 的焊缝实验测得误差为0.07 mm。杨鹏程等[12]采用点激光位移传感器对焊缝表面缺陷进行检测,基于高斯降噪以及Delaunay 三角剖分原理,重构出缺陷的三维模型。RODRÍGUEZ-GONZÁLVEZ 等[13]基于宏观摄影测量和激光扫描技术对焊缝进行测量与质量评估,对长度300 mm 的焊缝测量误差为0.072 mm。以上学者采用激光视觉对管道焊缝或熔池进行三维重构,虽然激光视觉有着较高的精度,但激光视觉发射的结构光易受到环境因素的影响,且需要高精度的控制台对其进行控制,不适用于现场作业的条件。

罗天洪等[14]提出基于双目结构光的方法对焊接熔池进行三维重构,来解决焊接过程中弧光对重构的干扰问题,实验表明该方法测量实际尺寸5.6 mm 的熔池得到的重构误差为0.7 mm。胡曦等人[15]提出一种基于双目视觉的管道全位置焊缝三维测量方法,对双目系统进行标定并进行极线校正,构建与像素点灰度值、灰度值梯度相关的能量代价函数进行立体匹配,再结合三角测量法计算三维坐标重构出焊缝点云,与标准值6.25 mm 相比重构误差在0.2 mm 以内。ZHANG 等[16]采用被动视觉传感系统,提出一种双光路成像方法采集焊缝熔池图像,选择了660 nm窄带和850 nm 长通作为系统的工作波段,并采用两台带有相同波段滤波器的相机采集熔池图像,图像配准后采用基于梯度和灰度的邻域超像素合并(GNSM)方法提取熔池图像轮廓,通过对比分析拟合偏差和实际测量结果,实际焊缝宽度为12 mm 的重构误差在0.2 mm 以内。以上学者采用立体视觉技术对管道焊缝进行三维重构。立体视觉的结构相对简单且易于操作,效率较高,因此本文作者选择双目立体视觉对管道焊缝进行三维重构。

但由于相机装配工作台安装不精确导致相机位姿改变,使测得焊缝的实际尺寸存在较大的累计误差。此外,双目相机平台在管道内运动过程中由于振动、障碍等情况也会导致相机位姿改变,无法保证焊缝三维重构测量的精确性。因此,本文作者提出一种基于改进灰狼算法优化广义回归神经网络(Improved Gray Wolf Algorithm-Generalized Regression Neural Network)的图像点三维坐标误差补偿模型,以解决不同相机位姿下管道焊缝的三维重构与测量。为提高GWO 算法的全局寻优能力,分别从种群初始化、收敛因子和最优位置更新3 个方面进行改进,优化GRNN 的平滑因子。在此基础上,利用GRNN 进行图像点三维坐标误差预测。通过立体视觉测量系统和焊缝三维重构测量实验,验证误差补偿模型对于不同相机姿态的焊缝三维重构和测量精度。

1 双目立体视觉测量方法

1.1 单目相机模型建立

单目相机模型是双目立体视觉的基础,在单目相机成像过程中设计4 个坐标系之间的变换,分别为世界坐标系Ow-xwywzw、相机坐标系Oc-xcyczc、图像坐标系O-xy和像素坐标系O-uv,如图1 所示。

图1 单目相机4 个坐标系Fig.1 Four coordinate systems for monocular camera

通过刚体变换,将坐标系进行旋转和平移可将世界坐标系转化为相机坐标系,再根据针孔成像原理将相机坐标系转化为更利于坐标变换的图像坐标系,像素坐标系反映了相机CCD 芯片中像素的排列情况,像素坐标是相机拍摄照片后唯一已知的位置信息,因为像素坐标系与图像坐标系共处同一二维平面内,通过平移变换便可相互转化,最终得到空间内任意一点P(xw,yw,zw)投影到像素坐标系中p(u,v)的变换公式为式(1)所示:

式中:Zc为比例因子;f为焦距;fx、fy分别为x轴、y轴的归一化焦距;u0、v0分别为图像主点中心坐标;R为相机的旋转矩阵;T为相机的平移向量。其中焦距和主点中心坐标都是相机内部参数,可通过查阅相机生产厂商手册获得。

1.2 双目相机模型建立及三维坐标计算

双目相机模型是基于单目相机模型建立的,双目相机中通常以左相机为基准建立双目模型,先确定左相机与世界坐标系的位置关系再建立右相机相对于左相机的联系。双目相机模型如图2 所示。

图2 双目相机模型Fig.2 Binocular camera model

基于双目相机模型对空间点三维重构及计算三维坐标,规定左相机为主相机,通过单目相机标定可以分别得到左相机的旋转矩阵Rl和平移向量Tl和右相机的旋转矩阵Rr和平移向量Tr。由式(1)可知两相机分别有:

因为旋转矩阵R是3×3的矩阵,平移向量T是3×1的向量,因此:

则式(2)(3)可改写为

将式(5)(6)展开整理得到:

通过双目相机的标定可以得到相机的外参数矩阵以及任意空间点P在左、右像平面上投影点的像素坐标,采用最小二乘法求解式(7),便可得到任意空间点P在世界坐标系下的三维坐标(xw,yw,zw)。

2 基于IGWO-GRNN 的图像点坐标误差补偿模型

本文作者针对立体视觉检测图像坐标点的误差进行预测和补偿,提出IGWO-GRNN 建立图像点坐标的误差补偿模型。利用Tent 映射提高初始种群的多样性,同时引入一种余弦收敛因子以平衡算法的全局和局部搜索能力,并将最优记忆保存思想用于最优位置更新,有效避免算法陷入局部最优。通过IGWO 算法对GRNN 的参数进行优化选择,以获得更高的图像坐标点误差的预测精度。

2.1 广义回归神经网络(GRNN)

广义回归神经网络(Generalized Regression Neural Network,GRNN)广泛应用于求解回归问题。GRNN 的网络结构共有4 层,包含输入层、模式层、求和层和输出层,网络结构示意如图3 所示。广义回归神经网络是以径向基网络为基础并且没有模型参数需要训练,因此具有良好的非线性逼近性能、收敛速度快、样本数据少时预测效果很好等优势。文中针对图像坐标的误差补偿属于回归问题且采集的数据量较少,因此选用GRNN 模型对图像坐标的误差进行补偿。

图3 广义回归网络结构示意Fig.3 Schematic diagram of GRNN

由图3 可知,网络的输入样本为X= [X1,X2,…,Xn]T,输出样本为Y= [Y1,Y2,…,Yk]T,n、k分别表示输入训练样本的维度和输出样本的维度。模式层神经元数目等于学习样本数目n,各神经元对应不同的样本,模式层神经元传递函数[17]如式(8)所示:

求和层的节点个数等于输出样本的维度加1(k+1)。求和层输出分为两部分:第一节点输出为模式层算术和,其余k个节点的输出为模式层的加权和。求和层的第一个节点输出如式(9)所示:

其余k个节点的输出如式(10)所示:

输出层节点个数等于标签向量的维度,每个节点的输出等于对应的求和层输出与求和层第一个节点输出相除,如式(11)所示:

式(8)中:X为输入参数;Xi为第i个神经元的训练样本;σ为平滑因子。由式(8)可知,当输入数据不属于样本数据时,σ的取值会严重影响预测精度,因此为了减小模型预测误差,需要求解一个最优的平滑因子σ。GWO 算法于2014 年由澳大利亚学者MIRJALILI 等根据狼群等级制度和狩猎过程提出,具有收敛性能较强、参数少、易实现等特点,但也存在容易收敛过早、易陷入局部最优等问题,因此提出一种改进GWO 算法来优化平滑因子。

2.2 改进灰狼优化算法(IGWO)

2.2.1 基本灰狼优化算法

灰狼种群有着严格的社会层级结构,如图4 所示。灰狼优化算法(Grey Wolf Optimizer,GWO)在每次求最优解过程中取得最优解的3 只狼的位置标记为α、β、δ,其余狼的位置标记为ω。GWO 的优化过程主要由每代种群中的最好3 个解α、β、δ 指导完成。

图4 灰狼种群层级结构Fig.4 Gray wolf population hierarchy

灰狼捜索猎物时会逐渐地接近猎物并包围它,全局最优灰狼的位置即为猎物的位置,位置标记为ω的狼跟随着α、β、δ 狼的位置进行更新,其行为的数学模型[13]为

式中:t为当前迭代次数;Xp(t)表示猎物的位置向量;X(t)表示当前灰狼的位置向量;D为狼群中个体狼与猎物之间的距离;A和C是协同系数向量;r1和r2是[0,1]中的随机向量;在整个迭代过程中a由2 线性降到0。

由式(12)可知α、β、δ 狼与猎物之间的距离Dα、Dβ、Dδ,进而引导ω 狼共同狩猎,达到更新狼群位置的目的,该行为的数学模型[18]为

式中:X1、X2、X3为狼群ω 被α、β、δ 三只狼指导后更新的位置。

2.2.2 改进灰狼优化算法

基本GWO 算法存在中后期收敛速度慢、容易陷入局部最优等问题,为此,本文作者通过引入Tent混沌映射、收敛因子非线性调整机制和最优记忆保存思想对算法进行改进,建立了一种具有较好全局寻优能力的改进灰狼优化算法。

(1)基于Tent 混沌映射的种群初始化策略

GWO 在优化过程中通常采用随机产生的数据作为种群的初始化设定,这种方法难以确保种群的丰富性,对求解最优造成影响。针对这种问题,本文作者引入Tent 混沌映射。

Tent 混沌映射的表达式为

里下河腹部地区湖泊湖荡管理与保护信息系统………………………………… 钱福军,李 频,夏卫中(17.72)

由式(15)可知:当u=1/2 时,Tent 混沌映射具有最典型的形式,此时得到的序列均匀分布,对不同的参数具有相似的分布密度,因此本文作者引入的Tent 混沌映射表达式为

Tent 混沌映射种群初始化的步骤为:随机产生一个[0,1]的初值,按照式(16)进行迭代计算至最大迭代次数后保存序列结果。

(2)非线性调整机制

GWO 算法中收敛因子a的值从0~2 的线性变化,容易陷入局部最优。为避免算法早熟,引入非线性余弦收敛因子,表达式为

式中:t为当前迭代次数;T为最大迭代次数。余弦因子在刚开始迭代时收敛速度较线性因子缓慢,便于寻找全局最优;在迭代后期,余弦收敛因子的收敛速度更快,有利于提升算法的快速性。

(3)基于最优记忆保存的位置更新策略

为了进一步改善GWO 算法易陷入局部最优、收敛速度慢、求解精度不高等问题,引入粒子群最优记忆思想保存狼群的位置更新变化。该方程表达式为

式中:τ为0~1 之间的个体记忆系数;Pi(t)为第i个灰狼个体经过的最优位置。改进后的灰狼算法在加强了算法的求解速度和求解精度的同时,又增加了个体自身最优信息。

2.2.3 改进算法测试

表1 测试函数Tab.1 Test functions

表2 测试结果Tab.2 Test results

由表2 可知:对于f7(x)和f8(x),IGWO 算法与基本GWO 算法求解精度相同,但对于其他情况,IGWO 算法表现出明显的优势,迭代寻优得到的最优解偏差都小于其他3 种优化算法。由此可见,IGWO 算法的寻优精度更佳,说明提出的改进策略能够有效地提高算法求解的质量,验证了IGWO 算法的有效性。

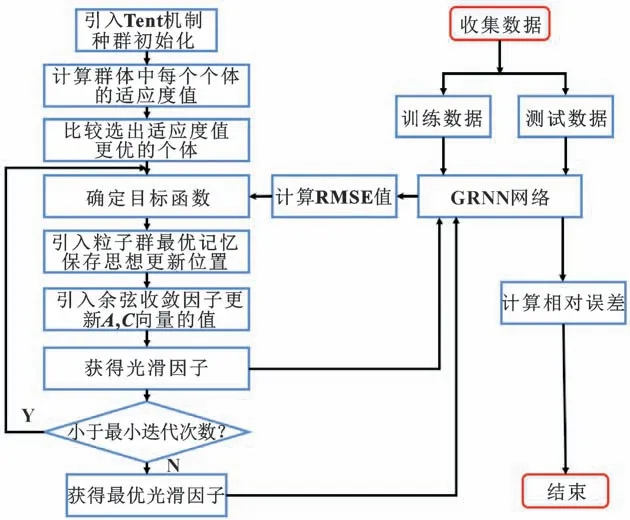

2.3 IGWO 优化GRNN 算法

本文作者采用IGWO 算法优化GRNN 中的平滑因子σ,将样本数据分为训练集和测试集,采用10 折交叉验证的方式对GRNN 进行训练。将训练集划分为10 等份,随机选择1 份作为测试数据,剩余9 份作为训练数据,可有效解决训练数据少导致预测精度低的问题。将GRNN 模型交叉训练的最小均方根误差(RMSE)作为IGWO 的目标函数,通过不断迭代使RMSE 的值达到最小或达到最大迭代次数后结束循环,将求解得到的最优平滑因子代入GRNN 模型,并通过独立测试集进行模型验证。IGWO-GRNN 的预测流程如图5 所示。

图5 IGWO-GRNN 流程Fig.5 Flow of IGWO-GRNN

详细步骤如下:

步骤1,通过立体视觉技术获取不同相机位姿下标定板各点在左、右相机中的像素坐标,计算检测的三维世界坐标与真实坐标之间的误差,构建坐标误差数据集,对数据归一化处理,并以9 ∶1 的比例划分为训练集和测试集。

步骤2,引入Tent 混沌映射对灰狼种群进行初始化,设置种群数量N,维度D以及上下限ub、lb,最大迭代次数T。

步骤3,采用10 折交叉验证的方式训练GRNN,获取均方根误差(RMSE)作为IGWO 的目标函数。

式中:n为预测样本总数量;为第i组预测样本的预测输出值;yi为对应的实际目标输出值。

步骤4,不断迭代至F(x)值最小后,输出对应最小值的最优平滑因子。

步骤5,将优化得到的最优平滑因子输入GRNN网络,对图像各点的三维坐标误差进行预测,并计算预测误差。

3 焊缝三维重构与测量实验

3.1 测量系统搭建及数据集构建

本文作者设计的双目立体视觉测量系统包括2 台basler 相机、4 个平面光源、光源控制器、激光发射器、图像采集器以及相机工作台。图像采集器选用NI 公司的IC-3172 相机控制器,相机型号为ACA2440-75uc,分辨率为2 448 像素(H)×2 048 像素(V),像素尺寸为3.45 μm×3.45 μm,镜头焦距为12 mm。图像采集采用LabVIEW 软件搭载的IMAQ模块,测量系统实物如图6 所示。

图6 双目立体视觉测量系统Fig.6 Binocular stereo vision measurement system

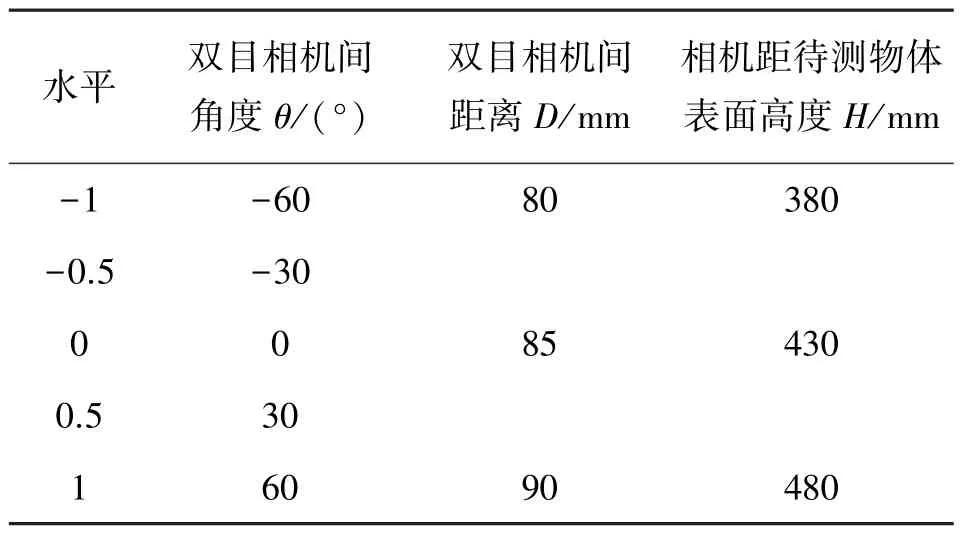

为了补偿双目相机在不同位姿下图像点三维坐标的检测误差,依据正交试验设计方法,选取双目相机之间转动角度θ、双目相机间距离D以及相机距待测物体表面高度H3 个因素表征相机位姿,其中因素θ包含五水平,因素D和H包含三水平,正交试验水平及因素如表3 所示[21]。为了方便试验与计算,只研究右相机相对于左相机z轴的旋转,且左、右相机处在同一平面(xOy面),距离D仅在y轴移动。图像采集环境为试验室,不考虑环境噪声对图片的影响,采集过程光源强度保持相同且相机光圈调至合适亮度,不考虑光线对图片的影响。

表3 正交试验水平及因素Tab.3 Orthogonal test levels and factors

为了便于坐标计算,利用双目相机采集的标定板图像构建坐标误差数据集,通过激光发射器产生的激光与标定板方格产生交点,可以确保左右相机在不同姿态下提取图像中每组点都为同一组固定点。利用VBAI 软件对采集后的图像进行特征提取,每张图片分别提取19 组激光与方格交点的左相机像素坐标(xl,yl)以及右相机像素坐标(xr,yr),根据设计的正交试验共有45 种不同的相机位姿,因此共提取了855 组对应点的左右相机像素坐标,计算各点的三维世界坐标,通过真实坐标获取各点坐标的检测误差。

3.2 误差补偿模型验证

本文作者以左相机坐标系为世界坐标系,即左相机坐标系与世界坐标系完全重合,那么左相机的旋转矩阵为单位阵,平移向量为零向量。已知右相机相对于左相机的旋转角度θ以及相机间的距离D,便可求得右相机的旋转矩阵R和平移向量T,结合第3.1 节中提取的左右相机图像中点的像素坐标并代入式(7)中便可求出不同姿态下提取点的三维坐标(x,y,z)。利用光栅尺测得提取点的真实三维坐标便可得到每个点坐标的误差(Δx,Δy,Δz)。IGWOGRNN 以相机间角度θ、相机间距离D、相机高度H、左相机像素坐标(xl,yl)以及右相机像素坐标(xr,yr)7 个参数作为输入,每个点坐标的误差(Δx,Δy,Δz)作为输出,将提取的855 组数据乱序后以9 ∶1的比例划分为训练集和数据集,并采用10 折交叉验证的方式进行训练,及训练集再划分为10 份,轮流将其中9 份作为训练数据,1 份作为测试数据进行训练,可有效解决训练数据少导致训练效果差的问题。设置IGWO 种群数量为30,最大迭代次数为200次,优化参数为平滑因子。训练基于MATLAB 平台,采用Intel Xeon Silver 4214R CPU GeForce 以及RTX 3070 GPU×2 64G RAM 的配置。

为了验证IGWO-GRNN 模型的优越性,采用相同的数据集分别对遗传算法优化广义回归神经网络(GA-GRNN),粒子群算法优化广义回归神经网络(PSO-GRNN),以及灰狼算法优化广义回归神经网络(GWO-GRNN)进行训练,并比较4 种模型的RMSE 收敛曲线以及预测效果,收敛曲线如图7所示。

图7 4 种方法的收敛曲线Fig.7 Convergence curves for the four methods

由图7 可以看出:IGWO-GRNN 模型随迭代次数的增加呈多层阶梯式的收敛,共经历了4 个收敛阶段,得到最小的RMSE 值为0.254,相比于其他3 种模型,IGWO-GRNN 求解的RMSE 值最小,且在迭代至100 次左右就结束收敛,快速性也优于其他3 种模型,IGWO-GRNN 最终优化得到的最优平滑因子值为1.514 1。

由此可以证明本文作者提出的IGWO 能够很好地实现对GRNN 模型的优化,相比于其他3 种模型,IGWO-GRNN 具有更小的RMSE 值,收敛速度更快,且精度更高,稳定性更好。将测试数据集以及求解得到的最优平滑因子分别导入至上述4 种模型中,得到图像点三维坐标检测误差的预测效果如图8 所示。

图8 4 种方法预测点的坐标误差Fig.8 Coordinate errors of the predicted points for the four methods:(a) x coordinate;(b) y coordinate;(c) z coordinate

由图8 可知:IGWO-GRNN 模型相比较于其他3种模型具有更高的预测精度,与真实值相比预测的平均误差为6.52×10-4mm,而GA -GRNN、PSO -GRNN、GWO-GRNN 的平均预测误差分别为0.314 8、0.608 6、0.067 5 mm,分别减少了99.8%、99.9%以及99%。这说明本文作者提出的IGWO-GRNN 预测精度最高,可以精准补偿相机在不同姿态下图像中任意点的三维坐标误差。

3.3 焊缝三维重构

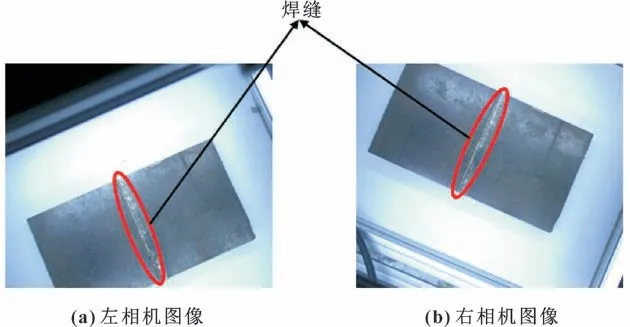

本文作者通过搭建的试验平台对管道焊缝图像进行双目立体视觉检测。为了验证所提出的IGWOGRNN 误差补偿模型在相机不同位姿下的焊缝三维重构效果,以X80 钢管道的一部分作为试样,该试样中间有垂直于母线方向的均匀焊缝,选取3 种不同位姿进行焊缝的三维重构,分别为:第一组,θ=20°,D=60 mm,H=420 mm;第二组,θ=45°,D=65 mm,H=370 mm;第三组,θ=70°,D=70 mm,H=470 mm。以第一组为例,双目相机采集的焊缝图像如图9 所示。

图9 第一组参数下双目相机采集焊缝图像Fig.9 Collected weld seam images by binocular camera under the first set of parameters:(a)left camera image;(b)right camera image

利用VBAI 软件提取焊缝图像各点的左、右相机像素坐标,并整合其位姿信息代入训练好的IGWOGRNN 模型中进行三维坐标补偿,利用补偿后的三维坐标绘制三维点云图,并计算补偿后的三维重构误差。3 组位姿的焊缝三维重构图以及x、y、z3 个方向的重构误差如图10 所示。可以看出:重构后焊缝三维模型很好地反映出焊缝的三维形貌,通过建立的IGWO-GRNN 误差补偿模型,x和y方向坐标的误差在6×10-4~8×10-4mm 内,很好地反映出焊缝的三维形貌;由于z坐标的实际尺寸略大于x和y坐标尺寸,导致误差有所增大,但平均误差也只有6×10-3mm 左右。

图10 重构后的焊缝三维模型及三维坐标误差Fig.10 Reconstructed 3D model of weld seam and 3D coordinate error:(a)the first set of poses;(b)the second set of poses;(c)the third set of poses

3.4 焊缝三维测量

根据第3.3 节中三维重构后的点云图对焊缝进行三维测量,提取焊缝边缘点,将最高点作为焊缝特征点从而对焊缝的焊宽、余高和长度进行计算测量。焊缝的尺寸示意图如图11 所示。

图11 焊缝尺寸示意Fig.11 Schematic of weld size

在焊缝横向的两端提取一组边缘点作为焊宽计算的特征点,由于焊缝宽度并不固定,因此共取n组边缘点计算,取平均值作为焊缝的焊宽,计算公式为

式中:为焊缝焊宽;(x1,y1,z1)、(x2,y2,z2)为左、右边缘点的三维坐标。

焊缝的余高是焊缝顶端至管道切面的垂直距离,由于不能直接测量,因此在焊缝表面提取3 个坐标点构成三维平面,求解该平面的法向量再求出单位法向量(i,j,k),取焊缝最高点到该法向量的投影即得到焊缝余高。共取n个最高点分别计算对应的余高后取平均得到焊缝的余高。其公式为

式中:为焊缝余高;各点与管道表面点构成的向量为(xm,ym,zm)。

提取焊缝首尾两端点的三维坐标,通过点到点距离公式计算焊缝的长度。共取10 组边缘点以及10 个焊缝最高点计算焊缝的焊宽与余高,将提取的三维坐标代入式(20)(21)中,分别计算得到焊缝的焊宽、余高以及长度,计算结果以及与目前其他学者研究的误差对比如表4 所示,表中焊缝真实值由游标卡尺测得。

表4 焊缝三维测量值以及误差对比Tab.4 Comparison of 3D measurement values and errors of weld seams

4 结论与展望

为解决相机在不同位姿下焊缝图像重构误差大、三维测量尺寸精度低的问题,建立双目立体视觉模型补偿相机不同位姿下图像点坐标的误差。针对双目立体视觉图像坐标点的误差预测和补偿,提出IGWOGRNN 建立图像点坐标的误差补偿模型,并搭建试验台对模型进行验证。

(1)基于GWO 优化算法提出了IGWO 算法,该算法分别对GWO 的种群初始化、位置更新以及收敛因子三方面进行改进,引入Tent 映射加强种群初始化的丰富性,引入粒子群最优记忆保存位置更新策略,同时引入余弦收敛因子代替原算法中的线性收敛因子,提高算法的收敛速度,避免陷入局部最优。

(2)根据IGWO 算法建立IGWO-GRNN 模型,基于GRNN 网络预测得到的RMSE 值作为IGWO 算法的目标函数,求解使RMSE 值最小时的GRNN 平滑因子作为最优平滑因子。将相机位姿信息以及左、右相机图像坐标点的像素坐标作为IGWO-GRNN 模型的输入,预测三维点x、y、z坐标的误差,验证预测的平均误差为6.52×10-4mm。

(3)搭建双目立体视觉测量试验台,提取不同相机位姿下的焊缝图片,基于IGWO-GRNN 模型预测焊缝三维重构坐标点的误差,与真实值比较,验证得到x、y方向坐标的重构误差在8×10-4mm 以内,z方向坐标的重构误差在6×10-3mm 以内,并绘制重构后的焊缝三维点云图计算焊缝的焊宽、余高和长度。研究结果表明:提出的IGWO-GRNN 模型收敛精度高,迭代速度快,具有强泛化能力,对不同位姿状态下的双目相机采集的图像误差补偿都有极高的精度。