低照度交通场景行人检测算法研究

2023-12-13刘凯天磨少清

刘凯天,磨少清

低照度交通场景行人检测算法研究

刘凯天,磨少清

(天津职业技术师范大学 汽车与交通学院,天津 300222)

无人驾驶汽车车载相机在低照度交通场景下由于光照不足、环境复杂导致采集的行人图像质量差,后续检测算法难以保障足够的检测精度。因此,针对低照度交通场景下行人检测效果不好的问题,文章提出一种基于改进YOLOv4-Tiny的行人检测算法。首先,对骨干网络增加了8倍下采样特征图输出,并自下而上的融合深层语义信息和浅层细节信息,以增强对小目标的检测能力,同时在不同特征图融合之前引入注意力机制模块,使网络更加关注重点特征信息。其次,使用SPP-Net提高网络的感受野和鲁棒性。利用K-means聚类算法对行人目标生成新的先验框,用Soft-NMS方法替换掉传统的非极大值抑制方法。改进后的网络模型记为YOLO-IPD,实验表明文章提出的YOLO-IPD模型在自建数据集上效果良好。

行人检测;低照度;YOLOv4-Tiny;注意力机制;深度学习

近年来,由于深度学习技术取得了突破性进展,计算机视觉及工业自动化技术也得到了显著提升。尤其在智能汽车领域,无人驾驶更是得到广泛的关注,在无人驾驶的系统中,行人检测模块是极重要的,它是无人驾驶技术安全性能的基础。行人检测的方法之一是对车载相机采集到的图像进行识别检测,然而现实生活中低照度交通场景下,无人驾驶汽车车载相机采集到的行人图像质量差,存在图像对比度低、噪声多、图像细节轮廓可见度低等问题。且由于车载相机安装位置的限制,导致行人目标存在偏小、密集遮挡、外形轮廓复杂多变等检测难点,若直接使用通用的目标检测网络难以保障无人驾驶汽车在低照度复杂多样交通场景下的行人检测精度要求。

目标检测算法,主要分为传统的检测算法和基于卷积神经网络的检测算法。传统的检测算法如梯度直方图或支持向量机,主要采用滑动窗口检测目标,时间长且人工设计的特征鲁棒性差。基于卷积神经网络的算法实时性和准确性高,且由于通过对大量样本特征的学习来完成目标检测,故在面对复杂图像识别时有着较好的鲁棒性[1]。因此,基于卷积神经网络的目标检测算法成为当前机器视觉领域的主流方法。

基于卷积神经网络的目标检测算法包括以 R-CNN[2]与 Faster R-CNN[3-5]等为代表的两阶段目标检测算法和以YOLO[6-7]和SSD等为代表的由端到端的一阶段目标检测算法。两阶算法使用区域候选网络来提取候选目标信息,区域建议模块对计算机内存消耗很大;而一阶段算法是学习从输入图像直接到目标位置和类别的输出,没有区域候选环节,目标检测被视为回归问题,检测速度较快。

本文采用YOLO系列的YOLOv4-Tiny模型作为低照度交通场景下行人检测的原始网络,对YOLOv4-Tiny模型进行改进以提高在低照度交通场景下行人检测的性能。对YOLOv4-Tiny网络模型的改进主要包括:1)增加了8倍下采样特征图输出,并融合深层语义信息和浅层细节信息,同时在不同特征图融合之前引入注意力机制模块,使网络更加关注重点特征信息,从而增强对小目标的检测能力。其次,使用SPP-Net提高网络的感受野和鲁棒性。2)利用K-means聚类算法生成适合自制数据集行人目标的先验框,用Soft-NMS方法替换掉传统的非极大值抑制方法,以缓解因行人目标密集遮挡而漏检的问题。改进后的模型记为YOLO-IPD,该模型较原模型提高了检测精度。

1 YOLOv4-Tiny模型结构

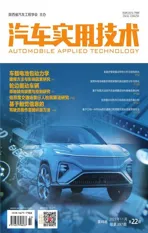

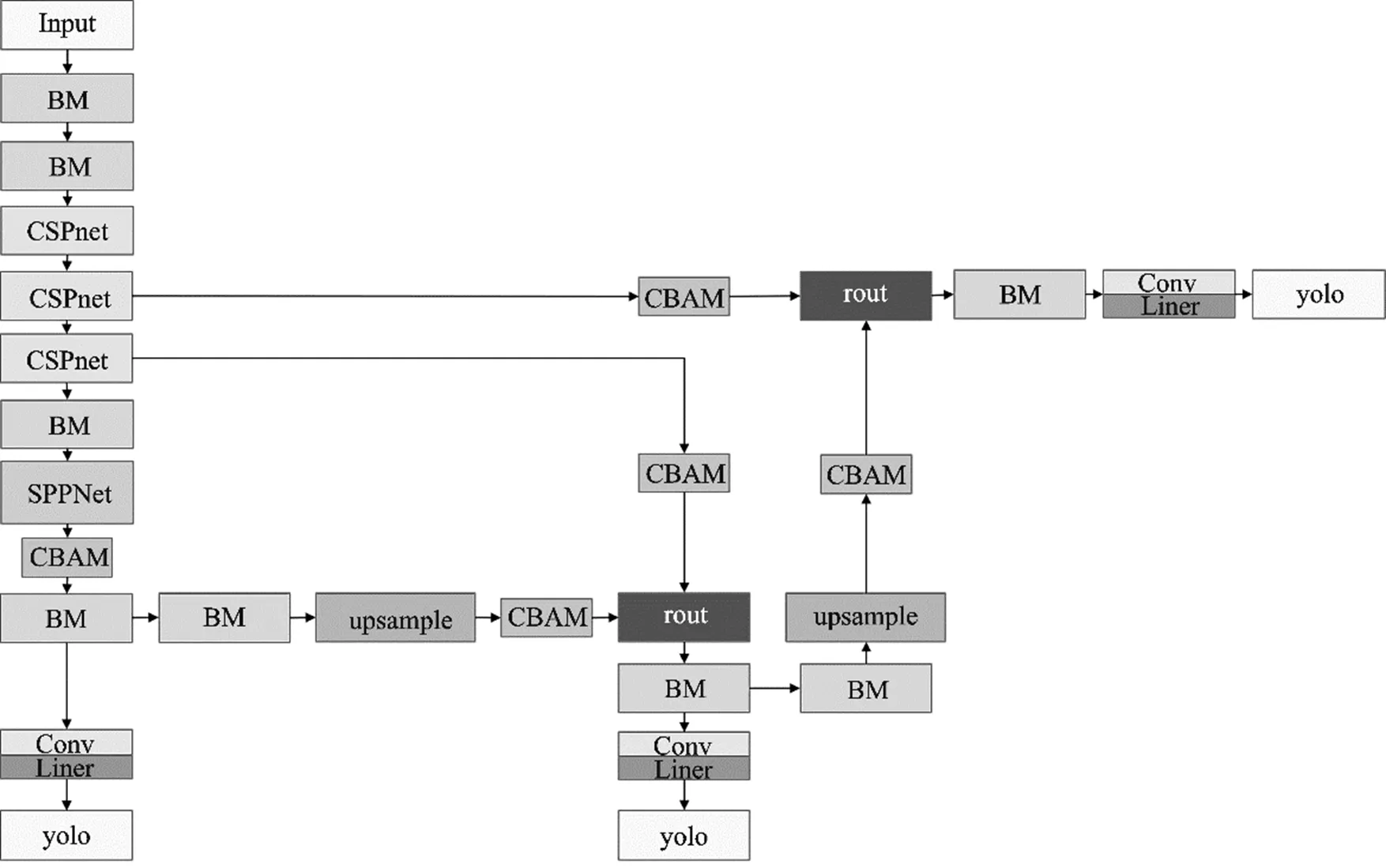

YOLOv4-Tiny是YOLOv4的精简版,属于轻量化后的模型,只有600万的参数相当于原来网络的十分之一,检测速度更快。由卷积层(Conv)、批量归一化层(BN)、激活函数(LeakyReLU)组成基本的特征提取单元(BaseModule),使用CSPDarket53-Tiny作为主干特征提取网络,CSPDarket53-Tiny由CSPnet堆叠组成,CSPnet由BM单元进行残差嵌套组合再经过最大池化层构成。残差结构能够缓解随着网络层数的增加而网络性能退化的问题。YOLOv4-Tiny仅使用了两个特征层进行分类与回归,合并特征层时使用了特征金字塔网络(FPN),如图1所示。

图1 YOLOv4-Tiny结构图

输入网络的图像,先经过两层BM单元进行初步的特征提取,然后再经过三层CSPnet模块进行32倍下采样输出13×13的特征图,之后再经过BM单元、卷积层、线性激活输入给第一个YOLO检测头。从第三个CSPnet中引出16倍下采样特征图,与经过2倍上采样的特征图进行拼接,融合浅层信息与深层信息,经过卷积与激活输入给第二个YOLO检测头。检测头1和检测头2分别处理13×13和26×26大小的特征图对不同尺度的目标进行检测。

2 YOLO-IPD算法

无人驾驶汽车车载相机收集到的低照度的图像,行人的纹理细节信息不明显,行人图像多为小目标,且行人目标多具有密集、遮挡的特点。原始的YOLOv4-Tiny网络模型,对特征的提取不够精细,对小目标的检测能力一般,因此,添加一个检测头以提升网络对小目标的检测能力,使用特征金字塔算法融合深浅特征层获得更加丰富的信息,加入SPP-Net模块增加提取的多尺度特征信息量,引入注意力机制使模型更加关注重点信息,使用Soft-NMS缓解密集情况下预测框被误删的问题,从而实现对原始模型的改进。

2.1 SPP-Net与注意力机制

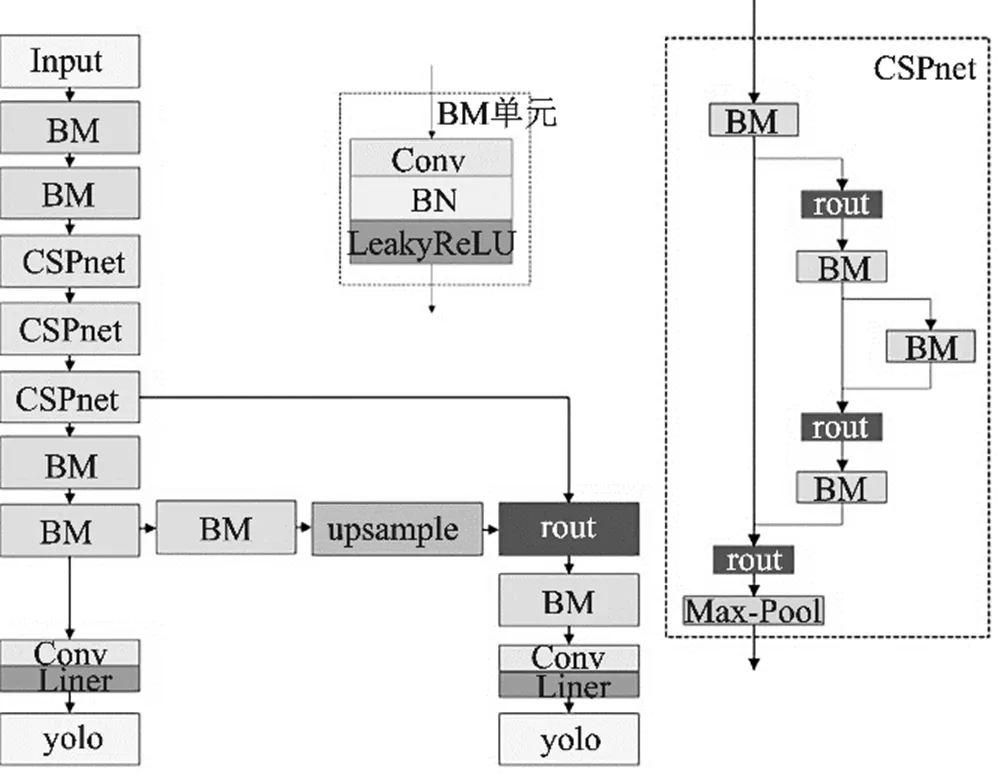

SPP-Net能够将来自不同核大小池化后的特征图串联在一起作为输出,最大池化核为k={1×1, 5×5, 9×9, 13×13},比单纯的使用单个尺寸核大小的最大池化的方式,更有效地增加网络的感受野,提升鲁棒性和提取多尺度特征,如图2所示。

图2 SPP-Net模块结构

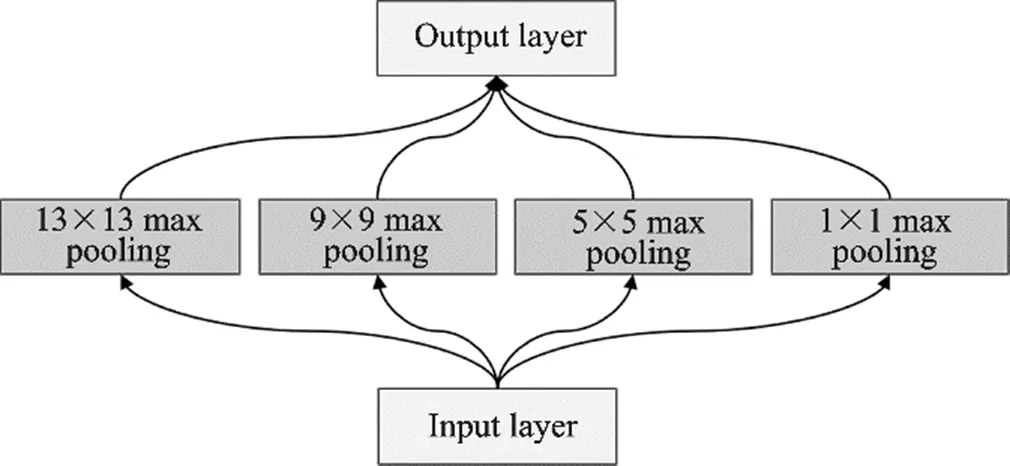

CBAM(Convolutional Block Attention Mod- ule)是卷积注意力机制模块,是结合了通道(channel)和空间(spatial)两个方向的注意力机制模块。输入的特征图先经过CAM再经过SAM,这样不仅能够减少参数节约算力,还能即插即用到网络的架构中,如图3所示。

图3 CBAM模块结构

2.2 YOLO-IPD网络

YOLOv4-Tiny只有两个检测头,分别对13×13,26×26两种大小的特征图进行检测,然而自制数据集中的行人目标大多是小目标,容易造成漏检问题。32倍下采样和16倍下采样特征图包含高级的语义信息,然而缺乏行人目标的细节纹理信息,加之在低照度交通场景下采集到的图像多为昏暗图像,本身纹理细节信息少,这些都导致原始网络对行人目标的检测精度低。因此,添加一个检测头,对输出的52×52大小的特征图进行检测,并自下而上的将三种大小不同的特征图进行融合,从而实现浅层纹理细节信息与深层抽象语义信息融合以提升对行人目标的检测精度,如图4所示。

图4 YOLO-IPD网络

在主干特征提取网络与头部网络之间加入SPP-Net以增加网络的感受野,26×26和52×52的特征图检测头都融合深层信息和浅层信息,在融合之前深层信息和浅层信息都经过了CBAM注意力模块的重点选择,使模型更关注重点信息。

2.3 K-means聚类算法和Soft-NMS算法

传统的K-means聚类算法采用欧氏距离或曼哈顿距离来计算数据对象间的距离,算法的详细流程如下:

1)首先确定聚类中心点的个数,即值;

2)从数据集中随机选择个聚类中心进行初始化;

3)计算数据集中其他点与每个聚类中心点之间的距离(如欧氏距离),将各个点划分到距离其较近的聚类中心所在类;

4)更新每个类的聚类中心;

5)重复步骤3)和步骤4),直到新计算出来的聚类中心和原来的聚类中心之间的距离小于一个设置的阈值,则可以认为聚类已经达到期望的结果。

文中将K-means算法中欧氏测距法进行改进,根据交并比(Intersection over Union, IoU)计算先验框之间的距离,计算公式为

(,)=1-(,) (1)

式中,为真实框与先验框之间的距离;为任意一个真实框;为先验框;IoU为真实框与先验框的交集和并集的比值。

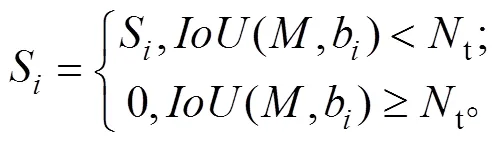

原始算法采用传统的NMS方法,来确定最后的预测框。

式中,为得分最高的预测框;b为第个预测框;t为人为设置的IoU阈值;S为第个预测框的得分。

传统的NMS方法会确定得分最大的预测框,计算其他预测框与得分最大的预测框的交并比,且当交并比大于设置的阈值时会将该预测框直接删除。但行人目标存在重叠、集群、遮挡的现象,传统NMS极易粗暴地将相邻目标的预测框剔除掉,所以引入Soft-NMS替换掉传统NMS。

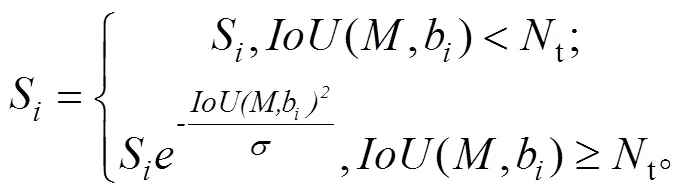

式中,为高斯系数,一般取值为0.5。与式(2)相比,Soft-NMS将IoU大于阈值的部分进行改进,使用了高斯加权,相对于原NMS直接置0的操作,Soft-NMS对IoU值大的预测框得分进行惩罚,重叠面积越大惩罚系数越高,对应的得分S越小,这样有利于对重叠目标的检测,减少漏检情形。对于Soft-NMS的高斯系数实验证明:设置为0.35对自制数据集效果最好。

3 实验及结果分析

本文实验在Windows10操作系统下,基于Pytorch深度学习框架,配有Intel(R) Xeon(R) CPU E5-2603v4,搭载NVIDIA Quadro P2000的工作站上运行。

3.1 数据集介绍

从BDD100K数据集中,筛选出5 400张图片数据,这些图片包含行人目标,同时包括了夜间、傍晚、清晨、雨天、雾天、多云等各种低照度复杂交通场景。包含行人目标22 157个,在行人识别数据CityPersons中,将小目标定义为了高度小于75像素的目标,按此标准自建数据集小目标占比70.19%,且存在大量遮挡状况。4 374张数据划入训练集,486张数据划入验证集,540张数据划入测试集。

3.2 网络训练参数

实验过程中,训练的轮数设置为350轮;动量(momentum)设置为0.9;权重衰减(decay)设置为0.000 5;批量大小(batch size)设为16;学习率(learning rate)最大设置为0.01,最小设置为0.000 1;优化器选用SGD(Stochastic Gradient Descent)。

3.3 结果与分析

目标检测网络有多种评价指标,本文采用以平均精度(Average Precision, AP)值作为评价指标,AP值是以召回率(R)、检测精度(P)构成的PR曲线下方的面积。

表1是进行的消融实验的结果,使用改进后的K-means聚类算法,模型的AP提高0.92%,同时使用了改进K-means聚类算法和Soft-NMS,模型的AP提高0.51%,最终改进后的网络模型YOLO- IPD比YOLOv4-Tiny的AP提高2.16%。

表1 消融实验对比

表2是在同样的实验条件下,验证不同的高斯系数值对模型精度的影响,可以看到在不同的高斯系数值下,模型AP值最大变化0.17%,最小变化0.01%。由表2可知本文算法在高斯系数取值0.35时在自制数据集上表现最优。

表2 高斯系数对算法性能的影响

为验证了YOLOv4-Tiny和YOLO-IPD的检测效果,选取了部分场景进行定性分析,在自制数据集上的检测结果可视化如图5所示。

图5是在傍晚十字街口的检测结果对比,可以看出YOLOv4-Tiny在低照度交通场景下,由于距离远、行人目标小、与周围的背景差异小且有相互遮挡因而没有检测到,而YOLO-IPD能够识别出远处的行人。同时可以看出由于引入了Soft- NMS,对于右侧的人群,YOLO-IPD也能很好的检测出来,并没有漏检。

(a) 原图

(b)YOLOv4-Tiny

(c)YOLO-IPD

图 6 是在不同照度下的检测结果,可以看出照度相对较好的条件下YOLOv4-Tiny和YOLO-IPD检测效果相近,但随着照度的降低,YOLOv4-Tiny出现了漏检问题,但YOLO-IPD依旧可以保持很好的检测效果。

(a) YOLOv4-Tiny不同照度下检测结果

图7以热力图的方式对比了YOLOv4-Tiny和YOLO-IPD对重点信息的关注程度。

(a) YOLOv4-Tiny热力图

(b) YOLO-IPD热力图

图7 不同低照度热力图对比

可以看到YOLO-IPD因为引入了CBAM注意力机制更加关注重点信息,对行人的检测效果更好。

4 结论

针对低照度交通场景下行人检测存在目标小、集群遮挡以及检测精度低的问题,基于轻量化的YOLOv4-Tiny网络模型,改进K-means聚类方法重新生成先验框以及引入Soft-NMS非极大值抑制,并在网络结构上添加一个检测头以提升对小目标的检测效果,引入注意力机制关注重点信息,而且自下而上的融合特征信息,提出了YOLO-IPD网络。YOLO-IPD网络在自制数据集上训练测试,与YOLOv4-Tiny相比AP提高了2.16%,在很低的照度环境下依旧有良好的检测性能。但在行人目标的定位上还有许多不足,离实际应用所需要的精度还有一定的距离。

[1] 杨伟,杜学峰,张勇,等.基于深度学习的车辆目标检测算法综述[J].汽车实用技术,2022,47(2):24-26.

[2] UIJLINGS J R R, DE SANDE K E A V, GEVERS T, et al.Selective Search for Object Recognition[J].Inte- rnational Journal of Computer Vision,2013(104):154- 171.

[3] GIRSHICK R.Fast R-CNN[C]//Proc of the IEEE Inte- rnational Conference on Computer Vision.Piscataway: IEEE,2015:1440-1448.

[4] GIRSHICK R,DONAHUE J,DARRELL T,et al.Rich Feature Hierarchies for Accurate Object Detection and Semantic Segmentation[C]//Proc of IEEE Conference on Computer Vision and Pattern Recognition.Pisca- taway:IEEE,2014:580-587.

[5] REN S,HE K,GIRSHICK R,et al.Faster R-CNN:Tow- ards Realtime Object Detection with Region Proposal Networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2016,39(6):1137-1149.

[6] REDMON J,FARHADI A.YOLOv3:An Incremental Improvement[J].ArXiv E-prints,2018:02767.

[7] BOCHKOVSKIY A,WANG C Y,LIAO H Y M. YOLOv4: Optimal Speed and Accuracy of Object Detection[J]. 2020:10934.

Research on Pedestrian Detection Algorithms in Low Illumination Traffic Scenes

LIU Kaitian, MO Shaoqing

( School of Automobile and Transportation, Tianjin University of Technology and Education, Tianjin 300222, China )

The quality of pedestrian images collected by autonomous vehicle mounted cameras in low illumination traffic scenes is poor due to insufficient lighting and complex environments, and subsequent detection algorithms are difficult to ensure sufficient detection accuracy. Therefore, in response to the problem of poor pedestrian detection performance in low illumination traffic scenes, this paper proposes a pedestrian detection algorithm based on improved YOLOv4-Tiny. First of all, the output of 8 times down sampling feature map is increased for the backbone network, and the deep semantic information and shallow semantic information are fused from bottom to top to enhance the detection ability for small targets. At the same time, the attention mechanism module is introduced before the fusion of different feature maps, making the network pay more attention to key feature information. Secondly, SPP-Net is used to improve the Receptive field and robustness of the network. Using K-means clustering algorithm to generate a new prior box for pedestrian targets, replacing traditional non maximum suppression methods with Soft-NMS method. The improved network model is labeled YOLO-IPD, and experiments have shown that the YOLO-IPD model proposed in the article performs well on a self built dataset.

Pedestrian detection; Low illumination; YOLOv4-Tiny; Attention mechanism; Deep learning

TP391

A

1671-7988(2023)22-43-06

10.16638/j.cnki.1671-7988.2023.022.009

刘凯天(1999-),男,硕士研究生,研究方向为目标检测,E-mail:1771623181@qq.com。

国家重点研发计划课题(2016YFB0101104);天津市重点研发计划科技支撑重点项目(18YFJLCG00130)。