基于迁移学习的卷积神经网络图像识别方法研究

2023-09-06张文韬张婷

张文韬 张婷

摘 要:卷积神经网络是图像分类领域效果卓越的深度学习算法,然而训练深度神经网络是一项繁琐且复杂的工作,不仅在结构设计上依赖开发人员丰富的经验,还容易产生过拟合现象。因此,该文提出一种基于模型迁移的图像识别方法,该方法能够在简化设计思路的同时极大地提升卷积神经网络的性能。此外还在三个小型图片集上进行了多次模型训练和对比分析。研究结果表明,经过迁移学习优化的卷积神经网络的测试集准确率均得到显著提升。

关键词:图像识别;深度学习;卷积神经网络;迁移学习;预训练模型

中图分类号:TP391.4 文献标识码:A 文章编号:2096-4706(2023)14-0057-04

Research on Convolutional Neural Network Image Recognition Method

Based on Transfer Learning

ZHANG Wentao, ZHANG Ting

(School of Mechanical and Automotive Engineering, Shanghai University of Engineering Science, Shanghai 201620, China)

Abstract: Convolutional neural network is an effective deep learning algorithm in the field of image classification. However, training the deep neural network is a tedious and complex work, not only relying on the rich experience of developers in structural design, but also prone to over fitting. Therefore, this paper proposes an image recognition method based on model migration, which can greatly improve the performance of convolutional neural network while simplifying the design idea. In addition, multiple model training and comparative analysis are conducted on three small image sets. The research results show that the test set accuracy of convolutional neural network optimized by Transfer learning is significantly improved.

Keywords: image recognition; Deep Learning; Convolutional Neural Network; Transfer Learning; Pre-trained Model

0 引 言

隨着智能手机与社交媒体的普及,大量的图片信息相继产生。人类能够在复杂的自然环境中识别物体并判断出物体的类别,然而如何将这种能力应用于计算机,令其灵活自如地对图片信息进行分类,提高信息获取的效率,并将这些分类识别方法应用于后续的目标检测、目标跟踪等领域,是一个值得深入研究和探讨的重要课题[1]。

传统的分类方法通常采用浅层的模型结构,例如高斯混合模型、K-均值聚类、支持向量机与逻辑回归模型等,这些结构最多含有一两个隐含层,难以刻画复杂的映射关系,通常不能在大规模的数据集上取得很高的识别准确率。随着人工智能的发展,卷积神经网络(Convolutional Neural Network, CNN)在图像识别领域取得重大突破。CNN结构具有权值共享与稀疏连接等特点,展现出良好的自适应性和强大的学习能力,能够在大幅度减少训练参数量的同时保证图像的识别准确率[2]。因而,CNN对于传统算法而言拥有极大的优势,在图像识别领域广受青睐。

训练一款有效的CNN是一项繁琐且复杂的工作。首先,在设计网络结构时,卷积层的数量和卷积核的大小没有明确的设计准则,往往需要多次尝试积累经验。其次,采用常规方法训练的网络中的可训练参数没有稳定的初始化方法,通常为一定范围内的随机初始化,容易陷入局部最优解。最后,在训练样本数不足的情况下,深度神经网络普遍容易产生过拟合的现象[3]。因此,本文针对上述问题提出一种相对简单且高效的图像识别方法,采用基于模型的迁移学习思路,引入先进的CNN作为预训练模型,使网络能够以较快的速度收敛并取得较高的识别准确率,同时还能有效缓解过拟合现象。

1 卷积神经网络模型

CNN经过多年的发展,在图像识别领域频频取得优异成绩,甚至能够取得优于人眼识别的准确率。接下来按照时间顺序介绍几种性能优异的CNN[4]。

1.1 AlexNet

AlexNet是一个包含5层卷积层和3层全连接层的8层CNN模型[5],其在多个方面进行了创新。例如采用线性整流单元作为激活函数,利用Dropout正则化缓解过拟合,采用重叠的最大池化避免模糊化效果,提出通过局部响应归一化增强泛化能力,使用数据增强扩大样本集规模等。这些方法极大地提升了模型性能,使其在ImageNet数据集上远超第二名的识别准确率,给当时的学术界和工业界带来了巨大冲击。

1.2 VGGNet

VGGNet是牛津大学计算机视觉组和Google合作研发的CNN[6],采用反复堆叠的小尺寸卷积核代替AlexNet中的大卷积核,在减少参数的同时将网络深度增加至16~19层,显著改善了当前的技术成果,证明网络深度的增加对于其性能的提升具有重要意义。VGGNet的结构规整,整个网络都使用同样大小的卷积核和池化核,尤其适于硬件加速,同时还具有良好的泛化能力,因此广泛应用于诸多图像识别任务中。

1.3 GoogLeNet

GoogLeNet是由Google研究院推出的CNN[7],采用模块化设计的思想,通过大量堆叠Inception模块,设计出稀疏连接的网络结构,并通过密集矩阵的高计算性能来提升计算资源的利用率。如图1所示,Inception模块是一种将多个卷积和池化操作组装在一起的网络模块,一方面可以让网络的深度和宽度高效率地扩充,另一方面也提升了网络对尺度的适应性和感知力。

1.4 ResNet

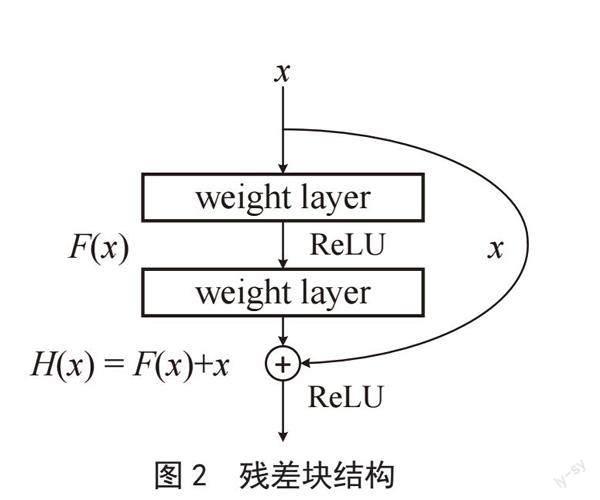

ResNet是2015年提出的CNN[8],通过残差结构成功训练出深层的神经网络。如图2所示,ResNet通过在卷积层的输入和输出之间添加一条跳连线,将前边的特征信息直接输送到后面,有效缓解了因梯度消失或梯度爆炸带来的模型退化,网络得以在输入特征的基础上在堆积层学习到新的特征,从而获得性能优越且能稳定训练的深层网络模型。

1.5 DenseNet

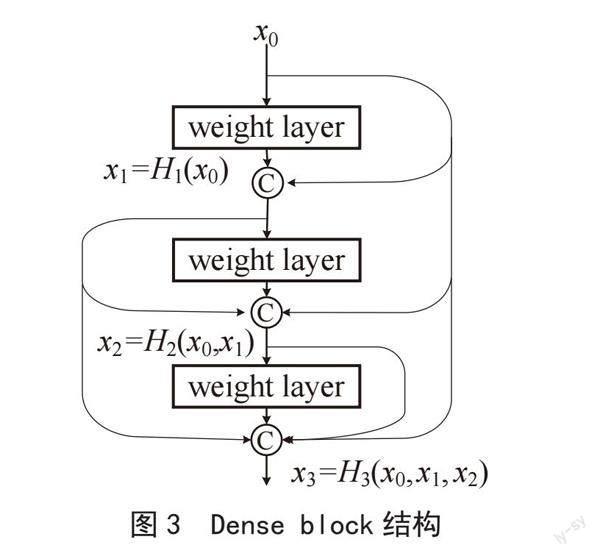

DenseNet是2017年提出的[9],通过全新的密集连接机制,以前馈的方式将每一层与前面所有层的输出特征进行通道合并实现特征重用,不但缓解了梯度弥散问题,而且还能够在参数与计算量很少的情况下实现更优的性能,如图3所示。DenseNet可以使用少量的卷积核生成大量的特征,不需要重新学习多余的特征图,每个层都能访问到网络的“集体知识”,同时紧凑的内部结构减少了特征冗余,随着参数数量的增加也不会出现性能下降或过度拟合的迹象,因而成为各种计算机视觉任务中良好的特征提取器。

1.6 MobileNet

MobileNet是Google为移动端和嵌入式设备而设计的一款轻量化CNN[10]。MobileNet使用深度可分離卷积来构建轻量化网络,将标准卷积分解成深度卷积和逐点卷积,二者结合达到的效果与一个标准卷积相近,但计算量却远远少于标准卷积。MobileNet还引入了宽度因子和分辨率因子两个全局超参数,使用户依据约束条件在内存大小和准确率之间取舍,构建出满足嵌入式设备小内存、低延迟等要求的模型。

2 迁移学习

迁移学习是一种重要的机器学习方法,本着将预训练模型的参数迁移到新的模型来帮助新模型训练的思路,利用数据、任务或模型之间的相似性,将在旧领域学习过的模型应用于新的领域。迁移学习引入预训练模型的参数并将其作为学习的起点,在此基础上对网络高层的参数进行微调。这样,新模型能够运用预训练模型学习到的知识更好地实现相应功能。迁移学习涉及两个基本的领域——源域和目标域,当目标领域数据量远远小于源领域数据量时,迁移学习能够借助源领域的知识有效帮助模型去学习目标领域的知识,本文采用的基于迁移学习的CNN图像识别过程如图4所示。

CNN适合于从图像中学习层次表示,低层网络通常能提取图像中常见的低级特征(例如边缘和曲线),其所包含的知识适用于绝大多数的图像识别任务,而高层网络更倾向于学习抽象化的高级特征,往往仅适用于某些特定的任务,因而高层的网络权重在迁移后需要进行微调以适应目标领域任务的需求。CNN包含许多在大型图像数据集ImageNet识别任务中取得高精度的模型,这些模型在开发的时候已经消耗了大量的时间和计算资源,包含有丰富的图像识别知识,可以作为预训练模型完成其他图像识别任务,以大幅减少训练所需的数据量并加快网络的收敛过程[11]。

3 图像识别实战

本节以MNIST、Fashion-MNIST和CIFAR-10三个图像数据集为例,选择VGG16、ResNet50、InceptionV3、DenseNet121、Xception和MobileNetV1六种CNN作为研究对象,将是否进行迁移学习作为两种不同的训练方式开展对照实验,在深度学习框架TensorFlow的高级API Keras上进行训练并测试其性能,相关设置如表1所示[12]。

MNIST数据集由0~9共十种手写数字图片组成,这些图片均由真人书写,其图像数据识别主要依赖于模型对黑白轮廓的特征提取能力,识别难度最低。表2展示了六种CNN在MNIST数据集上取得的测试集准确率,可以看出在不使用迁移学习的情况下,不同CNN的收敛速度存在差异,例如Xception的准确率达到了99.09%,而MobileNet的准确率仅有95.60%,可以认为MobileNet并未完全收敛。而应用迁移学习后,所有CNN均实现99%以上的准确率,这说明所有CNN都达到收敛到最优解的状态。由此可知迁移学习具有加快CNN收敛速度的效果。

Fashion-MNIST数据集图像共包含70 000张十种不同类别的时尚穿戴品图像,分别是T恤、牛仔裤、套衫、裙子、外套、凉鞋、衬衫、运动鞋、包、短靴,不仅考验模型对轮廓的提取能力,更考验模型对真实物品的细节掌控能力。表3展示了六种CNN在Fashion-MNIST数据集上所取得的测试集准确率,可以看出迁移学习对网络性能提升的作用更加明显,全部取得高于91%的测试集准确率,同时不同CNN之间的性能差异也体现出来。例如在不使用迁移学习的情况下,InceptionV3、DenseNet121和Xception有很高的测试准确率,原因可能在于GoogLeNet系列的CNN对于不同尺寸的感知能力更强。而DenseNet121、Xception和MobileNet产生了过拟合现象,在应用迁移学习方法之后,训练集与测试集的准确率差距缩小,说明过拟合现象得到一定程度的缓解。

CIFAR-10数据集是一个用于识别普通物体的小型数据集,包含10个类别3通道的RGB彩色图片:飞机、汽车、鸟类、猫、鹿、狗、蛙類、马、船和卡车,相较于前面的数据集包含更加丰富的细节,同时物体的角度和背景也不尽相同,场景更加接近于现实世界,导致识别难度大幅提升。表4展示了六种CNN在CIFAR-10数据集上所取得的测试集准确率。由于数据样本的复杂程度大幅提升,六种网络取得的准确率都远远小于前两个数据集。无迁移学习条件下大部分CNN甚至难以在训练集上取得高精度,只有DenseNet121和Xception训练集的准确率相对较高,然而却因为过拟合而无法在测试集上取得良好的效果。而在迁移学习条件下,所有训练集的准确率都上升到95%以上,而测试集准确率的提升幅度则在10%~38%之间,原因可能在于CIFAR-10更接近于ImageNet数据集,预训练模型能够有效避免CNN陷于局部最优解,缓解过拟合现象,最终以更快的收敛速度取得更高的识别准确率。

4 结 论

本文采用基于模型的迁移学习方法对CNN的性能进行优化,验证了迁移学习对CNN性能的正向影响包括提升准确率、加快收敛速度、缓解过拟合,以及避免局部最优解等方面。本文选用六种CNN作为研究对象,通过在三个小型图像数据集上进行模型训练和对比,展现了这些方法在处理不同图像识别任务时的性能差异性。本文采用的方法能够在较短的时间内获得高准确率,一定程度上简化了深度学习模型的设计思路,具有更高的实用性和可操作性。然而,数据增强和正则化等常用的深度学习优化策略尚未在文中采用,同时也未涉及CNN之外的深度学习模型,因此可以说神经网络的图像识别性能优化还可以有更多的研究思路以及更大的提升空间。

参考文献:

[1] 董潇.卷积神经网络的图像分类优化算法研究 [D].淮南:安徽理工大学,2020.

[2] 李炳臻,刘克,顾佼佼,等.卷积神经网络研究综述 [J].计算机时代,2021,346(4):8-12+17.

[3] 丁文博,许玥.预训练模型的跨领域跨任务迁移学习 [J].科技资讯,2020,18(2):107-110.

[4] 张珂,冯晓晗,郭玉荣,等.图像分类的深度卷积神经网络模型综述 [J].中国图象图形学报,2021,26(10):2305-2325.

[5] KRIZHEVSKY A,SUTSKEVER I,HINTON G E. ImageNet Classification with Deep Convolutional Neural Networks [J].Communications of the Acm,2017,60(6):84-90.

[6] SIMONYAN K,ZISSERMAN A. Very Deep Convolutional Networks for Large-Scale Image Recognition [J/OL]. arXiv:1409.1556.[2022-11-05]. https://ui.adsabs.harvard.edu/abs/2014arXiv1409.1556S/abstract.

[7] SZEGEDY C,LIU W,JIA Y Q,et al. Going Deeper with Convolutions [J/OL].arXiv:1409.4842 [cs.CV].[2022-11- 05].https://arxiv.org/abs/1409.4842.

[8] HE K M,ZHANG X R,REN S Q,et al. Deep Residual Learning for Image Recognition [C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Las Vegas:IEEE,2016:770-778.

[9] HUANG G,LIU Z,MAATEN L V D. Densely Connected Convolutional Networks [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu:IEEE,2017:2261-2269.

[10] HOWARD A G,ZHU M L,CHEN B,et al. MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications [J/OL].arXiv:1704.04861 [cs.CV].[2022-11- 09].https://arxiv.org/abs/1704.04861.

[11] 赵卫东,施实伟,周婵. 基于ImageNet 预训练卷积神经网络的图像风格迁移 [J]. 成都大学学报:自然科学版, 2021,40(4):367-373.

[12] 龙良曲.TensorFlow 深度学习 [M]. 北京:清华大学出版社,2020.

作者简介:张文韬(1997—),男,汉族,河南平顶山人,硕士研究生在读,研究方向:深度学习与故障诊断。