基于卷积神经网络的遥感图像目标检测识别*

2023-08-30张路青

张路青 郭 莹

(1.海军驻武汉地区第七军事代表室 武汉 430223)(2.武汉数字工程研究所 武汉 430205)

1 引言

随着遥感技术的迅速发展,各种不同成像方式、不同空间分辨率的遥感平台得以涌现,产生了大量遥感图像。高分辨率遥感图像作为信息的有效载体,它不仅具备全天时、全天候、实时传输的能力,同时扩宽了人的视野范围,提高了目标观察精度。舰船作为海上商业贸易的重要运输工具以及战时易遭受攻击的重点军事目标,为确保海上监测、救援等非军事活动和军事任务的顺利展开,使用航天遥感卫星对海上舰船动向进行监视,并寻求技术手段对遥感卫星获取的图像数据进行舰船目标的检测与识别,关乎国家安全和社会经济发展[1]。开展基于遥感图像的舰船目标检测和识别无论在民用还是军事领域都有着广阔的应用前景。在民用方面,可以监控特定港口或海域的海运交通,辅助遇难船只救援,配合安全管理部门监测和打击非法捕鱼、非法倾倒油污、走私和海盗等违法行为;在军事领域,可以监视敌方重点港口和海域的舰船部署与动态,分析敌方的海上作战实力,评估战时海上打击效果,形成海上作战情报等[2]。

近年来,随着GPU 计算性能的大幅度提升和各大数据集的公开,基于深度学习的目标检测与识别算法已经逐步取代了传统算法,成为当前主流的目标检测与识别算法。目前发展较为成熟的深度学习目标检测与识别算法分为两类,分别为以R-CNN[3]、Fast R-CNN[4]、Faster R-CNN[5]为基础的两段式和以YOLO[6~8]、SSD[9]为代表的一段式目标检测与识别算法,其他算法大多以上述算法作为基础进行优化和改进。其中两段式的检测算法与传统的目标检测与识别算法类似,将目标检测与识别作为分类问题来处理。首先根据一系列特征从输入图像提取出过量的候选区域,然后计算每个候选区域的特征,最后对各个候选区域进行分类。而一段式的目标检测与识别算法则直接将目标的定位转化为回归问题处理。由于两类算法在设计上的不同,其性能和精度产生了差异,一段式的算法在计算速度上有着绝对的优势,而两段式的算法则具有较高的定位精度和识别率。

从上述可以看出,一段式目标检测与识别算法在处理速率上是优于两段式目标检测与识别算法,但在目标检测与识别精度是不及两段式目标检测与识别算法的。而在军事行动中,舰船目标的检测与识别精度是核心问题,只有保证了识别信息的准确性,才能更好地掌握海情态势,辅助指挥员决策。本文以Faster R-CNN 模型为基础,提出一种基于改进卷积神经网络的遥感图像舰船目标检测与识别方法。

2 基于改进卷积神经网络的舰船目标检测与识别

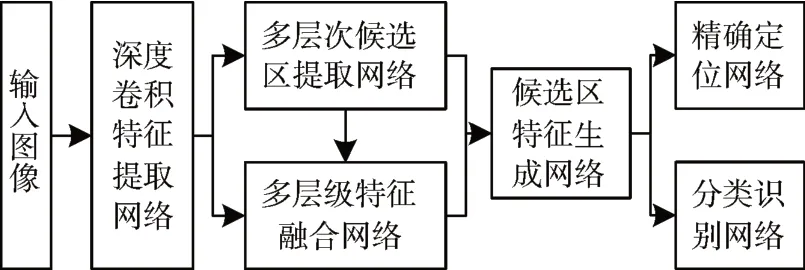

海面舰船目标在可见光图像成像中主要表现为大尺度跨度和多方向分布的特征,本文以Faster R-CNN 网络模型为基础,结合海面舰船目标的成像特征,构建了一种适用于舰船目标检测与识别的卷积神经网络模型,如图1 所示,该模型由深度卷积特征提取网络、多层次候选区提取网络、多层级特征融合网络、候选区特征生成网络、目标精确定位网络和目标分类识别网络六个模块组成。

图1 舰船目标检测与识别网络框图

2.1 深度卷积特征提取网络

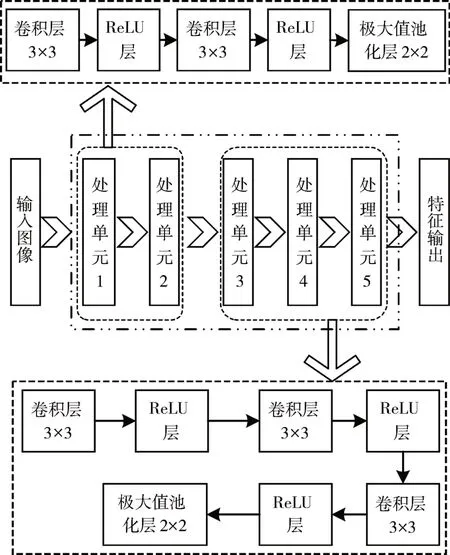

本文构建的深度卷积神经网络通过大规模的数据拟合复杂模型,学习出舰船目标的深层语义特征,更具体的表征待检测物体。该网络模块由5 个处理单元构成,如图2 所示。处理单元分为两类,前两个基本处理单元分为一类,分别对输入图像进行两次卷积和ReLU 操作之后连接了极大值池化层;后三个基本处理单元分为一类,分别对输入图像进行经过三次卷积和ReLU操作之后连接了极大值池化层。

图2 深度卷积特征提取网络

其中,所有的卷积层都使用尺寸为3×3 的卷积核;所有的极大值池化层都使用2×2 池化核来对卷积特征进行缩放。

2.2 多层次候选区域提取网络

当前目标识别模型在多尺度问题的处理上较为薄弱,对小尺度目标和大尺度目标的检测率低。深度卷积网络多尺度候选区域生成技术从获选区域产生步骤入手,使用多尺度候选区域生成网络在不同缩放级别的卷积特征图上生成尺度多样化的初始窗口。

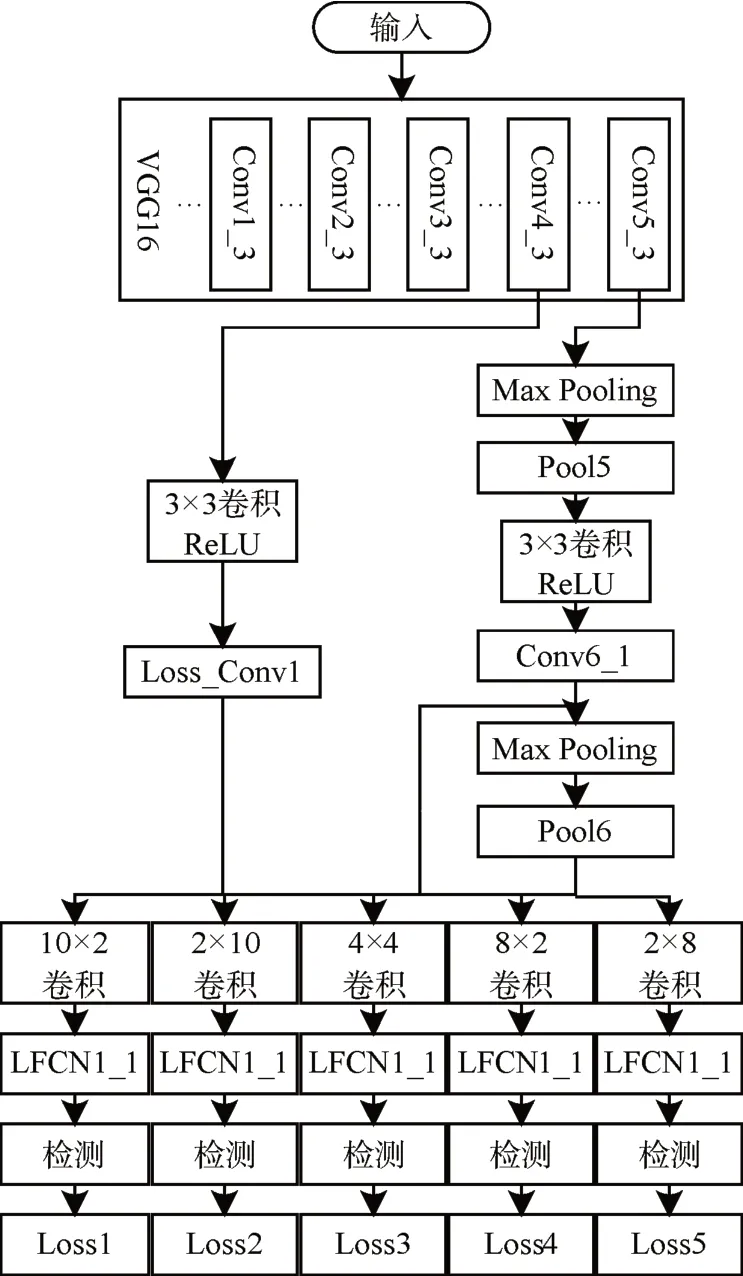

为了适应图像中舰船目标任意方向的特点,用以生成不同角度,不同尺度,不同比例的候选区域。本文结合Ma等提出的倾斜候选区域生成网络(Rotation Region Proposal Networks)[11]的思想,建立了适于舰船目标检测与识别的多层次候选区域提取网络,如图3所示。

图3 多层次候选区域提取网络

多层次候选区域提取网络中分别在4 个不同层级的卷积特征图上进行了候选框检测,这些特征图在进行候选区域生成前分别进行了3 次、4 次、5次和6 次2×2 的最大值池化操作,大小分别为原输入图像的1/8、1/16、1/32、1/64。在多个不同大小的卷积特征图上进行相同窗口大小的滑窗,将获得与原图中不同尺度物体相对应的候选框,有效地改善图像中过大或过小尺度目标的漏检问题。

针对遥感图像舰船目标水面姿态及种类的多样性,在多层次候选区域提取网络中,本文使用了10×2、2×10、4×4、8×2、2×8 五个不同大小的窗口在卷积特征图上生成初始候选框,通过对五个大小的卷积核的训练,连接Loss_Conv1、Conv5_3、Conv6_1、Pool6 四个卷积特征的卷积层将根据每个窗口的卷积特征回归出候选框的4 个主要参数,在添加方向控制参数以控制候选框的方向。在训练阶段,回归出的候选框参数将与人工标注给出的目标框进行比较,得出每个候选框的误差,将误差反向传播给前面的每一层,对每一层的参数进行调整优化。

2.3 多层级特征融合网络

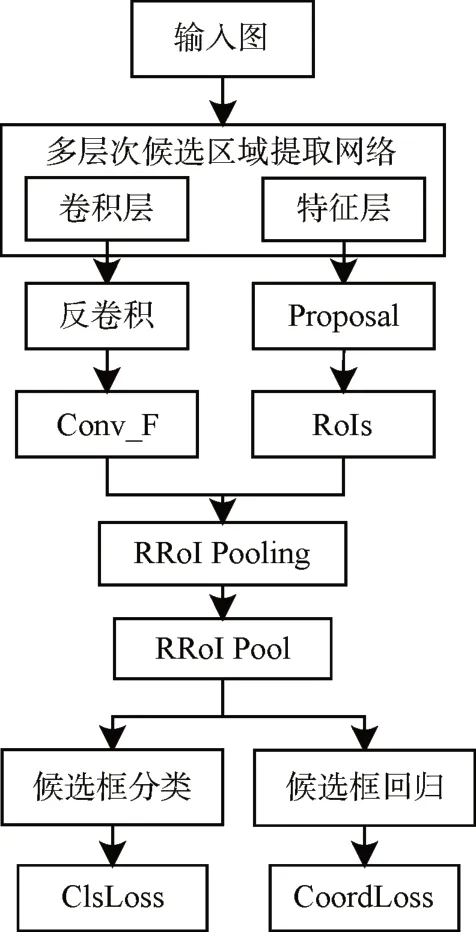

特征的表达能力是决定分类器性能的关键因素之一,更强的表达能力能够更具体地描述待检测目标的特性,减少分类器的搜索空间,从而达到提高分类器分类精度的效果。深度卷积网络多层级特征融合技术通过对不同深度的卷积特征进行特征外推和融合,将深度卷积网络学习到的低级、高级特征进行组合,通过学习的手段获得更适合舰船目标表达的融合特征。

图像卷积特征分为浅层特征和深层特征,浅层卷积特征主要表示目标的表面纹理、形状轮廓特征;而深层卷积特征则表示了目标的语义特征。在RRoI Pooling[10]之间,将不同深度的多层卷积特征进行融合,然后在融合特征上进行候选区域特征抽取,得到的候选区域特征将具有更强的表达能力。

本文构建的多层级特征融合网络如图4 所示,多层级特征融合网络主要对分类、回归、反卷积层等全连接层的参数值进行调整,并在一定程度上微调特征提取网络的卷积核权值,优化特征提取和候选区域生成效果。

图4 多层级特征融合网络

loss=αClsLoss+βCoordLoss

其中,类别损失是用softmax 分类层计算得出,边界误差则是通过下式计算的出:

式中(dx,dy,dw,dh)为人工标注舰船目标边界框的相关参数。

2.4 候选区域特征生成网络

候选区域特征生成网络将多层次候选区域提取网络和多层级特征融合网络的输出作为输入,生成每个候选区域对应的卷积特征,并将特征矢量化,为定位和识别网络提供标准化输入。

2.5 精确定位和分类识别网络

为了方便整个模型实现端到端的运算,在本模型中使用了全连接层来完成边界框回归与候选区域分类任务。全连接层以全连接的方式连接相邻的两层神经元,认为下一层的输入与上一层所有的输入都相关。全连接层的每个输出结点的输出值是所有输入结点输入值的加权和,其计算公式如下所示:

其中,N为输入结点的个数,xi为第i个输入结点的输入值,ωij为连接第j个输出结点对第i个输入结点的网络的权值。

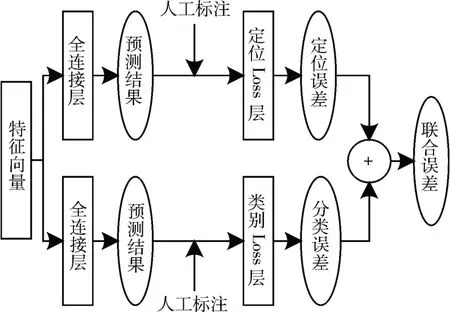

在训练阶段,其网络结构图5 所示。在训练过程中,使用多任务联合损失函数训练整个网络模型,通过联合误差的反向传播来调整网络内损失层、全连接层以及卷积层的参数。

图5 精确定位与分类识别网络结构图

由于舰船所处位置包含靠岸、近岸、离岸,其分布包含单只、并列及复杂队形,这些情况使得舰船目标本身可能存在被遮挡问题。当舰船目标部分区域被遮挡时,其识别特征与未被遮挡的舰船目标的识别特征具有一定的差异性。通过对舰船目标的实际航行与锚泊状态分析得出,根据舰船目标被遮挡的部分进行分类,可以分为舰艏被遮挡的船只、舰艉被遮挡的船只、左舷被遮挡的船只及右舷被遮挡的船只。为了提高这四类部分遮挡船只的检测率,本文将候选框分为了四个部分,如图6 所示。

图6 舰船目标子区域划分

根据上述的子区域划分,对于任意一个候选框box,本文所使用的多子区域联合损失函数定义如下:

loss=lbox+λ(lh,le,ll,lr)

其中,lbox为整个候选框的损失,lh为舰艏损失,le为舰艉损失,ll为左舷损失,lr为右舷损失,λ为加权系数。

3 试验与结果分析

实验数据部分来自于公开数据部分来自于商业卫星图像及Google Earth。

3.1 评估参数

在进行实验时由很多评估参数,IoU(intersection over union)用以衡量两个区域覆盖程度,即:

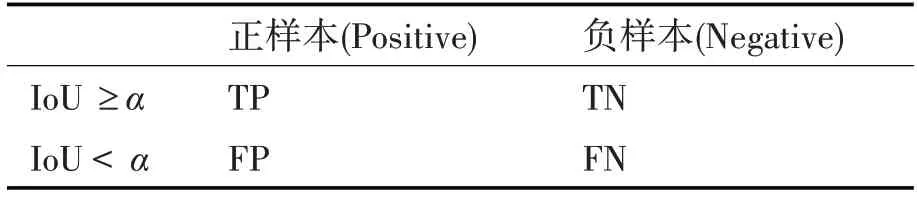

在目标检测中,通常有一个阈值来判断预测是否正确。当边界框的预测分数大于阈值α时则为正样本,反之为负样本。当IoU 比阈值大时,检测框为TP,如果小于阈值时为FP。FN 指的是模型预测框中没有目标,但实际上包含目标。混淆矩阵如表1所示。

表1 混淆矩阵

采用TPR、FNR、Precision多方位评估指标对本文测试结果进行评估,计算公式如下。

其中,TPR 为真正率、FNR 为假负率、Precision 为精准率。

3.2 实验环境

实验设置如表2所示。

表2 实验环境配置和参数设置

3.3 实验结果

针对实验数据,在已有的测试集中随机抽取800 张图片作为测试图片,根据得到的测试结果,测试该800张图片共耗时156800ms,平均的检测时间为196ms,采用TPR、FNR、Precision 评估结果如表3所示。

表3 舰船目标检测与识别结果分析

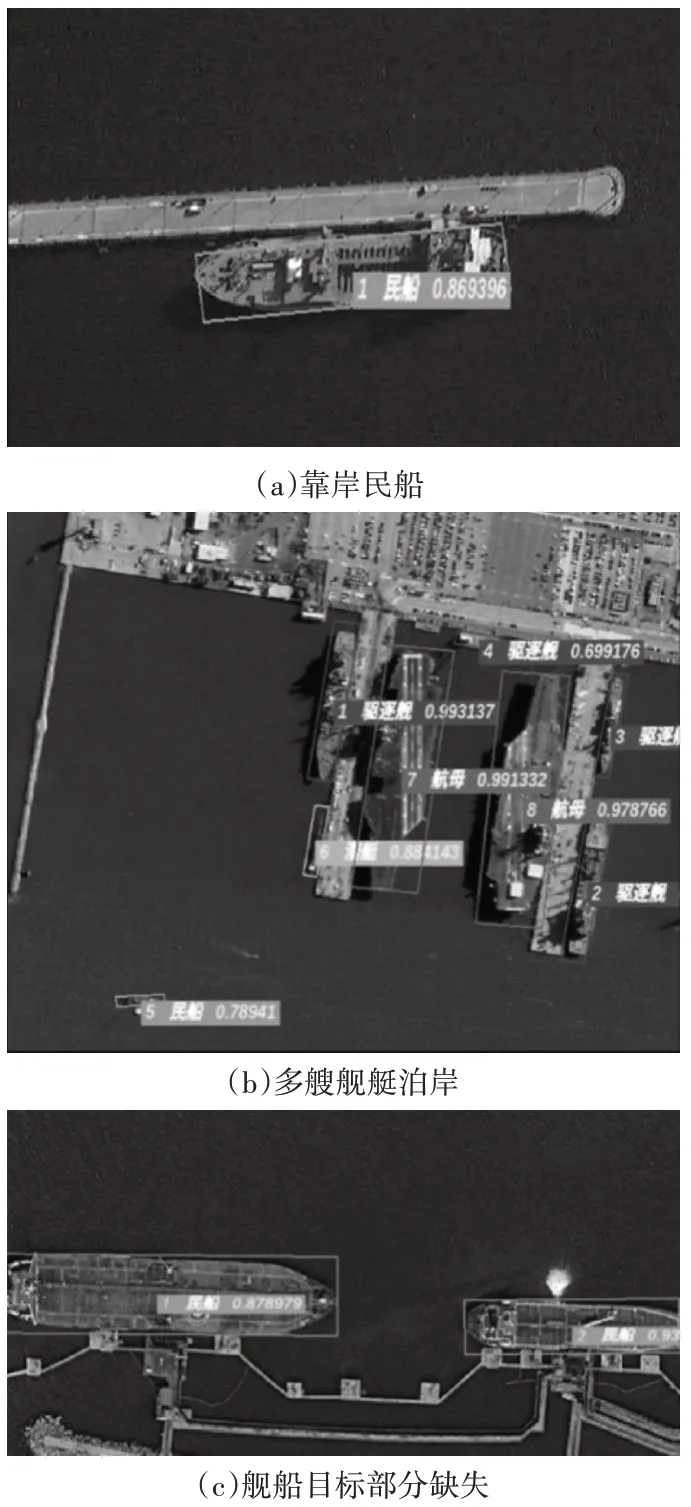

为了对模型进行充分测试,本文针对不同的海面场景进行检测识别测试,图7 给出了三种不同的海面场景下舰船目标检测识别结果。

图7 不同海面情况下舰船目标检测结果

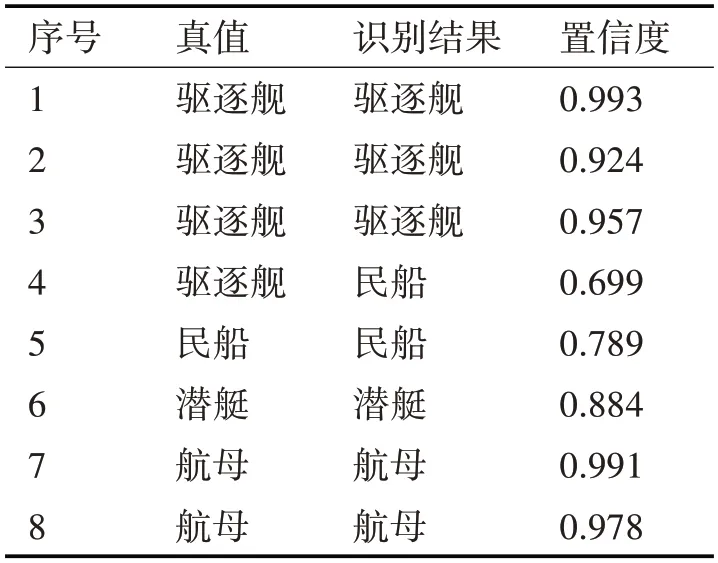

图7(a)为一艘靠岸民船,检测结果与实际结果一致,识别为民船的置信度为0.8694。图7(b)中为多艘舰艇泊岸检测,检测结果如表4所示。

表4 图7(b)舰船目标识别结果

结合表4 和图7(b),从检测结果可以看出,图像中所有舰船目标均正确检测出来,但是将目标4错误地识别为驱逐舰。图7(c)为两艘船泊岸检测,从检测结果看,虽然图片中的舰船目标部分缺失,但仍然能准确定位并识别出目标,识别结果与实际目标类型一致。

4 结语

针对遥感图像中目标方向、目标大小、拍摄角度及场景的多样性导致遥感图像舰船目标检测与识别精度不高的问题,本文提出了一种基于卷积神经网络的舰船目标检测与识别方法,该方法提高了卷积神经网络对旋转变换的鲁棒性,通过多层次候选区域提取技术减少了目标的漏检情况,采用多层级特征融合提取表达能力更强的融合特征,使得在舰船目标的检测与识别中展现出较好的效果。从实验示例可以看出,虽然在不同情况下本文方法均能正确的检测出图像中的舰船目标,但是在目标识别时还是存在错误的分类。下阶段的工作需要继续对舰船目标的识别能力进行优化,使得模型的整体性能进一步提升。