基于注意卷积模块的遥感图像场景分类应用

2023-04-29王李祺高翔程蓉谭秀辉白艳萍

王李祺 高翔 程蓉 谭秀辉 白艳萍

摘要:遥感场景分类任务中,面对遥感场景中类间相似性,类内多样性的挑战,直接应用卷积神经网络是局限的.现有的注意力机制在嵌入网络末端位置时,增强卷积神经网络表达场景图像的能力相较于嵌入其他位置时较弱.因此,提出基于注意卷积模块(ACM)的MoblieNetv2模型框架,增强了注意力机制在卷积神经网络末端表达场景图像的能力.首先通过主干网络提取丰富的深度语义特征图,然后将ACM嵌入主干网络的末端,以此关注更加显著的特征区域.嵌入的ACM模块可以在不显著增加网络计算量的同时,有效地提高网络分类性能.该模块在嵌入CNN末端位置时相较于现有的注意力机制模块有着较佳的性能.在RSSCN7和RSOD两个公开的遥感场景数据集上,平均分类精度相较于MoblieNetv2分别提升2.42%和1.64%.实验结果表明ACM相比于已有的注意力机制在网络末端具有泛化性和更佳的分类精度.

关键词:遥感图像; 图像分类; 卷积神经网络; 注意力机制; MoblieNetv2

中图分类号:TP183文献标志码: A

Classification application of remote sensing image scene based on

the attention convolution module

WANG Li-qi GAO Xiang CHENG Rong TAN Xiu-hui BAI Yan-ping(1.School of Mathematics, North University of China, Taiyuan 030051, China; 2.School of Information and Communication Engineering, North University of China, Taiyuan 030051, China)

Abstract:In the remote sensing scene classification task,facing the challenges of inter-class similarity and intra-class diversity in remote sensing scenes,the direct application of convolutional neural networks is limited.When the existing attention mechanism is embedded in the end position of the network,the ability of the convolutional neural network to express the scene image is weaker than when it is embedded in other positions.Therefore,a MoblieNetv2 model framework based on Attention Convolution Module (ACM) is proposed,which enhances the ability of the attention mechanism to express scene images at the end of the convolutional neural network.First,rich deep semantic feature maps are extracted through the backbone network,and then ACM is embedded at the end of the backbone network to focus on more salient feature regions.The embedded ACM module can effectively improve the network classification performance without significantly increasing the network computation.Compared with the existing attention mechanism module,this module has better performance when embedding the end position of CNN.On the two public remote sensing scene datasets,RSSCN7 and RSOD,the average classification accuracy is 2.42% and 1.64% higher than that of MoblieNetv2,respectively.The experimental results show that ACM has generalization and better classification accuracy at the end of the network than the existing attention mechanism.

Key words:remote sensing images; image classification; convolutional neural networks; attention mechanisms; MoblieNetv2

0引言

隨着遥感技术的快速发展,大型航天器相机已经具备了捕捉高分辨率遥感图像的能力,提供了丰富的地物信息[1].因此,遥感技术逐渐被广泛应用于自然灾害检测、地理图像检索、城市规划等领域[2].而遥感图像场景分类作为遥感技术的核心之一,成为了当前遥感领域的热点问题.

目前,从特征研究方法上看,遥感图像场景分类主要分为三类:基于浅层特征的遥感图像场景分类、基于中层特征的遥感图像场景分类和基于深度学习的遥感图像场景分类.

基于浅层特征的遥感图像场景分类:在遥感场景分类早期,由于遥感图像的分辨率和大小都很低,大多数方法都依赖于人工设计的特定特征提取器[3],如尺度不变特征变换(SIFT)[4]、纹理描述符(TD)[5]和方向梯度直方图(HOG)[6]等.然而传统手工特征过于依赖人工设计,且提取特征单一,无法应对当前遥感场景图像的高分辨率和复杂性的特点.

基于中层特征的遥感图像场景分类:为克服上述传统手工特征的缺点,众多学者通过特征编码的方式对局部手工特征进行编码,如视觉词袋模型(BoVW)[7]等,以及无监督学习的概率潜在语义分析(pLSA)[8]和隐含狄利克雷分布(LDA)[9]等.然而上述方法都使用各种手工的局部图像描述符来表示场景信息,依旧缺乏良好的泛化和分类性能.

基于深度学习的遥感图像场景分类:近年来,随着卷积神经网络(CNN)的快速发展,遥感场景分类的性能显著提升.章晨等[10]通过对ResNet网络的残差结构增加跨纬度特征整合,提升了残差网络对于遥感场景分类的性能.C.Shi等[11]提出了一种基于分支特征融合(LCNN-BFF)的轻量级CNN分类方法,用于遥感场景分类.相较于单线性卷积结构,通过双线性特征提取结构,提高场景分类性能.Chen.Wang等[12]提出了多分辨率块特征(MRBF)用于遥感场景分类,由双交叉模式(CDCP)和费舍尔向量(FV)构建了一种统一有效的场景表示.然而由于遥感图像面临类内多样性、类间相似性的巨大挑战,直接应用CNN提取场景图像特征是具有局限性的.

为解决上述问题,学者试图通过引入注意力机制等方法,实现特征增强[13].注意力机制本质来源于人类视觉机制,目前在图像分类、图像分割等视觉领域中表现出极佳的性能.李彦甫等[14]融合自注意力机制和残差卷积网络的遥感图像分类方法,在最后3个瓶颈层中嵌入多头自注意力模块,挖掘图像的全局结构信息.徐从安等[15]提出一种基于双重注意力机制的强鉴别性特征表示方法,通过通道和空间两个注意模块,增加图像显著性区域.J.Hu等[16]提出的SE模块对不同的特征通道进行重新加权,提升网络表示图像特征的性能.J.M.Haut等[17]设计了一种将视觉注意力机制集成到残差网络的方案.上述研究表明,引入注意力机制有效的增强了CNN提取特征的性能.

然而,目前对于注意力机制嵌入位置的探讨尚未有系统性的研究.众多学者已经验证了注意力机制与CNN结合可以取得优越的效果,但现有的注意力机制在嵌入CNN末端时,其具有的增强网络提取特征的能力相较于嵌入网络初始层和中间层出现显著退化.H.Wan等[3]对注意力机制嵌入位置进行比较,但没有关注不同嵌入位置的注意力机制优化问题.目前,适用于卷积神经网络不同位置的注意力机制模块还有待研究.

基于上述内容,本文将构建的注意卷积模块(ACM)嵌入到MoblieNetv2[18]中,提出基于ACM的MoblieNetv2模型,以提高遥感场景分类性能.主要贡献如下:(1)提出ACM模块和CNN模型框架,ACM在嵌入CNN模型末端时相较于现有的注意力机制取得了更加的分类效果,该模块有效的适配网络末端的结构;(2)在模型中引入了Hard-Sigmoid和Hard-Swish[19]两个激活函数,两个激活函数相较于改进前的函数在计算量上得到大大缩减,使得本文提出的模型框架具有轻量和高效的特性.

1基于ACM的MobileNetv2模型框架

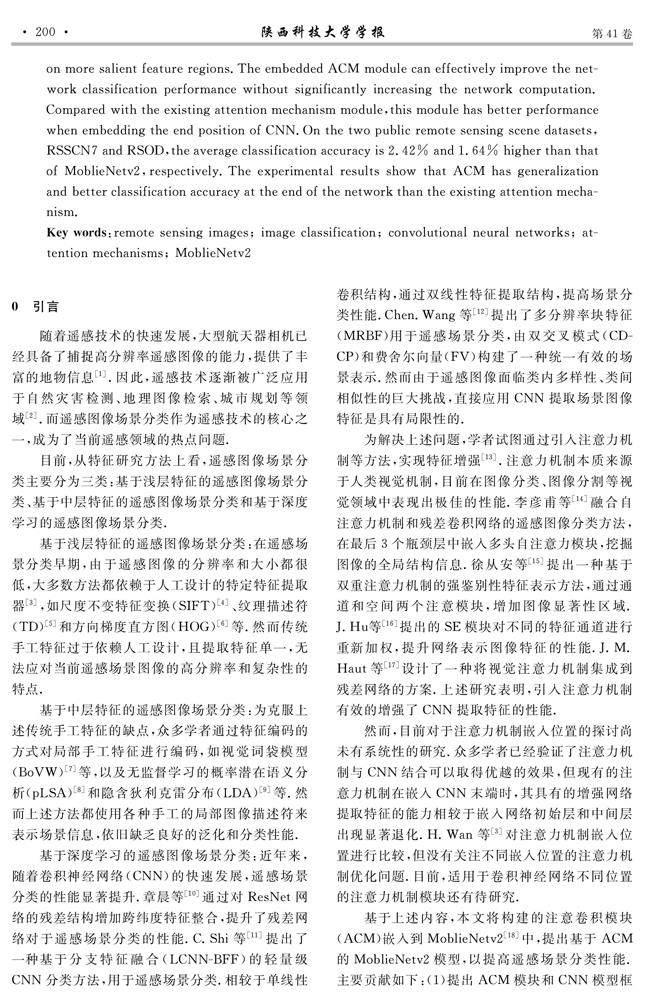

1.1整体模型框架

为了增强卷积神经网络提取场景图像的显著特征,本文在MobileNetv2作为主干网络的框架中嵌入ACM.整体框架如图1 所示.

首先进行主干网络的特征提取阶段,MobileNetV2是一个轻量高效的网络结构,可以在整体框架获取足够特征图的同时,保证框架的轻量性;其次将提取到的特征图输入注意卷积模块中,关注特征图中更显著的特征区域,以此获取更加精确的场景图像表示特征;最后通过dropout层抑制网络过拟合后,利用Adam优化器进行场景分类.

1.2主干网络

2018年,MoblieNetv2在 MoblieNetv1的基础上被改进提出.作为一种轻量级卷积神经网络的衍生产物,MoblieNetv2同样具有体积小、参数少和计算少的三大优势.MoblieNetv2通过引入线性瓶颈和反向残差两个结构,进一步压缩了参数和计算,提高了性能.主干网络结构如表1所示.

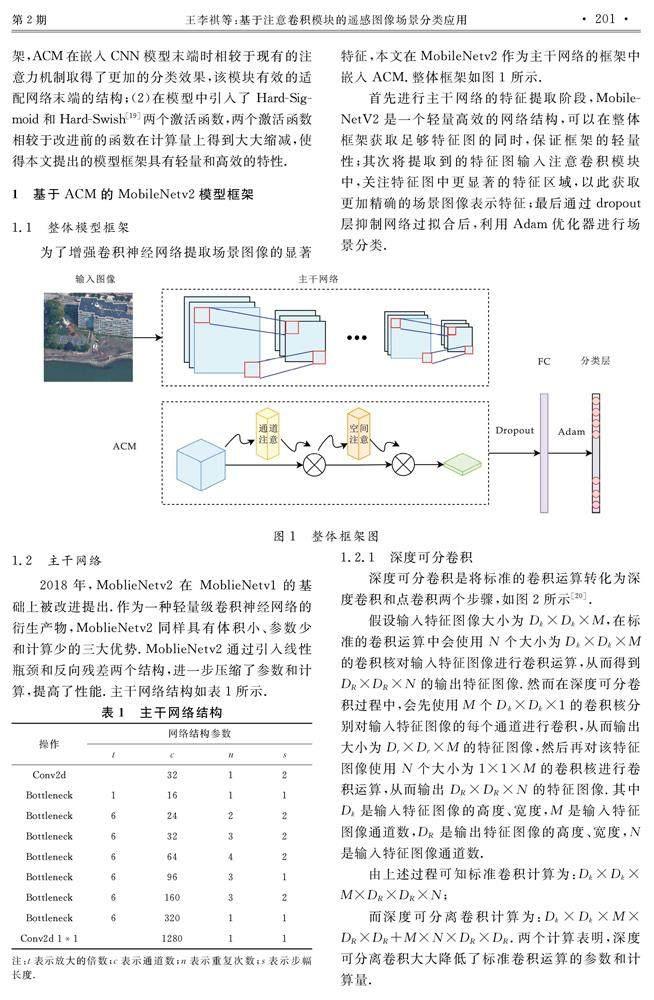

1.2.1深度可分卷积

深度可分卷积是将标准的卷积运算转化为深度卷积和点卷积两个步骤,如图2所示[20].

1.2.2线性瓶颈

为了解决卷积神经网络使用ReLu等激活函数引起的信息丢失问题,在MoblieNetv2中引入了线性瓶颈结构(如图3所示).ReLu激活函数可以将负输入转化为0进行输出,而对正输入进行一个线性变换操作.因此ReLu激活函数,增加了网络的稀疏性,降低了参数之间的相互依赖性,然而这个过程造成了特征通道出现较大的信息损失.线性瓶颈的本质就是在点卷积层和批处理规范化层之后,将特征映射直接传递到下一个卷积层,而无需使用非线性激活函数[21].

1.2.3反向残差

MoblieNetv2中的反向殘差结构与ResNet中的残差结构截然相反,完整的反向残差结构先通过点卷积操作,将特征通道的数量扩展到初始通道数的n倍(MoblieNetv2中n的值是6),然后再进行深度卷积和点卷积操作.其中第二次点卷积操作,起到特征缩放的作用,将特征通道的数量缩放到初始通道数,然后将得到的特征图添加到初始特征图中.在深度可分卷积结构前加入点卷积扩展通道维数,在高维空间中可以有效的提升深度卷积提取特征的能力.主干网络结构中,当步幅为1时使用反向残差结构(图4(a)),步幅为2 时使用线性结构(图4(b))(即缺少了一个快捷链接).两个结构如图4 所示.

1.3注意卷积模块

图5所示的ACM是一种新型的轻量级注意卷积模块,该模块相较于传统的卷积注意力机制在嵌入网络末端位置时可以取得更好的效果.其结合空间和通道注意力机制模块的架构,借助CBAM[22]思想.首先构建通道注意力块和空间注意力块,通道注意力块中将输入的特征图F分别从高度和宽度两个维度进行自适应全局最大池化和自适全局平均池化,得到两个1*1*C的特征图,再将它们分别送入一个两层的神经网络(MLP).第一层是一个1*1的卷积和激活函数,第二层是1*1的卷积.然后将输出的特征进行加和操作后,通过激活函数操作生成最终的通道注意特征.最后,将通道注意特征和输入特征F进行乘法操作,生成的特征图将作为空间注意机制块的输入特征图.

空间注意机制块中将输入的特征图 分别做一个基于通道的自适应全局最大池化和自适全局平均池化,得到两个H*W*1的特征图,然后将两个特征图进行通道拼接,再经过一个7*7的卷积和激活函数生成空间注意特征,最后将空间注意特征和 进行乘法操作,然后输入1*1卷积获取神经网络中的兴趣流行.与此同时,在该卷积后添加一个BN层,以防止网络的过拟合问题和增强网络的泛化能力.

其次在ACM中引入了两个新的激活函数:Hard-Sigmoid和Hard-Swish.这两个新型激活函数,都来源于Sigmoid函数,Sigmoid函数公式如下:

2实验结果与分析

2.1数据集

RSSCN7数据集包含2 800张遥感图像,这些图像来自于7个典型的场景类别分别是草地、田地、工业、河流湖泊、森林、居民区和停车场,其中每个类别包含400张图像,分别基于4个不同的尺度进行采样.RSOD数据集共包含4个典型的场景类别分别是飞机场,储油罐、立交桥和体育场,共有约1 000张遥感图像.RSSCN7数据集和RSOD数据集分别如图6、图7所示.

2.2实验设置

实验在python3.9和pytorch1.4环境下进行,处理器型号为:i5-8300,显卡型号为:GTX1050Ti,MoblieNetv2预训练网络基于ImageNet数据集,实验中参数设置为epoch:50、batch size:16、初始学习率:0.000 1.实验分析部分用分类精度、时间开销作为评价指标.

2.3实验分析

本实验使用RSSCN7和RSOD两个数据集,分别将两个数据集按照训练集40%、验证集10%和测试集50%进行划分.先用训练集和验证集对模型进行参数训练,然后再通过测试集测试模型的分类效果.为了验证本文提出的基于ACM的MobileNetv2模型框架在场景分类的优越性,对MobileNetv2、MobileNetv2+CBAM和MobileNetv2+ACM进行对比实验,分类精度和时间开销见表2所示.

由表2可知,本文模型在RSSCN7和RSOD两个数据集上均取得了最佳分类精度,分别达到90.64%和97.13%,相较于初始的MobileNetv2的88.22%和95.49%分别提升了2.42%和1.64%.实验结果表明本文提出的基于ACM的MobileNetv2模型框架,尽管每次迭代的平均时间略有增加,但该模块有效的增强了卷积神经网络提取特征的能力.同时通过在相同位置嵌入了CBAM进行的消融实验结果表明,本文提出的ACM在RSSCN7和RSOD两个数据集上分别比CBAM提高了2%和1.23%的分类精度,尽管增加了时间开销,但显著的分类性能提升依旧表明了ACM在卷积神经网络上增强特征的优越能力.

图8和图9是本文MoblieNetv2-ACM分别在RSSCN7和RSOD数据集上的混淆矩阵.由图8可知,在RSSCN7数据集上工业和停车场的分类精度分别只有77.5%和86.5%都低于整体分类精度.工业类别中误分入停车场类别的占工业类别错分总数的62.22%,而停车场类别误分入工业类别的占停车场类别错分总数的59.26%.由图9可知,在ROSD数据集上储油罐和立交桥分类精度略低于数据集整体精度.储油罐类别的错误分类全部被分入了飞机场类别中,而飞机场类别中误分入储油罐类别的占飞机场类别错分总数的80%.

为进一步验证本模块的分类有效性和优越性,在RSSCN7数据集上对比现有的注意力机制和主流网络框架,如:单头注意力和使用多头注意力的ViT,分类精度结果见表3所示.

由表3结果可知,MobileNetv2+ACM比ResNet50在分类精度上提高了1.59%.MobileNetv2作为轻量级移动网络,在分类精度上通常低于主流的神经网络框架.结果表明本文提出的方法在不显著增加网络参数的同时,提高网络分类精度.在RSSCN7数据集上MobileNetv2+ACM相较于使用多头注意力的ViT和单头注意力分类精度分别提高1%和2.5%,实验结果表明本文提出模块在分类精度上的优越性.

验证算法训练收敛速度的测试,本文选取RSOD数据集上关于MobileNetv2和MobileNetv2+ACM的一个训练精度和训练收敛的速度对比,实验结果见图10所示.由图10可知,最终迭代结束后的训练精度,MobileNetv2+ACM略高于MobileNetv2,且在第5次迭代中就达到了一个较優训练精度.而MobileNetv2在第15次迭代后才能达到类似的一个训练精度.结果表明:本文提出的MobileNetv2+ACM不仅在分类精度上达到一个更优的结果,也加快了网络训练收敛的速度.

为验证不同参数对实验的影响,对batch size、dropout等参数设置实验,测试模型的分类精度.表4展示的是两个数据集上不同的batch size实验,其中选取的batch size的大小分别为8、16和32.表5 展示的是两个数据集上不同的dropout实验,其中选取的dropout分别为0.2、0.4和0.6.

由表4可知,在RSSCN7數据集上,batch size为16时达到了最优分类精度.在RSOD数据集上,batch size为32时达到了最优分类精度.在训练过程中,当采用较小的batch size时,梯度波动会增大,使得网络不容易收敛;当batch size过大时,尽管会加快一次迭代的运算时间,但是会使得梯度变化不明显,从而陷入局部最优的困境.

由表5可知,在在RSSCN7数据集上,dropout为0.2时达到了最优分类精度.在RSOD数据集上,dropout为0.4时达到了最优分类精度.Dropout是训练网络过程中,对于神经网络单元,按照一定概率将其暂时从网络中丢弃,可以有效的避免过拟合的问题.因此当dropout设置过小可能会导致网络存在过拟合现象,过大则会造成信息严重丢失,影响分类性能.

为验证新引入的Hard-Sigmoid和Hard-Swish两个激活函数对ACM的分类精度和时间开销的影响,通过对该模块替换原始激活函数进行消融实验,实验结果见表6所示.

由表6可知,Hard-Sigmoid和Hard-Swish两个新型激活函数组合在RSSCN7和RSOD两个数据集上均取得了最优分类精度.由Si+R和Si+H-S,H-Si+R和H-Si+H-S的对比表明,用Hard-Swish代替

ReLU可以有效的提高网络分类精度,但会一定程度增加计算量.由Si+R和H-Si+R,Si+H-S和H-Si+H-S的对比表明,用Hard-Sigmoid代替Sigmoid可以在一定程度上降低激活函数计算量的同时小幅度的提升了网络的分类精度.

3结论

本文提出一种基于ACM的MoblieNetv2模型框架,用于遥感场景分类.通过在MoblieNetv2中嵌入ACM,增强卷积网络提取特征的显著区域.ACM作为新颖的注意卷积模块在增强通道信息和空间信息的同时,将特征图反馈给后续的1*1的卷积层,进一步增强保留了该显著区域.与此同时在注意卷积模块中引入两个性能较佳的激活函数,一定程度上降低了该模块的参数和计算量,提高了分类精度.在RSSCN7数据集和RSOD数据集中的实验结果表明,该ACM模块在不显著增加网络参数和计算量的同时,提高了网络的训练速度和分类精度.未来将设计一种更轻量级的注意卷积模块和细粒度视觉的融合方法进一步降低计算量的同时,提高模型分类精度.

参考文献

[1] Y.Li,Z.Zhu,J.G.Yu,et al.Learning deep cross-modal embedding networks for zero-shot remote sensing image scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing,2021,59(12):10 590-10 603.

[2] N.He,L.Fang,S.Li,et al.Remote sensing scene classification using multilayer stacked covariance pooling[J].IEEE Transactions on Geoscience and Remote Sensing,2018,56(12):6 899-6 910.

[3] H.Wan,J.Chen,Z.Huang,et al.Lightweight channel attention and multiscale feature fusion discrimination for remote sensing scene classification[J]. IEEE Access,2021,9:94 586-94 600.

[4] Lowe D.G..Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision,2004,60:91-110.

[5] T.Ojala,M.Pietikainen,T.Maenpaa.Multiresolution gray-scale and rotation invariant texture classification with local binary patterns[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(7):971-987.

[6] N.Dalal,B.Triggs.Histograms of oriented gradients for human detection[J].IEEE Computer Society Conference on Computer Vision and Pattern Recognition,2005,1:886-893.

[7] Li Zhou,Zongtan Zhou,Dewen Hu.Scene classification using a multi resolution bag of features model[J].Pattern Recogn,2013,46(1):424-433.

[8] W.Luo,H.Li,G.Liu.Automatica annotation of multispectral satellite images using author-topic model[J]. IEEE Geoscience and Remote Sensing Letters,2012,9(4):634-638.

[9] C.Vduva,I.Gavt,M.Datcu.Latent dirichlet allocation for spatial analysis of satellite images[J].IEEE Transactions on Geoscience and Remote Sensing,2013,51(5):2 770-2 786.

[10] 章晨,夏凯,杨垠晖,等.改进残差网络的遥感图像场景分类[J].测绘科学,2020,45(8):151-156.

[11] C.Shi,T.Wang,L.Wang.Branch feature fusion convolution network for remote sensing scene classification[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing,2020,13:5 194-5 210.

[12] Chen Wang,Wei Lin,Pengfei Tang.Multiple resolution block feature for remote-sensing scene classification[J].International Journal of Remote Sensing,2019,40(18):6 884-6 904.

[13] Li Q,Yan D,Wu W.Remote sensing image scene classification based on global self-attention module[J]. Remote Sens,2021,13:4 542.

[14] 李彦甫,范习健,杨绪兵,等.基于自注意力卷积网络的遥感图像分类[J].北京林业大学学报,2021,43(10):81-88.

[15] 徐从安,吕亚飞,张筱晗,等.基于双重注意力机制的遥感图像场景分类特征表示方法[J].电子与信息学报,2021,43(3):683-691.

[16] J.Hu,L.Shen,S.Albanie,et al.Squeeze-and-excitation networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2020,42(8):2 011-2 023.

[17] J.M.Haut,R.Fernandez Beltran,M.E.Paoletti,et al.Remote sensing image superresolution using deep residual channel attention[J].IEEE Transactions on Geoscience and Remote Sensing,2019,57(11):9 277-9 289.

[18] M.Sandler,A.Howard,M.Zhu,et al.MobileNetV2:Inverted residuals and linear bottlenecks[C]//IEEE Conference on Computer Vision and Pattern Recognition.Salt Lake City:Institute of Electrical and Electronics Engineers,2018:4 510-4 520.

[19] A.Howard,M.Sandler,B.Chen,et al.Searching for MobileNetV3[C]//International Conference on Computer Vision.Seoul:Institute of Electrical and Electronics Engineers,2019:1 314-1 324.

[20] A.Howard,M.Zhu,B.Chen,et al.MobileNets:Efficient convolutional neural networks for mobile vision applications[C]//Computer Vision and Pattern Recognition.Honolulu:Institute of Electrical and Electronics Engineers,2017:1 704-1 712.

[21] Yu D,Xu Q,Guo H,et al.An efficient and lightweight convolutional neural network for remote sensing image scene classification[J]. Sensors,2020,20:1 999.

[22] Woo S,Park J,Lee J Y,et al.CBAM:Convolutional block attention module[C]//European Conference on Computer Vision.Munich:Springer Nature Switzerland,2018:3-19.

[23] Ramachandran,Prajit,Barret Zoph,et al.Searching for activation functions[DB/OL].https://doi.org/10.48550/arXiv.1710.05941,2017-10-27.

【責任编辑:蒋亚儒】