基于CNN-GRU模型的齿轮寿命预测

2023-03-01张超庞永志王巍智吕达

张超,庞永志,王巍智,吕达

(1.内蒙古科技大学机械工程学院,内蒙古包头 014017;2.内蒙古自治区机电系统智能诊断与控制重点实验室, 内蒙古包头 014010)

0 前言

齿轮传动是机械传动中应用最广的一种传动形式。它的传动相对较稳定、效率高、结构紧凑、工作可靠,具有运行平稳、可变传动传递方向、传递大扭矩等优点[1]。随着集成度的提高,现代机械设备齿轮的精度也越来越高,在长期运行中很容易出现磨损,从而发生轮齿折断。监测齿轮的健康状态是保障机械设备可靠运行的重要手段。出于可靠性、安全性和经济性的考虑,齿轮故障预测和健康管理(Prognostics and Health Management, PHM)[2]获得广泛关注。但是如何用大量的数据通过深度学习得到齿轮的剩余使用寿命成为一大挑战。

深度学习(Deep Learning, DL)[3-4]是近几年机器学习领域最引人注目的方向,它通过模仿人脑的工作机制对语音、图像、文本等数据进行解释。其观点最早来自于人工神经网络(Artificial Neural Network,ANN)[5]的研究。反向传播算法(Back Propagation,BP)[6-7]的提出,将统计模型的机器学习推向浪潮。张瑞等人[8]较早开始用浅层BP神经网络,通过反向传播误差的算法构建了设备状态识别与剩余寿命预测模型;齿轮的状态监测数据非对称分布,而且在实际应用中采样往往不连续。因此,考虑到以上2个原因,很难准确预测齿轮的剩余使用寿命。由于Elman神经网络在反馈和精度上都优于BP网络,CHEN和LIU[9]提出了一种基于灰色神经网络的齿轮剩余寿命预测,主要利用Elman神经网络对灰色模型残差序列进行修正的融合方法进行预测;王铄[10]提出了基于支持向量机(Support Vector Machine, SVM)的剩余寿命预测方法,通过卡尔曼滤波与支持向量机相结合方法对剩余寿命进行预测,大大提高了机器剩余寿命预测精度,具有一定的工程应用价值;李磊[11]针对旋转机械传动部件剩余寿命预测的问题,通过极限学习机(Extreme Learning Machine, ELM)算法构建ELM趋势预测模型,用轴承全寿命数据进行验证,结果表明ELM算法与传统的SVM算法和BP算法相比在预测方面具有一定优越性。由于计算机计算能力不断提高,数据不断增加,自2016年机器人AlphaGo打败世界围棋高手,迎来了深度学习的高潮,深度学习的应用领域越来越广。相比于传统的人工神经网络,递归神经网络(Recurrent Neural Network,RNN)最大的优点是可以用当前时刻输入层的数据和之前输出的数据,但是传统的神经网络却不能。RNN 每一次的输入既有当前的也有过去的反馈,因此,RNN 更适合去解决一些与时序相关的信息[12]。然而RNN也存在一个很大的缺点,当序列过长时会导致网络发生梯度消失或梯度爆炸[13]。为了解决这个问题,HOCHREITER和SCHMIDHUBER[14]最早引出了长短时记忆网络(Long Short-Term Memory,LSTM),它可以很好地解决长时间序列的问题。石慧等人[15]依据监测的一些设备退化数据,提出了一种改进的记忆循环神经网络,时刻监测剩余使用寿命,提高了预测精度。CHEN等[16]提出了一种新的递归神经网络-门控递归单元(Gated Recurrent Unit, GRU),验证了该方法对非线性退化过程RUL预测的有效性;结果还表明:与LSTM方法相比,该方法训练时间更短,预测精度更高。温海茹和陈雯柏[17]提出一种深度卷积神经网络(Deep Convolutional Neural Network,DCNN) 和LSTM相结合的方法对剩余使用寿命进行预测,并在C-MAPSS 数据集上进行了验证,与CNN、LSTM 模型在相同数据集上进行比较,预测精度有了很大提高,验证了此算法的有效性。虽然LSTM相比于RNN有了巨大的改进,并且通过与CNN相结合准确率得到了提高,但是却引入了更高的计算复杂度。为了解决LSTM复杂度过高的问题,同时又能保证良好的准确率,本文作者提出了一种CNN结合GRU的方法来对齿轮进行预测。因为GRU简化了LSTM的结构,可以在保持与LSTM模型相当的表达能力前提下,提高循环神经网络的训练速度。

1 CNN-GRU模型

1.1 CNN模型

卷积神经网络(Convolutional Neural Networks,CNN)是目前比较火的深度学习网络之一,它有着很强的特征提取能力,大量应用于语音识别、模式识别、语言处理等,并能通过大量检测数据进行机械系统故障诊断[18]。文中采用一维卷积来构建时间序列,如图1所示,提取特征信息,构建2个卷积层,并采用最大池化层作为连接层,池化层尺寸为3×3,选择合适大小的池化窗口能够降低输入门控循环单元的噪声信息,但池化窗口过大则导致部分有效信息丢失。池化层的引入增加了参数量,但是提高了训练速度。

图1 一维卷积原理Fig.1 One-dimensional convolution schematic

1.2 GRU模型

GRU能够解决RNN在实际应用中出现的梯度爆炸和消失的问题。它的核心是一个“更新门”,在保证神经元记忆力的前提下,简化了与它类似的长短时记忆网络(Long Short Term Memory, LSTM)的结构,提高训练速度[19]。更新门的作用是决定模型要将多少之前的信息传递到后面。 它的重置门也非常重要,决定了要丢弃多少之前的信息。下一步当前记忆内容会被激活,激活后的更新门控制保留新信息和旧信息的数量。新信息和旧信息具有互补的关系。如果保留了大量的新信息,那么考虑的旧信息就会较少,反之亦然。具体的结构如图2所示。

图2 GRU原理Fig.2 GRU schematic

更新门公式:

zt=σ(W(z)xt+U(z)ht-1)

(1)

重置门公式:

rt=σ(W(r)xt+U(r)ht-1)

(2)

当前记忆内容:

h′t=tanh(Wxt+rt⊙Uht-1)

(3)

当前时间步最终记忆:

ht=zt⊙ht-1+(1-zt)⊙h′t

(4)

式中:W(z)、W(r)、W分别为更新门、重置门和当前记忆的权重;ht-1、ht分别为上一时刻的输出和当前时刻的输出;xt为当前时刻的输入;U(z)、U(r)、U为循环连接的权重;σ和tanh分别表示sigmoid函数和tanh函数;⊙表示元素相乘。

GRU的目标是通过学习非线性退化规律,将源数据转换为RUL标签。RNN有许多不同的结构,它们被应用于特定的任务,比如:图像自动标注通常采用单输入多输出结构;句子情感分析通常采用多输入单输出结构。具有多输入多输出的结构通常用于机器翻译和视频分类。不同的预测任务要建立不同的模型,GRU网络专用于对时间序列建模和学习序列的长期依赖性,由于用于表示旋转机械退化过程的退化特征由一系列随时间变化的参数组成,因此GRU网络能对滚动轴承,齿轮等的退化过程进行有效的分析[20]。此外,由于旋转机械的退化过程通常表现出高度的非线性和非平稳性,因此需要采用深度架构使网络具有更强大的非线性学习能力[21]。卷积神经网络与循环神经网络相结合在一定程度上提高模型的训练速度,在某些任务上也能提升模型的性能,并且有助于提高循环神经网络的训练稳定性。

1.3 CNN-GRU模型

图3所示是CNN-GRU模型的网络结构,首先划分好的数据集标准化处理后输入到一维卷积神经网络中,进行特征提取,减少冗余数据,使得数据量变小且数据特征不变;其次将卷积神经网络的输出作为门控循环单元的输入进行训练,训练结束后的数据将放进全连接层输出进行预测。

图3 CNN-GRU神经网络结构Fig.3 CNN-GRU neural network structure

2 超参数的选择

2.1 激活函数的选择

非线性的特征映射到神经网络中,需要用到激活函数,如果没有激活函数,网络中的每层输入都等于上一层的线性输出,网络的训练能力有限;如果加上激活函数,网络中有非线性因子,能够得到更强表达能力的深层神经网络[22]。

(1)Sigmoid函数对应的算法:

(5)

Sigmoid函数能够使计算结果大多数为0或1,这样就满足了门控的要求,即完全抑制和完全激活。

(2)Tanh函数对应的算法:

(6)

该函数光滑可微,导数计算方便,在0附近梯度较大,可较好地区别小特征差异,但是运算量比较大,速度慢;存在非线性饱和区,还容易在反向传播时引起梯度消散。

(3)ReLU函数对应的算法:

y=max(x,0)

(7)

ReLU是一种非线性函数,作为激活函数非常有效,它不仅能提高性能,而且有助于在训练阶段显著减少计算次数,可以很好地解决S形激活函数存在的梯度弥散问题[23]。因此文中除了最后一层全连接层采用Sigmoid函数外,其他层使用的都是ReLU函数。

2.2 优化器的选择

一般常用的优化器有2种,分别是随机梯度下降(Stochastic Gradient Descent, SGD)和自适应矩阵估计(Adaptive Moment Estimation, Adam)[24]。

SGD优化器在每个训练样本通过网络之后,计算并更新权重,该优化器虽然速度相对较快但是由于权重更新得过于频繁,因此整体损失曲线会有大量噪声[25]。该算法的更新公式可表示为

Wt=Wt-1-α·r

(8)

式中:Wt为当前时刻的权重;Wt-1为上一时刻的权重;α为学习率;r为损失值。

由于SGD存在噪声的问题,文中采用Adam优化器。它是目前深度学习中最热门最广泛的优化器,它定义了损失梯度的动量和方差,并利用组合效应来更新权重参数,动量和方差共同作用,有助于平滑学习曲线并有效改善学习过程。该算法数学表达式可简化为

Wt=Wt-1-pvσ

(9)

其中:pvσ为动量与方差的组合。

3 齿轮的RUL预测

3.1 基于CNN-GRU的模型对齿轮的寿命预测步骤

在Windows7下采用Tensorflow、Keras 框架来实现提出的网络结构。所用的编程语言是Python3.7,所有实验都是在Inter Core i5(3.7 GHz) CPU、16 GB RAM 的计算机上进行的。

(1)获取齿轮的转速数据、振动信号数据,按照8∶2的比例划分为训练集和测试集;对它进行编号,再进行数据标准化处理,然后进行特征的缩放。

(2)CNN选用一维输入数据,输入到模型当中,初始化权重和偏置,将训练样本分批次输入到网络,选择合适的学习速率和优化器。卷积神经网络的输出特征值维度的一维与时间序列的门控循环单元进行衔接。

(3)由全连接层进行输出,然后进行模型评估,构建趋势性量化指标并构建模型。将测试集进行标准化处理,将它输入到训练集训练好的模型中,对它进行测试评估,根据样本的输出概率与真实值对比,得出损失值,最后做出寿命预测曲线。

3.2 参数设置

此实验将部分GRU神经元的数量进行调整,选择最优的参数组合进行研究。由于GRU不能直接输出RUL,因此必须添加全连接层来预测RUL。此实验中CNN-GRU模型主要由一维Conv层、GRU层和Dense层组成,其中卷积核大小为3×1,选用最大池化,池化大小为3×1,选择学习速率大小为0.000 1,优化器选用Adam及选用padding=same进行填充。第一层GRU的return_sequences返回的是True,第二层返回的是False。在网络中加上Dropout层防止过拟合,Dropout大小设置为0.5。表1所示为每层网络神经元的数量。

表1 各层神经元数量Tab.1 Number of neurons in each layer

3.3 损失函数

损失函数又分为交叉熵损失、均方差损失(Mean Squared Error,MSE)、平方绝对误差损失函数、0-1损失等。文中采用MSE损失函数。

均方误差MSE:

(10)

式中:f(x)为预测值;y为真实值。

3.4 实验数据介绍

文中采用的是英国哈德斯菲尔德大学的齿轮信号数据,此实验数据为齿轮的全寿命周期,实验数据主要包括:速度信号数据、温度信号数据、电流信号数据、振动信号数据。一共有5个通道:通道一采集转速信号,通道二采集温度信号,通道三采集电流信号,通道四采集减速器振动信号,通道五采集齿轮箱增压器振动信号。文中主要采用振动信号、转速信号作为输入数据。其中采样频率为30 555 Hz。具体信息如表2所示。

表2 哈德斯菲尔德大学齿轮数据说明

3.5 模型评价指标

文中采用GRU模型预测齿轮的剩余寿命,属于监督学习。在监督学习中,根据属性可以将监督学习分为回归问题和离散问题。文中提出的齿轮的寿命预测属于时序的回归问题,离散问题一般评价指标是accuracy,然而回归问题的评价指标一般是MSE、MAE等,所以文中采用MSE作为模型好坏的评价指标,并对2个评价指标进行对比。第i个测试样本的误差损失率为

Er(i)=rRUL(i)-pRUL(i)

(11)

3.6 实验结果分析

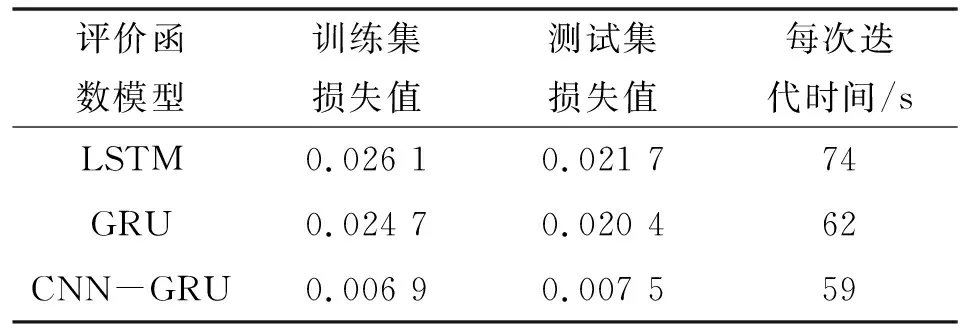

图4中的3个图分别为LSTM、GRU、CNN-GRU在MSE评价函数下得到的损失函数。通过图4可以发现:CNN-GRU损失函数的值下降得更快,损失率较小。表3所示为不同神经网络模型下的参数值,由此也可观察出:CNN-GRU模型的损失率较低,而且训练速度快,表明了该方法对齿轮寿命预测的可行性。

图4 齿轮在不同模型下的损失率

表3 不同模型参数值Tab.3 Different model parameter values

由以上可以得出CNN-GRU模型相比较其他的网络损失率有了很大的下降,无论在训练集还是测试集,CNN-GRU的误差曲线都比其他2个下降得快。说明相对其他网络它具有较低的误差、更快的收敛速度,拟合性能更好。因此,CNN-GRU在预测精度方面均优于普通的GRU和LSTM,能够对模型更好地进行RUL预测。

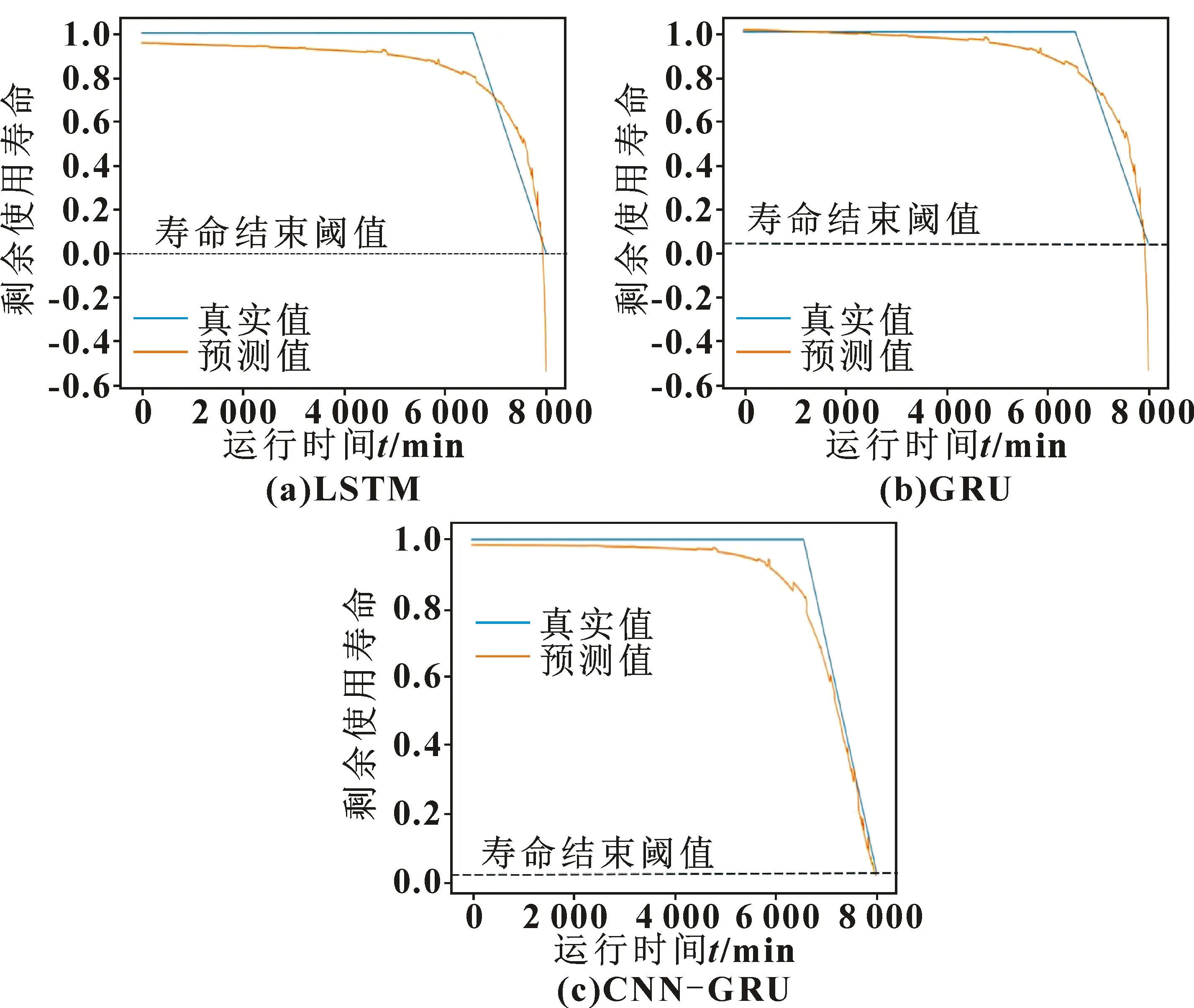

3.7 预测结果

齿轮的剩余寿命曲线如图5所示,通过前面数据的训练对后面数据进行预测。为了更直观地理解,将训练集的数据进行归一化处理,即纵坐标为1表示无损伤初始状态,寿命结束阈值设置为0。当剩余寿命达到0时代表完全失效。从预测的结果可以看出:CNN-GRU模型的预测结果相对更加准确,拟合度更高,预测误差较小。通过仿真分析,得出此方法对齿轮的寿命预测具有一定的有效性。文中提出的方法解决了LSTM、GRU等网络对齿轮的预测不够精确、训练速度慢的问题。

图5 齿轮在不同模型下寿命预测曲线

4 结论

文中提出了通过CNN-GRU模型相结合的方法,利用了CNN的特征提取能力,避免了人工提取特征,具有很强的泛化性,并且GRU相比LSTM的网络简化许多,同时也避免了类似RNN的梯度消失或梯度爆炸。所以此方法既在简化网络、减少参数的情况下加快了训练速度,又提高了准确率。采用哈德斯菲尔德大学数据对该方法进行验证,结果表明:此方法不论是在预测精度方面还是训练时间方面都优于其他模型,能够提供更好的预测效果。通过以上的验证可以得出:文中所提出的CNN-GRU模型既有CNN的特征提取能力,又有GRU时间序列的预测能力,与CNN相比准确率精准得多,与GRU和LSTM相比不论是在训练速度上,还是在预测精确度上都要好得多,具有一定的可行性和优越性,为齿轮的寿命预测提供了新的思路。