基于双专用注意力机制引导的循环生成对抗网络

2022-09-01劳俊明叶武剑刘怡俊袁凯奕

劳俊明,叶武剑,刘怡俊,袁凯奕

(1. 广东工业大学 信息工程学院,广东 广州 510006;2. 广东工业大学 集成电路学院,广东 广州 510006)

1 引 言

图像到图像的转换任务一直以来都是人们的研究热点,其目标是建立图像源领域到目标领域的映射,被广泛应用于图像超分辨率重建[1]、风格迁移[2]、图像着色[3]、图像去雾[4]等多个领域。

2014 年,基于博弈思维的生成对抗网络[5]开辟了一个新的研究领域,大为促进了图像转换领域的发展。此后,诞生了一系列优秀的图像转换算法,例如Pix2pix[6]、DualGAN[7]、DiscoGAN[8]、UNIT[9]、MUNIT[10]、DRIT[11]、CycleGAN[12]等算法。其中,Pix2pix 算法属于有监督的图像转换算法,该算法需要匹配的图像组才能完成图像转换的任务,然而,匹配的数据集制作难度较大、成本较高。为了实现无配对图像之间的转换,Dual⁃GAN、DiscoGAN 以及CycleGAN 等网络模型引入了循环一致性约束。实验结果表明,上述模型在无匹配的图像转换任务取得了较好的效果。尽管CycleGAN 等算法在无匹配的图像转换任务表现优越,但是,由于生成器既需要维持图像背景区域不变,又要对目标前景进行转换,从而导致生成器对目标图像转换的效率低下。

近年来,注意力机制在深度学习中的应用引起了研究人员的高度重视,为解决CycleGAN 网络等算法存在的问题,研究人员相继提出了基于注意力机制的无匹配图像转换算法UAIT[13]、Attention-GAN[14]、SAT[15]等,但上述算法将独立的通用注意力结构加到生成器网络中,使得模型的整体结构变得非常庞大,导致其训练时间变长,而且也难以关注到图中关键区域的所有细节。AttentionGAN[16]提出了专用注意力机制与生成器共享编码器的结构,虽然能够缩小整体的网络结构大小,但是,由于鉴别器没有注意力机制引导,从而引入背景元素的干扰,影响了生成图像的质量。U-GAT-IT[17]提出了基于类激活CAM[18]注意力机制引导的生成器和鉴别器,虽然提升了成像质量,但整体网络的判别器需要从2 个增加至4 个,不仅大幅增加了模型的复杂度,并且其提出的基于CAM 注意力机制引导的生成器不够优越,仍然会对整体图像进行修改,图像转换效率不高,图像生成质量仍然有提升的空间。

2 基本原理

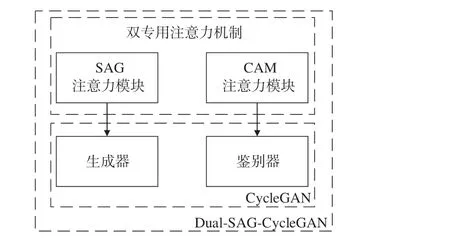

为解决上述存在的问题,本文提出了一种新的用于无匹配图像转换任务的循环生成对抗网络(Dual-SAG-CycleGAN),采用不同的专用注意力模块分别引导生成器和判别器,达到提升生成图像质量同时降低模型复杂度的目的。

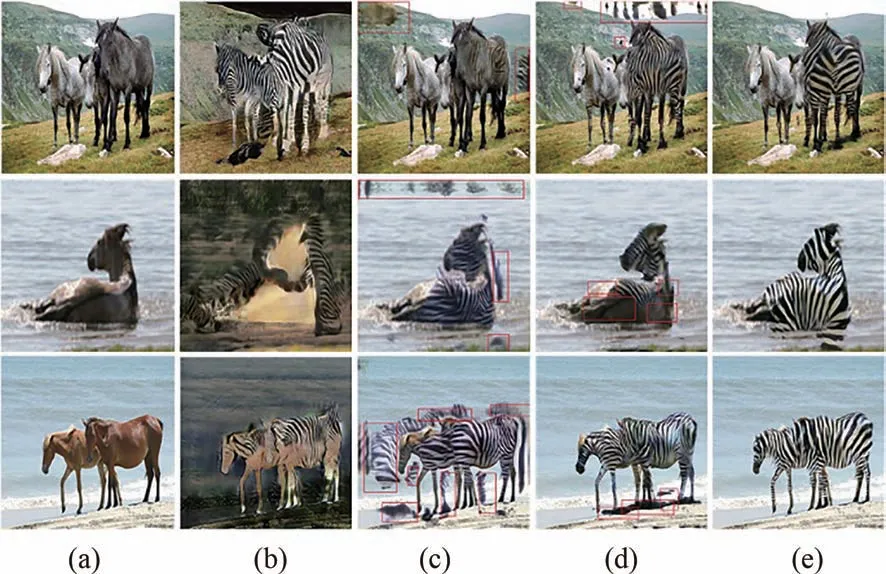

本文的贡献具体如下:(1)提出了一种名为SAG 的改进专用注意力模块来引导生成器工作,其中,生成器结构由内容图生成子模块与注意力掩码图生成子模块组成,两者高度共享参数权重。(2)为减少生成器对无关内容的生成以及削弱判别器对背景元素的判断,本文引入了基于CAM 注意力模块引导的鉴别器。(3)为了生成更加精准的掩码图来辅助图像转换,本文提出了背景掩码循环一致性损失函数约束掩码生成器的工作。图1 所示为本文所提出的模型以及现有对比模型在马转斑马任务上的生成效果图。

图1 不同模型在马转斑马任务上的表现。(a)原图;(b)CycleGAN;(c)UNIT;(d)MUNIT;(e)DRIT;(f)本文模型。Fig. 1 Performance of different models on the horse to zebra task.(a)Origin image;(b)CycleGAN;(c)UNIT;(d)MUNIT;(e)DRIT;(f)Ours.

2.1 整体框架

图2 是本文所提出的基于双专用注意力机制引导的循环生成对抗网络的示意图。本文在Cy⁃cleGAN 整体网络框架的基础上分别对生成器和判别器采用不同的注意力机制进行引导,其中,生成器采用本文提出的SAG 专用注意力机制进行引导,鉴别器使用了基于CAM 技术的专用注意力机制进行引导,两者构成紧密的整体。SAG专用注意力机制引导生成器修改图像的目标前景,而CAM 专用注意力机制则引导鉴别器关注两组图像之间差异最大的部分。

图2 网络示意图Fig. 2 Network diagram

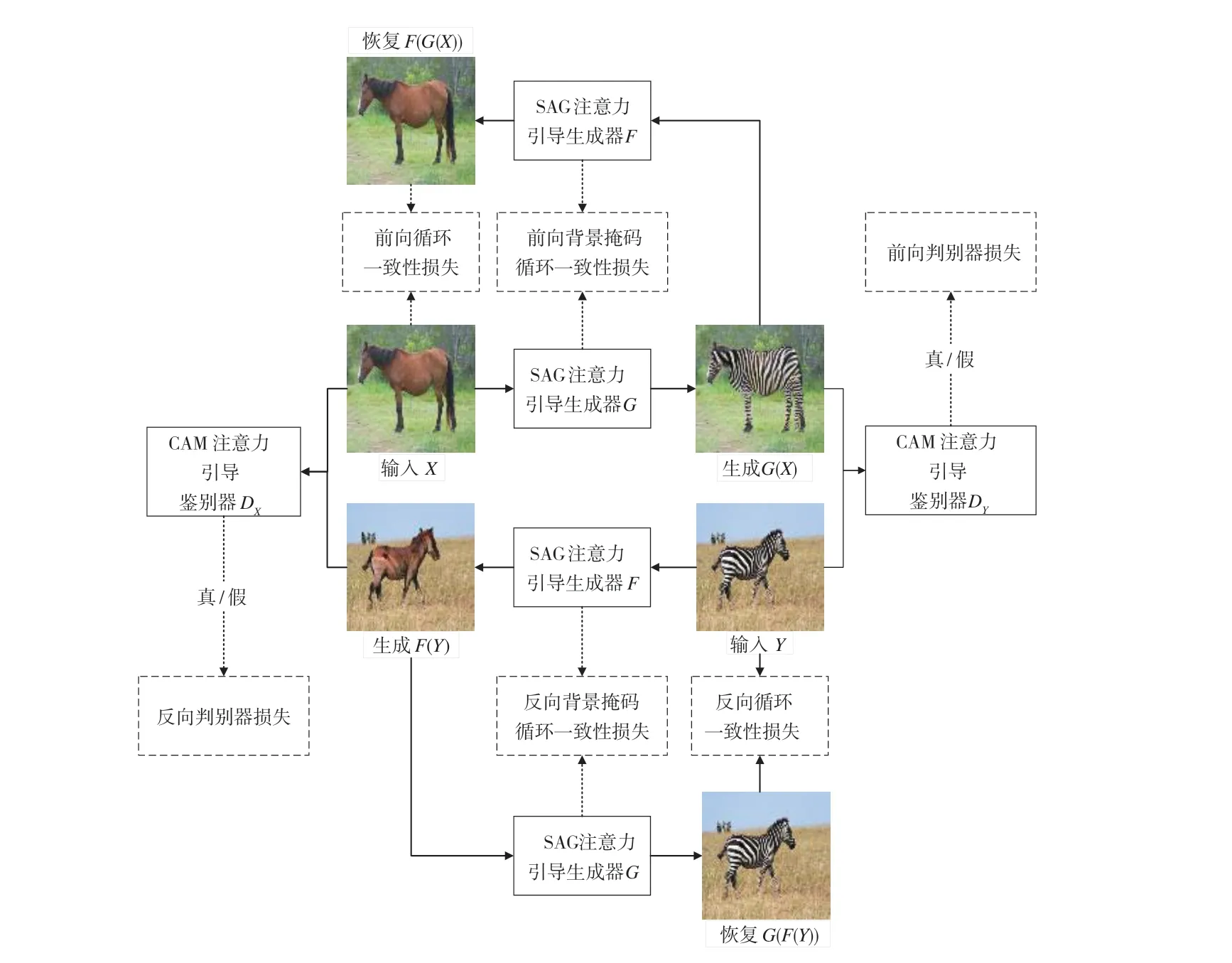

图3 为本文的整体框架图。在图像与图像转换的任务中,通常有两组不同的图像领域,其目标是得到域与域之间的映射。为了达成该目标,网络中需要两组对称的生成器与鉴别器,如图3所示,一组生成器G的功能是将X域(马)图像生成至Y域(斑马)图像,该组的鉴别器DY则将生成器生成的G(Y) 域(斑马)与真实的Y域(斑马)区分开来。同样,第二组生成器F的功能是将Y域(斑马)图像生成至X域(马)图像,该组的鉴别器DX则将生成器生成的F(X) 域(马)与真实的X域(马)区分开来。

图3 整体框架示意图Fig.3 Overall framework

为了防止网络在转换过程中,出现将X域(Y域)所有图像都映射到Y域(X域)中同一张图片的情况,本文与CycleGAN 一样,引入了两个循环一致性损失。所谓循环一致性损失就是X域的图像经过生成器G转换至Y域后,仍然可以通过生成器F恢复至原来的X域中,并且经过恢复的图像与原图之间差异不能过大,即前向映射x→G(x)→F(G(x))≈x。同样,反向映射y→F(y)→G(F(y))≈y亦是如此,本文遵循了CycleGAN 的整体基本原理。

由于在前向或反向循环映射过程中,需要修改各自的目标前景相同,即各自的背景掩码一致,故本文引入循环一致性损失函数约束掩码生成器的工作,使其生成更加精准的掩码图来辅助图像转换。通过两组对称的生成器与鉴别器动态博弈,最终得到相对理想的X域与Y域之间的映射。

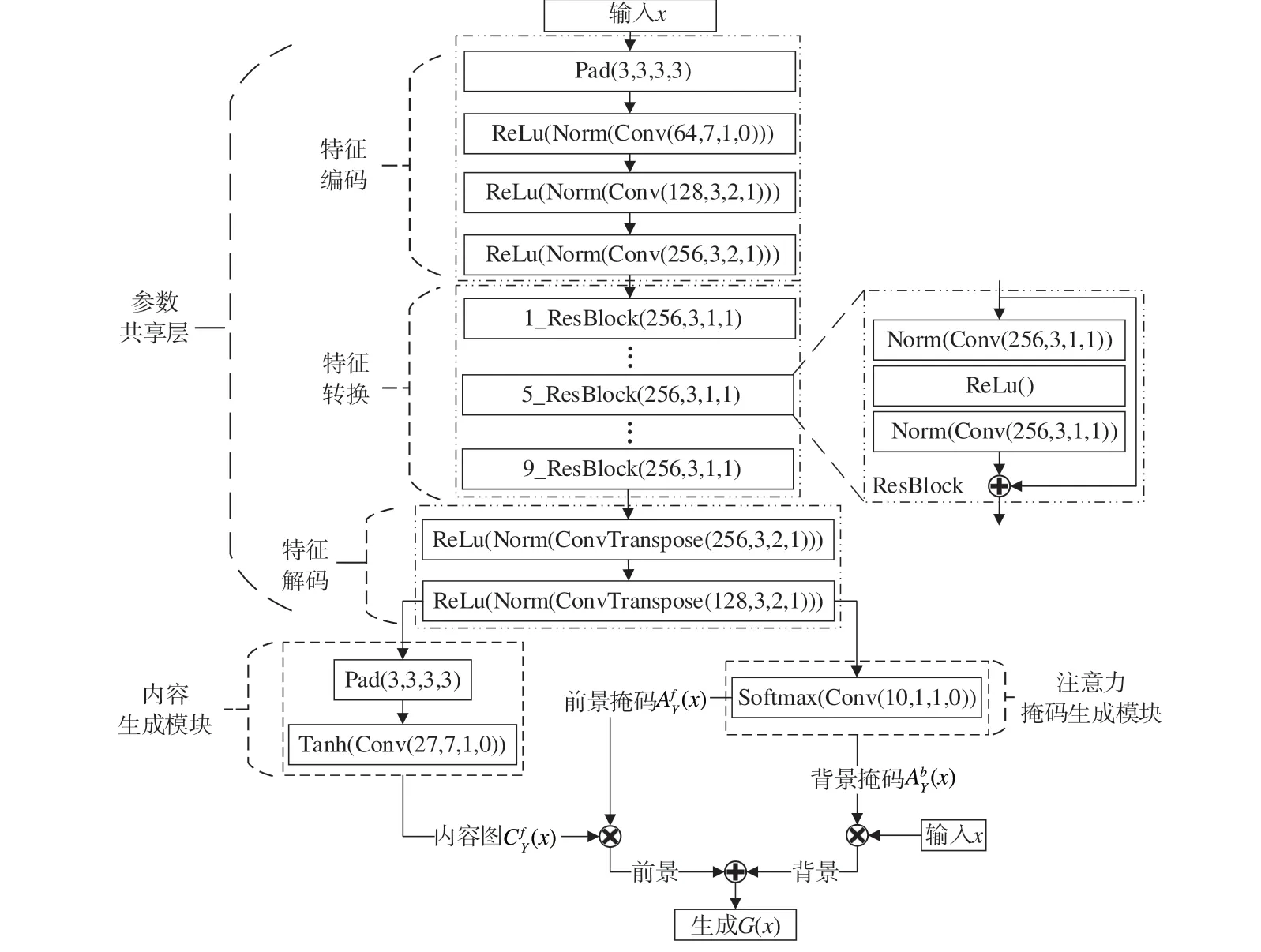

2.2 基于SAG 专用注意力引导的生成器

图4 基于专用注意力机制引导的生成器G 结构Fig.4 Structure of generator G based on special attention mechanism-guide

与其他基于注意力机制引导的模型相比,本文设计的基于专用注意力引导的生成器高度共享模型参数的结构,模型计算复杂度更低,而且由于我们的内容生成子模块卷积输出27 维图像矩阵,相较于其他模型直接输出3 维图像矩阵来说,可计算的映射路径更多。对于复杂场景下的图像,由于注意力机制的引入,使得网络只需要专注于生成前景目标,所以映射更加简单,网络更容易收敛,其生成图像细节更好。

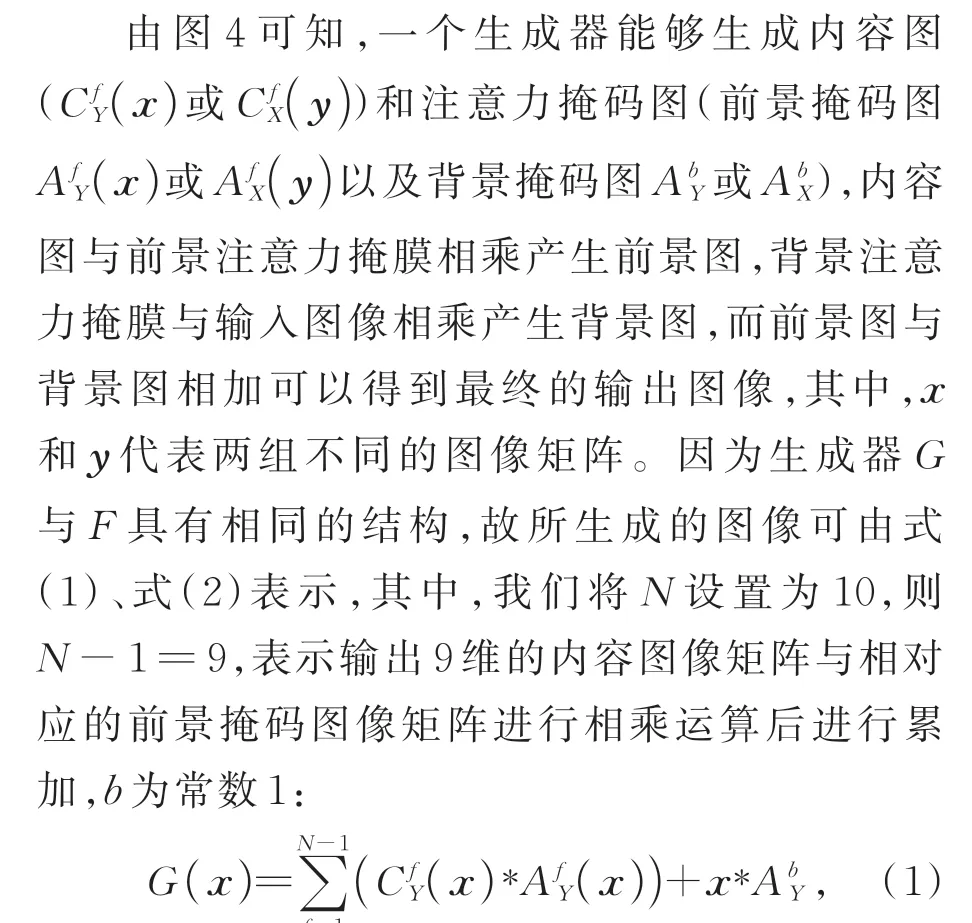

2.3 基于CAM 专用注意力引导的鉴别器

为了防止判别器对生成图像的背景元素进行判断,减少生成器对无关或者虚假内容的生成,本文采用了U-GAT-IT 中的鉴别器结构,如图5 所示,其利用了辅助鉴别器基于类激活图CAM 的原理对前景目标进行权重加权,影响最终鉴别器的输出,其中,卷积函数Conv 后的参数分别为特征输出通道数、卷积核大小、步长、四边填充行数。

图5 基于专用注意力机制引导的鉴别器结构Fig.5 Structure of discriminator based on special attention mechanism-guide

鉴别器的整体由辅助鉴别器以及最终鉴别器组成,两者同样高度共享权重参数。其中,辅助鉴别器的构成与传统的判别器一致,经过多层卷积提取特征后,通过池化层计算后,再通过全连接层后输出大小为1×1×1 的判别结果矩阵,将两个1×1×1 的判别结果矩阵拼接在一起,形成2×1×1 大小的辅助鉴别判断矩阵输出,从全局的方式去判断图像的真伪,维持生成目标的整体形状。而最终鉴别器的构成则与Cy⁃cleGAN 的判别器相似,从局部的方式去判断图像中每一小块的真伪,其最终输出大小为30×30 的判断结果矩阵,能够保持生成目标纹理的高细节、高分辨率。

最终鉴别器通过辅助鉴别器的卷积层、池化层以及全连接层计算后,从全局的方式利用CAM 的原理来得出对目标前景加权的矩阵,再与相应的特征矩阵相乘后得到注意力特征矩阵,进而输入到最终判别器进行进一步的特征提取,使得最终判别器进一步收敛至判断前景目标而不是背景元素。

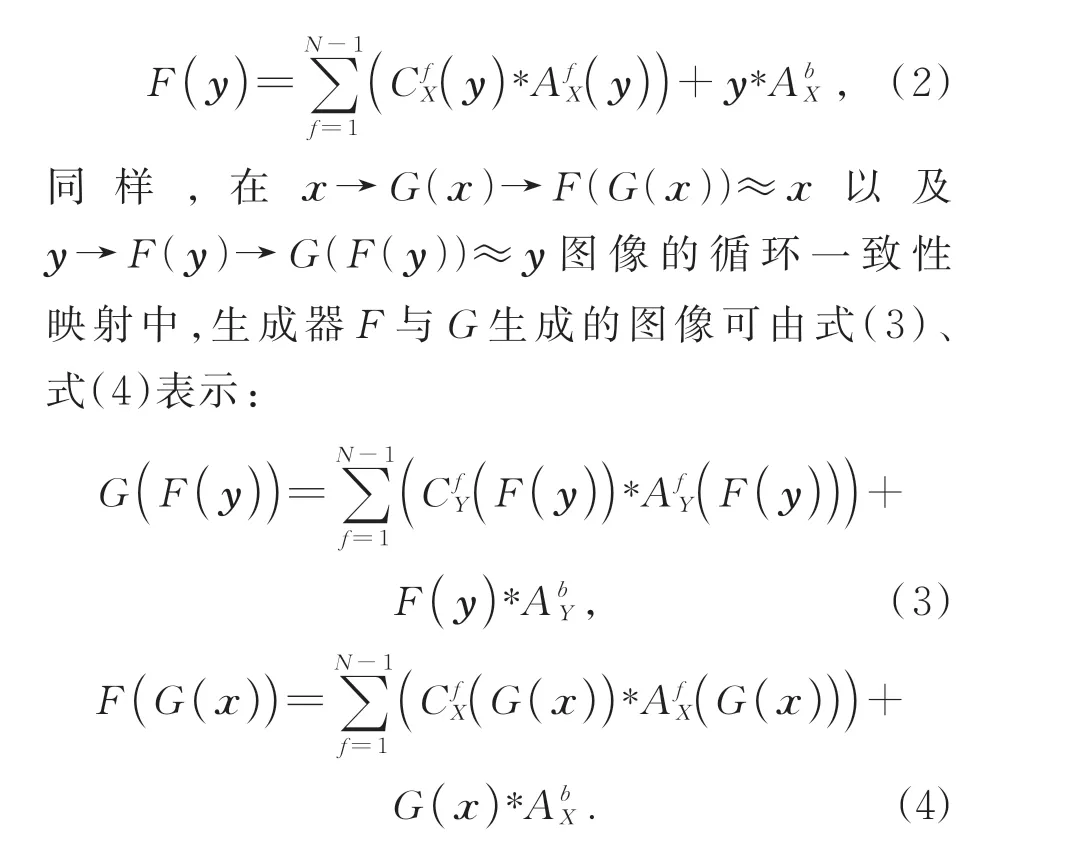

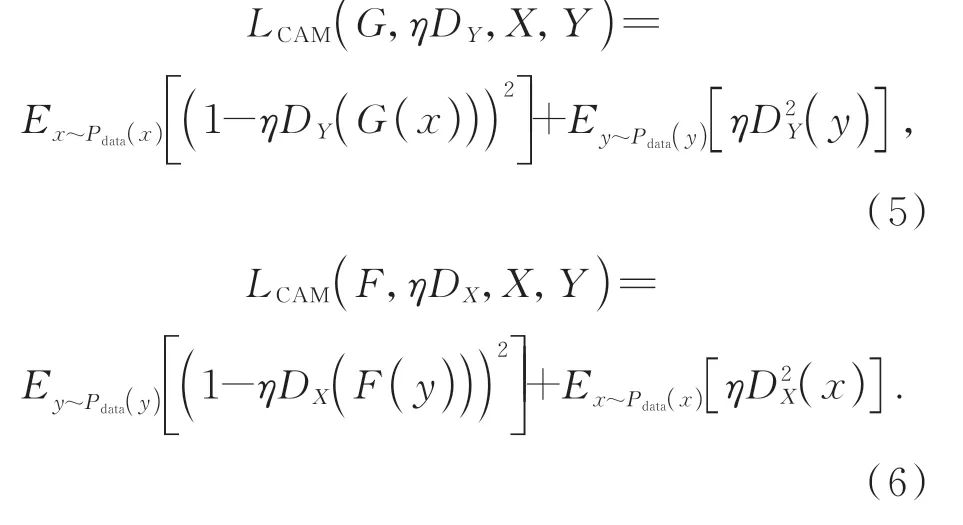

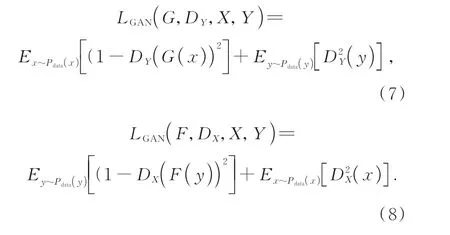

由图5 可知,本文采用的基于注意力机制引导的鉴别器结构具有两组输出,其中,ηDX或ηDY为辅助鉴别器输出,它能够从全局的形式来判断图像的真伪,由辅助鉴别器构成的生成对抗损失函数的数学表达式由式(5)以及式(6)表示。其中,x和y是真实的图像,Pdata(x)和Pdata(y)表示真实图像的样本分布,x~Pdata(x)和y~Pdata(y)表示样本x、y随机地从Pdata分布中取出,E则为求解数学期望。

要获得相似的样本分布,鉴别器D应当分辨出真实的图像与生成器G、F生成的虚假图像,也就是ηDY(G(x))及ηDX(F(y))的值要接近0,ηDY(y)及ηDX(x)接近1,即LCAM(G,ηDY,X,Y)越大越好;而生成器G则应当使生成的图像尽量可以骗过鉴别器,即ηDY(G(x))及ηDX(F(y))的值要接近1,也即LCAM(G,ηDY,X,Y)越小越好,该最优值为0.5。

最终鉴别器输出所构成的生成对抗损失函数与CycleGAN 一致,其数学表达式如式(7)和式(8)所示,类似的原理已在式(5)和式(6)处进行了详细的解释,故在此不再重复描述。

2.4 注意力引导下的循环一致性损失函数

2.5 优化目标

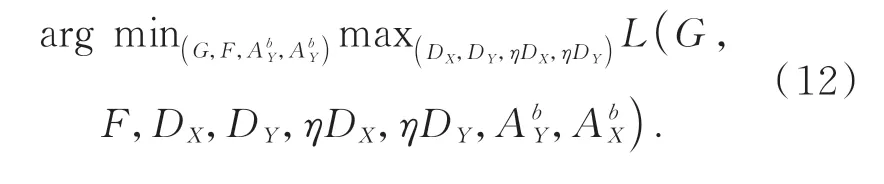

上文介绍了各部分的损失函数,而模型完整的损失函数方程由6 部分组成,如式(11)所示,分别为X域、Y域最终鉴别器的生成对抗损失;X域、Y域辅助鉴别器的生成对抗损失;整体图像的循环一致性损失以及背景掩码的循环一致性损失。

在图像转换任务中,要获得相似的样本分布,生成器G、F应当使生成的图像可以骗过鉴别器,而最终鉴别器DX、DY以及辅助鉴别器ηDX、ηDY则应当准确分辨出真实的图像与由生成器G、F生成的虚假图像,因此,生成器与鉴别器形成了对抗的关系。对于鉴别器DX、DY、ηDX以及ηDY,本文希望其辨别真实图像与生成器生成虚假图像的能力得到最大的提升,即为最优的鉴别器。在最优鉴别器的条件下,生成器G、F的优化目标是最小化图像的真实分布与模型生成图像分布之间的JS 散度,以获得最优的图像转换映射路径,同时本文希望循环一致性损失函数值最小。因此,本文网络的整体优化目标方程如式(12)所示:

3 实验分析

3.1 基准模型

本文对两大类无匹配图像转换算法进行对比,一类为无注意力机制引导的图像转换模型,包 括DualGAN[7]、DiscoGAN[8]、UNIT[9]、MU⁃NIT[10]、DRIT[11]、CycleGAN[12]、RA[19];另一类为有注意力机制引导的图像转换模型,主要有UAIT[13]、Attention-GAN[14]、SAT[15]、Attention⁃GAN[16]、U-GAT-IT[17]、DA-GAN[20]、TransGa⁃Ga[21]等模型。

3.2 数据集

本文采用3 组无匹配的图像数据集对模型进行训练与测试,各个数据集的详细情况如表1所示。

表1 各数据集详细信息Tab.1 Details of each dataset

3.3 参数设置

3.4 评价指标

3.4.1 生成图像质量评价

Kernel Inception Distance(KID)[22]指 标 通 过计算原始表征之间最大均值差异的平方来度量真实样本与假样本之间的差异,越低的KID 参数表示两组样本之间越相似。Frchet Inception Dis⁃tance(FID)[23]指标使用Inception V3 模型来提取图像的高级语义信息,通过计算真实图像与生成图像提取特征向量后的均值以及协方差距离来衡量生成对抗网络生成图像的质量以及真假图像的相似性。当生成的图像与真实的图像特征越相近时,FID 数值越小。

3.4.2 模型复杂度评价

浮点运算Floating Point Operations(FLOPs)以及乘加运算Multiply Accumulate Operations(MACs)是常用的模型复杂度统计指标,它们能够统计数据通过网络模型所需要计算量的大小,即启用该模型时所需要的计算力。Parameters 模型参数量也是描述模型复杂度的指标之一,Times 为模型运行时实际消耗时间而Memory 为模型训练时占用的实际显存空间,三者的数值越小,代表模型越优越。

3.5 消融实验

图6 为有无本文专用注意力机制引导的生成器、鉴别器以及背景掩码的循环一致性损失函数对生成图像的影响。在上述选项中,无本文专用注意力机制引导的生成器、鉴别器分别表示使用CycleGAN 的生成器、鉴别器,而无背景掩码的循环一致性损失函数则表示不引入本文所设计的背景掩码的循环一致性损失函数。

图6 有无本文生成、鉴别器以及背景掩码循环一致性损失函数对生成图像质量的影响。(a)原图;(b)无专用注意力引导的生成器;(c)无专用注意力引导的鉴别器;(d)无背景掩码循环一致性损失函数;(e)三者都有。Fig. 6 Effect of the generated image’s quality that with or without our generator,discriminator and cycle consistency loss function background mask. (a)Original image;(b)Generator without special at⁃tention-mechanism guided;(c) Discriminator without special attention-mechanism guided;(d)Without cycle consistency loss function of back⁃ground mask;(e)All of three factors.

由图6(b)可以观察到,当不使用本文的专用注意力引导的生成器时,图像的背景会被大幅度地修改,且前景目标的生成质量非常低。而当不使用本文的专用注意力引导的鉴别器时,在训练过程中,当鉴别器无法分辨生成器所生成的前景目标时,就会通过背景元素进行判断,这时候鉴别器也会引导生成器生成背景元素,如图6(c)所示,由于判别器对背景中的天空和海水进行判断,所以引导了生成器生成虚假的内容。由图6(d)观察到,当不引入背景掩码的循环一致性损失函数时,注意力掩码器所生成的背景掩码图会不完整地覆盖前景目标又或者覆盖无关的背景区域,从而使得生成器生成虚假的背景元素又或生成不完整的前景目标。

由图6(e)可以观察到,使用本文的专用注意力机制引导生成器、鉴别器以及有背景掩码循环一致性损失函数时模型生成的图像质量最好。

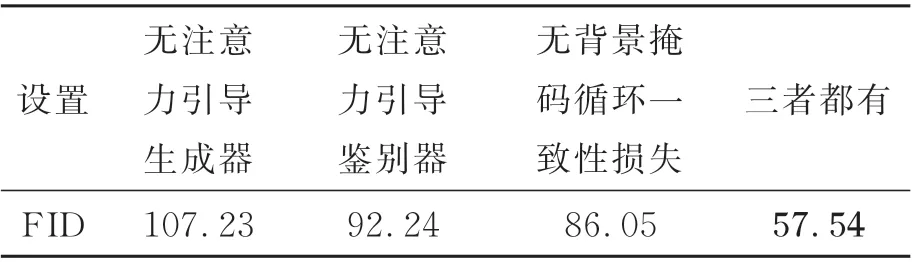

表2 给出了有无专用注意力引导的生成器、鉴别器以及背景掩码循环一致性损失函数以及对生成图像质量的量化参数FID 的影响。在本项测试中,FID 越小代表图像质量越高,并且生成的图像与真实的图像越相似,可以观察到,当模型三者都拥有时能够取得最小的FID 指数。

游戏板块的选股并不容易。A股中的游戏公司经过几轮下跌后,PE的角度看已经十分可观,甚至作为一个轻资产行业,部分企业PB也有一定的吸引力。然而,市场对于A股游戏公司的财务状况普遍存在不信任,认为行业财务舞弊风险较高,纯内容产业面临较大的业绩不确定性,此外高商誉问题依旧存在。因此,投资者切勿以某只游戏股的PE或别的估值指标极低便选择入场,这也是过去两年时间国内游戏股深套一批投资者的重要原因。

表2 在马转斑马任务上模型的消融研究Tab.2 Ablation studies of models on the horse-to-zebra task

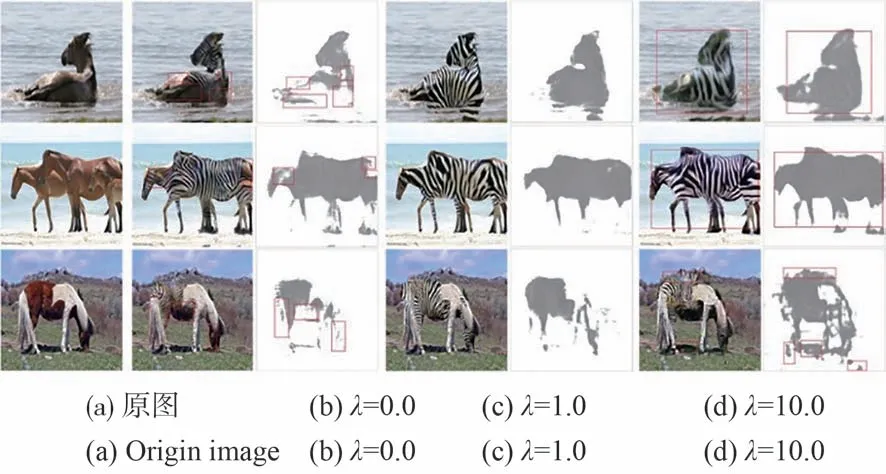

图7 给出了不同背景掩码循环一致性损失函数的λ系数在马转斑马任务上对生成图像质量的影响。由图7 可以观察到,当λ=0.0 时,模型生成的前景目标以及背景掩码不够完整,又或者将背景元素引入到了生成图像中,降低了图像的质量;当λ=1.0 时,模型生成的前景目标以及背景掩码最优,此时的生成图像质量最好;当λ=10.0时,由于过大的权重,降低了模型生成图像的清晰度以及产生了失真的色彩,并且使得模型生成了过大的前景目标掩码图。

图7 不同的λ 系数在马转斑马任务上对生成图像质量的影响Fig. 7 Effect of different λ-factors on the quality of the generated images on the horse-to-zebra task

表3 给出了不同背景掩码循环一致性损失函数的λ系数对模型生成图像质量量化参数FID 的影响,其中,FID 参数越低越好。

由表3 可以观察到,当λ=1.0 时,模型生成图像的FID 参数最低,此时的图像生成质量最优。

表3 不同λ 系数对图像生成质量的影响Tab.3 Effect of different λ-coefficients on the quality of the generated images

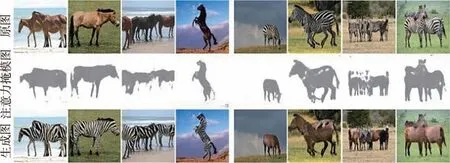

图8 和图9 展示的是本文模型在不同的转换任务上注意力掩码图生成器所生成的背景掩码图以及生成器生成的最终效果图。

图8 本文模型在苹果转橘子和橘子转苹果任务上生成的注意力掩码以及生成效果Fig. 8 Attention mask and images generated by ours model on the apple to orange and orange to apple tasks

图9 本文模型在马转斑马和斑马转马任务上生成的注意力掩码以及生成效果Fig. 9 Attention mask and images generated by ours model on the horse to zebra and zebra to horse tasks

由图8 和图9 可以观察到,本文模型能够准确地识别到需要转换的前景目标,做到修改前景目标的同时能够维持原背景图像不变,最大程度地提升了生成图像的质量。

3.6 量化结果

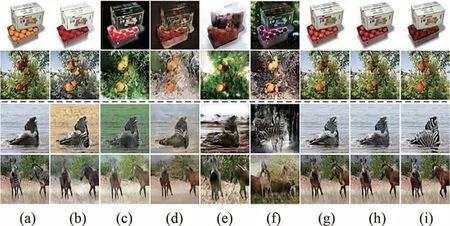

图10 是不同模型在马与斑马互相转换任务上的效果图。由图10 可以观察到,RA、Disco⁃GAN、UNIT、DualGAN、CycleGAN 等模型在生成前景目标的同时也对背景进行了转换,这大幅降低了模型所生成的图片质量。在复杂的无匹配图像转换任务上,这类模型所生成的图像质量更低,而带有注意力机制的模型,如UAIT、At⁃tentionGAN 等模型则只改变或者轻微改变背景元素,提升了生成图像的质量。

图10 不同模型在马与斑马互换任务上的表现。(a)原图;(b)CycleGAN;(c)RA;(d)DiscoGAN;(e)UNIT;(f)DualGAN;(g)UAIT;(h)Attention⁃GAN;(i)本文模型。Fig. 10 Performance of different models on the horse-ze⁃bra interchange task.(a)Original image;(b)Cy⁃cleGAN;(c)RA;(d)DiscoGAN;(e)UNIT;(f)DualGAN;(g)UAIT;(h)AttentionGAN;(i)Ours.

由于UAIT 等模型引入了独立的通用注意力机制结构,大幅增加了模型的复杂度。虽然AttentionGAN 模型提出的注意力机制与生成器共享参数层的结构,减少了模型的参数,但是,由于无基于注意力机制引导的鉴别器,使得生成器生成了许多虚假的幻纹,而本文提出的基于专用注意力机制引导的生成对抗网络不仅能够抑制和减少虚假的幻纹的生成,并且进一步缩小了模型的结构以及提升了生成图像的质量。

图11 是不同模型在自拍照与漫画脸转换任务上的效果图,可以观察到,本文的模型不仅能够仅转换前景目标区域图像,亦可以修改整张图像。由图11(h)的脸型、头发可以观察到,本文的模型能够最大程度地保留原有的语义信息的基础上来对图像进行转换。

图11 不同模型在自拍与动漫互换任务上的表现。(a)原图;(b)CycleGAN;(c)UNIT;(d)MUNIT;(e)DRIT;(f)U-GAT-IT;(g)AttentionGAN;(h)本文模型。Fig. 11 Performance of different models on the selfie-anime interchange task.(a)Original image;(b)Cycle⁃GAN;(c)UNIT;(d)MUNIT;(e)DRIT;(f)U-GAT-IT;(g)AttentionGAN;(h)Ours.

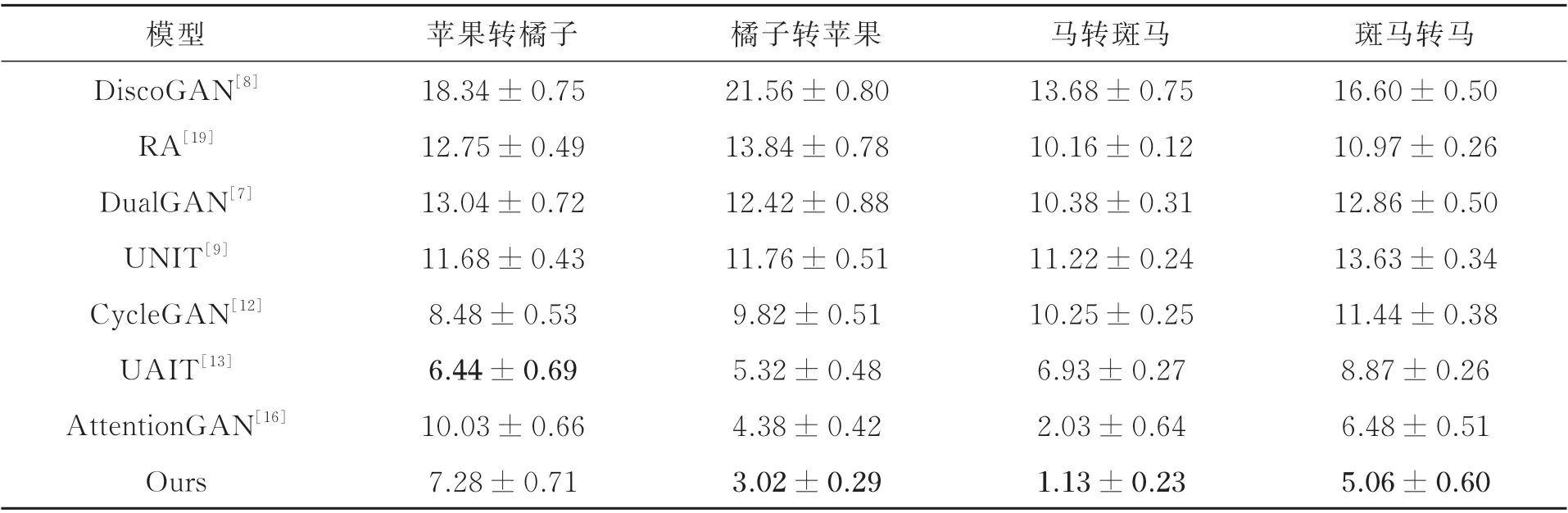

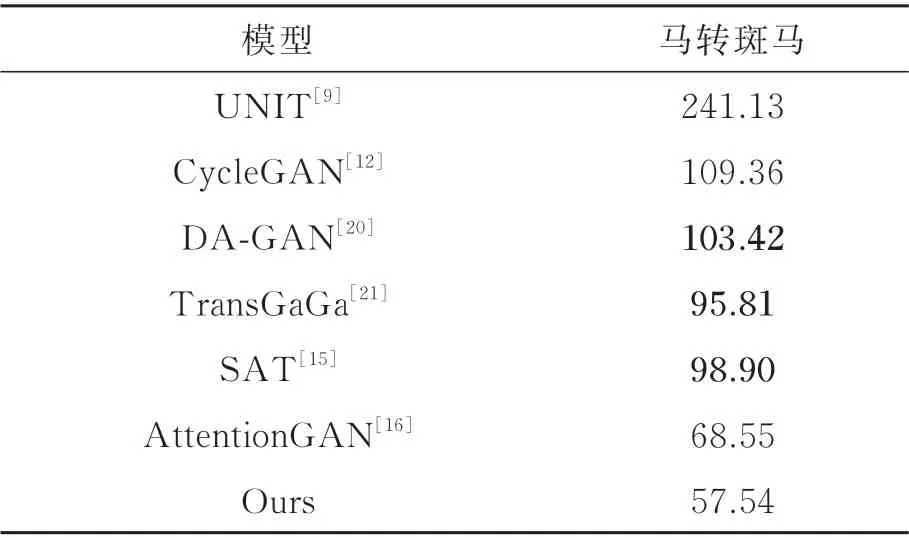

表4 是不同模型在马与斑马以及苹果与橘子转换任务的KID 指标,表5 是不同模型在自拍与漫画脸转换任务的KID 指标,表6 是不同模型在马与斑马转换任务上的FID 指标,其中,KID 与FID 的值越小,代表网络生成的图像与真实的图像越相似,生成图像质量越高,即数值越小越好。由表4~6 可知,本文的模型在不同的转换任务上都能取得最优的KID 以及FID 参数,即本文模型生成的图像与真实的图像最接近。

表4 不同模型在不同任务上的KID×100±std. ×100 指标Tab.4 KID×100±std. ×100 metrics for different models on different tasks

表5 不同模型在自拍转动漫任务上的KID×100±std.×100指标Tab.5 KID×100±std.×100 metrics for different models on selfie to anime task

表6 不同模型在马与斑马转换任务上的FID 指标Tab.6 FID metrics for different models on horse to zebra task

表7为基于注意力机制引导的各个模型的复杂度指标。由表7可知,与文献[14]相比,本文的网络模型参数量降低近32.8%,训练速度快34.5%。

表7 基于注意机制引导的不同模型复杂度分析Tab.7 Complexity analysis of different models guided by attention mechanism

得益于本文所提出的注意力掩码生成子模块与内容生成子模块高度共享参数的生成器结构,本文的模型复杂度最小,占用硬件显存资源最少,训练速度最快。

4 结 论

本文提出了一种新的用于无匹配图像转换任务的基于双专用注意力机制引导的循环生成对抗网络(Dual-SAG-CycleGAN)。生成器由端到端的、基于专用注意力机制引导的前背景掩码图生成子模块和内容图生成子模块所构成,两者高度共享权重参数。其中,前景、背景掩码图生成子模块的组成仅需要在原有的内容生成器结构中添加一个额外的卷积层以及Softmax 激活函数。为了引导前背景掩码生成子模块生成更加精准的掩码图以抑制生成器生成降低生成图像质量的无关背景内容,我们提出了背景掩码循环一致性损失函数并引入了基于CAM 专用注意力机制引导的判别器结构。

实验证明,本文结构不仅能够实现自动转换图像相关目标前景的功能,并且拥有更短的训练时间、更低的硬件开销、更好的生成图像质量。本文方法与现有同类模型相比,网络模型参数量降低近32.8%,训练速度快34.5%,KID 与FID 最低分别可达1.13、57.54,拥有更高的成像质量。

但是,由于本文的基于CAM 专用注意力机制引导的判别器不能非常精确地关注到感兴趣的区域,在某些复杂的场景上会以背景物作为判别依据,所以会导致生成器生成虚假的幻纹,这也是限制生成图像质量进一步提升的重要因素,所以,在后续的工作中,我们会重新设计一种新的判别器结构,设计一种识别能力更加精准的注意力机制模块来引导判别器,以提升判别器识别感兴趣区域的能力,使得网络生成图像的质量有更进一步提升。