民机飞行机组应急逃生设计混合现实仿真系统

2022-05-09吴程程袁新浩许澍虹

吴程程,吕 毅,袁新浩,许澍虹

民机飞行机组应急逃生设计混合现实仿真系统

吴程程1,吕 毅1,袁新浩2,许澍虹1

(1. 中国商用飞机有限责任公司北京民用飞机技术研究中心,北京 102211;2. 中国商用飞机有限责任公司上海飞机设计研究院,上海 201210)

开展民机飞行机组应急逃生仿真旨在飞机研制早期发现飞行机组逃生口设计的潜在问题,确保飞行机组成员的人身安全。提出了一种民机飞行机组应急逃生混合现实仿真系统设计方案,进行了系统搭建与实验验证。针对系统中人体虚实匹配的关键问题,提出一种光-惯混合追踪的全身人体运动捕捉方法,结合基于Kinect2图像识别的人体关键尺寸快速匹配技术,可以有效提升人体虚实匹配效率与鲁棒性。相关成果已应用于某型国产大型民机研制中,为飞行机组逃生口设计验证与评估提供了快速、有效的解决方案。

民机设计评估;混合现实;仿真系统;混合跟踪;虚实匹配

民机飞行机组逃生口设计是飞机研制中的重要环节[1],设计方案的合理性将直接影响飞行机组人员紧急状况下的安全撤离。适航条款CCAR-25要求,飞行机组逃生口的设计需满足身高158~190 cm的人员可以顺利逃生[2-3]。同时,逃生口的开口尺寸与位置会对机体结构强度、驾驶舱布局、气动特性等产生影响。因此,针对飞行机组逃生口设计的评估工作受到了飞机设计人员与适航当局的普遍关注[4-5]。在设计早期阶段提前开展飞行机组人员应急逃生仿真,能够尽早发现、弥补设计缺陷,降低飞机研制后期设计方案出现重大更改的风险,减少时间成本与经济损失。但是,飞行机组逃生口属于早期设计内容,设计方案需要进行多次迭代,因此需要提供一种灵活可变、快速高效的仿真手段。传统应急逃生仿真采用搭建实物模型的方式进行。通过采样不同身高的目标人群开展试验,验证设计方案的符合性与适航性。但对于大型民机复杂产品,实物制造难度大、周期长、成本高,且不能满足早期设计对方案快速迭代的需求。

近年来,虚拟仿真技术发展迅速,因其成本低、迭代快等优势,越来越多地应用于工程仿真[6-10]。目前应用较多的桌面式虚拟仿真工具有Delmia[11],Jack[12]和Ramsis[13]等,此类软件提供了符合人体尺寸分布的百分位数模[14-16]。然而,对于机组应急逃生这样复杂的运动,工程人员在进行虚拟仿真时需花费大量时间进行手动虚拟人动作姿态设定,不仅效率低,且仿真质量难以保证。这一问题在进行不同百分位人体数模的运动仿真时则会进一步加剧。由于无法在设定姿态时全面考虑人体运动特性以及受力情况等因素,仿真后的人体姿态与真人体姿态往往存在较大差异。

基于上述问题,本文提出了一种民机飞行机组应急逃生混合现实仿真系统设计方案。通过融合实物与虚拟仿真的优势,应用人体运动追踪技术,快速获取基于关键逃生物理支撑件的真人应急逃生运动姿态,并实时驱动虚拟人在虚拟逃生仿真场景中进行应急逃生仿真。其仿真方式保证了虚拟人动作的准确性,避免了因缺乏人体力学分析而导致的仿真结果不准确问题,且灵活可变、快速高效。所提方案完成了系统搭建与验证,相关成果成功应用于某民机型号研制中,得到设计人员认可,为飞行机组逃生口设计评估验证提供了新的技术手段。

1 系统总体设计

1.1 系统设计原理

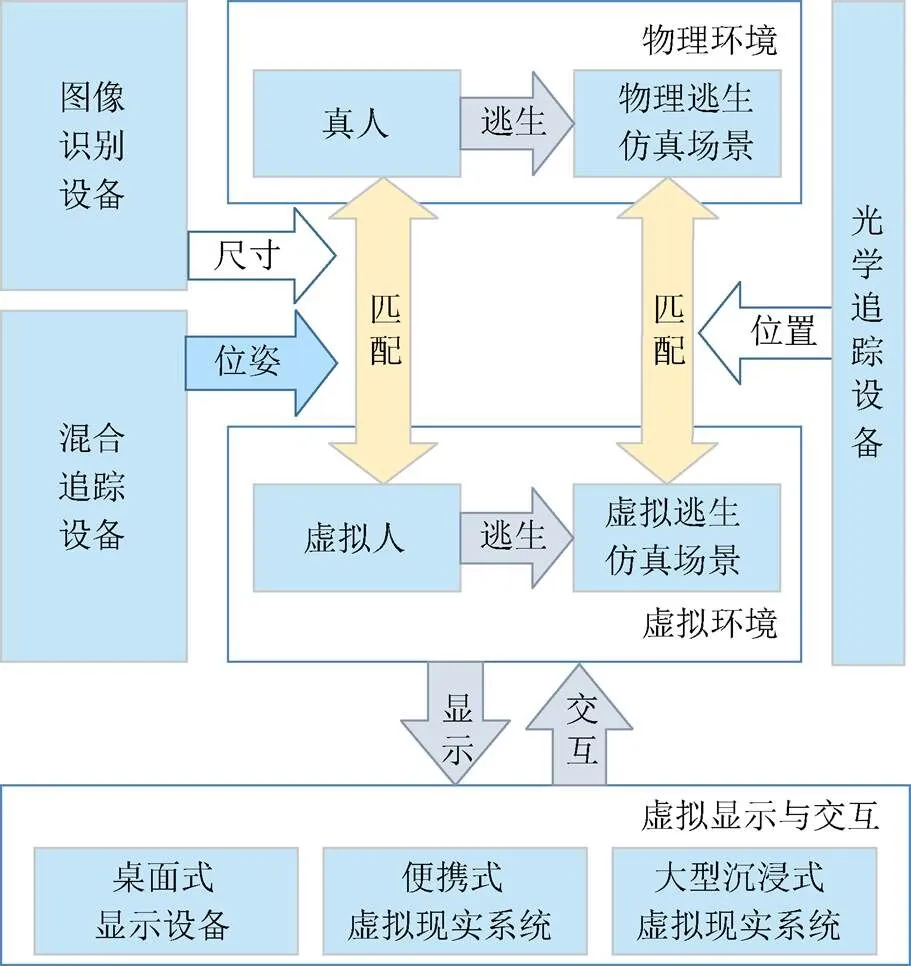

本文基于UE4开源平台进行开发,主要分为人体虚实匹配、逃生仿真场景虚实匹配、虚拟显示与交互3个部分,如图1所示。

图1 系统设计原理图

人体虚实匹配模块用于获取并驱动与真人尺寸一致的虚拟人,包含2部分功能:①为人体尺寸快速匹配,通过图像识别设备快速识别人体骨骼关节点,根据其位置计算出关键骨骼长度,并依次将结果输入虚拟系统中逐关节调整虚拟人模型,实现人体尺寸虚实匹配;②为虚拟人实时位姿匹配,其中位姿指的是位置与姿态。利用全身运动捕捉设备捕捉人体关节位姿信息,并实时驱动调整后的虚拟人进行运动仿真,实现虚拟人的虚实联动。

逃生仿真场景虚实匹配是在物理逃生仿真场景中搭建可调节的物理支撑架,作为虚拟逃生仿真场景中驾驶舱关键设备的实物替代,为真实逃生过程中提供物理支撑。利用光学追踪设备保证物理逃生仿真场景中与虚拟仿真场景中关键设备的位置保持一致。

虚拟显示与交互模块用于仿真结果地观看与评估,包含虚拟显示与虚拟交互2部分:①虚拟显示可分别在桌面式显示设备、便携式虚拟现实系统(简称VR头盔)以及大型沉浸式虚拟现实系统(简称CAVE系统)进行逃生仿真过程的三维显示;②虚拟交互具有逃生运动姿态录制,场景漫游以及第一/第三人称的视点切换功能,方便设计人员直观地发现设计中的缺陷,并进行离线分析。

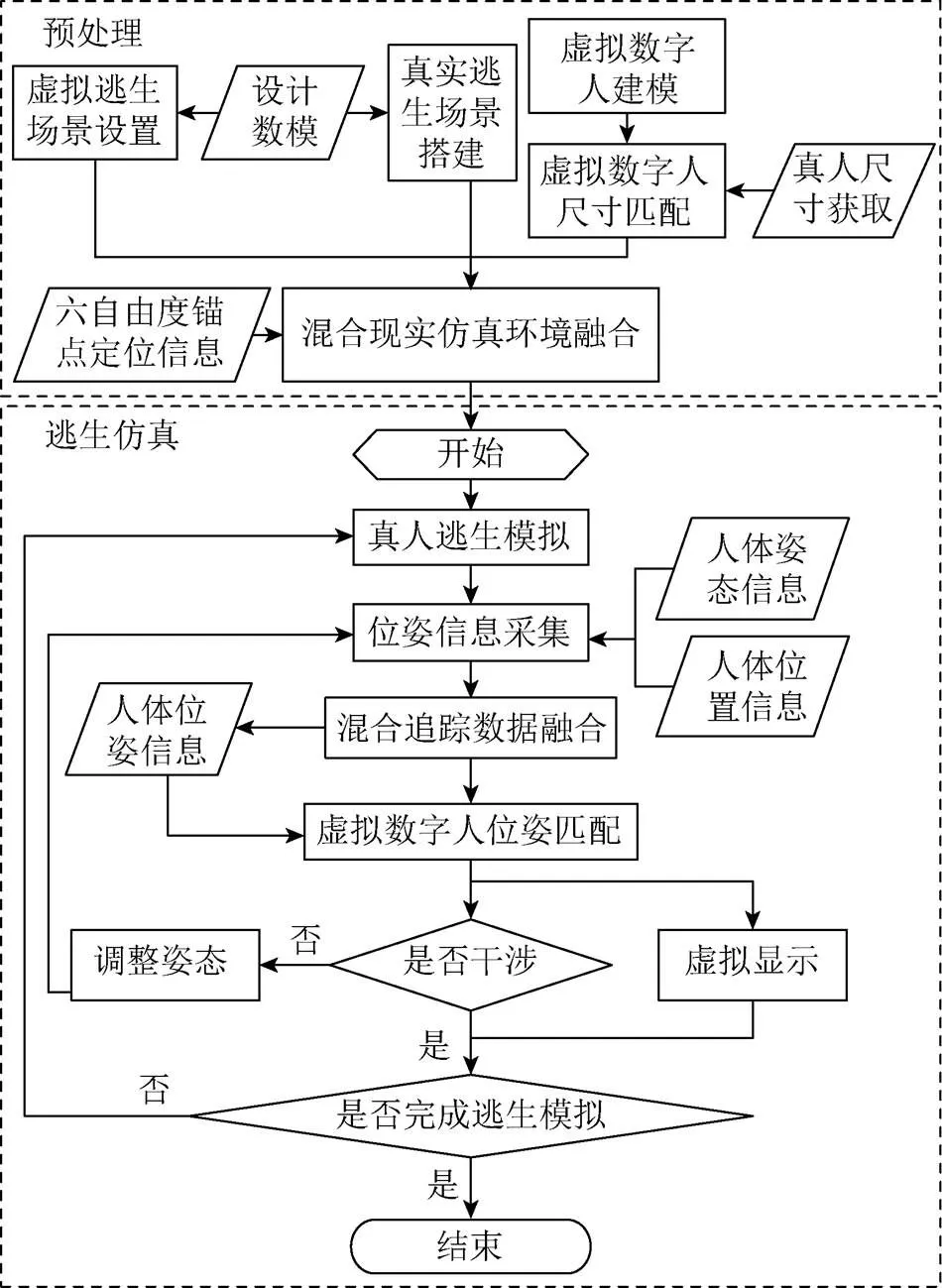

1.2 系统仿真流程

系统仿真流程可分为预处理与逃生仿真2部分,如图2所示。预处理是在进行正式仿真之前开展的准备工作。首先,将飞机设计人员提供的设计数模导入软件系统,构建虚拟逃生仿真场景,并根据数模进行可调节物理支架的设计与搭建,完成物理逃生仿真场景;其次,建立带有运动骨骼的虚拟人模型,并基于Kinect2图像识别设备自动获取人体关键尺寸参数,调整虚拟人的关键尺寸以快速匹配真人,确保虚实尺寸一致;然后,采用光学锚点(固定式被动光学跟踪标记点)定位信息匹配虚拟场景与物理场景的坐标系,将虚拟逃生仿真场景、物理逃生仿真场景、虚拟人以及真人进行混合现实仿真环境的融合,实现虚实匹配,保证后续开展逃生仿真的准确性。

图2 系统仿真流程图

在预处理的基础上,开始进行逃生模拟,真人在物理逃生场景中进行逃生,可通过惯性与光学2种人体运动捕捉设备,采集其位姿信息并进行混合追踪数据的融合;基于融合后的人体位姿信息,将虚拟人与真人的位姿进行实时匹配,实现虚拟人在虚拟逃生场景中进行同步运动;此过程中,真人可通过虚拟显示与交互功能进行实时地多角度观察,若发现与逃生场景中的设备发生干涉,可立即调整逃生姿态,做出可满足设计方案得出逃生动作,直到得出能否逃生成功的结论,该逃生模拟结束。

若进行不同体型的真人逃生仿真,该系统可快速响应。只需获取并输入该人的人体关键尺寸,系统将自动调整虚拟人人体尺寸并快速匹配,真人穿戴上人体运动捕捉设备即可进行逃生模拟,系统可将不同的逃生模拟样本进行存储并用于后续显示与分析。

由于该仿真系统通用性强,如果在前一次逃生仿真中发现设计缺陷,软件系统可快速导入修改后的设计方案并处理。同时,可调节物理支架可根据设计方案立即进行关键设备的尺寸与位置调整,达到快速逃生仿真的目的。

2 系统关键技术

应急逃生仿真过程中,虚拟人在虚拟环境中的逃生情况是评估逃生口设计合理性的重要依据。虚拟人的逃生实际是由真人在真实环境中实时驱动的。为了保证逃生仿真的准确性,提高仿真效率,需要快速、准确地进行人体虚实匹配。其实质是虚拟人的人体关键尺寸及位姿与真人保持一致。该技术实现的挑战在于快速匹配人体关键尺寸以及更准确、更稳定的全身人体运动捕捉。为此,本文提出了基于Kinect2图像识别的人体关键尺寸快速匹配方法及基于混合追踪的全身人体运动捕捉方法。

2.1 基于Kinect2图像识别的人体关键尺寸快速匹配方法

虚拟人与真人在人体尺寸不一致可能导致仿真误差,因此需要在预处理过程中将虚拟人与真人的人体尺寸进行一比一匹配。人体尺寸的匹配核心在于获取真人骨骼长度。传统方式是人工测量,依靠人的经验定位出人体骨关节点并依次测量,再将尺寸手动输入软件进行虚拟人的人体尺寸调整。为了提高测量效率,本文采用Kinect2图像识别技术对人体骨关节的空间位置信息进行自动化识别与采集,跳过了人工测量与手动输入参数等环节,减少预先测量与操作时间。被测者无需穿戴任何设备,只需静止站立于设备前1~2 s,系统便可快速计算出真人的人体尺寸并自动对虚拟人进行尺寸调整。

应急逃生仿真更偏重于人体大关节尺寸的准确性。根据仿真需求与人体运动特性,采用如图3所示的人体骨骼节点。选择骨骼节点Spine Base作为树形模型的根节点[17],其他关节点依次连接形成树形结构,根节点的参数是位于世界坐标系的方向,其他节点的参数是相对上一点的旋转角。

图3 人体骨骼关键节点树

通过Kinect2的SDK开发包中的API函数获取到的各个人体骨骼关键节点的实时位置信息。如图4所示,被测者采用Tpose站立于Kinect2设备前,利用该设备采集有效骨关节点的位置信息并输入系统软件中。算法基于图5中的关节树依次遍历每个骨关节与其上一节点的空间坐标信息,得到相应的关键骨骼长度,并获取到虚拟人的人体所对应每一个关节点在虚拟空间中的位置P,以及根据图3中人体骨骼关键节点树所示的每个关节点与其对应的上一节点在虚拟空间中的位置P,根据式(1)求得与真人的人体匹配后骨关节的虚拟空间位置点,即

将其赋予虚拟人的对应骨关节点。按上述方法,每一骨关节依次遍历完成后,得到了一比一人体尺寸匹配后的虚拟人。

图4 Kinect2下识别的人体骨骼关节点

Fig. 4 Human bone joints recognized by Kinect2

图5 惯性系统攀爬漂移示意((a)动作前;(b)动作后)

通过测试,整个测量过程不超过1 min,与手动测量相比,测量效率至少提高了20倍。

2.2 基于光-惯混合追踪的全身人体运动捕捉方法

高精度全身人体运动捕捉是进行精准人体驱动的基础。目前,主流的全身人体运动捕捉系统主要分为基于光学[18]和基于惯性[19-20]2类。光学运动捕捉系统精度高,但易受实物遮挡,鲁棒性较差;惯性运动捕捉系统不受遮挡影响且姿态信息精准,但存在位置积分的误差累积,精度难以满足需求,特别是在攀爬过程中出现双脚离地的情况下,由于位置积分算法依赖脚步与地面的接触,进行这一动作后会使整体位置漂移,无法满足应用需求,具体如图5所示。

针对混合现实场景下的全身人体运动捕捉,单一运动捕捉系统无法满足需求。基于这一问题,本文采取光-惯混合追踪的方式,综合利用光学与惯性的优势特性,实现高精度、高鲁棒性的全身人体运动捕捉。此方法从宏观与局部2个维度进行混合,宏观上采取惯性捕捉全身姿态信息,光学捕捉人体根节点位姿信息,这能最大程度上减小了惯性器件位置积分的累积误差与光学捕捉的遮挡影响。局部上,针对根节点的位姿追踪,采取了更加深度的融合策略,在光学靶点未全部丢失的情况下,利用光学进行人体根节点的位置追踪,代替惯性设备输出的位置信息作为融合处理后的位置追踪结果,并且对惯性位置信息进行校正,消除其累计误差;在光学靶点完全丢失的状态下,使用校正后的惯性位置作为融合后的位置输出,保证在遮挡情况下的追踪鲁棒性。

本文提出的光-惯混合追踪方式采用了光学和惯性2套运动捕捉系统,如图6所示,需要分别采集运动捕捉数据,通过开发的通讯接口实时进入软件系统中,并进行后续的数据融合处理。

图6 光学-惯性混合的追踪系统

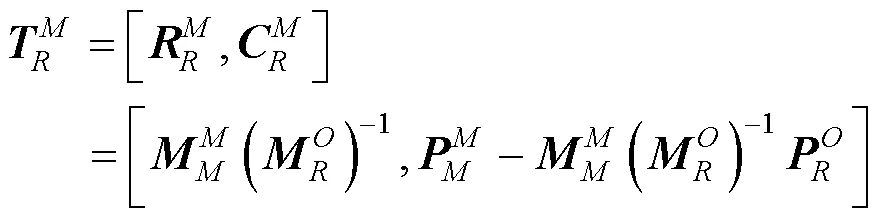

在光学靶点未全部丢失的情况下,数据融合处理的实质是利用光学设备进行人体根节点位置捕捉,利用惯性设备进行人体关节姿态捕捉,通过在物理环境(R)、Optitrack系统(O)、MVN系统(M)以及虚拟环境(V)之间进行追踪数据的坐标转化与匹配,实现数据融合。

其中,为旋转矩阵;为平移矩阵。

在光学靶点完全丢失的情况下,启用惯性实时追踪数据,给系统提供全部六自由度信息。同时,为解决惯性元件位置积分累积误差的问题,使用光学追踪数据实时修正惯性位置追踪结果,在光学靶点没有完全丢失的最后时刻,将当前惯性位置追踪结果直接置为光学追踪结果,从而消除此前的累积误差,实现了精度提升,其计算式为

光-惯数据融合后,实时的将姿态数据输入给虚拟人分别控制其对应的人体骨骼关键节点旋转,而位置数据控制虚拟人体的根节点位移,从而使虚拟人跟随真人进行实时运动,实现人体的虚实匹配。

3 系统实现与实验结果

3.1 逃生仿真场景虚实匹配

逃生仿真场景虚实匹配是通过设计并搭建可调节物理支架,利用六自由度锚点定位方法,将物理仿真环境与虚拟仿真环境中关键尺寸以及设备的相对位置进行完全匹配,以保证逃生仿真的准确性。

本系统设计了可调节物理支架,如图8(a)所示,即可对构建的支架进行,,轴自由度的位置调整,包括逃生口开口的尺寸及位置,观察员控制台的高度及位置,及观察员座椅椅面1位置与椅背2高度及位置。在前期试验过程中发现观察员控制台,观察员座椅椅面1位置与椅背2能够满足踩踏需求,逃生口开口外沿部分能承受人的手臂支撑,整个物理支架满足攀爬过程中的安全性与稳定性要求。

图8 虚拟与物理逃生仿真场景虚实匹配((a)虚拟场景;(b)物理场景)

支架搭建后,需要保证其关键尺寸、位置与虚拟逃生仿真场景中的相对应设计数模保持一致。如2.2节所述,可利用光学捕捉设备与被动光学标记点,能够准确获取到空间中任一点的位置这个特性,本文采用光学锚点定位方法进行逃生仿真场景的虚实匹配。

首先,确定虚拟坐标原点位置,在虚拟场景中,设置观察员桌椅椅面右上角为坐标原点,其坐标系定为左手坐标系。然后,根据虚拟场景原点位置确定真实场景中对应的原点及其坐标系。其次,将光学锚点分别贴在原点、椅背2平面、观察员控制台上表面以及逃生口开口4个角上,如图8(b)所示,保证真实场景下可提供力学支撑的物理件与虚拟场景中相应设备的位置保持一致。通过光学捕捉设备获取到各个光学锚点的空间位置信息,逐一与虚拟场景中的位置进行匹配,完全吻合后进行固定,以此方法完成物理逃生仿真场景的搭建,实现虚拟与真实的逃生仿真场景虚实匹配。

3.2 虚拟显示与交互功能实现

根据逃生仿真的设计需求,需要进行在线和离线状态下的虚拟显示与交互。其中,在线显示与交互是由于试验人员在进行逃生运动时,需通过观察虚拟人在虚拟仿真场景中的干涉情况,调整合适的逃生姿态。此外,利用虚拟交互外设设备能够在虚拟仿真场景中进行漫游,便于从多角度观察干涉情况。离线显示与交互是为了设计人员在进行方案更改与讨论时,能通过沉浸式显示方式更加真实地感知到设计方案对机组逃生的影响,方便进行设计方案的更改与确认。综上所述,开发了基于UE4开源平台的桌面式(LED显示器)实时显示,便携式(VR头盔)虚拟现实以及大型沉浸式(CAVE系统)虚拟现实3个版本的软件工具。

桌面式实时显示软件的主要功能包括虚拟逃生仿真场景的建立、基于c++的全身人体运动捕捉数据获取与融合、虚拟人实时驱动、虚拟交互中的漫游以及虚拟场景的实时渲染与显示等,软件运行效果如图9(a)所示。

便携式虚拟现实软件的优势在于能够让设计人员进入该虚拟仿真环境,并可通过VR交互手柄进行虚拟场景漫游及第一/第三人称眼点切换。VR头盔显示形式具有轻巧方便、易携带的特点,便于异地、多部门的沟通。其中,第一/第三人称眼点切换功能指的是2种在虚拟场景中的不同观察方式:第一人称是指观察者作为机组人员站在观察员控制台上,对逃生口的开口尺寸与位置进行观察,直观感受并预判逃生难度;第三人称是指观察者作为旁观者从多角度对虚拟人的整个逃生过程进行观测,便于对设计方案进行详细分析,快速确认设计方案的合理性。该软件是基于SteamVR对HTC VIVE头盔进行了开发,此软件功能在桌面式软件功能的基础上开发了第一/第三人称眼点切换与手柄漫游以及交互功能,并利用Animation Sequences进行动作序列录制,完成后放入虚拟场景中,可在显示设备中进行离线观测,效果如图9(b)所示。

大型沉浸式虚拟现实系统是专业级的虚拟现实设备,具有高真实、全沉浸式的特点。与VR头盔相比,此系统显示方式使观测者能够看到物理世界,因此对于设计方案的观测可融入实物对比,更加直观,并且该系统能够容纳多人同时观看,便于多部门进行设计方案的讨论。应用于CAVE系统的软件需要具有多通道立体渲染功能。为了提高实时渲染速率采用被动立体渲染方式。本系统基于UE4平台的nDisplay模块进行功能扩充,通过增加节点眼位配置接口与节点显示方式接口,使节点渲染管理类获取相应眼位信息及被动模式渲染命令,执行被动立体渲染驱动类,调用相应单画面渲染基础功能模块,实现左右眼渲染分别输出功能,实现结果如图9(c)所示。

图9 虚拟显示与交互功能实现((a)桌面式混合现实仿真结果实时显示;(b)基于VR头盔的第一/第三人称眼点切换功能;(c)多通道被动立体渲染功能实现结果)

3.3 实验结果

混合现实仿真系统搭建完成后,开展了2组系统验证实验。

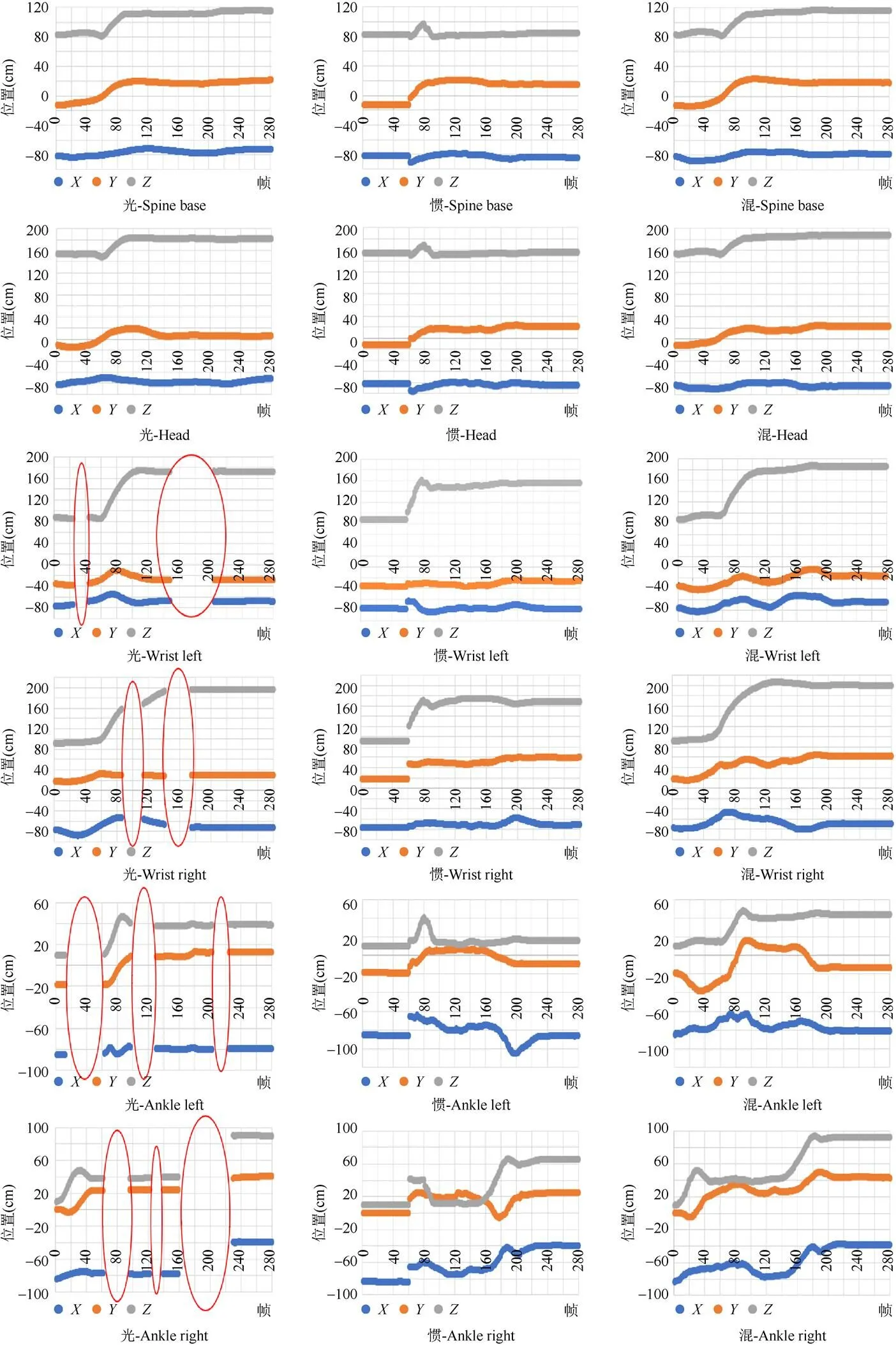

实验1.对本文提出的基于光-惯混合追踪的全身人体运动捕捉方法在混合现实环境下进行测试。实验内容是真人利用搭建后的物理支架进行逃生过程中的攀爬运动。由于多次攀爬运动时,人体关节角度无法保持一致,因此实验针对运动过程中的全身关键运动关节位置进行记录。预先设定攀爬过程中人体接触物理支撑件的位置并做好标记,实验人员基于标记点做同样3组姿态的攀爬运动,分别利用光学追踪、惯性追踪和本文提出光-惯混合追踪方式进行全身人体运动捕捉,并将捕捉后的位置数据进行了对比,如图10所示。其中,纵坐标代表位置,横坐标代表虚拟人跟随真人运动的动画刷新帧序列。光、惯、混分别代表了利用光学、惯性及光-惯混合追踪所获取人体关节点的运动位置数据。其中,根节点Spine Base、头部关节点Head、左腕关节Wrist Left、右腕关节Wrist Right、左踝关节Ankle Left以及右踝关节Ankle Right的位置追踪数据用来表征全身人体运动捕捉的稳定性与准确性的特点。

通过图10红圈部分数据可以看出,由于存在物理遮挡,导致光学运动捕捉系统部分关节点动捕数据丢失,捕捉的鲁棒性无法满足应用需求,但由于光学追踪精度较高[21-22],因此在这里认定未丢失的捕捉结果作为后续2种捕捉方式的结果标准对照值。惯性运动捕捉系统从图中明显看出位置变化趋势与光学追踪结果相差较大,存在位置追踪不准确的问题。本文提出的光-惯混合追踪方法和光学相比,稳定性大幅提高,且相较于惯性的准确性上也有明显的提升。

实验表明,本文方法在混合现实环境下可以有效捕捉全身人体运动,相比与其他方法能够有效保证追踪的稳定性及鲁棒性。

实验2. 通过传统的民机设计虚拟仿真软件Delmia以及利用集成后的混合现实仿真系统开展应急逃生仿真。

首先,专业虚拟仿真人员利用传统的Delmia V5虚拟仿真软件,花费近6 h,建立了将近50个关键帧,仿真了数字人攀爬逃生的过程,如图11所示。通过仿真得到可行的逃生路线为站立于观察员控制台,然后通过踩踏储物柜,并利用手部支撑飞机逃生口外力面,共同向上使力,攀爬出逃生口。

图10 光学、惯性动捕系统与光-惯混合追踪方法对比

图11 基于Delmia虚拟仿真软件的逃生仿真

利用混合现实仿真系统开展仿真实验。根据Delmia得到的逃生路线,进行逃生仿真发现,由于人体向后倾斜角度过大,真人无法完成如图11所示的攀爬姿态。实验逃生人员改变逃生路线策略,将踩踏储物柜改成踩踏观察员桌椅椅背,发现该方式可以逃生成功,并且发现若在椅背高度位置附近设计逃生脚踏,增大可踩踏接触面,并缩短逃生口与第二落脚点的水平距离,可使逃生更加省力并节省逃生时间。整个试验过程包括穿戴全身人体运动捕捉数据衣,校正动捕设备以及逃生仿真过程只需20 min,可快速进行逃生过程的模拟,具体逃生实验过程如图12所示。从图中可以看出,基于本文方法结合基于Kinect2图像识别的人体关键尺寸快速匹配方法可以对人体尺寸与人体姿态进行快速、有效地虚实匹配。且该仿真系统能在真人逃生实验过程中可实时在虚拟环境中看到虚拟人的逃生过程,若发现虚拟人与虚拟场景发生干涉,能及时调整真人逃生姿态。虚拟人能否顺利攀爬出逃生口可有效评估逃生口设计的合理性。

图12 基于混合现实的应急逃生仿真((a)初始位姿脚部虚实匹配;(b)右脚踩踏椅背虚实匹配;(c)上半身攀爬姿态虚实匹配;(d)全身攀爬姿态虚实匹配)

该实验结果表明传统的虚拟仿真软件方式的仿真可靠性与设计人员仿真经验相关,且存在数字人可完成的人体姿态,真人无法实现的情况。而通过混合现实仿真系统开展民机飞行机组应急逃生仿真在保证仿真准确性的同时,大大提高了仿真效率。

4 结束语

通过搭建民机飞行机组应急逃生混合现实仿真仿真系统,开展了飞行机组应急逃生仿真研究。采用基于Kinect2图像识别的人体关键尺寸快速匹配技术与基于本文方法进行人体虚实匹配,通过逃生仿真场景虚实匹配及开发的虚拟显示与交互软件系统,快速实现了应急逃生仿真。实验表明,本文方法能在设计早期有效开展应急逃生仿真,相较于传统仿真方法,能有效提高仿真效率,保证仿真的准确性。本文方法目前已应用于现有型号中的飞行机组逃生口设计评估,且应用的混合现实仿真方案具有通用性的特点,可应用于大型复杂装备的设计方案评估,可达性、可维修性检查等方面。

[1] 严立浩, 张洁, 孙稳, 等. 民用飞机驾驶舱应急逃生出口设置适航要求研究[J]. 民用飞机设计与研究, 2018(2): 126-130.

YAN L H, ZHANG J, SUN W, et al. Airworthiness study of flightcrew em ergency exits arrangem ent[J]. Civil Aircraft Design & Research, 2018(2): 126-130 (in Chinese).

[2] 中国民用航空总局. CCAR25 R4-2011中国民用航空规章第25部运输类飞机适航标准[S]. 北京: 中国民用航空总局, 2011.

Civil Aviation Administration of China. CCAR-25-R4-2011 China civil aviation regulations, part 25 airworthiness standard for transport aircraft[S]. Beijing: Civil Aviation Administration of China, 2011 (in Chinese).

[3] Fedral Aviation Administration. AC25 17A-2009 transport airplane cabin interiors crashwonlriness handbook[S]. Washington: Fedral Aviation Administration, 2009.

[4] 董大勇, 俞金海, 李宝峰, 等. 民机驾驶舱人为因素适航符合性验证技术[J]. 航空学报, 2016, 37(1): 310-316.

DONG D Y, YU J H, LI B F, et al. Airworthiness compliance certification technology of civil aircraft flight deck human factor[J]. Acta Aeronautica et Astronautica Sinica, 2016, 37(1): 310-316 (in Chinese).

[5] NIU X Y, LIU Z, ZHANG J J, et al. Integrated cockpit simulation design for civil aircraft alerting system[C]//The 2019 International Conference on Electronical, Mechanical and Materials Engineering. Paris: Atlantis Press, 2019: 76-79.

[6] 王巍, 高雪松, 穆志国, 等. 人机工程仿真技术在飞机零组件装配中的应用[J]. 航空制造技术, 2017, 60(9): 92-96.

WANG W, GAO X S, MU Z G, et al. Application of man-machine engineering simulation technology in aircraft component assembly[J]. Aeronautical Manufacturing Technology, 2017, 60(9): 92-96 (in Chinese).

[7] 朱妍如. 基于DELMIA的某型民机后机身装配仿真[D]. 哈尔滨: 哈尔滨工业大学, 2018.

ZHU Y R. Simulation of rear fuselage assembly of a civil aircraft based on DELMIA[D]. Harbin: Harbin Institute of Technology, 2018 (in Chinese).

[8] SALLEH N A M, KASOLANG S, MUSTAKIM M A, et al. The study on optimization of streamlined process flow based on delmia quest simulation in an automotive production system[J]. Procedia Computer Science, 2017, 105: 191-196.

[9] KAMAT S R, HAFIZ M, HAMID A, et al. Ergonomics study of working postures in demould process at aerospace manufacturing[C]//International Conference on Design an Concurrent Engineering 2017 & Manufacturing System Conference. Amsterdam: Elsevier Press, 2017: 8-11.

[10] 张开运. 基于DELMIA的三维模型属性数据提取及重构的研究[J]. 装备制造技术, 2018(1): 119-122.

ZHANG K Y. Research on extraction and reconstruction of 3D model attribute data based on DELMIA[J]. Equipment Manufacturing Technology, 2018(1): 119-122 (in Chinese).

[11] 李保和. 舰船设备维修人机工效量化评估关键技术研究[D]. 武汉: 华中科技大学, 2019.

LI B H. Research on key technologies of quantitative evaluation of ergonomics for warship equipment maintenance[D]. Wuhan: Huazhong University of Science and Technology, 2019 (in Chinese).

[12] 代明远, 路易霖, 王硕, 等. 基于虚拟现实的工程机械人机工程设计研究进展[J]. 机械设计, 2020, 37(7): 116-123.

DAI M Y, LU Y L, WANG S, et al. Research progress on engineering mechanical ergonomic design based on virtual reality technology[J]. Journal of Machine Design, 2020, 37(7): 116-123 (in Chinese).

[13] 王洪宝, 王金, 支锦亦, 等. 基于RAMSIS仿真的高速列车驾驶界面人机工效评估[J]. 机械设计, 2020, 37(1): 128-134.

WANG H B, WANG J, ZHI J Y, et al. Ergonomic evaluation of high-speed train driving interface based on RAMSIS simulation[J]. Journal of Machine Design, 2020, 37(1): 128-134 (in Chinese).

[14] BERG L P, VANCE J M. Industry use of virtual reality in product design and manufacturing: a survey[J]. Virtual Reality, 2017, 21(1): 1-17.

[15] ERKOYUNCU J A, DEL AMO I F, DALLE MURA M, et al. Improving efficiency of industrial maintenance with context aware adaptive authoring in augmented reality[J]. CIRP Annals, 2017, 66(1): 465-468.

[16] AZIZ F A, ALSHAMMAR M, ARIFFIN M K A. Using virtual reality for equipment maintenance in oil and gas industry[J]. Journal of Computational and Theoretical Nanoscience, 2018, 15(4): 1090-1094.

[17] 王磊. 视频人体运动的检测跟踪与识别[D]. 上海: 上海交通大学, 2017.

WANG L. Visual detection, tracking and recognition of human motion in video[D]. Shanghai: Shanghai Jiaotong University, 2017 (in Chinese).

[18] ŠOLONY M. Optical motion capture system [EB/OL]. [2021-10-11].https://www.optitrack.com/.

[19] WOUDA F, GIUBERTI M, BELLUSCI G, et al. Estimation of full-body poses using only five inertial sensors: an eager or lazy learning approach?[J]. Sensors, 2016, 16(12): 2138.

[20] XSENS. MVN Inertial Motion Capture System[EB/OL]. [2021-10-11]. https://www.xsens.cn/MVN.

[21] 黄波士, 陈福民. 人体运动捕捉及运动控制的研究[J]. 计算机工程与应用, 2005, 41(7): 60-63.

HUANG B S, CHEN F M. Research on human body motion capture and motion control[J]. Computer Engineering and Applications, 2005, 41(7): 60-63 (in Chinese).

[22] 王军, 胡永刚, 韩崇昭. 被动式光学运动捕捉系统丢点检测与补偿[J]. 系统工程与电子技术, 2012, 34(11): 2374-2378.

WANG J, HU Y G, HAN C Z. Detection and rectification for missing markers in passive-optical motion capture system[J]. Systems Engineering and Electronics, 2012, 34(11): 2374-2378 (in Chinese).

Mixed reality simulation system for emergency escape design of civil aircraft flight crew

WU Cheng-cheng1, LYU Yi1, YUAN Xin-hao2, XU Shu-hong1

(1. COMAC Beijing Aircraft Technology Research Institute, Beijing 102211,China; 2. COMAC Shanghai Aircraft Design & Research Institute, Shanghai 201210, China)

Emergency escape simulation for civil aircraft crew helps to identify the potential problems of crew escape hatch design during the early development of aircrafts, and ensures the safety of crew members. This paper presented a mixed-reality simulation system for emergency escape of civil aircraft flight crew. To solve the key problem of human body virtual-physical matching, an optical-inertial hybrid whole-body human motion capture method was proposed. The method, working together with the Kinect2-based human body key dimension matching technique, can effectively improve the efficiency and robustness of human body virtual-physical matching. The proposed mixed-reality simulation system has been successfully applied to the development of large domestic aircrafts. Experimental results show its efficiency in the evaluation of crew escape hatch design.

civil aircraft design evaluation; mixed-reality; simulation system; hybrid tracking; virtual and physical matching

TP 391.9

10.11996/JG.j.2095-302X.2022020306

A

2095-302X(2022)02-0306-10

2021-11-12;

2021-12-08

中国商飞公司科技创新专项(Y18GS10)

吴程程(1987–),女,工程师,博士研究生。主要研究方向为虚拟现实。E-mail:wuchengcheng@comac.cc

许澍虹(1967–),男,研究员,博士。主要研究方向为虚拟现实。E-mail:xushuhong@comac.cc

12 November,2021;

8 December,2021

COMAC Special Fund for Science and Technology Innovation (Y18GS10)

WU Cheng-cheng (1987–), engineer, PhD candidate. Her main research interest covers virtual reality. E-mail:wuchengcheng@comac.cc

XU Shu-hong (1967–), researcher, Ph.D. His main research interest covers virtual reality. E-mail:xushuhong@comac.cc