改进多尺度卷积神经网络的人脸表情识别研究

2022-05-03李军,李明

李 军,李 明

(重庆师范大学 计算机与信息科学学院, 重庆 401331)

0 引 言

随着深度学习的快速发展,人脸表情识别已经成为人机交互的研究热点,提高模型的识别准确率变得尤为重要。人脸表情是人与人之间信息沟通的有效途径之一[1],随着科技的不断发展,人脸表情识别技术的应用领域越来越广泛。传统的人脸表情识别技术有几何特征[2]、稀疏表示[3]和局部二值模式[4]。人工智能与大数据的发展,使得神经网络备受瞩目,研究者开始将卷积神经网络[5]和对抗神经网络[6]应用于人脸表情识别。卷积神经网络是特征提取的有效方法,广泛应用于图像处理和图像识别领域,并取得了一定的成功。之后的发展是进一步改进卷积神经网络,从而达到更好的效果,包括卷积神经网络与自编码器结合[7]和特征融合[8]等。特征融合使特征信息更加丰富,从而增强信息的流通与重利用。多尺度卷积神经网络的出现使特征信息更加丰富,研究者开始将多尺度卷积神经网络应用于单目深度估计[9]、图像增强[10]和人脸识别领域[11]。

卷积神经网络被广泛应用于图像处理,并且取得了较多的研究成果,但是仍然存在信息丢失严重、组件间相对空间联系不密切的问题,造成这些问题的原因是卷积神经网络对图像的理解粒度太粗,池化操作丢失了一些隐含信息,从而限制了模型的学习能力。卷积核能够理解非常细微的局部特征,池化操作能够让局部特征更加明显,人脸表情识别必须突出局部特征来学习表情的分类,所以池化操作在人脸表情识别中是必不可少的一部分。因此,在池化操作的基础上,必须尽可能地减少信息的丢失,从而优化模型。

针对以上问题,本文提出基于多尺度卷积神经网络的改进模型,首先在多尺度卷积层基础上再次构建多尺度卷积层,帮助模型挖掘出更多潜在的特征信息,每个卷积层后都有批量归一化(batch normalization,BN)层,加快网络收敛速度,使网络更加稳定,再通过特征融合促进信息的流通和重利用,通过特征的增加来减少池化操作带来的信息丢失,通过控制卷积核的大小来平衡全局特征与局部特征之间的关系,从而增强组件间相对空间的联系。为了避免特征图通道信息冗余,本文在特征融合后的连接压缩层减少了特征图的数量。

1 理论基础

1.1 卷积核与卷积神经网络

卷积神经网络是深度学习中非常经典的模型之一,通常由输入层、卷积层、池化层、全连接层、输出层组成。

卷积核是卷积层的重要组成部分,用来提取特征。每个神经元与输入区的某个特定区域相连,这种区域称为感受野[12],卷积核的大小与感受野的大小一致。在卷积神经网络中,小卷积核可以提取细微的特征,而且计算量较小,但并不意味着卷积核越小越好,太小的卷积核会过多提取局部特征,不利于某些模型的训练,忽略了组件之间的相对空间联系,这些都会导致模型训练准确率低下。卷积核越大,感受野越大,但是计算量也会增大,所以需要找到合适的卷积核应用到模型训练中。

池化层能够使局部特征更加明显,并减少模型中神经元的个数[13],但是池化操作丢失了部分特征信息,导致卷积神经网络的泛化性较差。

1.2 多尺度卷积神经网络

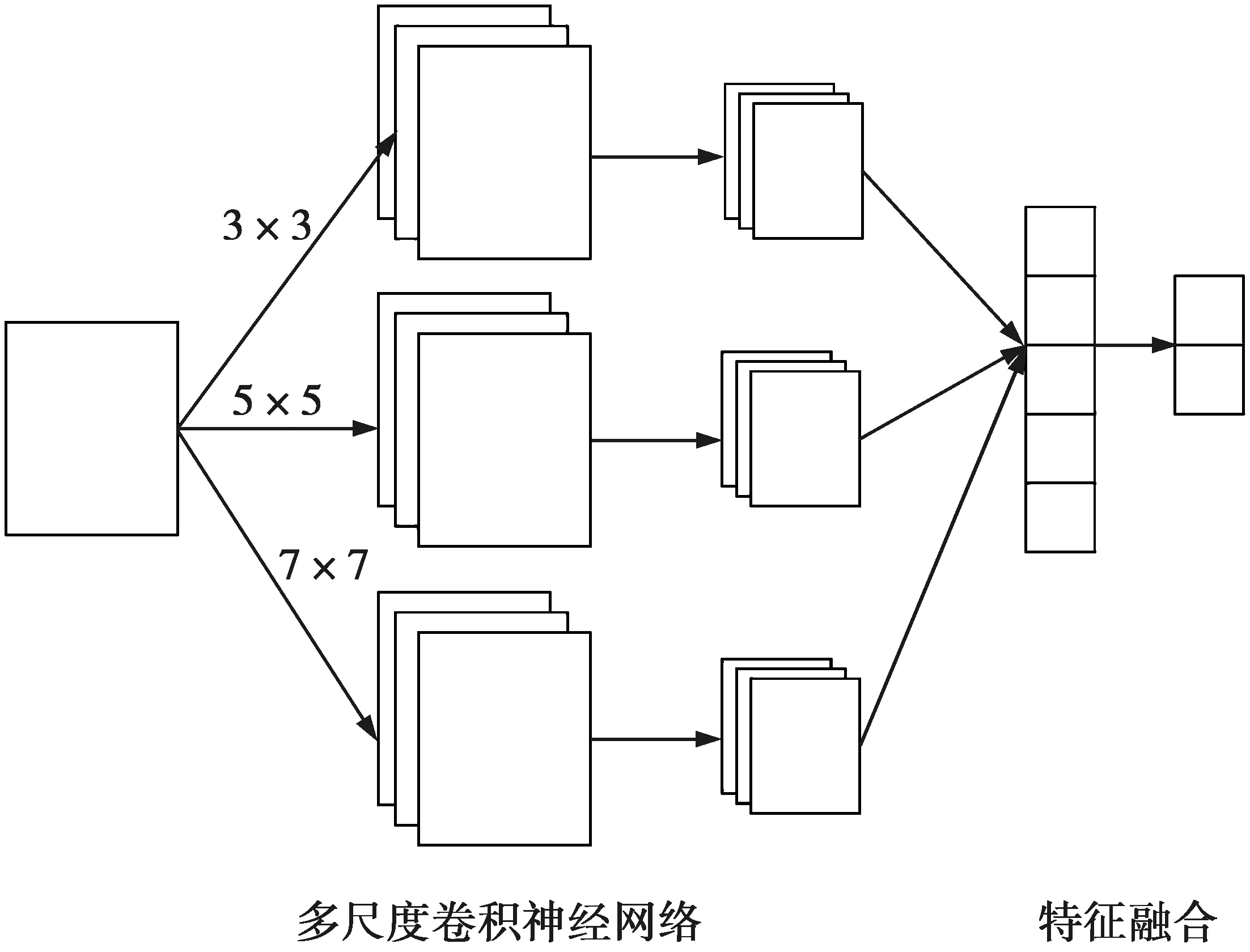

多尺度卷积神经网络是使用多个不同尺寸的卷积核对图像进行卷积,分别进行池化操作,再将结果连接,最后进行分类处理,多尺度卷积神经网络如图1所示。

图1 多尺度卷积神经网络Fig.1 Multi-scale convolutional neural network

多尺度卷积神经网络通过不同尺寸的卷积核提取特征,可以增加特征图的数量,提取的信息更加丰富,训练效果优于基准卷积神经网络,但是存在训练不稳定的缺陷,主要原因是组件间相对空间联系不密切和特征利用不够充分。

2 模型建立

在多尺度卷积神经网络基础上再次构建神经网络模型。首先对输入图像进行卷积与池化,在每个卷积层后都添加BN层,能够使网络收敛速度加快,并且使网络更加稳定。随后分两个阶段:阶段一,对池化后的图像采用较大尺度的卷积核分别进行卷积操作,每个卷积层产生的特征图再与卷积前的特征图进行特征融合,最后进行压缩与池化处理;阶段二,采用较小尺度的卷积核分别进行卷积操作,同样将产生的特征图与卷积之前的特征图进行融合,最后将特征图依次连接,经过池化处理后,依次传入全连接层与分类层。模型具体网络结构如图2所示。

改进的多尺度卷积层:通过两次不同尺度的卷积神经网络与特征融合操作不仅可以提取到更加丰富的特征信息,一定程度上也减少了池化操作所丢失的信息,有利于模型学习到更多隐藏的信息,能够平衡全局特征与局部特征之间的关系。为避免特征信息的冗余,模型增加了压缩层。

卷积核控制:阶段一采用5×5,7×7,9×9,11×11的卷积核进行卷积,阶段二采用3×3和5×5的卷积核进行卷积。阶段一采用的卷积核较大,对应的感受野也较大,提取的特征更倾向于全局特征,而阶段二采用较小的卷积核,感受野也较小,所以提取的特征更倾向于局部特征。通过阶段一与阶段二的学习,能够很好地衡量全局特征与局部特征间的关系。

特征融合:阶段一与阶段二都实行了特征融合处理,特征融合能够促进信息的流通和重利用。经过特征融合后,阶段一和阶段二的特征图数量分别为96和128。

压缩层:融合后的特征图经过压缩处理,可以有效减少特征图通道信息的冗余。压缩层采用1×1的卷积核进行卷积操作,阶段一压缩后的特征图数量为48。

池化层:池化层可以让特征更加明显。本文采用最大池化操作,池化区域为2×2,步长为2,池化后的特征图分辨率变为原来的1/2。

Dropout:池化层后采用Dropout操作,防止过拟合,系数设为0.7。

BN层:每个卷积层后都加入了BN层,BN层能够加快网络的收敛速度,并使网络更加稳定。

具体模型参数如表1所示。

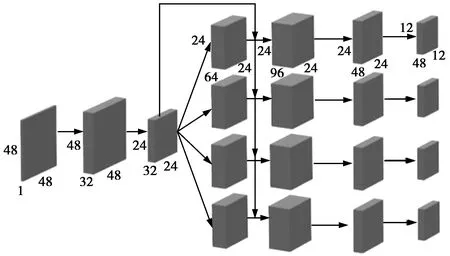

模型输入的大小为48×48×1,经过一次卷积和池化后大小变为24×24×32,经过阶段一的多尺度卷积后,各通道图像大小变为24×24×64,将卷积前的特征图与多尺度卷积后的特征图进行融合,图像大小变为24×24×96,经过压缩处理后图像大小变为24×24×48,最后进行池化操作来结束阶段一,图像大小变为12×12×48。阶段一网络结构如图3所示。

图3 阶段一网络结构图Fig.3 Phase1 network structure diagram

表1 模型参数

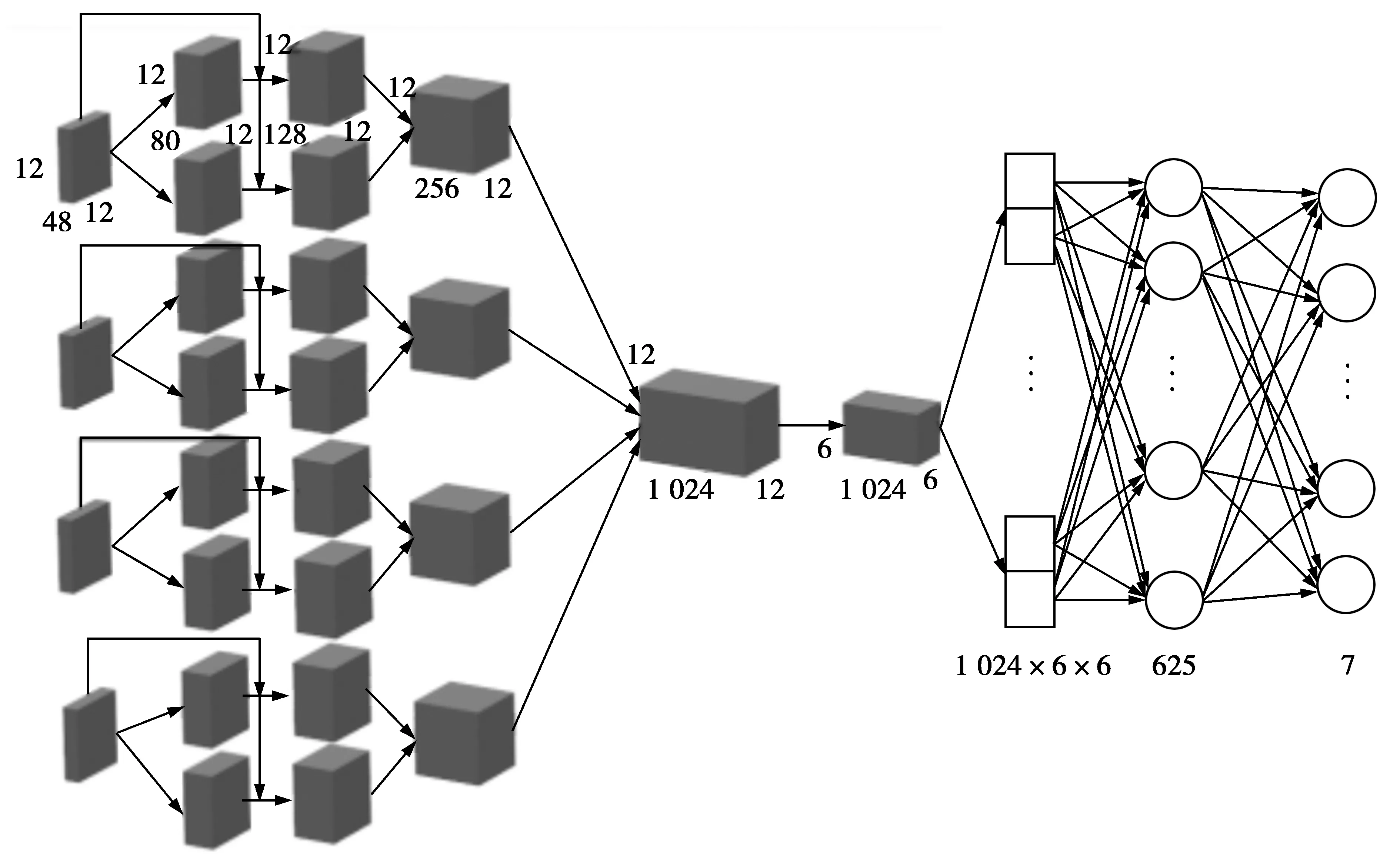

阶段一的输出作为阶段二的输入,采用较小的卷积核进行多尺度卷积操作,各通道图像大小变为12×12×80,将阶段二的输入与卷积后的特征图进行融合,图像大小为12×12×128,最后各通道经过总的特征融合后图像大小变为12×12×1 024,经过池化操作后,输出由6×6像素的1 024个图像组成,将这些图像展开为一个一维向量,长度为6×6×1 024,这个向量作为输入并传入含有625个神经元的全连接层,最后再传入输出层,由含有7个神经元的全连接层组成。阶段二网络结构如图4所示。

图4 阶段二网络结构图Fig.4 Phase 2 network structure diagram

3 数据集与实验结果

3.1 数据集与预处理

本文采用的数据集有两种,一种是JAFFE人脸表情数据集,有213张图片,由10名日本女性的正面人脸表情组成,数据集有7种表情,分别为愤怒、厌恶、恐惧、高兴、悲伤、惊讶、中性,本文将数据集裁剪为48×48,采用十折交叉验证,随机打乱数据,并以9∶1分为训练集和测试集。数据集部分表情如图5所示。

图5 JAFFE数据集部分表情图像Fig.5 Some facial expressions in the JAFFE dataset

另一种是FER-2013人脸表情数据集,由Kaggle人脸表情识别挑战赛提供。由35 887张人脸表情图片组成,训练集有28 709张,公共测试集和私有测试集各有3 589张,本文在私有测试集上进行测试。数据集也有7种表情,分别为愤怒、厌恶、恐惧、高兴、悲伤、惊讶、中性。

3.2 实验结果和分析

实验环境为Windows10操作系统,python编程语言,采用TensorFlow深度学习框架,在谷歌提供的Colab平台上使用GPU资源进行实验。首先,在JAFFE数据集上进行实验,由于JAFFE数据集本身较小,采用较大的批处理样本数量使得实验效果不佳。大量实验表明,批处理样本设为32为最佳。学习率的设定会对网络的收敛速度和训练结果产生重要影响,学习率设定过小会导致收敛过慢,学习率设定过大,会使代价函数振荡,可能达不到最小值。大量实验证明,学习率设为0.001为最佳。经过65次迭代训练之后,对测试集进行测试,准确率稳定地达到了95.45%。模型的准确率和损失趋于稳定,证明模型的收敛性较好。在JAFFE测试集上的准确率测试结果如图6所示。

本文与文献[14-17]所采用方法在JAFFE数据集上的准确率测试对比如表2所示。文献[14]通过使用局部Gabor特征的径向编码和分类器合成来进行面部表情识别。文献[15]采用局部有向数值模式用于面部分析,通过对面部纹理进行编码,从而具有更好的区分性。文献[16]通过多通道的卷积神经网络进行特征提取,并进行特征融合,丰富了特征信息,从而提高模型的识别准确率。文献[17]将曲波变换和在线顺序极限学习机与径向基进行融合从而构造出模型。由表2可知,文献[14-17]的方法准确率都低于本文方法。

图6 JAFFE测试集上的准确率Fig.6 Accuracy on the JAFFE test set

表2 JAFFE数据集上采用的方法以及对应的准确率

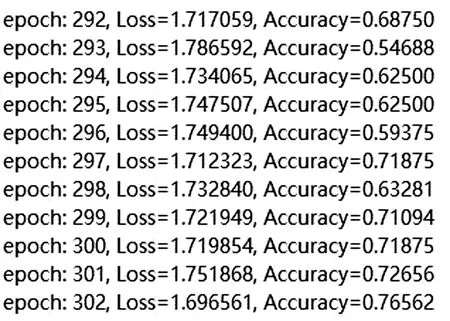

把本文方法在FER-2013数据集上进行实验,该数据集较大,经过大量实验表明,批处理样本设为128为最佳,学习率设为0.001,经过302次迭代训练后,损失趋于稳定,准确率达到了76.56%,在FER-2013测试集上的准确率测试结果如图7所示。

图7 FER-2013测试集上的准确率Fig.7 Accuracy on the FER-2013 test set

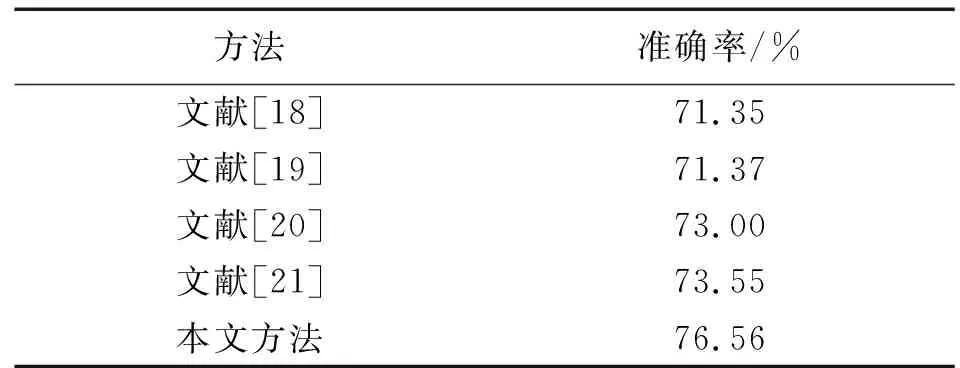

本文与文献[18-21]所采用方法在FER-2013测试数据集上准确率的对比如表3所示。文献[18-21]所采用方法是目前在该数据集上效果较好的方法。文献[18]对数据集进行复杂度分类,从而解决环境因素所带来的影响,以此来提高模型的准确率。文献[19]将人脸进行分割,凸显出与人脸表情联系密切的区域,从而提高准确率。文献[20]通过多尺度卷积神经网络来提高识别的准确率。文献[21]在Res18残差网络和正则化的基础上,提出联合优化策略来提高识别的准确率。从表3可知,本文方法的准确率比文献[18-21]都高。

表3 FER-2013数据集上采用的方法以及对应的准确率

4 结束语

本文提出了改进的多尺度卷积神经网络,在原始多尺度卷积神经网络的基础上再次构建卷积神经网络,从而提取出更丰富的特征信息,通过特征融合提高了特征信息的重复利用率;在模型中加入了BN层、压缩层和Dropout,不仅加快了模型的收敛速度,让网络更加稳定,而且也避免了模型的过拟合。实验证明,本文方法在JAFFE和FER-2013人脸表情数据集上识别的准确率有所提高,未来可以将数据增强方法结合到模型中,从而提高模型的鲁棒性。