基于弱监督学习的医学图像分割方法研究

2022-03-12程舸帆何良华

程舸帆 何良华

摘要:为提升针对医学图像的弱监督语义分割性能,本文从种子线索的生成出发,在CAM网络训练中引入多空洞卷积率的空洞卷积,以从图像级别的标注中产生密集位置预测,扩大响应范围。实验证明本文提出的分割模型在CAMELYON16数据集上能得到10个百分点的提升,并通过实验结果图证明本文模型可在仅有图像及标签已知的情况下为医生的诊断提供参考。

关键词:弱监督学习;语义分割;乳腺癌数据集;卷积神经网络;空洞卷积

中图分类号:TP311 文献标识码:A

文章编号:1009-3044(2022)03-0007-03

开放科学(资源服务)标识码(OSID):

随着科学技术的快速发展,计算机性能的飞速提升,近年来智能医疗得到了长足的发展。其中,医学图像分割能够自动化地实现影像数据的组织、病灶等区域的划分,能够为医生提供参考,一定程度上缓解了目前医生人才短缺的问题。而基于弱监督学习的医学图像分割方法研究,实现了人工制作标签和分割性能之间的平衡,仅利用图像级标签就能够实现像素级的预测,大大消除了人工制作标签的繁琐,推动了医学图像分割领域的发展。

如今大多数弱监督语义分割网络框架是在由 Alexander Kolesnikov等人[1]提出的SECNet的基础上衍生而来的,虽然SECNet在Pascal voc2012[2]数据集上的表现优于传统弱监督语义分割方法,如CCNN[3],EM-Adapt[4]等,但是其还是存在存在分割区域不完整、分割结果不准确等问题。对于特异性较强的数据集如医学图像数据集,SECNet的局限性就会更明显。

为了解决SECNet无法精准地定位像素级目标区域以得到高质量的目标边缘的问题,我们从种子标签的生成出发,引入多扩张率的空洞卷积使目标響应区域增大。这样伪像素级标签能够更好地贴近图像本身病灶区域,使其分割性能得到明显提升。

1 相关工作

1.1 类激活映射图

在分类网络训练中,类激活映射图(class activation map)[5]可以帮助我们了解到网络关注图片的哪块区域,可以实现对图片前景区域的初步定位。CAM的主干网络可以为任意一种常用的卷积神经网络模型如ResNet、VggNet等,但是用了GAP(global average pooling)[6]来代替网络的全连接层,这不仅能大大减少参数量,也使每个特征通道与其权重一一对应,实现了定位能力。

1.2 条件随机场

条件随机场(conditional random filed)[7]经常用作对语义分割网络的输出做后处理,使分割结果更为精细。CRF中的一元势能由分割网络给出的类别概率得到,二元势能取决于图像上每两个像素点间的相似性,具体由像素点的距离与颜色决定。随着CRF的多轮迭代,可以对深度神经网络的输出进行细节补充。

2 基于弱监督学习的医学图像分割模型

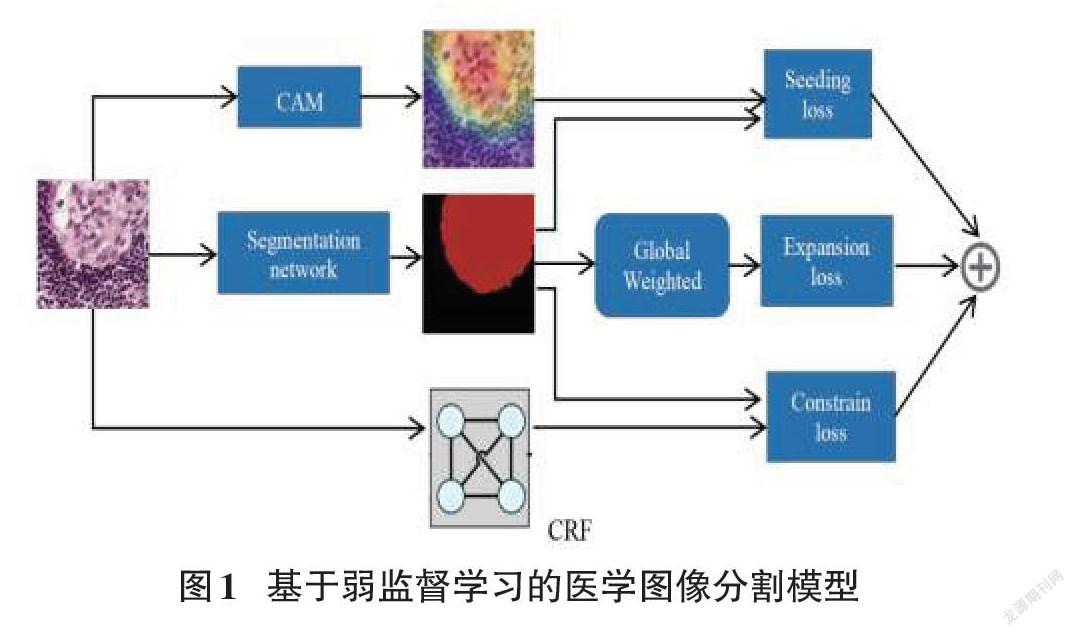

本论文提出的弱监督语义分割模型以SECNet为基础,为了提升性能,引入了不同空洞率的空洞卷积,使CAM图的初始定位更加准确。具体模型结构如图1所示:

2.1 使用多空洞卷积率的CAM

弱监督图像分割最大的挑战在于如何精准地定位像素级目标区域以得到高质量的目标边缘,而使用基础3*3卷积的CAM在分割大的目标时在目标物体处不集中,其不足以从图像级别的标注中产生密集位置预测。为了解决这个问题,我们在特征提取网络最后一层引入空洞率分别为2,4,6的空洞卷积(如图2所示),不同空洞率的空洞卷积不但可以扩大核的感受野,更重要的是还能将环境的判别信息推广转换至类别不明确的区域。

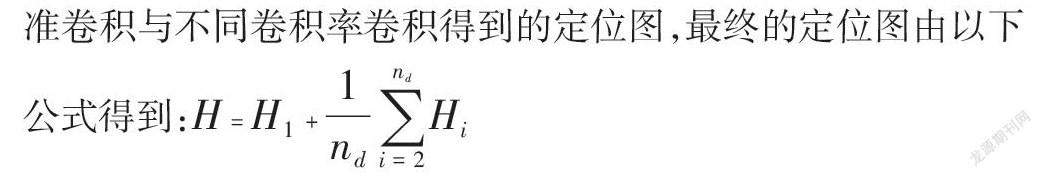

我们使用[H0]和[Hi] (i = 1...n,n为空洞卷积率)代表分别由标准卷积与不同卷积率卷积得到的定位图,最终的定位图由以下公式得到:[H=H1+1ndi=2ndHi]

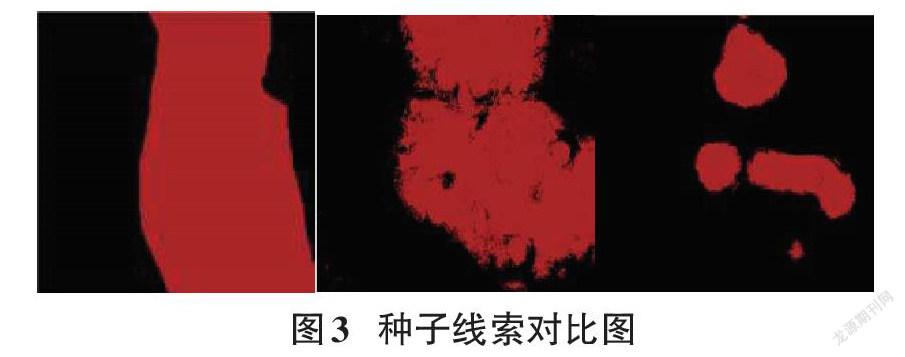

如图3所示从左至右依次是普通卷积得到的种子线索、采用多卷积率并平均后的种子线索、ground_truth,可以看到引入不同空洞卷积率后定位像素级目标区域准确率大幅提升。

3 实验与结果分析

3.1 实验数据

本论文实验均基于CAMELYON16数据集[8]。此数据集由CAMELYON16比赛提供,在本篇论文中我们使用此数据集来进行乳腺癌图像的弱监督语义分割。该数据集由270张被苏木素伊红染色的全片乳腺癌病理图像(whole-silde images,wsi)组成.由于全片病理图像属于超大分辨率图像,每张图片大小超过2GB,每张癌症图像上也包括多个癌症像素点区域。为了将图像能够送入网络处理,我们需要对WSI图像进行预处理,即利用数据集中专家给出的像素级标签——xml文件来对每张图片进行切割。利用xml文件中癌症区域与非癌症区域的中心点坐标将原始超大图像切割成若干大小为512*512的图像。经过切割与筛选,最终我们得到癌症图像与正常图像各900张,我们随机选取其中800张为训练数据,100张为测试数据。然后对训练数据集进行水平旋转,垂直旋转,水平加垂直旋转、[90∘] 、[180∘] 以及 [270∘] 六种操作,将数据集扩大至原来7倍。

3.2 训练流程

本文实验主要考虑原SECNet模型与经过本文改善的模型SECNet+Atrous,下面的训练流程对两个模型均一致:

本文实验基于python3.8环境与pytorch1.0框架,显卡为NVIDIA GEFORCE 1080Ti。使用像素准确率(PA),Miou与Dice三种评价指标进行模型评测。所有训练图像的大小均为512*512,batchsize为15。优化算法为动量为0.9,学习率为0.001的SGD优化算法。在训练CAM得到初步种子线索时,分类网络框架使用VGG16,并把网络最后的全连接层修改为GAP层,分割网络模型框架使用deeplabv3+,CRF的迭代次数设置为10。除此以外,实验还进行了全监督对比实验,采用FCN[9]全监督模型,对实验数据集进行全监督语义分割训练,并与弱监督语义分割结果进行对比。

3.3 结果分析

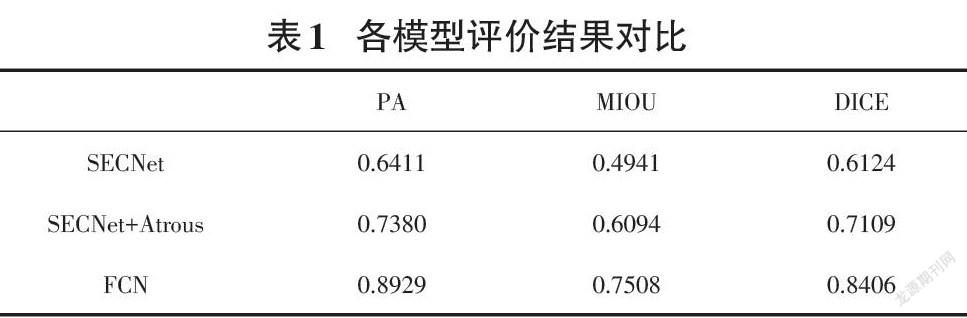

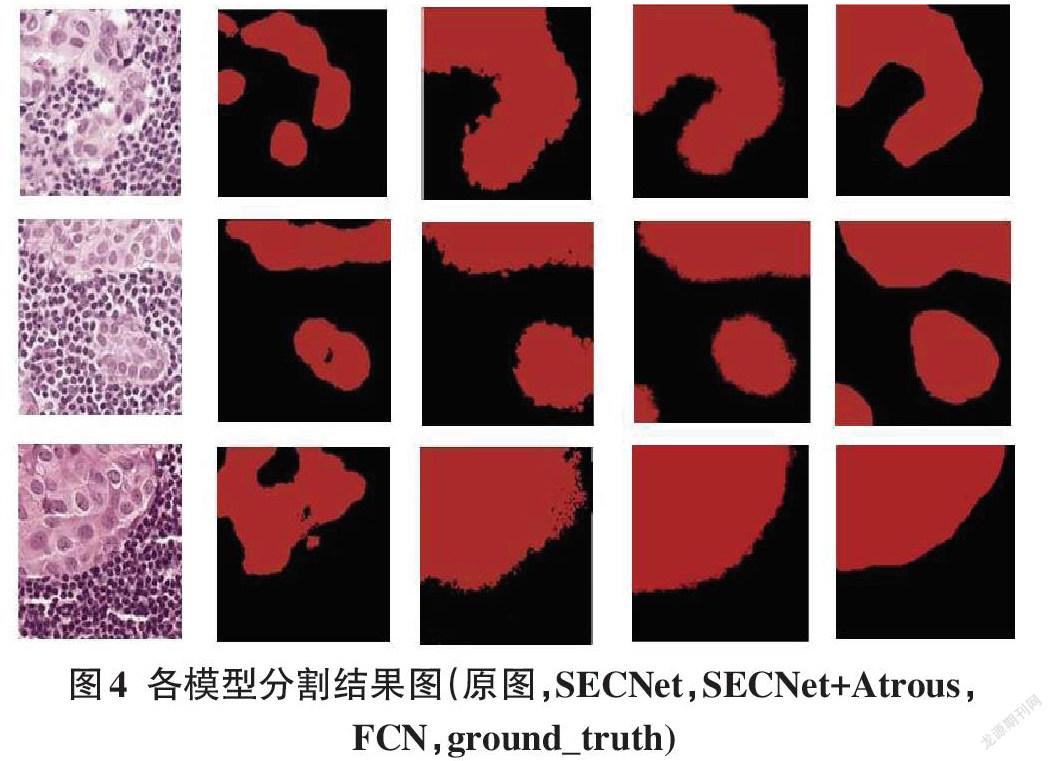

由表1和图6分析可得,将CAM网络中普通卷积改为多空洞卷积后,响应区域能适当扩大,变得更完整,性能提升显著,MIOU提高了10个百分点左右。虽然弱监督语义分割的性能距离全监督还有较大差距,但是他们的已知条件就不是同一层次的,全监督训练所需的像素级标签需要耗费巨大的精力才能得到。故在已知条件有限的情况下,弱监督语义分割能为医生的诊断提供参考。

4.结论

本文提出的基于弱监督学习的医学图像分割模型,在种子线索的生成中引入多卷积率的空洞卷积使分割结果中病灶区域更完整,更准确地对每一像素点进行分类。并通过对比实验证明了本文方法的有效性。

参考文献:

[1] Kolesnikov A,Lampert C H.Seed,expand and constrain:three principles for weakly-supervised image segmentation[C]//Computer Vision - ECCV 2016,2016.

[2] Everingham M, Winn J. The pascal visual object classes challenge 2012 (voc2012) development kit[J].Pattern Analysis,Statistical Modelling and Computational Learning, Tech. Rep,2011,8.

[3] Pathak D,Krähenbühl P,Darrell T.Constrained convolutional neural networks for weakly supervised segmentation[C]//2015 IEEE International Conference on Computer Vision (ICCV).December 7-13,2015,Santiago,Chile.IEEE,2015:1796-1804.

[4] Papandreou G,Chen L C,Murphy K P,et al.Weakly-and semi-supervised learning of a deep convolutional network for semantic image segmentation[C]//2015 IEEE International Conference on Computer Vision (ICCV).December 7-13,2015,Santiago,Chile.IEEE,2015:1742-1750.

[5] Zhou B L,Khosla A,Lapedriza A,et al.Learning deep features for discriminative localization[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).June 27-30,2016,Las Vegas,NV,USA.IEEE,2016:2921-2929.

[6] Lin M,Chen Q,Yan S.Network In Network[J].Computer Science,2013.

[7] Krhenbühl, Philipp, Koltun V . Efficient Inference in Fully Connected CRFs with Gaussian Edge Potentials[J].Curran Associates Inc,2012.

[8] Camelyon 2016. 2016. https://camelyon16.grand-challenge.org

[9] Shelhamer E,Long J,Darrell T.Fully convolutional networks for semantic segmentation[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(4):640-651.

【通聯编辑:梁书】