基于神经网络计算的无线容量高实时预测

2020-10-14赖昱辰LAIYuchen钟祎ZHONGYi王建峰WANGJianfeng

赖昱辰/ LAI Yuchen, 钟祎/ZHONG Yi, 王建峰/WANG Jianfeng

(1.华中科技大学,中国 武汉 430074;2. 微软公司,美国 雷德蒙德 98052)

随着无线数据需求的急剧增加,用户与无线接入点之间的距离大大减少,导致无线网络向超密集架构发展。由于密集的部署和多样化的传播环境,网络管理和调节也变得极为复杂。在室外环境中,需要额外部署小型基站,减轻宏基站的无线流量负担,提高覆盖范围的连续性和信号强度。在室内传播环境如购物中心和办公楼内,由于承重墙等障碍物,加上个体用户密集部署的无线局域网(WLAN)的影响,信号传播可能比室外更为复杂。此外,由于覆盖率、速率、等待时间的不同,不同无线应用有着多样化的服务质量(QoS)要求。因此,应当正确规划接入点的部署,以保证无线网络的性能。

为规划无线网络的部署,首先应评估给定部署方案的容量。传统方法中,网络的容量通过系统级仿真进行估算,需要计算每个位置的信噪比(SINR)值,再计算每个位置的数据率;然而,模拟具有复杂传播环境的大规模无线网络相当复杂,且仅适用于特定的部署方案,而部署方案千变万化,所以对网络容量的评估应该更加智能和高效。

本文中,我们提出了使用卷积神经网络(CNN)模型预测无线网络的容量的方法。图1中给出了容量预测模型的框架,由用于无线网络仿真的系统模型和用于数据预测的CNN组成。首先,在方形区域和有墙环境中使用无线网络模型模拟信号传输,将环境信息与接入点信息等多维数据应用于网络容量估计,使用二维矩阵描述接入点部署位置,并将无线网络容量标记为标签,得到CNN数据集。其次,将数据集按一定比例分为训练集和测试集两部分,建立CNN模型并将训练集导入,经过特征提取与分类决策后输出网络容量值,再利用反向传播算法动态调整神经网络参数的权重,优化数据预测模型。

1 无线网络系统建模

在本节中,我们介绍两种不同的无线网络部署环境(方形无障碍区域与有墙环境)并建立了信号传输模型。在两个环境中各自生成10 000个接入点部署图并计算其网络容量,作为卷积神经网络的数据集。

我们将区域均匀划分为个M×M网格,随机分布N个发射功率相同的接入点。区域中,有M2个用户均匀分布在平面内。在方形区域内,每个用户连接与其距离最近的接入点。在有墙环境中,用户连接到穿墙后能提供最大信号功率的接入点,并将其他接入点视作干扰。对每个接入点发射的信号,需要考虑的关键因素有:

1)路径损耗。该损耗是由发射功率的辐射扩散和无线信道的传播特性引起的。电波信号随距离增长而衰减,根据标准信号传播模型,设定路径损耗系数大于2。

2)瑞利衰落。由于信号的反射、衍射、折射和散射引起无线信道的多径传播,使得接收到的信号幅度遵循瑞利分布,功率衰减系数遵循均值为1的指数分布。

3)墙损。对有墙环境,还需要考虑穿墙带来的信号损耗。信号通过一面墙时的衰减值为10~15 dB,故设定墙损系数为0.314。此外,采用跨立实验方法来计算在用户和接入点之间的无线通信链路上的墙的数量。

与接收信号功率相比,通信环境中的高斯噪声的干扰可以忽略不计,利用香农公式可以计算每个用户的网络容量值。在方形区域内需考虑到边缘效应的影响,在4条边界各忽略15%的区域,累计中心区域的用户的数据率,取平均得到全局网络容量值。对有墙环境,则累加平面图内所有室内区域的数据率并取平均值。

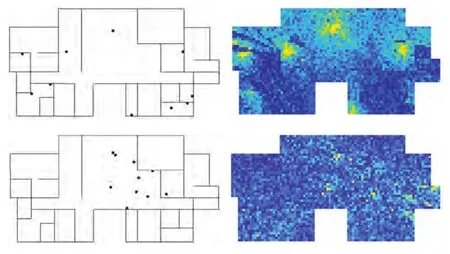

图2给出了一个室内设计方案示例图。原点设置在左下位置,将整个区域按比例缩放到平面直角坐标系中,同时将墙壁模拟为线性线段,建模得10 000个样本。图3中是获得最大和最小网络容量值的接入点的部署图和相应的全局数据率分布。其中,高网络容量值区域显示为黄色,低容量区域显示为蓝色。可以看出,数据率随着接入点周围半径的增加而减小,并在靠近接入点的区域达到峰值,但当接入点分布过于密集时会互相干扰,使得网络容量值较小。

2 基于CNN的容量预测

本节中,我们将分析不同的卷积神经网络架构,以探讨网络容量预测问题在不同场景下的适用性。将接入点的位置矩阵(即像素值为M×M的二维图像)作为CNN的输入,接入点位置的像素值标准化为1,其他区域像素值设置为0;将网络容量从大到小均分为40类,作为CNN的标签。表1给出了使用的卷积神经网络的结构,Conv(x,y,z,s)表示卷积层,其输入通道数为x、输出通道数为y、步长为s,卷积核的大小为(z×z)。MaxPool(z,s)表示最大池化层,其卷积核大小为(z×z),步长为s。Fc(x,y)表示具有输入节点数为x与输出节点数为y的全连接层。

2.1 特征提取

在卷积层中,通过将卷积核连接到输入层相邻区域中的多个神经元,自动完成输入数据集的特征提取。每个卷积层都会生成一个新的特征图,其维数等于卷积核的数量,其尺寸取决于卷积核的大小和步长。通过连续卷积,特征图维数增大而尺寸减小。

卷积层的输出特征图会被传输到最大池化层,以进行特征选择和信息过滤。在最大值滤波的区域中,下采样函数提取所有连接神经元的最大值。池化层用于压缩特征图并减小输出的空间大小以简化计算,也可提取主要特征以提高网络的鲁棒性。池化层中的计算方法与卷积层中相同,滤波器的参数不会经反向传播过程被修改。

▲图3 获得最高和最低容量值的接入点的部署位置及数据率分布图

表1 应用于无线网络容量预测的CNN的详细结构与参数信息

2.2 分类预测

全连接层位于所有神经网络的末端,连接所有输入特征并将分散特征映射到标记的样本空间中,可用于减少特征位置对结果的影响。第一,将从最后一个卷积层获得的高维数据表示为大小为3、维数为64的特征图,并扩展成576个单独特征作为全连接层的输入;第二,将线性加权和方法应用于隐藏层,将每个标签的输出概率发送到分类器,并在下一次训练中通过反向传播算法更新隐藏层的参数权重;第三,分类器将概率最高的标签作为最终输出。分类的数量越多,两个相邻网络容量标签的值差就越小,即预测的网络容量的精度越高。我们设置了两个全连接层,并添加了一些非线性方法来提高数据集的训练效率。

2.3 权重更新与模型优化

卷积层与池化层具有较少的参数和较大的计算量,而全连接层则相反;因此,在加速优化过程时着重于调整卷积层的参数和结构,在实现参数优化和权重裁剪时着重于全连接层。

经过仿真测试,使用线性整流函数(ReLU)作为激活函数以解决过拟合和梯度消失的问题,同时减少计算量。使用交叉熵损失函数作为评估神经网络性能的指标,用于比较预测容量值与实际输出之间的差异。在反向传播过程中计算完所有参数的梯度后,使用基于随机梯度下降(SGD)算法的AdaGrad优化算法对网络的权重和参数进行更新,从而获得最优的权重参数。

3 仿真验证与分析

在本节中使用Pytorch框架建立所有的CNN模型,主要研究以下CNN结构和参数对训练效率与准确度的影响:分类数与数据集数量、优化算法学习率、批归一化层与Dropout层、CNN的深度。

将训练集和测试集的比例设置为6:1,为确保实验结论的普适性,每个测试重复3次以上并取结果平均值。一个时期(epoch)意味着训练集中的所有样本训练一次,且测试集的所有数据被评估一次。由于过拟合现象的产生,可以使用早停法,即提前终止训练过程以获得更高准确性。为了减少大规模样本的计算时间和梯度值差异,每32个训练集样本被划分成一个小批次,随机打乱批次顺序并分批进行训练。在以上前提条件下进行测试,观察到在方形无障碍区域内,测试集准确率最高为96.01%,有墙环境中准确率最高为87.84%。在简单环境中应用的CNN也可以从复杂场景中提取隐藏特征,但模型训练时间更长,精度更低。

3.1 分类数与数据集数量

当方形区域的10 000个数据输入到CNN-4时,准确率仅达到79.93 %。增加训练集的数量可以提高CNN模型的拟合能力,当训练集的数量逐渐增加到40 000个时,可基本满足准确率要求。将网络容量预测视为一个分类问题,当预测结果与真实值的误差不超过2级时可视作结果正确,也可以通过减小分类类别数提高准确率;但随着输出等级的逐渐减小,测试集的数据精度降低,经测试后选择40级输出以平衡二者性能。

3.2 神经网络深度

低时间复杂度意味着程序执行的语句较少,运行每个epoch的时间较短。低空间复杂度则意味着临时占用的参数和存储空间数量较少。一般情况下,模型的时间和空间复杂度随神经网络层数的增加而增加。由表1可知,CNN-2的模型结构与CNN-1非常相似,只是使用两层3×3卷积替换了CNN-1第3层卷积层的5×5卷积核,这使得时间复杂度反而下降。

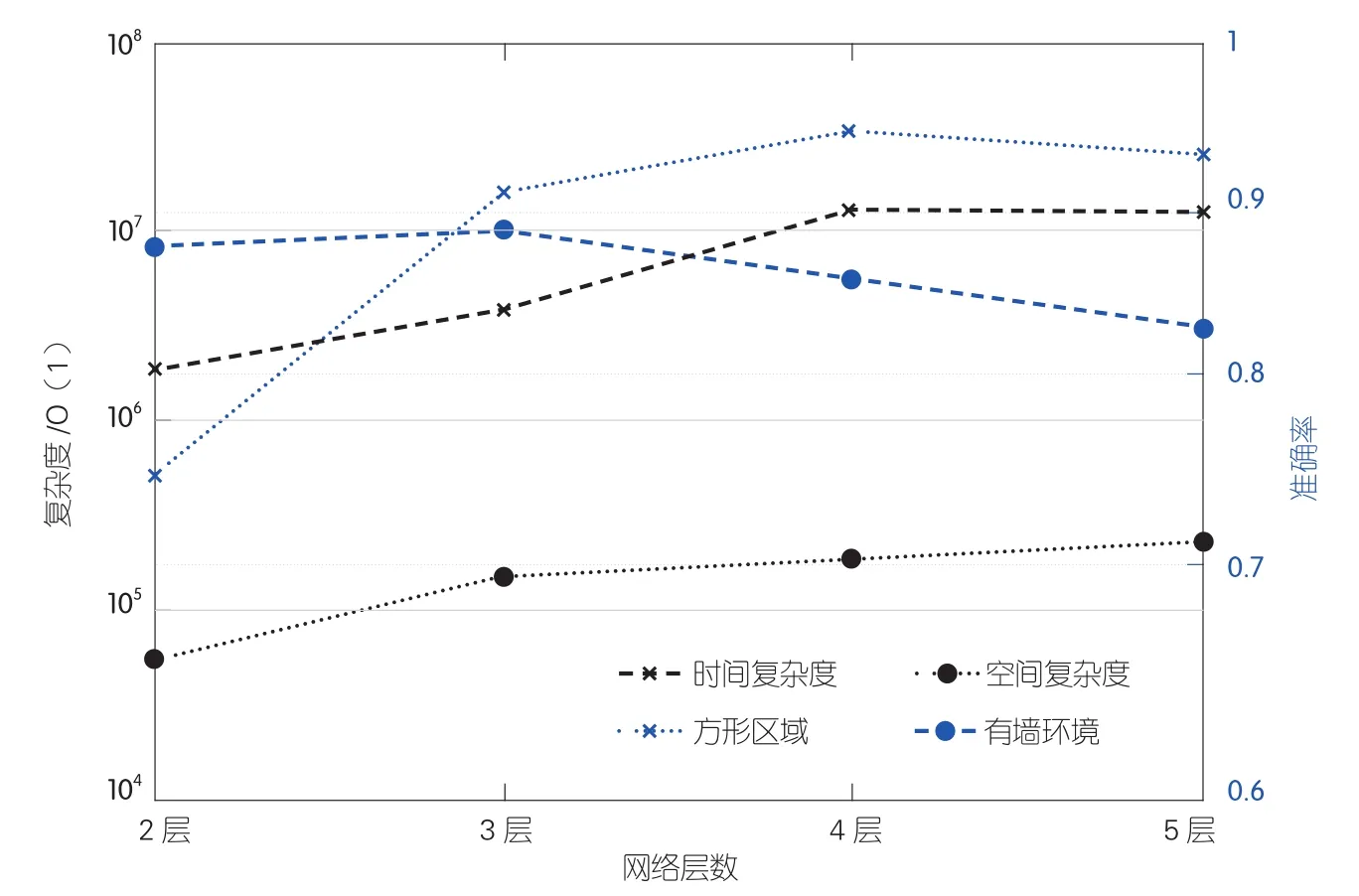

如图4所示,在方形区域中,由于2层网络无法充分提取特征图的特征,甚至无法学习基本特征,2层CNN的准确率只能达到74.77 %;但随CNN深度的增加,准确率呈上升趋势并在使用4层网络时达到最大值94.12 %。在层数增加的同时,权重的线性相乘容易导致梯度爆炸或消失,且抽象能力过强时会阻止网络提取有用的功能,这将使得5层网络的准确率下降。在有墙环境中,准确率首先从2层的87.06%提高到3层的87.84%,接着持续降低。所以,在方形区域中使用4层神经网络CNN-2,在有墙环境中使用3层网络CNN-3。

▲图4 2—5层卷积神经网络的时间和空间复杂度及其在方形区域与有墙环境内的准确率

3.3 优化算法学习率(LR)

图5中测试了LR介于0.001~0.1之间的Adam算法和可自动调整学习率的AdaGrad算法的性能。LR较大时,收敛速度很快,但容易出现梯度爆炸,使得权重更新失败,导致模型不收敛。可以看到,在LR为0.1时,模型不收敛。当LR为0.01时,准确率先上升,但梯度爆炸使得模型训练失败。LR较小时,梯度下降下降慢,收敛时间较长,也可能导致过拟合问题。将LR减小到0.001,模型可正常运行并表现出良好的性能。0.005的LR也被测试,虽然缓慢收敛,但性能不如0.001的LR。由于自适应学习率算法被越来越多地应用,我们选择使用AdaGrad算法,并发现其在训练效率和准确率上显示出了更好的性能,并最终将其应用于本文的CNN模型内。

▲图5 使用LR为0.001~0.1之间的Adam算法和AdaGrad算法的准确率

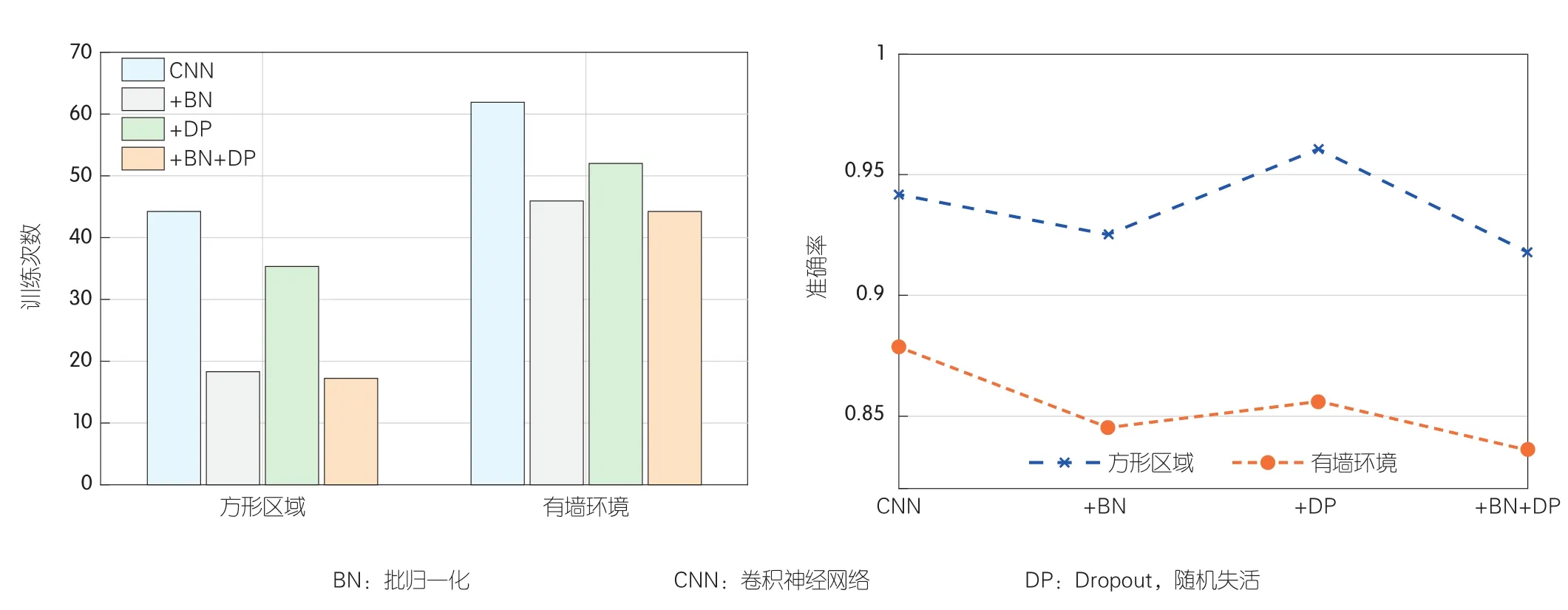

▲图6 在DP层和BN层影响下的训练次数和准确率

3.4 Dropout(DP)层和批归一化(BN)层

BN层将重新缩放所获均值和与方差,将每批训练数据标准化,再使用新学习的均值0和单位方差优化网络梯度,使数据分布更符合训练过程中的实际情况,以确保模型的非线性。在前向传播过程中,DP层使隐藏层的某些节点停止工作,确保该模型不会太依赖于局部特征。两者都可提高网络泛化能力,优化过拟合问题。

如图6所示,网络内不加BN或DP层时,训练次数和单次训练时长最大,但在有墙环境内的准确率最高,为87.84 %。在每个最大池化层后添加BN层后,训练速度大大提高,可在第18和第46个epoch完成模型训练;然而,由于训练集是接入点分布的二维图像,BN在训练过程中丢失部分特征图值,从而导致模型拟合度下降,使得准确率降低。带有DP层的CNN模型的训练速度得到了提高,同时在方形区域中的精度达到最大值96.01%。BN层和DP层同时添加时,训练速度最高,但精度最低。

在程序中使用统一计算设备架构(CUDA)加速,可大大缩短训练时间,这对二者在训练效率上的影响差异可以忽略。因此在方形区域中,在CNN-2全连接层后加DP层,在有墙环境中可直接使用CNN-1模型。当使用优化后的卷积神经网络来预测有墙环境的网络容量时,可以在33 s内预测10 000个接入点部署方案的网络容量,这比使用传统系统仿真方法所需要的12 413 s快376倍。

4 结束语

利用接入点部署的二维图像,卷积神经网络将复杂环境中网络容量的预测转换为二维数据处理问题,可成功提取接入点部署位置的特征,实现高实时精准预测。比起传统的系统仿真方法,CNN更高效与智能,且具有高精度和鲁棒性。随着人工智能技术的发展,更多的机器学习方法将被应用于未来无线网络的部署与管理中。