深度神经网络在森林步道视觉识别中的应用*

2019-02-13侯永宏吕晓冬陈艳芳李器宇

侯永宏,吕晓冬+,陈艳芳,赵 健,李器宇,陈 浩

1.天津大学 电气自动化与信息工程学院,天津 300072

2.天津航天中为数据系统科技有限公司,天津 300458

1 引言

无人机以其体积小、成本低、适应性强、机动性好等特点在军用和民用领域展现出巨大的应用潜力,在搜索救援、森林监测、地貌重建等[1-3]方面具有广阔的应用前景。然而,传统无人机的飞行需要全球定位系统(global positioning system,GPS)或人为操控,无法在复杂环境下自主完成任务。近年来,学术界和工业界研究重点逐渐转向无人机自主导航技术,无人机代替人类在野外环境下执行任务成为可能[4]。无人机在森林环境下的自主导航具有广泛的应用前景,主要体现在搜索救援方面:无人机的大量部署是对救援人员的有效补充,能够有效减少救援的反应时间以及失踪人员的受伤风险。但由于森林环境的复杂性和多样性,无人机在森林环境下的自主导航仍是一个亟待解决的问题。

自主导航的关键在于环境感知,无人机需要在森林环境中探索可飞行路径。森林步道是人们为了穿过森林而走出来的林中小路,因此,无人机沿着森林步道飞行是相对安全有效的行进方式。然而,相比于规范、边界明显的人行道,森林步道多样且边界模糊,形状和宽度不受限制,没有可用于导航跟踪的规律性,因此,森林环境下的路径识别更具有挑战性[5-6]。过去的几十年中,路径识别的相关算法得到广泛研究,在该领域有了长足的发展。现有的道路识别算法主要可分为三类:基于特征的、基于参数模型的以及基于机器学习的方法。基于特征的算法通常提取图像中重要且稳定的特征,如强度[7]、颜色[8-9]或纹理特征[10-11]将道路从背景中分割出来。然而,基于单个特征的分割方法鲁棒性和兼容性差,容易受到天气、光照变化以及阴影的影响,并且对道路形状不敏感,不适用于森林步道这类的复杂场景。因此,后续提出的算法通常将图像分割处理与其他方法相结合,以获得适当的特征。Alon等人[12]将基于Adaboost算法的区域分割与基于几何投影的边界检测相结合,来寻找自然地貌下的可行驶区域。然而该算法计算量过大,实用性不高。文献[13-14]采用了图像显著性检测算法,利用颜色、亮度和方向对比来寻找视觉焦点,通过视觉差异来突出路径。但当路径与周围环境对比度小时,很难根据强度变化进行区分。文献[15]提出了一种基于自顶向下的混合算法,将图像的区域和边缘信息相结合,通过离线分类器学习低阶和高阶图像信号以检测道路区域。Zhang等人[16]提出修改特征编码器并增加特征选择的过程,使用树形结构来表示分割区域多阈值的层次关系,再结合K-means进行无监督特征学习,从而提高路径识别的鲁棒性。Santos等人[17]利用边缘密度估计进行超像素检测,从灰度、纹理、交通等特征中提取先验信息,结合支持向量机对图像中的路径进行分割。这类基于特征的方法需要根据具体的环境选择合适的分割算法,因此有着一定的局限性和应用范围。基于参数模型的方法需要根据少量先验信息匹配数学模型,如道路边缘、形状、分布等,从而估计模型参数完成道路检测。Hu等人[18]提出一种多模态道路检测与分割系统,利用单目图像和高清多层激光雷达获取反映环境结构的三维点云数据进行高斯模型的参数估计,从而确定道路的中心线区域。文献[19]基于随机抽样一致性(random sample consensus,RANSAC)算法,利用顶视图图像匹配曲线道路模型,不易受图像中物体遮挡或覆盖等情况影响。但这类算法的有效性取决于模型的精确度,因此对道路形状有着严格要求,适应性较差。

随着人工智能的发展,路径感知逐渐向机器学习过渡,基于机器学习的相关算法相继提出[20-21]。文献[22]从输入图像中提取每个像素的特征向量,利用支持向量机在线进行自监督学习,通过训练后的分类器进行道路/非道路分类。文献[23]通过距离归一化和水平图像金字塔泛化远近场的限制,利用深度神经网络训练分类器将道路与其他背景区别开,具有良好的自适应效果。Laddha等人[24]提出一种基于单目图像的道路识别算法,利用车辆姿态估计传感器(GPS和惯性测量单元)对训练道路图像进行自动标注,再利用卷积神经网络对其训练完成路径识别。这些算法虽然能够达到较高精度,但预处理手段复杂,需要大量的前期工作和计算。苏黎世大学Scaramuzza教授带领学生Giusti等在文献[25]中首次提出将无人机的路径导航问题转为神经网络分类问题的思想,即根据识别路径位置来调整无人机航向。研究员使用三个不同朝向的头戴式相机收集在森林中行走时的数据,组成数据集IDSIA。利用神经网络判断图像中的路径位置(右侧/中间/左侧),进而完成飞行方向(右转/直行/左转)修正。这是第一个利用深度神经网络来实现无人机在森林中自主飞行的文献,但当无人机在飞行中遇到树木稀疏的低密度场景时,往往会导致飞行方向的误判,从而偏离正确的森林路径。NVIDIA作为全球领先的视觉计算公司,在自动驾驶汽车、医疗影像分析和机器人自主学习等方面成果斐然,引领人工智能计算领域的前进与发展。由Smolyanskiy[26]领导的NVIDIA公司研究团队在IDSIA数据集的基础上利用安装了三个摄像头的宽基线装置来增加水平边路的数据,从而估计无人机的飞行方向(右转/直行/左转)和横向偏移(左偏/中间/右偏)。该方法虽然一定程度上提高了准确率,但依旧忽略了低密度场景下的误判情况,准确率仍有一定的提升空间。

以往的相关工作大都集中在城市道路、高速公路等场景,主要应用于地面车辆的自动驾驶领域。用于无人机复杂环境下搜救应用场景的路径识别技术研究较为少见。基于神经网络的路径识别算法[25-26]是少有的针对该应用场景下的技术研究,能够通过简单的端对端网络实现路径跟踪,并且相较于传统方法具有鲁棒性高,适用范围广的优点。但在森林环境中,路径边缘模糊,树木分布不匀,不可避免地会出现低密度的森林场景。上述两种方法在此类场景下会出现严重误判,大大降低无人机路径跟踪的安全性和稳定性。针对这个问题,本文提出一种基于多列深度神经网络的方法,该方法通过建立一个双列深度神经网络模型(two-column deep neural networks,2CDNN),将相机获取的RGB图及其边缘与纹理特征作为输入,利用网络自主学习预测三种飞行方向(左转/直行/右转)的概率,在保证高密度场景中路径识别准确率的前提下,大大提高在低密度场景下的识别准确率,从而提高无人机在森林环境下进行搜索救援的安全性和可靠性。实验表明在IDSIA数据集中取得了良好的效果,准确率高达91.31%,比现有的方法提高了4.41%。

2 基于单路深度神经网络的路径感知方法

2.1 IDSIA数据集

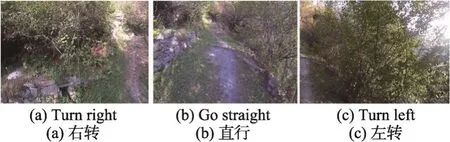

目前,针对森林环境的路径感知技术研究,业界普遍采用苏黎世大学Scaramuzza教授发布的数据集IDSIA。该数据集采集方法如下:徒步者配备三个头戴式相机,沿着森林路径迅速行走并始终直视前方。三个相机并行排列但朝向不同:中间相机指向正前方,与徒步者视角一致;两边相机分别朝左、朝右偏转30°,如图1所示。IDSIA数据集由这三个相机采集到的图像序列组成。图像的标签为无人机的三类飞行转向指令:左转、右转和直行,由获取图像的相机位置决定。左侧相机采集的图像中路径在右侧,则图像标签为右转。同理,右侧相机的图像标签为左转,中间相机的图像标签为直行,如图2所示。

2.2 基于单个神经网络的路径感知方法介绍及分析

文献[25]采用深度神经网络(deep neural network,DNN)作为图像分类器,网络包含4个卷积层、4个池化层以及1个全连接层。网络输入为裁剪成101×101大小的RGB图,对于给定的输入图像,深度神经网络给出3个值,分别表示输入标签为左转、直行和右转的概率。该方法在IDSIA数据集上取得了85.2%的准确率。

Fig.1 Top view of acquisition setup图1 头戴式相机配备俯视图

Fig.2 Images taken by cameras facing different view directions图2 不同朝向相机获取的图像

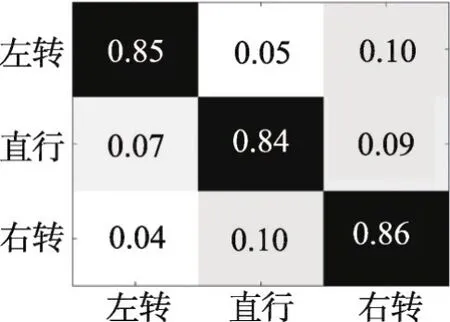

本文针对该方法在数据集下发生误判的概率做出统计,具体情况如图3所示。

Fig.3 Confusion matrix for DNN on IDSIAdataset图3 DNN在IDSIA数据集上的混淆矩阵

图3中纵坐标为标签,横坐标为网络判断结果,表格内容为统计概率。统计结果显示,网络将左转误判为右转以及右转误判为直行的概率很高。结合图像分析,网络在树木稀疏的低密度场景下的误判概率要远远高于树林茂密的高密度场景。高密度场景下,高大的树木与平坦的小路界限较为分明;而低密度场景的路径周围多为平坦的草丛,两者的分界线较为模糊,如图4(a)和图4(b)所示。

Fig.4 High-density and low-density scenes in forests图4 高密度场景图与低密度场景图

解决此类问题的关键在于如何在低密度场景下将森林路径与其周围环境很好地区分开。低密度场景的路径周围由于存在堆积的枝条和草叶,故含有更多的纹理特征;而路径除两旁轮廓线外基本没有多余线条,纹理更少。因此,本文提出2CDNN网络模型,一列网络输入为经过预处理的特征图来突出输入图像的边缘纹理特征,另一列网络输入RGB图突出输入图像的颜色特征,最终将两个网络结果融合进一步提高路径识别性能。

3 2CDNN模型

2CDNN模型本质上是基于多列深度神经网络[27]的网络模型。多列深度神经网络是一个简单的集成模型,由多个神经网络并行组成。各网络输入为不同方法预处理后的图像,通过将各网络的输出向量融合作为最终判断结果。本文提出的2CDNN模型主要由三部分组成:图像预处理、网络结构以及结果融合,如图5所示。

(1)图像预处理:首先将相机获得的RGB图进行直方图均衡结合边缘提取的方法获得特征图,并将原RGB图和特征图分别作为两列网络的输入。

(2)网络结构:采用两列深度残差网络分别对输入进行监督训练,预测三个飞行方向的概率。

(3)结果融合:将两个网络的概率向量进行点乘融合,最大概率值的标签即为识别结果。

3.1 图像预处理

针对上文对低密度场景下的误判分析,纹理信息是区分路径与周围环境的重要特征,因此为了更好地提取图像中的纹理信息,本文采用了直方图均衡和边缘提取的方法对图像进行预处理,从而获得突出局部细节和结构纹理信息的特征图。

Fig.5 2CDNN model图5 2 CDNN模型

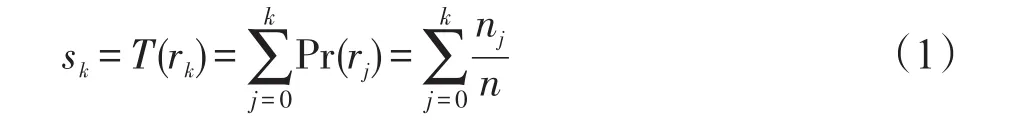

直方图均衡化处理是一种简单有效的图像增强算法,常常用来压缩图像的动态范围使得高动态范围的场景呈现出更多的细节,提高整体对比度。因此,在进行边缘提取前采用直方图均衡处理可以有效地提取出图像的局部纹理细节[28-29]。为了达到均衡化的效果,算法需要利用累积分布函数将原图的直方图映射为均匀分布的直方图。设一幅图像像素总数为n,灰度级为L,nk为灰度级为rk的像素个数,则映射函数T(r)公式如下:

式中,rk为归一化后的灰度级,Pr(rk)为rk灰度级出现的概率。

边缘检测采用经典的Laplacian算子,它是一个二阶微分算子,具有各向同性的特点,可有效提取图像的边缘纹理等细节信息,定位精度高。但因其对噪音较为敏感,因此检测前需进行低通滤波。Laplacian算子及其变体已经成为提高各种应用性能的有效方法[30-32]。本文主要通过该方法来突出图像中的纹理和结构特征。假设图像像素点为f(x,y),Laplacian算子可以定义为下式:

图6(a)、图6(b)分别为图4(a)和图4(b)经过直方图均衡和边缘提取预处理后的特征图,由图可知,高密度场景特征图和低密度场景特征图都能很好地突出局部细节,并且森林路径相较于周边环境的纹理信息更少。因此,该预处理方法适用于这两类场景中。

Fig.6 Feature maps of Fig.4(a)and Fig.4(b)图6 图4(a)和图4(b)对应特征图

大多数现有的深度学习算法只考虑颜色或深度特征,无法从多角度学习和分辨目标。因此,本文应用深度学习模型从两方面——颜色和纹理特征发现和学习有意义的图像信息,这有助于提高复杂森林环境下路径识别的准确性。如图5所示,RGB图和特征图分别为2CDNN模型中两个网络通道的输入。

3.2 网络结构

传统的卷积层在信息传递中或多或少会存在信息的丢失和损耗,而深度残差网络的越层连接可以直接将输入信息跨越中间层传输到后层,一定程度上保证了信息的完整性。深度残差网络的另一个特点是能够解决网络变深后的性能退化问题。本文提出的网络结构由两列相同的深度残差网络构成,如图5所示。单个网络主要基于深度残差网络TrailNet[26],并在TrailNet的每个卷积层后额外添批归一化操作(batch normalization,BN)。批归一化操作使输入数据服从均值为0、方差为1的分布,公式如下:

其中,x(k)为输入数据的第k维,E[x(k)]、分别表示该维的均值和标准差,表示批归一化变换后的值。之后利用式(4)对上式结果施加一个反变换,还原出上层需要学习的数据分布:

式中,γ和β为可学习变量,y(k)为批归一化最终值。批归一化操作保证每层的输入数据分布稳定,从而达到加速训练的目的。

以一列通道为例,其具体结构如图7所示。网络输入为裁剪成320×180大小的RGB图像。网络由4个残差模块组成,每个残差模块包括两个卷积层和一个恒等映射。整个网络加权层总数为18。除了第一个卷积核为7×7,其余均为3×3大小。部分层利用步长为2的卷积层进行下采样,卷积核数量增加一倍但特征映射大小减半,从而能保持时间的复杂度不变。每个卷积层后都进行批归一化操作,使数据分布稳定。池化层选用平均操作,最后输出通道为3,分别表示无人机飞行方向为左转、直走和右转三类的概率。

3.3 结果融合

为了进一步提高模型的判断准确率,本文尝试了多种方法,最终采用点乘方式将两路网络结果进行融合。模型中两个网络的输出结果都是一个概率向量,里面包含三个概率值,分别表示飞行方向为右转、直行和左转的概率。点乘融合是将两个网络输出的概率向量逐个元素相乘,结果向量中的最大值为该测试图像的识别结果,其索引对应的标签即为最终预测的飞行方向。表达式如下所示:

其中,label表示图像标签,v1、v2代表概率向量,∘为点乘运算,Fin()表示为寻找最大值索引的函数。若两个网络的输出向量分别为[0.012 3,0.152 6,0.835 1]和[0.002 5,0.341 8,0.655 7],三个概率值从左到右的标签为右转、直行和左转,因此两个网络判断的飞行方向均为左转。将两个向量进行点乘得到最终输出向量为[3.075E-05,0.052 2,0.547 6],取其最大值对应的标签,则网络判断飞行为左转。这是两个网络输出标签一致的情况。当图像中路径定位较难判断时,往往会导致两个网络输出标签不一致。如向量[0.458 3,0.431 2,0.110 5]和[0.263 5,0.701 4,0.035 1],前一个向量中右转和直行概率接近,而另一个向量中直行概率明显高于左转。利用点乘融合可以得到的向量为[0.120 8,0.302 4,0.003 9],即直行。因此,点乘融合可以纠正大部分因路径定位模糊导致的单个网络误判。

4 性能评估

为了验证提出的2CDNN模型性能,本文实验主要从以下两方面进行:

Fig.7 Network architecture used in 2CDNN图7 2 CDNN中的网络结构

(1)比较不同的预处理方法、融合方法,前期融合与后期融合的差异以及该模型与其他网络架构的对比。所有对比实验均在IDSIA数据集上进行。

(2)在仿真环境AirSim下的森林场景利用该模型判断无人机的飞行方向,画出其飞行轨迹。

4.1 实验配置

4.1.1 数据集处理

本文采用针对森林环境下路径跟踪的数据集IDSIA作为网络的训练和测试数据集。该数据集在多样的道路类型和环境下从3种不同角度(朝左30°、正面以及朝右30°)拍摄森林路径,道路类型包括从倾斜狭窄的高山小路到宽阔的森林小路,环境有晴天、阴天和下雪等。根据文献[26]进行训练和测试数据集的划分,路径001、002、004、007和009为训练集,005、006为验证集,003、008和010为测试集。此外,本文采用多种经典方法进行数据增强,包括轻度的仿射变形、随机翻转和旋转等,从而进一步增加样本数量,提高识别率和网络泛性能力。

4.1.2 实验平台

(1)所有的实验均在一台工作站上完成,工作站配置了主频3.6 GHz的Intel®CoreTMi7-4790 CPU,8 GB内存。该工作站还配置了英伟达的TITAN X显卡,用于完成神经网络的训练。软件平台为业界广泛采用的深度学习框架Caffe(convolutional architecture for fast feature embedding)。

(2)该模型的仿真实验主要在AirSim环境下进行。该环境是微软推出的用于模拟无人机飞行的开源工具,通过人工智能(artificial intelligence,AI)技术提供详细的三维街景,包括交通灯、公园、湖泊等。本文采用该环境提供的森林场景,利用2CDNN模型判断无人机的飞行路线。

4.2 2CDNN模型在IDSIA数据集上的评估

本文针对2CDNN模型在IDSIA数据集下的训练和测试进行了多种对比实验。网络训练采用Xavier初始化权重,一次迭代128张训练图片(batch size),一共训练了20个循环(epoch)。网络采用牛顿加速梯度(Nesterov accelerated gradient,NAG)优化器,初始学习率(base learning rate)设置为0.001,该学习率经过20个循环后下降为0.000 01。实验主要步骤如下:

(1)利用训练集中的RGB图对单网络(如图7)进行训练,训练后的网络在测试集上测试,获得飞行方向的识别正确率。

(2)对数据集中的图像利用4种预处理方法获取特征图,分别为边缘提取、直方图均衡、CIELab色彩域转换结合边缘提取以及直方图均衡结合边缘提取。训练和测试按照(1)中步骤进行,获得测试集的正确率。

(3)分别采用平均融合和点乘融合的方法将(2)中4种预处理方法获取的识别正确率与(1)中RGB图的识别结果相融合。

(4)将RGB图与文中3.1节预处理方法得到的特征图进行叠加,获得与前期融合相同效果的叠加图,训练和测试按照(1)中步骤进行,获得测试集正确率。

(5)选取几个目前较为主流的网络架构在数据集上按照(1)中步骤进行训练与测试。

表1给出了各预处理方法在单网络通道以及与RGB图测试结果平均融合、点乘融合下的识别率。由表可得出以下结论:(1)相较于其他三种方法,直方图均衡结合边缘提取的方法在单网络通道下的识别率最高,达到87.94%。这表明,增强局部细节并突出边缘纹理信息能更好地提高路径感知性能。(2)双网络通道结果融合明显提高了识别率。这是由于结果融合能够很好地综合两路信息优点,达到信息互补的目的。(3)点乘融合方法明显优于文献[27]中的平均融合,能够进一步提高识别准确率。

Table 1 Comparison of various preprocessing methods表1 预处理方法比较

1)该部分只用RGB图作为网络输入,为了与有预处理方法的网络结果进行比较,因此没有融合的结果。

此外,输入为直方图均衡结合边缘提取的特征图比输入为RGB图在单网络通道下的判断准确率有所提升,主要体现在对低密度场景中路径位置的正确判断,如图8所示。其中,图8(a)为网络误判的RGB图,图8(b)中为其判断正确的对应特征图。图8(a)中两张图的标签分别为直行和左转,但由于该场景下树木稀疏,路径周围较为空旷,导致网络在这两张RGB图下误判飞行方向为左转和右转。而通过本文方法获得图8(a)的特征图,如图8(b)所示,能够很好地显示图中的局部细节。可以看出,图中路径部分的纹理细节明显少于周边环境,因此可以很清楚地表示出路径位置。网络对特征图的正确判断使2CDNN模型在结果融合时能够大概率地纠正网络对RGB图的误判,从而提高测试集的整体识别率。此外,图9显示了网络判断正确的RGB图及其误判的特征图,此情况多出现于光照对比强烈的场景中。这类两路网络判断有偏差的情况绝大部分在融合后得到解决,两个结果向量通过点乘融合能够获得正确的判断结果。由此可见,采用两路网络融合的2CDNN模型才能达到信息相互弥补的目的,取得更优效果。

Fig.8 Success cases fusing results of RGB images(detected wrong)and their feature maps(detected right)图8 融合RGB图(误判)和其特征图(判断正确)结果后判断正确的场景

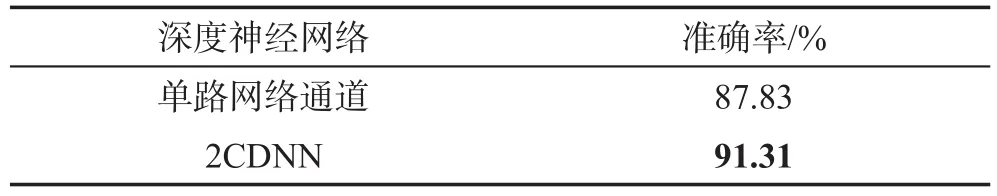

为了展示2CDNN模型在提高识别率上的出色表现,本文对单路网络通道和2CDNN模型进行了对比。单路网络通道输入为RGB图与特征图相加获得的叠加图,等同于图像信息的前期融合;2CDNN模型的两路输入分别为RGB图和特征图,测试结果如表2所示。可以看出,2CDNN的识别率比单路网络对于叠加图测试识别率要高出3.48%。这表明信息的后期融合在识别性能上的效果要优于前期融合。

Fig.9 Success cases fusing results of RGB images(detected right)and their feature maps(detected wrong)图9 融合RGB图(判断正确)和其特征图(误判)结果后判断正确的场景

Table 2 Accuracy comparison between DNN and 2CDNN表2 单路网络通道和2CDNN准确率对比

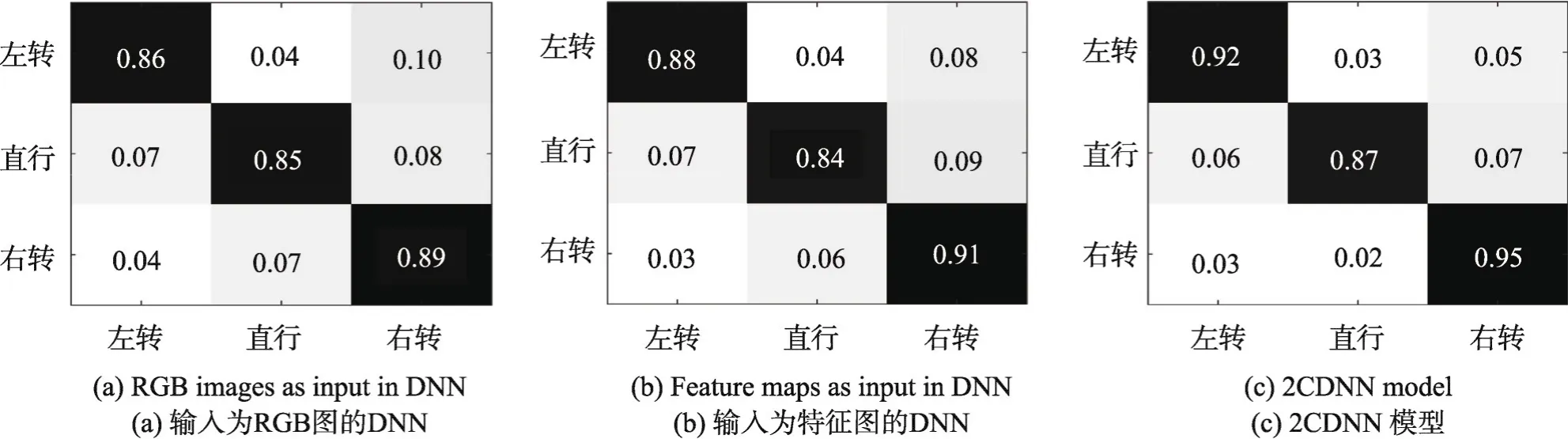

图10给出了单网络通道输入分别为RGB图、特征图的混淆矩阵以及2CDNN模型的混淆矩阵。图中纵坐标为标签,横坐标为网络判断结果,表格内容为统计概率。从图中可以看出,2CDNN显著提高了标签为左转和右转的准确率,特别是右转方向提升到了95%。此外,相比于文献[25]方法,2CDNN不仅提高了整体的判断准确率,而且针对上文提到的左转误判为右转以及右转误判为直行的问题也得到了较大的改善,误判率分别从10%、10%降低到5%和2%。

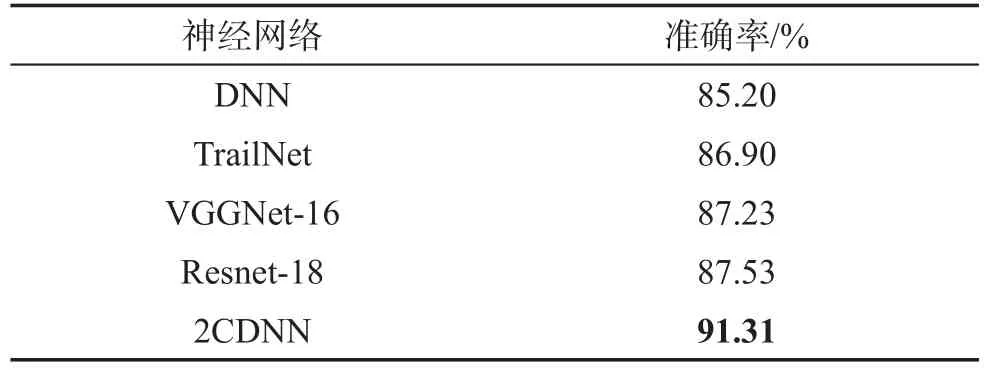

另外,本文使用不同网络架构在IDSIA数据集上进行测试,将其识别结果与2CDNN模型进行比较。本文选用了 DNN[25]、Trailnet[26]、VGGNet-16[33]和 Resnet-18[34]与本文方法进行对比,结果如表3所示。DNN、Trailnet、VGGNet-16和Resnet-18网络输入同为RGB图。表3结果显示,2CDNN网络显著提高了识别性能,这说明了残差网络的越层学习结合直方图均衡和边缘提取的预处理有助于提取路径更本质和抽象的特征,有效提高路径位置判断准确性。

Fig.10 Confusion matrices for DNN and 2CDNN on IDSIAdataset图10 DNN和2CDNN在IDSIA数据集上的混淆矩阵

Table 3 Comparison of proposed method with different network architectures on IDSIAdataset表3 不同网络架构在IDSIA数据集的识别率

4.3 2CDNN模型在AirSim环境下仿真实验

为了体现2CDNN模型在无人机自主飞行应用中的可行性,本文利用AirSim下的3D森林场景对2CDNN模型进行测试。

4.3.1 仿真实验方案

森林环境中囊括多种不同情况,例如光照角度不同、森林密度不同、路径弯曲程度不同等。本文选取一段环境较为复杂的森林步道,这段步道俯视图如图11所示,红色曲线为正确的森林步道,起点为坐标轴位置。利用遥控器人为控制场景中的模拟无人机沿着森林步道飞行,通过无人机上搭载的一个正面朝前的相机来收集飞行过程中的图像,形成一个数据集做2CDNN模型在该森林步道下的飞行测试集。通过2CDNN模型对飞行测试集中的图像进行方向判断,根据判断结果按照采集图像的顺序在图11中画出该模型判断的飞行轨迹,由图中紫色虚线表示。

4.3.2 仿真实验结果及分析

从图11中可以看出,飞行轨迹基本上与人为控制的选择结果相符,表明所提出的2CDNN模型能够识别路径位置并判断正确的飞行方向,从而安全穿过森林。此外,飞行轨迹有几处偏离正确路径,大多为岔路口或光线太暗导致的失误,之后在飞行过程中会逐渐回归正确步道,具体情况如图12。图12(a)中为判断正确的场景图,可以看出,光照造成的部分阴影对模型的判断没有影响,在弯曲步道处也适应良好。而图12(b)中误判的场景显示,由于树冠过于茂密导致整个路面处于黑暗中,使得模型无法判断路径位置。另外,在多条道路交叉的路口处飞行方向的判断具有随机性。

Fig.11 Top view of flight trajectory in forest图11 森林场景下无人机的飞行轨迹俯视图

Fig.12 Success and failure cases inAirSim图12 AirSim环境下判断正确和错误的场景

5 总结

本文提出了一种深度学习模型——2CDNN,使得无人机能够根据一张图像判断在森林环境下沿着森林路径的飞行方向。2CDNN利用两个相同的残差网络构建一个简单的融合模型,残差网络利用越层连接实现较深网络的训练,提高识别准确率的同时能够加快网络收敛速度。模型包括两个输入通道,在获取RGB图突出颜色信息的同时,采用直方图均衡结合边缘提取获得特征图以突出路径局部细节和边缘纹理信息。最终将两个结果向量通过点乘方法进行融合,以提高2CDNN的识别性能。在IDSIA数据集上的实验表明,本文提出的网络模型在准确性方面优于现有模型,提高了无人机在森林环境中路径感知和方向判断的准确率。因此,本文方法在无人机自主导航方面具有较高的实际应用价值。