多民族人脸和眼动情感数据库的构建

2018-11-21缪立欣苏日娜邢淑敏段晓东

缪立欣,苏日娜,邢淑敏,段晓东

(1.大连民族大学 a.计算机科学与工程学院;b.大连市民族文化数字技术重点实验室,辽宁 大连 116605;2.北方民族大学 计算机科学与工程学院,宁夏 银川 750000)

在情感研究中,研究者们对面部表情识别[1-2]、语音识别[3-4]和脑电信号等信息融合来识别和分析人类情感。眼睛作为面部的主要器官,也是反映人心理活动的主要窗口,通过不同的眼神表达丰富的情感和意向。人们在交流中除了使用语言、面部表情和肢体动作表达情感之外,眼睛作为心灵的窗口也在交流中起着至关重要的作用[5-6]。所以眼动信息也成为情感分析重要的一环,Schurgin和Nelson使用眼动信息来进行人脸情感识别的研究[7],但缺乏融合表情和眼动数据的相关研究。

人脸的族群特征是人脸视觉认知中先于年龄、性别和表情识别的最重要的人脸信息之一。此外,不同民族在表现不同情绪时采用的方式既有共同点又有差别,民族属性将会在情感计算和分析中增加重要的属性元素,有利于数据的多样性。因此,一个包含多民族、数据真实的情感数据库更是多民族情感识别研究的关键。

1 数据集构建过程

1.1 实验设备的选定

融合人脸民族、表情和眼动数据需要由摄像机、Tobii眼动仪两种设备进行数据的采集工作。

(1)摄像机:考虑到后期要把录制的面部视频分解成视频帧,并截取出面部区域,如果摄像机的帧数和分辨率太低,可能会给多民族情感的研究造成不必要的情感数据误差。本文选用佳能XC10 4K影像机动态影像模式,分辨率为1920×1080 px的视频。

(2)眼动仪:眼动数据采集使用Tobii ProX3-120眼动仪录制,且与关联Tobii Studio软件系统结合使用。由于Tobii Studio的诱发刺激源可以是一个序列的图像。可采集5种数据内容,分别是:文本数据(原始注视点坐标及时间)、图片(注视点分布图,轨迹图,热点图,兴趣区,集簇图)、视频 (整个记录视频,特点片段视频,动态热点图,轨迹图flash)、表格(统计指标数据)、柱状图(统计指标数据)。

(3)数据记录计算机:实验采用台式电脑记录情感视频和眼动数据,内存6G,主频3.10GHz,操作系统Windows7旗舰版,64位系统。眼动数据是由和眼动仪配套使用的软件Tobii Studio生成,最后从该软件内,导出轨迹视频、热点图、表格等数据到电脑上。情感视频数据由Cannon摄像机采集存储到内存卡中,再导入到电脑上进行存储备份。

(4)诱导视频播放计算机:播放诱导素材的计算机是一台64位、i5的英特尔处理器的台式电脑,电脑的内存为6G,主频为3.10GHz,Windows7旗舰版的操作系统。该电脑配置两个显示器,一个显示器供给实验人员观看,另一个显示器用于实验参与人员进行相关操作。并使用漫步者电脑专用音箱连接电脑的USB接口,进行播放情感诱导视频的声音。

(5)诱导视频:本文中通过让被试者观看诱导视频的方式,诱导被试者的情感。选定6段带有不同情感色彩的诱导视频作为最终的诱导材料,六种情感分别是生气、厌恶、害怕、高兴、惊奇、伤心,在测试六种情感过程中,需要在每一段中插入可以使人平静的视频。

1.2 数据采集环境

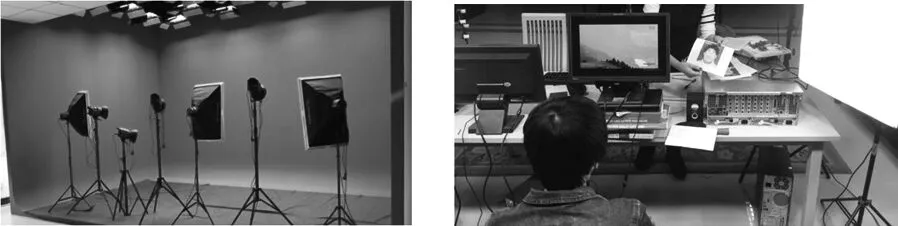

数据的采集在数字摄影棚进行,实验采集环境如图1。负责播放情感诱导视频的是一台配置了两个显示屏电脑,桌子两边放了两台立式的柔光灯补光。摄像机架在被试者面对的显示屏的后边,根据被试者的情况调节摄像头的角度和椅子的高度,以及调节暖光灯的位置,以达到拍摄画面的最佳效果。

(a)实验整体环境 (b)数据采集场景

1.3 采集过程

由于不同的人心理承受能力不同,所以在实验开始前,首先询问参与实验数据采集人员是否能够承受诱发情绪视频,实验参与人员帮助被试者调整好座位和相关机器的位置,校准眼动设备,以实现最佳的数据采集效果;并将实验室内所有人的手机都设置静音模式远置于被试者周围。数据集总计录制了时间为171.24 min的面部情感视频和眼动轨迹的情感视频,完成了五个民族情感数据的采集,采集了与之对应的六种情感类型的眼动数据,每个眼动数据包含三种数据类型,最终录制的数据总量为86 G。

2 数据文件的命名规则

在对情感数据的源文件进行处理前,要对文件名称进行规范,从而更好地进行数据的管理工作[8],本文制定了多民族情感数据的文件命名规则。

(1)第1位:表示情感数据来源的类型,共有两种数据来源类型,分别表示为表情图片F(Facial Expression Picture),眼动E(Eye);

(2)第2位:被试人员的性别,由男女的英文首字母缩写组成,男性M(Male),女性F(Female);

(3)第3~4位:实验者的民族,由民族的英文缩写组成,分别是汉族HZ(Han Zu)、蒙古族MG(Mongolian)、回族HN(Hui Nationality)、壮族ZN(Zhuang Nationality)、满族MC(ManChu);

(4)第5~7位:被试人员的编号,按照情感数据录制的先后顺序从001开始(不分男女);

(5)第8~9位:6种基本情感类型(每种情感类型的缩写),高兴HP,惊奇SP,厌恶DG,伤心SD,生气AG,害怕FE;

(6)第10~11位:不同的数据类型代表的含义不一样;情感图片表示图片的情感采样点,例如02代表面部情感采样片段为2的视频片段里的图片;眼动的数据类型,Gazeplot 1,Heatmap 2,cluster 3,video 4;

(7)第12~14位:该图片的编号,按照录制的先后顺序从001开始。

面部情感图片的命名示例如下:文件名FFMG004HP06003代表从第四个参与被试的人员的第六个情感片段中截取的第三张面部表情图片,该参与者为女性,蒙古族;眼动数据的命名实例如下:文件名EFHZ003HP2代表第三个实验参与者的眼动视频轨迹,该参与者为女性,蒙古族。

3 表情图片的处理

3.1 情感图片的截取

情感图片截取是从录制的情感视频文件中截取出目标情感片段,然后从带有目标情感的视频片段中分解出关键帧。在每一种情感中,情感表现最强烈的地方做标记,标记的规则为情感的最低值到最高值再到最低值这样一个完整的过程。五位不同编号的实验被试人员所表现出来的6种面部基本情感图片如图 2,图片已经经过一系列的处理和筛选,符合目标情感且情感表现强烈,以下6张图片的名称分别为FFHZ003HP04002、FFHN004

AG01082、FMMC007DG03097、FMHN006FE01014、FFHN004SP01044、FMHZ002SD03011。

(a)高兴 (b)生气 (c)厌恶 (d)害怕 (e)惊奇 (f)伤心

3.2 图像的灰度处理

目前所进行的无论是情感图片识别的研究,还是多民族人脸识别的研究,大多数都是采用灰度表情图片作为研究的基础,需要进一步把彩色图片转为灰度图像。所谓灰度图像是用一个采样颜色的图像表示每个像素,经常使用的算法有以下三种:

(1)中值法:取彩色图片的R、G、B的分量值,并求三者的和,然后进行平均计算,即

R=G=B=(R+G+B)/3。

(1)

采用中值法把彩色图像转换为灰度数字图像的处理,得到比较柔和的灰度图像,如图3(a)。

(2)加权平均值法:根据彩色图片进行灰度处理的指标,分别给R、G、B三个分量值赋予不同的权重,三原色的值分别和自身对应的权重相乘,最后除以权重总和,所得的结果分别复制给三原色的值,即

R=G=B=(Wr*R+Wg*G+Wb*B)/(Wr+Wg+Wb)。

(2)

式中,Wr、Wg、Wb为权重,分别对应R、G、B。经过加权平均值的算法处理过的图像如图3(b)。

(3)最大值法:取三原色的分量值中最大的一个,分别赋值给G、B、R,然后赋值给R、G、B,即

R=G=B=max(R,G,B),

(3)

用最大值法对彩色图像进行灰度处理会使得图像的整体亮度增强,如图3(c)。

关于加权平均值算法,针对不同的权重值,加权平均值法将形成不同的灰度图像,由于人眼对绿色的敏感度最高,对红色的敏感度次之,对蓝色的敏感度最低,因此使三个权重之间的关系定位Wg>Wr>Wb时,得到的灰度图像将会比较合理。结合前人的理论推导和实践操作证明,当三原色的权重值分别为Wr=0.299、Wg=0.587、Wb=0.114时,得到的灰度图像最合理,即:

R=G=B=(0.299*R+0.578*G+0.114*B)/(0.299+0.578+0.114)。

(4)

按照以上三种方法对图2的伤心表情彩色图片的灰度化处理结果如图3(a)中值法、3(b)加权平均值法、3(c)最大值法。

(a)中值法 (b)加权平均值法 (c)最大值法

从图3的三幅图片的展示效果中可以看出,使用中值算法生成的灰度亮度最低,使用最大值法生成的灰度图片亮度最高,而使用权值为0.299、0.578、0.114三个权值的加权平均值法生成的灰度图片亮度适中。此外,最大值法生成的灰度图最模糊,中值法生成的灰度图次之,加权平均值法生成的灰度图像比中值算法亮度高,比最大值算法生成的图片亮度低,生成的灰度图片效果最好,故本文选择加权平均值法生成的灰度图片。

3.3 人脸面部关键区域的截取

面部关键区域的截取原则是:从带有目标情感的图片中通过相关算法截取出仅包含面部区域的人脸情感图片。从源图片中截取出仅包含人脸关键部分的范围较小的面部区域图片。眼睛、眉毛、脸颊、嘴巴、额头、鼻子、下颚是表情识别的主要识别区域,通过人脸区域算法截取出面部关键区域,算法的基本步骤为,针对图像中的人脸区域先做一个基准点标注,以鼻梁中点为中心将不是水平的的图像旋转至水平状态,图像旋转为水平的标准是与两眼连线之间的线段是否平行。

进行人脸关键区域截取采用Openface和Face-crop[9],算法实现过程如图4。把彩色图片转换为灰度图片后,截取出的人脸面部区域图片。

图4 人脸截取算法

3.4 眼动数据的处理

眼动信息就是通过使用眼动仪记录人在处理视觉信息时的眼动轨迹特征,所以眼动数据的表达方式是展现在视频的每一帧上,眼动追踪过程中的眼动轨迹如图5。

图5 眼动追踪过程中的眼动轨迹

为了管理方便,情感数据分别以两种类型存储,每种类型的文件夹下包含实验参与者的数据文件夹,每个情感参与者的文件夹下包含6种情感的情感数据文件。

由于眼动数据表达的情感不具有直观性,无法使用评判面部情感视频片段的原则一样,直接给出眼动轨迹所属的情感类型,只有以截取情感图片的视频分段时做的标记为参考,来截取某段眼动轨迹视频,然后给出此段眼动轨迹所属的情感类型;参考面部情感片段截取的时间标记眼动轨迹视频,根据标记好的眼动轨迹视频从眼动记录文件中截取出相应眼动轨迹片段存为新的视频文件。由于眼动轨迹是连续的,随着诱导视频的变化而变化,单独截取一帧的眼动轨迹图片,经过一系列的处理,最终共采集了196个眼动信息。

4 总 结

介绍了在多民族情感数据库的构建过程中进行情感采集实验的过程以及如何从情感采集实验的情感视频和眼动文件中得到面部表情图片和眼动轨迹这两种多民族情感数据,分别给出了具体的数据提取和数据挑选规则,并展示了部分面部表情图片、眼动轨迹。在情感数据采集及处理的基础上,最终建立了一个包含5个民族6种基本表情的多民族情感数据库,其中共有11 328幅表情图片、196个眼动信息的多民族情感数据。本数据集虽然采集一定数量的数据,但是少数民族较少,多民族的情感类别的数据量依然需要进一步补充,进而促进我国多民族情感识别和智能人机交互的发展。