基于线结构光的曲线焊缝焊接技术*

2017-09-28范明洋嵇保健洪磊

范明洋, 嵇保健, 洪磊

(1.南京工业大学 电气工程与控制科学学院, 南京 211816;2.南京工程学院 汽车与轨道交通学院, 南京 211167)

基于线结构光的曲线焊缝焊接技术*

范明洋1, 嵇保健1, 洪磊2

(1.南京工业大学 电气工程与控制科学学院, 南京 211816;2.南京工程学院 汽车与轨道交通学院, 南京 211167)

在实际焊接过程中,曲线焊接是工业生产中的一项重要内容,其焊接方法目前以示教焊接以及建立数学模型为主,这些方法的过程过于机械和繁杂。文中提出一种新的基于线结构光的曲线焊缝焊接技术。在实验中,首先对采集的图像进行降噪等图像处理,通过焊缝的特征点提取算法,得到焊缝的特征点坐标,最后,利用B样条曲线插值算法,将各特征点坐标进行曲线拟合。在此基础上使用一种新的算法能够实时的根据工件侧面的角度自动调节焊枪的角度,极大地提高了焊接工艺。经实验表明其实际误差约为0. 1mm,具有良好的检测精度,能够满足实际焊接的精度和需求。

曲线焊缝;线结构光;图像处理;斜交管

0 引言

随着工业自动化的不断发展,自动化焊接已经成为汽车、船舶等生产企业的发展主流。然而,在实际焊接中,经常会遇到斜交圆管插接时的相贯线焊接情况。对于管管相贯焊接而言[1],其模型即为典型的空间曲线。与此同时,为了满足焊接工艺需要时刻改变焊枪的位置和姿态[2]。

目前,国内基于线结构光的焊接机器人的应用对象是以V型口的直线焊接为主,而就曲线焊缝检测领域而言,焊缝的特征点提取往往采用离散示教的方法获得,该种方法在实际焊接中较为繁琐,不能满足自动化焊接生产的发展需求。赵洁等[3]建立了较为简便的球管相贯数学模型,但是并没有对焊枪的位姿进行深入分析,这样使得焊枪不能实时的根据焊缝曲线模型改变自己的姿态。此后,汪苏、等人提出了一种基于弗莱纳-雪列的轨迹规划[4-5]方法,该方法虽然有效的解决了复杂空间曲线位置和姿态的控制,但求解过程复杂且计算量大,实际应用效率较低。

通过简单的位姿插补轨迹规划算法已经不能满足当前的焊接要求。为此,本文提出一种基于线结构光的面向于斜交管的曲线焊缝焊接技术,该方法把机器视觉和机器人运动学很好的结合了起来,解决了曲线焊缝特征点获取过程机械且曲线轨迹模型建立困难的问题。该种方法不论是对理论研究还是生产实践都有着一定的指导意义。

1 曲线焊缝图像处理

图像处理[6]模块过程包括图像预处理、图像处理和图像识别。图像预处理操作包括中值滤波、ROI区域提取、图像二值化、图像腐蚀和图像细化等。图像处理过程主要为曲线拟合。焊缝识别主要包括特征点提取。焊缝原始图像如图1所示。

图1 焊缝原始图像

1.1 中值滤波

中值滤波对椒盐、灰尘以及飞溅等噪声具有良好的滤除作用。为此,对原始图像进行中值滤波,为兼顾处理质量和效率,实验采用5×5的滤波窗口,该窗口沿图像顺次扫描,使得与周边像素灰度差较大的像素接近周边像素值,从而在较大程度上消除噪声。

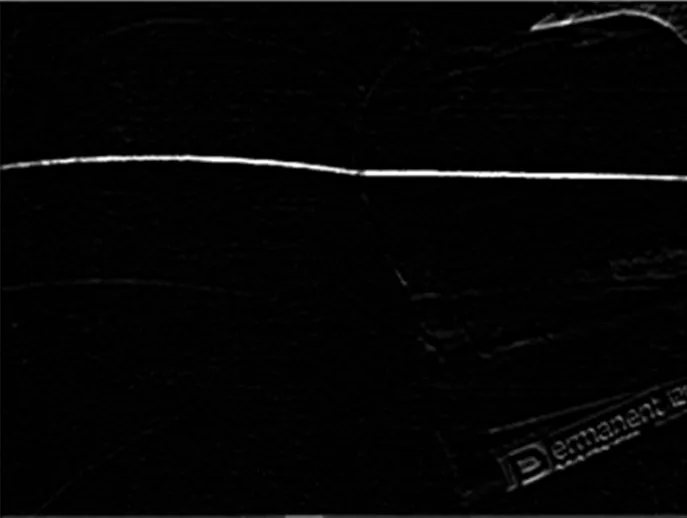

1.2 ROI区域提取与二值化

在图像处理的过程中,常常会在非感兴趣区域出现大量的噪声干扰,如曝光点等,会给图像处理工作带来极大的困难和干扰,而ROI区域的提取便会使非感兴趣区域带来的干扰得以消除,降低了数据运算规模,提高了图像处理的运算效率。ROI区域提取算法如下:

(1)读取一幅灰度图像,并将该幅图像上所有像素点的灰度值存储在一个已经定义的二维数组当中;

(2)确定ROI区域剪切图像中的各项参数值。

Xmin(剪切图像的起点的X轴坐标):设置为“1”;

Ymin:(剪切图像的起点的Y轴坐标):通过Y轴方向的灰度值扫描,找到某一列竖直方向灰度值最大的像素点位置,根据工件尺寸,以此点为参考向该点的Y轴负方向平移20~30个像素点的位置,并把此点在Y轴方向的位置数值设置为“Ymin”;

Weight:选取原图像的宽度作为“Weight”值;

Height:根据工件尺寸,将“Height”数值设置为40~50;ROI区域提取图像如图2所示。

图2 ROI区域以及二值化

假设第n列灰度值最大的像素点的位置为Y,所以得到以下表达式:

在提取ROI区域之后,利用条纹与背景的灰度差,采用动态二值化方法[7],以最大限度的减小误差并保留条纹区域。

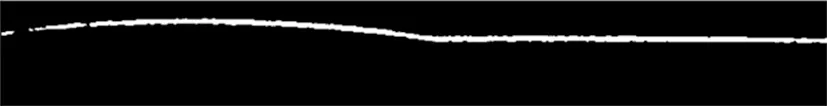

1.3 焊缝特征点提取

经过上述图像处理只能得到结构光条纹的所在区域,通常来说,条纹宽度一般远大于1个像素,这会影响测量的精度,因此,实际应用必须对获取结构光条纹进行细化处理。本文采用的图像细化算法如下:首先通过水平和竖直方向扫描,找出所有像素值为1的点,找出光带在每一列上下边界的纵坐标,分别记为y1i和y2i。光带的宽度记为△yi,中心线的纵坐标记为ymidi,所以中心点坐标为(xi,ymidi)。

本文的算法直接在细化图像上进行斜率计算,通过斜率法[8]以斜率直观的反应曲线的走向,最后确定特征点。算法的步骤为:

(1)首先从左向右不断计算以n个像素点为长度单位的线段的斜率,将整个线段的斜率以曲线的类型表示。

(2)从斜率变化曲线可以清楚的知道线段的斜率变化,通过分析得知斜率最大值所对应的点便是曲线上所需求取的焊缝特征点的位置,如图3所示。

图3 焊缝特征点提取效果图

1.4 三维重建

首先对结构光视觉传感器进行精确标定,获取摄像机内参数及结构光平面参数,详细算法参见文献[7,9];由标定得到的摄像机内参数矩阵M、光平面方程分别为:

假设在图像坐标系下的坐标(u1,v1),可以计算出P点在摄像机的焦距归一化成像平面的成像点P1c1的坐标:

由于空间点P1c1在摄像机的光轴中心点与成像点构成的直线上,即可知:

利用该直线的方程与结构光平面方程,即可得到特征点在摄像机坐标系下的三维坐标Pc=(x,y,z)。综合上述公式可得:

其中a=-0.00037;b=0.03079;c=-0.00423

通过标定可知摄像机到腕部的转换矩阵T。机器人的六自由度关节角可以从示教器上得知,经过机器人的正解可以得知机器人末端相对于机器人基座的位姿矩阵B。最后,通过式pb=B·T·pc,可求得pc点在基坐标系下的坐标pb。

2 焊枪位姿的确定与离散

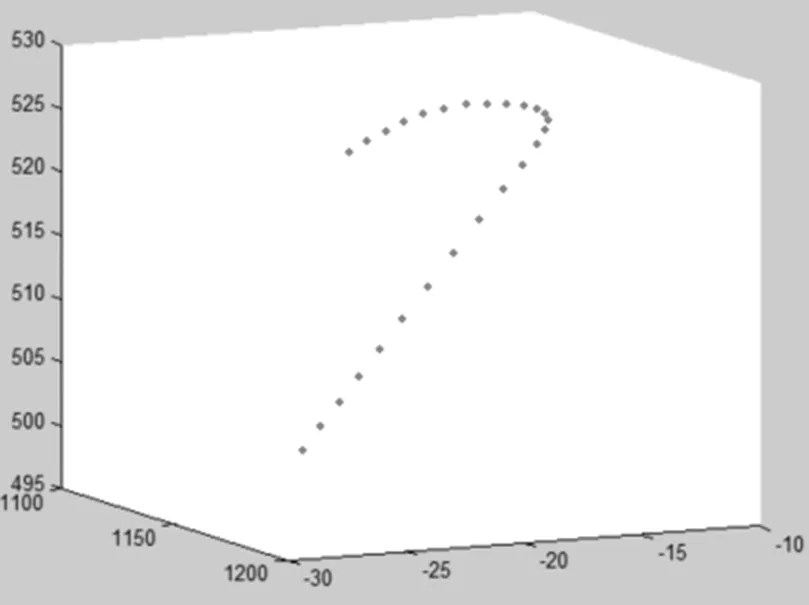

要想控制曲线自动焊缝焊接中焊枪的运动轨迹,首先要确定空间曲线焊缝的数学描述。在焊接加工中我们首先根据前期的图像处理算法以及三维重建,获取到曲线焊缝各个特征点的三维坐标,也就是型值点坐标,然后计算控制顶点。我们根据给定的型值点序列Pi(i=1,2,…,n)计算控制顶点vj(j=1,2,…,n+1,n+2),使其定义的三次B样条曲线通过点列Pi(i=1,2…,n)并以Pi为曲线段的结点。

在曲线拟合中一般需要n个型值点,在本实验中通过前期获取的6个型值点为例,把曲线段数分为5段,详细算法参照文献[10]。最终就可以求出所有的控制顶点。结果如图4所示。

图4 曲线焊缝控制顶点效果图

2.1 焊枪姿态的确定

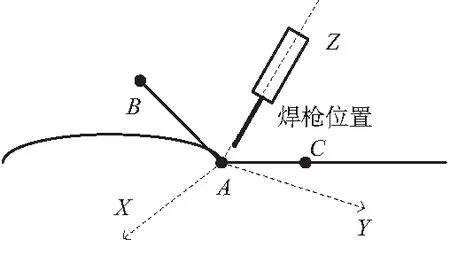

由于在焊接的过程中,需要时刻根据每个焊缝特征点的位置和斜交管的角度来确定焊枪的姿态。在本文中,在直线和曲线上各选取一个参考点C和B,其中B点在曲线焊缝特征点起点的切线延长线上,如图5所示。

图5 焊缝参考点示意图

角BAC近似表示为斜交管的侧面张角。根据焊接工艺及要求,焊枪所在的位置应为斜交管侧面张角角平分线的位置。根据B样条曲线插值得到焊缝曲线表达式U,通过对U求导,从而得到沿曲线切线方向的方向向量Xx。把向量AB和AC单位化:

初步计算焊枪尖点Z轴的方向向量:

Xz′ =AB+AC

进一步求取特征点Y轴方向的方向向量:

Xy=Xz′×Xx

显然可以得出,Xx和Xy是相互垂直的,而Xx和Xz′不能保证垂直,所以需要对Xz′的方向向量进行方向修正:

Xz=Xx×X

根据该特征点三个方向向量的确定进而可以得到该特征点所对应焊枪位置的姿态矩阵:

最后经过机器人逆运动学分析[11]验证得到的六自由度关节角和机器人示教器上的关节角大小完全吻合。

2.2 焊枪姿态的离散

根据2.1中得到的各特征点的姿态矩阵,进而求解每两个特征点之间各离散点的姿态。假设第一和第二特征点的姿态矩阵分别为R1和R2,R1和R2之间需要离散N个点。在这里我们可以得到:R1到R2的姿态变换矩阵Rot1=R1R2;利用机器人运动学求解得到R1和R2之间每个离散点之间的欧拉角梯度E1,进而得到每两个离散点之间的姿态梯度R01;最终得到第一个离散点的姿态矩阵R11=R1·R01;同理可以得到第二个离散点的姿态矩阵为R12=R1·R01·R01,以此类推求取接下来各离散点的姿态矩阵。

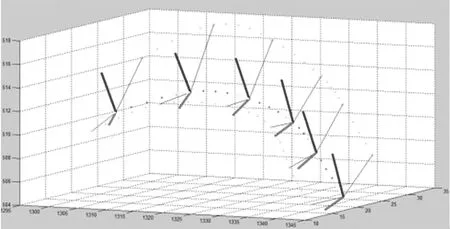

根据焊缝特征点以及离散点各姿态矩阵的确定,通过机器人运动学求解,最终得到焊缝特征点位置的四元数数值。最后把这些离散得到的焊缝特征点的四元数数值传输给机器人,以此来实现曲线焊缝各特征点位置和姿态的传输与控制。如图6所示。

图6 焊枪在各个焊缝特征点的姿态

3 实验平台与数据分析

整个焊接实验平台包括焊接执行与控制系统与视觉检测系统,焊接执行系统由6自动度工业机器人本体及其控制器、焊机系统、焊枪机构、主控机及各通信线缆组成。其中工业机器人及其控制器采用ABB1410型工业机器人和IRC5控制器、焊机及焊接电源系统采用松下YM-500GR3HGE500A系统,焊枪可装配各种尺寸直径的焊丝。视觉检测系统由CCD 摄像机、线结构光传感器和图像采集卡构成。其中线结构光传感器系统以及CCD摄像机固定安装在工业机器人的末端执行器上,构成机器人手眼系统,用于焊缝识别和位置检测。如图7所示。

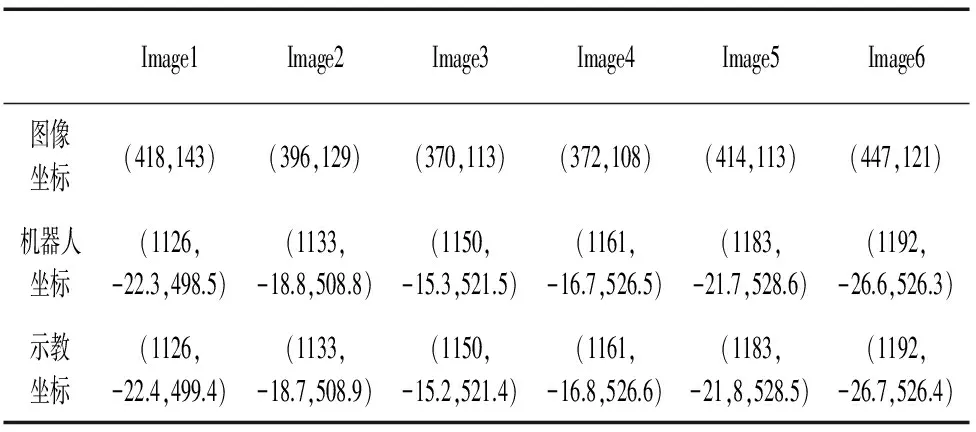

经过图像处理和三维重建,得到曲线焊缝各特征点坐标数据如表1所示。由表1可见,曲线焊缝各特征点的检测坐标与实际示教坐标相比,其误差为0.1mm,焊接精度较高。

图7 焊接实验平台

表1特征提取后特征点的坐标参数

4 结束语

为实现曲线焊缝的自动化焊接,本文提出了一种基于线结构光的视觉检测算法以及焊枪轨迹规划技术。

在焊接过程中,该种算法不仅检测效率高而且可以根据工件的夹角实时的改变焊枪的姿态,以达到最佳的焊接效果。相比较于之前通过示教获取焊缝特征点以及单一的焊接姿态有了很大的提高。当然,在实际检测的过程中,由于在机器人的焊枪标定、摄像机内外参数标定以及机器人手眼标定的过程中可能存在误差,造成实际检测和实际示教的结果存在误差。在后来的实验过程中,应多次标定求取平均值以减小标定带来的误差。经实际检测表面,其误差大约为0.1mm,误差较小,能满足工业现场的实际需求,该种算法对于进一步实现自动化加工与生产具有十分重要的参考价值。

[1] 黄世游,徐雷,任清川,等.管管相贯开孔及焊接装配模型与BP仿真[J].焊接学报,2014,35(6):53-56.

[2] 汪苏,焦茂强,李晓光,等.大型相贯线埋弧焊接工艺研究及焊枪姿态建模[J].焊接技术,2009,38(10):42-47.

[3] 赵洁,胡绳荪,丁炜,等.基于Matlab的球管相贯空间曲线焊缝的数学模型[J].焊接学报,2010,32(8):89-91.

[4] 曾翠华,张继忠,杨军.基于弗莱纳-雪列空间矢量的焊接离线编程规划[J].焊接技术,2011,40(7):44-48.

[5] Liu H, Huang s, Gai Y. Robot continuous Trajectory Planning Based on Frenet-Serret Formulas[C]//International Conference on Computer,2010:47-51.

[6] 催明,顾启民,黄震. 基于机器视觉的轴承滚动体缺陷检测算法研究 [J].组合机床与自动化加工技术,2015(11):74-78.

[7] 王帅,徐方,陈亮,等. 视觉技术在机器人零部件装配中的应用研究.[J].组合机床与自动化加工技术,2015(8):107-110.

[8] 刘国平,张华,王洪亮,等. V形焊缝特征点提取的算法研究[J]. 焊接,2006(2):36-38.

[9] 洪磊, 田啟良, 嵇保健. 基于单应性矩阵的线结构光参量标定法[J]. 光子学报, 2015,44(12):1212003-1-6.

[10] 徐绍华.空间相贯曲线自动化焊接中的轨迹规划[D].济南:山东大学,2008.

[11] 苗建伟,杨铁宝,曾林森.一种六自由度机械手的智能轨迹规划 [J].组合机床与自动化加工技术,2014(9):73-76.

(编辑李秀敏)

CurveWeldingTechnologyBasedOnLineStructuredLight

FAN Ming-yang1, JI Bao-jian1, HONG Lei2

(1.College of Electrical Engineering and Control Science, Nanjing TECH University, Nanjing 211816, China;2.School of Automotive and Rail Transit, Nanjing Institute of Technology, Nanjing 211167,China)

In the actual welding process, curve welding is an important part of industrial production. At present, the welding method is mainly through the manual teaching of welding and the establishment of mathematical model method, but the process of these methods is too mechanical and complex. In this paper, a new method of curve welding based on line structured light is proposed. In this experiment, the first work is to image noise reduction, Based on the feature point extraction algorithm, the coordinates of the characteristic points of the corresponding position of the weld are obtained. Finally, the B spline curve interpolation algorithm is used to fit the coordinates of each feature point. Based on this,A new algorithm is proposed that can automatically adjust the position and posture of welding torch, it’s improve the welding process. Experiments show that the actual detection error is about 0. 1mm, It has good detection accuracy and can meet the requirement and demand of the actual welding.

curve weld; structured-light vision; image processing; skewed tube

TH122;TG40

:A

1001-2265(2017)09-0142-04

10.13462/j.cnki.mmtamt.2017.09.037

2016-12-08;

:2017-01-11

江苏省产学研联合创新资金-前瞻性联合研究项目(BY2014005-09);南京工程学院产学研项目(281210926216083)

范明洋(1991—),男,安徽滁州人,南京工业大学硕士研究生,研究方向为机器视觉与机器人轨迹规划技术,(E-mail)1435643790@qq.com。