基于Haar-CNN模型的自然场景图像分类的研究

2017-05-15张慧娜李裕梅傅莺莺

张慧娜, 李裕梅, 傅莺莺

(北京工商大学 理学院, 北京 100048)

基于Haar-CNN模型的自然场景图像分类的研究

张慧娜, 李裕梅*, 傅莺莺

(北京工商大学 理学院, 北京 100048)

研究基于Haar-CNN模型的图像特征提取用于自然场景图像分类的问题.Haar小波变换是图像处理中常见的一种变换,可以提取图像的局部和空间信息,并把彩色图像的颜色、轮廓和纹理信息进行分层次的表达.卷积神经网络(CNN)是一种得到广泛研究与应用的深度学习模型,对图像特征具有很好的表达能力.基于Haar小波变换和CNN模型的优势,提出一种新的图像特征提取方法,即Haar-CNN模型;利用该模型提取得到图像更丰富的特征信息;然后比较基于Haar-CNN和CNN模型提取的自然场景图像特征在分类中的效果,探究Haar-CNN模型对于自然场景图像特征提取的优势.再对比在不同颜色空间上Haar-CNN模型对自然场景图像的分类效果,实验结果表明YCbCr颜色空间上的分类精度最高,为96.2%,比灰度图像的分类精度提高了7.8%.同时,进一步分析Haar-CNN模型中图像块大小、隐藏层神经元个数、池化区域大小、模型深度等参数对图像分类精度的影响,实验结果表明参数选择对图像分类很重要,合适的参数选择可以提高分类精度.

图像分类; 深度学习; Haar-CNN模型; 颜色空间

随着高新技术的创新和发展,人工智能和机器学习越来越受到研究者们的关注.如何利用计算机自动提取特征和自动进行图像分类,已经发展成人工智能和计算机视觉领域的重要研究课题之一.自然场景图像分类是基于图像分析[1]开展起来的,在模式识别和人工智能中有着重要的作用.图像分类一般需要人为构造有效底层特征(如颜色特征:颜色直方图[2]、颜色矩[3]、颜色相关图[4]等;形状特征:HOG[5]、BOVW[6]、SIFT[7]等;纹理特征:LBP[8]、灰度共生矩阵[9]等),然后将提取得到的特征送入分类器进行分类.随着研究的不断深入,发现人为构造的底层特征已不能够很好地表达图像的内容,特征严重冗余且维数高,泛化能力差,于是如何从原始图像中自主学习出高层特征已成为研究热点.

CNN模型[10]是深度学习中一种有效的自主学习特征的方法,可以从原始图像中重构图像的高层语义特征,利用权值共享提高训练性能.目前该模型已成功应用于手写字符识别[11]、人脸识别[12]、MNIST识别[13]等领域,在图像分类[14]中表现出很好的效果,受到了许多研究者的关注.

Haar小波变换是常用的一种变换分析方法,通过低通和高通滤波器把图像分解为:低通低通(LL)、低通高通(LH)、高通低通(HL)和高通高通(HH)的表示.LL分量图像是在原图像上进行降采样得到,在不显著降低质量的前提下对信号进行压缩和消噪等处理,同时也对原图的颜色特征进行了更集中的表达,LH、HL和HH分量将提取图像水平、垂直和对角的轮廓和纹理信息,在信号分析、图像处理和计算机视觉领域应用十分广泛[15].

彩色图像在图像中包含丰富的颜色信息.相比于灰度图像,彩色图像在模式识别中具有更加丰富的特征信息,尤其是在图像分类的应用中[16].目前已有研究者探究Haar小波变换和颜色空间对图像分类效果的影响.将Haar小波变换用到各个颜色空间上对图像进行变换,然后提取出的特征对图像分类效果更佳[17].

针对人工构造提取特征算法繁琐,特征信息严重冗余,泛化能力差的问题,本文结合了Haar小波变换和CNN的优势,提出一种新的图像特征提取方法:Haar-CNN模型,对比传统CNN模型与Haar-CNN模型在自然场景图像特征提取和分类中的性能,通过在自然场景图像库中实验,探究了Haar-CNN模型在不同颜色空间中对自然场景图像分类的效果,分析了Haar-CNN模型中图像块大小、隐藏层神经元个数、池化块大小、神经网络的深度等参数对分类结果的影响.

合适的参数选择可以提高Haar-CNN模型对自然场景图像分类的精度.实验结果还表明Haar-CNN模型提取了更丰富的局部和空间信息,后续分类效果优于传统CNN模型提取出来的特征,在YCbCr颜色空间上的分类效果最高,为96.2%,比灰度图像的分类精度提高了7.8%.

1 深度学习模型介绍

1.1 稀疏自编码器 自编码神经网络[18]是一种无监督学习算法,让输出值等于输入值,尝试学习一个恒等函数hw,b(x)≈x,其中

w1和b1为第一层的权值和偏置项,w2和b2为第二层的权值和偏置项,f和g为激活函数.图1是最典型的自编码神经网络结构,该结构包含了一个输入层、一个隐藏层和一个输出层.

如果输入数据之间存在特定关系,自编码神经网络就能通过编码和解码过程发现数据间的相关性.当隐藏层神经元个数小于输入层和输出层神经元个数时,则从输入层到隐藏层将迫使该网络对输入数据进行压缩表示,这是编码过程.然后,从隐藏层到输出层重构原来的数据,这是解码过程.相反,如果隐藏层神经元个数大于或等于输入层和输出层时,对该网络结构引入稀疏性限制仍能挖掘出原始数据之间的关联性.加入稀疏性限制后,稀疏自编码网络的整体代价函数为

式中,第一项是均方误差项,用来衡量输入数据和重构数据之间的误差;第二项是权重衰减项,用来减小权重的幅度,防止过度拟合;第三项是稀疏项

其中

表示隐藏层神经元的平均激活度,稀疏性由ρ值来调节,β控制稀疏性惩罚因子的权重.将输入数据经过自编码神经网络模型的训练,通过控制该网络的整体代价函数,待迭代算法收敛或达到最大收敛次数,就训练好了该神经网络的权值w和偏置值b.

1.2CNN模型CNN最早出现于20世纪80年代,文献[19-20]开启了深度学习的大门,使得CNN受到了广泛的关注和应用.CNN模型是建立在传统人工神经网络上的一种深度学习算法,也是第一个成功训练多层网络的学习算法.

传统的CNN模型由卷积层和降采样层交替构成,通过局部感受野、权值共享和降采样来获得缩放和旋转不变性[10].通过局部感受野,神经元可以提取低层的特征;权值共享大大减少了卷积神经网络的参数,提高计算效率;降采样降低了噪声和旋转对图像特征的影响,增强了特征的泛化能力.图2展示了灰度图像基于CNN模型的图像特征提取过程.该模型包括一个卷积层、一个池化层和一个全连接层,是基本的CNN网络结构.如果对于彩色图像,将其R、G、B通道分别送入CNN模型提取特征,然后将特征融合到一起得到彩色图像的CNN特征.

卷积操作是CNN的核心,其作用类似图像的边缘检测,其中,卷积层中每个神经元的权值矩阵称为卷积核.该模型中,每一个特征图与前一层的部分特征图建立联系,输入图像和卷积核进行卷积,通过激活函数形成S1特征图.一般地,当前层的输入可以表示为

其中,l表示层数,W和b表示由稀疏自编码已训练好的当前层的权值和偏置项,g代表激活函数,通常为sigmoid或tanh函数,在卷积层后对输出结果进行调整.

池化层是为了防止特征过拟合,减小计算量,对卷积后特征的不同位置进行降采样的操作.本文实验采用最大池化的方式,将池化后的特征通过一个全连接网络(特征融合),得到最终特征.

1.3Haar-CNN模型 小波分析是一种信息窗口大小固定但其形状、时间窗和频率窗都可以改变的时频局部化分析方法.Haar小波变换[21]是其中的一种,通过加强局部对比提取局部特征,由尺度和小波基函数形成.Haar尺度函数可以定义为

一族函数通过尺度和变换从尺度基函数中产生

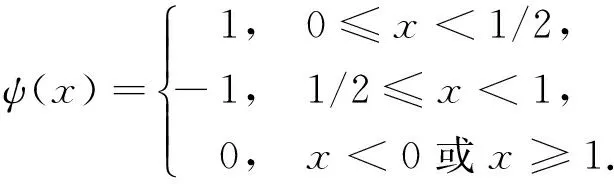

Harr小波函数可以定义为

Haar小波通过尺度和变换从母波基函数中产生

图3展示了灰度图像Haar小波变换的过程,通过低通和高通滤波器将灰度图像分解成低通低通(LL)、低通高通(LH)、高通低通(HL)和高通高通(HH)4个部分.图4展示了彩色图像Haar小波变换的过程,对图像进行了分层次的表达,对彩色图像R、G、B通道分别进行类似灰度图像Haar小波变换的过程,最后对3个通道得到的变换图像进行抓取得到彩色图像Haar小波变换的图像.显然,LH、HL和HH展现了彩色图像水平、垂直和对角方向的轮廓和纹理信息,且图像最主要的信息都集中在低频子图LL中,去掉图像的高频部分并不影响对图像的理解,LL分量很好地表达了彩色图像的主要信息,故实验只选取LL分量提取图像特征.

Haar-CNN是先对图像进行不同水平Haar小波变换,对原始图像做一次Haar小波变换,得到LL分量,记为LL1图像,再对LL1做一次Haar小波变换,得到相应的LL分量,记为LL2图像.然后对原图像、LL1和LL2提取图像块(对彩色图像R、G、B通道提取同一位置的图像块),并对图像块进行归一化、ZCA白化的预处理过程,将其输入到稀疏自编码器训练参数W和b,这是CNN参数训练的过程.这里训练好的参数W和b将作为CNN模型中的参数.将原图、LL1和LL2分别输入CNN训练,就可以得到相应的原图像CNN特征、Haar1-CNN特征和Haar2-CNN特征,最后将3个特征融合,得到彩色图像的Haar-CNN特征.图5展示了Haar-CNN特征的提取过程.

2 不同颜色空间的Haar-CNN的图像分类

下面主要介绍5个彩色空间,分别为RGB、rgb、HSV、YCbCr和∘RGB颜色空间[17].彩色图像包含了3个颜色通道,每个像素点都可以用3个值来表示.

∘RGB颜色空间是彩色图像最常见的三基色空间,由红色、绿色和蓝色3种基色构成.其他颜色空间均是由RGB颜色空间通过线性或非线性变换而得到.

为了减小RGB图像对光照和角度变化的影响,rgb颜色空间通过归一化RGB颜色空间的3个通道得到.

HSV颜色空间由人类视觉系统而来,是RGB颜色空间的非线性变换

V=MAX.

YCbCr颜色空间是RGB颜色空间的线性变换

RGB颜色空间有3个通道:L、C1和C2.颜色信息包含在C1和C2中,且C1取值范围为[-1,1],C2的取值范围为[-0.866 0,0.866 0],L通道包含了亮度信息且其范围为[0,1],

图6展示了不同颜色空间中基于Haar-CNN特征的图像分类过程.首先,将图像转换到5种不同的颜色空间,然后分别对每个空间中的图像提取Haar-CNN特征,用PCA得到各个颜色空间中最具图像表达力的特征,最后利用SVM对图像进行分类.

3 实验数据和实验效果

3.1 实验数据 本文实验的1 000张图像来自Corel图像库的图像,且均为常见的自然图像.Corel图像库[22]一共由1 000张彩色图像构成,分10个类别:非洲人、沙滩、古建筑、公共汽车、恐龙、大象、花朵、马、雪山和西餐.图像大小为256×384或者384×256像素,均为彩色图像,每类有100张图像.图7为Corel图像库中的示例图像.

实验中,训练图像和测试图像均来自Corel图像库,从图像库的每类中随机选取50张图像作为训练样本,其余的50张图像作为测试样本,并记录相应的类别标号.最终,训练样本共500张图像,测试样本共500张图像.由于图像大小不一致,且受到电脑内存的限制(8 G内存),这里将图像统一缩放到100×100像素大小.

3.2 实验结果与探讨 主要比较了Haar-CNN模型和传统CNN模型对自然场景图像分类的效果,对比了Haar-CNN模型在不同颜色空间中对自然场景图像的分类精度,讨论了Haar-CNN模型中参数对图像分类的影响,分析了如何选取Haar-CNN模型中的最佳参数.为保证实验数据和结果的稳定性,训练集和测试集将随机选取5次,并重复实验5次,取分类结果的均值作为最终的分类精度.

一般地,彩色图像由RGB的3个通道组成,这里同时提取RGB 3个通道同一位置的图像块,将各个图像块按照R、G、B顺序排列成一个长向量.当图像块的大小为8×8,且图像块的数量为100 000时,对图像中RGB的每一个通道来说,将得到64×100 000大小的图像块特征向量,从而对彩色图像就得到192×100 000的图像块特征向量,然后进行预处理并送入稀疏自编码器去训练,得到参数W和b,对其他颜色空间类似进行特征提取.以下实验将采用固定其他参数,而只变化一种参数的方法来探究各个参数对图像分类效果的影响.

3.2.1 Haar-CNN与CNN的比较 探究了Haar-CNN与传统CNN模型对自然场景图像的分类效果,得到Haar-CNN和CNN模型的分类精度分别为94.4%和92.8%.

由此可以看到Haar-CNN比CNN模型的分类精度提高了2.4%,Haar-CNN可以提取到更丰富的纹理信息和空间信息.

3.2.2 Haar-CNN模型在不同颜色空间上的分类效果 探究了Harr-CNN模型在5个不同颜色空间(RGB、rgb、HSV、YCbCr、∘RGB)中对自然场景图像分类的效果,如图8所示.

从图8中可以看出,Haar-CNN模型在YCbCr颜色空间中的分类效果最好,达96.2%,其次是∘RGB、RGB、HSV、rgb颜色空间,对应的分类精度分别为95.6%、94.4%、93.8%、92.6%,而灰度图像的分类精度为88.6%.YCbCr颜色空间上的分类精度比灰度图像的分类精度提高了7.6%.显然,颜色信息对图像分类并不是冗余的,在一定程度上可以提高图像分类的精度;因此,以下实验将选择YCbCr颜色空间,探究Haar-CNN模型中的参数的变化对图像分类效果的影响.

3.2.3 图像块大小的影响 实验中,图像块大小影响着Haar-CNN模型对图像分类的效果.本文固定其他参数,选取8×8、16×16和32×32等3种大小图像块,从所有图像中提取40 000个图像块对图像进行分类,探究了当隐藏层神经元个数为50、60、70、80、90和100的条件下,3种图像块大小对图像分类精度的影响,如图9所示.

从本实验分类效果来看,当固定其他参数时,图像块为16×16的分类效果最好,且对于不同的隐藏层神经元个数,16×16图像块的整体分类精度要普遍高于8×8和32×32图像块的分类精度.实验表明,不同大小的图像块包含不同的特征信息,图像块太小不足以表达图像的特征,图像块太大容易引入噪声干扰.因此,选取合适的图像块大小,对图像特征表示和图像分类具有重要意义.

3.2.4 隐藏层神经元个数的影响 固定其他参数,探究当图像块选取16×16时,隐藏层神经元个数对自然场景图像分类效果的影响,实验结果如图10所示.

从图10不难发现,当固定其他参数和图像块大小为16×16时,图像的分类精度随着隐藏层神经元个数的增加而呈现出先增再减的趋势.

当隐藏层神经元个数为50时,图像的分类精度较低,为80%左右.当增加隐藏层神经元个数至90时,图像分类精度迅速增加至96.5%.继续增加隐藏层神经元个数,此时分类精度不增加,反而呈下降趋势;因此,本文选取隐藏层神经元个数为90时就足以表达图像特征了,其分类精度达到了96.5%.

同时,图11进一步实验了当图像块大小为8×8或32×32时,隐藏层神经元个数对图像分类效果的影响.实验结果与图10一致,显示分类精度随着神经元个数的增加而表现出先增再减的变化趋势.

3.2.5 池化区域大小的影响 探究当图像块为16×16,隐藏层神经元个数为90的情况下,池化块区域的大小对Corel图像库分类精度的影响,实验结果如图12所示.

由图12可知,图像分类精度受池化区域大小的影响,并随着池化区域大小的增加而呈现先递增再递减的变化趋势.池化区域太小,不能达到减少计算量的优势;池化区域较大,容易将不同特征聚合,干扰图像分类的准确率.当池化区域大小为10×10时,Corel图像库分类精度最优,达到96.8%,因此,合适的池化区域的选取,对图像特征的表达和图像分类有着重要的影响.

3.2.6 网络深度的影响 进一步研究了增加一层网络深度对图像分类效果的影响.Haar-CNN模型层数分别为1和2时,分类精度分别为96.2%和97.8%.由此可见,当增加Haar-CNN模型的深度时,对Corel图像库分类精度进一步提高.由于仅含有一层深度的Haar-CNN模型对图像分类效果已达到较高的准确率,故再增加一层深度对图像分类精度的提高并不是很明显.文献[23]说明了过多的层数也会导致过拟合,影响深度学习的泛化能力,因此,合适的模型深度对Haar-CNN模型的分类精度也有重要的影响.

4 结束语

本文结合Haar小波变换和CNN模型的优点提出Haar-CNN模型,提取了图像时空上丰富的特征信息,提高了对图像分类的精度.以Corel自然场景图像库为数据,对比了Haar-CNN模型与传统CNN模型对自然场景图像分类的效果,实验结果表明:Haar-CNN可以提取更丰富的空间信息和纹理信息,明显提高了分类精度.然后,研究Haar-CNN模型在不同颜色空间上对自然场景图像的分类效果,更进一步表达了各个颜色空间对于颜色表达的不同程度上的重要性.同时,探究Haar-CNN模型中各类参数对图像分类效果的影响,实验依次研究了Haar-CNN中图像块大小,隐藏层神经元个数,池化区域大小,模型深度对图像分类精度的影响,表明合适参数的选取对图像分类效果的重要性,且可以提高分类精度.

[1] 彭辉. 基于纹理特征的图像分类识别[J]. 计算机与信息技术,2007(10):16-20.

[2] 王向阳,杨红颖,郑宏亮,等. 基于视觉权重的分块颜色直方图检索算法[J]. 自动化学报,2010,36(10):1489-1492.

[3] 杨红菊,张艳,曹付元. 一种基于颜色矩和多尺度纹理特征的彩色图像检索方法[J]. 计算机科学,2009,36(9):274-277.

[4] 李永芳. 基于颜色相关图和纹理矩的图像检索[J]. 计算机应用与软件,2011,28(10):38-42.

[5] DALAL N, TRIGGS B. Histograms of oriented gradients for human detection[C]//IEEE Conference on Computer Vision and Pattern Recognition,2005,1(12):886-893.

[6] BOLOVINOU A, PRATIKAKIS I, PERANTONIS S. Bog of spatio-visual words for context inference in scene classification[J]. Pattern Recognition,2013,46(3):1039-1053.

[7] LOWE D G. Distinctive image features from scale-invariant keypoints[J]. Inter J Comput Vision,2004,60(60):91-110.

[8] OJALA T, PIETIKAINEN M, MAENPAA T. Multiresolution gray-scale and rotation invariant texture classification with local binary patterns[C]//IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(7):971-987.

[9] 薄华,马缚龙,焦李成. 图像纹理的灰度共生矩阵计算问题的分析[J]. 电子学报,2006,34(1):155-158.

[10] ZEILER M D, FERGUS R. Visualizing and Understanding Convolutional Networks[M]. New York:Springer International Publishing,2013:818-833.

[11] 高学,王有旺. 基于CNN和随机弹性形变的相似手写汉字识别[J]. 华南理工大学学报(自然科学版),2014,44(1):72-76.

[12] 汪济民,陆建锋. 基于卷积神经网络的人脸性别识别[J]. 现代电子技术,2015,38(7):81-84.

[13] 余萍,赵继生. 基于线性叠加特征和CNNs的图像分类方法[J]. 微电子学与计算机,2015(10):36-40.

[14] SZEGEDY C, LIU W, JIA Y, et al. Going deeper with convolutions[C]//IEEE Conference on Computer Vision and Pattern Recognition,2014:1-9.

[15] PATIDAR D, JAIN N, PARIKH A. Performance analysis of artificial neural network andKnearest neighbors image classification techniques with wavelet features[C]//International Conference on Computer Communication and Systems IEEE,2015:191-194.

[16] VERMA A, BANERJI S, LIU C. A new color SIFT descriptor and methods for image category classification[C]//Proceedings of 6th International Conference on Computer Vision,2010:1-8.

[17] BANERJI S, SINHA A, LIU C. Scene image classification:some novel descriptors[C]//IEEE International Conference on Systems, Man, and Cybernetics,2012:2294-2299.

[18] BENGIO Y. Learning deep architectures for AI[J]. Foundations and Trends in Machine Learning,2009,2(1):1-127.

[19] LECUN Y, BOSER B, DENKER J S, et al. Backpropagation applied to handwritten zip code recognition[J]. Neural Computation,2008,1(4):541-551.

[20] HINTON G E, SALAKHUTDINOV R R. Reducing the dimensionality of data with neural networks[J]. Science,2006,313(5786):504-7.

[21] BANERJI S, SINHA A, LIU C. New image descriptors based on color, texture, shape, and wavelets for object and scene image classification[J]. Neurocomputing,2013,117(14):173-185.

[22] CHAPELLE O, HAFFNER P, VAPNIK V N. Support vector machines for histogram-based image classification[J]. IEEE Transactions on Neural Networks,1999,10(5):1055-64.

[23] LAROCHELLE H, BENGIO Y, LOURADOUR J, et al. Exploring strategies for training deep neural networks[J]. J Machine Learning Research,2009,10(10):1-40.

(编辑 李德华)

Research on Natural Scene Image Classification Based on Haar-CNN Model

ZHANG Huina, LI Yumei, FU Yingying

(SchoolofScience,BeijingTechnologyandBusinessUniversity,Beijing100048)

In this paper, we Investigate natural scene image classification based on features’ extraction of Haar-CNN model. Haar wavelet transform is one of the common transforms, which extracts local information and space information by means of enhancing local contrast. The color, contour and texture information can be expressed hierarchically by Haar wavelet transform. Convolution neural network(CNN), one kind of deep learning models which has good expression ability for image features, is widely used in image classification research and applications. Based on the advantages of Haar wavelet transform and CNN model, this paper proposes a new method to extract features, which is called Haar-CNN model and it can extract rich information from images. The image classification performance can be compared based on the feature extraction by using Haar-CNN and CNN model, and the advantages of feature extraction on natural scene image classification by using Haar-CNN model are also explored. Moreover, in different color spaces, the classification performance by using Haar-CNN model on natural scene images is compared. Here, Haar-CNN model in YCbCr color space achieves the best average classification performance of 95.6%, which rises by 7.8% compared to that in gray space. In addition, we analyze the influence of model parameters on the classification performance, such as patch size, the number of hidden layer neurons, pooling size, and the depth of Haar-CNN. Results show that selecting parameters appropriately parameter selection plays a crucial role in image classification and the classification performances can be improved greatly.

image classification; deep learning; Haar-CNN model; color spaces

2016-07-01

国家自然科学基金(11101012)和北京市优秀人才培养资助青年骨干个人项目(2015000020124G032)

TP391.9

A

1001-8395(2017)01-0119-08

10.3969/j.issn.1001-8395.2017.01.020

*通信作者简介:李裕梅(1976—),女,副教授,主要从事机器学习、人工智能与模式识别、图像处理等的研究,E-mail:liwjyumei@163.com