面向机器人航天员的3D目标识别定位算法参数优化研究

2016-10-19郝颖明付双飞

潘 旺,郝颖明,朱 枫,付双飞

(1.中国科学院沈阳自动化研究所光电信息技术研究室,沈阳110016;2.中国科学院大学,北京100049;3.中国科学院光电信息处理重点实验室,沈阳110016;4.辽宁省图像理解与视觉计算重点实验室,沈阳110016)

面向机器人航天员的3D目标识别定位算法参数优化研究

潘 旺1,2,郝颖明1,3,4,朱 枫1,3,4,付双飞1,3,4

(1.中国科学院沈阳自动化研究所光电信息技术研究室,沈阳110016;2.中国科学院大学,北京100049;3.中国科学院光电信息处理重点实验室,沈阳110016;4.辽宁省图像理解与视觉计算重点实验室,沈阳110016)

针对机器人航天员抓取目标物体时的快速识别定位问题,分析了HALCON中基于CAD模型的三维目标识别与定位算法在美国Robonaut 2视觉上的应用;对该算法的参数优化进行了研究,分析了各个参数对算法的影响效果,并对各个参数的选择原则以及协调搭配进行了探讨;最后搭建实验平台,验证了优化效果,证明这些优化提高了模板匹配的相似度,达到100%正确识别率,处理百万像素图像仅需约200 ms,且位置平均精度小于2 mm,角度平均精度小于1°。

机器人航天员;Robonaut 2;目标识别定位;3D测量;形状匹配;HALCON

1 引言

世界各航天大国都在发展空间机器人以协助或代替航天员完成空间任务。传统的机械手式空间机器人在降低航天员出舱风险、减轻航天员工作负担等方面发挥了重要作用,但随着更广泛和深入的太空探索的需要,新型的类人机器人航天员成为了航天技术研究的一项重要内容[1]。

国外典型的机器人航天员有美国的Robonaut 2[2],日本的Kirobo[3],俄罗斯的SAR-401[4],德国的Justin[5]和欧洲航天局的Eurobot[6]等。这些机器人航天员中,除了Kirobo是一个小型的聊天机器人,不从事体力工作外,其余的都要协助或代替航天员完成工作任务。其中,最具代表性的是首个进入太空的Robonaut 2。

Robonaut 2是由美国航空航天局(NASA)和通用公司合作开发的首个进入太空的人形机器人[7],其外观如图1所示。Robonaut 2主要用于完成空间站的清洁任务,配合或代替航天员进行舱外操作,或做一些重复循环的工作[8]。未来还可能从事更危险的、极端条件下的探索任务,例如火星表面的勘探任务等。现在已制造出两台Robonaut 2,其中一台于2011年2月24日乘发现号航天飞机顺利进入国际空间站[9],另外一台应用于地面试验。Robonaut 2已经能够进行抓握扶手[10]、按动控制面板按钮、使用空气流量计测量[11]以及粘贴薄膜等精细操作。

图1 美国人形机器人航天员Robonaut 2[7]Fig.1 American humanoid robot astronaut Robonaut 2[7]

机器人顺利地对目标进行操作,离不开强大的机器视觉系统[12]。Robonaut 2的视觉系统安装在金色头盔里,包括四部紧凑型彩色立体摄像机Prosilica GC2450C,其中两个摄像机的安装与人眼布局相似,能够为机器人和操作人员提供立体视觉,另外两个摄像机作为备用;嘴部安装有红外TOF相机Swiss Ranger SR4000,提供景深感知,与双目视觉形成冗余,根据不同场景应用的需要,互为补充,提高测量速度和精度[13]。

本文为快速实现3D目标识别定位系统,选用了机器视觉领域比较成熟的商业化软件HALCON。HALCON是由德国MVtec公司开发的一套完善的机器视觉软件,使用户能够在最短的时间内开发出视觉系统,其不仅提供了最先进和最新的技术算法和函数,还提供了功能强大的集成开发环境HDevelop[14-15]。为了缩短项目研发周期,实现快速开发,NASA在Robonaut研发项目中也充分运用了HALCON软件实现机器视觉系统[13]。针对CAD(计算机辅助设计,Computer Aided Design)模型已知的三维物体(如:扶手等),HALCON提供了一种基于CAD模型的三维目标识别与定位算法[16-18]。该算法主要利用三维物体的形状轮廓信息进行匹配,具有识别定位速度快、精度高、鲁棒性强等优点。当待识别物体为金属工件时,通常其表面没有明显可识别定位的颜色或纹理信息[19],基于此类特征的识别定位算法将无法应用,而该算法不受此条件约束。此外,该算法最大的优点是具有良好的通用性,如果要识别多种不同的CAD物体,那么只要更换CAD模型,再适当地调整参数即可,无需根据物体的不同而重新修改算法,大大减少了工作量。但该算法受应用环境以及参数的影响较大,并且可调参数众多,参数的作用效果以及如何有效合理地调整参数以达到最佳应用效果,是非常重要且值得研究的问题。

我国的空间机器人研究起步较晚,目前对机器人航天员的相关研究还很不成熟,且国内基于HALCON的应用研究主要集中在二维方面[20],因此,本文以类人机器人航天员为应用背景,基于HALCON软件进行3D目标识别定位算法的参数优化研究,有非常重要的意义和实际应用价值。

2 3D目标识别定位原理

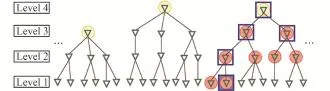

基于CAD模型的三维目标识别与定位算法[16-18],首先根据目标的三维CAD模型进行建模,建模方法如下:将目标置于一虚拟球形的球心位置,虚拟球的经纬度和球半径是由物体的位姿变化范围确定的,虚拟摄像机在球面上该设定范围内进行步进移动,生成物体的二维视图;因为获得的二维视图数量巨大,所以采用金字塔策略进行加速,即下层相邻的金字塔模板视图相似度大于一定阈值将会在上层金字塔进行合并,相似度评价函数如式(1)所示。

其中n表示视图中像素点个数,mi、si分别表示模板图像和待搜索图像第i个像素点的梯度向量,c用来表示两图像之间的相似度,取值范围是0~1。生成模板金字塔时,令c=0.9[18],合并后视图的数量随着金字塔层数的升高而急剧减少;在顶层金字塔,图像分辨率较低,视图数量变得非常少,同时,模板的边缘信息也会变得较粗略;最终完成了分层次视图模板的建立,其包含的信息有目标的模板图像以及生成该图像对应的位姿。

识别匹配过程是建模过程的逆过程,输入待识别图像,生成图像金字塔,从最顶层金字塔开始搜索,使用式(1)计算该层模板视图与搜索图像的相似度,设置一个阈值分数MinScore,只有大于阈值分数的模板视图才继续进行下层金字塔的匹配,最终匹配得到分数最高的最底层金字塔视图,即最优的匹配结果。上述过程如图2所示,图中绿色三角形表示所有的模板视图,黄圈表明在最顶层的全位姿范围搜索,红圈表示候选匹配视图的子视图(物体位姿逐渐被确定),蓝框表示匹配成功的候选视图,最终,搜索到最底层,得到蓝底纹的最优匹配视图。再利用最小二乘法对匹配结果的位姿进行优化,完成亚像素级的位姿精确定,从而进一步减小了位姿测量的误差。

图2 物体的搜索过程Fig.2 The search process of the object

3 3D目标识别定位方法软件实现

基于CAD模型的三维目标识别与定位算法主要由两大部分组成,第一部分是建模阶段:读取3D CAD模型,设置建模参数,创建2D视图金字塔模板;第二部分是识别定位阶段:用创建好的形状模板搜索物体并定位测量。在HALCON中算法实现步骤如下:

第一步:根据物体的三维CAD模型,创建合适的形状模板。

首先利用函数read_object_model_3d()读取物体的三维CAD模型文件。然后利用函数prepare_object_model_3d()为接下来的形状匹配建模做准备,它可以加速接下来的建模操作。最后设置建模阶段的一系列参数,利用函数create_ shape_model_3d()创建金字塔结构的形状模板视图。这里的模板金字塔结构对应于图像金字塔。例如:原始图像(第一层金字塔,即最底层金字塔)是2448×2050,第二层金字塔图像尺寸为1224×1025,第三层金字塔图像尺寸为612× 512,……识别定位阶段是从最高层金字塔开始的。这种设计是一种由粗到精的策略,可以大幅提高识别匹配效率,且具有良好的鲁棒性。

第二步:查看生成的模板,调整参数。

主要利用函数get_shape_model_3d_params()查看每层金字塔的视图个数等参数,利用函数get _shape_model_3d_contours()查看任意一层金字塔的任意一个视图模板的形状轮廓。其形状轮廓是将CAD模型投影成图像,然后生成图像金字塔,因为sobel边缘检测效率较高,所以采用sobel算子提取边缘,如式(2)所示。

其中I表示图像,gx,gy分别表示经过横向和纵向边缘检测的图像。梯度大小g计算如式(3)所示,梯度方向Θ计算如式(4)所示。

通过查看形状模板的边缘轮廓,可以有针对性地修改建模和识别匹配过程中的参数。创建的形状模板对随后的识别匹配以及定位测量有重要影响,所以在建模阶段,选择合适的建模范围,边缘提取对比度等建模参数非常关键。

第三步:识别定位物体。

在图像中对目标物体识别定位,主要利用函数find_shape_model_3d()。该函数的参数较多,主要包括MinScore,Greediness,NumLevels,pose_ refinement,recompute_score等,为了获得实时的匹配速度以及满足需求的高精度,需要对这些参数进行合理调整。识别匹配的过程是从最高层金字塔开始的,即从分辨率最低的图像开始搜索,使用的是最高层金字塔的粗略的形状模板,这样可以快速地确定目标在图像中的大致位置区域,为后面高分辨率图像上的搜索节省大量时间,从而大幅度提高了算法的执行效率,保证了最终的定位精度,同时具有较好的鲁棒性。

4 参数的优化设置

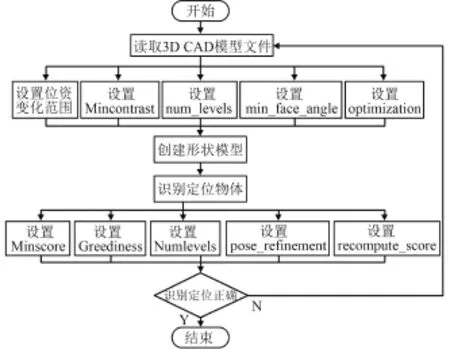

整个算法的参数优化设置,主要包括建模参数设置和搜索参数设置。在实际应用场景下采集大量测试图像,有针对性地调整各个参数。算法的参数优化设置流程如图3所示。

图3 参数优化设置流程图Fig.3 The flow chart of parameter optimization

建模参数优化设置主要包括:根据物体坐标系和相机坐标系之间的位姿变化范围,确定建模时球形经纬度,球半径和相机滚转角的范围;通过查看图像中的边缘提取情况,设置最小对比度;根据图像的尺寸以及建模后最顶层金字塔的形状模板,设置建模生成的视图金字塔层数;通过查看最底层金字塔形状模板的边缘轮廓,确定最小面夹角的值;根据模型的大小和轮廓点数量的多少,设置optimization的值。搜索参数优化设置主要包括:根据工程应用的速度和精度要求,设置Min-Score、Greediness、NumLevels、pose_refinement和recompute_score的值。算法的鲁棒性和识别速度是实际应用中最关心的性能,因此参数的优化目标主要有这两个方面。

4.1 以鲁棒性为优化目标

在考虑优化速度和精度之前,首先有必要保证算法对所有测试图像是可用的,即能够正确识别定位所有测试图像中的目标物体。根据文献[21]中3D形状匹配的相关内容以及本文的实验经验,这里需要考虑如下参数的优化设置:

4.1.1 建模参数

1)设置足够大的位姿建模范围,保证物体位姿变化范围都在球形建模范围内。通过设置参数LongitudeMin、LongitudeMax、LatitudeMin、Latitude-Max、CamRollMin、CamRollMax、DistMin、DistMax,确定物体的建模范围。建模范围过小,目标位姿不在建模范围内会导致识别失败或错误识别。范围设置过大,会导致每层视图金字塔的视图模板数过多,大幅拉低识别过程的搜索速度,同时也会增大将非目标物体识别为目标物体的错误概率。

2)建模时设置MinContrast的值,保证物体在图像中提取的轮廓线完整清晰。如果物体和背景之间有明显的对比度,即可轻松从背景中识别出物体。但如果对比度较低,则需要适当减小MinContrast。MinContrast设置过小,会造成图像中混乱边缘点过多,易导致错误识别,同时严重降低匹配效率。MinContrast设置过大,图像中目标物体的边缘提取会发生缺失甚至消失,特征减少,匹配得分下降,算法的鲁棒性会下降。检查Min-Contrast的值是否合适,可以通过函数edges_image将滤波器设为sobel_fast,查看图像的边缘提取结果。

3)建模时设置num_levels的值与图像的尺寸以及最顶层视图金字塔的形状模板有关,会影响到搜索速度和匹配鲁棒性。图像的尺寸越大,num_levels的值应设得越大,但要查看最顶层视图金字塔的2D形状模板,保证其仍能很好地表征目标特征。

4)建模时设置min_face_angle的值会影响生成的形状模板的轮廓特征,调整它的值,观察生成的形状模板的边缘情况,与图像中提取的目标边缘进行比对,越一致越好。

5)建模时设置optimization的值与CAD模型的大小以及复杂程度有关,同时与参数Greediness有关联。设为none时,鲁棒性最好。设为其它优化值,可提高搜索速度。

6)判断使用忽略部分对比度极性,还是忽略局部对比度极性。如果将参数metric设置为“ignore_part_polarity”,只允许模型的不同部分之间对比度极性改变,而相同的模型内部不得改变。如果设置参数metric为“ignore_local_polarity”,即使每一个模型点的极性都发生了改变,物体也能被识别出来。当图像背景混乱复杂时,容易导致错误匹配,此时应设置metric为“ignore_part_polarity”。

7)如果物体存在一定的对称性,则需要在建模时调整物体坐标系与相机坐标系的相对关系,并控制角度变化范围。例如一个绕摄像机光轴旋转对称的物体,可以在建模时将摄像机滚转角CamRoll由[0,360°]设置为[0,180°]。

4.1.2 搜索参数

1)调整Greediness的值,将其设置为0,不使用贪心算法加速,所有轮廓点全部参与计算,搜索速度较慢,鲁棒性好。

2)判断在某一层或某几层高层金字塔上的识别匹配是否失败或错误,可以通过调整函数find_shape_model_3d()里的参数NumLevels来测试查看。

3)如果存在相同的多个物体实例堆叠在一起部分重合的情况,则应增加MaxOverlap的值。如果物体存在部分遮挡的情况,物体的形状轮廓将部分缺失,则应减小MinScore的值保证能够识别出被部分遮挡的物体。如果要识别出在图像边缘部分出界的物体,则需要设置border_model的值为“true”。

4.2 以识别速度为优化目标

识别定位过程的速度不仅跟创建生成的金字塔视图模板有关,还跟参数设置密切相关。根据文献[21]中3D形状匹配的相关内容以及本文的实验经验,加快识别速度的参数优化设置方法如下:

1)建模时尽可能缩小球形经纬度、球半径以及摄像机滚转范围,限定物体的位姿变化范围可大幅提高搜索匹配速度。

2)如果CAD模型和图像大小允许,在创建生成金字塔视图模板时尽量选择大的num_levels,生成更多层视图金字塔以加快匹配速度。

3)尽可能在图像中限定待搜索的ROI区域。

4)在保证能够正确识别定位的前提下,尽可能增大MinScore的值。MinScore的值越大,排除掉的非目标点越多,识别匹配的速度越快。过大会导致找不到目标,过小会导致匹配速度慢,还可能造成识别定位错误。

5)增大Greediness的值,利用非安全贪心算法减少运算量,只采样一部分轮廓点进行计算,如果小于MinScore的值,就快速排除,可提高匹配速度。但同时需要减小MinScore的值,二者具有相关性。Greediness值过大有可能找不到目标,过小会导致计算量大,匹配速度慢。

5 试验结果与分析

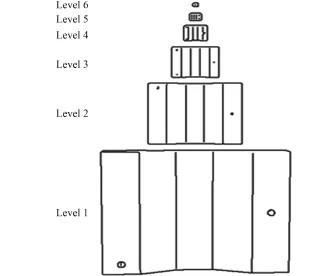

本文试验用计算机为PC机,其配置为Intel(R)Core(TM)2 Duo CPU 2.66 GHz,2.00 GB内存,操作系统为Windows XP,开发环境为Halcon 11.0.2,Visual Studio 2010。以一普通CAD实物工件(尺寸为120 mm×150 mm×30 mm)为例进行试验,工件的CAD模型如图4所示。使用标定好内外参的百万像素工业摄像机采集的8位单通道灰度图像2000幅作为测试图像,相机焦距为8.38 mm,图像分辨率为1224×1025。

图4 待识别工件的CAD模型Fig.4 CAD model of the workpiece to be identified

参数优化目标是在保证正确识别率为100%的前提下,尽可能提高识别速度。参数优化前的CAD建模范围是经纬度为[-45°,45°],距离为[0.7 m,0.9 m],摄像机滚转角为[0,360°]。根据所有测试图像中物体的姿态变化范围可得,参数优化后的CAD模型的建模范围是经纬度都为[-8°,8°],距离为[0.75 m,0.84 m],摄像机滚转角为[0,360°]。其中,摄像机滚转角的范围不会对生成模板金字塔的每层视图数产生影响。参数优化前后都创建生成了六层金字塔模板,参数优化前每层的视图模板数为[601,151,42,16,5,5],参数优化后每层的视图模板数为[7,1,1,1,1,1]。可见,优化建模范围大幅度减少了视图金字塔的模板数量,从而减少了每一层图像金字塔的匹配计算量,优化了算法的搜索速度。参数优化后第一层金字塔到第六层金字塔的第一个视图模板如图5所示。可以看出,最高层金字塔的视图模板轮廓点稀少,已经不足以完整清晰地表达目标物体的形状特征,不构成排它性,易导致误识别,因此设置num_levels的值为5。

图5 六层金字塔每层的第一个视图模板Fig.5 The first view in each level of the pyramid

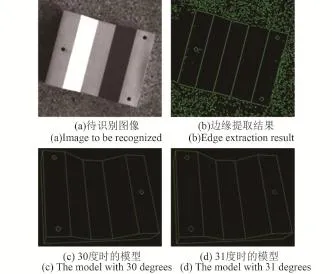

通过查看最底层金字塔形状模板的边缘轮廓确定min_face_angle的值为31°,优化前的值为30°,如图6所示。该调整消除了模型中3个通孔内部侧壁圆柱面上的轮廓线,而这些轮廓线在测试图像的边缘提取结果中也是不存在的。因此通过增大min_face_angle的值,使模型在建模时通孔内壁也不出现边缘,提高了算法的鲁棒性,同时有助于MinScore的设置。通过查看测试图像的边缘提取情况设置MinContrast为8,该值与成像光照条件密切相关。优化前该值为10,无法提取出图像中目标物体的全部形状特征,丢失重要的轮廓线特征,不利于匹配定位。物体的模型尺寸较小,轮廓点不多,因此设置optimization的值为none,使算法更加鲁棒。以上就完成了建模参数的优化设置,创建生成了合适的形状模板视图金字塔。

读入单幅测试图像进行识别定位,结果如图7所示,搜索该图像的时间是0.118 s,而参数优化前搜索该图像的时间为0.542 s,由此可见,合理调整建模参数可以明显提高识别定位的速度。同样保持其他参数不变,将num_levels改为3,建模生成的金字塔每层视图模板数为[7,1,1],搜索该图像花费时间为5.531 s,可以看出,num_levels的增加明显缩短了搜索花费的时间。

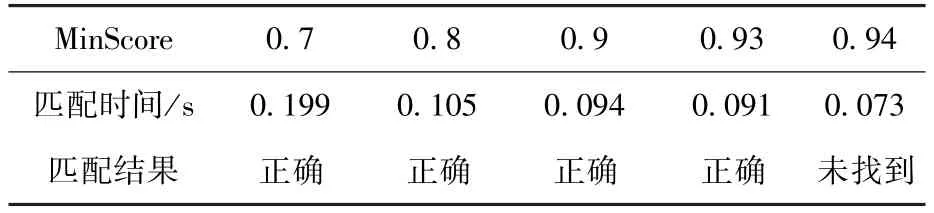

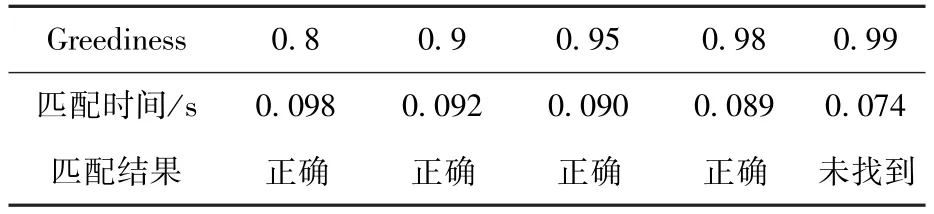

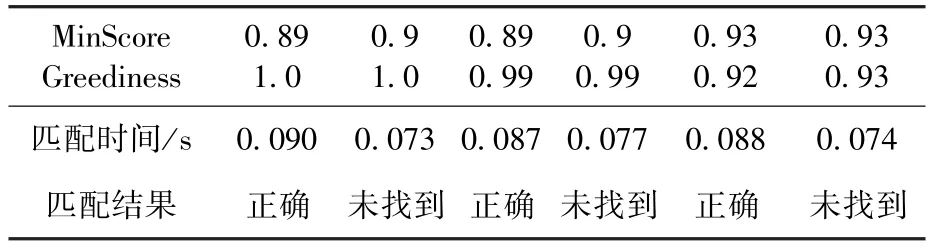

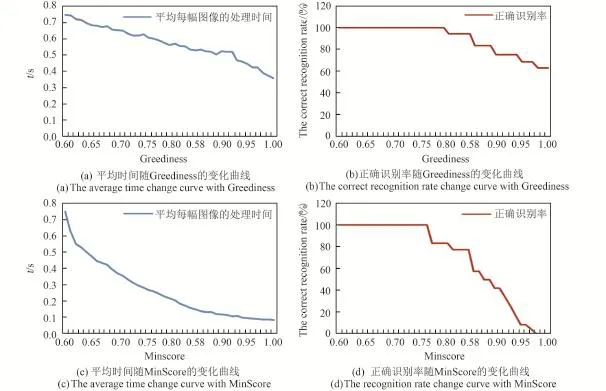

参数MinScore和Greediness的可取值范围都是0~1,可调间隔为0.01,结合采用枚举法和二分法进行试验。对单幅图像进行参数MinScore和Greediness的优化试验,首先保持Greediness值为0.9不变,随着最小得分参数MinScore值不断增大,匹配速度不断加快,MinScore值设置过大导致找不到目标,试验结果如表1所示。然后保持MinScore值为0.9不变,随着贪心系数Greediness值不断增大,匹配速度逐渐加快,过大则参与运算的轮廓点过少,匹配得分降低,导致找不到目标,试验结果如表2所示。两参数同时优化的试验结果如表3所示,如果Greediness增大,则参与匹配运算的点数减少,MinScore应相应地适当减小才能保证识别正确。因此工程应用中应针对所有的测试图像进行两参数的优化配置,保证全部图像中的目标都能被正确快速地识别定位。

图6 调整最小面夹角使模型与待识别图像边缘特征一致Fig.6 Adjust min_face_angle to make edge features of the model consistent with the ones of images

图7 识别定位结果Fig.7 The result of the recognition and location

表1 固定Greediness=0.9优化参数MinScoreTable 1 Optimization of MinScore with Greediness=0.9

表2 固定MinScore=0.9优化参数GreedinessTable 2 Optimization of Greediness with MinScore=0.9

表3 参数MinScore与Greediness同时优化Table 3 Simultaneous optimization of the MinScore and Greediness

图8 Greediness和MinScore优化实验结果Fig.8 Optimization results of Greediness and MinScore

对所有测试图像进行优化实验,结合采用枚举法和二分法调整MinScore和Greediness的值,每设置一组值,都需要遍历所有测试图像,直至挑选出一组合适的值,能够达到100%正确识别率,且满足工程应用的速度和精度要求。对全部2000幅图像优化参数MinScore和Greediness的实验结果如图8所示。首先设置MinScore为一个偏小的值,本文设为0.6,保证所有图像中待识别目标的匹配得分都能大于该分数,被正确识别。然后枚举Greediness的值,遍历所有测试图像,平均每幅图像的处理时间随Greediness的变化如图8(a)所示,可见Greediness越大,处理时间越短。正确识别率随Greediness的变化如图8(b)所示。从图中可以看出,当Greediness=0.8时,识别率仍为100%,此时平均每幅图像的处理时间为0.564 s。当Greediness继续增大时,参与匹配计算的点数越来越少,得分将下降,导致越来越多的图像中找不到目标,因此识别率呈下降趋势。然后将Greediness的值设为0.8,枚举MinScore的值,遍历所有测试图像,平均每幅图像的处理时间随MinScore的变化如图8(c)所示,MinScore越大,消耗时间越少。正确识别率随MinScore的变化如图8(d)所示。当MinScore=0.77时,识别率仍为100%,此时平均每幅图像的处理时间为0.259 s。随着MinScore的继续增大,分数阈值过高,使得越来越多的图像中找不到目标或找到错误目标,正确识别率下降。最终确定Greediness和MinScore的优化值分别为0.8和0.77,保证了100%正确识别率情况下平均每幅图像处理时间最短。

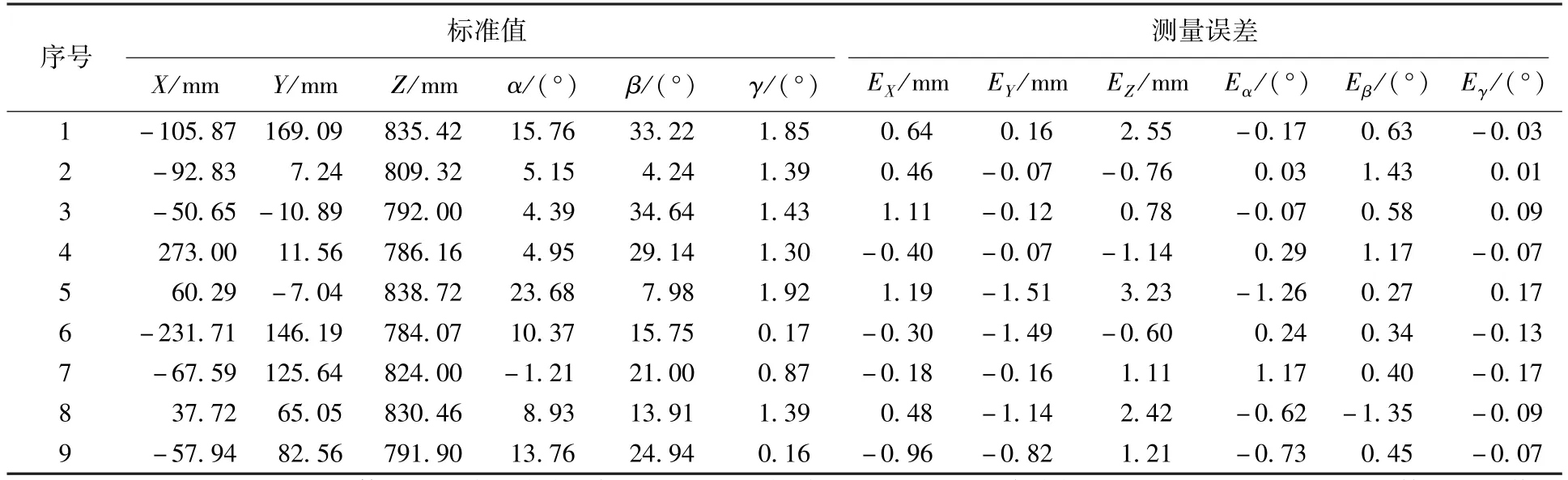

全部参数优化的结果如表4所示。为了达到高精度,本文将亚像素设置为最高精度,即将pose_refinement设为least_squares_very_high,且将NumLevels设为匹配至最底层金字塔,将recompute_score设为true。本文选择了9个固定位置,每个位置连续取十幅图像进行精度测试,十幅图像中检测到的目标位姿的平均值作为测量值,使用激光跟踪仪Leica AT901测得的目标位姿作为标准值,结果如表5所示。因为在参数优化前存在误识别结果,没有精度可言,所以此处测量值为参数优化后的测量值。结果表明,X,Y方向的测量误差均在2 mm以内,且明显小于Z方向的测量误差。Z方向误差均在3.5 mm以内,旋转角度误差均小于1.5°,实现高精度和100%正确识别率付出的代价是平均每幅图像耗时增加0.038 s。

表4 对全部图像进行参数优化的结果Table 4 Optimization results of parameters for all images

表5 精度测试结果Table 5 Test results of measurement accuracy

在使用HALCON进行3D CAD物体形状匹配识别定位时,应根据实际应用背景,合理调节各个参数的值,最优化设置MinScore与Greediness,保证识别定位效果达到应用的需求。特别是在检测结构复杂的物体时,CAD模型结构相当复杂或有曲面结构,物体的形状轮廓特征信息丰富,物体在成像时有些模板轮廓可能没有形成实际成像边缘,这样会影响MinScore和Greediness的设置,不利于识别,还会影响匹配鲁棒性及速度。许多不成像的边缘轮廓线应当在建模时通过合理设置min_face_angle去除,甚至适当地手动修改CAD模型。在特定的应用环境下进行参数优化,不仅保证了正确识别率和定位精度,还尽可能地提高了算法的鲁棒性和速度。

6 结论

本文以机器人航天员操作三维物体为应用背景,研究了HALCON软件中基于CAD目标识别定位算法的参数优化设置,梳理了HALCON中基于CAD模型的三维目标识别与定位算法的原理和技术流程,并对参数优化过程进行了详细描述。由于算法本身采用图像金字塔,先对最高层图像,即尺寸最小图像,进行粗识别匹配,针对这些候选目标进行逐层搜索,这样的搜索过程可以快速排除非目标区域,但如果上层金字塔匹配失败,则可能直接导致最终测量结果的失败。实验表明了参数优化对识别定位结果的影响。确定优化参数,既可以提高算法鲁棒性,又可以大大缩短匹配时间。参数的优化设置为机器人航天员操作三维物体提供了快速准确可靠的视觉测量定位信息,且具有广阔的工业应用前景,合理配置各个参数可满足不同的应用场景和指标要求。

(References)

[1]韩亮亮,杨健,陈萌,等.面向空间站在轨服务的人机系统概念设计[J].载人航天,2015,21(4):322-328.Han Liangliang,Yang Jian,Chen Meng,et al.Conceptual design of human-robot system for on-orbit service of space station[J].Manned Spaceflight,2015,21(4):322-328.(in Chinese)

[2]Diftler M A,Mehling J S,Abdallah M E,et al.Robonaut 2-the first humanoid robot in space[C]//Robotics and Automation(ICRA),2011 IEEE International Conference on.IEEE,2011:2178-2183.

[3]Brown S.Real C-3PO?This hyper intuitive talking robot is going to the International Space Station[J/OL].(2013)[2016].http://www.digitalafro.com/real-c-3po-this-hyperintuitive-talking-robot-is-going-to-the-international-space-station/.

[4]Zawieska K,Duffy B R.Social exploration:Mars rovers[C]//Proceedings of the 2014 ACM/IEEE international conference on Human-robot interaction.ACM,2014:324-325.

[5]Ott C,Eiberger O,Friedl W,et al.A humanoid two-arm system for dexterous manipulation[C]//2006 6th IEEE-RAS International Conference on Humanoid Robots.IEEE,2006:276-283.

[6]Didot F,Schoonejans P,Pensavalle E,et al.EUROBOT underwater model:system overview,tests results&outlook[R].i-SAIRAS'08,2008.

[7]National Aeronautics and Space Administration.Robonaut 2 Fact Sheet-NASA[DB/OL].(2010)[2016].https://www.nasa.gov/pdf/464887main_Robonaut2FactSheet.pdf.

[8]Ahlstrom T,Curtis A,DiftlerM,et al.Robonaut 2 on the International Space Station:status update and preparations for IVA mobility[C]//AIAA SPACE 2013 Conference and Exposition,San Diego,CA,2013:1-14.

[9]李海阳,张波,黄海兵.航天员与类人机器人月面联合探测概念初步研究[J].载人航天,2014,20(3):301-306.Li Haiyang,Zhang Bo,Huang Haibing.Preliminary concept study on integrated Lunar exploration of astronaut and humanoid robot[J].Manned Spaceflight,2014,20(3):301-306.(in Chinese)

[10]Diftler M A,Culbert C J,Ambrose R O,et al.Evolution of the NASA/DARPA robonaut control system[C]//Robotics and Automation,2003.Proceedings.ICRA′03.IEEE International Conference on.IEEE,2003,2:2543-2548.

[11]Tzvetkova G V.Robonaut 2:mission,technologies,perspectives[J].Journal of Theoretical and Applied Mechanics,2014,44(1):97-102.

[12]宋屹峰,王洪光,李贞辉,等.基于视觉方法的输电线断股检测与机器人行为规划[J].机器人,2015,37(2):204-211.Song Yifeng,Wang Hongguang,Li Zhenhui,et al.Vision based transmission line broken strand detection and robot behaviour planning[J].ROBOT,2015,37(2):204-211.(in Chinese)

[13]Wolfgang Eckstein.NASA's R2 vision software controls a space-robot-spectroNet[DB/OL].(2010)[2016].http://spectronet.de/story_docs/vortraege_2010/101109_vision/1_ MVTec.pdf.

[14]Xu X,Zhang X,Han J,et al.HALCON application for shape-based matching[C]//2008 3rd IEEE Conference on Industrial Electronics and Applications.IEEE,2008:2431-2434.

[15]卢泉奇,苗同升,汪地,等.基于HALCON的机械手视觉抓取应用研究[J].光学仪器,2014,36(6):492-498.Lu Quanqi,Miao Tongsheng,Wang Di,et al.Application research of vision crawling robot based on HALCON software[J].Optical Instruments,2014,36(6):492-498.(in Chinese)

[16]Wiedemann C,Ulrich M,Steger C.Recognition and tracking of 3D objects[M].Pattern Recognition:Springer Berlin Heidelberg,2008:132-141.

[17]Ulrich M,Wiedemann C,Steger C.CAD-based recognition of 3D objects in monocular images[C]//Robotics and Automation,2009.ICRA′09.IEEE International Conference on.2009:1191-1198.

[18]Ulrich M,Wiedemann C,Steger C.Combining scale-space and similarity-based aspect graphs for fast 3D object recognition[J].IEEE transactions on pattern analysis and machine intelligence,2012,34(10):1902-1914.

[19]杨大为,丛杨,唐延东.基于结构化的加权联合特征表观模型的目标跟踪方法[J].信息与控制,2015,44(3):372-378.YANG Dawei,CONG Yang,TANG Yandong.Object tracking method based on structural appearance model with weighted associated features[J].Information and Control,2015,44(3):372-378.(in Chinese)

[20]于涛,刘卫国,朱淑亮,等.基于HALCON的缝纫机针外观质量检测系统设计与研究[J].现代制造工程,2015(3):103-109.Yu Tao,Liu Weiguo,Zhu Shuliang,et al.Design and research on sewing needles appearance quality inspectionsystem based on HALCON[J].Modern Manufacturing Engineering,2015(3):103-109.(in Chinese)

[21]MVTec Software GmbH.Solution guide III-C-3D Vision[DB/OL].(2016)[2016].http://www.halcon.com/halcon/download/documentation/pdf-12/halcon-12.0-solution-guideiii-c-3d-vision.pdf.

Research on Parameter Optimization of 3D Target Recognition and Location Algorithm for Robot Astronaut

PAN Wang1,2,HAO Yingming1,3,4,ZHU Feng1,3,4,FU Shuangfei1,3,4

(1.Optoelectronic Information Technology Laboratory Shenyang Institute of Automation Chinese Academy of Sciences,Shenyang 110016,China;2.University of Chinese Academy of Sciences,Beijing 100049,China;3.Key Laboratory of Optical-Electronics Information Processing,Chinese Academy of Sciences,Shenyang 110016,China;4.Liaoning Key Laboratory of Image Understanding and Computer Vision,Shenyang 110016,China)

This paper aims at the fast recognition and location issue of the robot astronaut when grabbing objects.The main applications of the 3D target recognition and location algorithm in HALCON based on CAD models used in the vision of American Robonaut 2 were described.Then the parameter optimization of the algorithm was studied.The effect of various parameters on the algorithm was analyzed.In addition,the selection principle and harmonious collocation of all parameters were discussed.Finally,an experimental platform was set up and it was validated that the proposed optimization improved the similarity of template matching,achieved 100%correct recognition rate,and only spent more than 200 ms for the megapixel image.The mean position accuracy was less than 2 mm and the orientation accuracy was less than 1 degree.

robot astronaut;Robonaut 2;object recognition and orientation;3D metrology;shape matching;HALCON

TP391.4

A

1674-5825(2016)05-0555-09

2015-09-09;

2016-07-14

载人航天预先研究项目(050101)

潘旺(1987-),男,博士研究生,研究方向为模式识别、图像处理、三维目标测量。E-mail:panwang@sia.cn