面向作业与人工智能的仿人机器人研究进展

2015-09-04吴伟国

吴伟国

(哈尔滨工业大学机电工程学院,150001哈尔滨)

自1996年日本本田技研(HONDA R&D)发布研制成功P2型仿人机器人以后,仿人机器人、表情机器人、多指手、双足步行机器人等在机构原理、控制理论与技术、系统集成以及实验研究方面取得了快速发展.如果说20世纪60年代末早稻田大学加藤一郎教授研制首台双足步行机引领了仿人步行机器人研究第一轮世界潮流,那么,受日本本田技研1996—2000年相继成功研制仿人机器人P2、P3、ASIMO的影响和鼓舞,20世纪末、21世纪初掀起了新一轮仿人机器人研发国际热潮.美国、中国、韩国、德国、法国、意大利等国相继研制出了仿人机器人,并在稳定步行速度、集成化程度上有大幅提高.仿人机器人研究发展到今天,已经从20世纪的基础研究向21世纪的应用基础、应用研究迈进,已从诸如有感知能力/表情/人工情感的仿人头、多指手、稳定快速动步行乃至跑步的仿人双足步行机等部分研究进入集成化整体仿人设计研发仿人机器人及应用基础研究平台的发展阶段,其间涵盖了各种驱动原理、不同集成化程度及性能指标的相关研究,涉及的领域越来越宽,从机械、电子、自动控制、计算机与人工智能到生物学、心理学、神经科学、行为科学乃至社会科学,呈现出史无前例的多学科交叉态势.本文对仿人机器人研究的总体现状进行回顾、综述与分析,客观总结评价目前发展状况并提出看法和观点.

1 20世纪仿人机器人研究简要回顾

1.1 基于ZMP的双足稳定动步行控制技术

1972年,著名机器人学者 Vukobratovic等[1]提出了ZMP(zero moment piont)的概念,并研究了基于ZMP的双足步行控制方法,为双足稳定动步行提供了重要理论基础.自1971年早稻田大学加藤一郎教授成功研制出第一台双足步行机并实现静步行以后的近30年间,经过世界范围内专家学者、研究机构和相关企业多年的不懈努力,稳定双足动步行理论与控制技术基础得以奠定,并集中体现在:1)地面力反射控制;2)着地脚位置控制;3)姿势保持控制这三项控制技术的实现[2-3];本田技研P2型控制系统构成[2]以及控制技术堪称将基于模型控制、步行仿真与实际机器人控制技术有效结合的典范.

1.2 全自立仿人机器人集成(1996-2000年)

1996年以前,专家学者分别利用电动、气动、液压等驱动原理以及连杆机构、滚珠丝杠、齿轮传动等原理,研制出多种双足步行机,但是机构较复杂,相对原动机驱动能力较重,难以实现快速稳定动步行.随着高精度谐波传动、高性能交/直流伺服电动机与驱动控制技术的发展,以及高档单片机、DC伺服驱动控制器与产品、网络、铝/镁合金轻质材料铸造等技术的发展,使质量轻、整体刚度好的仿人机器人集成化设计与制造成为可能.20世纪末,本田技研的P1、P2、P3型开创了仿人机器人集成化先河,著名的仿人机器人有ASMO[4]、WABIAN-RIV[5]、H7[6]、SDR-3X[7]等等(见图 1).

图1 日本1996-2000年间研发的代表性仿人机器人

1.3 仿人表情机器人(1994-2000年)

1993年,东京理科大学原文雄教授在国际上首次研制出具有6种面部表情的表情机器人“AHI”[8](2002 年研制出“SAYA”[9]),表情实现是基于美国心理学家Paul Ekman等人提出的人类面部表情编码系统FACS(facial action coding system)原理,并提出“表情智能”概念,应用人工神经网络研究了表情视觉识别技术[10];自1996年以来,早稻田大学研制出“WE-3R”、“WE-3RII”、“WE-3RIV”、“WE-4RIV”等多个版本表情机器人,实现了视觉、嗅觉和面部颜色表情等感知功能[11-12],在人工肺、可变脸色及触觉感知的面部皮肤以及对光强感受的表情实验方面也进行了研究[11];1996年,哈尔滨工业大学蔡鹤皋教授、吴伟国博士研发出“仿人像演讲机器人”[13];1999年MIT研制出了有视觉、听觉机能,能够传递感情信息并与人交流的“Kismet”.早在本田技研面向家庭开发出P系列之后,人们就对无情感的机器人与人共存会对人产生什么样心理影响提出了疑问.

仿人表情机器人研究意义在于为未来机器人与人类社会共存奠定“人工情感”研究与应用技术基础;其现实意义在于解决无生命的“机器”人与人长期共存对有生命、有情感的人的心理影响.因此,这一时期的研究也为后续仿人全身机器人装备头部奠定了基础,但头部尚未集成化而且能实现的表情也不够丰富.

1.4 仿人多指灵巧手(1974-2000年)

多指灵巧手的研究最初源于人失去手后对人工假手的强烈需求.随着工业机器人操作臂、仿人手臂被广泛研究及对灵巧操作的技术需求,作为臂末端灵巧操作器种类之一的多指灵巧手自日本1974年研制出OKADA三指灵巧手之后取得了长足发展.如1980年MIT人工智能实验室与犹他大学联合研制了由气缸与绳索驱动的四指灵巧手Utah-MIT Hand;1984年Nakano等研制了Hitachi四指手;1999年德国宇航中心Hirzinger教授等研制了DLR-I四指灵巧手;1999年美国研制的NASA Robonaut五指手.1993年北京航空航天大学研制出第1个三指手BUAA-I,此后又研制出BUAA-II、III型.

1.5 多移动方式类人猿机器人(1999-2000年)

自1991年起,名古屋大学福田敏男教授从猴子荡树枝移动中得到启发研究了Brachiator II[14]以及此后的 Brachiator III[15],研究了基于行为的Brachiation机器人智能学习运动控制.

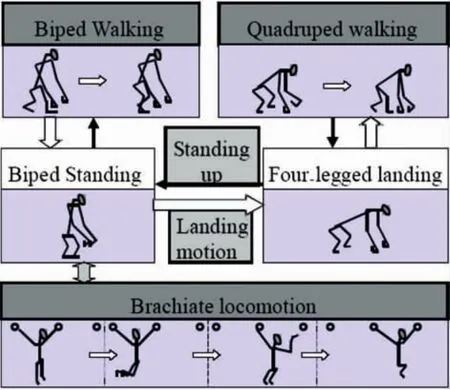

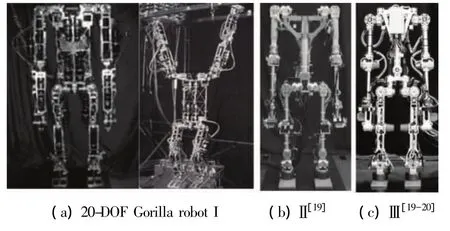

1999年,吴伟国博士从人及类人猿动物运动获得启发,在名古屋大学福田研究室做博士后研究时提出了兼有双足步行、四足步行以及步行方式转换、荡树枝移动机能的“多移动方式类人猿型机器人”新概念(图2),研制出首台类人猿机器人Gorilla robot I型,并研究了步行与步行方式转换控制[16-18](图 3(a));此后,福田研究室研发了Gorilla robot II、III[19](图 3(b)、(c));Kobayashi等[20]又基于Q-学习方法和跌倒系数优化方法研究了使用手杖的控制方法,并用Gorilla Robot III进行实验,验证了该控制方法的有效性,但这些机器人都是非集成化的.

图2 多移动方式类人猿机器人概念图[16]

图3 Gorilla robot

多移动方式类人猿机器人概念的提出和研究为研发一台高移动能力与环境适应性的仿生仿人机器人及其实用化提供了新设计、新思想和技术基础.这种机器人兼顾了环境适应性以及移动作业能力,具有研究变力学结构下控制问题的理论与实际意义.

小结:1970年以后的30年间,随着仿人手臂、双足步行机、多指灵巧手、面部表情机器人等理论与技术长期积累,以及具有多移动方式类人及类人猿机器人新概念的提出,从P2、P3到全自立小型化ASIMO等等,都说明已经为进一步研究有表情智能、多感知、多移动方式等集成化、形象更加接近人类的仿人全身机器人做好了准备,同时也预示着21世纪智能仿人机器人研发大发展时代必将到来的世界潮流与大趋势.

2 2000-2015年国际仿人机器人研究

有专家学者预言,21世纪将会进入机器人与人类社会共存的时代.目前,国际上仿人机器人研究已从20世纪仿人双足步行、多指手、面部等部分研究过渡到集成化仿人全身机器人平台研发,利用这样的平台开展仿人运动、操作等应用基础研究乃至应用研究阶段.本节根据关节不同驱动原理分别对国内外仿人机器人研究进行综述分析.包括:1)伺服电动机加谐波齿轮传动;2)液压驱动;3)气动人工肌肉驱动;4)绳驱动等驱动方式的仿人机器人的应用基础研究现状.并讨论了在人工智能方面的应用基础研究现状.

2.1 以伺服电动机和谐波传动为主要驱动方式的仿人机器人、仿人全身机器人

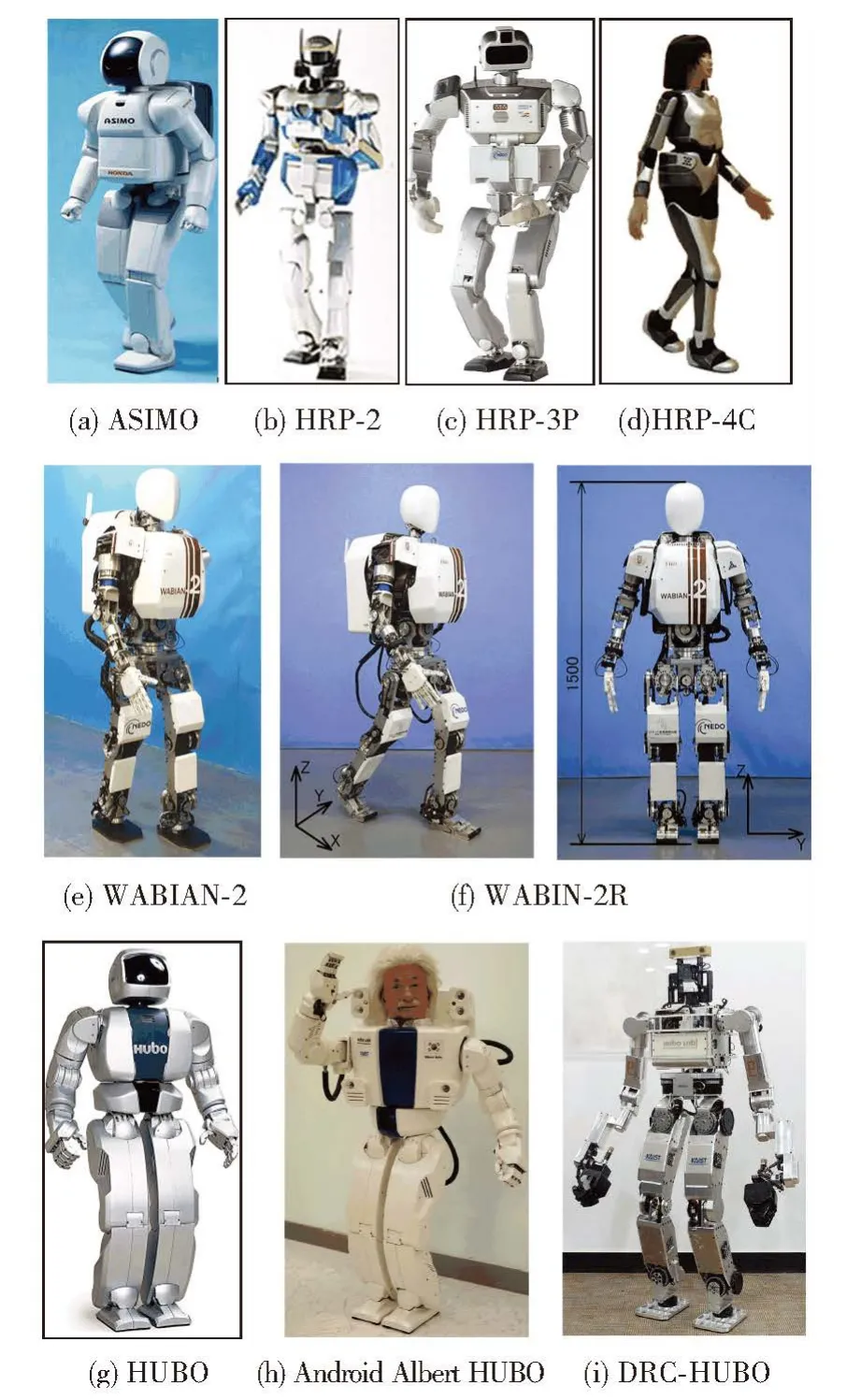

国际上已研发的这类仿人机器人较多,本文主要介绍有代表性的样机.目前已研发出的先进仿人机器人主要有:ASIMO、HRP、WABIAN、HUBO等系列,如图4所示.

图4 国际上著名的仿人机器人

1)本田技研“ASIMO”

ASIMO(图 4(a))高 1.3 m,质量 48 kg,共 54个自由度,其采用本田公司开发的I-WALK步行技术,步速可达9 km/h[21];美国卡耐基梅隆大学Chestnutt等[22]赋予了ASIMO自治通过多障碍物的能力,通过视觉系统预测障碍物在场景中的速度,并能在线矫正,确立机器人步行,自治并安全地通过动态环境;Kim等[23]利用 ASIMO机器人研究了让绳子旋转模拟跳绳运动的控制问题.

2)日本通产省工业技术研究院产学研合作研发的“HRP”系列

日本自1998年起实施了“与人协调、共存的仿人机器人系统研发项目”(HRP)5年计划,完成了HRP-1仿人机器人、面向遥操作/虚拟仿人机器人平台V-HRP、HRP仿人机器人等课题.其中软件研究经历了由 HRP-1到 V-HRP,以及用 CORBA、Linux、ART-Linux等技术开发出开放式虚拟软件平台Open-HRP的过程,并促成了HRP-2版仿人机器人研制成功.Open-HRP对于仿人机器人硬件设计、研发、虚拟实验都有着特别重要的作用和意义,其后期计划之一为面向室外共同作业应用研究[24-25].日本国立尖端科学技术研究院智能系统所主任Tanie认为:未来期望仿人机器人在工厂维护、维修、看护照料病人、与人协作、家庭安全服务、建筑机械遥操作中得到应用[26].

(1)HRP-2系列

HRP-2(图 4(b))[27]身高 1.539 m,质量58 kg,是作为平台进行应用基础研究最多的版本.2005 年,Kajita 等[28]研究了高 1.27 m、12-DOF、质量31 kg的HRP-2LR跑步控制,其控制器由:姿势稳定器、倒立摆稳定器、接触力矩控制、冲击吸收控制、脚部垂直力控制、力矩分配控制组成,实现了HRP-2LR平均速度0.16 m/s、重复飞跃相0.06 s、支撑相 0.3 s的连续跑步控制,脚底垂直方向最大接触力接近500 N,为机器人自重的1.61 倍;Stasse 等[29]研究了实时、自治地生成黑白视觉系统的3D SLAM,利用HRP-2研究了当变换场景特征时头部搭载摄像机运动的单目视觉SLAM方法;Takubo等[30]利用HRP-2研究了基于3-D ZMP修整准则变换的突然停止控制方法;Harada等[31]利用HRP-2研究了臂操作的阻抗控制、基于位置控制的方法、基于力控制的方法以及实时步态规划,得到了根据对象物重力改变时机器人稳定推拉物体的操作实验结果;德国研究者Mittendorfer与日本CNRS-AIST联合机器人实验室的Yoshida等[32]为HRP-2的臂部、胸部分区装备了基于传感器单元的分布式阵列网络结构的多模式人工皮肤,实验研究了基于自组织、多模式人工皮肤的全身接触力反射技术,实现了HRP-2怀抱箱子、与人拥抱等作业;Kajita等[33]研究了HRP-2LR基于ZMP的跑步控制问题,足底最大冲击力接近1 000 N,为机器人自重的3.226倍;Kajita等[34]基于ZMP研究了带扭簧机构前脚掌的 HRP-2LT(14-DOF、1.27 m、质量 32.3 kg)跑步样本生成问题,仿真实现了3 km/h跑步,并实验实现了垂直跳跃动作;Yamazaki等[35]用 HRP-2进行了在具有故障检测、恢复和视觉识别功能条件下,为病患者穿裤子的实验研究;东京大学的Okamoto等[36]在分析人跳舞时随着音乐节拍变化特征基础上,提出了通过合成下肢、躯干、上肢运动个体临时比例算法生成实际机器人全身运动的算法,同时发现关键姿势是跳舞的基本要素,可以用来作为锚点生成全身运动,并用HRP-2做了跳舞实验以验证算法;Petit等[37]提出借助于BCI(brain-computer interface)设计采用环境与人相互作用的辅助通信方法控制HRP-2的新方法.

(2)HRP-3P

日本川田工业与JAIST共同研发了HRP-3P型仿人机器人(图4(c)),其主要特点有:1)机械结构防尘防水保护设计;2)开发了实现分布式控制系统的节点控制器;3)基于Ethernet的主控制器与节点控制器间的实时通信;4)较HRP-2的操作能力强,并进行了防水测试以及雨中上下台阶实验.HRP-3P 高、宽、厚分别为 1.6、0.664、0.363 m,有 36-DOF(腕部 3-DOF,手 3-DOF),质量 65 kg,步 速 2 km/h[38];Hasunuma 等[39]为HRP-3P研制了一套遥控“驾驶座舱”设备,研发了面向仿人机器人的自治-遥控混合控制系统及算法,并且进行了实时遥控遥操作,诸如上台阶、双手持管前行、左手支撑右手操作等多种作业实验;Kanehiro等[40]为HRP-3P研发了一套基于实时Ethnet通信和体内搭载的分布式控制系统,实时Ethnet通信是通过使用直接数据连接层通信和实时操作系统ART Linux来实现的,这样可以减少嵌入式系统成本,提高研发效率;为提高与已有软件的兼容性,还开发了工作在通信层的CORBA工具;在其顶层开发出一个面向HRP-3P在体网络的小型分布式控制器和分布式I/O系统;Yoshida等[41]研究了基于仿人机器人操作作业的全身旋转运动规划问题,并且进行了HRP-3P搬转箱子的运动控制实验.

(3)HRP-4、HRP-4C

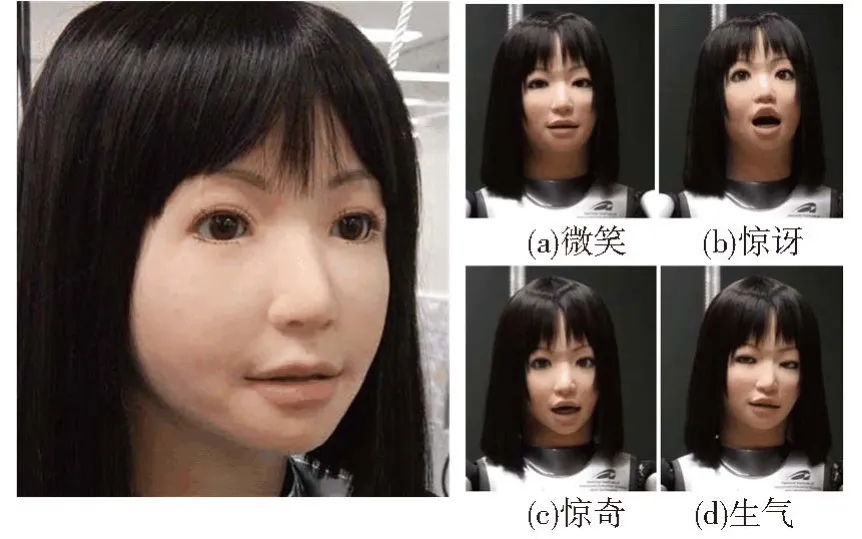

Kaneko等[42]在着重双足步行的同时也着眼于形象逼真、形态模仿人的运动设计,设计研制了“HRP-4C”(图 4(d)):高 1.58 m,质量 43 kg,42-DOF,运动控制器 CPU 为 Pentium M1.6 GHz,语音识别 CPU 为 VIA C7 1.0 GHz,关节、脚底、躯干、头部分别配置增量编码器、6轴力传感器、姿势传感器、蓝牙麦克风接收器,电源用48 V DC NiMH电池.在设计上参考、对比了当时多款仿人机器人参数.图5为其头部特写及表情.

Miura等[43-44]利用美国 VICON 公司 3D 光学运动捕捉系统,基于捕捉人体步行、转身运动数据生成样本让HRP-4C动作,进行了再现实验验证;Kaneko等[45]通过模拟由运动捕捉器获得真人的步行动作,实现了 HRP-4C与人相似的步行;Kaneko 等[46]开 发 了 HRP-4(34-DOF,身 高1.51 m、质量 39 kg)、由 OpenRTM-aist软件平台和带有RT-Preempt的Linux内核构成的软件系统,具有48 V/5.4 Ah Ni-MH电池和分布式控制系统,与HRP-2相比,虽然多了4个自由度,但体重减轻了19 kg,外貌形象为苗条、年轻长发女性;Miura等[47]利用仿人机器人拟人化形态研究了将其作为辅助设备评估者使用来进行基本研究的可行性问题,期望用它进行定量测量以辅助评估,从而减少人类受试者接受测试所导致的昂贵测试成本以及伦理方面的负担,并给HRP-4C穿着“智能服Lite”进行了测试实验.

图5 HRP-4C的头部特写及表情

3)早稻田大学WABIAN-2、KOBIAN、KOBIAN-R

早稻田大学加藤研究室是仿人双足机器人研究的先驱,现为高西研究室,研制的WABIAN-2(图 4(e))高 1.5 m,质量 67.5 kg,双腿 14-DOF[48];Gautam 等[49-50]研制的 WABIAN-2R 高 1.5 m、41-DOF、质量 67.5 kg(含电池),带有由 3-DOF加速度计、3-DOF陀螺仪及3-DOF磁力计组成的惯性测量单元和力-力矩传感器以及前脚掌;Kishi等[51]研制了 KOBIAN 和 KOBIAN-R 两台仿人机器人,拥有成人女性形象;头部24-DOF.

4)韩国KAIST的HUBO、Albert HUBO、DRC-HUBO

韩国KAIST(韩国先端科学技术研究院)分别于 2003、2004、2005、2006、2013 年研发出 KHR-1、2、3(HUBO,图 4(g))以及 MAHRU、Albert HUBO、DRC-HUBO 等 多 款 仿 人 机 器 人[52-61].Android版 Albert HUBO(图 4(h))高 1.37 m,质量57 kg,66-DOF,有刷DC电动机+RC servo motor(伺服机,也即舵机)驱动,为名人脸形像(图6).它能听、看、说并能表达多种表情,拥有动步行特征和宇航服外观,每次充电供电时间长,具有独立系统结构,头与身体为两个独立的机器人系统.主计算机1、2 分别为 Pentium III 1.1 GHz和933 MHz;操作系统(OS)分别为Windows XP和实时操作系统RTX(Real-time OS);内、外部通信方式分别为CAN、IEEE802.11g;视觉系统为 CCD 相机;有声音识别和声音合成功能的语音系统;21个RC伺服机和3个RC伺服机分别驱动面部皮肤运动和脖子机构以形成所有诸如笑、悲伤、生气、吃惊等表情以及眼睑、眼球、下颌和脖子动作.头部这24个伺服机由可驱动31个RC伺服机的SSC II(Scott Edwards Electronics公司生产)控制器控制.

图6 Android版仿人机器人“Albert HUBO”的头部[61]

DRC-HUBO 是 KAIST的 Heo等[62]2013年研制的面向美国DRC(DARPA robotics challenge)机器人挑战赛中迈过台阶或河中石板路等多种作业的仿人机器人(图4(i)),质量50 kg,臂和腿分别比前一版HUBO长6、26 cm,身高1.7 m,各关节局部伺服控制器使用的是1 kHz控制频率高增益比例-微分位置控制器.臂和腿上的主要关节由200或100 W以上无刷DC或有刷DC伺服电动机驱动,并经速比为100∶1或200∶1的谐波传动减速.DRC-HUBO“骨盆”部位带有惯性测量单元(IMU)传感器,用以测量角度、角速度,踝关节有力/力矩传感器;电源为48 V/7.8 Ah/380 Wh电池,总共30-DOF(其中,臂7-DOF,手爪 1-DOF).

2.2 绳索肌腱驱动的肌肉骨骼型新型仿人机器人(2001-2015年)

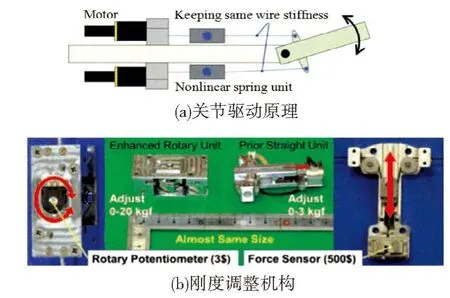

人体关节由两块或更多肌肉驱动,以非线性弹簧特性使关节柔顺,相比谐波齿轮减速器等驱动的机器人,挠性驱动可吸收振动,减缓冲击,保护机构,以实现双足稳定步行.一些学者受到人类肌腱-关节的生物学启发,开始研制仿人肌腱-关节的挠性驱动.绳驱动用于仿人机器人可追溯到1998年早稻田大学双足机器人 WL-14[63],其髋关节俯仰采用钢丝绳驱动,并可用非线性弹簧调整刚度,该驱动方式能减小75%的能耗.目前较有代表性的绳索挠性驱动仿人机器人有:单腿机器人、Kenzoh、Kojiro、Kenshiro、Kotaro 等(图 7).

东京大学JSK(情报理工学系)于2010年研制出图 7(a)所示的仿人机器人 Kenzoh[64-65],其采用一种绳驱动的关节刚度调整机构(图8(a)),通过非线性弹簧模块来调整钢丝绳刚度,并通过机构中的电位计间接得到弹簧变形,从而计算出关节刚度.Kenzoh可提起2 kg重物,虽然其关节刚度可调,但每个关节需要两个电动机、两个非线性弹簧模块,且出力不足以驱动腿部关节.2011年进行了如图 8(b))所示的改进[66-67],引入张力传感器以准确获得钢丝绳刚度,仍采用双电动机驱动,且出力未有改善[68-71].普通“线性肌肉”由电动机、绳轮和钢丝绳组成,Osada等[72]为 Kenzoh开发了“平面肌肉”,原理是平面布置的多个绳轮上多次弯绕钢丝绳以产生大速比,并采用4个“平面肌肉”驱动脊柱[72-75](图 9).

图7 几种典型绳驱动机器人

图8 Kenzoh机器人刚度调整机构[66-67]

图9 绳驱动脊柱及其驱动原理[72-73]

美国佐治亚理工学院Deweerth课题组于2010年研制了有髋、膝关节俯仰两个自由度绳驱动单腿机器人[76],腿部质量 10.1 kg,腿长 87.4 cm.

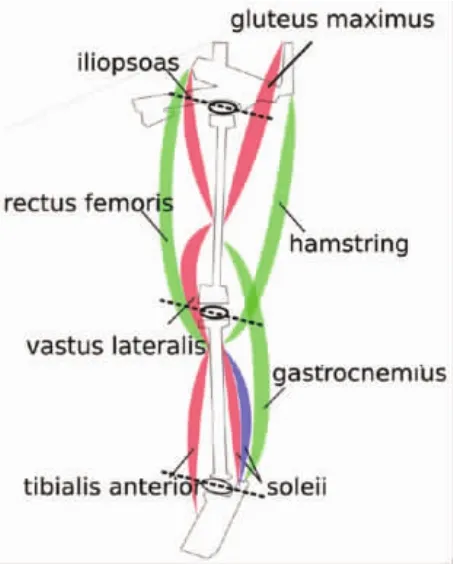

东京大学JSK的Nakanishi等[77]研制了可实现双足步行的绳驱动骨架机器人Kojiro(图 7(b)),身高 1.35 m,质量 40 kg,能实现站立姿态下摇摆平衡控制;东京大学 Kozuki等[78]于2011年研制出按人体解剖学设计,由160块人造“肌肉”、肌腱驱动控制的仿人机器人 Kenshiro(图7(c)),身高1.58 m,约100台无刷电动机驱动所有关节,其特征为:1)有肋骨的胸廓结构用ABS工程塑料经3D打印而成[79];2)用“平面肌肉”驱动大臂[80];3)肩胛骨添加肌肉缓冲垫,以减小冲击[81-82].Kenshiro 无模块化驱动单元,大腿长0.348 m,质量 4 kg,输出范围-30°~ 40°,出力3×9.81 N[83-84].其研究目的都在于模拟人体.

东京大学Nakanishi研究室研制的Kotaro[88](图 7(d))高 1.33 m,质量 20 kg,91 个自由度,120个驱动器(可增加),为其设计的绳驱动肌肉单元内有100×9.81 N的张力传感器,用电动机驱动缠绕钢丝绳的绳轮(图10(a),(b)),钢丝绳仅能承受20×9.81 N.腿部俯仰关节分别由两个肌肉单元驱动,其中,膝关节两个肌肉单元配置在前面,髋关节和踝关节肌肉单元均配置在后面,只能承受张力,不能承受压力,要使机器人处于站立状态,需处于屈膝姿态.预期于2020年实用化,原型样机具有超多自由度、柔性可变、多节脊椎、多感知机能、可随意添加筋肉、体内分布式处理系统、学习和自组织化等特点,体内搭载筋肉长度与张力、电流、温度、关节角度、分布触觉、肉质触觉、双眼立体听觉、扬声器等传感器.

图10 Kotaro机器人的绳驱动原理[88]

2.3 气动人工肌肉驱动仿人机器人(2006-2015年)

典型气动人工肌肉机器人是比利时布鲁塞尔自由大学于2006年研制的Lucy和法国LMS研究室于2000年开发的BIP2000(图11(a),(b)).Lucy采用的人工肌肉比普通气动人工肌肉有更快速的响应特性和更大输出功率,在固定侧偏运动情况下可实现前向步行[89];BIP2000有15个自由度,能实现静步行,有较强稳定能力,受到9.81 N扰动也不会倾覆[90].

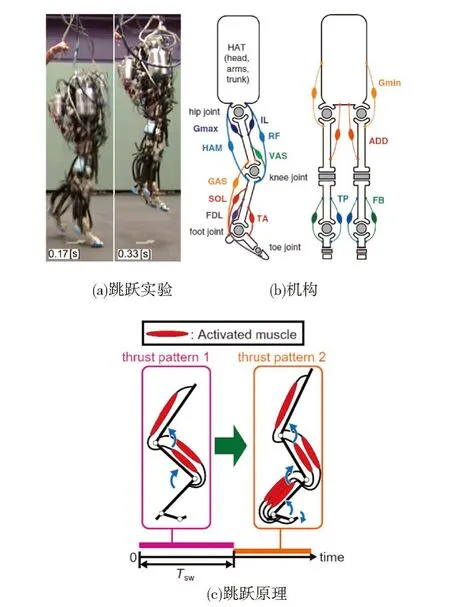

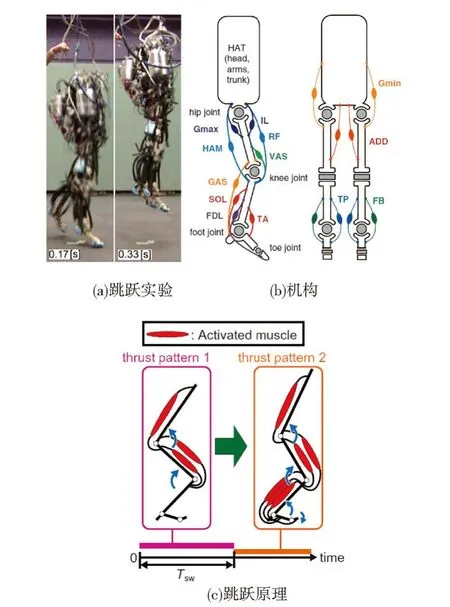

常见气动人工肌肉为McKibben肌肉[91],靠纵横比变化产生轴线位移下的牵拉运动,每个关节需要两个人工肌肉驱动;Tsuji等[92]分别研究了仿人臂关节6根、10根人工肌肉驱动模型的关节驱动控制器设计问题;加拿大Ottawa大学的Dong与瑞士学习算法与系统实验室的Figueroa等[93]于2014年分别研究了6、10个肌肉驱动手臂关节下基于负载分配的肌肉力控制方法(图12):通过肌肉力的计算模块和动力学参数自适应模块协调肌肉力,计算按负载分配给实际的肌肉与骨骼被控对象的肌肉力,并且同时用实际被控对象与所建立模型之间的预测误差实时地更新参数;日本大阪大学的Rosendo等[94]研究了由人工肌肉驱动的仿人跳跃机器人,质量7.8 kg,气动人工肌肉长200 mm,收缩率30%,如图11(c)、图13所示.该机器人腿部结构上有双关节肌肉和单关节肌肉,控制着三自由度;比目鱼肌感知器与其并联,独自伺服检测着地期间压力差.

图11 气动人工肌肉驱动的仿人双足机器人

图12 包括肌肉力的计算模块和动力学参数自适应模块的肌肉协调方法原理[93]

图13 日本大阪大学气动人工肌肉驱动腿部原理图[94]

东京大学的 Nishikawa等[95]基于 McKibben型PAM设计研制了带有压力、姿势等传感器,有前脚掌、全部关节由肌肉骨骼系统驱动的仿人双足机器人(图11(d)),并实现了腾空跳跃,图14给出了其原型样机跳跃实验场景照片.

气动驱动装置用于机器人时,负载响应延迟问题较严重,其输出的非线性问题较为明显,且误差很大,对于双足步行来说,实现难度较大,且单个气动人工肌肉无法驱动一个机器人关节,增加了机器人成本和机构的复杂程度.

图14 基于McKibben型PAM肌肉骨骼型仿人双足机器人[95]

2.4 液压驱动的新型仿人机器人(2007-2015年)

典型的液压驱动仿人机器人分别是美国波士顿动力公司于2011年研发的Petman[96]和日本科技研究中心于2007年研制的 CB[97](图15(a)、(b)).Petman采用了波士顿动力公司BigDog机器人驱动系统,其动力来自带有液压系统的柴油发动机,动力强劲[98];CB有50个自由度,采用主被动控制,其中主动自由度有 34 个[99-100],这两款仿人机器人尽管能够实现步行运动,质量都接近100 kg,造价昂贵.

图15 液压驱动的仿人机器人

美国国防部尖端研究计划局DARPA机器人挑战项目(DARPA Robotics Challenge,DRC)(Pratt&Manzo,2013)发布于 2012年,起初是2013年6月的VRC(虚拟机器人挑战),顶级指标为波士顿动力公司制造的Atlas仿人机器人,并且开始寻求挑战计划;第2个挑战项目是2013年12月在佛罗里达的迈阿密高速公路确定的“DRC Trials”(DARPA机器人挑战大赛),来自世界各地16个代表队参加了这场机器人角逐赛,其中排名前8个队均使用了Atlas机器人的VRC.“DRC Trials”有运载、碎石堆、阀门、坡道、开门、软管、爬2.4 m高梯子、切墙等8项竞赛作业,每项需在30 min内完成.IHMC(The Florida Institute for Human&Machine Cognition)总结了在DRC Trials期间使用波士顿动力公司制造的Atlas机器人完成8项任务的经验,也总结了由仿真到硬件传送以及竞赛过程中“课程”学习等内容[101].

Atlas机器人[102](图 15(c))质量 150 kg,由28个液压缸驱动所有关节自由度:臂、腿各6,躯干3、脖子 1.各关节运动范围:肩俯仰-90~45°、侧偏-90~90°;肘俯仰 0~180°、侧偏 0~135°;腕部俯仰 0~180°、侧偏-67.5~67.5°;总高 1.88 m;手及脚上装有力传感器;在骨盆部位装有光纤惯性测量单元(IMU)用来测算机器人姿态;臂上的每个驱动器都装有线性电位计、两个压力传感器(基于差分压力测量值)分别用来测量位置、关节力;机器人传感器套装还包括3个以 IP(Ethernet)分布在机器人周围用来支持360°视野的相机和一个提供视觉输入给操作器(CRL,2014)的Carnegie Robotics MultiSense SL传感器头.MultiSense SL包括一套立体视觉相机和一个转动的LIDAR激光雷达定位器,并且可以用来处理再现机器人视野的点-云.该部分包括给机器人供电的480 V电源、1个10 Gbit/s网络通信的光纤连接器和水冷风扇.传感器直接与控制站覆盖的光纤网络通信[102];控制站可以无线遥控机器人,由5台计算机:领域计算机、主操控单元(primary operator control unit,OCU)、3 个辅助操控单元(auxiliary OCUs)组成.领域计算机管理所有与机器人有关的通信,限制、压缩来自机器人的高分辨率数据并发送给各OCU操控单元;主操控单元完成解压缩并将响应信息发送到通信管道;各辅助操控单元作为终端负责信息协调、面向用户和处理来自用户的信息.领域计算机直接以光纤连接到Atlas网络,并且它以DARPA指定的有限带宽连接到 OCU 1[102];Atlas的末端可换接iRobot、Sandia、Robotiq 3种多指手,它们分别为 3指5自由度、4指12自由度、3指4自由度的多指手;质量分别为 1.53、2.95、2.3 kg;传动形式分别为蜗杆、齿轮、蜗杆传动[102];MIT 为 Atlas设计、研制了基于可视化、感知和全身运动规划的控制仿真软件系统,该系统有高效运动规划的人机交互机能[103];Feng 等[104]基于逆运动学、逆动力学的成本函数及它们的权重系数、约束条件等建模,研究了Atlas全身运动控制优化问题,并将设计的控制器应用于Atlas,进行了DRC竞技项目中不平整地面行走仿真与跨越障碍、关闭阀门、爬楼梯等实验;美国Delaware大学的Rasmussen和Drexel大学的Sohn等[105]在DARPA奖资助下,研究了2013年DARPA DRC trials中驾驶Polaris vehicle(北极星车)的DRC-Hubo有效驾驶车辆的精确控制策略;他们还在DAROA资助下开展了DRCHubo、Hubo2+机器人在头部两个 Asus Xtion Pro Live空间深度相机视觉系统导引下搜索测试区域入口、找到车门上车的视觉系统研究[106];Cheng等[107]研究的仿人机器人 CB-i(图 15(d))高1.55 m,质量 85 kg,有 51-DOF(腿、臂、眼、颈/头、手、嘴、躯干分别有 7、7、2、3、6、1、3-DOF),研究了智能学习运动控制问题(详见2.5节).

液压驱动机构外型较为复杂且质量大,并存在油液泄露问题,但驱动力强劲,操作出力能力强,目前为多数仿人机器人研究者及研发机构追捧.

2.5 仿人机器人与人脑的脑-机接口技术的融合

RoboCup最终目标是按着 FIFA规则,到2050年用自律型仿人机器人11台组成机器人足球队夺取世界杯.以北野宏明、浅田捻等为代表的日本学者在1993年提出以多台自律机器人实现足球比赛为目的的机器人学和人工智能研究领域的新标准问题,如何让仿人机器人达到与人类足球运动员技术匹敌的程度以及团队协作处理好临场赛并最终获胜一直是机器人学者考虑的大问题.需要在仿人机器人与人类之间找到一种有效的学习、训练方式,脑-机接口技术可能为解决这一复杂难题提供了新途径.

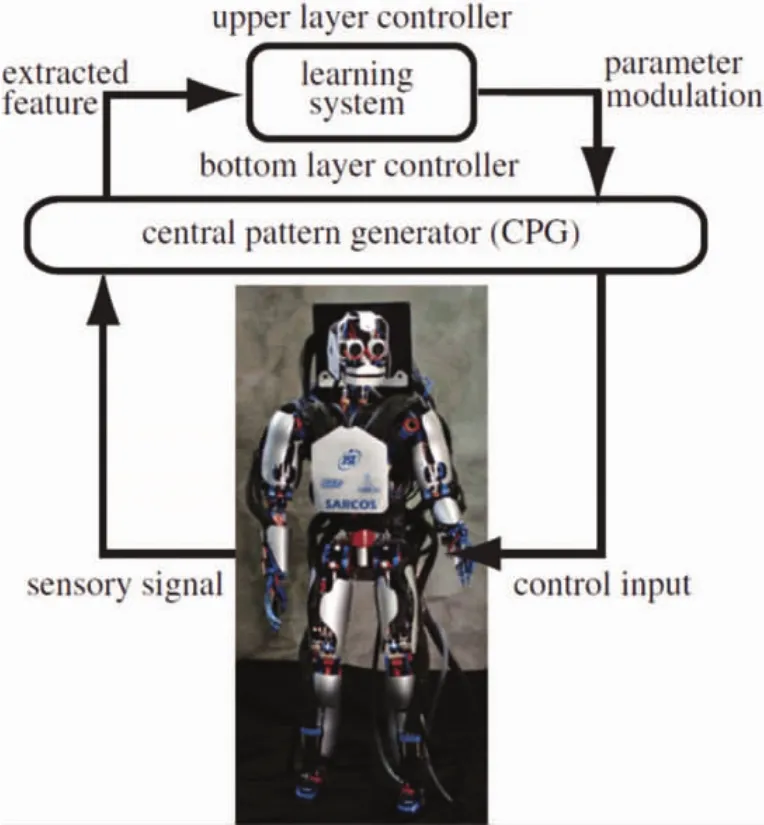

2014年 Petit等[37]提出借助于 BCI(braincomputer interface)设计,采用环境与人相互作用的辅助通信方法去控制一台仿人机器人HRP-2.这种接口是基于稳态可视化诱发电势SSVP(steady-state visually evoked potentials)原理的,并且刺激物被集成到可再现来自装在机器人上相机图像的头盔显示器HMD(head-mounted display)上.为测试所设计的基于 SLAM(simultaneous localization and mapping)反馈的新通信方法的性能,用HRP-2进行了控制实验,以测试用户所要求的、在一确定区域内为执行一项作业的通信能力,并获得经验;日本ATR计算神经科学实验室脑-机器人接口室的Morimoto与ATR脑信息通信研究实验室的Kawato等[108]针对近年来脑-机接口研究以及在人脑与仿人机器人间所形成的闭环系统内相互“连接”的研究进行了综述.介绍了集成脑科学和来自脑信息解码的机器人学、基于信息解码的机器人控制、从机器人到脑并且以实时和闭环多模式形式反馈给脑的“脑-机接口”研究新方向,同时介绍了基于CPG的步行样本学习方法(图16)、CB-i步行学习实验及外骨骼助力双足训练实验研究结果.

德国慕尼黑大学的Ramirez-amaro和不莱梅大学的Beetz等[109]提出并验证了一种合适的语义表达方法和比较初级的感知系统,以充分证明来自人的观察活动.首先,他们从传感器数据提取底层信息;然后,通过推断人的行为意图推断高层行为;该系统另一个很重要的方面就是具有面向新活动可即时按需学习的比例自适应性,并且在仿人机器人iCub上进行了实验验证:在线执行机器人控制环系统的鲁棒性,机器人可以在0.12 s内识别、推断人的行为并且做出决定(识别率精确到85%);2011年,德国宇航中心(German Aerospace Center,DLR e.V.)的 Ott等[110]基于接触力优化方法研究了双足步行机器人姿势和平衡控制;Ott等[111]于2014年研究了仿人机器人Justin基于力矩控制的多作业和平衡控制.

图16 CB-i及其基于CPG的双足步行学习方法原理图[108]

2.6 关于仿人机器人在Telexistence中的应用研究

Telexistence是构筑具有3D画面和声音行为空间,集视、听、触觉感觉的人工现实感技术.该概念是由东京大学名誉教授Tachi于1980年原创提出的,人工现实感技术可以实现虽非亲临现场但在异地以高感度产生逼真地临场感.而且通过构造遥感代理仿人机器人TELESAR和在日本国家大规模项目“Robots in Hazardous Environments”与CREST触觉遥感项目中的TELESAR V等,证明该技术是可行的,不但在“仿人机器人项目(HRP)”中研发了“HRP超级座舱双足机器人系统”,而且已经研发出使用代理机器人和反射机器人投射技术(RPT)等组合实现分别处于异地产生临场感这样的共同遥感系统TELESAR II、IV、V,并且已证明协同临场感系统的可行性.HRP仿人机器人、Telexistence Avatar(遥感阿凡达机器人系统)以及主从机器人等已被用于其中(图17)[112].

图17 仿人机器人在Telexistence中的应用[112]

3 国内仿人机器人研究现状(2001-2015年)

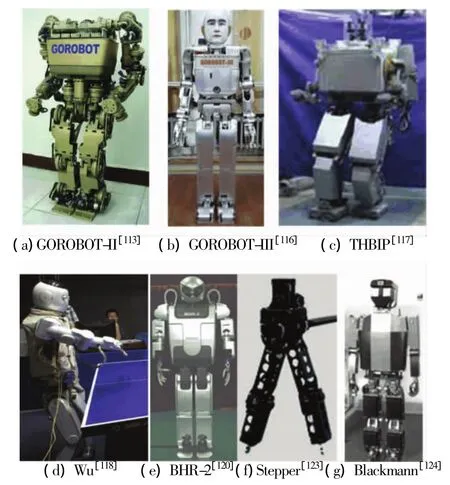

自2000年底国防科技大学成功研制了我国第一台仿人机器人“先行者”以来,国内各大学相继研制出了一些仿人机器人,主要有:哈尔滨工业大学的GoRoBoT-II型类人猿机器人[113-115]、仿人全身机器人GoRoBoT-III[116];清华大学的THBIP、Stepper机器人;浙江大学的“悟”、“空”机器人;北京理工大学的BHR-II机器人等[120-121].清华大学于2002年研制了THBIP,高1.7m,质量130kg,可实现上下楼梯运动[117];浙江大学的“悟”、“空”机器人,高1.6m,质量55kg,有30个自由度,具有视觉捕捉技术,可打乒乓球,反应时间50~100ms[118],动步行速度1.07km/h,面向打乒乓球的7-DOF臂轻量化设计到4.4kg(无外壳,装外壳后质量5kg),球拍最快移动速度达2.5m/s[119];北京理工大学于2005年研制的BHR-2高1.6m、质量63kg、有32-DOF(其中手为3-DOF),用运动捕捉研究了步行[120-121].其后还研究了有仿人头的机器人[122];清华大学研制的Stepper机器人是小型、刚性驱动双足机器人(高0.44m),步速可达3.6km/h[123];国防科技大学还研制了Blackmann[124].这些机器人如图18所示.

图18 国内仿人机器人

目前,国内外典型的仿人机器人大多可实现双足步行等运动,甚至具有多感知机能.这些机器人多采用电动机加减速器等传动装置进行驱动.而人类步行时来自地面反力最大可达自身体重7倍,对于机器人机构来说,如此大的冲击可能导致机构损坏.为实现机器人快速步行同时有效缓冲外部冲击,越来越多的专家学者和研究机构开始致力于挠性驱动机器人研究,以期利用挠性吸收振动,减缓冲击,保护机构,同时减小系统惯量影响,进行能量存储.

4 作者在仿人机器人方面研究(2001-2015年)

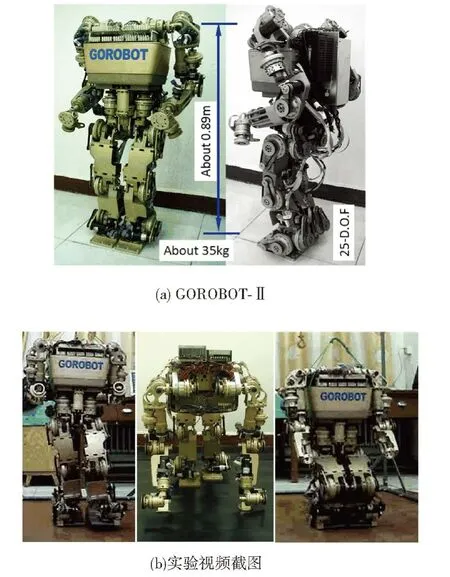

4.1 具有多移动方式的类人及类人猿机器人GOROBOT-II

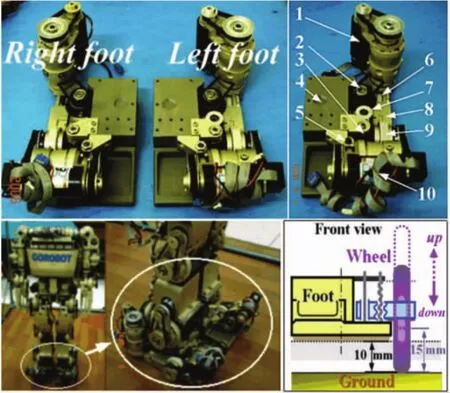

2003年,本文作者在1999年提出的具有多移动方式类人猿机器人概念基础上,在国家自然科学基金资助下研制出模块化组合式类人猿机器人GOROBOT-II[113-116,125,126],于2005年IEEE ROBIO国际会议上提出了如图19所示的具有腿式、轮式及特殊移动方式类人及类人猿型自主移动机器人的概念[125],并且为GOROBOT-II设计装备了如图20所示的脚用轮式移动机构,在2004年实现双足步行、四足步行及步行方式转换基础上,进一步实现了轮式移动及腿式与轮式转换等功能,图21为gorobot-Ⅱ外观及其双足步行、四足步行、轮式移动等实验视频截图.

图19 具有腿式、轮式及特殊移动方式类人及类人猿型自主移动机器人新概念[125]

图20 脚用轮式移动机构[115]

图21 GOROBOT-II的外观及其双足步行、四足步行、轮式移动实验视频截图[114,116]

4.2 有面部表情、表情识别与再现及语音口型的

仿人头像机器人F&Hrobot系列版

2004年,本文作者在国内最早研制出了真正具有面部表情的仿人头像机器人F&Hrobot-I型,并实现了如图22(a))所示的喜怒哀乐严肃等8种面部表情[127];2005年研究实现了人类表情的视觉识别与表情再现(图22(b))[128],将表情机器人F&Hrobot-I升级为II型;2006年在国际上首次提出研究表情机器人“语音-口型协调”问题,并将II型升级为集视觉、语音-口型协调、表情于一体的 F&Hrobot-III 型[129-130],提出并研究了基于有限状态机的人工情感模型,并用F&Hrobot-III进行了初步的实验验证[130].

图 22 F&Hrobot-I、II的表情

4.3 集成化仿人全身机器人GOROBOT-III(2007.01-2012.09)

在前述的有表情仿人头像机器人、多移动方式类人猿机器人研究工作基础上,作者从2005年开始设计、研制一种集多种移动方式自主移动机能(图19)、表情智能、兼作脚用的多指手等一体化的高度集成化仿人全身机器人系统.在国家“863计划”资助下,作者于2012年研制出了高约1.58m,70-DOF,集1∶1比例有多感知机能与表情的集成化仿人头部(F&Hrobot-IV)、带有腕力传感器1∶1比例仿人四指灵巧手双臂手、带有前脚掌的仿人双足及躯干部分全自立型仿人全身机器人的高度集成化系统GOROBOT-III[116](见图23).早在2004年IEEEROBIO国际会议上,为面向四足步行及双足行走双臂操作而提出了兼作足式步行脚用的多指手[113],并进行了设计,这一概念和设计在2007年设计、2012年研制出的GOROBOT-III型仿人全身机器人上得以实现并装备其上.

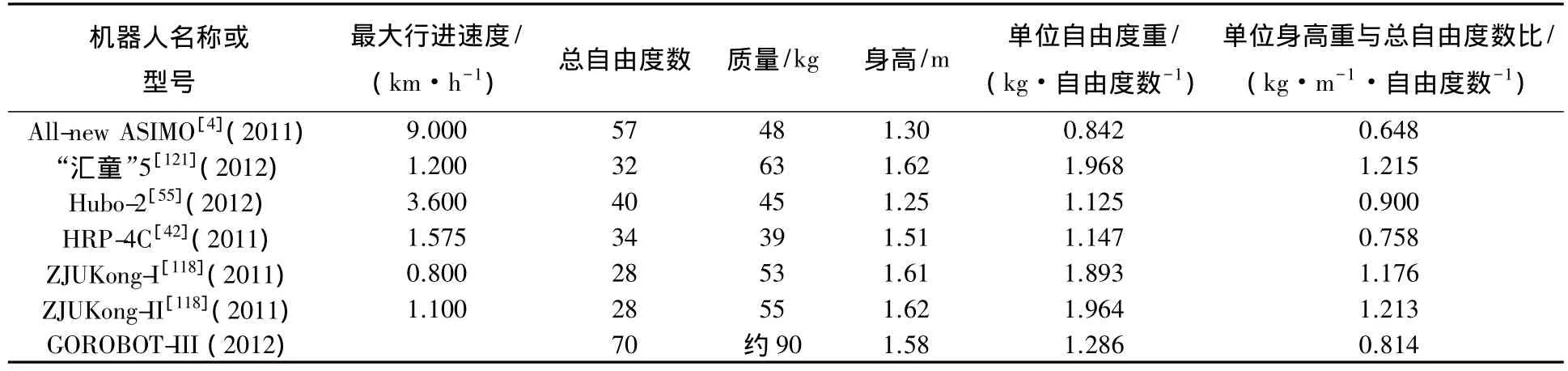

为客观地评价GOROBOT-III集成化设计结果,将国内外代表性的已公开仿人机器人参数据入表1,定义两项相对评价指标:指标1是机器人总重(kg)与总自由度数比值,即单位自由度均重;指标2是单位身高重(kg/m)与总自由度数比.由表1可以看出,GOROBOT-III系统具有较轻的单位自由度均重以及较小的单位身高重/总自由度数比值,接近于国外先进机器人这两项指标,且系统整体刚度很高,在步行速度上有较大的提高潜力.

图23 仿人全身机器人GOROBOT-III的集成化示意图与外观

表1 GOROBOT-Ⅲ与国内外代表性集成化仿人机器人性能对比

4.4 挠性驱动单元及其在双足步行机器人的应用

针对刚性传动(减速器)驱动的仿人机器人存在的抗冲击能力差等问题,作者自2006年开始研究挠性驱动单元,基于钢丝绳传动与动滑轮组増力原理,分别在2013、2014年研制出FDU(flexible drive unit)-I、II型挠性驱动单元[131].其中,FDU-II带有关节转角位置编码器和绳索张力传感器;基于黏弹性动力学研究了FDU-II全位置闭环和张力反馈控制挠性驱动控制技术[132].并研究了单元快速响应特性及负载特性(最大40kg),使频响达6Hz,关节轨迹最大跟踪误差<1°;FDU-II已应用于仿人双足步行机器人FDUBR-I的髋部俯仰运动关节,实现了双足稳定步行,步速0.1km/h[133].

上述研究成果已获授权发明专利十余项[116].

5 仿人机器人研究现状分析与总结

仿人机器人研究目标是以人类自身为参照的,因此,对照人类自身数据对上述仿人机器人研究现状作如下分析与总结.

1)从关节驱动能力看关节抗冲击能力

国内外以代替人工作为目标研发的仿人机器人身高、体重大约分别在1.0~1.7m、30~100kg(不含负载).按人类步行、跳跃等动作时脚底与地面冲击力3~7倍于自重计算,仿人机器人需承受来自地面的210~700kg的冲击力.按国际上最高性能的HarmonicDriveⒸ谐波减速器CSG系列产品数据计算,考虑如下实际约束条件:(1)瞬时许用最大转矩/输入转速2000r/min时额定转矩的比值≈4~5;(2)平均负载最大许用转矩/输入转速2000r/min时额定转矩的比值≈1.4;(3)HarmonicDriveⒸ谐波齿轮传动寿命10000h;(4)仿人机器人中各关节机械传动中,滚动轴承多采用的是轻或超轻系列轴承——获得紧凑的结构;(5)工作在瞬时许用最大转矩时意味着谐波齿轮即将失效,等等.由Kajita等[33]研究的HRP-2LR跑步足底最大冲击力实验数据接近1 000 N可以算出,冲击力为机器人自重的3.23倍,已接近前述(1)中瞬时最大驱动能力的上限4,而且这些跑步实验持续的时间很短.虽然可在脚底部加上减缓冲击的橡胶类材料,但其刚度难以适应不同材质的地面;另外,脚底弹性过大(相当于弹簧)还会引起位置控制偏差大、定位不准以及失稳等问题.目前,以谐波齿轮传动方式减速驱动关节的仿人机器人的实用化面临着难以解决跳跃、快跑带来的足底大冲击等问题.液压驱动下,即使最大压力按公称压力2~3倍计算,也难以抵抗仿人机器人相当于人跳跃、跑步时3~7倍于自重的冲击力,同时可能伴随着液压油易泄露,压力增高将降低可靠性以及噪声与振动等问题.足底压力传感器、脚部六维力-力矩传感器也面临着因大冲击力而超量程的安全问题.因此,研究具有频繁抗3~7倍于自重的大冲击能力,且质轻的精密传动或自动控制下能实现精确定位的传动装置以及大量程力-力矩传感器具有特别重要的意义.

2)现有仿人机器人负载及多指手操作的能力

前述国内外仿人机器人上的1∶1比例仿人手多指灵巧手自由度数不多,抓持重物能力远不及人手,最大约在1~3 kg.现有仿人机器人除了DARPA的Atlas外,其余仿人机器人负载和多指手操作能力都较小,而人手一般可持20~30 kg重物(人手的动力不全在手上,而是由小臂上的肌腱群来驱动的).因此,本文作者研制的GOROBOT-III型仿人全身机器人并没有采用所有动力源元件放在多指灵巧手内的方案,而是仿生人手与小臂的解剖学,提出一种将小臂与多指灵巧手合在一起设计单元臂的形式,采用将所有伺服电动机、传动装置均设置在小臂上的设计方法设计了1∶1比例仿人四指灵巧手.

3)仿人机器人平台研发与应用基础研究情况总结

发达国家均研发出相应仿人机器人平台并进行应用基础研究,其中日本以HRP系列、ASIMO系列、CB-i各为平台,韩国以HUBO为平台,美国以Petman、Atlas为平台,进行了面向应用以及与人工智能技术相结合的持续的应用基础研究,已开展的应用基础或应用研究涉及:(1)快速稳定步行;(2)跑步控制与实验;(3)利用三维运动捕捉系统获取人体运动数据,生成机器人相应运动样本,具体包括学习人类步行、跳舞及与音乐节拍协调运动;(4)DARPA挑战赛的8项作业;(5)全身多模式人工皮肤触觉下的自组织、接触力反射控制技术与操作实验,与人拥抱等;(6)HRP开挖掘机作业;(7)仿人机器人急停、摔倒、过矮门等运动;(8)为病患穿衣服;(9)机器人学习人做菜;(10)视觉导引自治通过障碍物环境;(11)ASIMO为跳绳摇绳的控制;(12)利用“驾驶座舱”设备实时远程遥控操作;(13)机器人全身运动规划搬箱子;(14)HRP-4C的商业演出;(15)仿人跳跃运动控制;(16)脑-仿人机器人“脑-机接口”实验研究:包括步行学习及外骨骼助力双足训练实验;(17)仿人机器人在人工现实技术中的应用;(18)打乒乓球;(19)寻找目标,上下车、开车;(20)仿人机器人“教师”;(21)与人协作抬物件;(22)服务导购;(23)HRP-4C穿着“智能服”接受测试实验;(24)表情机器人与人的交流;(25)步行期间手持重物的平衡控制;(26)一手支撑一手作业等等作业与行为;(27)爬楼梯;(28)踢球等等.这些作业研究大多数都是在伺服电动机与谐波传动驱动的HRP系列平台下进行的,部分是在液压驱动仿人机器人平台下完成的,而气动人工肌肉原理、绳索驱动原理的仿人机器人仍处于原型样机设计与研发阶段,需解决多挠性耦合下精确控制与频响特性问题.

4)仿人机器人研发策略

从 HRP、P1、P2、P3 及 ASIMO、KHR 和 HUBO等各系列仿人机器人研发成果看仿人机器人研发战略:(1)产学研协同攻关;(2)持续的、系列化的研究,技术水平不断完善、提高;(3)无论是本田技研、日本通产省工业技术研究院、早稻田大学高西研究室还是韩国先端科学技术研究院都经历至少5台、多则10数台的仿人机器人样机研发才取得标志性成果——仿人机器人系统平台,可见研发工作宜求稳而不可操之过急.以上3点值得我国借鉴.

5)有关仿人机器人脚的研究

人脚有着适应快速步行,脚掌抓牢地面,减缓着地冲击力,巧妙利用重力场与倒立摆作用,主被动控制结合减少能量消耗等特点,对于仿人机器人而言有着极高的研究价值,近年来,诸如有非线性弹簧变刚度前脚掌脚等各种原理的仿人脚部机构研究开始被重视并开展研究.限于篇幅,另文阐述.

6)仿人全身机器人优化设计与仿真平台的必要性

目前,尽管世界上已研发许多仿人机器人,有的机械结构与整机系统设计公开发表,但是难见有关仿人全身机器人系统运动与负载性能优化设计方法的研究,类似 Open-HRP[24-25]这样的软件平台,对于仿人机器人设计非常重要,但在原型样机设计之前是否考虑优化设计不得而知.从现有大多数仿人机器人文献可知:仿人机器人全身运动还局限于人体可达所有运动范围空间内的一小部分.因此,着眼于仿人全身运动行为和负载能力的仿人机器人集成化虚拟设计与仿真软件平台的开发,对于设计高运动能力和负载能力的仿人机器人具有重要的理论与实际意义.

7)关于步行与全身行为的稳定性获得与控制问题

现有仿人机器人大都是在结构化地势或室内环境下完成作业实验的,其步行与全身行为的控制方法主要分为:(1)基于模型的控制;(2)基于行为的控制;(3)基于CPG的运动控制(即生物控制方法);(4)基于脑-机接口技术的方法;(5)基于运动捕捉系统的运动学习方法,等等.其中,现有研究多为基于ZMP稳定性准则、运动样本规划以及反馈控制技术等基于模型的控制方法,属于局部稳定而非全局稳定,难以很好地适应环境与自身行为的变化.为此,从人成长过程中小脑平衡能力获得启发,作者在文献[134]中提出了基于串并联机构平台、随机运动生成和传感系统的机器人步行(以及全身行为)稳定性训练方法,目前,正在进行理论与试验基础研究,期望获得全局稳定器.

8)电动机驱动与液压驱动技术博弈

目前,以Atlas、BigDog等为代表的液压驱动仿生仿人机器人在步行及作业能力上较电动机驱动的仿生仿人机器人显现出优势,其根源在于泵站小型化液压驱动与控制技术的发展使得其综合性能已超越了目前电动机驱动性能,其差别恰似上世纪研制的液压驱动双足步行机过于笨重,不如电驱动双足步行机一样.因此,目前电动机驱动下的仿人机器人步行与作业能力的进一步提高将依赖于更高功率性能体积(或质量)比的新型电动机和传动装置新技术的问世,狭义上讲,仿生仿人机器人若要达到近乎于人类或动物行为的控制目标,首先取决于驱动系统相对于自身或负载的驱动能力及其在传感系统/控制系统的感知与控制下的快速响应特性.

6 结论

1)在仿人双足步行技术基础上发展起来的仿人全身机器人已成为衡量一个国家机器人技术水平的重要标志,也已成为仿人机器人应用基础研究、应用研究的平台,基于传感系统、训练与智能学习算法,面向各种移动作业应用和人工智能的大规模应用基础研究将成为仿人机器人平台研究重心.

2)以Atlas、CB-i等液压驱动原理的仿人机器人驱动强劲,出力大,适合于强力操作类移动作业场合;而有表情的HRP-4C以及Albert HUBO等仿人全身机器人亲和力好,更适合未来面向与人类长期共同生活、工作等用途.

3)具有多种移动方式的类人猿型机器人、仿人全身机器人以其高度的运动灵活性,环境适应能力强和多移动方式,将会成为一种通用型的机器人.

综上所述,现已研发出的仿生仿人机器人在很多方面与人和生物还相差甚远,很大程度上还是动作行为与情感生硬的“机械”、“机器”,期待经过专家学者们的不懈创新和技术积累,未来能够研发出环境适应性、柔顺性、精确性、自学习进化能力、心性和情感、机体组成等方面与人和生物更加接近、“生物化柔性”与“机器智能”兼顾的仿生仿人机器人.

[1]VUKOBRATOVIC M,STEPANENKO Y.On the stability of anthropomorphic systems[J].Math Biosci,1972,15(1):1-37.

[2]HIRAI K,HIROSE M,HAIKAWA Y,et al.The development of honda humanoid robot[C]//Proceedings of 1998 IEEE International Conference on Robotics and Automation.Leuven:IEEE,1998:1621-1326.

[3] TAKENAKA T.The control system for the Honda humanoid robot[J].Age and Ageing,2006,35(2):ii24-ii26.

[4]Honda-Robotics.ASIMO[EB/OL].[2015-06-20].http://www.honda.co.jp/ASIMO/.

[5]YAMAGUCHI J,TAKANISHI A.Development of a leg part of a humanoid robot:development of a biped walking robot adapting to the humans’normal living floor[J].Autonomous Robots,1997,4(4):369 –385.

[6]NISHIWAKI K,KUFFNER J,KAGAMI S,et al.The experimental humanoid robot H7:a research platform for autonomous behavior[J].Philosophical Trans of the Royal Society A:Mathematical,Physical and Engineering Sciences,2007,365(1850):79-107.

[7]Sony Corporation.Corporation history[EB/OL].[2015-06-23].http://www.sony.co.jp/SonyInfo/CorporateInfo/History/history.html.

[8]KOBAYASHI H,HARA F,UCHIDA G,et al.Study on face robot for active human interface-mechanisms of face and facial expressions of 6 basic emotion[J].Journal of the Robotics Society of Japan,1994,12(1):155-163.

[9] KOBAYASHI H,ICHIKAWA Y,SENDA M,et al.Realization of realistic and rich facial expressions by face robot[C]//Proceeding of 2003 IEEE International Conference on Intelligent Robots and Systems.Las Vegas:IEEE,2003:1123-1128.

[10]KOBAYASHI H,HARA F.Recognition of mixed facial expression by neural network[C]//Proceeding of 1992 IEEE International Workshop Conference on Robot and Human Communication.Tokyo:IEEE,1992:381-486.

[11]MIWA H,UMETSU T,TAKANISHI A,et al.Humanlike robot head that has olfactory sensation and facial color expression[C]//Proceeding of 2001 IEEE International Conference on Robotics and Automation.Seoul:IEEE,2001:3255-3260.

[12]MIWA H,ITOH K,MATSUMOTO M,et al.Effective emotion expressions with emotion expression humanoid robot WE-4RII[C]//Proceedingof2004 IEEE InternationalConference on IntelligentRobots and System.Sendal:IEEE,2004:2203-2208.

[13]柯显信,柏垠,唐文彬.仿人面部表情机器人研究现状与展望[J].机械设计,2009,26(11):5-8.

[14]FUKUDA T,HOSOKAI H,KONDO Y.Brachiation type of mobile robot[C]//Proceedings of the 1991 IEEE International Conference on Advanced Robotics.Pisa:IEEE,1991:915–920.

[15]HASEGAWA Y,ITO Y,FUKUDA T.Behavior coordination and its modification on brachiation-type mobile robot[C]//Proceedings of the 2000 IEEE International Conference on Robotics and Automation.San Francisco:IEEE,2000:3984-3989.

[16]WU W G,HASEGAWA Y,FUKUDA T.ゴリラ型ロボットの機構設計及び起き上がり動作の基礎研究[C]//RSJ2000.つくば:RSJ,2000.

[17]WU W G,HASEGAWA Y,FUKUDA T.Standing up motion control of a gorilla robot for a transition from quadruped locomotion to biped walking[C]//ROBOMEC2001.Kagawa:JSME,2001.

[18]WU W G,HASEGAWA Y,FUKUDA T.Walking model shifting control from biped to quadruped for a gorilla robot[C]//Proceedings of the 40th SICE Annual Conference.Nagoya:IEEE,2001:130-135.

[19]FUKUDA T,HASEGAWA Y,SEKIYAMA K,et al.Multi-locomotion robotic systems-new concepts of bioinspired robotics[J].Springer Tracts in Advanced Robotics,2012,81:79-81.

[20]KOBAYASHI T,SEKIYAMA K,AOYAMA T,et al.Cane-supported walking by humanoid robot and fallingfactor-based optimal cane usage selection[J].Robotics and Autonomous Systems,2015,68:21-35.

[21]KAMIDE H,MAE Y,TAKUBO T,et al.Direct comparison of psychological evaluation between virtual and real humanoids:Personal space and subjective impressions[J].InternationalJournalofHuman-Computer Studies,2014,72(5):451-459.

[22]CHESTNUTT J,MICHEL P,KUFFNER J,et al.Locomotion among dynamic obstacles for the Honda ASIMO[C]//Proceedings of the 2007 IEEE/RSJ InternationalConference on IntelligentRobots and Systems.San Diego:IEEE,2007:2572-2573.

[23]KIM C H,YONEKURA K,TSUJINO H,et al.Physical control of the rotation of a flexible object:rope turning with a humanoid robot[J].Advanced Robotics,2011,25(3):491-506.

[24]KANEHIRO F,FUJIWARA K,KAJITA S,et al.Open architecture humanoid robotics platform [C]//Proceeding of 2002 IEEE Int Conf on Robotics&Automation.Washington:IEEE,2002:24-30.

[25]KANEKO K,KANEHIRO F,KAJITA S,et al.Design on prototype humanoid robotics platform for HRP[C]//Proceeding of the 2002 IEEE/RSJ Int Conference on Intelligent Robots and Systems.Lausenne:IEEE,2002:2431-2436.

[26]TANIE K.Humanoid robot and its application possibility[C]//Proceeding of the 2003 IEEE Conference on MultisensorFusion and Integration for Intelligent Systems.Tokyo:IEEE,2003:213-214.

[27]3KANEKO K,KANEHIRO F,KAJITA S,et al.Humanoid robot HRP-2[C]//Proceeding of 2004 IEEE Int Conf on Robotics& Automation.Los Angeles:IEEE,2004:1083-1090.

[28]KAJITA S,NAGASAKI T,KANEKO K,et al.A running controller of humanoid biped HRP-2LR[C]//Proceedings of the 2005 IEEE International Conference on Robotics and Automation.Barcelona:IEEE,2005:616-622.

[29]STASSE O,DAVISON A J,SELLAOUTI R,et al.Real-time 3D SLAM for humanoid robot considering pattern generator information[C]//Proceedings of the 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems.Beijing:IEEE,2006:348-355.

[30]TAKUBO T,TANAKA T,INOUE K,et al.Emergent walking stop using 3-D ZMP modification criteria map for humanoid robot[C]//Proceedings of the 2007 IEEE International Conference on Robotics and Automation.Roma:IEEE,2007:2676-2681.

[31]HARADA K,KAJITA S,KANEHIRO F,et al.Realtime planning of humanoid robot’s gait for forcecontrolled manipulation[J].IEEE/ASME Transactions on Mechatronics,2007,12(1):53-62.

[32]MITTENDORFER P,YOSHIDA E,CHENG G.Realizing whole-body tactile interactions with a self-organizing,multi-modal artificial skin on a humanoid robot[J].Advanced Robotics,2015 29(1):51–67.

[33]KAJITA S,NAGASAKI T,KANEKO K,et al.ZMP-based biped running control:the HRP-2LR humanoid biped robot[J].Proceedings of the 2007 IEEE Robotics &Automation Magazine,2007,14(2):63-72.

[34]KAJITA S,KANEKO K,MORISAWA M,et al.ZMP-based biped running enhanced by toe springs[C]//Proceedings of the 2007 IEEE International Conference on Robotics and Automation.Roma:IEEE,2007:3963-3969.

[35]YAMAZAKI K,OYA R,NAGAHAMA K,et al.Bottom dressing by a life-sized humanoid robot provided failure detection and recovery functions[C]//Proceedings ofthe 2014 IEEE/SICE International Symposium on System Integration.Tokyo:IEEE,2014:564-570.

[36]OKAMOTO T,SHIRATORI T,KUDOH S,et al.Toward a dancing robotwith listening capability:keypose-based integration oflower-, middle-, and upper-body motions for varying music tempos[J].IEEE Transactions on Robotics,2014,30(3):771-778.

[37]PETIT D,GERGONDET P,CHERUBINI A,et al.Navigation assistance for a bci-controlled humanoid robot[C]// Proceedings of the 4th Annual IEEE International Conference on Cyber Technology in Automation, Controland IntelligentSystems.Hong Kong:IEEE,2014:246-251.

[38]AKACHI K,KANEKO K,KANEHIRA N,et al.Developmentofhumanoid robotHRP-3P[C]//Proceedings of the 2005 5th IEEE-RAS International Conference on Humanoid Robots.Tsukuba:IEEE,2005:50-55.

[39]HASUNUMA H,HARADA K,HIRUKAWA H.The tele-operation of the humanoid robot-whole body operation for humanoid robots in contact with environment[C]//Proceedings of the 2006 IEEE-RAS International Conference on Humanoid Robots.Genoa:IEEE,2006:333-339.

[40]KANEHIRO F,ISHIWATA Y,SAITO H,et al.Distributed control system of humanoid robots based on real-time ethernet[C]//Proceedings of the 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems.Beijing:IEEE,2006:2471-2477.

[41]YOSHIDA E,POIRIER M,LAUMOND J P,et al.Whole-body motion planning for pivoting based manipulation by humanoids[C]//Proceedings of the 2008 IEEE International Conference on Robotics and Automation.Pasadena:IEEE,2008:3181-3186.

[42]KANEKO K,MIURA K,KANEHIRO F,et al.Cybernetic human HRP-4C[C]//Proceedings of the 9th IEEE-RAS International Conference on Humanoid Robots.Paris:IEEE,2009:7-14.

[43]MIURA K,NAKAOKA S,KAJITA S,et al.Trials of cybernetic human HRP-4C toward humanoid business[C]//Proceedings of the 2010 IEEE Workshop on Advanced Robotics and itsSocialImpacts.Seoul:IEEE,2010:165-169.

[44]MIURA K,MORISAWA M,NAKAOKA S,et al.Robot motion remix based on motion capture data-towards humanlike locomotion of humanoid robots[C]//Proceedings of the 9th IEEE-RAS International Conference on Humanoid Robots.Paris:IEEE,2009:590-603.

[45]KANEKO K,KANEHIRO F,MORISAWA M,et al.Hardware improvement of cybernetic human HRP-4C for entertainment use[C]//Proceedings of the 2011 IEEE/RSJ International Conference on Intelligent Robots and Systems.San Francisco:IEEE,2011:4392-4399.

[46]KANEKO K,KANEHIRO F,MORISAWA M,et al.Humanoid robot HRP-4 humanoid robotics platform with lightweight and slim body[C]//Proceedings of the 2011 IEEE/RSJ International Conference on Intelligent Robots and Systems.San Francisco:IEEE,2009:4400-4407.

[47]MIURA K,YOSHIDA E,KOBAYASHI Y,et al.Humanoid robot as an evaluator of assistive devices[C]//Proceedings of the 2013 IEEE International Conference on Robotics and Automation.Karlsruhe:IEEE,2013:679-685.

[48] OGURAY, OGURAY, AIKAWAH, etal.Development of a new humanoid robot WABIAN-2[C]//Proceedings of the 2006 IEEE International Conference on Roboticsand Automation.Orlando:IEEE,2006:76–81.

[49]GAUTAM N,KONG W S,XU P,et al.Comparison of bipedal humanoid walking with human being using inertial measurement units and force-torque sensors[C]// Proceedings of the 2013 IEEE/SICE International Symposium on System Integration.Kobe:IEEE,2013:198-203.

[50]HASHIMOTO K,HATTORI K,OTANI T,et al.Foot placement modification for a biped humanoid robot with narrow feet[J].The Scientific World Journal,2014,2014:1-9.Article ID 259570.

[51]KISHI T,OTANI T,ENDO N,et al.Development of expressive robotic head for bipedal humanoid robot[C]//Proceedings of the 2012 IEEE/RSJ International Conference on Intelligent Robots and Systems.Vilamoura:IEEE,2012:4584-4589.

[52]KIM J H,OH J H.Realization of dynamic walking for the humanoid robot platform KHR-1[J].Advanced Robotics,2004,18(7):749-768.

[53]KIM J Y,PARK I W,OH J H.Design and walking controlofthehumanoid robot,KHR-2 (KAIST Humanoid Robot-2)[C]// Proceedings ofthe International Conference on Control,Automation and Systems.Bangkok:ICCAS,2004:1539-1543.

[54]KIM J Y,PARK I W,LEE J H,et al.System design and dynamic walkingofhumanoidrobotKHR-2[C]//Proceedings of the IEEE International Conference on Robotics& Automation.Seattle:IEEE,2005:1431-1436.

[55]PARK I W,KIM J Y,OH J H.Online biped walking pattern generation for humanoid robot KHR-3(KAIST Humanoid Robot-3:HUBO)[C]//Proceedings of the IEEE InternationalConferenceon Humanoid robot.Daejeon:IEEE,2006:398-403.

[56]AHN K H,OH Y W.Walking control of a humanoid robot via explicit and stable CoM manipulation with the angular momentum resolution[C]//Proceedings of the 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems.Beijing:IEEE,2006:2478-2483.

[57]KIM J Y,LEE J H,OH J H.Experimental realization of dynamic walking for a human-riding biped robot,HUBO FX-1[J].Advanced Robotics,2007,21(3/4):461-484.

[58]KIM J Y,PARK I W,OH J H.Walking control algorithm of biped humanoid robot on uneven and inclined floor[J].Journal of Intelligent and Robotic Systems,2007,48(4):457-484.

[59]HACKEL M.Humanoid Robots:Human-like Machines[M].Vienna:I-Tech Education and Publishing,2007:43-64.

[60]DANTAM N T,LOFARO D M,HEREID A,et al.The ach library: a new framework for real-time communication[J].IEEE Robotics & Automotion Magazine,2015,22(1):76-85.

[61]OH J H,HANSON D,KIM W S,et al.Design of android type humanoid robot albert HUBO[C]//Proceedings of the 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems.Beijing:IEEE,2006:1428-1433.

[62]HEO J W,OH J H.Biped walking pattern generation using an analytic method for a unit step with a stationary time interval between steps[J].IEEE Transactions on Industrial Electronics,2015,62(2):1091-1100.

[63] YAMAGUCHIJ, NISHINOD, TAKANISHIA.Realization of dynamic biped walking varying joint stiffness using antagonistic driven joints[C]//Proceedings of the 1998 IEEE International Conference on Robotics and Automationp.Leuven:IEEE,1998:2022-2029.

[64]MASAHIKO O,NOBUYUKI I,YUTO N,et al.Stiffness readout in musculo-skeletal humanoid robot by using rotary potentiometer[C]//Proceedings of the 2010 IEEE Sensors.Waikoloa:IEEE,2010:2329-2333.

[65]ITO N,URATA J,NAKANISHI Y,et al.Development of very small high output motor driver for realizing forceful musculoskeletal humanoids[C]//Proceedings of the 2010 IEEE-RAS International Conference on Humanoid Robots.Nashville:IEEE,2010:385-390.

[66]NAKANISHI Y,ITO N,SHIRAI T,et al.Design of powerful and flexible musculoskeletal arm by using nonlinear spring unit and electromagnetic clutch opening mechanism[C]//Proceedings of the 2011 IEEE-RAS International Conference on Humanoid Robots.Bled:IEEE,2011:377-382.

[67]NAKANISHI Y,IZAWA T,KUROTOBI T,et al.Achievement of complex contact motion with environments by musculoskeletal humanoid using humanlike shock absorption strategy[C]//Proceedings of the 2012 IEEE/RSJ International Conference on IntelligentRobotsandSystems.Vilamoura:IEEE,2012:1815-1820.

[68]NAKANISHI Y,IZAWA T,OSADA M, et al.Development of musculoskeletal humanoid kenzoh with mechanical compliance changeable tendons by nonlinear spring unit[C]//Proceedings of the 2011 IEEE International Conference on Robotics and Biomimetics.Phuket:IEEE,2011:2384-2389.

[69]MASAHIKO O,NOBUYUKI I,YUTO N,et al.Stiffness readout in musculo-skeletal humanoid robot by using rotary potentiometer[C]//Proceedings of the 2010 IEEE Sensors.Waikoloa:IEEE,2010:2329-2333.

[70]OSADA M,ITO N,NAKANISHI Y,et al.Realization of flexible motion by musculoskeletal humanoid“Kojiro”with add-on nonlinear spring units[C]//Proceedings of IEEE-RAS InternationalConference on Humanoid Robots.Nashville:IEEE,2010:174-179.

[71]IZAWA T,NAKANISHI Y,ITO N,et al.Development of stiffness changeable multi joint cervical structure with soft sensor flesh for musculo-skeletal humanoids[C]//Proceedings of IEEE-RAS International Conference on Humanoid Robots.Nashville:IEEE,2010:665-670.

[72]OSADA M,IZAWA T,URATA J,et al.Approach of“planar muscle” suitable for musculoskeletal humanoids,especially for their body trunk with spine having multiple vertebral[C]//Proceedings of IEEERAS International Conference on Humanoid Robots.Bled:IEEE,2011:358-363.

[73]KOICHI N,ATSUSHI K,KOICHI N,et al.The humanoid saika that catches a thrown ball[C]//Proceedings of IEEE/RSJ International Conference on Robot and Human Interactive Communication.Kobe:IEEE ,1997:94-99.

[74]ITO N,URATA J,NAKANISHI Y,et al.Development of Small Motor Driver Integrating Sensor Circuit and Interchangeable Communication Board[J].Journal of Robotics and Mechatronics,2011,23(3):443-450.

[75]OSADA M,MIZOGUCHI H,ASANO Y,et al.Design of humanoid body trunk with“multiple spine structure”and“planar-muscle-driven”system for achievement of humanlike powerful and lithe motion[C]//Proceedings of IEEE InternationalConferenceon Roboticsand Biomimetics.Phuke:IEEE,2011:2217-2222.

[76]MIGLIORE S A,TING L H,DEWEERTH S P.Passive joint stiffness in the hip and knee increases the energy efficiency of leg swing[J].Autonomous Robots,2010,29(1):119-135.

[77]MIZUUCHI I,NAKANISHI Y,SODEYAMA Y,et al.An advanced musculoskeletal humanoid kojiro[C]//Proceedings of IEEE-RAS International Conference on Humanoid Robots.Daegu:IEEE,2007:294-299.

[78]KOZUKI T,MIZOGUCHI H,ASANO Y,et al.Design methodology for the thorax and shoulder of human mimetic musculoskeletal humanoid Kenshiro-a thorax structure with rib like surface[C]//Proceedings of IEEE/RSJ International Conference on Intelligent Robots and Systems.Vilamoura:IEEE,2012:3687-3692.

[79]ASANO Y,MIZOGUCHI H,KOZUKI T,et al.Achievement of twist squat by musculoskeletal humanoid with screw-home mechanism[C]//Proceedings of IEEE/RSJ International Conference on Intelligent Robots and Systems.Tokyo:IEEE,2013:4649-4654.

[80]NAKANISHI Y,ASANO Y,KOZUKI T,et al.Motion Generation of Redundant MusculoskeletalHumanoid Based on Robot Model Error Compensation by Muscle Load Sharing and Interactive Control Device[C]//Proceedings of IEEE-RAS International Conference on Humanoid Robots.Atlanta:IEEE,2013:336-341.

[81]NAKANISHI Y,ASANO Y,KOZUKI T,et al.Design concept of detail musculoskeletal humanoid“Kenshiro”-Toward a real human body musculoskeletal simulator[C]// Proceedings of IEEE-RAS International Conference on Humanoid Robots.Osaka:IEEE,2012:1-6.

[82]MOTEGI Y,SHIRAI T,IZAWA T,et al.Motion control based on modification of the Jacobian map between the muscle space and work space with musculoskeletal humanoid[C]//Proceedings of IEEERAS International Conference on Humanoid Robots.Osaka:IEEE,2012:835-840.

[83]ASANO Y,MIZOGUCHI H,KOZUKI T,et al.Lower thigh design ofdetailed musculoskeletalhumanoid“Kenshiro” [C]// Proceedings of IEEE/RSJ InternationalConference on IntelligentRobotsand Systems.Vilamoura:IEEE,2012:4367-4372.

[84]OSADA M,MIZOGUCHI H,ASANO Y,et al.Design of humanoid body trunk with“multiple spine structure”and“planar-muscle-driven”system for achievement of humanlike powerful and lithe motion[C]//Proceedings of IEEE InternationalConferenceon Roboticsand Biomimetics.Phuket:IEEE,2011:2217-2222.

[85]ASANO Y,MIZOGUCHI H,OSADA M,et al.Biomimetic design of musculoskeletal humanoid knee joint with patella and screw-home mechanism[C]//Proceedings ofIEEE International Conference on Robotics and Biomimetics.Phuket:IEEE,2011:1813-1818.

[86]SHIRAI T,URATA J,NAKANISHI Y,et al.Whole body adapting behavior with muscle level stiffness control of tendon-driven multijoint robot[C]//Proceedings of IEEE International Conference on Robotics and Biomimetics.Phuket:IEEE,2011:2229-2234.

[87]MIZOGUCHI H, ASANO Y, IZAWA T, et al.Biomimetic design and implementation ofmuscle arrangement around hip joint for musculoskeletal humanoid[C]//Proceedings of IEEE International Conference on Robotics and Biomimetics.Phuke:IEEE,2011:1819-1824.

[88]MIZUUCHI I,NAKANISHI Y,NAMIKI Y,et al.Realization of standing of the musculoskeletal humanoid kotaro by reinforcing muscles[C]//Proceedings of IEEE-RAS InternationalConference on Humanoid Robots.Ganoa:IEEE,2006:176-181.

[89]ESPIAU B,SARDAIN P.The anthropomorphic biped robot BIP2000[C]//Proceedings of IEEE International Conference on Robotics and Automation.San Francisco:IEEE,2000:3996-4001.

[90]VERRELST B,HAM R V,VANDERBORGHT B,et al.The pneumatic biped“lucy”actuated with pleated pneumatic artificial muscles[J].Autonomous Robots,2005,18(2):201-213.

[91]CHOI T Y,JIN S,LEE J J.Implementation of a robot actuated by artificial pneumatic muscles[C]//Proceedings of International Joint Conference on SICEICASE.Busan:SICE,2006:4733-4737.

[92]TSUJI T,MIYATA S,HASHIMOTO T,et al.Controller design for robot with pneumatic artificial muscles[C]//Proceedings of International Joint Conference on SICEICASE.Busan:SICE,2006:5419-5422.

[93]DONG H,FIGUEROA N,SADDIK A E.Adaptive“load-distributed” muscle coordination method for kinematically redundant musculoskeletal humanoid systems[J].Robotics and Autonomous Systems,2015,64:59-69.

[94]ROSENDO A,LIU X X,SHIMIZU M,et al.Stretch reflex improves rolling stability during hopping of a decerebrate biped system[J].Bioinspir Biomim,2015,10(1):016008:1-12.

[95]NISHIKAWA S,TANAKA K,SHIDA K,et al.A musculoskeletalbipedal robot designed with angledependent moment arm for dynamic motion from multiple states[J].Advanced Robotics,2014,28(7):487-496.

[96]HUDYJAYA J, MIR-NASIRI N.Development of minimalist bipedal walking robot with flexible ankle and split-mass balancing systems[J].International Journal of Automation and Computing,2013,10(5):425-437.

[97]HYON S.A motorcontrolstrategywith virtual musculoskeletal systems for compliant anthropomorphic robots[J].IEEE/ASME Trans on Mechatronics,2009,14(6):677-688.

[98]NELSON G,SAUNDERS A,NEVILLE N,et al.Petman:A humanoid robotfortesting chemical protective clothing[J].Journal of the Robotics Society of Japan,2012,30(4):372-377.

[99]KAWATO M.From ‘understanding the brain by creating the brain’towards manipulative neuroscience[J].Philosophical Trans of the Royal Society B:Biological Sciences,2008,363(1500):2201-2214.

[100]CHENG G,HYON S H,MORIMOTO J,et al.CB:A humanoid research platform for exploring neuroscience[J].Advanced Robotics,2007,21(10):1097-1114.

[101]JOHNSON M,SHREWSBURY B,BERTRAND S,et al.Team IHMC’s lessons learned from the DARPA robotics challenge trials[J].Journal of Field Robotics,2015,32(2):192-208.

[102]DEDONATO M,DIMITROV V,DU RUIXIANG,et al.Human-in-the-loop control of a humanoid robot for disaster response:a report from the DARPA robotics challenge trials[J].Journal of Field Robotics,2015,32(2):275-292.

[103]FALLON M,KUINDERSMA S,KARUMANCHI S,et al.An architecture for online affordance-based perception and whole-body planning[J].Journal of Field Robotics,2015,32(2):229-254.

[104]FENG S Y,WHITMAN E,XINJILEFU X,et al.Optimization-based full body control for the DARPA robotics challenge[J].Journal of Field Robotics,2015,32(2):293-312.

[105]RASMUSSEN C,SOHN K,WANG Q S,et al.Perception and control strategies for driving utility vehicles with a humanoid robot[C]//Proceedings of the 2014 IEEE/RSJ International Conference on Intelligent Robots and Systems.Chicago:IEEE,2014:973-980.

[106]RASMUSSEN C,SOHN K,YUVRAJ K,et al.Early phases of humanoid vehicle ingress using depth cameras[C]//Proceedings of the 2014 Technologies for Practical Robot Applications.Woburn:IEEE,2014:1-6.

[107]CHENG G,HYON S,MORIMOTO J,et al.CB:a humanoid research platform for exploring neuroscience[J].Adv Robot,2007,21(10):1097-1114.

[108]MORIMOTO J,KAWATO M.Creating the brain and interacting with the brain:an integrated approach to understanding the brain[J].J R Soc Interface,2015,12(104):1-15.

[109]RAMIREZ-AMARO K,BEETZ M,CHENG G.Understanding the intention of human activities through semantic perception:observation,understanding and execution on a humanoid robot[J].Advanced Robotics,2015,29(5):345-362.

[110]OTT C,ROA M,HIRZINGER G.Posture and balance controlfor biped robots based on contactforce optimization[C]//Proceedings of the 2011 IEEE-RAS International Conference on Humanoid Robots.Bled:IEEE,2011:26-33.

[111]OTT C,DIETRICH A,ROA M A.Torque-based multi-task and balancing control for humanoid robots[C]//Proceedings of the 11th International Conference on Ubiquitous Robots and Ambient Intelligence.Kuala Lumpur:KROS,2014:143-144.

[112]BRUNNETT G,COQUILLART S,LIERE R V,et al.Virtual Realities[M]. Switzerland: Springer International Publishing,2015:229-259.

[113]WU Weiguo,WANG Yu,LIANG Feng, et al.Development of modular combinational gorilla robot system [C]// Proceedings of the 2004 IEEE International Conference on Robotics and Biomimetics.Shengyang:Institute ofElectricaland Electronics Engineers Computer Society,2004:403-406.

[114]WU W G,WANG Y,PAN Y Z,et al.Research on the walking modes shifting based on the variable ZMP and 3-DOF inverted pendulum model for a humanoid and gorilla robot[C]// Proceedings of IEEE/RSJ InternationalConference on IntelligentRobots and Systems.Beijing:IEEE,2006:1978-1983.

[115]WU W G,WANG Y,LIANG F.Development,Stability Locomotion Analysis and Experiments of Wheeled-Locomotion Mechanism for a Humanoid and Gorilla Robot[C]//Proceedings of IEEE International Conferenceon Roboticsand Biomimetics.Kunming:IEEE,2006:1390-1395.

[116]吴伟国.仿生仿人机器人及其智能运动控制研究室[EB/OL].(2014-06-10)[2015-06-23].http://homepage.hit.edu.cn/pages/wuweiguo/5

[117]刘莉,汪劲松,陈恳.THB IP-I拟人机器人研究进展[J].机器人,2002,24(3):265-266.

[118]张正涛.乒乓球机器人视觉测量与控制[D].北京:中国科学院自动化研究所,2010.

[119]SUN Y C,XIONG R,ZHU Q G,et al.Balance motion generation for a humanoid robot playing table tennis[C]//Proceedings of 2011 11th IEEE-RAS International Conference on Humanoid Robots.Bled:IEEE,2011:19-25.

[120]TAO X,QIANG H,LI J X,et al.Trajectory calculation and gaitchange on-line forhumanoid teleoperation[C]//Proceedings of IEEE International Conference on Mechatronics and Automation.Luoyang:IEEE,2006:1614-1619.

[121]ZHANG L G,HUANG Q,LV S H,et al.Humanoid motion design considering rhythm based on human motion capture[C]//Proceedings of the 2006 IEEE/RSJ International Conference on Intelligent Robots and Systems.Beijing:IEEE,2006:2491-2496.

[122]YU Z G,MA G,HUANG Q.Modeling and design of a humanoid robotic face based on an active drive points model[J].Advanced Robotics,2014,28(6):379 -388.

[123]HAO D,ZHAO M G,ZHANG N Y.High-speed and energy-efficient biped locomotion based on Virtual Slope Walking[J].Autonomous Robots,2011,30(2):199-216.

[124]WANG J.Design and dynamic walking control of humanoid robotblackmann[C]//The 6th World Congress on Intelligent Control and Automation.Dalian,China:IEEE,2006:8848-8852.

[125]WU W G,LANG Y D,ZHANG F H,et al.Design,simulation and walking experiments for a humanoid and gorilla robot with multiple locomotion modes[C]//Proceedings of 2005 IEEE/RSJ International Conference on Intelligent Robots and Systems.Edmonton:IEEE,2005:44-49.

[126]ZHANG F H,WU W G,LANG Y D,et al.Omnidirectional quadruped walking gaits and simulation for a gorilla robot[C]//Proceedings of 2005 IEEE/RSJ InternationalConference on IntelligentRobots and Systems.Edmonton:IEEE,2005:2121-2126.

[127]WU W G,MENG Q M.Development of the humanoid head portraitrobotsystem with flexible face and expression[C]//Proceedingsofthe2004 IEEE International Conference on Robotics and Biomimetics.Shenyang:IEEE,2004:718-723.

[128]MENG Q M,WU W G,LU L.Research and development of the humanoid head portrait robot"H&Frobot-II" with expression and function of recognizing human expression[C]//Proceedings of the 2006 IEEE International Conferenceon Robotics and Biomimetics.Kunming:IEEE,2006:1372-1377.

[129]吴伟国,宋策,孟庆梅.仿人头像机器人"H&Frobot-III"语音及口形系统研制与实验[J].机械设计,2008,25(1):15-19.

[130]MENG Q M,WU W G.Artificial emotional model based on finite state machine[J].Journal of Central South University of Technology,2008,15(5):694-699.

[131]吴伟国,侯月阳.机器人关节用挠性驱动单元研制与负载特性实验[J].机械工程学报,2014,50(13):16-21.

[132]WU W G,HOU Y Y.Controller design based on viscoelasticity dynamics modeland experimentfor flexible drive unit[J].JournalofCentralSouth University of Technology,2014,21(12):4468-4477.

[133]侯月阳,吴伟国高力扬.有挠性驱动单元的双足机器人研制与步行实验[J].哈尔滨工业大学学报,2015,47(1):26-32.

[134]WU W G,DU W Q.Design and research of a 6-DOF serial-parallel mechanism platform for stability training of legged-walking robot[J].Journal of Harbin Institute of Technology(New Series),2014,21(2):75-82.