基于机器视觉与无人机的结构动位移测量方法

2022-10-17韩怡天冯东明

韩怡天, 冯东明,2, 吴 刚,2

(1.东南大学 混凝土及预应力混凝土结构教育部重点实验室,南京 211189; 2.东南大学 智慧建造与运维国家地方联合工程研究中心,南京 211189)

测量结构响应是评估结构使用性能和发现结构安全隐患的重要手段,位移是结构响应的重要指标,结构的静力与动力特性如挠度[1]、承载力[2]、影响线[3]、模态参数[4]等均可以通过位移数据得到,并用于进一步的结构分析。然而,由于传感器和数据采集系统安装繁琐、维护昂贵,传统接触式传感器在实际工程中的推广受到限制,因此学界一直在积极探索更普遍适用的新型检监测技术。随着机器视觉技术的快速发展和图像采集设备的不断升级,近年来基于视觉的结构位移测量方法不断涌现,并在实验室与工程应用中得到验证[5-6]。当前基于视觉的测量方法在工程应用中的局限可以归纳为两点:测量距离的限制和测量范围的限制。本文方法目的在于解决前者。对大跨度桥梁和超高层建筑等结构,寻找合适的位置放置视觉传感器是这类方法在应用中的难点,比如对于大部分跨越山谷河流的大跨桥梁来说,使相机具有合适拍摄角度的安放位置通常距离结构1 km以外,而受天气、镜头抖动等影响,常难以保证远距离测量的准确性[7]。

无人机(unmanned aerial vehicle, UAV)因其机动性的优势使得基于视觉的大型结构近距离位移观测成为可能,然而无人机悬停时并不能保持完全静止,以无人机视角观察到的结构位移并非结构的绝对位移,而是结构相对于无人机的位移。现有的视觉位移测量方法大多是基于静止相机的,为了消除无人机自身运动带来的影响,Reagan等[8]提出将无人机与三维数字图像相关(digital image correlation, DIC)技术结合的方法,以获得桥梁部分区域的全场位移。Tian等[9]结合相对位移和频差,提出了一种基于计算机视觉的无人机非接触索力估计法,并将其应用于悬索桥。Hoskere等[10]通过滤波和补偿提取位移信号,并将其应用于全尺度基础设施的模态分析。也有研究直接用运动相机观测到的结构位移减去某静止背景点位移来消除摄像机运动带来的影响[11],然而这种方法只有在相机距离被测结构足够远或背景距离被测结构足够近时,才能满足测量的精度,否则由空间几何关系造成的误差可能会相对显著,此外,在许多实际测量条件下,相机视野内并不总能找到静止的背景作为参考。

本文提出以静止激光灯在结构表面投射出的激光光斑为参考,利用无人机进行非接触式结构动位移测量的方法,自动检测和定位目标测点和激光光斑,通过计算无人机视角观察到的结构位移与静止激光点位移的差消除无人机自身平行于结构平面的运动,通过逐帧更新比例因子消除无人机自身垂直于结构平面的运动。开展相关试验,通过对比激光位移计和加速度传感器获取的响应数据,验证本文方法在结构动位移测量方面的准确性和在结构动力特性识别方面的可行性,以及其在不同尺度结构上开展测量的适用性。

1 使用无人机的结构动位移测量方法

1.1 测量方法与基本原理

测量方法示意如图1所示。已知尺寸的黑白靶标粘贴于结构测点表面,地面固定一远射激光灯,调整角度使其在靶标附近的结构表面形成激光光斑,无人机悬停在测点附近并使镜头云台尽可能与结构表面保持平行,确保视频画面中包含靶标和激光光斑。方法的基本原理在于,以安置在地面的远射激光灯在结构表面投射出的静止激光光斑为参考,估计和消除无人机自身平行于结构平面的运动,同时,自动检测测点处已知物理尺寸的靶标,利用已知的靶标物理尺寸,计算和更新当前帧“物理尺寸-像素尺寸”比例因子,估计和消除无人机自身垂直于结构平面的运动。

图1 基于无人机的结构动位移测量方法示意Fig.1 Schematic of UAV-based structural dynamic displacement measurement method

视频处理和位移计算的方法与步骤,如图2所示。主要包括:① 在视频首帧中选择靶标和激光光斑区域分别作为各自的感兴趣区(region of interest, ROI)模板,在后续帧中对两模板进行匹配,重新选择自适应ROI,实现靶标和激光光斑中心的“粗定位”;② 对两个自适应ROI分别进行图像处理,通过寻找图形轮廓和寻找最小包络圆获得图形几何中心的位置坐标,实现“精定位”,通过靶标圆点间识别得到的像素距离与已知的其物理距离逐帧自动计算当前帧的“物理-像素”比例因子;③ 将自适应ROI“精定位”局部坐标结果恢复到全帧图像的坐标,计算得到靶标和激光光斑间的相对物理位移,经过比例因子换算得到各帧绝对物理位移,按照时间序列连接得到最终的时程位移曲线。

图2 基于机器视觉与无人机的动位移计算方法流程Fig.2 Flow chart of dynamic displacement calculation method based on machine vision and UAV

1.2 基于模板匹配的目标“粗定位”

模板匹配方法是通过在目标图像中逐像素位置搜索找到与模板图像最相似位置的方法,模板图像以像素为步长,从左到右,从上到下在目标图像上滑动,每到达一个新位置时,与模板大小相同的图像进行像素计算,最终选择最相似的区域。因设计的黑白靶标与结构和背景相比具有明显的区分度,为提高运算速度,本文选用最简单的平方差作为衡量相似度的指标

(1)

式中:T为模板;I为目标图像。相似度越高,计算结果越小,完全相似时,R=0,对每帧图像进行初始ROI的匹配,选择结果最小的位置作为该目标的自适应ROI,即“粗定位”位置。

1.3 图像预处理与目标精定位

1.3.1 自适应二值化分割

灰度图像中每个像素都用灰度表示,灰度直方图是图片灰度分布的函数,用于计算图像所有像素中不同灰度值出现的频率。靶标ROI和激光光斑ROI均具有明显的灰度分布特征,二值化是分割目标和背景最简单和快速的方法。然而,受不同测量环境、光照变化、阴影遮挡等因素影响,二值化无法规定统一的阈值,人工判断不同视频的合适阈值耗时费力。最大类间方差法是Otsu[12]提出的自适应阈值选择方法,现被称为OTSU方法。该方法的主要思想是根据图像灰度特征将图像分为背景类和目标类。背景类(C0)与目标类(C1)之间的类间方差越大,构成图像的两部分间差异就越显著,当两部分间差异最大时,阈值即为所求。

背景类与目标类灰度均值计算公式分别为

(2)

(3)

式中:M为图像中的最高灰度值;pm为灰度值为m的像素出现的概率;ω0和ω1分别为C0类和C1类出现的概率。

图片整体灰度均值计算公式为

(4)

类间方差计算公式为

ω0ω1(u1-u0)2

(5)

1.3.2 形态学运算

二值化后的ROI图像中目标以白色图块呈现在黑色背景上,但其边缘往往存在一些凸起。开操作是一种图像形态学运算,通过使用结构元素B对集合A先腐蚀再膨胀,可达到平滑边界的目的。开操作运算公式如下

A∘B=(A⊖B)⊕B

(6)

式中:⊖为腐蚀;⊕为膨胀,二者均为基本的图像形态学运算。结构元素是一个给定的像素矩阵,一般为方形、圆形或菱形。在结构元素中有一个与模板中心相同的锚点在图片中逐像素移动和计算,并将处理后的结果分配给中心点对应的像素。这一过程与卷积基本相同,只是形态学为基于集合运算,而卷积为基于算术运算。膨胀是寻找局部最大值的操作,具体步骤为:用结构元素扫描图像的每个像素,并在结构元素与其覆盖的二值图像之间进行“与”运算,若所有位置的结果都为0,则该像素的值为0,否则为1。腐蚀是寻找局部最小值的操作,与膨胀操作的最后一步不同,腐蚀的标准是:若所有位置的结果都为1,则该像素的值为1,否则为0。

1.3.3 提取轮廓和拟合图形

通过前述图像处理过程,两个ROI的图像均以分界线平滑的黑白两色呈现,使用边界跟踪算法[13]得到靶标圆点和激光光斑的轮廓,并分别设为不同的二维点集。寻找各轮廓点集的最小包络圆,获得圆心坐标,算法流程如图3所示。

图3 求解最小包络圆算法流程Fig.3 Flow chart of finding minimum envelope circle algorithm

1.4 位移计算

通过上述图像处理步骤,得到靶标上四个白色圆点的圆心坐标及激光光斑的中心坐标。在靶标的四个白点中选择两个相对排列的白点(即选择上、下两点或左、右两点),逐帧计算两圆心间的像素距离dtarget,i。利用已知的两圆心间的物理距离Dtarget,计算得到每一帧图像拍摄时结构物理尺寸与图像像素尺寸的比值,即比例因子

(7)

式中,i为视频的第i帧。

将靶标上四个圆点圆心坐标的平均值作为靶标的位置坐标,激光光斑中心的坐标作为激光光斑的位置坐标,还原至全帧尺寸以计算靶标位置坐标与激光光斑位置坐标的差值(Δxi,Δyi),以第1帧计算结果为参考零点像素位移,调整各帧像素位移基线,即第i帧像素位移为(Δxi-Δx1,Δyi-Δy1),与对应帧的比例因子相乘得到各帧拍摄时结构发生的物理位移

Di=si×(Δxi-Δx1,Δyi-Δy1)

(8)

最终,将每一帧计算得到的物理位移按照拍摄时间序列连接即得到结构的绝对动位移时程。

2 精度验证

2.1 试验方案

为了验证该方法的准确性,制作了一个两层框架模型,将本文使用无人机的动位移测量方法与高精度激光位移传感器测量得到的位移响应数据进行对比,试验布置如图4所示。框架全部采用Q235钢制成,层高为400 mm,每层平面尺寸为240 mm×240 mm,使用螺栓连接,黑白标记贴于框架顶层正面左侧表面。高精度激光位移计(KEYENCE IL-600)固定于顶层左侧支架上,通过放大器(KEYENCE IL-1000)与动态采集仪(北京东方振动和噪声技术研究所INV3062S)和笔记本电脑相连,用于采集框架顶层位移响应,采集频率设为300 Hz。激光灯固定于地面,激光束射于框架顶层表面,用于为无人机拍摄的视频提供静止参考点。无人机采用大疆御2双光版小型无人机,并使用其搭载的可见光相机进行视频拍摄,分辨率为3 840×2 160,帧率为30 Hz。

图4 试验布置Fig.4 Test setup

试验时,控制无人机悬停于测点附近,调整无人机视角使镜头尽量正对待测结构表面,使用橡胶锤在框架顶层分别施加2次不同大小的冲击荷载,使结构在x方向产生不同幅值的振动,无人机视觉测量系统采集测点附近的振动视频,激光位移计同步采集测点位置的位移响应。

2.2 试验结果

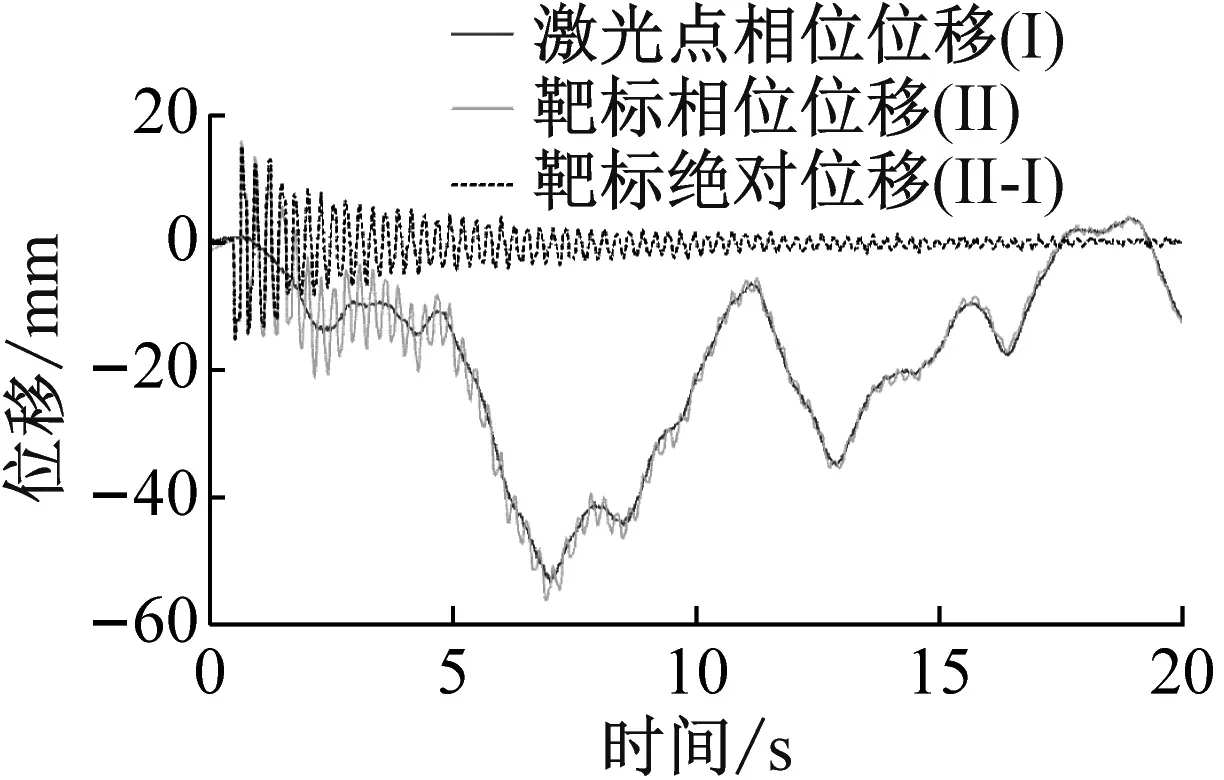

两次敲击试验中无人机对结构测点沿x方向运动的测量结果,如图5(a)和(b)所示。三条曲线分别为:① 无人机观察到的激光点位移,即激光点相对于无人机的位移;② 无人机观察到的靶标位移,即靶标相对于无人机的位移;③ 通过前两项相减计算得到的靶标绝对位移。从图5(a)和(b)可知,无人机在测量过程中自身产生了明显大于结构振动幅值的位移,通过本文提出的方法有效地消除了无人机自身的振动,测量结果准确地反映了结构本身的振动。

(a) 第1次敲击试验无人机测量结果

(b) 第2次敲击试验无人机测量结果

(c) 第1次敲击试验位移时程对比(0~20 s)

(d) 第2次敲击试验位移时程对比(0~20 s)

(e) 第1次敲击试验位移时程对比(4~6 s)

(f) 第2次敲击试验位移时程对比(4~6 s)

(g) 第1次敲击试验频谱

(h) 第2次敲击试验频谱图5 试验结果Fig.5 Test result

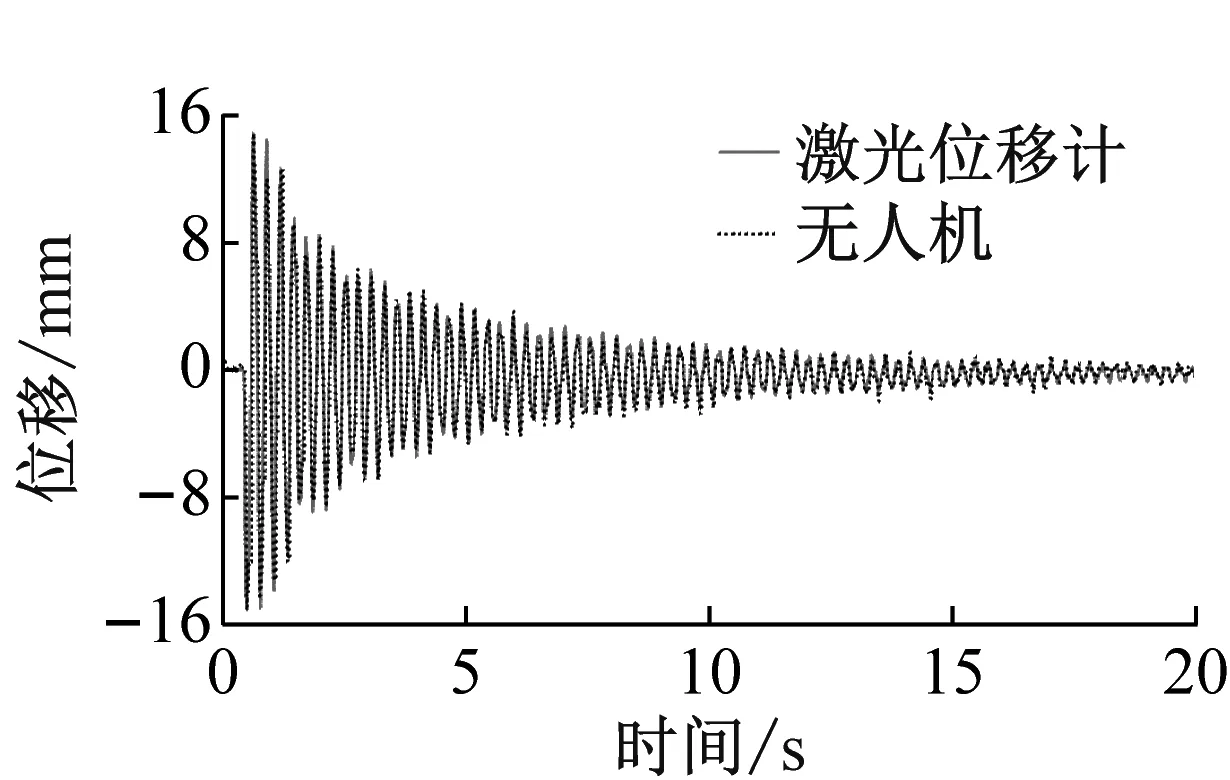

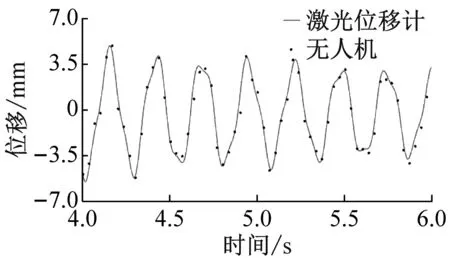

将无人机的位移测量结果与激光位移计的测量结果进行对比,并选取其4~6 s的测量结果进行放大,如图5(c)~5(f)所示。结果表明,基于无人机的位移测量结果与激光位移计数据高度吻合,以激光位移计获得的数据作为真实值,使用归一化均方根误差(normalized root mean square error,NRMSE)进行误差量化分析

(9)

式中:n为计算的采样点的个数;U为无人机获取的数据;L为激光位移计获取的数据。对无人机0~20 s的测量数据进行分析,得到两次试验的归一化均方根分别为1.38%和2.18%。

为进一步验证使用无人机的位移测量方法在结构动力分析方面的可行性,将无人机与激光位移计测得的位移响应进行了频域分解,结果如图5(g)~5(h)所示。由图5(g)~5(h)可知,两种测量方法得到的位移数据经过频域分解均可以很好地识别出结构的前两阶模态。通过无人机和激光位移计测量结果获得的框架第1阶和第2阶模态频率,如表1所示。同时,以激光位移计测量数据为参考,计算得到了基于无人机测量数据进行模态频率分析的误差。从表1可知,无人机测量结果经过频域分解得到的结构前两阶频率与激光位移计数据得到的计算结果误差非常小,均在0.9%以内。需要说明的是,本试验采用的无人机最高拍摄帧率为30 Hz,根据奈奎斯特采样定理可知,其采样频率已接近结构第2阶模态的最小采样频率,如果采用更高帧率的相机进行拍摄,测量精度还可能进一步提高。

表1 模态频率对比分析Tab.1 Comparative analysis of modal frequencies

3 大型地震模拟振动台试验

为了验证该方法在大型结构低频振动位移测量和动态特性识别方面的应用能力,将本文提出的基于无人机的结构动位移测量方法应用于大型地震模拟振动台试验中结构关键节点的动位移测量。

3.1 试验方案

试验在东南大学地震模拟振动台上开展,振动台台面尺寸为4 m×6 m,单向水平振动,最大加速度1.5g(25 t),最大激振力100 t,频率范围0.1~50 Hz,最大行程± 250 mm。按照峰值加速度20 Gal、35 Gal、70 Gal、100 Gal、160 Gal、220 Gal、340 Gal、400 Gal分别调整Imperial Val.-06、Loma Prieta和一条人工波作为输入,并在每次地震动输入前进行白噪声激励。

试验对象为经5∶1缩尺后的钢结构屈曲约束支撑框架,层高0.8 m,共5层。选取第4层中间节点进行动位移测量,如图6所示,振动台对结构施加沿x轴的地震荷载。无人机悬停于测点附近记录测点的振动视频,录制帧率为30 Hz。同层侧边安装有激光位移计,被测节点所连钢梁中间位置安装有加速度计,配合东方所动态采集仪同步收集振动台输入地震响应时该层的位移与加速度响应数据,采样频率为1 000 Hz。

图6 大型地震模拟振动台试验现场图Fig.6 The site of seismic simulation shaking table test

3.2 试验结果

选取其中一组工况的结果进行展示与分析,所选人工波以峰值加速度220 Gal加载时激光位移计和无人机获取的测点沿x方向的位移时程曲线,如图7所示。从图7可知,无人机测量结果与激光位移计测量结果基本一致,准确反映了结构的振动情况。以激光位移计获得的数据作为真实值,通过式(9)计算得到无人机测得位移响应结果的归一化均方根误差为2.49%。然而,无人机测量得到的曲线在部分峰值点比激光位移计曲线峰值点略低,这是因为本次试验采用的无人机视频录制帧率较低,采样点错过了部分峰值点,可以通过搭载更高帧率的相机云台避免这一问题。

图7 一组人工波下的位移时程曲线Fig.7 Time-history displacement waves under an artificial waves

因无人机采集的位移数据与加速度传感器采集的加速度数据无法直接进行比较,故通过频域分解法将两种信号转换至频域进行分析。选取0~5 Hz频率段绘制频谱曲线如图8所示。从图8可知,加速度计识别的加速度信号在高频段具有更高的能量,无人机识别的位移信号在低频段具有更高的能量,这与我们“加速度信号对高频敏感,位移信号对低频敏感”的认知也是相符的。提取两者峰值对应的频率进行数值比较,如表2所示。结果表明,两种响应在频域峰值点处的频率结果非常吻合,相对误差均小于1.7%。

(a) 加速度计测量的加速度响应频谱

(b) 无人机测量的位移响应频谱图8 地震模拟振动台试验频域分解结果Fig.8 Frequency domain decomposition results of seismic simulation shaking table test

表2 地震模拟振动台试验频谱峰值对比Tab.2 Frequency spectrum peaks comparison of seismic simulation shaking table test

4 结 论

针对目前基于视觉的结构位移测量手段存在的局限,本文提出了一种结合机器视觉与无人机的结构动位移测量方法,并与传统测量方法的结果进行对比,结果表明:

(1) 本文方法突破了基于视觉的结构位移测量中传感器摆放位置的局限,利用无人机高机动性的优点,为远距离非接触式结构动位移测量提供了新的思路。

(2) 对实验室二层钢框架结构进行了动位移测量并对结果进行了模态频率识别,通过与高精度激光位移计测量结果对比分析可知,本文方法准确地消除了无人机因自身抖动带来的测量误差,测量结果与激光位移计结果具有良好的一致性,归一化均方根误差小于2.2%,同时模态频率计算结果也高度吻合,误差小于0.9%,表明本文方法在结构动位移测量方面的准确性和在结构动力特性识别方面的可行性。

(3) 将此方法应用于大型振动台框架试验节点位移测量,与布置于该层的激光位移计和加速度计数据进行对比,以激光位移计为参考的位移响应归一化均方根误差小于2.5%,以加速度计为参考的频谱峰值频率相对误差小于1.7%,说明了本文方法用于大型结构测量的可靠性。

本文方法在实际工程应用中可行的工作距离主要取决于激光装置的技术参数,本文两个室内试验受场地限制激光灯安置位置距离结构较近,但所选用的远射激光灯在理想暗光条件下射程可达2 000 m以上,在实际室外光线环境测试中可在200 m以外的结构上投射出较为清晰的光斑。然而随着激光灯投射距离的增加,投射在结构表面的光斑强度有所下降,光斑范围有所扩大,测量精度可能会受到一定程度的影响。通过选用大功率、高精度的专业激光装置可以在一定程度上控制这一问题,同时,本文算法在室外条件下的鲁棒性研究仍需在后续的工程应用中不断测试与完善。