基于融合自注意力机制的GRU边坡预测算法研究

2023-12-22贾学明毛友平

贾学明,黄 河,毛友平,周 伟

(招商局重庆交通科研设计院有限公司,重庆 404100)

0 引言

边坡的稳定性预测对于保障人员和财产安全至关重要。然而,传统的边坡预测方法往往无法准确捕捉边坡演化的复杂性和非线性特征[1-2]。近年来,基于循环神经网络(Recurrent Neural Network,RNN)的深度学习技术在时序数据建模和预测方面取得了显著进展[3],但是传统的预测模型难以捕捉到序列中不同位置之间的复杂依赖关系,导致预测结果的不稳定。为解决长时间序列预测趋势偏差太大的问题,本研究提出了一种基于融合自注意机制的门控循环单元(Gate Recurrent Unit,GRU)边坡预测算法,旨在提高预测准确性和可靠性。自注意机制能够加权不同位置的序列元素,更好地关注关键时间步,捕捉到边坡演化的重要特征,从而实现边坡趋势的有效预测。

本文详细介绍了融合自注意机制的GRU模型的原理和方法,并建立了神经网络模型。实验验证了该算法在不同边坡数据集上的性能,与传统方法进行了对比分析。本研究的成果对于边坡管理和风险防控具有重要意义。提高边坡预测的准确性和可靠性,可以及时发现边坡的潜在风险,并采取相应措施进行干预和修复。该研究为深入理解边坡演化机制和优化预测模型提供了借鉴价值。合理应用基于融合自注意机制的GRU边坡预测算法,为边坡工程的安全性和稳定性提供可靠保障。

1 基于融合自注意力机制的GRU边坡预测算法

1.1 循环神经网络

循环神经网络是一种能够处理序列数据的神经网络模型。与传统的前馈神经网络不同,RNN可以循环连接,使得信息能够在网络内部进行传递和保存。这种内部的循环结构使得RNN能够对序列数据中的时间依赖关系进行建模。

RNN的核心思想是在每个时间步,网络会接受当前输入和上一个时间步的隐藏状态,并输出当前时间步的隐藏状态和预测结果。这种隐藏状态的传递和更新机制使得网络能够通过时间的推移捕捉到序列数据中的动态模式和信息[4]。

1.2 门控循环单元

门控循环单元是一种循环神经网络(RNN)的变体,旨在解决传统RNN模型中的梯度消失和梯度爆炸问题。GRU通过引入更新门(Update Gate)和重置门(Reset Gate)来控制信息的传递和遗忘,从而在序列数据建模中表现出色。

GRU的核心思想是在每个时间步,它接受当前输入和上一个时间步的隐藏状态,并输出当前时间步的隐藏状态。通过引入更新门,GRU能够决定应该从上一个时间步的隐藏状态中保留多少信息。更新门可以控制隐藏状态的更新幅度,从而更好地处理长期依赖关系。此外,GRU还引入了重置门,用于控制隐藏状态中历史信息的遗忘程度,使模型能够更好地适应不同时间步的序列模式[5-6]。结构如图1所示。

图1 GRU结构

GRU相对于传统的RNN模型具有更少的参数和更高的计算效率,同时在某些任务上表现出更好的性能。它适用于处理序列数据,如自然语言处理、语音识别、时间序列分析等领域。在边坡预测中,GRU能够学习边坡序列中的演化规律,通过隐藏状态的传递和更新,提取序列中的重要特征,并进行预测和分析。GRU在边坡预测中的应用可以提高预测的准确性和可靠性,有助于边坡工程的安全性评估和风险控制。

1.3 自注意力机制

自注意力机制(Self-Attention Mechanism)是一种用于建模序列数据中元素之间相互关系的技术。它被广泛应用于自然语言处理和计算机视觉等领域,用于捕捉序列中不同位置之间的依赖关系和重要性。

自注意力机制通过计算序列中不同元素之间的关联度(或称为注意力权重),来确定不同元素在模型计算中的重要性。具体来说,自注意力机制引入了3个线性变换:查询(Query)、键(Key)和值(Value)。通过计算查询和键之间的相似度,得到注意力权重,然后将权重与值相乘得到加权值的总和作为输出[7]。

自注意力机制的优势在于能够对不同位置之间的依赖关系进行建模,无论这些位置在序列中相隔多远。这使得模型能够在处理长序列时更好地捕捉到全局上的依赖关系,而不仅仅局限于局部信息。此外,自注意力机制还具有并行计算的特性,使得模型能够高效地处理大规模序列数据[8]。

在边坡预测中,自注意力机制可以用来对边坡序列中的不同时间步进行加权处理,从而更好地关注重要的时间步和边坡特征。通过引入自注意力机制,边坡预测模型能够更准确地捕捉到边坡演化过程中的关键特征,提高预测的准确性和可靠性。

1.4 融合Self-Attention的GRU的预测模型

GRU作为序列建模的经典模型,具有门控机制,可以有效地处理长期依赖问题[9]。通过引入自注意力机制,注意力机制模块用于计算输入序列的自注意力权重[10-11],将自注意力权重与隐藏状态的更新和输出相结合。模型可以更加有效地关注传感器数据跳变部分,并将相关信息加权融合到隐藏状态和输出中,以增强模型对序列数据的建模能力和表征能力。融合自注意力机制的GRU预测模型如图2 所示。

图2 融合自注意力机制的GRU预测模型

2 实验验证

2.1 实验环境

本实验采用Python3.8进行编程,Pytorch作为模型基本框架实现,学习率为0.001,优化器选择Adam,120个epoch进行训练,实验环境具体信息如表1所示。

2.2 数据集构建

本文数据集来源于边坡监控企业实测数据,结合业主对于短期监测趋势预测的需要,从已安装的传感器中,选取典型的位移传感器3个月数据,共1 680个数据点作为数据集,其中训练80%作为训练集,20%作为测试集。

2.3 处理异常值

边坡监测设备中,由于测量误差、环境变化、元器件特性、测量方法、数据采样和外部干扰等,导致采集到的元数据存在抖动数据。处理抖动数据,可以最小化抖动对数据分析和解释的影响。

中值滤波是一种非线性数字滤波器[12-13],它使用滤波器窗口内所有数据点的中位数来替换每个数据点的值。与其他滤波器不同,中值滤波器对于去除脉冲噪声或其他不规则噪声效果明显。传感器数据滤波前后如图3所示。

图3 数据滤波对比

2.4 重复值处理

由于同一时刻采集到多组数据映射到时间轴上且由于设备采样频率不稳定,采集的原始数据中,会产生异常跳变数据。在正常情况下,设备的采样间隔为每1 h采集1个样本点,但是在实际的工程应用中,由于设备及通信环境的不稳定性,导致设备在很短的时间间隔进行了多次采样,反映在折线图中就会产生斜率很大的折线,如图4所示。重复数据通常根据时间数据一对一的关系,直接剔除第二个重复数据。处理后的数据如图5所示。

图4 重复数据

图5 重复数据处理结果

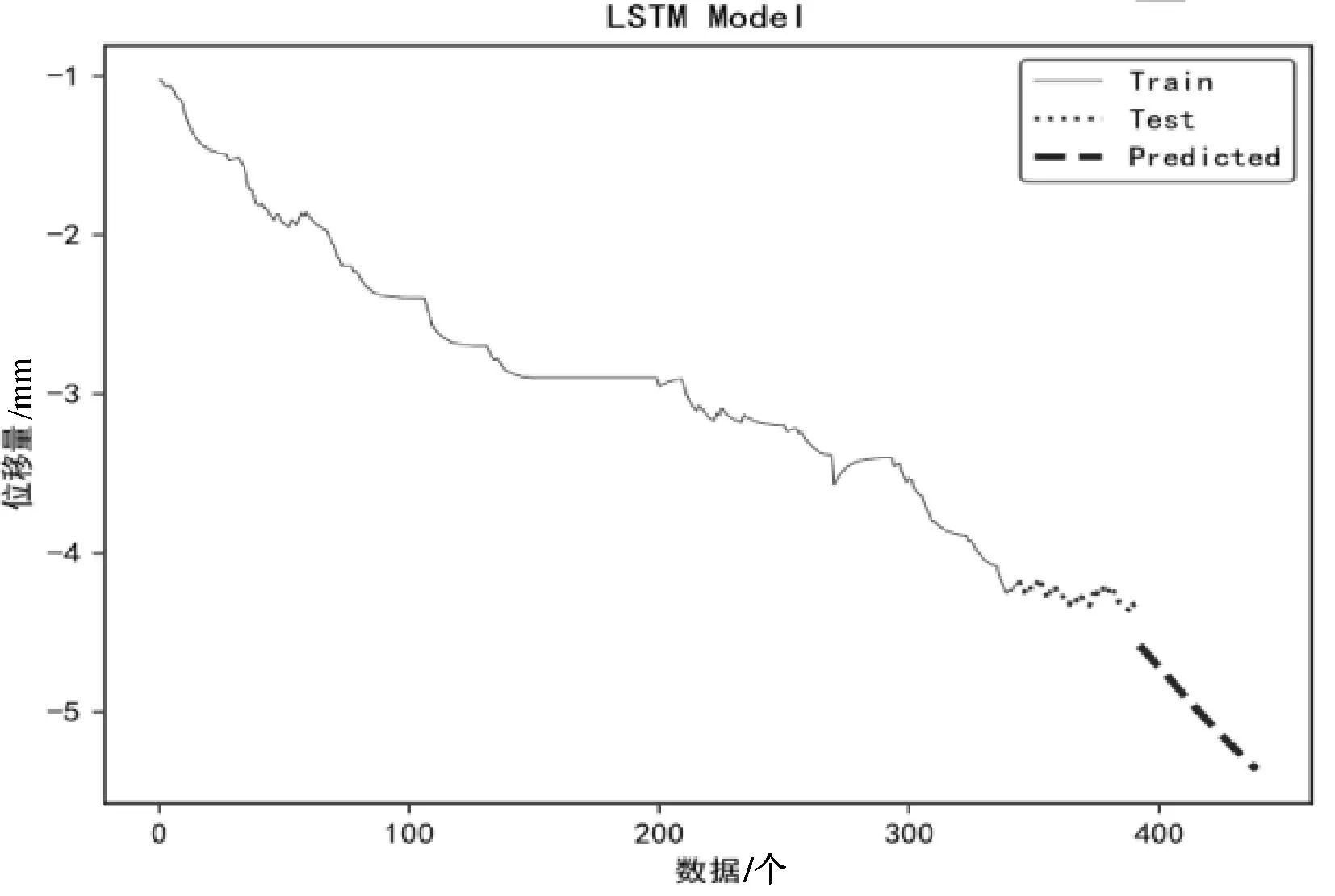

2.5 预测消融实验

经过前期数据预处理后,分别构建双层LSTM、GRU、SA-GRU,将预处理后的数据输入模型中进行训练,训练完成后对传感器未来48个数据点(4天)趋势进行预测。实验结果如图6—8所示。通过对传感器的预测消融实验对比分析可知,LSTM模型能够对过去某一段数据变化趋势进行预测,但对于整体的变化趋势预测效果不佳,如图6所示。GRU模型与LSTM模型对于未来趋势预测效果类似,能对于大致趋势进行预测,但预测值出现了较大范围的整体跃变情况,不完全符合工程中的变化规律,如图7所示。融合自注意力机制的SA-GRU预测模型在整体变化趋势上,捕捉了历史的变化规律,短期变化趋势也有较好的预测效果,对于未来趋势的预测更符合实际变化规律,如图8所示。本实验的证明,对于未来一段时刻的边坡趋势预测,SA-GRU能够较好地捕捉历史变化规律,更好地预测效果。

图6 LSTM模型预测结果

图7 GRU模型预测结果

图8 SA-GRU模型预测结果

3 结语

本文针对边坡稳定性预测的准确性和可靠性存在的误报和漏报问题,融合自注意力机制的GRU模型,解决了边坡形变监测中趋势预测值与实际变化趋势吻合度差的问题。文章对历史边坡监测数据进行预处理,构建基于GRU的循环神经网络模型;为了捕捉序列中的长期依赖关系,引入了自注意机制,以增强模型的关注能力;通过训练和优化模型,使用历史数据来学习边坡的演化规律,并预测未来边坡的状态;通过与实际观测数据的比较,评估了模型的预测性能。实验结果表明,融合自注意机制的GRU边坡预测算法在边坡预测方面具有较高的准确性和可靠性,为边坡管理和风险防控提供了重要参考依据。

虽然本文方法在边坡预测取得了一定效果,但是对于不同的边坡类型,需要确定不同的模型参数,因此,研究人员有必要探索样本更小、预测时间更长的预测方法。针对样本数量较少的数据,研究人员可以加入增强学习算法或者增加更多传感器种类数据作为预测模型训练数据,从而进一步提高整体边坡预测准确度。