一种面向水体面积智能量测的双分支神经网络

2023-08-31郑东鹏徐立军王启龙徐丽艳

郑东鹏,徐立军,王启龙,徐丽艳

(1.辽宁省水利水电勘测设计研究院有限责任公司,辽宁 沈阳 110000;2.辽宁巨维建设工程有限公司,辽宁沈阳 110000)

快速准确地测量水体面积,在水资源调查规划、预防洪涝灾害、船舶航行等应用中占有重要作用。传统方法主要通过人工调绘的方式进行水体面积测量,然而此类方法往往耗费大量的人力物力财力。随着遥感技术的发展,高分辨率遥感影像成为水体面积量测的重要数据源,该方法不直接与地面接触,可动态对水资源进行深入监测,具有成像周期短、时效性强等特点,弥补了人工野外观察的问题。

目前,随计算机技术的发展,深度学习技术凭借高精度、高适用性等特点,在遥感影像处理领域具有更高的优势,其中卷积神经网络与Transformer 结构是其两大主要分支,二者特性的相互补充可大大提升检测效能,因此本文基于高分二号卫星影像,从计算机视觉角度出发,联合卷积神经网络与Transformer 进行水体量测。

1 本文方法

为了更加精准高效地进行水体检测与测量,本文提出了一种卷积神经网络(以下简称CNN)与Transformer 联合的双边网络框架。在现有网络结构设计中,卷积神经网络由于较强的归纳偏置,被认为可提取较多的水体局部信息,但缺乏水体全局信息的编码;Transformer 方法缺乏局部信息,全局建模机制对水体的全局信息有着更好的认知,因此二者相互补充可对水体信息形成更为良好的认知。

基于上述理论,本文提出一种CNN-Transformer 联合的深度学习网络,通过结合二者特性进行水体提取,网络结构见图1。其中,卷积神经网络采用ResNet50 架构,该模型结构被认为可更好地提取局部信息。在Transformer 部分,本文选用Swin-Transformer 用于全局信息的编码。对于二者在四个阶段产生的特征,本文将特征相互融合,以此达到水体特征相互补充的目的。

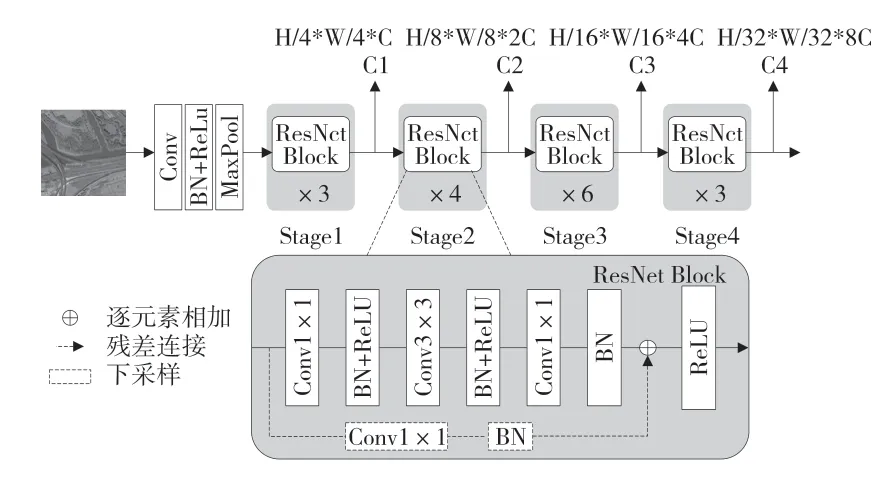

1.1 残差网络结构

残差网络(ResNet)作为卷积神经网络的重要分支,被认为具有较强的局部信息提取能力。该模型利用残差连接,连接不同的卷积层,从而将浅层的特征信息传播到深层。目前,残差网络主要有ResNet-18、ResNet-34、ResNet-50和ResNet-101 四类模型,考虑到准确性与参数量的权衡,选用ResNet50 用于水体提取,具体结构见图2。给定输入H×W×3(3 代表RGB 通道),经过卷积(Conv)、批量归一化(BN)、激活函数(ReLU)和最大池化(Max Pool)后,分辨率降低到H/4×H/4,其中通道维度变为64。然后,特征经过四个阶段生成C1、C2、C3 和C4 特征,这四个特征包含了大量的水体局部信息,适用于水体这类的多尺度对象。另外,四个特征的分辨率依次降低一半,分别为4、8、16、32,通道数依次增加到C、2C、4C、8C。在该模型中,每个阶段有3、4、6 和3 个残差模块,残差模块(ResNet Block)具体结构见图2。

图2 ResNet50 网络结构

1.2 Swin-Transformer

Transformer 由于自注意力机制与加权融合策略使其能够更好地捕获全局信息,这有助于改善水体提取结果的断裂缺陷。目前,Swin-Transformer 是一种新型视觉主干,由Patch Partition 层、Linear Embedding 层、Patch Merging 层 以及Transformer Block 层组成。其中,Patch Partition 层将输入水体影像分块降维,Linear Embedding 层用于线性变换,Patch Merging 层则起到了下采样的作用,核心模块Swin Transformer Block 采用移位窗口计算自注意力,见图3,该方法将自注意力限制在非重叠的局部窗口上,并允许特征之间的跨窗口连接,这使得该模型在降低复杂度的同时提搞了特征提取效率,注意力计算如下所示:

图3 Swin-Transformer 网络结构

式中:Q、K、V 分别为查询、键、值矩阵;d 为向量维度;B 为偏置矩阵;SoftMax 为激活函数。

通过公式(1)的特征响应,即可捕获水体的全局信息。

1.3 特征融合

特征融合目的是将图像中不同分支的特征进行合并,从而形成相比于先前特征更具有判别能力的水体特征图。在本文方法中,卷积神经网络由于编码局部特征的优势,包含更多水体的位置、边缘等细节信息。而Swin-Transformer 中则包含更多的全局信息,因此二者的相互融合可实现局部特性与全局特性的互补。本文选择逐像素相加的方式将二者进行融合,并使用双线性插值法进行上采样,以便进行接下来特征阶段间的特征融合。这一过程可公式化为式(2):

式中:Add 表示逐像素相加方法;Upsample 则表示双线性上采样插值方法;cnn′_x 表示Resnet50 输出特征;trans_x 表示Swin-Transformer 输出特征。

从公式(2)可以看出,特征融合可分为两部分,第一部分在第一阶段,此部分只有两种网络结构的第一阶段输入,在2~4 阶段则为三种输入,分别为上一阶段输入featurei-1,当前阶段的resnet50 特征与Swin-transformer 特征,以此完成特征融合。

2 实验结果与讨论

2.1 评价指标

选取精确率(Precision)、召回率(Recall)、IoU 和 F1对本文方法与对比方法进行评价,四种评价指标计算公式如下:

式中:TP 为正确提取水体像素;FP 为误提取水体像素;FN为漏提取像素数。

精确率表示所有预测为水体像素中正确分类的水体像素的百分比,体现了模型对负样本的区分能力,精确率越高,模型对负样本的区分能力越强;召回率表示所有实际水体像素中正确分类的水体像素的百分比,体现了模型对正样本的识别能力,召回率越高,模型对正样本的识别能力越强。F1值是两者的综合,F1值越高,说明模型越稳健。交并比和均交比是综合性的指标,前者表示GroundTruth 和预测图的重叠面积与联合面积的比率,后者表示所有类别的IOU 的平均值。上述四个评估指标都是逐像素计算的,计算通式(3)~式(6)是这些评估指标的定义。

2.2 训练策略

数据集。在实验数据方面,选用高分二号上海地区影像进行实验,该影像空间分辨率为0.8 m/像素。本文初次裁剪图像1050 张,每张大小为512×512 像素大小,代表实地面积为0.17 km2。使用数据增强方式增加至6300 张将其作为训练集,数据增强方法包括:亮度变化、对比度变化、色度变化、图像镜像、图像旋转以及锐度变化,以上方法已被证明可加强水体目标表达。另外,本文选用测试集为100 张,每张大小同样为为512×512 像素。数据标注采用开源软件Labelme。

本文超参数等相关设置见表1。

表1 超参数设置

实验环境。为保证实验对比的公平性,采用相同的硬件设备软件环境进行实验。计算机显卡为NVIDIA GeForce RTX 3070 Ti,处理器为12 th Gen Intel(R)Core(TM)i7-12700 KF,64 内存。基于此硬件设备,使用Python 在Pytorch 环境下进行模型编写。

2.3 对比方法选择

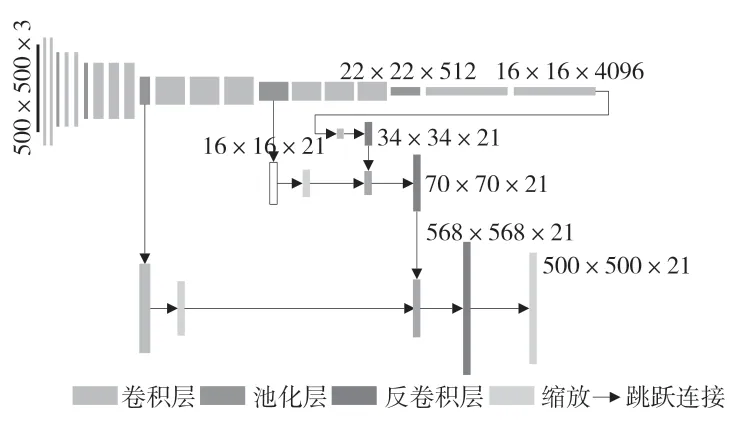

为了验证本文方法的有效性,本文选用语义分割经典网络——全卷积网络(Fully Convolutional Networks,FCN)进行对比分析。针对CNN 在像素级分割任务的局限性,Jonathan Long 等学者提出FCN 用于影像分割,FCN 可从抽象的特征中恢复单个像素的所属类别,将图像级别的分类延伸到像素级别分类,从而解决语义分割问题。首先,FCN 使用卷积层取代了经典CNN 中的全连接层。如图4 所示,FCN 将传统CNN最后三层全连接层替换为卷积层;其次,FCN 使用双线性插值使特征图恢复到输入影像相同的尺寸,保留了原始影像的空间信息;最后,FCN 提出一种“跳跃”连接结构,该结构将深层特征与浅层特征进行结合,达到了可同时兼顾局部预测和全局预测的要求。

图4 全卷积网络结构示意图

2.4 本文实验及对比

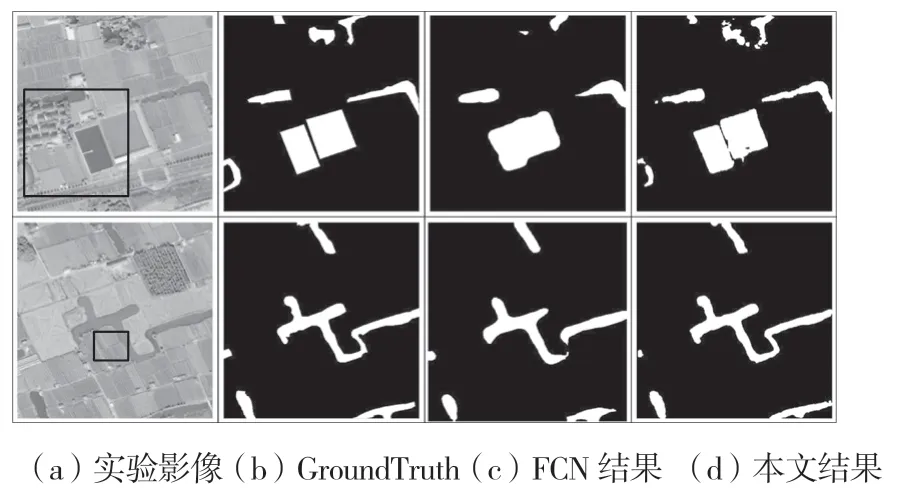

本文及对比部分实验结果见图4,图中从左到右展示结果依次为实验影像、真值(GroundTruth)、对比方法结果及本文结果(白色像素即为水体信息)。

从图中第一行红色矩形框内可以看出,该区域存在大面积人工建造水体信息,此处水体信息由两处相邻矩形水体结构组成,边缘较为规则和清晰。在计算机视觉中,物体边缘信息属局部信息,卷积神经网络的滑动窗口策略可较好地编码该图像特征。从图5 中可以看出,本文选用的ResNet50 结构与Transformer 相结合较为完整清晰地分离出相邻水体。然而对比方法粘连现象较为严重,这对水体信息的面积评价是不利的。

图5 实验结果

在图中第二行红色矩形框内展示区域可以看出,自然水体结构具有弯曲、狭窄等特点。此类水体在图像编码过程中局部信息容易丢失,造成提取结果断裂。解决断裂问题的方法之一则为全局信息的约束。该方法通过建立远距离水体像素之前的依赖关系,使得神经网络在编码水体信息过程中保证水体信息的正确性。Swin-Transformer 应用类卷积的滑动窗口策略与自注意力机制获取水体信息的全局特征,与此同时,丰富的底层信息对于狭窄水体也很重要,本文使用Resnet50 结构保证了局部信息的丰富,因此本文提取结果没有发生断裂。然而,对比方法由于没有建立远程依赖关系,在狭窄处存在断裂现象,这体现了本文方法的优越性。

为进一步对本文方法以及对比方法进行比较,定量化对比结果见表2,从评价结果中可以看出,本文各项评价指标均优于FCN 方法,Precision、Recall、F1、IoU 较对比方法分别高出13%、14%、1%、20%。其中,IoU 作为较为全面的评价指标,突出了本文方法在精度上的优势,体现了本文模型将水体局部信息与全局信息考虑在内的必要性与可靠性。总之,本文方法优势在于,一方面,本文考虑到局部信息与水体的边界、形状密不可分,使用ResNet50 结构进行局部信息的提取;另一方面,水体的全局信息对于水体提取结果的连续性也至关重要,因此本文使用Swin-Transformer 进行水体全局信息的表达。

表2 对比方法与本文方法定量对比结果

2.5 测量时间分析

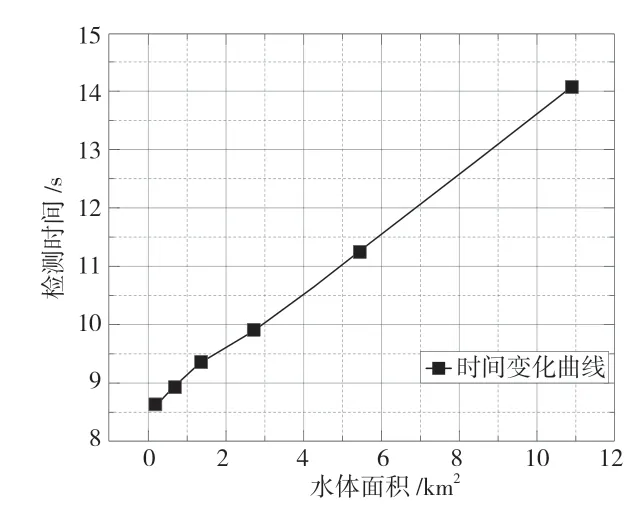

针对水体面积与检测时间进一步分析,结果见图6。从图中可以看出检测时间随水体面积增加呈线性增长趋势,遵循上述硬件配置,当水体面积为6 km2时,检测时间为11.5 s左右,水体面积为11 km2时,测量时间约为14 s。这证明本文方法可用于水体面积测量,且大大提升了工程效率。

图6 水体面积与检测时间关系折线

3 结语

本文提出了一种用于水体面积的智能测量方法,经实验对比分析论证了卷积神经网络与Transformer 网络结构的结合是提升水体测量精度与效率的关键所在,该方法可在实际工程中展开应用。