基于对抗性持续学习模型的输电线路部件缺陷分类

2022-11-29赵振兵蒋志钢聂礼强吕雪纯

赵振兵 蒋志钢 熊 静 聂礼强 吕雪纯

①(华北电力大学电子与通信工程系 保定 071003)

②(华北电力大学河北省电力物联网技术重点实验室 保定 071003)

③(复杂能源系统智能计算教育部工程研究中心 保定 071003)

④(山东大学计算机科学与技术学院 青岛 266237)

1 引言

随着我国电网系统的不断发展,中国已进入一个“特高压,大电网”时代,但输电线路故障率仍然较高,因此应及时有效地预防电网的停电事故,预测电网的安全运行状态,即对电网的安全态势进行感知[1]。态势感知起源于20世纪80年代,定义为在特定的时间和空间下,对环境中各元素或对象的察觉、理解以及对未来状态的预测[2]。对于电网而言,环境中各元素指的是电网内各电气设备以及输电线路的运行状态。电网安全态势感知技术由3个阶段组成:首先是电网中各态势要素的监测与提取,其次是态势的评估与理解,最后是对态势的发展进行预测。电网中各态势要素准确、及时、高效的监测,是电网安全态势感知的基础,也是重中之重。

对输电线路上部件进行定期巡检的过程,就是电网安全态势感知的态势要素提取环节。目前电力系统已经广泛采用直升机和无人机对输电线路拍照,再由巡检人员借助自身专业知识根据航拍图像提取输电线路态势要素的方式。但依赖人工进行态势要素提取的方式效率低、成本高且受巡检人员主观因素限制[3]。因此,对输电线路部件缺陷的自动化与智能化态势感知技术的需求越来越迫切。

目前已有的输电线路部件缺陷分类研究大多集中于防震锤、均压环、绝缘子、防鸟刺等的缺陷分类与检测。文献[4]提出了一种基于R-FCN的金具目标检测方法,在全卷积网络的基础上,使用在线困难样本挖掘、软性非极大值抑制、样本优化等方法改进,不仅提高检测精度,还使得模型可以适应多类型、多尺度的目标检测任务,不过该方法对数据集要求较高,检测精度不稳定。文献[5]针对输电线路航拍图像上各目标之间、目标与背景之间存在相互干扰的问题,利用KL散度替代Faster R-CNN模型中原有的Smooth L1损失函数;并且考虑到不同金具目标具有不同形状特征,将形状特征作为约束加入到损失函数中,提高了模型的检测精度。文献[6]通过构建符合因果关系学习的输入特征集,进行金具缺陷特征与标签之间的因果关系学习,构建符合金具特点的因果逻辑回归模型,完成金具缺陷分类,但该方法只针对单类金具缺陷进行分类,具有一定的局限性。文献[7]使用SCNet替换原始Faster R-CNN模型上的特征提取网络,并提出了PinFPN网络,以增强模型的底层语义信息和位置信息提取能力,但同时造成了参数量和运算量的增加,提高了对设备的要求。文献[8]提出运用经过多尺度训练的YOLOv3目标检测网络框选并截取出经过锐化处理的电力巡检图像中的防鸟刺区域,再处理截取出的防鸟刺区域,实现防鸟刺故障检测,不过该方法处理过程较为繁杂,计算量显著上升。文献[9]利用角度旋转参数和更换损失函数实现了绝缘子的精确定位,但该算法仍然存在对于密集小目标会出现漏检、检测精度低的问题。

虽然上述模型在输电线路某些部件缺陷分类上取得了不错的效果,但都是在有限数据集条件下的研究,而忽略了现实中无限数据流条件下模型欠缺持续学习能力的问题。持续学习研究的是从无限增长的数据流中,逐步扩展已经获得的知识,并将其用于未来学习的任务[10]。目前电网在役金具超过1900种,同种部件存在多种型号且型号间外观也存在差异[11],而现今的模型大多只采集部分金具数据集同时训练,训练完成后,模型只能对学习过的金具进行分类。当需要增加新的待分类任务时,如果直接使用新的待分类数据集对原模型进行训练,会导致模型对旧任务的分类准确率断崖式下降,出现灾难性遗忘的问题[12],而将新旧数据集混合重新训练模型会导致时间成本巨幅增加,因此亟需针对深度学习模型的可持续学习能力进行研究。

本文的工作主要包含:

(1)针对目前输电线路部件缺陷分类模型无法解决现实情况中无限数据流的问题,本文提出一种基于对抗性持续学习的输电线路部件及其缺陷分类方法,缓解了灾难性遗忘的问题。

(2)为解决待分类任务类间差异过小导致分类准确率低的问题,通过在可持续学习模型中融入注意力机制,融入注意力机制后的可持续学习分类网络较加入之前平均准确率从92.58%提升到94.01%。

(3)L3损失函数的加入使得模型的准确率提升了2.25%。

(4)可持续学习任务具有排序不可知性。本文提出了分别基于数据集数量、离散度以及难易度影响进行排序的方法,并设计多组对照实验,实现了持续学习分类模型在已获取输电线路部件缺陷分类数据集上的最优利用。

2 输电线路部件及缺陷分类模型

现阶段的持续学习主要通过3种方式来实现。第1种是基于正则化的方法,通过限制模型参数偏离先前的解太远来防止遗忘,但是同时会限制模型适应新任务的能力,导致模型很难,甚至无法找到最优解[12–14]。第2种是基于数据集重放的方法,通过保存以前任务的数据进行多次重放来使模型记住曾经学习过的任务的特征,该方法虽然在防止灾难性遗忘方面很有效,但该方法的性能高度依赖缓冲内存区的大小和重放内容的选择,在某些情况中,保存任何数据可能都不是最佳选项[15,16]。第3种方法是基于模型结构扩增的方法,通过对每个任务设置增长模型来对抗遗忘,并且可以容易地添加额外的必要容量来容纳新任务。这种不需要保存任何数据就能实现持续学习的能力给扩增方法提供了在大规模数据环境设置中成功的可能性。但是随着任务量的增加,如何将模型参数量的增长保持在可接受范围是需要解决的问题[17–19]。

2.1 可持续学习分类模型

本文受基于模型结构扩增的可持续学习模型方法的启发,针对需要学习的每个序列任务构建增长模型来对抗灾难性遗忘。与传统的基于模型结构扩增的方法不同,本文方法通过将模型提取特征空间分解为共享特征模块和特有知识模块来限制模型参数的增加。该方法受服务器绝对容量的限制较小并且不需要保存先前序列任务数据,因此该方法能在无限数据流的复杂现实环境中应用成功。

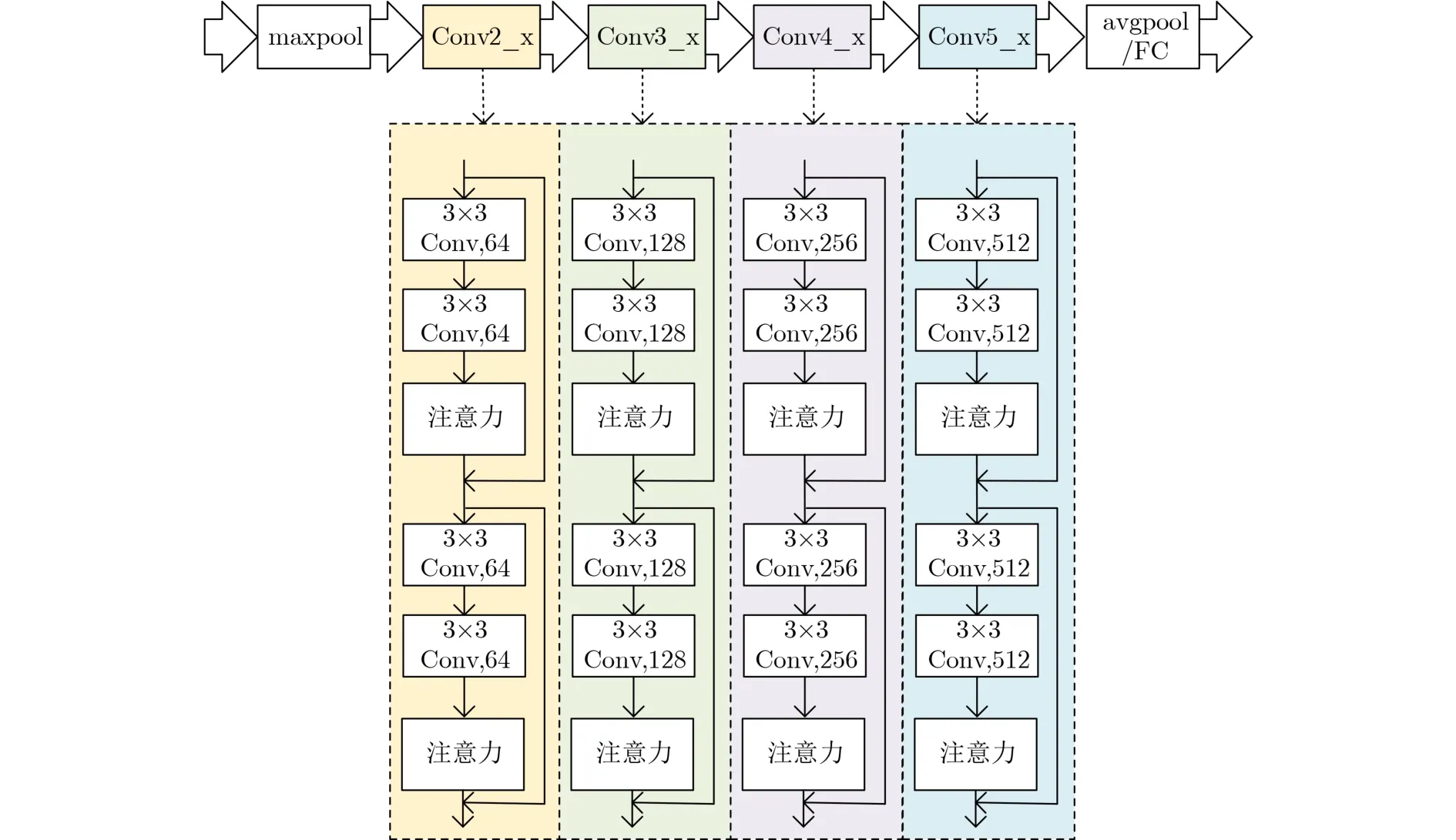

本文将深度网络学习到的特征划分成共享特征和特有特征,因此在本文的基于对抗性持续学习分类模型中,包含基于ResNet网络构建的共享特征提取模块S和特有特征提取模块P,对两种特征分别进行提取。训练时共享特征提取模块S将会采用对抗性训练的方式学习所有分类任务中(假设共有T个任务)的所有种类训练集的共有特征,而特有特征提取模块P则只是针对学习具体某序列分类任务(T个任务中的某一个)的特有特征,同时特有特征提取模块P将会随着总分类任务的增加而增加,而共享特征提取模块网络则只更新但不会增加参数。在对输入的测试集图像进行分类时则只会调用共享特征提取模块S以及相对应的特有特征提取模块P。与传统的基于模型结构扩增的可持续学习不同,由于共享特征提取模块S的设计,模型参数大幅度减少。在实现分类模型的可持续学习能力的同时,保证模型的参数量不会巨幅增长。同时,采用正交约束保证共享模块中学到的特征知识与特有模块学习到的特征知识尽可能不相同,从而提高分类准确率。模型整体结构如图1所示。

图1 基于对抗性持续学习分类模型整体结构

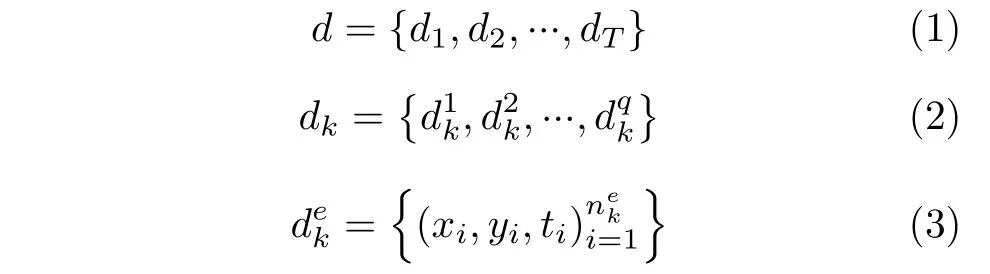

首先将金具缺陷数据集d按照不同种类金具划分为 d1, d2,···, dT,之后以各金具的具体缺陷状态为子类再次划分,例如提包线夹数据集中包括提包线夹锈蚀数据、提包线夹脏污数据等类别

式(3)中,xi为输入图像,yi为类别标签,ti为任务标签,为样本数。

在训练可持续学习分类模型时,首先学习同一任务中不同类别图像的不相似的特征,并针对每一个任务单独保存一个子模型P。对于一个包含q种类别图像的任务而言,实际上就是一个共q类的分类任务,损失函数为

其中,yei表示数据对应真实标签,是模型预测值。

接下来学习各不同任务中的相似特征,构建特征映射生成器S和对抗判别器D,并通过对抗性训练的方式对S进行训练,损失函数为

当S能够生成D不能再正确预测任务标签的图像时,生成器S的训练就完成了。其中T为总的任务数量。

为了保障共享模块中学到的特征知识与特有模块学习到的特征知识尽可能不相同,通过使用正交约束方法对两个模块的特征知识进行因式分解,计算其差异为

其中,| |F为F-范数,Pk表示第k个P模块。

最后,将3个损失函数相加则获得了可持续学习分类模型的总损失为

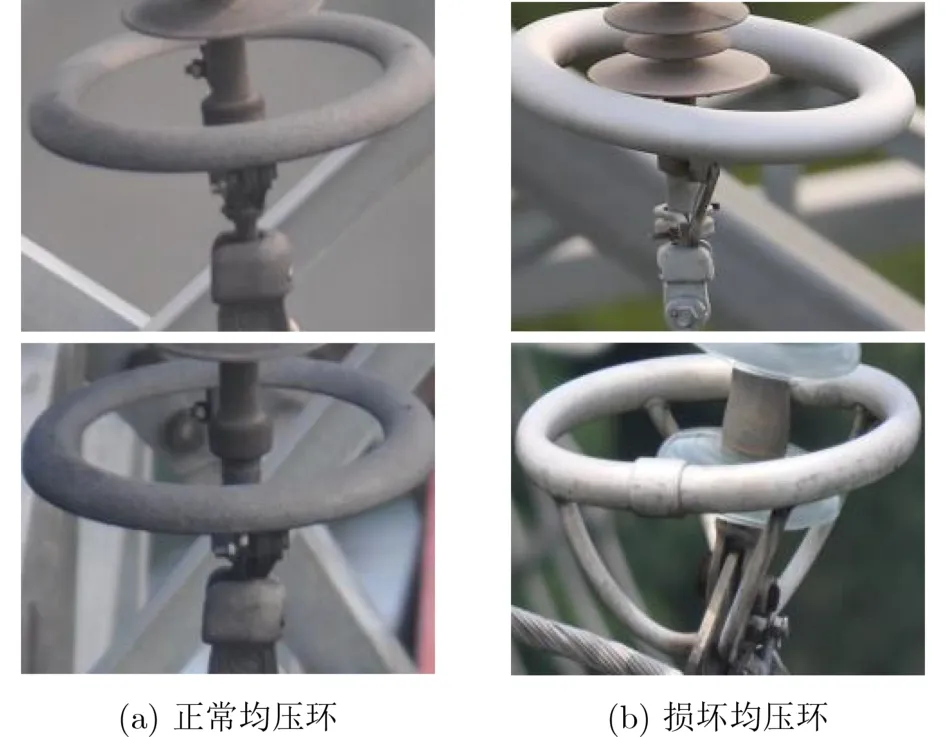

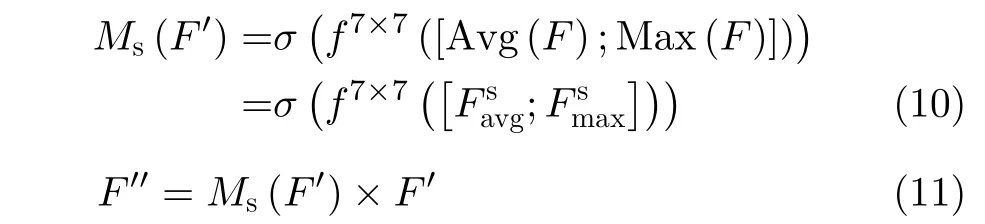

2.2 融入注意力机制

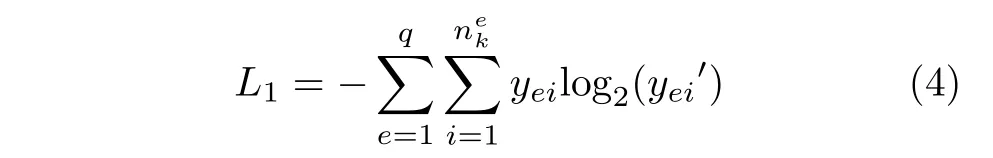

如图2所示,在输电线路部件缺陷分类任务中,正常部件和某些缺陷部件的图像极为相似,分类任务类间差异过小,导致分类准确率不高,因此有必要对模型的细微特征提取能力进行增强。针对待分类任务类间差异过小导致分类准确率低的问题,本文通过在可持续学习分类网络模型的特征提取网络融入结合通道注意力和空间注意力的注意力机制[20]来增强模型对细微特征提取能力,提高分类准确率。

图2 正常图像与缺陷图像对照

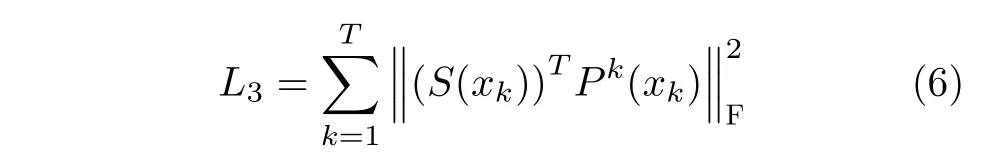

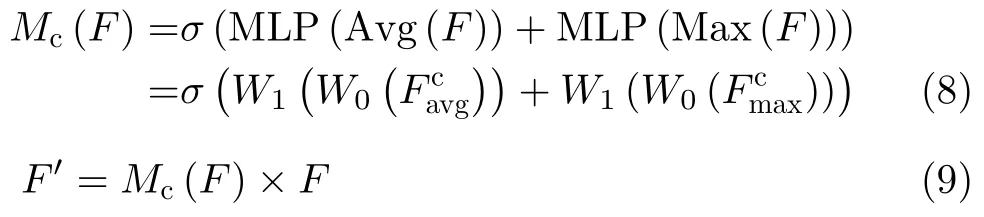

特征图的每一个通道都被视为一个专门特征检测器,因此为了获得更详细的通道特征信息,同时采用了平均池化和最大池化两种池化方式。对于输入为M×H×W的特征图F,将其压缩成为M×1×1大小的通道注意力特征图。

计算如式(8)所示

其中,σ表示sigmoid函数,MLP(MultiLayer Perceptron)表示多层感知器,Avg表示平均池化,Max表示最大池化,感知器中的W1和W0分别设置为RC×C/r, RC/r×C。和分别表示平均池化特征和最大池化特征。

之后使用空间注意力模块对特征图F'进行空间信息提取,计算式为

其中,σ表示sigmoid函数,f7×7表示7×7的卷积运算,和分别表示通道上的平均池化特征和最大池化特征,其中∈R1×H×W,∈R1×H×W,注意力机制模块如图3所示。

图3 注意力机制模块

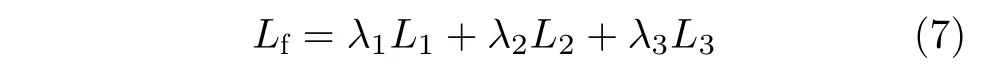

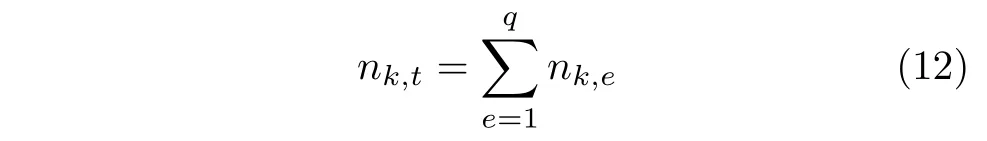

本文所采用的主干网络为ResNet网络,因此为了增强可持续学习分类模型对细微特征提取能力,本文在残差模块中融入注意力机制,改进后ResNet-18网络整体结构如图4所示。

图4 改进后ResNet-18网络整体结构

2.3 模型最优利用

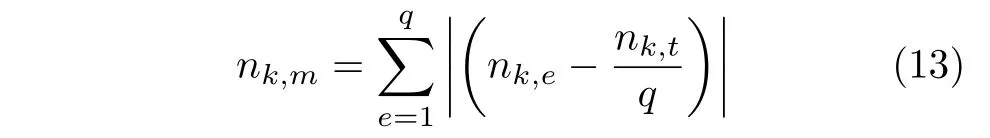

由于持续学习任务应用场景的特殊性,在训练分类模型时需要对待分类任务训练的先后顺序进行排序。因此与普通分类任务相比,基于持续学习的研究还面临着如何实现模型最优利用的问题。不同的训练任务顺序排列势必对模型的准确率造成不同程度的影响。因此很有必要研究各类输电线路金具缺陷图像分类任务的训练顺序。令所有数据集总集合为d,d中共含有T个q分类任务,则I中共含有T× q类数据集,nk,e表示第k类分类任务中第e类数据的数量。深度学习模型的核心驱动是数据,由于无法将各类数据的具体图像质量、图形特征等客观因素作为排序的依据,因此考虑将数据分布作为排序的首要因素。首先考虑每个分类任务训练集数量对模型的影响,如

其中,nk,t表示数据集I中第k类任务总数据量,根据nk,t的大小作为对任务训练顺序进行排序的依据。

对于持续学习分类任务而言,各类数据集之间离散度也将对持续学习模型准确率产生影响。如

其中,nk,m表示数据集I中第k类任务中数据的离散度,离散度大小作为对任务训练顺序进行排序的依据。

除了数据量和离散度之外,任务的难易程度也会影响模型准确率,因此本文将模型对T个分类任务分别训练时的准确率作为任务难易度的等同替换,准确率高则说明任务简单。

3 实验验证与结果分析

3.1 数据集构建与模型评价标准

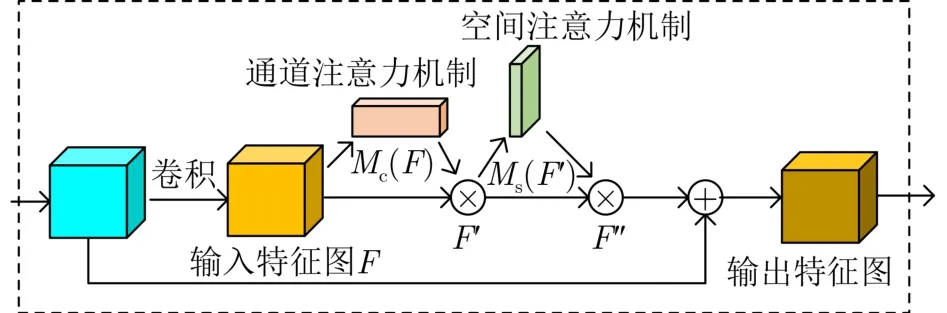

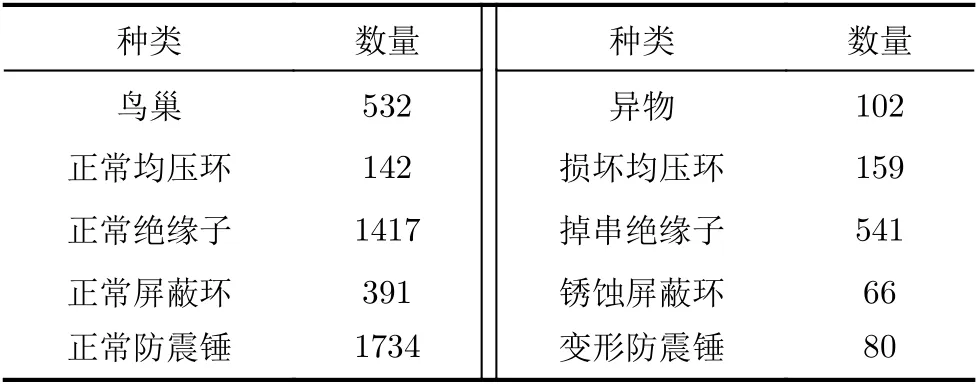

由于目前并没有公开的输电线路部件及缺陷的数据集,因此本文采集了正常均压环及均压环损坏等共计10类图像建立了输电线路部件及缺陷数据集,如图5所示。其中各类数据的数量如表1所示。

表1 数据种类及数量(张)

图5 自建数据集样例展示

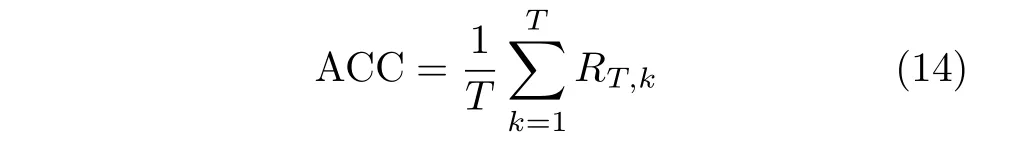

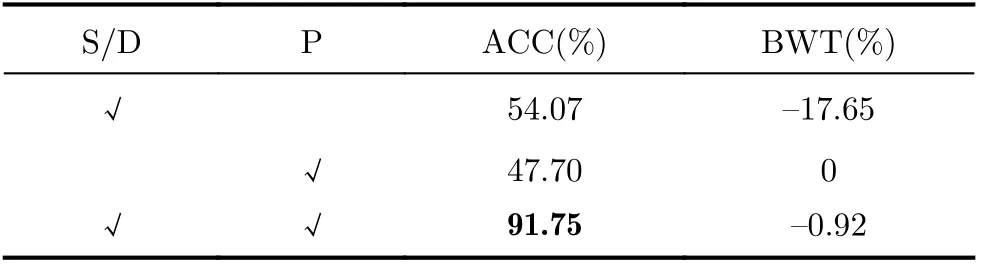

与普通分类模型不同,为了测试可持续学习分类模型的性能,在学习新的序列任务之后,需要再次对先前学习的序列任务的分类效果进行评估。本文使用平均准确度(ACCuracy, ACC)作为检验模型准确率的指标,计算式如式(14)所示。同时,为了描述模型对抗遗忘的能力,本文使用BWT(Back-Ward Transfer)来描述模型在学习新分类任务之后对先前学习任务的影响,当BWT>0时表示学习新的任务有助于提高旧任务的准确率,当BWT<0时意味着模型受到了灾难性遗忘的影响,计算如式(15)所示。除此之外,同时考虑模型占用空间大小(Parameter)和模型训练时间(Time)的影响。其中Parameter的单位为MB,时间的单位为min。其中,RT,k表示在模型依次学习第T个任务之后对任务k的分类测试准确率。

3.2 可持续学习分类模型训练

本文所用的实验环境为ubuntu 16.04操作系统,Python3.6,PyTorch 1.3.1,GPU为NVIDIA Quadro K600。

在可持续学习分类模型训练过程中,将输入的部件及其缺陷图像大小调整为32×32,本文采用随机梯度下降法进行训练,冲量设置为0.9,batch_size设置为64,训练轮数设置为200,初始学习率为0.001,权重衰减正则项设置为0.01,式(7)中的λ1,λ2,λ3分别设置为1, 0.05和0.1。

为了模拟现实中无限数据流条件,基于持续学习的模型采用了与传统分类模型不同的训练方式。以本文自建数据集举例,首先将鸟巢与异物分类数据集作为训练集,训练完成之后模型可进行鸟巢与异物分类;再将均压环缺陷分类数据集作为训练集,在原模型权重上进行训练,完成后模型可同时对鸟巢、异物、正常均压环和损坏均压环进行分类,以此类推,直到完成所有分类任务的训练。

3.3 实验结果与分析

3.3.1 可持续学习分类模型泛化能力研究

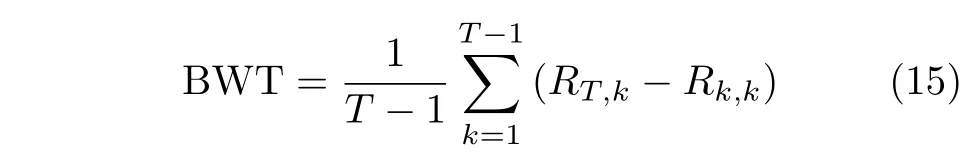

为了确定泛化能力最优的主干网络,本文选取了AlexNet, ResNet-18, ResNet-34, ResNet-50共4种网络分别作为可持续学习分类模型的主干网络进行实验。在3.1节中所提到的自建输电线路部件及其缺陷数据集上进行验证。将包含10类的分类任务划分为5个序列任务,每个序列任务包含一个二分类任务,任务学习的先后顺序为鸟巢与异物分类、均压环缺陷分类、绝缘子缺陷分类、屏蔽环缺陷分类、防震锤缺陷分类。实验结果如表2所示。

AlexNet网络结构相对简单,因此训练时间较短,模型占用空间较小,但是模型准确率仅为90.86%,低于ResNet-18网络和ResNet-34网络;而对于ResNet网络,由表2可知,随着网络的逐渐加深,模型训练的时间延长,模型参数量增多,基于ResNet-18网络的可持续学习分类模型的分类准确率、训练时间、模型大小以及BWT都显著优于基于ResNet-34网络和基于ResNet-50网络的模型。因此,本文选择ResNet-18网络作为可持续学习分类模型的主干网络。

表2 不同主干网络对照实验

3.3.2 模型各部分消融实验

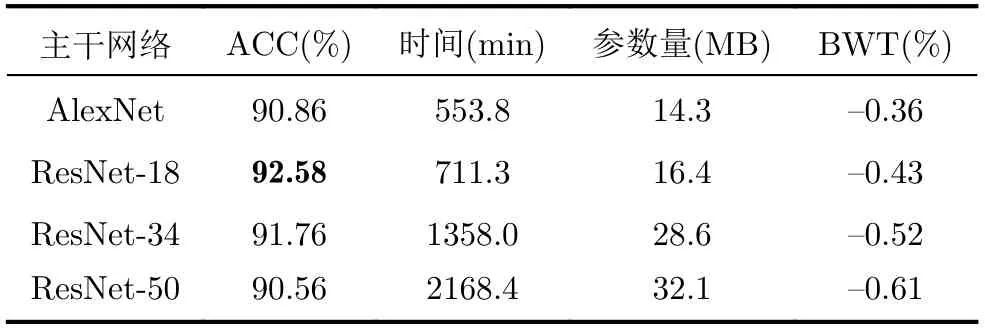

对抗性持续学习模型由多任务共享特征生成器及对抗判别器、多任务特有特征模块等部分构成。因此为了确定各部分对模型准确率的影响,进行了消融实验,实验结果如表3所示。

表3中,S表示共享特征提取模块,D表示判别器,P表示特有特征提取模块。从表3可以看出,单独的多任务共享特征生成器及对抗判别器和多任务特有特征模块的准确率都较低,当两部分同时使用时可使模型准确率和抗灾难性遗忘能力获得显著提升。

表3 模型各部分消融实验

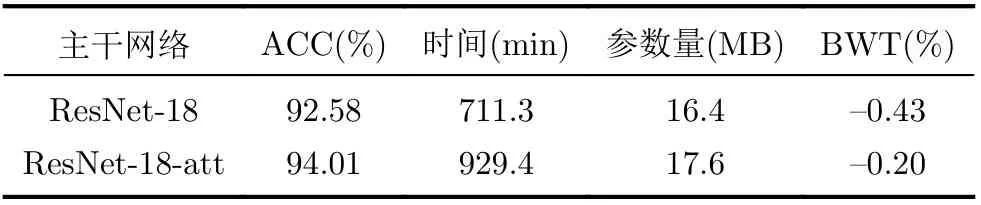

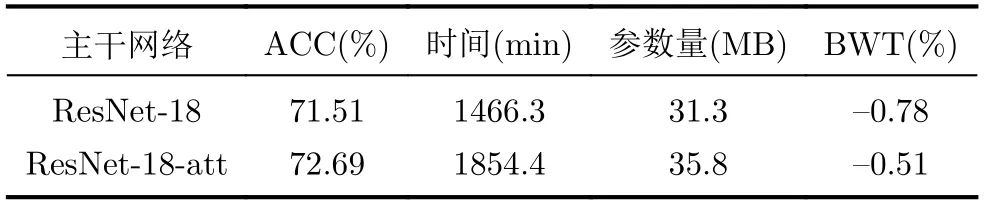

3.3.3 改进网络前后模型对比

使用本文2.2节所提出的注意力机制对ResNet-18网络进行改进之后,标记为ResNet-18-att,分别在自建数据集和CIFAR-100公共数据集上进行验证。自建数据集共5个分类任务,任务学习的先后顺序为鸟巢与异物分类、均压环缺陷分类、绝缘子缺陷分类、屏蔽环缺陷分类、防震锤缺陷分类。实验结果如表4所示。

表4 改进网络前后模型性能对比(自建数据集)

与ResNet-18网络相比,融入注意力机制后,模型在5个二分类序列任务上的平均准确率提高了1.43%;BWT值从–0.43%提升到了–0.20%,说明改进后的模型尽管仍然受到了灾难性遗忘的影响,但是具有相对更强的抗遗忘能力;不过训练时长增加了287.9 min,模型占用内存也增加了1.2 MB。

CIFAR-100公共数据集分为20个分类任务,每个任务包括5种类别物体的分类,实验结果如表5所示。

表5 改进网络前后模型性能对比(CIFAR-100)

在公共数据集上的实验结果依然证明本文提出的融入注意力机制的方法在减轻灾难性遗忘的影响和提高分类准确率上有效。

3.3.4 L3损失函数对实验结果影响

为了验证损失函数L3的有效性,本文分别使用3种主干网络构成的可持续学习分类模型进行对比实验,实验结果如表6所示。从表6可以看出,使用损失函数L3使得3种模型的分类准确率都有所提升,特别是对于改进的ResNet-18网络,ACC提高了2.25%,同时,BWT值也都有不同程度的减小,说明损失函数L3在提升模型准确率和提高模型抗遗忘能力方面都效果显著。

表6 L3损失函数消融实验

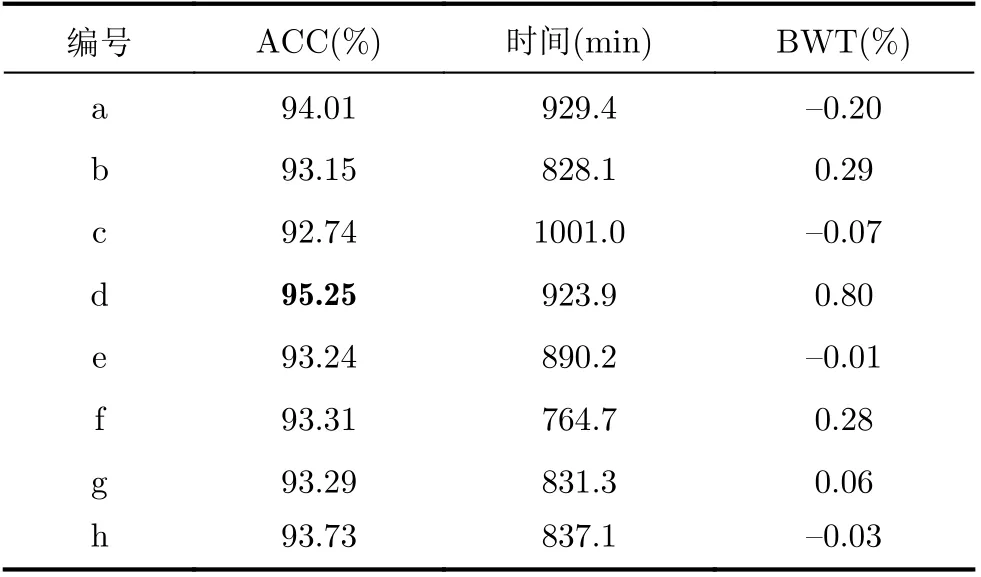

3.3.5 任务序列排序影响

在持续学习问题中,待学习的任务如何排序也将对模型准确率和抗遗忘能力产生影响,但是目前并没有针对任务排序问题的研究,持续学习表现出排序不可知性。因此本文分别以数据比例、数据量以及任务难易度为排序依据,研究了输电线路部件缺陷分类任务的排序不可知性。

本文将鸟巢与异物分类编为任务1,均压环缺陷分类编为任务2,绝缘子缺陷分类编为任务3,屏蔽环缺陷分类编为任务4,防震锤缺陷分类编为任务5。

首先对待学习任务的学习顺序进行完全随机排列两次,排序结果为1-2-3-4-5(编号a)和4-1-2-3-5(编号b)实验。

考虑数据比例的影响,以任务中数据离散度作为排序依据,由表1可知,各分类任务中数据离散度最小的是任务2(均压环缺陷分类,比例为142:159),依次类推,最后确定训练排序为2-3-1-4-5(编号c),再将倒序5-4-1-3-2(编号d)作为训练顺序实验。

接着以任务总数据规模大小作为排序依据。由表1可知,任务3总数据量最多,任务2总数据量最少,分别按2-4-1-5-3(编号e)和3-5-1-4-2(编号f)的训练顺序实验。

在实验a—实验f中,本文分别将5个任务作为第1序列任务进行训练,即在学习该分类任务时模型处于原始状态。可持续学习分类模型对5个任务的准确率依次为89.38%,90.85%,95.54%,92.65%,98.70%。分类准确率高即说明该分类任务较为简单。因此,按照任务难易程度进行排序,分别为5-3-4-2-1(编号g)和1-2-4-3-5(编h)。

实验完成后,统计每组实验中各任务准确率,结果如表7所示。

从表7可以看出,学习任务的排序对某些任务准确率影响很大。以任务(2)为例,在实验a、实验b、实验c、实验d、实验g中,其分别出现在5个不同的排序位置上,准确率相差较大。实验b中任务(2)训练排序为3,准确率为89.93%;实验d中训练排序为5。准确率为97.81%,准确率相差高达7.88%。也有一些任务受到排序影响不大,如任务(1)、任务(3)和任务(5)。任务(2)(均压环分类)和任务(4)(屏蔽环分类)分类准确率受任务排序影响较为明显的主要原因是图像背景较为复杂,鉴于其呈环状的特殊形态特征,图像数据中往往还包含着其他金具的某些部分,因此这两类任务在不同排序中准确率差异较大,而任务(1)、任务(3)、任务(5)的数据集中则不存在该问题,因此差异较小。同时,任务(2)和任务(4)的数据量较为稀缺也是造成该情况的原因之一。

表7 8组对照实验准确率结果

随着学习的任务的增多,已学习任务的准确率也会变化,如图6所示。

从图6可以看出,在本文的可持续学习模型中灾难性遗忘的问题得到了显著改善。甚至在某些任务排序条件下,学习新任务使得模型对旧任务分类准确率略有提高,这是由本文的可持续学习分类模型的特殊结构决定的。在某些特定任务排序中,曾被用于训练的数据集中与待训练的数据集中的部分共享特征相似,因此在学习新任务训练特征映射生成器S时,起到了加强分类效果的作用,导致学习新任务使得模型对旧任务分类准确率有所提高。

图6 已学习任务准确率变化图

8组实验所有实验结果如表8所示。

表8 8组实验结果

在实验d中,可持续学习模型达到最高的准确率,为95.25%,实验c中,可持续学习模型达到最低的准确率,为92.74%,说明基于本实验数据集的可持续学习任务中以数据离散度作为排序依据对模型准确率影响最大。而其他排序方式对模型影响相对较小,但是依然存在影响。总的来说,持续学习任务排序具有不可知性。

受限于采集数据集的困难,本实验无法在改变数据比例变量的同时控制数据量总数不变,但是本实验证明改变待学习任务的顺序会对可持续学习模型产生不同的影响。对于自建的输电线路部件缺陷分类数据集和可持续学习模型,更改训练时任务的先后顺序,模型的准确率相差高达2.51%。而BWT值从–0.20%提高到0.80%,意味着任务的排序会影响模型的抗遗忘能力,减少灾难性遗忘的影响,甚至学习新的任务有助于提高旧任务的准确率。

4 结束语

针对目前输电线路部件缺陷分类模型无法解决现实情况中无限数据流的问题,本文设计了一种基于对抗性持续学习的输电线路部件及其缺陷分类方法。首先将持续学习技术引入到输电线路部件缺陷分类任务中,使得分类模型在保证分类准确率的同时,可以从无限增长的数据流中不断学习新的分类任务。为解决待分类任务类间差异过小导致分类准确率低的问题,通过在可持续学习模型中融入注意力机制,以增强模型对细微特征提取能力从而提高分类准确率。针对持续学习任务中的排序不可知性问题,提出基于数据集的数量、离散度以及难易度进行排序的方法,设计多组对照实验,以实现持续学习分类模型的最优利用。最后,设计进行了实验验证,并对模型的各种性能进行分析与比较。结果表明本文提出的方法实现了输电线路部件及其缺陷分类任务的可持续学习,缓解了灾难性遗忘的问题;融入注意力机制和使用L3损失函数使分类准确率分别提高了1.43%和2.25%;并且实现了持续学习分类模型的最优利用。

尽管如此,受限于输电线路上部件种类过多和数据难以采集的问题,并且目前尚没有一个明确、统一的对任务难易度量化的标准,基于持续学习的输电线路部件缺陷分类任务排序具有不可知性。不可否认的是,该模型的另一个限制是无法解决已训练过的任务数据集变化的问题。因此,这也是本文后续将要进行的研究。