基于无人机的三维消防辅助救援系统构建

2022-03-12李鹏

李 鹏

(内蒙古乌海市消防救援支队海南区消防救援大队,内蒙古 乌海 016000)

0 引言

随着城市的发展,人员向中心城区集聚,将建设的高大居住建筑和商业建筑解决了居民的居住和交易问题,但也给消防安全带来巨大的挑战[1]。一方面这些建筑物中人员密集,火灾发生后导致的救援难度增大,另一方面火灾引发的财产损失和人口伤亡给人的身心健康带来伤害[2]。火灾监测和预防是降低火灾灾害程度的有效方法,无人机倾斜摄影技术具有灵活性强、适合复杂环境高空监测的优点,同时可以融合建筑三维信息技术和地理信息系统技术,为消防辅助救援提供性的解决方案,同时也赋予了无人机倾斜摄影的测量、侦察、监测和信息化的新应用内涵。该研究基于无人机倾斜摄影技术的三维消防辅助救援系统为无人机在消防领域中的推广应用提供了十分重要的理论基础。

1 基于无人机倾斜摄影的倾角数学模型的推导

为了获取不同影像角度、影像覆盖范围和影像分辨率的图像,无人机倾斜摄影在采集影像图片时,需要将航摄仪设置一定的镜头倾斜角和巡航高度,如徕卡RCD30 航摄仪,其巡航时镜头倾斜角为35°[3]。无人机倾斜摄影仪镜头的角度变化对构建三维实景图像模型产生一定的影响,表现为摄影成果图像特征提取、模型纹理清晰度和模型匹配精度等[4]。在三维消防实景图像模型构建中,需要利用无人机倾斜摄影获得的2 种影像数据,分别是下视影像和倾斜影像。前者主要是获得地形地物的表面影像信息,其分辨率为传统意义上的分辨率,而后者主要获得地形地物的侧面影像数据,其分辨率为倾斜水平分辨率和倾斜垂直分辨率[5-6]。

为了使影像数据与实际模型更好地匹配,在无人机倾斜摄影中应保证一定程度的影像重叠,提高影像分辨率,同时影像的最大分辨率和最小分辨率的比值应小于2.0。无人机倾斜摄影的下视分辨率可以按公式(1)进行计算。

式中:GSD为无人机倾斜摄影的下视分辨率;H为无人机相机镜头巡航高度;f为相机镜头的焦距;a为相机镜头视场角的一半。

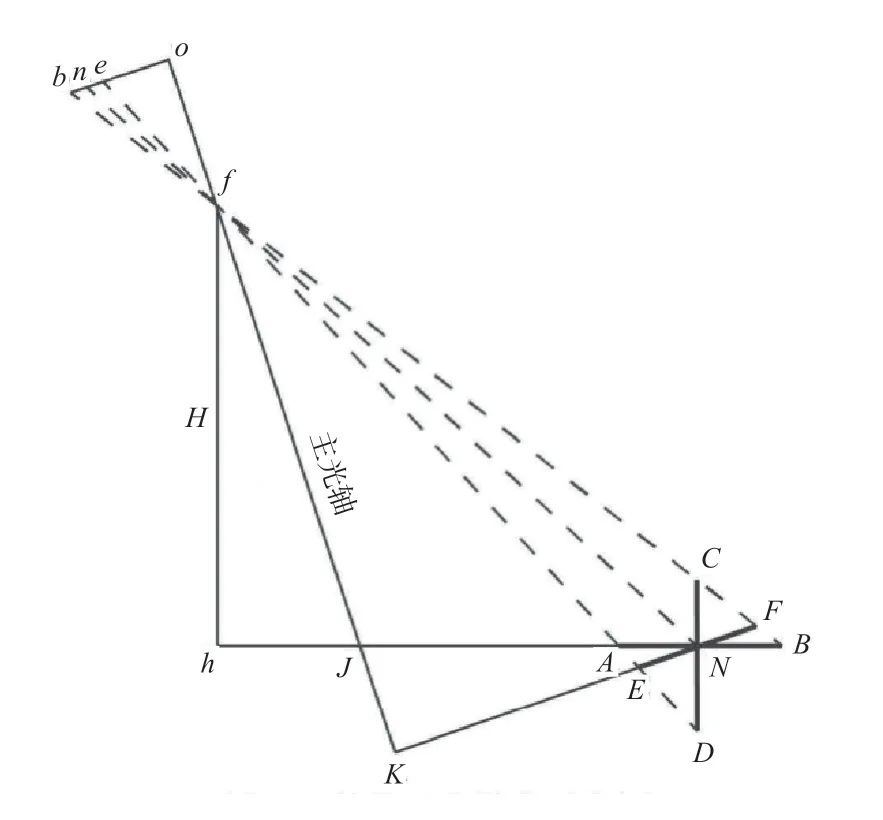

倾斜影像分辨率的求解数学模型如图1 所示,图中of为相机的主光轴,be为像元,EF为像物,K为相机主光轴和像物EF延长线的角点,航摄仪倾角为θ。根据三角函数关系以及中心投影原理,可以推导得到无人机倾斜摄影的倾斜水平分辨率AB,如公式(2)、公式(3)所示[7]。

图1 无人机倾斜摄影倾斜水平分辨率和倾斜垂直分辨率的计算原理

同样地,可对无人机倾斜摄影的倾斜垂直分辨率进行计算,结果如公式(4)、公式(5)所示。

2 基于无人机倾斜摄影的三维消防实景模型构建

在构建三维消防实景模型前,需要获取消防建筑物的航空影像数据。该研究以乌海市海南区某独栋大楼作为试验模型,采用无人机倾斜摄影设备进行数据采集,建筑物高度为8 层,高度约23 m,建筑物周边较为空旷,适宜作为试验场区,建筑结构相对复杂,对无人机倾斜摄影三维消防建模试验具有一定的适宜性[8]。无人机倾斜摄影设备为大疆DJI-Phantom-4Pro 无人机,搭载多个相机镜头摄影仪对建筑物进行多角度的拍摄,相机类型为DJIFC6319,相机传感器为Sony Exmor R2 英寸 CMOS,焦距为8.5348mm,像素元为5472×3648pixel,像幅尺寸/CCD 尺寸为12.8333×8.5556 mm,像元大小为2.34527 um,航向视场角为±26.2234°,摄影范围为120m×90m。

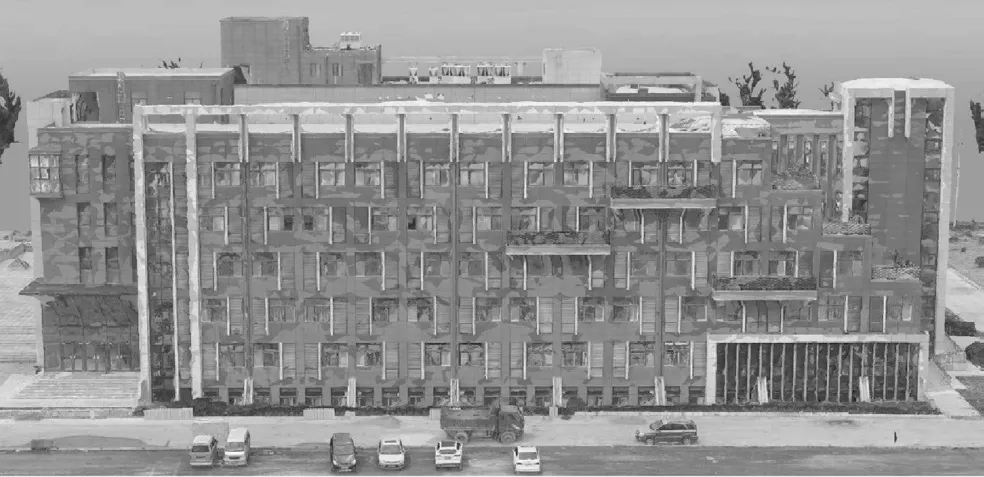

在拍摄的过程中,沿着建筑物周边共布置6 个像控点,像控点坐标通过RTK 进行采集,无人机设备设定纵横向5个巡航入选进行拍摄,巡航高度为55 m,沿着建筑物垂直面外扩进行拍摄,外扩的距离为30m,平均面航向重叠度为82%,拍摄高度分为3 个等级,分别为距离地面6 m、距离地面12 m、距离地面18 m 和距离地面55 m,共获取无人机倾斜摄影影像1090 张,其中东西方向185 张,南北方向268 张,西东方向160 张,北南方向262 张,下视拍摄215张。采集图像通过Smart3D 和PhotoScan 软件进行三维消防建筑实景建模。通过PhotoScan 软件强大的空三能力,对无人机倾斜摄影原始图像进行空三加密,并导入Smart3D 软件中进行自动化三维建模,利用密集点云数据构建TIN 三角网、生成建筑物的纹理和3D 虚拟模型,并通过软件自带的S3CComposer 工具编辑索引,完成建筑实景与三维模型的相互融合,结果如图2 所示。

图2 基于无人机倾斜摄影的三维点云模型与实景融合构建

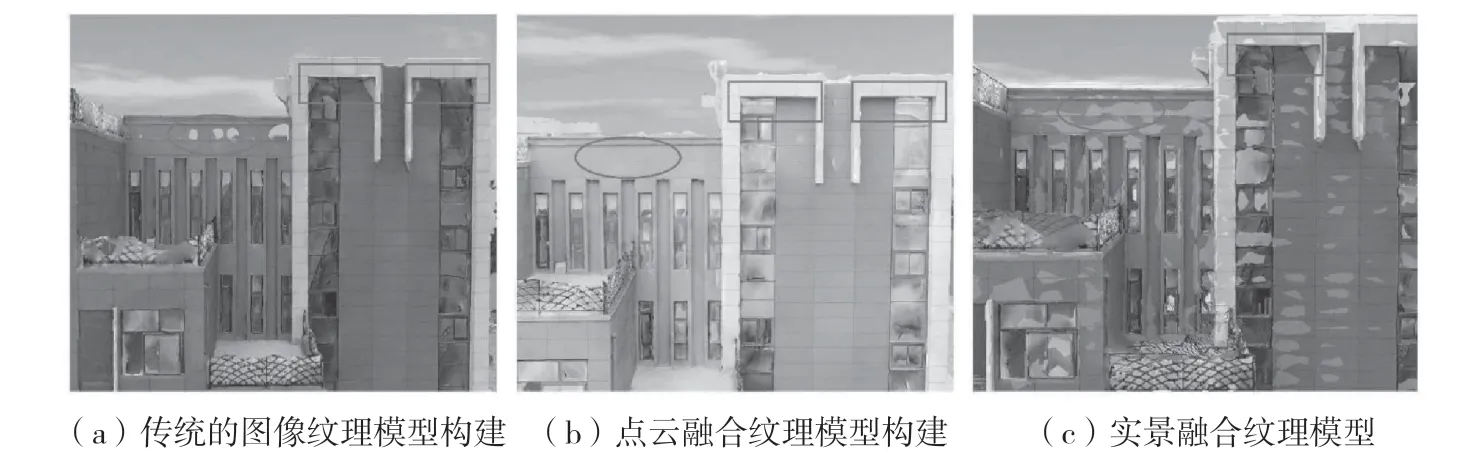

为了验证构建的三维实景模型的精细化程度,对建模过程中的纹理映射进行研究,分别采用传统的图像纹理模型构建、点云融合纹理模型构建以及实景融合纹理模型构建3 种方法,得到的三维实景模型如图3 所示。从图3(a)中可以看出,采用传统的图像纹理模型构建,图中椭圆形中存在明显的纹理数据空洞,而在模型房檐遮挡部位,则存在数据细节模糊现象,这是因为传统的图像纹理模型在较薄结构实体和有遮挡物存在的区域,密集匹配的点云较少,运算时容易存在纹理映射缺失,TIN 网格结构稀疏,导致空洞出现;从图3(b)中可以看出,与传统的图像纹理模型构建相比,点云融纹理模型构建使空洞现象和细节拉花现象得到显著改善,如图中椭圆形和矩形位置,模型中的细部纹理也更清晰,这是因为采用点云融合数据时,统一的空三加密点云数据能够得到有效加密,对点云稀疏位置可以得到纹理映射;从图3(c)中可以看出,基于实景融合的纹理模型构建,椭圆形中的数据空洞现象得到明显改善,但是仍没有解决在模型房檐遮挡部位的细节模糊问题,这是因为实景融合同样具有较好的点云数据加密功能,对近地影响TIN 网格结构能够与纹理建立较为完整的映射函数。

图3 不同融合方法得到的三维建筑实景模型纹理

3 融合多传感器信息的无人机三维消防辅助救援系统应用效果

在无人机倾斜摄影技术建立的三维实景建筑模型的基础上,采用无人机飞行平台搭载多种传感器提取火灾因子,以建立建筑物火灾信息和消防救援辅助系统,搭载的传感器主要有二氧化碳传感器、一氧化碳传感器、烟雾传感器、温度传感器等[9]。由于实际尺寸的建筑物中进行火灾测试,具有危险性大、测试成本高的缺点,该文基于建立的三维实景建筑模型的基础上,通过交互式PACT 设计系统进而FDS 计算程序,研究火灾中消防辅助救援无人机测试的烟雾浓度和温度的效果。温度测试结果见表1。从表1 中可以看出,搭载温度传感器的无人机能够较为可靠地测试到建筑物发生火灾时温度的变化,在停留的180 s 中,距离墙体5 m 的温度呈现剧烈变化,温度最大值达到57.8 ℃,而距离墙体10m时,温度变化程度相对较小,温度最大值为35.4 ℃。

表1 不同墙面距离处的温度测试结果

烟雾浓度测试结果见表2。从表2 中可以看出,搭载烟雾浓度传感器的无人机能够较为可靠地测试到建筑物发生火灾时烟雾浓度的变化,在停留的180 s 中,距离墙体5 m 的烟雾浓度呈现剧烈变化,烟雾浓度最大值达到967.84×10-4%,而距离墙体10 m 时,温度变化程度相对较缓,烟雾浓度最大值达到695.25×10-4%。

表2 不同墙面距离处的烟雾浓度测试结果

4 结论

该文以乌海市海南区某独栋大楼为研究对象,通过数学理论分析、现场数据采集以及仿真分析的方法,研究三维建筑消防实景模型的建立方法、模型精细化程度,得到以下3个结论:1)基于无人机倾斜摄影的倾角数学模型推导的倾斜水平分辨率和倾斜垂直分辨率、下视影像分辨率,为三维消防实景模型的建立提供了分辨率计算基础。2)与传统的图像纹理模型和实景融合纹理模型相比,点云融合纹理模型的精细化程度更高,模型中的空洞现象和细节拉花现象得到显著改善。3)搭载烟雾浓度传感器和温度传感器的无人机能够较为可靠地测试到建筑物发生火灾时烟雾浓度的变化,融合多传感器信息的三维消防实景模型可为消防救援提供可靠的温度和烟雾浓度等参数。