一种基于攻击距离的对抗样本攻击组筛选方法

2022-03-08刘洪毅方宇彤文伟平

刘洪毅,方宇彤,文伟平

(北京大学 软件与微电子学院,北京 102600)

随着深度学习算法及计算设备的快速发展,深度学习由于其优秀的效果与性能被广泛应用于各个领域,如语音识别、图像识别、人脸识别、自动驾驶等。在计算机视觉领域,随着 2012 年Krizhevsky等[1]设计AlexNet赢得了ImageNet LSVRC-2012比赛的冠军,奠定了卷积神经网络在深度学习应用中的地位。在之后的发展中,学者们先 后 提 出 了 GoogLeNet[2]、VGG[3]、ResNet[4]、DenseNet[5]等深层网络模型,使得基于深度学习的图像识别技术成为了图像识别领域的主流,并使得识别精准度在ImageNet上达到了95%以上。在带来便利的同时,深度学习本身也存在着一定的安全问题,这引起了安全领域的极大关注。例如,Szegedy等[6]很快发现了深层神经网络在图像识别领域的一个有趣的弱点,即深度神经网络容易被对抗样本欺骗。这种攻击的表现形式是对图像添加一个微小的扰动,并且这些扰动对于人类视觉来讲,是几乎不可察觉的,但会使得分类器分类错误。

随着研究的深入,学者们将攻击方法进行了分类。根据攻击者掌握的知识,对抗攻击可分为白盒攻击和黑盒攻击。其中,白盒攻击是指攻击者完全了解模型的架构和参数。白盒模型在实际的威胁模型中并不常见,更为广泛的应用场景是黑盒模型。因此,更关注黑盒环境下的对抗样本生成技术。黑盒攻击指攻击者无法获取模型全部信息,只能通过对模型的使用来观察输入输出并展开攻击。

黑盒攻击方法主要有2种,基于可转移性的对抗样本生成方法(transfer-based adversarial example generation,TAEG)和基于查询的对抗样本生成方法(query-based adversarial example generation,QAEG)。可转移性是对抗样本的一种性质,即针对某分类器模型生成的对抗样本也可能欺骗其他分类器模型。TAEG方法主要利用对抗样本的可转移性,针对一个替代模型进行白盒攻击,如基于梯度的对抗样本生成方法,包括FGSM[7]、IFGSM[8]、PGD[9]、MI-FGSM[10]、CW[11]、JSMA[12]、DeepFool[13]等,并使用产生的对抗样本攻击目标模 型,如Substitute Model[14]、DI-2-FGSM[15]、Ensemble Attack[16]。基于可转移性的对抗攻击可以仅查询目标模型一次就完成攻击,但其攻击成功率较低,若非目标模型和替代模型十分相似,即便是目前鲁棒性最好的方法,攻击成功率也难以令人满意[15]。而QAEG方法已经被实践[17-18]证明可以应用在现实模型上。QAEG仅需要对目标模型进行一定的查询,根据查询结果不断优化对抗样本,即可实现黑盒攻击,并且成功率一般都较高。

目前流行的QAEG方法都是基于攻击组的,如NES Attack[17]、CMA Attack[18-19]、Boundary Attack[20]等。这些方法引入原始样本与目标样本(称这一对样本为一个攻击组)共同参与攻击,当对抗样本生成任务陷入局部最优解时,为对抗样本进化提供了基本的方向,即向着原始样本靠近,可以在一定程度上缓解由于估算梯度不准确而导致的对抗样本陷入局部最优的情况。但是,由于引入了攻击组来指导攻击,针对一个对抗样本生成任务,如何合理地选择对抗攻击组将成为一个挑战。由于对抗攻击的目的仅是使得目标模型错误分类。但在现有的研究中,由于引入了攻击组的指导,相当于加入了一个限制条件,当生成任务到达局部最优解时,只能向着原始样本靠近。但原始样本与目标样本可能并不容易实现攻击,最终导致攻击失败,或者所需查询次数过多,如CMA Attack实现攻击的平均查询次数为60 000次,但最坏的情况可能达到200 000次[18]。

为了解决以上挑战,本文以图像识别领域为例,设计了一种基于决策边界长度的攻击距离度量方法,探测原始图片到目标分类决策边界的垂直距离,并计算需要进化的决策边界长度,以度量两图片的攻击距离,并为该攻击组的攻击难易程度提供参考。同时,设计了基于攻击距离的对抗样本攻击组筛选方法,利用图片间的攻击距离,选取较为容易完成攻击的攻击组,再展开对抗样本生成任务。通过实验验证,筛选后的攻击组对于多个攻击方法有效,总体攻击效果提升42.07%,攻击效率提升24.99%,方差降低76.23%。

1 相关工作

1.1 深度学习

深度学习[21]是机器学习领域的一个新的研究方向,其目前正以前所未有的规模被用于破解各种复杂的科学难题。例如,深度神经网络(deep neural networks,DNN)在图像识别、重建脑回路[22]、DNA突变分析[23]等各种任务上都取得了显著的成功。DNN也成为语音识别[24]、自然语言 理 解[25]、无 人 机[26]、机 器 人[27]和 人 脸 识 别ATM[28]中许多具有挑战性任务的首选解决方案。显然,深度学习解决方案,尤其是源自计算机视觉问题的解决方案,将在日常生活中发挥重要作用。

1.2 对抗样本

对于深度学习分类器来说,对抗样本是一种特殊的样本,其与原始样本的差别不大,但却可以使得分类器分类错误。对抗样本生成的基本思想是:对于原始图片x,设计一个尽量小的扰动δ,能够使得分类器C分类错误,如式(1)所示,上述场景被称为非目标攻击,即只要使得分类器分类错误即可。

同时,还有一种更强的攻击场景,要求对抗样本使得分类器分类为指定标签t,如下:

其中扰动大小的度量公式常使用P范式,如式(3)所示。本文中使用L2距离度量扰动的大小,即2范式、欧氏距离,其中N为像素点的个数。为了能够在连续的空间上搜索对抗样本,将像素值从[0,255]压缩到[0,1]。同时,给出攻击成功的判定,一般为平均像素差值小于0.05且使分类器分类错误,对应到大小为(299,299,3)的图片上,L2距离约为25。

白盒对抗攻击最常用的就算是基于梯度的对抗样本生成方法,通过计算损失函数对输入图片的梯度,再通过梯度下降的方式降低损失值以达成目的。其中损失函数设计原理为损失值越小,对抗样本的效果越好,如扰动的L2距离加上目标分类置信度的负值。Szegedy等[6]首先设计了让神经网络做出误分类的最小扰动的方程,转而寻找最小的损失函数添加项,将对抗样本生成问题转化成了最优化问题。Goodfellow等[7]使用Linf距离设定扰动的上限,将原始分类的交叉熵作为目标函数,最大化目标函数以实现非目标攻击。Kurakin[8]和Makelov[9]等引入了迭代的思想,将扰动上限分成n份逐步完成攻击。Carlini和Wagner[11]将错误分类的约束条件统一至目标函数中,将对抗样本生成问题转化为优化问题,并设计了强有力的攻击方法。Papernot等[12]提出使用梯度显著图的方式,每轮迭代仅选择效果最优的2个像素点进行修改,尽量降低扰动大小的同时完成了攻击。

1.3 黑盒对抗攻击

黑盒对抗攻击现有2种常用的方法,即TAEG和QAEG。

可转移性是对抗样本的一个很重要的性质。可转移性是指针对某一个模型产生的对抗样本,也可以欺骗其他模型[29]。对抗样本存在可转移性的主要原因是:同类型分类任务学到的分类区域可能大致相同,这导致对于一个模型有效的对抗样本可能对另一模型也有效。Papernot等[14]通过一定量的查询来构造与目标模型相似的替代模型,再使用白盒方法攻击这个替代模型以产生能够攻击目标黑盒模型的对抗样本。Dong等[10]将动量引入对抗样本生成过程,使得梯度更新的方向更加稳定,提高了攻击鲁棒性,同时提高了对抗样本的可转移性。Xie等[15]将输入变换引入到对抗样本生成过程,提高了对抗样本的可转移性。Tramer等[16]提出了联合多个模型进行生成及防御对抗样本,大幅提高了对抗样本的可转移性。Huang等[30]提出了针对模型的中间层而非logit层或输出层进行攻击,可以一定程度上提高对抗样本的可转移性。

尽管有众多学者对对抗样本的可转移性进行了研究,但是TAEG的黑盒成功率依然很低[15],难以适应实际的需求。因此,QAEG受到了越来越多的关注。QAEG是通过查询目标模型,来估算模型对于输入的自然梯度,并辅以原始样本与目标图样本,逐步地进化对抗样本。在目标攻击场景下,QAEG最常用基于攻击组的对抗攻击方法,即从目标图片出发,保持对抗样本的分类为目标分类,持续地降低对抗样本到原始图片的距离。Ilyas等[17]提出使用自然进化策略(natural evolutionary strategies,NES[31])来估算目标模型输出对对抗样本分布期望的梯度,并通过进化整个分布来进化对抗样本。Kuang等[18]提出使用协方差矩阵自适应进化策略(covariance matrix adaptation evolutionary strategies,CMA-ES[32])来拟合并进化对抗样本的分布,提升查询模型的效率,以降低完成攻击所需的查询次数。Brendel等[20]提出通过拒绝采样来拟合决策边界,不断地进化对抗样本,削弱了攻击算法对于模型自然梯度的依赖性,并实现了仅利用模型输出的top1标签完成攻击。Dong等[19]降低了搜索维度,并利用(1+1)-CMAES来拟合决策边界分布,快速地进化对抗样本以实现攻击。

2 方法论

2.1 威胁模型

目前,攻击组的引入主要是为了解决黑盒模型下,目标攻击估算的自然梯度不精确的问题。因此,本文主要研究黑盒模型下目标攻击的攻击组筛选方法,同时要求该黑盒模型可以被查询多次。

现有目标性对抗攻击主要有如下4种应用场景:

1)场景1。原始分类固定,目标分类固定,但原始图片与目标图片均不固定。这是限定最弱的攻击场景,也是最常见的攻击场景,仅实现目标性攻击即可。实现人类识别结果和机器识别结果不同,如仅使目标分类系统出现错误。

2)场景2。原始图像固定,目标分类固定,但目标图像不固定。这是另一种常用的攻击场景,给定原始图像,使得对抗样本与原始图像相差不大,但被分类器分类为目标分类,如自动驾驶欺骗。

3)场景3。原始分类固定,目标图片固定,但原始图片不固定。这也是一种常见的攻击场景,如绕过人脸身份验证系统。

4)场景4。原始图像固定,目标图像固定。这是最严格的攻击场景,但并不常见。

在前3种应用场景中,都存在很多符合要求的攻击组。本文主要研究如何在前3种场景中,筛选出较为容易的攻击组,从而提高现有黑盒攻击的效率及攻击的稳定性。

2.2 基于攻击距离的攻击组筛选

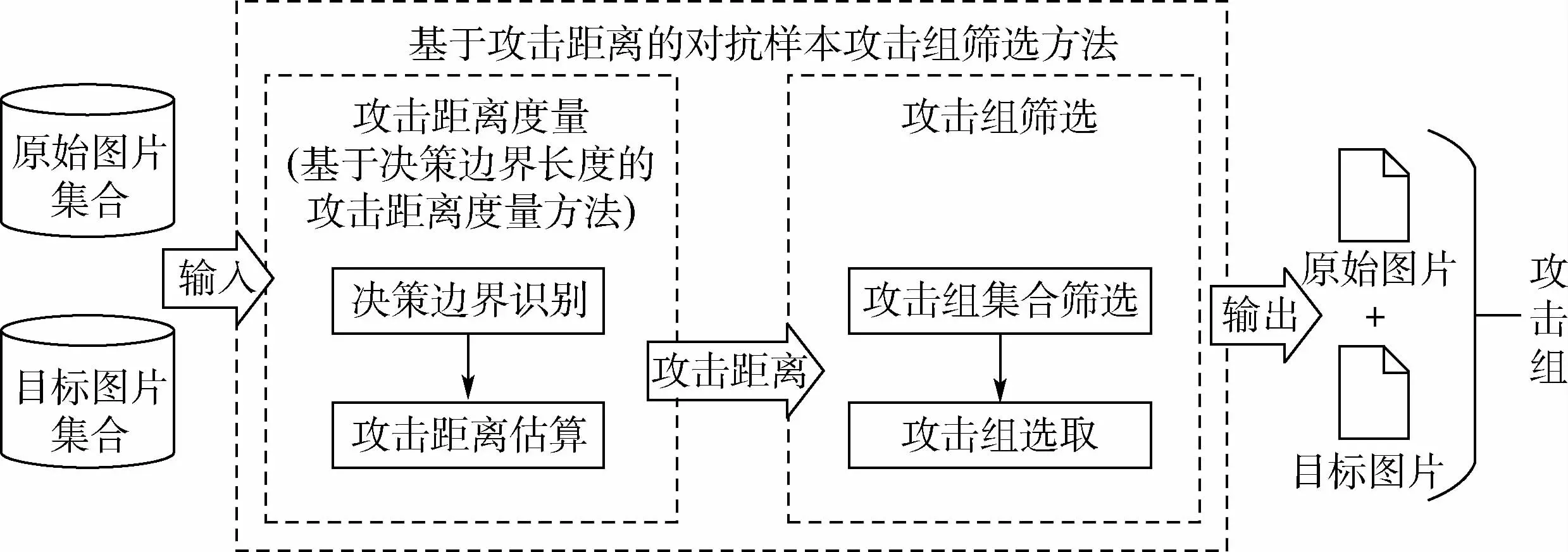

现有的QAEG虽然普遍使用了攻击组来指导攻击,但未注意到由于攻击组难度差异导致的攻击效果不稳定问题。因此,目前也没有估算攻击组攻击难度的方法。为了解决以上问题,本文提出了基于决策边界长度的攻击距离度量方法,讨论了如何利用估算的攻击距离筛选对抗样本攻击组,通过预先筛选现有对抗样本生成方法的输入来大幅提升其攻击效率。基于攻击距离的对抗样本攻击组筛选方法的框架如图1所示。

图1 基于攻击距离的对抗样本攻击组筛选方法框架Fig.1 Framework of adversarial example attack pairs filtering method based on attack distance

2.2.1 攻击距离度量

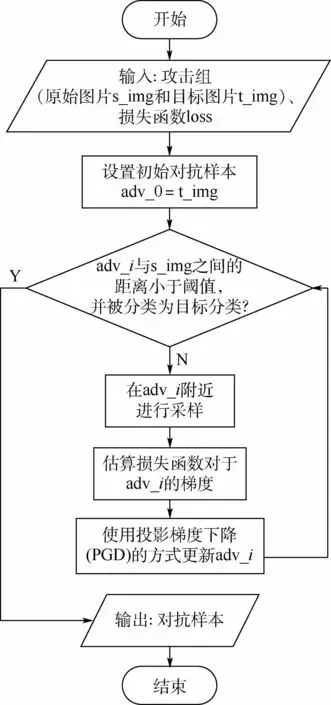

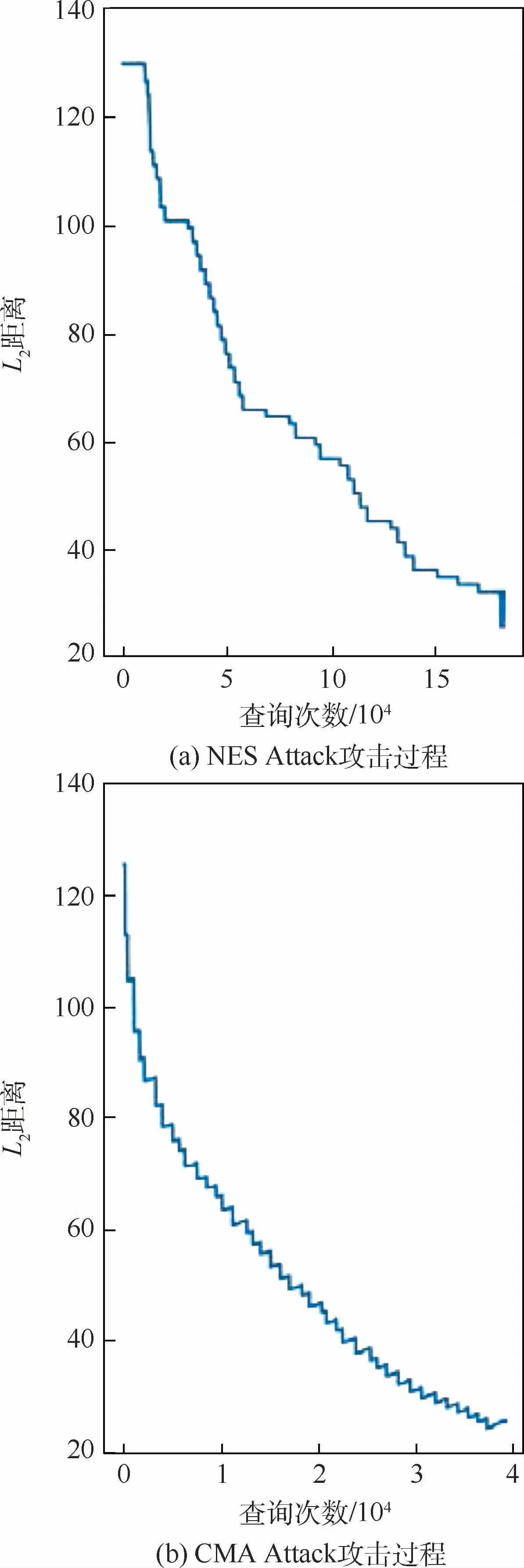

以NES Attack为例,其对抗样本生成的流程如图2所示,攻击速度如图3(a)所示。图2中:s_img为原始图片,t_img为目标图片,adv_i为对抗样本的第i轮迭代结果。迭代的主要内容就是通过查询目标模型,估算目标函数对输入的梯度,并通过梯度下降的方式更新对抗样本。同时,在攻击速度图中可以明显看到,对抗样本的L2距离会先快速下降,再逐渐平缓。CMA Attack的攻击速度也是类似的,如图3(b)所示。这其中的原因是:基于查询的攻击都会先快速找到决策边界,这个过程一般很快,再通过迭代稳步地更新对抗样本,这个过程一般很慢。而重要的是:第2个过程可以用线性拟合,以提前估算对抗样本生成所需要的查询次数。即查询次数和扰动的大小成反比,如果能够提前估算第2个阶段完成的攻击距离,就可以提前估算完成攻击所需的查询次数,从而估算攻击组的攻击难度。

图2 NES Attack对抗样本生成流程Fig.2 Flowchart of NESAttack adversarial examples generation

图3展示了NES Attack[17]与CMA Attack[18]在ImageNet上攻击InceptionV3的攻击速度。2个方法针对同一攻击组展开攻击,并展现出相似的攻击速度曲线。

图3 攻击速度Fig.3 Attack speed

基于查询的攻击过程有上述特性主要是由于对抗样本的特性。对抗样本是一种既要被分类为错误分类,又要与原始图片相差不大的样本。这就要求对抗样本一般都处于目标分类与原始分类的分类边界附近。因此,对抗样本迭代生成的过程就是对抗样本游走于决策边界,并一步步向原始图片靠近的过程,包括基于梯度的白盒攻击与基于查询的黑盒攻击。估算一个攻击组完成攻击所需要的查询次数,主要需要解决2个问题:①如何确定对抗样本已经抵达决策边界附近;②如何估算攻击距离。

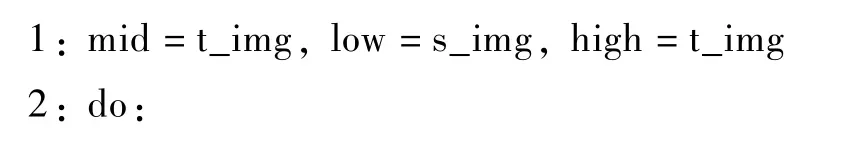

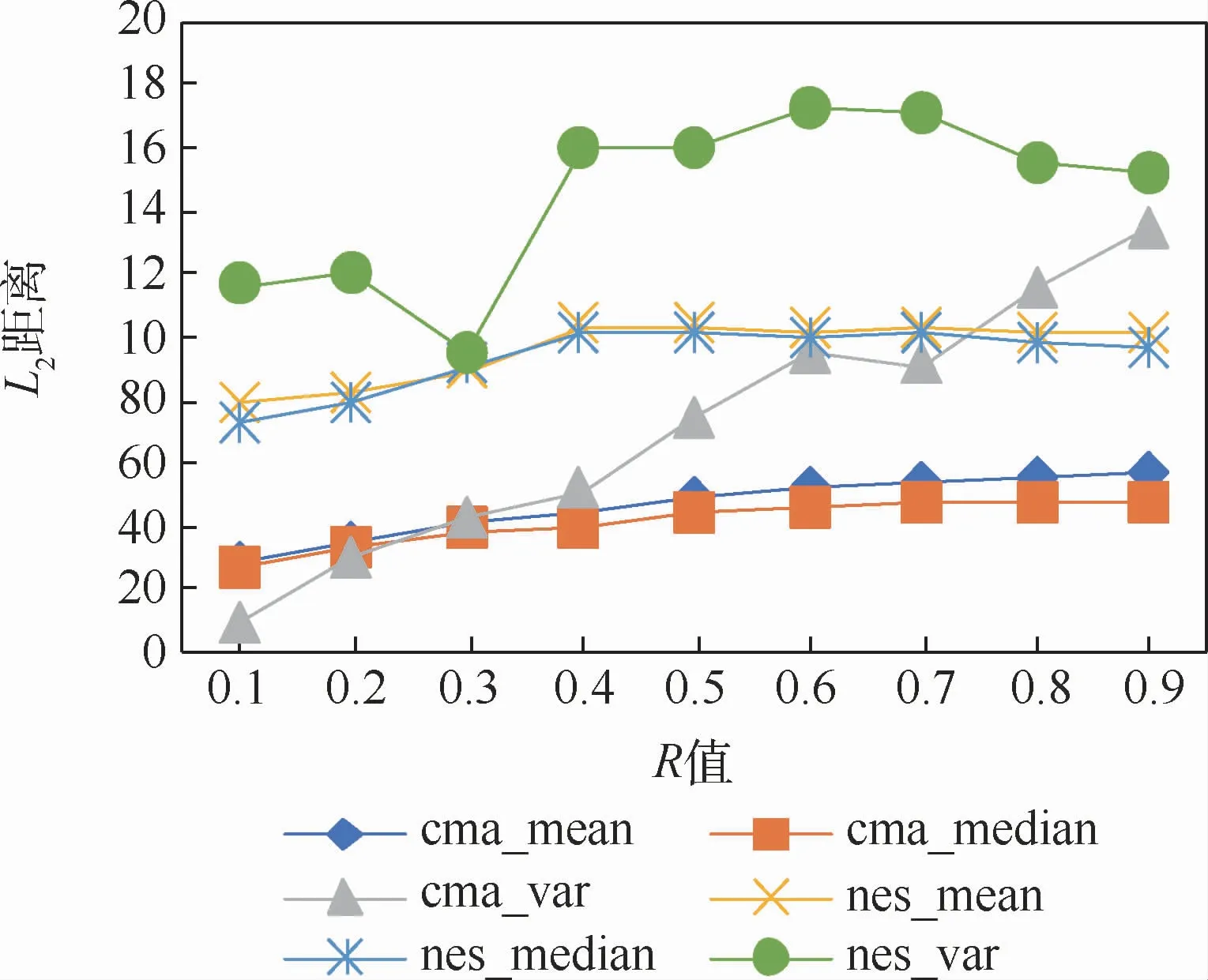

为了解决第1个问题,设计了基于采样的决策边界识别方法,其效果示意图如图4所示。将原始图片与目标图片设为2个端点,并在2端点所在连线上进行二分查找,以快速定位决策边界位置。查找规则如下:如果大部分采样均为目标分类,则将中间图片向原始图片靠近;如果大部分采样均为原始分类,则将中间图片向目标图片靠近;直到在中间图片附近的采样有40% ~60%的概率为目标分类。图4(a)展示了中间图片附近采样分类为目标分类的概率小于40%的情况,中间图片将向目标图片靠近,即图4(b)展现的情况。

图4 基于采样的决策边界识别方法示意图Fig.4 Schematic diagram of decision boundary recognition method based on sampling

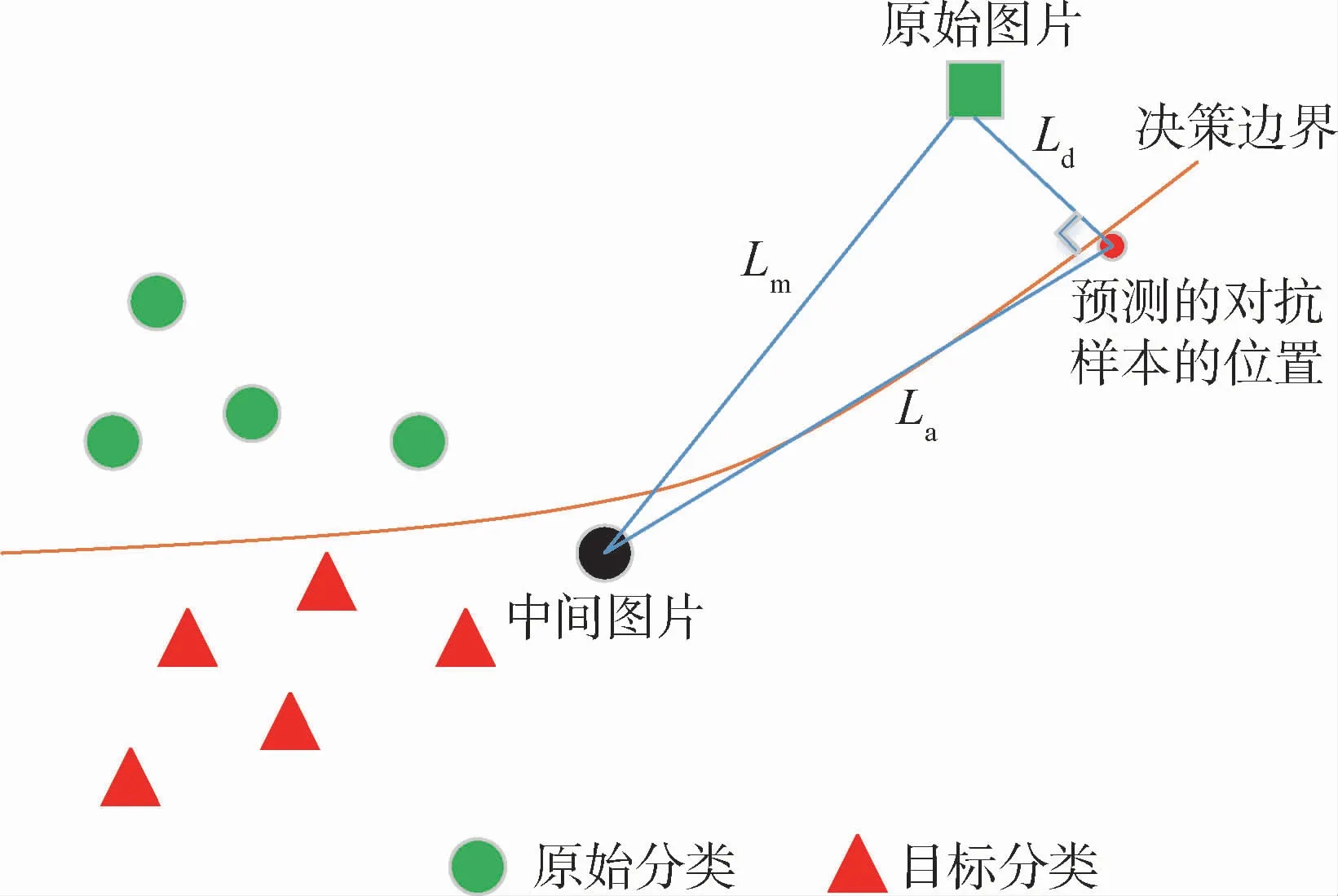

为了解决第2个问题,设计了基于毕达哥拉斯定理的攻击距离估算方法,其效果示意图如图5所示。设中间图片到原始图片的距离为Lm,最终对抗样本到原始图片的距离为Ld,从中间图片进化到对抗样本需要完成的攻击距离为La。由于对抗样本进化的过程实际是在决策边界附近游走的过程,原始图片到最终对抗样本的距离可以看作是原始图片到决策边界的距离。又因为点到面垂线距离最短,所以最先找到符合Ld距离要求的对抗样本应该处于原始图片到决策边界的垂线附近。同时,对抗样本游走的攻击路径在决策边界附近,因此可以看做Ld近似垂直于La。因此由毕达哥拉斯定理得,L2a=L2m-L2d。整个基于决策边界长度的攻击距离度量方法如算法1所示。

图5 攻击距离估算示意图Fig.5 Schematic diagram of attack distance estimation

算法1 基于决策边界长度的攻击距离度量方法。

输入:原始图片s_img、目标图片t_img、目标模型C()、期望的对抗样本的扰动大小Ld。

输出:攻击距离La。

2.2.2 攻击组筛选

估算出攻击组之间的攻击距离之后,就可以在现有攻击方法之前做一个预处理阶段,进行攻击组的筛选,以提高现有算法的攻击效果。

需要注意的是,攻击距离的估算结果并非十分精确,能大致反映完成攻击所需要的查询次数,但也会存在一些偏差。因此,不能直接利用估算的攻击距离选出最容易攻击的攻击组,但可以利用估算的攻击距离筛选出较容易攻击的攻击组。具体来说,从攻击组集合S中筛选出较容易攻击的攻击组集合E,再从E中随机选取一组作为建议展开攻击的攻击组Pair。三者之间的关系如下:

其中,将集合E与集合S的比例定为超参数,即过滤因子R。关于R值对于算法的影响,将在第3节进行详细的讨论。筛选时会先利用算法1估算S中各个攻击组的攻击距离,并将攻击组按照攻击距离升序排序。之后筛选前η=ρR个攻击组来组成E,ρ为S中攻击组的个数,η为集合E中攻击组的个数。最终在E中随机选取一组作为Pair。基于攻击距离的对抗样本攻击组筛选方法如算法2所示。

算法2 基于攻击距离的对抗样本攻击组筛选方法。

输入:原始图片集合s_imgs、目标图片集合t_imgs、过滤因子R。

输出:合适的攻击组Pair。

3 实验与评估

本节将讨论攻击组筛选对不同的攻击方法在不同应用场景下的有效性,同时讨论超参数R对于算法的影响。

本文主要对比的攻击方法包括NES Attack[17]和CMA Attack[18],目标模型为InceptionV3。对比攻击组筛选前后实现攻击所需要查询次数的平均值、中位数及方差,从而验证攻击组筛选的有效性。

实验设定如下:选取ImageNette数据集进行验证与评估,共10个分类,场景1每种分类选取10张图片参与攻击组的构造,场景2、3每种分类选取100张图片。场景1与场景2、3实验环境设置不同是因为场景1的组合情况过多,若每种分类选取图片均为100张,场景1的攻击组个数会达到900 000=90×100×100,而场景2、3的攻击组个数仅为9 000=90×100。因此,降低场景1每种分类选取的图片为10张,以平衡3种场景的攻击组个数均为9 000=90×10×10。

具体来说,从10个分类中选择原始分类和目标分类,共有90种不重复的组合。场景1时,分类A中从10张图片选取1张作为原始图片,分类B中也从10张图片选取1张作为目标图片,共有100种攻击组合,因此场景1共有9 000种攻击组。场景2时,分类A中固定选取1张图片作为原始图片,分类B中从100张图片中选取1张作为目标图片,共有100种攻击组合,因此场景2也共有9 000种攻击组。场景3与场景2类似,分类A中从100张图片选取1张作为原始图片,分类B中固定选取1张图片作为目标图片,共100种组合,因此场景3也共有9 000种攻击组。

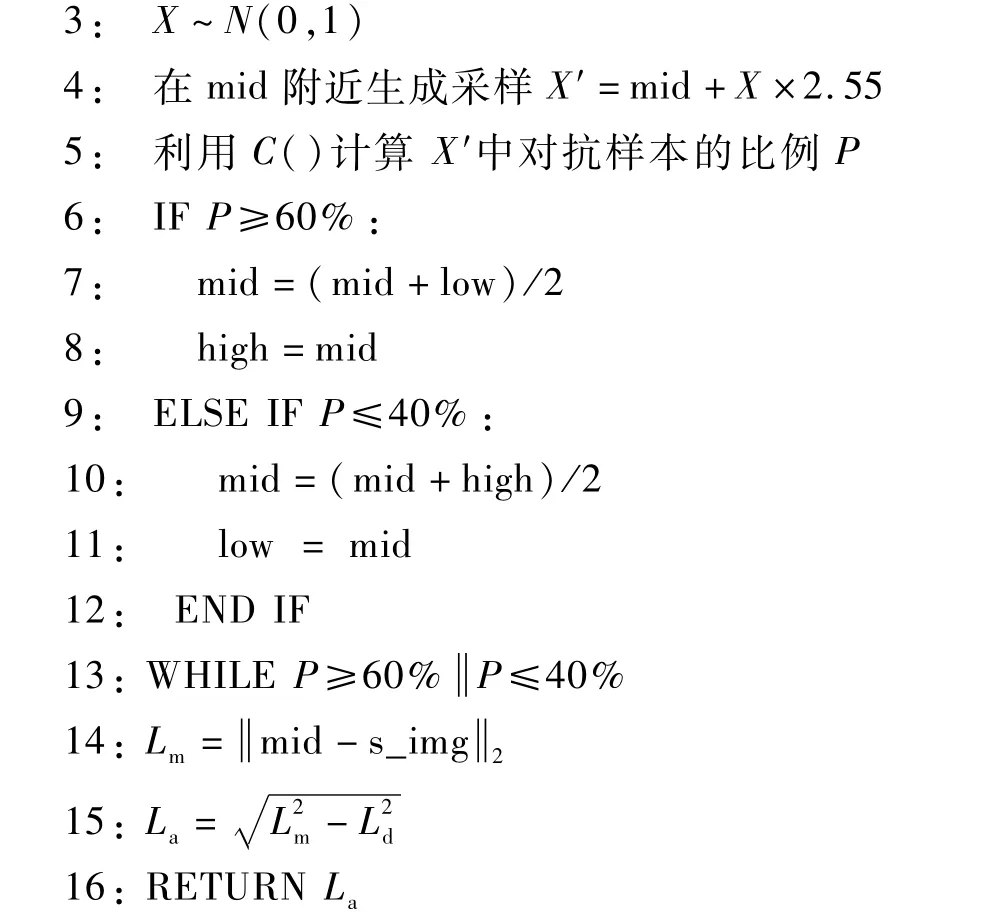

本文首先讨论不同R值在场景1下对不同攻击算法的影响,如图6所示。随着R值的降低,2种方法的平均查询次数与查询次数中位数均稳定地下降,验证了攻击组筛选对于提高查询效率的有效性。同时随着R值的降低,CMA Attack的查询次数方差稳定下降,NES Attack的查询次数方差波动下降,这验证了攻击组筛选对于稳定方差的有效性。实验结果显示,R值越小,攻击效果越好,因此推荐将R值设为0.1。本文之后的性能对比也是基于R值为0.1的基础上进行的。

图6 R值影响Fig.6 Influence diagram of R’s value

图6中:cma_mean、cma_median和cma_var分别代表CMA Attack攻击成功所需查询次数的平均值、中位数和方差;nes_mean、nes_median和nes_var分别代表NES Attack攻击成功所需要查询次数的平均值、中位数和方差;同时为了共用纵坐标轴,方差曲线显示的值为实际方差的1/10 000。

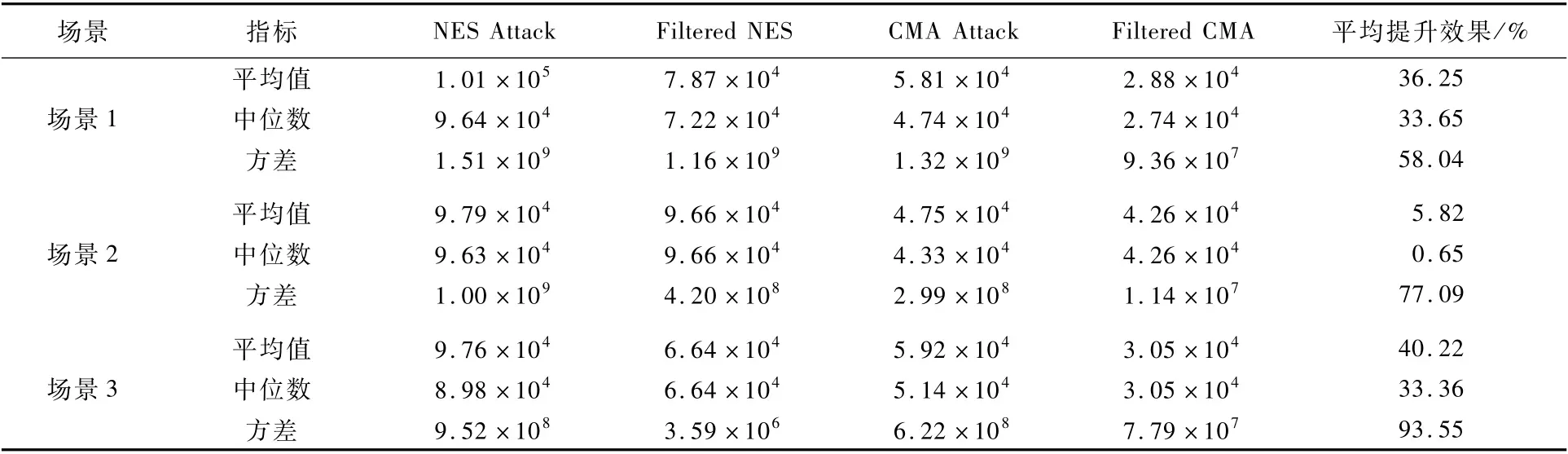

攻击组筛选前后的攻击效果对比如表1所示。表1展现了不同对抗样本生成方法在不同场景下实现攻击所需要的查询次数的平均值、中位数和方差。表1给出了所有待测的方法,包括NES Attack[17]、CMA Attack[18]、经 过 攻 击 组 筛 选的NES Attack(Filtered NES)和经过攻击组筛选的CMA Attack(Filtered CMA)。

表1中给出了攻击组筛选在每一个指标上带来的平均提升效果。总体提升效果表示攻击组筛选在不同场景下平均值、中位数和方差的综合提升,即将所有平均提升效果求平均;平均提升效率表示攻击组筛选在不同场景下的平均值、中位数的综合提升,即将不同场景下的平均值与中位数提升效果统一求平均;平均稳定方差表示攻击组筛选在不用场景下的平均稳定方差效果,即将不同场景下的方差提升效果求平均。

表1 筛选前后查询次数对比Table 1 Comparison of query times before and after filtering

场景2下筛选效果不是很明显,这可能是因为原始样本在筛选中占有更重要的地位。一旦固定原始样本的位置,那么原始样本附近的决策边界布局将确定,最终的优化难度也将基本确定。越到最后的优化过程越困难,总体的优化难度更多取决于最终过程的优化难度。这也印证了一个普遍的实验现象,即对抗攻击的速度是先快后慢。也就是说,如果在分类A中选定了原始图片,与分类B中的众多目标图片形成的攻击组具有相似的攻击距离。

无论是哪种场景下,攻击组筛选后的攻击效果都是优于筛选前的攻击效果。筛选后攻击效率提高了24.99%,方差降低了76.23%,总体攻击效果提升了42.07%,充分验证了基于决策边界长度的攻击距离度量方法的有效性,验证了攻击组筛选的有效性。

本文所提出的算法1与算法2是以图像识别领域为例,但均不局限于图像识别领域。这是因为:算法1的适用前提有2个:①分类器模型的输入样本可以测量样本间距离;②可以在样本附近进行高斯采样。如果这2个前提条件能够满足,那么算法1很容易复现,如语音识别领域的语音向量、恶意代码识别的代码向量[33]等。算法2基于算法1,没有任何额外的限制,因此本文提出的方法是适用于所有领域的分类器。同时,本文所提出的方法适用于所有对抗样本生成方法的攻击组选取。这是由于算法1与算法2的设计不局限于任何对抗样本生成方法,并在对比实验中证实了所提方法对多种对抗样本生成方法有效。

4 结 论

1)针对攻击组间攻击难度不同导致攻击不稳定的问题,本文以图像识别领域为例,设计了基于决策边界长度的攻击距离度量方法,为攻击组的攻击难度提供了度量方法。

2)设计了基于攻击距离的对抗样本攻击组筛选方法,筛去难以攻击的攻击组。通过预处理,提升现有算法的攻击效率和攻击稳定性。

3)实验表明,筛选后的攻击组相比于筛选前,攻击效率提升了24.99%,方差降低了76.23%,总体攻击效果提升了42.07%。

4)建议所有利用攻击组的对抗样本生成方法,先进行攻击组的筛选,特别是对原始样本进行筛选,再展开攻击,以稳定攻击的效果。

为了更加清晰筛选对于攻击组的意义,笔者将会继续研究原始样本对于整个优化过程的意义。