基于HSV色彩空间的红外与可见光图像融合方法

2021-12-28胡锦昊王明昊夏天扬王悦行杜海静徐传刚

胡锦昊,王明昊,夏天扬,王悦行,杜海静,徐传刚

(1.南开大学人工智能学院,天津 300350;2.天津津航技术物理研究所,天津 300308)

0 引 言

导弹打击目标时,需要捕控手根据导弹导引头所传回的图像信息选择实施打击的位置。可见光图像具有丰富的亮度及纹理信息,能保留物体的色彩及轮廓,通过人眼观察即可获得图像所包含的大部分信息,如物体的尺寸和位置。因此,通常情况下仅使用可见光图像就能找到目标并实施打击。但如果作战时的光照条件受限或目标进行伪装,此时仅使用可见光图像将不利于捕控手准确识别目标,需要结合其他传感器所获取的信息进行综合判断[1]。红外相机可以根据热辐射差异区分目标与背景,这使得红外图像具有更强的抗干扰能力和穿透性[2]。但红外图像分辨率低,仅能得到目标大致的轮廓而丢失了大部分的背景信息[3]。由于需要获得目标周围的环境信息,因此无法直接使用红外图像进行目标识别。因此,可以将可见光图像及红外图像按一定的方式进行图像融合,使得融合图像在具有可见光的色彩纹理信息的同时又能具备较好的目标指示能力。红外-可见光图像双光融合,正是从像素级对两种图像进行融合的技术,对于实施针对军事目标的跟踪和打击以及对非军事目标的识别和追踪等都具有重要的意义。

由于结构简单、原理清晰,RGB 色彩空间系统成为计算机中应用最广泛的色彩系统。目前,许多双光融合算法采用了基于RGB 色彩空间系统模型。文献[4]提出基于各向异性扩散(anisotropic diffusion fusion,ADF)的方法,将原始图像分解为基础层和细节层,经过Karhunen-Loeve 变换后再进行线性叠加,最终组合得到融合图像,算法易于实现、融合后的损失小,但最终的视觉效果并不理想。文献[5]和文献[6]分别提出基于卷积神经网络(convolutional neural networks,CNN)和基于残差神经网络(ResNet)的方法,搭建卷积神经网络和残差神经网络,通过大量的训练优化参数进而融合图像,融合图像的性能指标较优,但需要构建数据集、消耗大量时间来训练耗时较长。文献[7]提出基于梯度转移融合(gradient transfer fusion,GTF)的方法,先构建了目标函数,通过迭代求解目标函数,使得融合后的图像更接近红外图像,并且保留了更多的外观信息,其优势在于融合后的视觉效果好,但由于需要迭代求解,算法无法达到实时处理的要求。文献[8]基于潜在低秩表示(latent low-rank representation,LatLRR)的方法,先对原始图像进行分解得到低秩部分和显著部分,再用两种不同的策略进行融合,最后重建得到图像,该算法融合结果的评价指标较优,但其视觉效果不是非常理想。为了满足红外武器系统精准打击目标的任务需求,融合后的图像应首先具备较好的视觉效果,能满足人眼对图像的识别要求;其次应尽可能保证融合后图像中目标、背景的信息不被丢失。但由于人眼无法直接根据红、绿、蓝三种颜色的比例来区分物体,且RGB 系统各个通道之间相关性高,难以进行分离从而进行独立分析,这使得RGB 系统融合图像的视觉效果不是十分理想。

相比于RGB 系统,HSV 色彩空间系统的构建是基于人类对色彩的生理感知,将色彩的亮度分离,而色调和饱和度与人类感知相适应,从而使它在图像处理领域中具有很高的应用价值[9]。因此,出于对视觉效果的考虑,本文提出了两种基于HSV色彩空间系统的红外-可见光双光图像融合算法,并在MATLAB R2021a环境下对其进行了仿真测试及对比。

1 本文算法介绍

1.1 HSV模型原理

HSV 模型中,颜色的3个参数分别为色调(hue)、饱和度(saturation)和明度(value),明度又称为亮度(brightness)。色调表示色彩信息,即所处的光谱颜色的位置;饱和度表示色彩的鲜艳程度;亮度表示色彩的明亮程度。HSV 模型的各通道之间具有较强的独立性,便于分通道对图像进行处理。相比RGB色彩模型,HSV 模型更接近人类对彩色的感知经验,可以直观地表达颜色的色调、鲜艳程度和明暗程度,方便人眼进行颜色感知。

1.2 融合算法流程

1.2.1 灰度红外-可见光融合

本文提出自适应HSV(adaptive hue-saturationvalue,AHSV)双光融合算法,该算法先将可见光与红外图像转换到HSV模型下,将红外图像的灰度映射到融合图像的H 和S 通道;然后根据红外图像与可见光图像不同区域的亮度进行加权融合,从而获得HSV模型下的融合图像;最后再转换到RGB 空间进行显示。算法流程如图1所示。具体流程如下。

图1 灰度红外-可见光融合算法流程Fig.1 Gray infrared-visible light fusion algorithm flow

1)将可见光与红外图像转换到HSV 模型下。由于红外图像为单通道图像,故将图像进行扩充,将单通道图像复制并拷贝到其余两个通道使之扩充为三通道图像。利用文献[10]中提出的基于色域变换对的算法进行转换,该算法将RGB 图像的红、绿和蓝色值分别通过判断赋值后转换为HSV图像的色调、饱和度和明度值,最终得到HSV 空间下的红外与可见光图像。

2)根据红外图像的灰度,利用式(1)映射到融合图像的H通道

式中:H(i,j)表示融合图像H 通道上某像素点的色调值;fIR(i,j)为红外图像fIR上某像素的灰度值;i、j为该像素的行和列;fIRmax、fIRmin表示红外图像像素灰度的最大值和最小值。

3)将红外图像的灰度利用高斯函数映射到融合图像的S通道

式中:S(i,j)表示融合图像S 通道上某像素的饱和度值;k为饱和系数;σ为高斯函数的标准差。k和σ的取值会影响图像的整体饱和度。k值过大会影响图像的视觉效果,一般k取0.2 到1.5 之间,本文取k=0.5;σ取1到3之间,本文取σ=2.5。

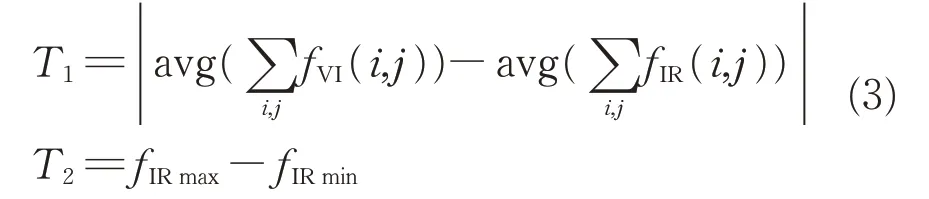

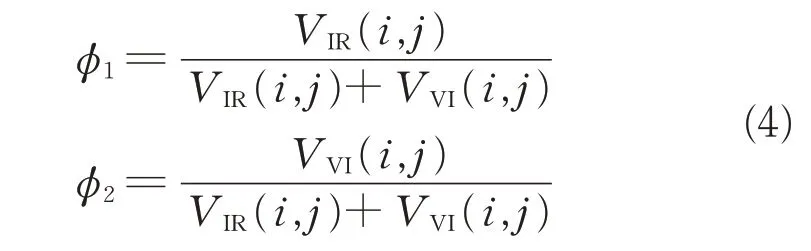

4)根据可见光与红外图像亮度的差值,采用双阈值方法进行判断得到图像的融合系数,最后相加得到融合图像V 通道的值。考虑转换图像的V 通道,设可见光与红外图像上某像素V 通道的取值分别为VVI(i,j)和VIR(i,j),阈值为T1和T2(T1<T2),红外与可见光的融合系数分别为ϕ1和ϕ2。根据图像信息计算阈值T1和T2

式中:fVI(i,j)为可见光图像fVI上某像素的灰度值。若当:

(1)|VIR(i,j)-VVI(i,j)|<T1时,可见光与红外图像的亮度差异不大,取

(2)T1≤|VIR(i,j)-VVI(i,j)|≤T2时,可见光与红外图像存在一定的亮度差异,取

(3)|VIR(i,j)-VVI(i,j)|>T2时,可见光与红外图像存在较大亮度差异,主要对应图像上部分区域光照过强使得目标被光线遮盖的情况,如:车灯过亮,产生光晕遮挡车身。为尽可能削弱光线对目标的遮挡效果,使得目标能显露出来以便观察者观察,取

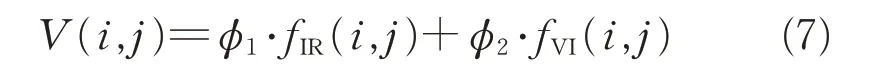

融合图像该像素点的亮度最终确定为

5)利用文献[11]中所述方法将HSV 模型下的融合图像映射到RGB色彩模型下,显示融合图像结果。

1.2.2 伪色彩红外-可见光融合

红外图像通常是灰度图像,而可见光图像则是彩色图像。如果将可见光图像直接灰度化后与红外图像融合,则会使可见光带有的颜色等信息丢失。本文提出伪彩色编码HSV(pseudo-color coding huesaturation-value,PCCHSV)双光融合算法,采取的策略是:先对红外图像进行伪彩色编码,然后将编码后的伪彩色红外图像映射到HSV色彩空间;再按照红外图像的原始灰度值与彩色可见光图像进行HSV 模型下的融合,从而达到保留可见光丰富信息的目的。算法流程如图2所示。

图2 伪彩色红外-可见光融合算法流程Fig.2 Pseudo color infrared-visible light fusion algorithm flow

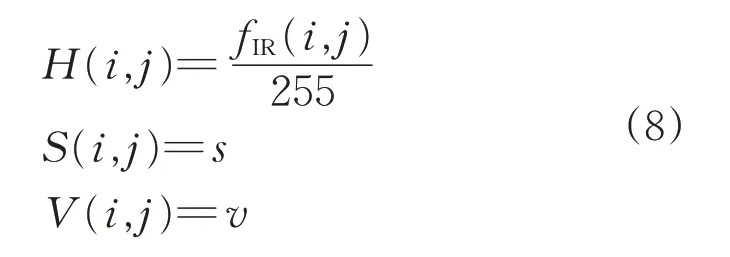

首先,对红外图像按式(8)进行HSV 模型伪彩色编码。

式中:s和v是两个常数,分别影响图像的饱和程度与明暗程度。经过调试图像的亮度和饱和度,为保证图像视觉效果,取

随后将可见光通过矩阵映射到HSV 模型下,与HSV 模型下的伪彩色红外图像进行色调和饱和度通道映射

式中:H(i,j)和S(i,j)分别表示融合图像上某点的色调值和饱和度值;fIR表示红外图像上某点的灰度值;fIRmax和fIRmin分别表示红外图像灰度值的最大和最小值;kH和kS是色调常数和饱和度常数,分别影响图像色调和饱和度。

对融合图像,当kH<0.2时,图像整体呈现红色;当0.2≤kH<0.3 时,图像整体呈现黄色;当0.3≤kH<0.9时,图像整体呈现绿色;当kH≥0.9时,图像高亮度处出现蓝紫色。一般地,图像为橙黄色和黄绿色时,最有利于人眼对目标的识别。kS越大,融合图像对暗处信息越敏感,kS取值一般在5 到110 之间。本文取kH=0.2、kS=100。

对于亮度通道融合映射,设T为融合阈值,μ为融合系数。则有

式中:T为经验值,本文取T=100。

融合图像上某点的亮度灰度值由式(13)确定。

式中:τ为暗信息值,一般取1到5之间的整数,τ的取值与融合图像对暗处信息的还原程度有关,本文取τ=2。

2 实验结果与分析

2.1 实验组设置

本文融合图像对比评测基于可见光与红外图像融合基准(visible and infrared image fusion benchmark,VIFB)[11],采用统一的性能评价平台。挑选了6 组比较有代表性的红外和可见光图像,来模拟各类场景下的目标识别任务,如图3所示。

图3 实验所使用的双光图像Fig.3 Visible and infrared images used in the experiment

测试图像分别针对:夜间光源对目标的遮盖问题(组1);夜间图像融合后细节保留问题(组2);高亮环境中阴影中的红外特征目标提取问题(组3);雪天高亮反光和低温环境红外图像融合问题(组4);夜间整体图像细节的协调处理问题(组5);可见光图像信息部分缺失问题(组6)。

为验证本文方法的有效性,选用5 种图像融合算法进行对比测试。它们分别是:基于各向异性扩散(ADF)的方法[4];基于卷积神经网络(CNN)的方法[5];基于残差神经网络(ResNet)的方法[6];基于梯度转移融合(GTF)的方法[7];基于潜在低秩表示(LatLRR)的方法[8]。CNN 和ResNet 选用了已训练好的模型进行测试,各方法使用参数均与对应论文原文保持一致。

本文所用方法的设置参数如下所示。

1)AHSV 方法:饱和系数k=0.5;高斯函数标准差σ=2.5。

2)PCCHSV 方法:色调系数kH=0.2;饱和系数kS=100;融合阈值T=100;暗信息值系数τ=2。

2.2 实验评价指标

融合图像质量评测分为主观评测与客观评测两部分。主观评测即目视效果评测,是图像融合效果最直接的评价方法,需要由人对红外与可见光图像及它们对应的融合图像进行比对,判断图像保真度、细节丰富度等指标。由于本文算法侧重于满足人眼对目标识别的要求,故以主观评测的结果为判断融合图像质量的主要依据。

客观评测需要针对融合图像的各项性能指标进行对比。本文选择了信息熵(EN)、互信息(MI)、峰值信噪比(PSNR)、结构相似性(SSIM)进行效果评价。信息熵表征图像所含信息量的多少;互信息描述图像之间的相关性和冗余性;峰值信噪比基于融合图像与原图像对应像素的误差来衡量融合图像的质量;结构相似性从亮度、对比度、结构3个方面度量图像相似性。

2.3 融合图像结果分析

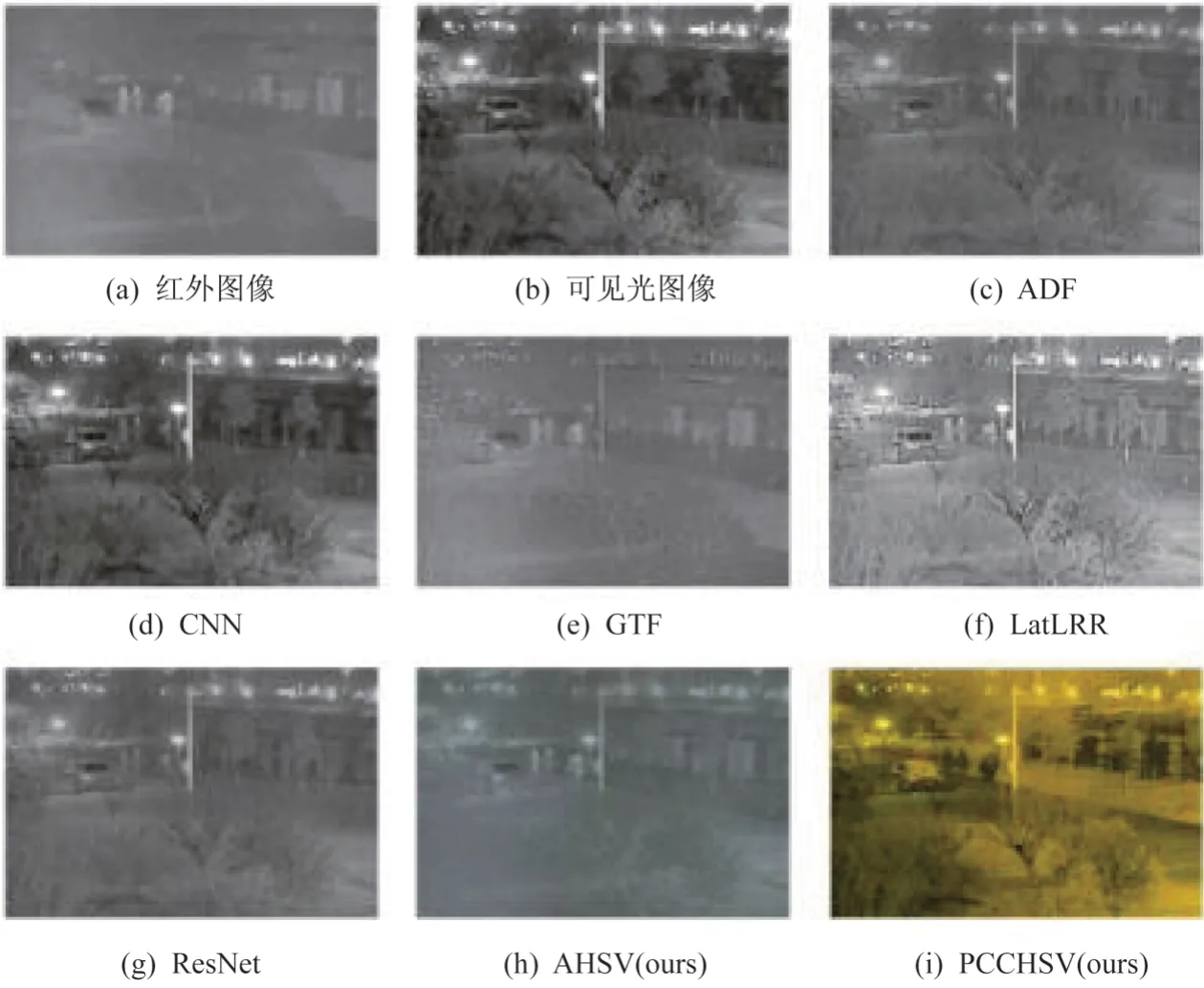

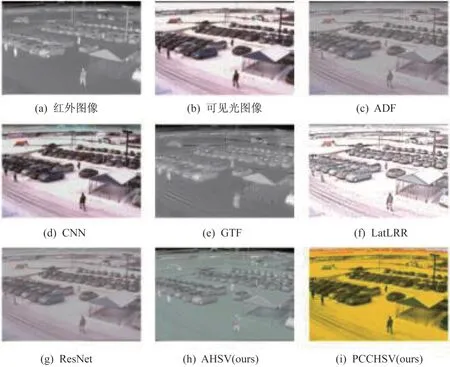

将各算法得到的融合图像进行整合,直观地对比图像质量和视觉效果。生成图像整合结果如图4~9所示。

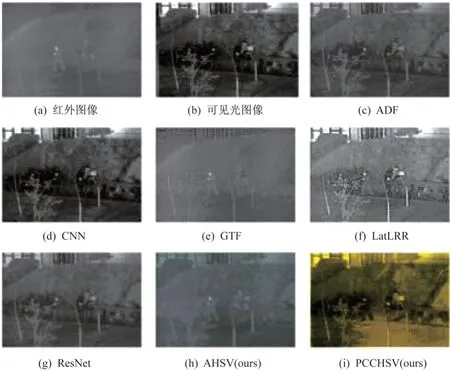

由图4 和图5 可以看出:CNN、ResNet 和LatLRR算法难以应对高亮光源干扰,GTF算法可以避免强光干扰,但背景环境中的信息损失较大;本文提出的两种融合方法不仅能有效地处理强光干扰情况,还能很好地还原背景信息。

图4 夜间高光遮蔽融合结果Fig.4 Fusion results of highlight masking at night

图5 图像细节保留融合结果Fig.5 Fusion results of image detail preservation

在图6 和图7 的日间场景的图像融合中,本文的两种方法均实现了对红外特征目标的突出显示,便于在较亮的场景中找到目标的位置。并且,使用伪彩色编码的PCCHSV算法在日间环境能有效应对阴影,可用于去除伪影。

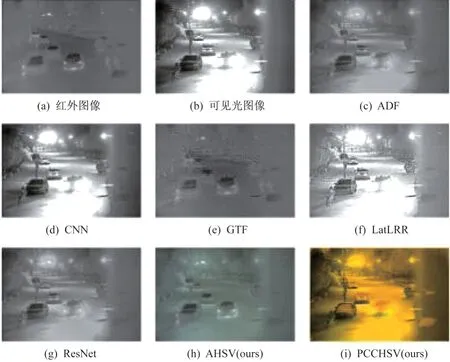

图6 阴影中目标提取融合结果Fig.6 Fusion results of target extraction in shadow

图7 雪天反光与低温环境图像融合结果Fig.7 Fusion results of snow reflection and low temperature environment images

在图8 中,GTF 和CNN 算法没有将所有目标都很好地突出显示出来,而本文算法在凸显人物的同时也还原了图片中的背景细节。在图9 中,CNN 和LatLRR 算法未去除光源干扰,可见光图像右侧部分信息缺失,本文算法有效利用了红外图像的信息,实现了对缺失部分真实情况的还原。

图8 夜间图像细节的协调处理融合结果Fig.8 Fusion results of image detail coordination processing at night

图9 图像信息部分缺失融合结果Fig.9 Fusion results of partial loss of image information

在客观评测中,综合各对照算法的图像性能指标,生成对照图,如图10所示。4种指标大小与融合图像质量均为正相关。PCCHSV 算法由于像素值与原图差异较大,且与AHSV 方法原理类似,故仅使用AHSV 算法融合图像与其他算法图像进行性能指标对比。由图10可知:本文算法在峰值信噪比和结构相似性方面均位于领先位置,与最优方法结果差距在3%以内;在互信息方面,低于CNN与ResNet算法,考虑到训练成本和时间消耗,该性能差距可以接受;在信息熵方面表现一般,具有进一步改进的空间。

图10 客观评测结果Fig.10 Objective evaluation results

综合主观评测与客观评测结果,本文算法很大程度上解决了各场景中由于亮度差异、图像不同部分处理不均匀导致目标信息丢失的问题,具有一定的视觉效果优势。

通过本文算法获得的融合图像更便于人眼观察,可满足通过观察者观察图像进行目标追踪等任务的要求。由本文两种算法在不同场景下的实验结果可以看出:AHSV算法在处理夜间场景时的目视细节留存度更高,适用于处理环境亮度较低的、需要场景信息整体协调的融合任务;PCCHSV算法处理白天场景的效果更佳,伪彩色编码使得目标的轮廓更为突出,适用于处理高亮环境下对特定目标的识别跟踪任务。

3 结束语

针对夜间红外与可见光融合视觉效果不佳,导致目标检测效果差的问题,本文提出了一种基于HSV色彩系统的红外-可见光双光融合算法。该算法首先将红外图像灰度图以及红外图像伪彩色编码图映射到HSV模型上;再分别从色调、饱和度与亮度这三个通道建立与HSV空间中可见光图像三通道的对应关系,建立融合模型;最后通过色彩模型变换,将图像转换到RGB空间,获得AHSV与PCCHSV两种方法在RGB空间下的融合图像。综合主观测评与客观测评结果可知,与其他双光融合算法相比,本文算法得到的融合图像在结构相似性与互信息方面有一定优势;在图像视觉效果方面,本文算法的图像融合质量有较大的提高,尤其在细节保留与干扰去除方面具有一定的优势。