改进YOLOv3的快速遥感机场区域目标检测

2021-11-12韩永赛马时平何林远李承昊朱明明

韩永赛,马时平,何林远,李承昊,朱明明,张 飞

(1.空军工程大学 航空工程学院,陕西 西安 710038;2.空军工程大学 研究生院,陕西 西安 710038)

目标检测目前为计算机视觉和数字图像处理的一个热门方向。它被用于机器自主识别所需要被检测的目标,对减少人力资源的消耗有着重要意义[1]。而随着卫星遥感图像的分辨率越来越高,其蕴含的信息量也越来越大,促进了遥感检测的大跨步发展。同时机场因为其军用和民用的特殊意义,成为了目标检测领域研究的“宠儿”。如何从大数据量、高分辨率的遥感图像中快速、精确地检测出机场以及机场内典型目标,具有很大的现实意义。

许多人员对这一问题进行了深入的研究,并做出了具有一定价值的贡献。基于传统的方法有:文献[2]等提出了线段检测器与支持向量机相结合的方法,先对图像进行边缘检测,然后用线段检测器提取直线,利用机场的细长直线特征来检测机场。文献[3]等提出了Hough变换与支持向量机相结合的方法,在对图像进行边缘检测后,进行Hough变换来提取直线,同样利用机场的细长直线特征来进行机场的分类。它们的检测速度快、算法复杂度低,但是却极易受到周围形似物的干扰,如同样具有细长直线特征的长公路以及海岸线等,因此检测率偏低。文献[4]等结合视觉显著性和特征对称性的方法对飞机类目标进行分类和定位。文献[5]等基于稀疏编码和约束池化相结合的方法进行飞机类目标特征的表达,进而进行后续的分类和定位任务。此类方法的检测精度较高,但是较为依赖人工特征的设计,特征的鲁棒性不高,模型的泛化能力偏弱。随着深度学习的发展,基于卷积神经网络的目标检测逐渐成为该领域的“标配”[6]。文献[7]等基于机场线性分布的先验知识来进行更为合理的区域建议,并结合迁移学习的思想进行有限样本下的卷积神经网络训练来提取深层特征进行机场检测。文献[8]从几何与局部显著性相结合的显著图上建议感兴趣区域,并利用残差网络确定感兴趣区域进行机场分类检测等。上述方法都发挥了卷积神经网络强大的特征提取能力,但普遍采用遍历滑动窗口法来进行检测有很大的时间复杂度,达不到快速检测的标准。针对此类问题,以更快的区域卷积神经网络(Faster Region Convotutional Neural Network,Faster R-CNN)[9]系列为代表的“两步法”和以YOLO[10]系列为代表的“一步法”检测网络逐渐成为目标检测领域的主流网络,并对各式检测任务做出了巨大的贡献,取得了很好的检测效果。在这两类代表网络的基础上,文献[11]使用迁移学习结合难分样本挖掘的方法针对机场的检测进行了改进。文献[12]结合卷积神经网络与显著性特性对机场目标的检测进行了改进。文献[13]在检测网络基础上提出了视觉显著性指导的红外与可见光图像的融合算法。上述方法通过在网络上进行改进,更好地发挥了网络的性能,获得了较高的目标检测率。但众多实验多是对单类目标的检测,同时在检测率与检测时间的权衡方面还有待提高。

该文由大范围遥感机场区域目标快速精确检测任务出发,以一种快速和准确的实时对象检测算法,(You Only Look Once,YOLOv3)[14]网络为基础检测网络,自主构建了复杂背景、小目标、多目标、不同视角下的含有机场区域六类典型目标的遥感图像数据集,并针对具体任务做出了部分改进。主要创新点如下:

(1)由遥感机场区域目标检测任务出发,构建了一个更加符合任务的,包含六类典型目标(机场、民航飞机、战斗机、直升机、运输机、油罐)的较为完备的遥感数据集,为模型在训练过程中得到更多的深层次区分性特征,从而获得更好的预测能力奠定了基础。

(2)相比传统的硬采样均衡样本分布问题以及数据增强方法,应用生成对抗网络实现数据增强,来补充用于训练的数据集,从数据集本身进行样本分布均衡,并降低采集样本的开发成本。

(3)采用改进的特征融合部件DWFPN来进行更加鲁棒的特征融合以及更加精确的末端检测。

1 基于YOLOv3的机场区域目标检测原理与改进

1.1 遥感机场区域目标检测原理

针对遥感机场区域目标检测任务,文献[15]从Google Earth上截取的相关遥感监测图相比不同的遥感监测器已有较好的分辨率特性以及泛化性能,因此在遥感机场区域目标检测任务中,以从Google Earth上针对不同机场区域、不用拍摄高度、不同拍摄视角得到的包含所需检测目标的遥感图片作为输入,将改进的YOLOv3网络作为检测器,通过训练得到相关知识模型,并输出带有精确位置信息以及类别示意的检测图。其原理示意如图1所示。

图1 遥感机场区域目标检测原理示意图

1.2 数据集的构建

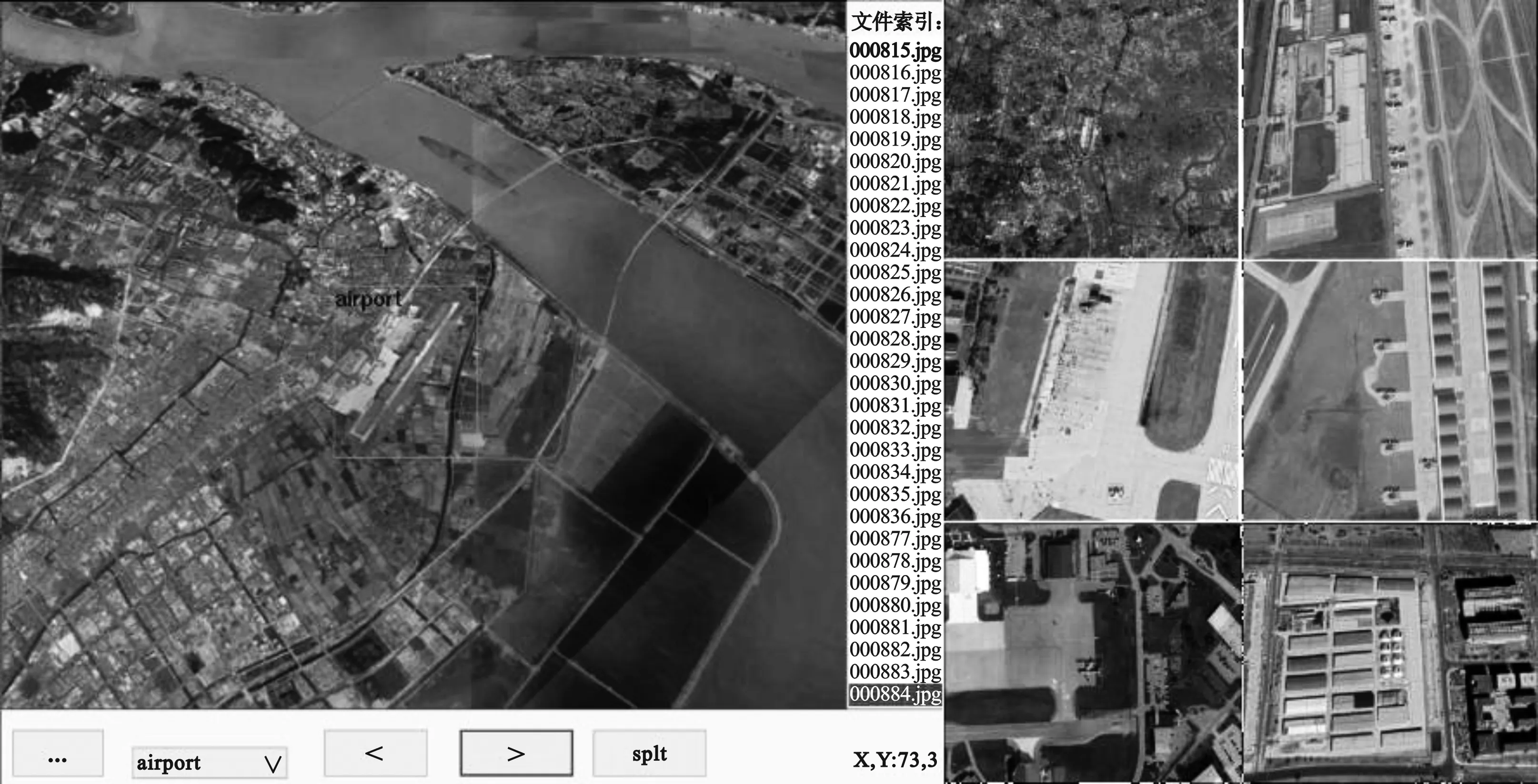

目前公开的用于遥感机场区域目标检测任务的数据集较少或较小,尚不足以训练一个泛化性很强的特定任务网络,因此需要人为构建一个用于训练的较为完备的数据集。为了方便网络的训练,以VOC2007[16]数据集格式进行数据集的构建工作,通过应用Google Earth Pro软件从不同卫星拍摄高度、不同视角分别对近200个机场区域进行了图像采集,每个机场区域根据其实际包含的目标分布,分别采集了10~50张不等的图像。最终形成的原始数据集包含6 681张含有各类目标的有效图片,其中含有各类目标的图片数量如表1所示。目标与标签对应关系如表2所示。数据集示意如图2所示。

表1 原始数据集各类目标对应图片数量汇总表

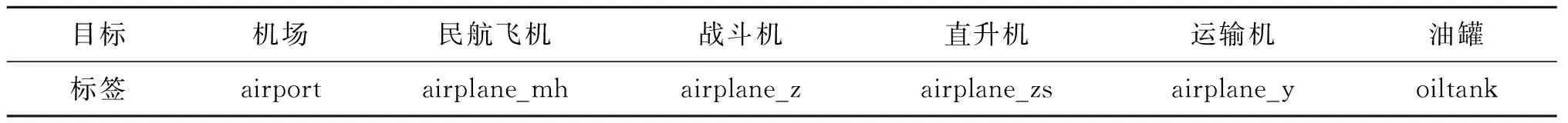

表2 目标—标签对应表

图2 数据集示意图

标签示例如图3所示。

图3 标签示意图

1.3 YOLOv3网络以及改进

1.3.1 YOLOv3网络

YOLOv3是“一步法”的代表作。它可以依托众多主流框架,其中该文使用的为darknet框架,本框架没有任何依赖项,易于安装与移植,结构清晰简明,并提供python接口,可在python环境下运行YOLOv3模型,并且易于更改模型参数以及结构。其算法框架如图4所示,其中Concatenate代表特征图拼接操作。

图4 YOLOv3算法框架图

图4中各层对应的参数如表3所示。

表3 层级参数对照表

YOLOv3采用“全局检测”策略进行目标检测,而不再是由众多分组步骤组成的检测系统,它可以直接学习到图像的全局信息并做回归预测,因此它的检测速度非常快。它通过将整幅图片分成S×S个预测网格,然后对每个预测网格都预测B个预测框,并预测每个预测框的N个类别的概率,然后计算出每个网格中预测框的置信度得分,采用非极大值抑制算法选出置信度得分最高的预测框来实现目标的粗定位与分类,再利用损失函数训练对各类误差进行极小值寻优,最终完成对目标的精确定位与分类。通常各式检测算法只是选取最后一层卷积特征图来进行预测。显而易见,最后一层卷积特征图尺度通常会很小,对小目标的表征能力很弱,算法很难从其中学到区分性的特征,因此这样会使得算法对小目标不敏感,对小目标的检测能力偏弱。针对这个问题,YOLOv3的多尺度预测(如图4所示)显得尤能可贵,其主要在13×13、26×26和 52×52三种特征图尺度上进行预测,进而很好地解决了一步检测网络颗粒度粗、对小目标检测能力差的问题。其训练损失函数可表示为

Ltotal=lxy+lwh+lconf+lclass,

(1)

(2)

(3)

(4)

(5)

其中,

M(a,b,c,d)=(a-c)2+(b-d)2,

(6)

B(a,b)=alog(b)+(1-a)log(1-b) ,

(7)

1.3.2 网络的改进

针对数据侧,该文通过生成的方法来对传统的硬采样改善类别不平衡问题的思路进行改进,使用生成对抗网络来进行数据集中少类目标的扩充来优化类间数据分布不平衡问题。

传统的硬采样思路通过设置正负样本的比例来主要改善前景和后景的数量不平衡问题。此方法一般不对前景进行采样操作,而对后景进行随机或条件随机(如重新制定负样本阈值)欠采样,可以在一定程度上缓解前景与后景间的类别不平衡问题。

其中生成对抗网络[17]是一种二人零和博弈模型,其思想如下:通过构建一个深度神经网络组成的生成器以及判别器的对抗系统,使得生成器可以生成越来越真的目标样本。文中使用的生成对抗网络框架示意如图5所示。

图5 该文使用的生成对抗网络框架示意图

其判别器以及生成器的训练目标函数如下:

(8)

(9)

αy=Ey=tr[logD(y)] ,

(10)

βy=Ey=G(x)[log(1-D(y))] ,

(11)

其中,αy为当输入为真实图像时,判别器的输出期望值;βy为当输入为生成图像时,判别器的输出期望值。

从式(8)可以看出,判别器的优化目标为提高鉴别能力;从式(9)可以看出,生成器的优化目标为使得判别器的鉴别能力尽可能低。两者相互对抗,当达到纳什均衡时达到最终的优化目标。

文中生成对抗网络的训练步骤如下:

(1)在进行训练时,参照目标检测网络的预训练模式,沿用模型迁移学习[18]的方法,使用已在ImageNet训练过的网络参数初始化生成对抗网络的训练权重,以达到更快更好的收敛效果。

(2)在进行每一轮判别器判别训练前,先对生成样本以及真实样本进行批归一化至[-1,1],以消除奇异样本带来的不良影响,同时保持生成样本和真实样本数据在同一量纲。

(3)训练中判别器判别的噪声作为“知识”进入生成器继续训练。

(4)各类目标图片的生成权重比为:机场∶民航飞机∶战斗机∶直升机∶运输机∶油罐=0.45∶0.05∶0.24∶0.08∶0.15∶0.03。

应用生成对抗网络进行数据增强的优点如下:

(1)通过生成对抗网络强大的学习推理能力,可以重新生成新的前景样本,在改善前景与后景类别不平衡的同时,可以通过设置合理的生成图片数量权重来改善前景不同目标间的类别不平衡问题。

(2)生成对抗网络在生成新样本时,可以引入完全不同的样本背景,使得生成的样本更具多样性,有助于网络后续提取更具区分力以及领域不变性的特征,提高检测任务的稳定性。

(3)生成的方法将大大减少收集数据等构建数据集时人力资源的消耗,极大提高训练准备工作的效率。

构建新型特征融合检测网络DWFPN以进行更加鲁棒的特征融合,使得网络提取到深层次区分性特征,进一步提高网络的分类以及定位能力。

YOLOv3网络的末端检测部分如图4所示,因为残差块1和2的特征尺寸较大,所包含的语义信息不足,所以网络应用残差块3、4、5进行特征融合,并用于后续检测。这样可以使得在进行检测时用到网络各层级提取的融合特征,尤其对于小目标检测的提升效果最好,因为其应用了3个残差块卷积得到的融合特征进行检测,在保留较强的分辨率信息的同时,融合了最高层很强的语义信息。然而由图4也可以看出,进行中目标检测时其未很好地融合残差块3的特征信息,同时进行大目标检测时未进行特征融合,同时进行融合的部分权重设置也是相同的,未进行较为细致的融合权重设置。基于此,文中提出如图6所示DWFPN改进融合方式,以更好地进行残差块提取特征之间的融合。图6中Sofcmax为分类函数,Conv代表进行卷积操作,Concat代表进行特征图拼接操作,maxpooling、Stride表示最大值池化的步长。

图6 DWFPN结构示意图

则融合特征公式如下:

(12)

(13)

(14)

(15)

2 实验以及结果分析

2.1 实验环境以及参数设置

(1)实验环境:服务器系统ubuntu 14.06,GPU GTX 1060Ti,RAM 16 GB。

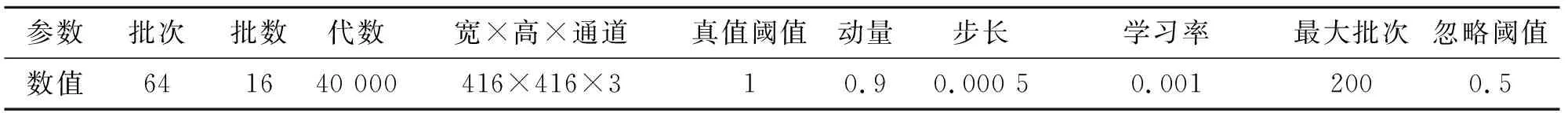

(2)参数设置见表4。

表4 参数设置表

用K均值聚类算法对构建的数据集内数据进行锚框的聚类初始化结果如下:

(13,15);(23,14);(13,32);(34,36);(68,33);(56,120);(180,92);(210,304);(342,380)。

2.2 针对改进部分的结果分析

在相同的实验环境以及参数设置下,进行改进前后的对比实验(其中YOLOv3的基础网络选用相比原网络中Darknet-53对特征表达能力更强的密集连接结构DenseNet[19],且沿用模型迁移学习的方法,用imagenet_models对网络进行预训练)。实验结果如表5~7所示,其中T1代表已使用生成对抗网络,T2代表已使用DWFPN。

表5 改进前后检测性能(AP)对比汇总表

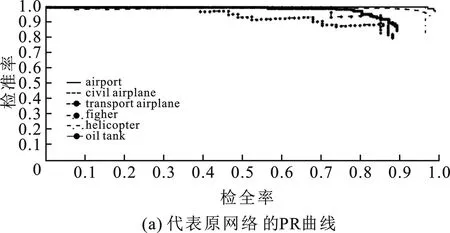

可视化Precision-Recall曲线如图7所示。

图7 PR曲线示意图

表5实验结果显示,改进网络相比原网络增加了4.98%的多类目标平均检测精度以及8.33%的平均交并比,证明了改进网络取得了更好的分类以及定位效果。同时根据检测PR曲线可以得到,改进网络的曲线更加贴近上坐标轴,各目标的PR曲线与Precision和Recall坐标轴正向所包围的面积更大,表明改进网络在平衡检测精确率以及检全率方面有了更好的性能。同时构建的原始数据集中搜集到的战斗机、直升机以及运输机的图片较少,且每张相关图片所包含的目标数较少,通常为1~8个有效目标。因此,在通过生成对抗网络进行重点数据增强扩充操作后,结合DWFPN末端检测网络使得平均检测精度值有了较大的提升,增量分别达到了9.31%、8.97%、6.51%。通过实验证明了改进网络的有效性。同时,通过表6、表7可以得到,改进网络相比原网络平均降低了4.99%的漏警概率以及4.97%的虚警概率,分别达到了5.94%的平均漏警概率以及11.95%的平均虚警概率,由此证明了改进网络针对各个待检测的目标的漏警以及虚警问题都得到了一定的改善,并取得了较低的漏警和虚警概率。证明了改进网络针对机场区域目标检测任务中性能的整体提高。

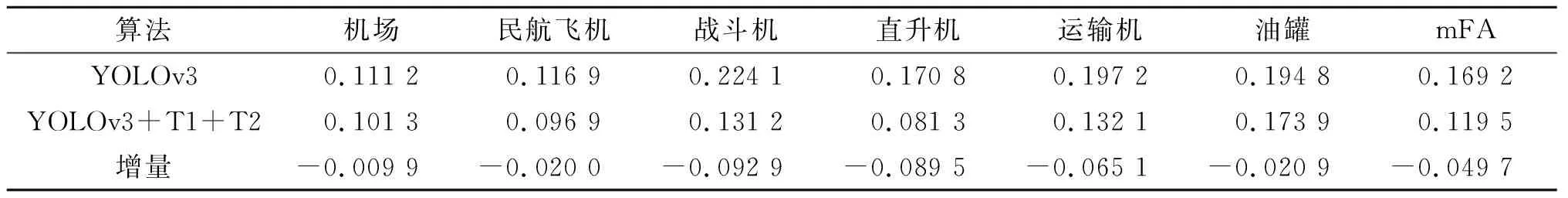

表6 改进前后漏警概率(MA)对比汇总表

表7 改进前后虚警概率(FA)对比汇总表

2.3 可视化检测结果示意

图8给出了可视化检测的结果。其中图(K-1)表示YOLOv3网络的检测结果,图(K-2)以及图(9)、(10)、(11)表示改进网络在相同实验环境下的检测结果,K=1,2,…,8。从检测图例可以直观地看出,改进网络对6类机场区域典型目标都有较好的检测效果,主要表现在分类准确度高以及定位框与真实目标的贴合度高。通过对比图(1-1)、(1-2),(2-1)、(2-2),(4-1)、(4-2)和图(7-1)、(7-2)可以得出,改进网络对小目标的检测有更好的检全率以及更低的误检率,主要表现在改进网络对原网络将图(1-1)左下角类似形状物检测为民航飞机进行了修正,以及对图(2-1)左侧、图(4-1)左侧和右侧以及图(7-1)漏检的目标进行了检全,这主要得益于DWFPN检测器的自下而上融合特征时的权重矩阵组的设置,使得图像特征尤其是边缘特征在进行方向传播时,可以进行对应权重加强(相对正样本)或减弱(相对负样本),加强了融合的效果使特征更加鲁棒。对比图(3-1)、(3-2),(5-1)、(5-2)和(6-1)、(6-2)可以得出,改进网络对大、中目标进行了更加精确的定位,表现在最终的定位框与真实目标的边界贴合度的提高,主要得益于DWFPN检测器自下而上进行更好的特征融合以及后续自上而下进行特征融合时引入了更好的分辨率特征信息。对比图(8-1)和(8-2)可以得出,改进网络相比原网络有更好的泛化性能,可以在一定程度上检测特殊背景、特殊形状的机场,这主要得益于生成对抗网络对样本的生成扩充以及DWFPN较强的融合深层次可区分性特征的能力。

图8 可视化结果示意图

2.4 对比实验

使用高度一致的实验环境以及共享参数用该文数据集对目前主流的目标检测算法进行对比实验,实验结果如表8所示。

表8 不同目标检测网络对比实验结果汇总表

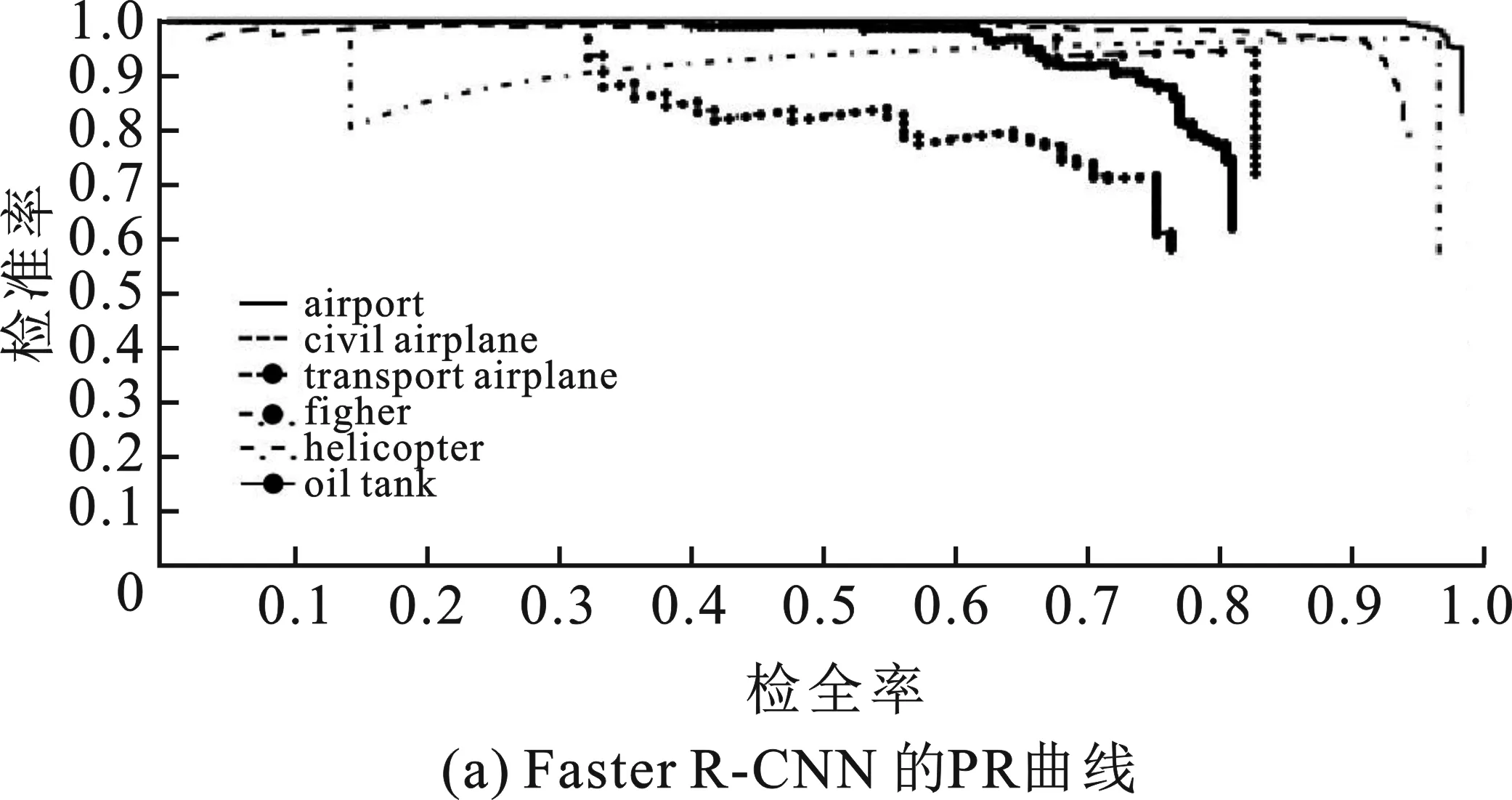

对比网络的可视化Precision-Recall曲线如图9所示。通过对比实验表明,改进网络在检测精确率方面相比目前几大主流网络取得了较大的提升,基本达到了与RetinaNet-101[20]持平的多类目标检测精确率,相比Faster R-CNN、R-FCN[21]、DSSD[22]分别提高了11.73%、6.05%、7.82%。相比YOLOv3原网络,改进网络提高了4.98%的多类目标平均检测精确率。同时,由于原YOLOv3网络出色的一步回归全局检测设计,使得改进网络在平均检测时间方面也保留了较为突出的性能,达到了0.062 5 s的平均检测时间。相比原网络增加了0.004 3 s的时间成本,主要为在网络的改进中增加了自下而上融合过程中的权重矩阵组以及自上而下融合的过程,所以相比原网络增加了少许检测时间,但依旧保持了较高的检测速度。其检测速度相比Faster R-CNN、R-FCN、DSSD平均提速约1.9倍,比RetinaNet-101提速约5.3倍。

图9 PR曲线示意图

3 结束语

在快速遥感机场区域目标精确检测任务中,通过使用生成对抗网络对原始数据集进行针对性扩充以及在YOLOv3快速检测神经网络中加入改进的DWFPN特征融合检测部件,改进网络实现了数据集中类别目标数据之间较为均衡的分布以及深层次可区分的更加鲁棒特征的融合提取,在仅增加少许检测时间的基础上为模型带来了4.98%的多类目标平均检测精确率以及8.33%的平均交并比的提升,达到了89.07%的多类目标平均检测精确率以及61.97%的平均交并比,且平均检测时间为0.062 5 s,相比部分目前主流检测网络取得了较好的检测效果,表明了改进网络针对快速遥感机场区域目标精确检测任务有较大的实际意义。在下一步的工作中,将着眼于多模态的特征融合以及进一步提高网络的检测性能研究。