AlexNet网络的井下钻杆打钻动作识别

2021-11-05安徽理工大学宗占强

安徽理工大学 宗占强

由于目前煤矿井下钻杆计数效率低下且极易出错,因此本文提出一种基于AlexNet网络煤矿井下钻杆打钻动作识别的方法。本文对原AlexNet网络的拓扑结构和参数进行修改、调整,并通过MATLAB进行仿真实验对比,最终确定其最优的拓扑结构和参数。通过实验发现,神经网络深度为2层,卷积核个数为16,卷积核大小为5*5,步长为2,激活函数为Relu,学习率为0.001,最大学习整个数据集的次数为5,调整后的AlexNet网络模型分类检测平均准确率可达99.37%。

本文提出一种基于AlexNet网络的井下钻杆打钻动作识别的方法。目前利用神经网络,实现井下钻杆计数的研究颇多。如党伟超等提出基于利用三维卷积神经网络模型对探水作业中的卸杆动作进行识别和高瑞等提出基于改进ResNet网络的井下钻杆计数方法,主要是通过训练后的神经网络,对视频中的每一帧图像的动作类型进行识别,从而实现井下钻杆的计数。与其相比,本文是对AlexNet网络进行改进,并且本文网络准确率更高,本文分类识别的平均准确率为99.37%,而党伟超等提出基于3DCNN网络的煤矿探水动作识别的最高准确率为98.86%,高瑞等提出基于改进ResNet网络的井下钻杆计数方法分类检测准确率为89%,钻杆计数精度为97%。

1 基于卷积神经网络的井下钻杆打钻动作识别系统

近年来,神经网络得到飞速发展,并在图像处理领域得到广泛应用。目前,较为经典的神经网络模型有Lecun等在1998年提出的LeNet模型。Krizhevsky等在2012年提出的AlexNet模型。Simonyan等在2014年提出的VGG模型。Szegedy等在2015年提出的GoogleNet模型。与VGG模型、GoogleNet模型和ResNet模型相比AlexNet网络模型网络结构简单,计算参数较少,训练时间较短。因此,本文选取的是AlexNet网络模型。

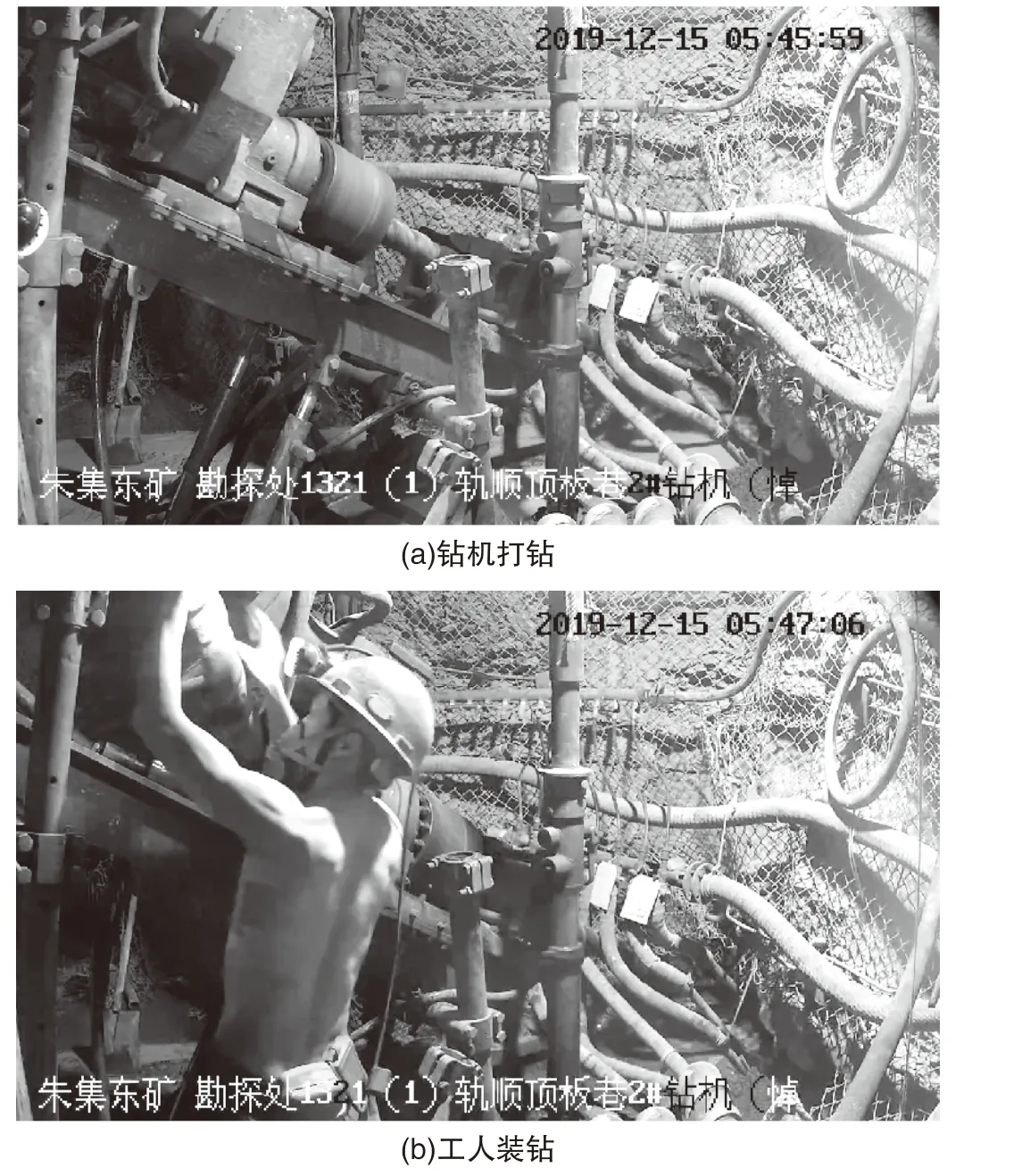

本文基于改进AlexNet网络的井下钻杆打钻动作识别系统步骤如下:1)首先根据淮南矿业集团提供的一段朱集东矿井下钻机打钻视频,本文生成了大约20000多张图像。随后根据这些图像的图像特征,人为的分为钻机打钻动作和工人装钻动作如图1所示。然后从中选取钻机打钻部分图像和工人装钻部分图像各9000幅作为数据集,其中训练集各为7500幅,测试集各为1500幅。2)接着将分类好的图像交给神经网络进行训练,并保存训练好后的网络。3)然后利用已经训练好的网络来识别打钻的动作。

图1 煤矿井下钻杆打钻动作分类

2 神经网络模型

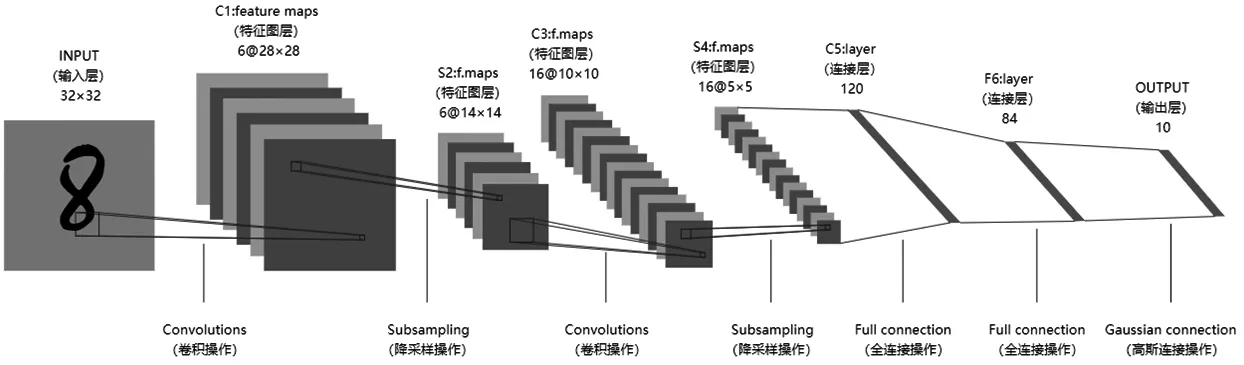

AlexNet模型由输入层、卷积层、归一化层、池化层、激活函数、全连接层、分类层组成。前五层是卷积层和池化层,后三层是全连接的层,每个卷积层都包含激励函数ReLU和局部响应规范化(LRN)处理,需要进行下采样(池)处理。具体结构组成见图2所示。

图2 AlexNet网络结构图

2.1 输入层

卷积网络的输入一般情况下是一个矩阵,可以是原始或者预处理后的像素矩阵。本文的输入是一个预处理后的32*32的像素矩阵。

2.2 卷积层

卷积层由多个特征面组成,每个特征面上有多个神经元。卷积层是通过卷积核和输入图像进行卷积运算,从而提取图像的特征,每一个卷积核通过一次卷积运算并通过一个激活函数后,可以得到一张特征图。本文神经网络卷积层中卷积核大小为5×5,卷积核个数为16,步长为2,经过卷积运算后,得到的特征图大小为15×15,个数为16。

2.3 归一化层

Ioffe等针对神经网络中数据分布不一致的问题提出一种正则化的方法——批量归一化。批量归一化的实质是一种预处理操作,也就是对神经网络中上一层的特征输出进行归一化处理,然后再作为下一层的输入。归一化层的作用是防止梯度爆炸和梯度消失,减少计算时间,提高准确率。

2.4 池化层

池化层是将特征图分成若干块,将每一小块中的最大值或者平均值提取出来,从而组合成一幅新的特征图。对应的方法为最大池化和平均池化。池化层的目的主要是减少神经网络的计算量,并且通过特征压缩,提取主要特征。

其中,称为下采样层I的第j通道的净激活,它由前一层输出特征图进行下采样加权、偏置后得到,β是下采样层的权重系数,是下采样层的偏置项。

2.5 激活函数

激活函数的作用主要是将输出的特征图进行非线性映射,从而模拟更细微的变化。常见的激活函数有Relu函数、Sigmoid函数、Tanh函数、Softmax函数、Maxout函数等。本文采用的激活函数为Relu函数。该函数具有无梯度耗散的优点,并且计算量很小。其公式如式(4)所示:

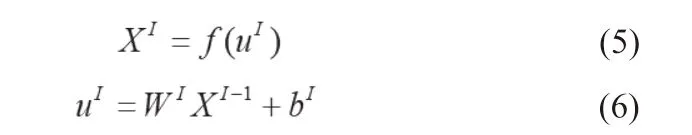

2.6 全连接层

全连接层一般处于神经网络的末端,它是将之前经过多轮卷积池化后得到的二维特征图,拼接成一维特征图作为网络的输入。

其中,uI称为全连接层I的净激活,它由前一层输出特征图X I-1进行加权和偏置后得到的。W I是全连接网络的权重系数,b I是全连接层I的偏置项。

3 实验过程及结果

本文是在AlexNet模型的基础上,对AlexNet模型进行改进。而卷积核个数和神经网络深度对神经网络准确率的影响较大。因此,为了确定卷积核个数和神经网络深度。本文对不同的卷积核个数和不同的神经网络深度,利用MATLAB进行仿真实验,对比它们的训练时间以及准确率。

首先本文选用的图像大小为32*32,卷积核大小为5*5,步长为2,激活函数为Relu,学习率为0.001,最大学习整个数据集的次数为5。训练集为7500张,测试集为1500张。

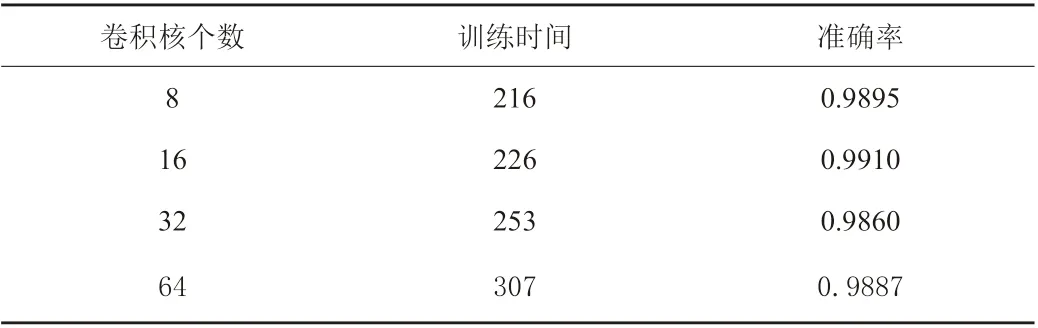

3.1 不同的卷积核个数对准确率及训练时间的分析

首先将网络神经网络深度设计为一层,然后对卷积核个数分别为8、16、32、64进行仿真实验。其准确率和训练时间如表1所示。

表1 不同卷积核个数的准确率及训练时间

由表1可知,随着卷积核个数的增加,所需的训练时间也相应的增加。当卷积核个数为16时,准确率最高,并且训练时间相对较短。因此本文选取卷积核个数为16。

3.2 不同的神经网络深度对准确率及训练时间的分析

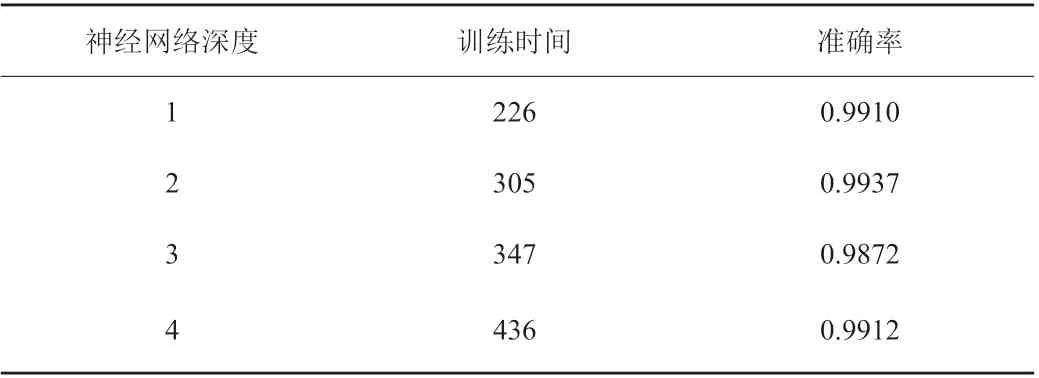

在确定池化层中卷积核个数为16的情况下,依次对神经网络为1、2、3、4层时进行仿真实验。其准确率和训练时间如表2所示。

由表2可知,随着网络深度的增加,其训练时间会大幅增加,而神经网络的深度对本文的准确率影响相对较小,且当神经网络深度为2层时准确率最高,因此本文的神经网络深度最终确定为2层。

表2 不同神经网络深度的准确率及训练时间

3.3 训练过程

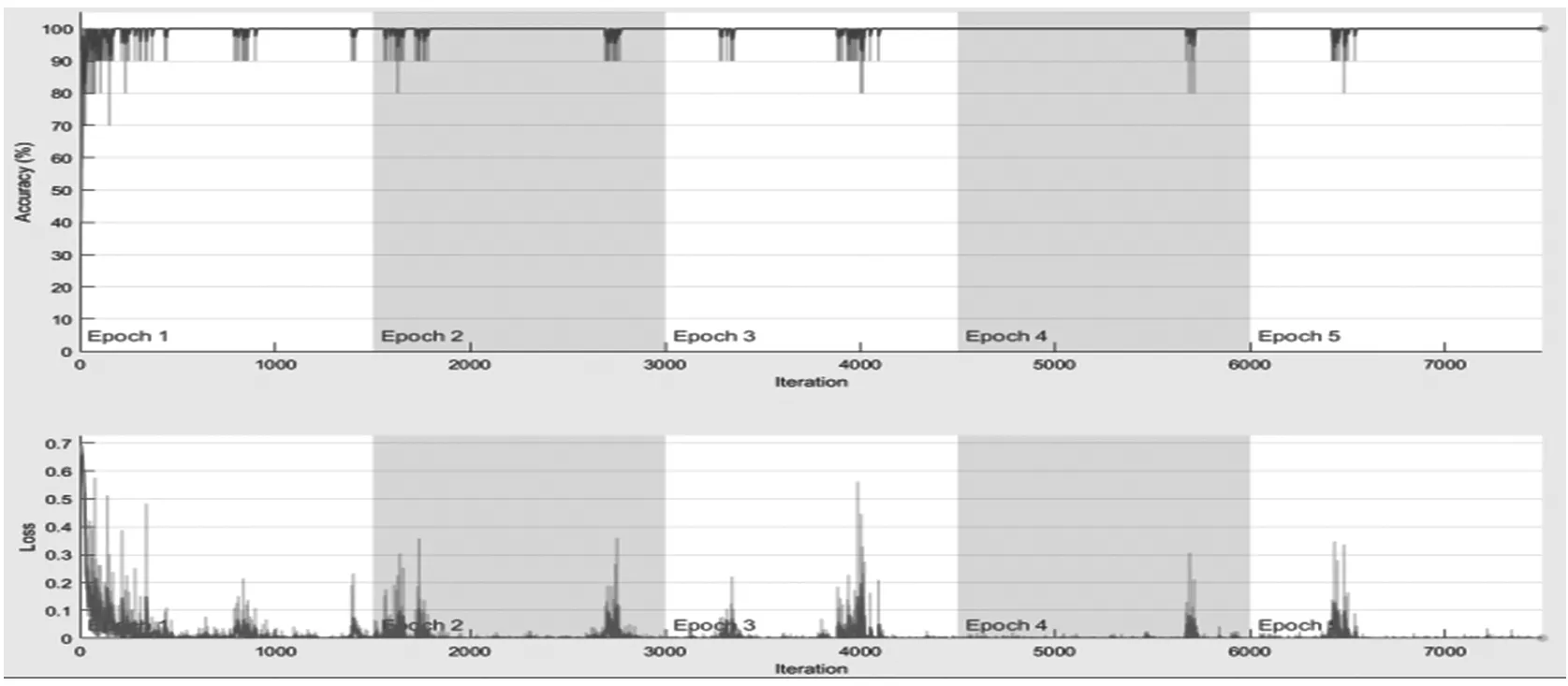

本文神经网络训练过程如图3所示。

图3 神经网络训练过程图

从图3可以看出,本文神经网络训练过程准确率基本稳定在100%。因为迭代次数比较大,中间偶尔会出现波动,但也基本稳定在90%~100%。因此,本文的神经网络比较稳定。

3.4 实验结果及分析

为了测试本文神经网络的有效性,本文从剩余的数据集中随机地选取100张图片进行测试。图4所示是部分测试结果。

图4 神经网络识别结果图

图4中黑色字体表示钻机实际的打钻动作,蓝色字体表示本文神经网络判断的打钻动作。从图中我们可以看出,本文神经网络判断的打钻动作和钻机实际的打钻动作完全一致。因此,证明本文的神经网络确实有效。

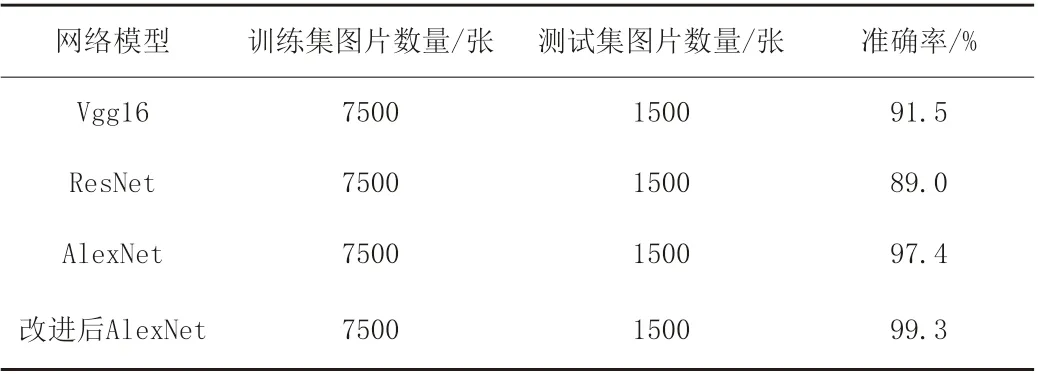

随后本文有对不同的神经网络模型进行仿真实验,其结果如表3所示。

表3 不同神经网络模型的准确率

由表3可知Vgg16和ResNet因为网络深度较深,产生了梯度爆炸,因此准确率相对较低。而本文改进后的AlexNet神经网络则避免了梯度爆炸,因此准确率较高。

本文是在AlexNet模型的基础上,对AlexNet模型进行改进。通过对不同的卷积核个数以及不同的神经网络深度利用MATLAB进行仿真实验,最终确定卷积核个数为16,神经网络深度为2层,最终的准确率为99.37%。并且和其他人的模型相比,本文的准确率更高、训练时间更短。