基于密集连接自逆生成对抗网络的MR 图像生成方法

2021-09-20陈春晓李东升陈志颖

傅 雪,陈春晓,李东升,陈志颖

(南京航空航天大学自动化学院,南京 211106)

引 言

随着医学成像技术的不断发展,计算机断层成像(Computed tomography,CT)、正电子发射断层成像、磁共振成像(Magnetic resonance imaging,MRI)和超声成像等广泛应用于临床诊断、手术导航及术后监测等各个领域。不同的成像方式可以得到不同的病理学特征,结合多模态的医学图像可以更好地帮助医生进行精准的临床诊断和科研人员进行相关课题的研究。然而,完备的多模态图像样本的收集是一个长期而艰巨的任务,某些模态医学图像样本的缺失会阻碍相关课题的研究。近年来,基于深度学习的图像处理技术为丰富医学图像数据提供了新的途径[1]。

生成对抗网络(Generative adversarial networks,GAN)[2]是近年来图像处理领域里一个热门的研究方向。GAN 可以通过学习真实图像的数据分布来生成逼近真实图像的虚拟图像,目前已在图像生成[3]、图像增强[4⁃5]、图像分割[6]和图像超分辨率重构[7]等应用方向取得较大进展。基于GAN 的图像生成技术为医学图像获取困难与数据缺失的问题带来了新的解决方案[8]。Nie 等[9]采用卷积网络作为生成器的GAN 模型可以从MRI 图像生成CT 图像;Wolterink 等[10]提出了一种基于循环对抗生成网络(Cycle generative adversarial networks,CycleGAN)[11]的模型,避开了传统GAN 模型对训练数据必须配对的要求,使用没有配对的MRI 与CT 图像实现了不同模态医学图像间的转换;Shen 等[12]利用自逆的循环对抗生成网络实现了多种标签与图像及图像与图像间的转换,利用生成对抗网络生成虚拟样本,可缓解不同模态医学图像缺失的问题。

在医学图像中,MRI 图像由于其非侵入性的特点及可以清晰地显示组织结构的能力而成为临床医学中应用最广泛的医学影像之一,但MRI 成像时间长且成本较高。因此,学者们进行了许多基于GAN的核磁共振图像生成技术的研究[13⁃15]。针对部分公开数据库中MRI 的T1 加权像或T2 加权像缺失的问题,本文在自逆的循环生成网络基础上,通过对生成器的结构进行优化,研究了MRI 图像中的T1 与T2 图像之间的互相转换和生成模型。该模型可以得到高质量的虚拟样本供后续的研究和实验使用。

1 方 法

1.1 CycleGAN 算法

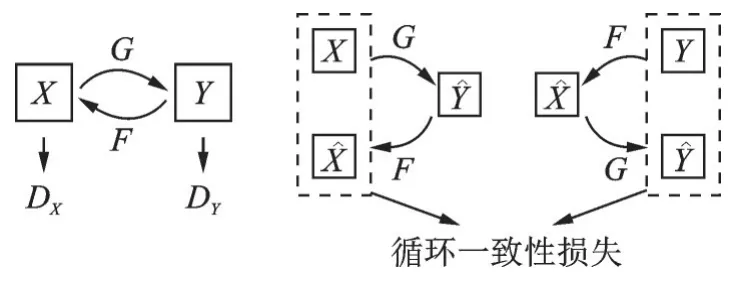

生成对抗网络是Goodfellow 等于2014年提出的一种生成式模型。原始GAN 模型由1 个生成器和1 个判别器构成。生成器通过学习真实样本的数据分布来生成逼近真实样本的虚拟样本,判别器则用来判断生成的虚拟样本是否可以以假乱真。生成器与判别器相互制衡,并在对抗的过程中不断优化,最终目的是让生成器生成出让判别器判定为是真实样本的虚拟样本。基于GAN 模型的循环对抗生成网络则是通过增加1 个生成器和1 个判别器,并引入循环一致性损失概念建立的一种新的模型,其结构流程图如图1所示。

图1 CycleGAN 模型结构及运行流程图Fig.1 Architecture and operation flow chart of CycleGAN model

由图1 可以看出CycleGAN 的算法流程为:生成器G(F)将真实样本X(Y)转换为虚拟样本,生成器F(G)再将刚刚生成的虚拟样本转换为虚拟样本,最后计算间的误差即为循环一致性损失。通过引入循环一致性误差,使得CycleGAN 可以使用没有配对的样本进行训练,以完成风格迁移等任务。

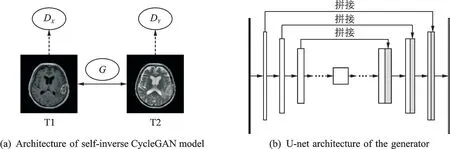

1.2 自逆的CycleGAN 算法

不同于CycleGAN 使用两个单向的生成器G和F,自逆的One2One CycleGAN[12]仅使用一个生成器就能够实现双向的图像到图像的转换任务,其模型结构如图2(a)所示。模型的生成器部分则采用了U⁃net[16]结构,如图2(b)所示。

图2 自逆的CycleGAN 模型及其生成器结构示意图Fig.2 Self-inverse CycleGAN model and architecture of its generator

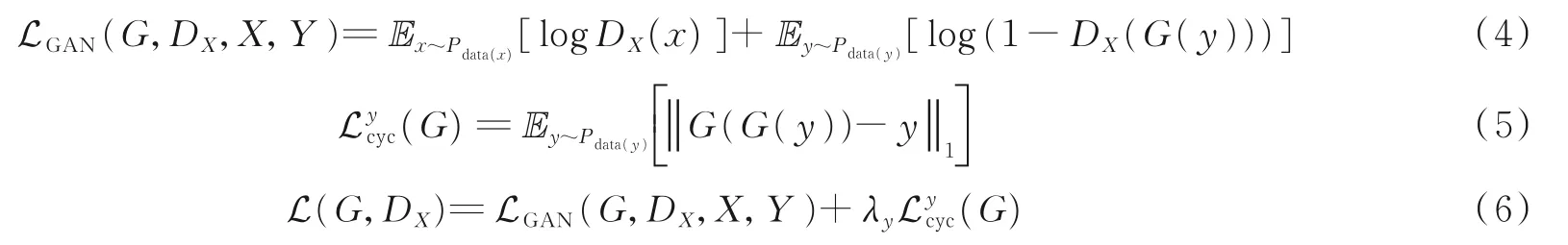

One2One CycleGAN 有两个独立的损失函数分别对应于两个数据图像传输方向。对于生成器G:T1→T2 及其鉴别器DY,最终的目标函数为

对于生成器G:T2→T1 及其鉴别器DX,最终的目标函数为

式中:LGAN为传统GAN 模型的损失函数,Lcyc为CycleGAN 特有的循环一致性损失函数。通过对总的损失函数求解minimax 优化问题,就可以得到符合要求的生成器G与鉴别器DX和DY。One2One Cycle⁃GAN 模型由于仅使用一个生成器,相当于自动地将样本量增加了一倍,使其在双向循环的过程中可以学习到更多的特征,在最终合成图像时还原出更丰富的细节特征。

1.3 改进的One2One CycleGAN 算法

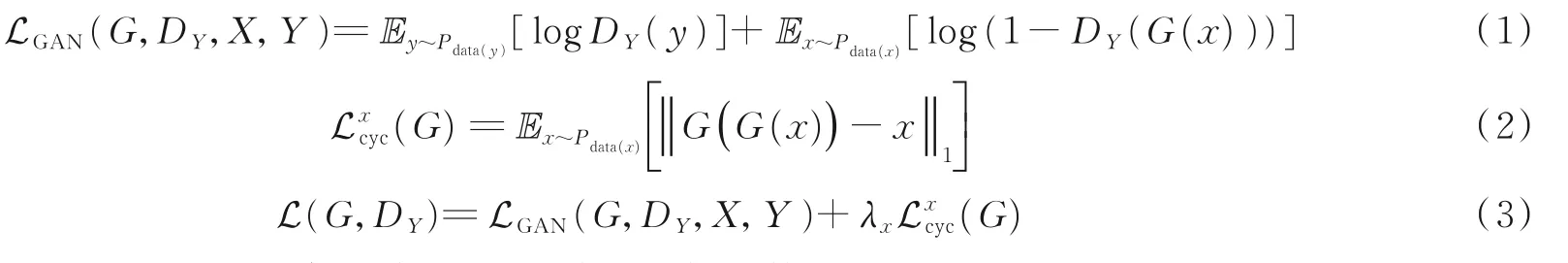

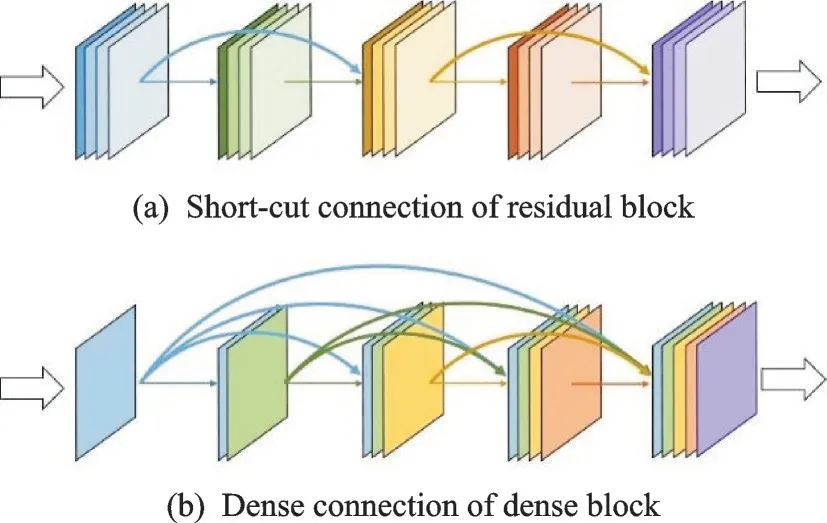

一般情况下,医学图像语义较为简单、结构较为固定,并且高分辨率信息和低分辨率信息同样重要。One2One CycleGAN 模型中的生成器为U⁃net 结构,适用于小样本量的医学图像,并且通过将低分辨率信息与高分辨率信息使用跳跃连接的方式进行融合,可以一定程度上改善上采样时信息不足的问题,但仍会因为某些特征丢失导致最终生成的虚拟样本出现纹理重复或伪影等。近年来,残差网络ResNet[17]的残差块结构及密集连接网络[18]的密集连接块结构是解决特征提取数量不足问题的常用方法。若将U⁃net 网络中用作提取特征的卷积层替换为残差块,可以通过其特有的短路连接机制加深高级特征与低级特征的联系,一定程度上提高生成图像的质量。与残差块相比,密集连接块能更直观地将前后不同程度的高低级别特征紧密地联系到一起,可以使模型学习到更加丰富的特征,从而使最终合成的虚拟样本更加接近真实图像。图3 展示了残差块的短路连接机制和密集连接块的密集连接机制。

图3 密集连接块与残差块结构对比Fig.3 Architecture comparison between dense block and residual block

在密集连接块中,每一层都接收来自所有前层的特征,网络的结构可以更薄更紧凑并且误差可以更直接地传播到更早的层中,可以做到对整个网络的学习过程进行更深层次的监督。因此,本文在U⁃net框架下引入了密集连接块,重新搭建了基于密集连接块的生成器DenseU⁃net 结构。DenseU⁃net 结构不仅可以充分地利用底层特征,将高分辨率信息和低分辨率信息充分融合,同时还能降低模型参数量,使模型的学习更高效。

此外,本文在生成器模型的输出层添加了ReLU激活函数,并将最终输出图像中输出结果大于1 的像素点置1,使输出结果更接近真实样本的数据分布。

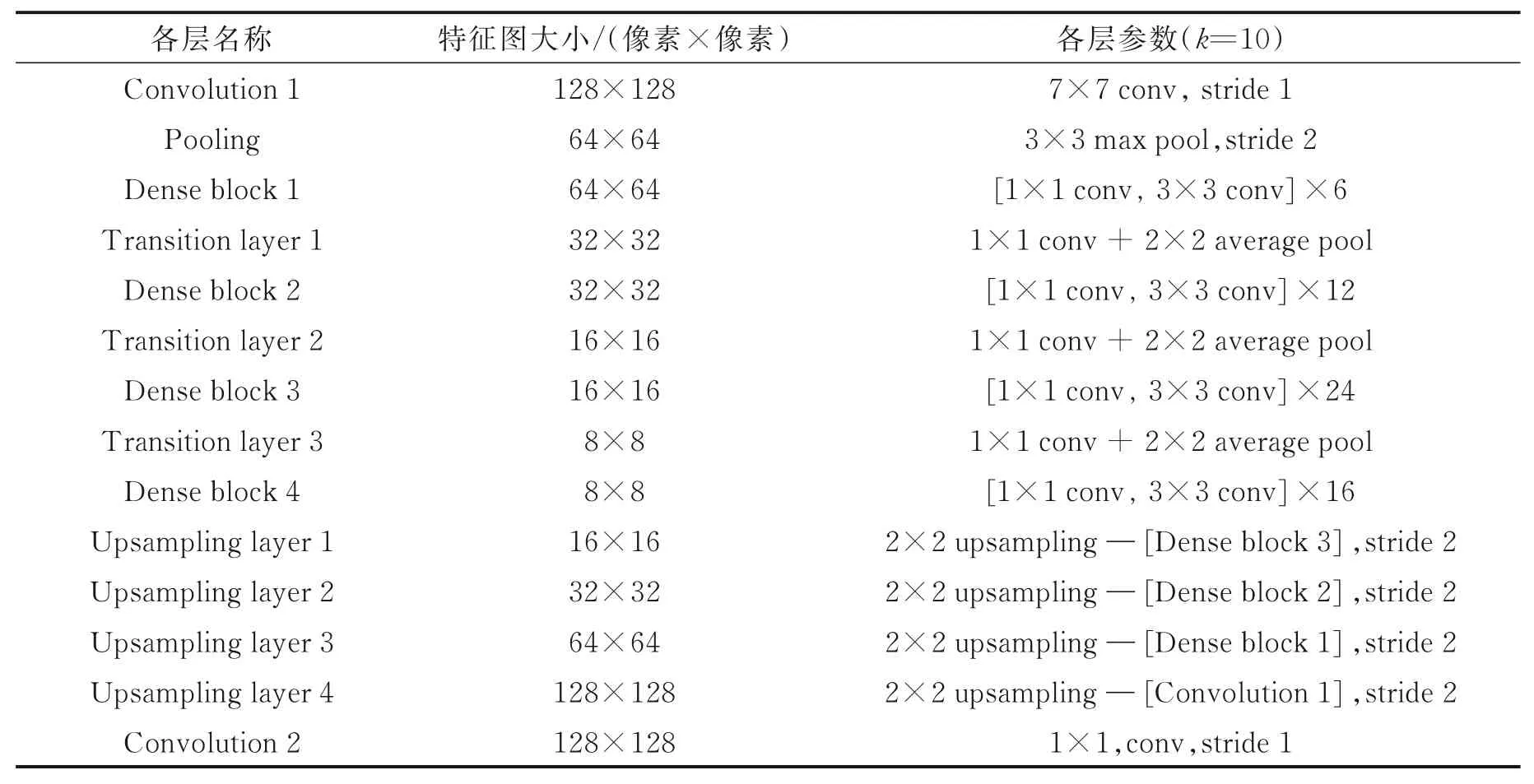

1.4 实验样本及模型参数设定

本次实验采用的是BraTS 2018 数据库[19⁃21]中的脑胶质瘤病人的T1 加权与T2 加权图像样本。从数据库中随机挑选13 203 张患者图像作为训练样本,4 293 张患者图像作为测试样本。为减少图像中背景区域对最终生成结果的影响并受限于硬件设备,对原始图像的背景区域进行了剪裁并将图像缩小为128 像素×128 像素。改进的生成器模型结构参数如表1 所示。

表1 DenseUnet 生成器模型结构参数Table 1 Architecture parameters of the DenseUnet generator model

从表1 可以看出,本文所用到的生成器经过了4 次特征提取与4 次上采样过程,不但在下采样与上采样中间有低层特征与高层特征的跨越连接,在特征提取的每一个密集连接块中也有低层特征与高层特征的融合,充分挖掘了原始样本各层级的特征,力求生成的虚拟样本更加接近于真实样本。

本文采用峰值信噪比(Peak signal⁃to⁃noise ratio,PSNR)与结构相似性(Structural similarity,SSIM)作为评价生成图像质量的客观指标[22]。PSNR 是目前图像处理领域使用最广泛的一种客观评价指标,它基于两张图像像素点之间的误差进行计算;SSIM 通过比较两张图像的亮度、对比度及结构来判断两张图像是否相似。

2 实验结果

实验所用计算机的配置为Intel i5⁃8400 的CPU 和NVIDIA 1080 的GPU。训练时的批处理量为10,进行80 次完整迭代过程。

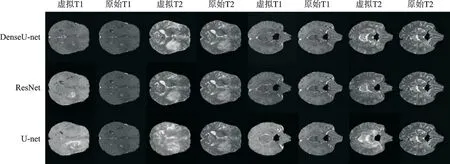

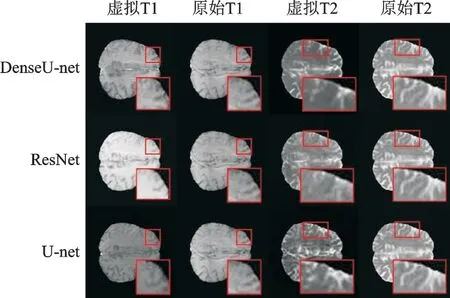

除了使用DenseU⁃net 作为生成器的结构基础外,还对比研究了目前流行的基于U⁃net 及ResNet 结构的生成器生成的图像结果。图4 分别展示了使用3 种结构生成器生成的部分实验结果。

图4 使用3 种不同结构生成器生成的部分T1 与T2 图像及原始图像Fig.4 Examples of generated T1 and T2 images and original images using three generators with different architectures

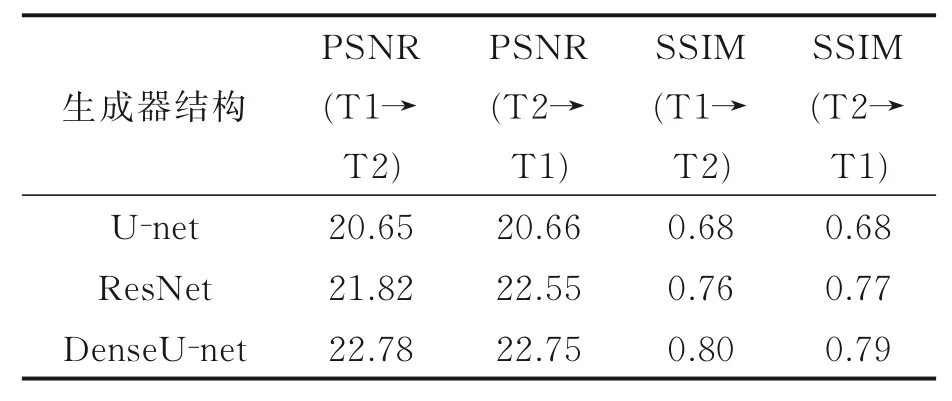

由图4 结果可以看出,使用DenseU⁃net 结构生成器生成的虚拟样本能更好地还原原始图像的轮廓、组织间不同的灰度值以及肿瘤的位置等信息,该方法合成的核磁共振医学图像具有一定的科研应用价值。表2 对这3 种结构生成器生成的图像结果进行了对比。

表2 使用3 种不同结构生成器生成图像的评价结果Table 2 Evaluation results of the generated images using three generators with different archi⁃tectures

一般来说,PSNR 超过20,SSIM 超过0.5,表明该图像处理方法具有一定的有效性。从图4 至图6 及表2 可以看出,本文提出的DenseU⁃net 生成的虚拟样本PSNR 超过了22,SSIM 接近0.8,明显高于另外两种方法。此外,使用DenseU⁃net 结构的生成器无论是生成的组织纹理还是生成的肿瘤区域都更接近原始图像。

3 讨 论

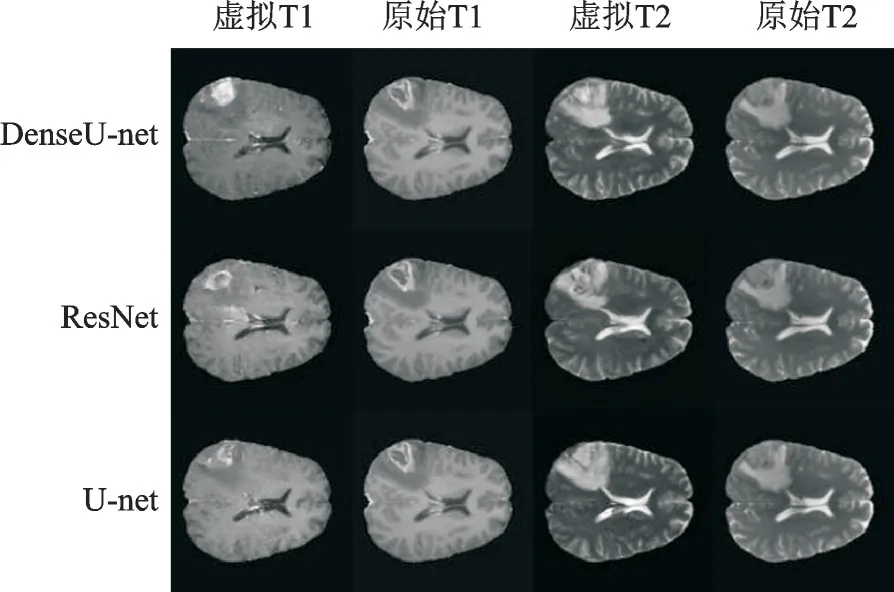

实验结果显示,无论是直接观察生成的图像,还是对比PSNR 与SSIM 两个指标都可以发现使用DenseU⁃net 结构生成器生成的图像质量更高。图5 给出了使用3 种结构生成器生成的无肿瘤T1 和T2图像细节对比。

如图5 所示,在轮廓方面,3 种结构生成的图像都很好地还原了大脑的轮廓,轮廓边缘平整光滑;从细节纹理特征来看,虽然3 种结构生成的图像都存在纹理不连续和极小纹理丢失的情况,但使用DenseU⁃net 结构生成器生成的图像细节纹理更加清晰,更接近真实图像。此外,图6 给出了使用3 种结构生成器生成的含有肿瘤T1 和T2 图像。

图5 3 种结构的生成器生成图像的细节对比Fig.5 Detail comparison of the generated images using three generators with different architectures

从图6 可以看出,使用DenseU⁃net 结构生成器生成的含肿瘤图像在3 种结构生成器的生成图像中可以更好地还原出肿瘤大小、位置、灰度及肿瘤周边组织的灰度等,但相比于不含肿瘤的图像来说,肿瘤区域的组织纹理特征在还原时存在的偏差更明显,这将是今后需要进一步改进的地方。

图6 3 种结构的生成器生成含肿瘤图像的结果对比Fig.6 Comparison of the generated tumor images using three generators with different architectures

此外,在生成器模型的输出层使用了ReLU 激活函数,并进行了阈值处理,使生成图像的像素值范围与进行归一化后的原始图像的像素值范围相同。但可能由于截断式的阈值处理方法过于生硬,导致一些细节纹理特征混淆或丢失。因此,在后续研究中还需要尝试更加平滑的阈值处理方法,或使用局部加权回归的损失函数来替代传统的全局回归损失函数。

4 结束语

针对数据集中磁共振T1 或T2 图像缺失的问题,本文提出了T1 与T2 图像相互转换和生成的模型。基于CycleGAN 的图像生成模型,将密集连接块引入One2One CycleGAN 的生成器结构,更好地整合了训练过程中产生的低级别和高级别的特征图,极大地丰富了模型学习到的特征种类与数量,使得最终的T1 与T2 加权图像的相互生成实验可以取得PSNR 与SSIM 分别为22.78 和0.8 的实验结果。实验结果表明,本文所提出的方法在医学图像生成领域具有一定的应用与研究价值。